La gestión de memoria es un aspecto fundamental de la programación, esencial para la estabilidad y el rendimiento de las aplicaciones. Entre los desafíos asociados con la gestión de memoria se encuentra el fenómeno de las fugas de memoria, que pueden degradar significativamente el rendimiento de una aplicación o incluso provocar su bloqueo. Este artículo profundiza en qué son las fugas de memoria, sus causas, cómo se pueden detectar y los métodos para prevenirlas. Además, incluye ejemplos prácticos de codificación y analiza cómo el uso de SMART TS XL Puede mejorar la detección, el análisis y la prevención de fugas de memoria a través de análisis estático avanzado, creación de diagramas de flujo y mejoras en la calidad del código.

¿NECESITA ARREGLAR FUGAS DE MEMORIA?

SMART TS XL es su solución ideal para detectar fugas de memoria en millones de líneas de código

Explora ahora¿Qué son las fugas de memoria?

Una pérdida de memoria ocurre cuando un programa asigna memoria del montón pero no la libera cuando ya no la necesita. Como resultado, el programa ya no utiliza la memoria, pero el sistema operativo u otros procesos no pueden recuperarla. Con el tiempo, estos bloques de memoria no liberados se acumulan, lo que reduce la cantidad de memoria disponible, lo que puede provocar una reducción del rendimiento y, finalmente, que el programa se bloquee si el sistema se queda sin memoria.

En lenguajes administrados como Java o C#, la administración de memoria la realiza el recolector de elementos no utilizados, que recupera automáticamente la memoria a la que ya no se hace referencia. Sin embargo, incluso en estos entornos, pueden producirse fugas de memoria si se sigue haciendo referencia a objetos de forma inadvertida, lo que impide que el recolector de elementos no utilizados libere la memoria.

Causas de las pérdidas de memoria

Las fugas de memoria se encuentran entre los problemas más generalizados e insidiosos en el desarrollo de software, ya que degradan silenciosamente el rendimiento y desestabilizan las aplicaciones con el tiempo. En esencia, las fugas de memoria ocurren cuando un programa asigna memoria, pero no la libera cuando los datos ya no son necesarios. A diferencia de los fallos o errores evidentes, las fugas suelen pasar desapercibidas durante las pruebas iniciales y solo se manifiestan tras un uso prolongado, cuando la aplicación se ralentiza o se cierra bruscamente debido al agotamiento de los recursos del sistema.

El impacto de las fugas de memoria puede variar desde pequeñas ineficiencias hasta fallos catastróficos, especialmente en sistemas de larga duración como servidores, dispositivos integrados o aplicaciones móviles. En casos extremos, las fugas pueden causar ralentizaciones en todo el sistema, obligando a los usuarios a reiniciar sus dispositivos o servicios para recuperar memoria. Incluso en lenguajes con recolección de basura como Java o Python, donde se espera que la gestión automática de memoria se encargue de la limpieza, pequeños errores de programación pueden provocar fugas debido a referencias persistentes o recursos sin cerrar.

Comprender las causas fundamentales de las fugas de memoria es esencial para desarrolladores de todos los niveles de experiencia. Ya sea que trabajen con lenguajes de bajo nivel como C++, que requieren gestión manual de memoria, o con lenguajes de alto nivel con recolección de elementos no utilizados, los programadores deben adoptar prácticas rigurosas para prevenir fugas. Este artículo explora las causas más comunes de las fugas de memoria, ofreciendo información sobre cómo se producen y estrategias para mitigarlas. Al reconocer estos problemas, los desarrolladores pueden escribir código más eficiente, fiable y fácil de mantener, garantizando así el óptimo rendimiento de sus aplicaciones durante todo su ciclo de vida.

Errores de gestión manual de memoria

En lenguajes como C y C++, la gestión de memoria es completamente manual. Esto significa que cada bloque de memoria asignada dinámicamente que utiliza malloc, calloc o new debe desasignarse explícitamente con free or deleteUna fuga de memoria ocurre cuando los desarrolladores olvidan liberar esta memoria cuando ya no es necesaria. Estas omisiones suelen deberse a flujos de control complejos, retornos anticipados o gestión de excepciones que omiten las llamadas de desasignación. Además de la omisión de desasignación, la reasignación incorrecta, como perder un puntero a la memoria asignada antes de liberarla, también genera memoria irrecuperable. Otro problema importante es el uso de punteros colgantes, que son referencias a memoria ya liberada. Esto puede provocar un comportamiento indefinido o fallos difíciles de diagnosticar. Los desarrolladores deben seguir una disciplina estricta y estándares de revisión de código al gestionar la memoria manualmente. Herramientas como Valgrind, AddressSanitizer y las comprobaciones integradas de Clang son esenciales para ayudar a rastrear las asignaciones y garantizar que cada malloc or new tiene un correspondiente free or deleteEn la programación de sistemas críticos, las fugas de recursos causadas por errores manuales de memoria pueden degradar el rendimiento o hacer que la aplicación se comporte de manera impredecible a lo largo del tiempo.

Estructuras de datos ilimitadas o en crecimiento

Las colecciones que crecen con el tiempo sin los límites adecuados son una fuente común de fugas de memoria, especialmente en aplicaciones de larga duración. Estructuras de datos como listas, colas, diccionarios y cachés se utilizan a menudo para almacenar objetos para su procesamiento o búsqueda temporal. Si las entradas antiguas nunca se eliminan o caducan, la estructura continúa consumiendo memoria incluso después de que los datos se vuelvan irrelevantes. Por ejemplo, un sistema de registro puede anexar cada mensaje a una lista que nunca se borra, o una capa de caché puede almacenar los resultados de las consultas indefinidamente sin ninguna estrategia de caducidad. En aplicaciones de alto volumen, estas estructuras pueden crecer hasta albergar miles o millones de objetos, lo que eventualmente provoca situaciones de falta de memoria. Los desarrolladores deben implementar límites, intervalos de limpieza o políticas de desalojo de los objetos menos utilizados recientemente (LRU) para garantizar que las estructuras de datos no crezcan sin control. En lenguajes con recolección de basura, este tipo de fuga es particularmente delicado porque la memoria es técnicamente accesible, por lo que no se recolectará. Monitorear el tamaño de la colección y establecer controles para eliminar entradas antiguas o no utilizadas ayuda a prevenir una pérdida lenta de memoria que de otra manera podría pasar desapercibida durante el desarrollo o las pruebas a pequeña escala.

Referencias circulares en lenguajes de recolección de basura

Los lenguajes con recolección de elementos no utilizados, como Java, Python y JavaScript, simplifican la gestión de memoria al limpiar automáticamente los objetos inaccesibles. Sin embargo, las referencias circulares plantean un desafío sutil. Cuando dos o más objetos se refieren entre sí y la aplicación ya no los utiliza, sus referencias mutuas impiden que el recolector de elementos no utilizados determine si es seguro eliminarlos. Si bien los recolectores de elementos no utilizados modernos han mejorado su capacidad para detectar estos ciclos, no todos los entornos o tipos de recolectores los gestionan eficazmente. Además, los cierres o lambdas en estos lenguajes pueden capturar variables del ámbito principal de forma involuntaria, lo que mantiene los objetos activos más allá de su ciclo de vida previsto. Este problema suele presentarse en aplicaciones con programación reactiva, sistemas de eventos o grafos de objetos que forman bucles estrechos. Se recomienda romper estos ciclos manualmente anulando referencias o utilizando referencias débiles. Algunos lenguajes también ofrecen estructuras de datos especializadas o gestores de contexto que minimizan el riesgo de formar cadenas de referencias robustas. Sin prestar atención a este detalle, las referencias circulares pueden acumular memoria de forma silenciosa, lo que provoca una degradación del rendimiento y fugas difíciles de rastrear.

Recursos no cerrados

Las aplicaciones que interactúan con recursos del sistema, como archivos, conexiones de bases de datos, sockets de red o flujos, deben garantizar que estos recursos se liberen explícitamente. A diferencia de los objetos normales, que pueden ser objeto de recolección de elementos no utilizados, estos recursos suelen estar vinculados a los identificadores del sistema operativo y requieren una limpieza manual o estructurada. Si un archivo se abre pero nunca se cierra, o si una conexión de base de datos se deja colgada, no solo consume memoria, sino que también reserva descriptores de archivo, conexiones de socket o ranuras del grupo de bases de datos. Con el tiempo, esto puede provocar el agotamiento de los identificadores de archivo o el bloqueo de los grupos de conexiones. Los lenguajes de programación modernos suelen ofrecer construcciones como try-with-resources En Java, using en C#, o administradores de contexto en Python para garantizar el cierre de recursos incluso ante excepciones. Los desarrolladores que ignoran o ignoran estas construcciones se arriesgan a generar fugas de recursos silenciosas pero perjudiciales. En sistemas grandes, incluso un pequeño porcentaje de recursos sin cerrar puede causar problemas en todo el sistema, especialmente cuando las aplicaciones escalan con carga concurrente. El seguimiento y cierre de recursos de forma fiable debe ser una práctica fundamental en todo flujo de trabajo de desarrollo.

Variables estáticas y globales

Las variables estáticas y globales están diseñadas para persistir durante la vida útil de una aplicación, lo que las hace inherentemente riesgosas si no se gestionan con cuidado. Cuando estas variables contienen objetos grandes, datos temporales o referencias a componentes de la interfaz de usuario o información específica de la sesión, impiden que el recolector de elementos no utilizados recupere esa memoria incluso después de que ya no sea útil. Una caché estática que nunca se borra, o un servicio global que conserva resultados antiguos indefinidamente, consume lentamente más memoria con el tiempo. Este problema es especialmente problemático en sistemas que gestionan sesiones de usuario, transacciones o trabajos por lotes donde se procesan repetidamente diferentes contextos. Si el campo estático acumula el estado de cada instancia y nunca se reinicia, el consumo de memoria aumenta con el uso. Los desarrolladores deben limitar el uso de variables estáticas a constantes o pequeñas utilidades que garanticen su relevancia durante todo el ciclo de vida de la aplicación. Si se requiere almacenamiento persistente, se deben implementar mecanismos para recortar o invalidar periódicamente los valores almacenados. Las auditorías y la creación de perfiles de memoria rutinarios también pueden ayudar a detectar un crecimiento inesperado de la memoria causado por referencias estáticas con un alcance incorrecto.

Fugas relacionadas con el hilo

Las aplicaciones multihilo presentan desafíos únicos para la gestión de memoria, especialmente en lo que respecta al almacenamiento local del hilo y a los hilos de larga duración. Cuando los datos se almacenan en variables locales del hilo pero nunca se borran, permanecen asociados al hilo mientras exista. Esto se convierte en una fuga de memoria si el hilo persiste más de lo necesario o se reutiliza indefinidamente en un grupo de hilos. Además, los hilos en segundo plano que están bloqueados, en reposo o en espera de eventos pueden retener objetos mucho después de que sean necesarios. Si un hilo hace referencia a una clase que se suponía que sería efímera, como un objeto de solicitud o un búfer temporal, dicha clase no se puede recopilar hasta que el hilo finalice. En los casos en que los hilos se gestionan mal o se abandonan, estas fugas persisten silenciosamente y aumentan a medida que el sistema escala. Las prácticas recomendadas incluyen la limpieza explícita de las variables locales del hilo, garantizar que los hilos de larga duración liberen referencias innecesarias y diseñar hilos de trabajo para restablecer su contexto entre tareas. También se debe supervisar el tamaño y el consumo de memoria de los grupos de hilos para detectar cuándo los hilos inactivos retienen más datos de lo esperado.

Problemas con bibliotecas de terceros

No todas las fugas de memoria se originan en el propio código. Las bibliotecas y los frameworks, especialmente aquellos que interactúan con gráficos, audio o hardware externo, pueden contener sus propias fugas o exponer API que requieren una limpieza explícita. Si estas API no se utilizan correctamente, por ejemplo, al no llamar a un dispose() or shutdown() método, los recursos que gestionan permanecerán asignados. Esto es particularmente común en bibliotecas antiguas o en las más nuevas que abstraen la complejidad, pero no documentan bien los requisitos del ciclo de vida. En algunos casos, las bibliotecas implementan sus propias estrategias de almacenamiento en caché o agrupación de recursos, lo que puede retener los objetos en memoria más tiempo del previsto. Estas cachés pueden ser ajustables o completamente opacas. Además, la integración de una biblioteca podría mantener inadvertidamente referencias a los objetos de su aplicación (como registrar una devolución de llamada que nunca se elimina), lo que impide que se recopilen sus objetos. Los desarrolladores deben revisar cuidadosamente la documentación de cualquier código de terceros que incluyan y supervisar el uso de memoria a lo largo del tiempo para detectar fugas introducidas por las bibliotecas. Probar las integraciones de terceros bajo carga o usar herramientas de perfilado ayuda a detectar estos problemas de forma temprana.

El sistema operativo maneja las fugas

Las fugas de memoria no se limitan a las asignaciones de montón. Las aplicaciones también dependen en gran medida de los controladores del sistema operativo, como descriptores de archivos, controladores de GUI, sockets y semáforos. Cada uno de estos recursos tiene un límite finito a nivel de sistema. Cuando los controladores no se cierran correctamente, el sistema acaba agotando los recursos, incluso si parece haber memoria disponible. Por ejemplo, no cerrar un descriptor de archivo en Linux genera errores como "Demasiados archivos abiertos", que pueden detener los servicios inesperadamente. En entornos Windows, las fugas de controladores de la interfaz gráfica de dispositivo (GDI) pueden impedir la representación de nuevas ventanas o elementos de la interfaz de usuario. Las fugas de controladores son especialmente difíciles de diagnosticar porque pueden no aparecer en los perfiladores de memoria tradicionales. Las herramientas de monitorización específicas de su plataforma, como lsof En Unix o el Administrador de tareas de Windows, puede revelar un uso anormal de los controladores. Los desarrolladores deben auditar cuidadosamente sus rutinas de gestión de recursos y asegurarse de que cada asignación tenga su correspondiente versión. El uso de patrones RAII o administradores de recursos con alcance puede ayudar a garantizar un comportamiento correcto tanto en sistemas de alto como de bajo nivel.

Suscripciones a eventos y devoluciones de llamadas

Los sistemas basados en eventos son propensos a fugas de memoria cuando los componentes se registran para eventos, pero nunca se desregistran. Esto es especialmente cierto en aplicaciones con publicadores de eventos de larga duración, como frameworks de interfaz de usuario, buses de mensajería o pipelines reactivos. Cuando un oyente se registra y no se elimina, el publicador conserva una referencia a dicho oyente, manteniendo activo todo el gráfico de objetos. Por ejemplo, si un widget de interfaz de usuario escucha las actualizaciones de un modelo compartido, pero nunca se desregistra al eliminarse de la pantalla, el widget permanece en memoria. En aplicaciones JavaScript, los nodos DOM asociados a eventos globales son una causa frecuente de fugas cuando se eliminan visualmente, pero no se desconectan programáticamente. La solución reside en la gestión simétrica del ciclo de vida. Cada registro debe ir acompañado de una desregistro explícita. Algunos frameworks admiten patrones de eventos débiles o ganchos de limpieza automática para minimizar la carga de trabajo de los desarrolladores. Sin embargo, depender únicamente de estos es arriesgado a menos que se confirme su comportamiento durante el desmontaje. Las revisiones y pruebas de código siempre deben incluir la verificación de que las suscripciones a eventos se finalizan correctamente.

Uso indebido del puntero inteligente en C++

Punteros inteligentes de C++ como unique_ptr, shared_ptry el ámbito weak_ptr son herramientas potentes para la gestión automatizada de la memoria, pero si se usan incorrectamente, pueden causar fugas de memoria sutiles. Un problema común surge cuando shared_ptr Las instancias forman referencias circulares. Dado que los punteros compartidos utilizan el conteo de referencias para gestionar los tiempos de vida, los objetos que se apuntan entre sí con propiedad compartida nunca alcanzarán un conteo de cero, lo que impide la desasignación. Este problema se encuentra a menudo en estructuras padre-hijo o relaciones bidireccionales. Los desarrolladores deben usar weak_ptr En una dirección para romper el ciclo y permitir una limpieza adecuada. Otro problema es mezclar punteros sin procesar con punteros inteligentes. Si se utilizan punteros sin procesar para contener referencias que no se gestionan con cuidado, se reducen los beneficios de los punteros inteligentes. Algunos desarrolladores asignan objetos por error utilizando new y olvidan envolverlos en un puntero inteligente, perdiendo así la noción de su propiedad. Seguir los principios RAII (Adquisición de Recursos es Inicialización) es esencial para garantizar que los recursos se liberen de forma predecible. Al diseñar teniendo en cuenta la propiedad de punteros inteligentes y evitar modelos híbridos de gestión de memoria, los desarrolladores pueden reducir considerablemente la probabilidad de introducir fugas en el código C++ moderno.

Detección de fugas de memoria

Las fugas de memoria suelen ser difíciles de detectar porque se acumulan lentamente y no siempre causan errores inmediatos. A diferencia de los fallos o errores de sintaxis, las fugas pueden aparecer solo después de horas o días de funcionamiento de la aplicación, especialmente en sistemas con cargas de trabajo persistentes o alta concurrencia. Detectarlas requiere una combinación de observación, instrumentación y herramientas. A continuación, se presentan estrategias prácticas y eficaces para identificar fugas de memoria en aplicaciones reales.

Monitorear el uso de la memoria a lo largo del tiempo

Una de las primeras señales de una fuga de memoria es una tendencia constante al alza en el uso de la memoria durante el funcionamiento normal. Esto se puede observar con herramientas sencillas del sistema como el Administrador de tareas de Windows. top or htop En Linux o en paneles de orquestación de contenedores en entornos Kubernetes. El uso de memoria debería fluctuar con las cargas de trabajo, pero eventualmente se estabilizará. Si continúa aumentando con el tiempo, especialmente durante periodos de inactividad o después de tareas repetitivas, es un claro indicador de que no se está liberando memoria. En sistemas de producción, los gráficos de uso de memoria se pueden monitorizar mediante métricas del sistema o herramientas de monitorización de la infraestructura. Correlacionar los picos de uso con eventos específicos de la aplicación o interacciones del usuario puede ayudar a identificar el origen de la fuga. La detección temprana mediante la monitorización periódica ayuda a prevenir fallos y la degradación del rendimiento.

Utilice perfiladores de memoria y montón

Los perfiladores de montón son herramientas esenciales para visualizar el uso de memoria e identificar qué objetos consumen espacio en la aplicación. Estas herramientas permiten a los desarrolladores tomar instantáneas de memoria en diferentes momentos y compararlas para detectar qué objetos aumentan sin liberarse. En Java, se utilizan comúnmente VisualVM y Eclipse Memory Analyzer. Los desarrolladores de .NET suelen usar dotMemory o CLR Profiler, mientras que las aplicaciones C/C++ se benefician de Valgrind o AddressSanitizer. Python ofrece herramientas como objgraph además memory_profilerLos perfiladores de montón muestran cadenas de referencia, tamaños de memoria retenida y árboles de asignación, lo que ayuda a rastrear cómo se almacena la memoria. En aplicaciones complejas, la combinación de instantáneas con lógica de filtrado y agrupación puede identificar áreas problemáticas. Al combinarse con la depuración en vivo, los perfiladores permiten la investigación en tiempo real de objetos que permanecen en memoria más tiempo del esperado. Esta información es crucial para diagnosticar fugas lentas que eluden los registros tradicionales o las métricas del sistema.

Registro del crecimiento de objetos y colecciones

Registrar el tamaño de las estructuras de datos clave o los grupos de objetos a lo largo del tiempo es una técnica sencilla pero potente para detectar fugas durante el desarrollo y las pruebas. Los desarrolladores pueden instrumentar el código para informar periódicamente la longitud de colecciones como listas, mapas, colas o registros de sesión. En escenarios donde se espera que estas estructuras de datos crezcan temporalmente y luego se reduzcan, la monitorización de su tamaño puede revelar si alguna vez vuelven a su estado inicial. Por ejemplo, si una cola de mensajes procesa tareas, pero el tamaño de su lista interna nunca disminuye, los objetos podrían estar acumulándose debido a lagunas lógicas. Esto es especialmente útil cuando la creación de perfiles no es factible o cuando se sospecha que hay fugas en áreas funcionales específicas. Al integrar estos registros junto con la ejecución de tareas o los flujos de usuario, los desarrolladores obtienen visibilidad de los patrones anormales de retención de objetos. Se pueden añadir comprobaciones de umbral automatizadas para detectar y alertar sobre el crecimiento descontrolado, lo que permite la mitigación temprana de fugas de memoria antes de que afecten al rendimiento.

Analizar el comportamiento de la recolección de basura

Los lenguajes con recolección de basura, como Java, Python y C#, ofrecen indicadores útiles de la presión de memoria a través de sus registros de recolección de basura. Cuando el sistema experimenta ciclos frecuentes de recolección de basura con una recuperación mínima de memoria, generalmente indica que se están reteniendo objetos innecesariamente. El análisis de estos registros revela la frecuencia con la que se producen las recolecciones importantes, la cantidad de memoria recuperada y cómo cambia el uso del montón con el tiempo. En Java, herramientas como GCViewer o registros JVM integrados (-XX:+PrintGCDetails) proporcionan información sobre la eficacia del recolector de basura. Una actividad excesiva del recolector de basura puede reducir el rendimiento de la aplicación incluso si la memoria aún no se ha agotado por completo. Si el recolector de basura se ejecuta con frecuencia, pero no puede recuperar espacio, los desarrolladores deben investigar las referencias a objetos y las rutas de asignación. Patrones como el aumento del uso de memoria de generaciones anteriores y los largos tiempos de pausa del recolector de basura suelen indicar objetos persistentes que el sistema asume erróneamente que siguen en uso. Revisar estos patrones periódicamente es una forma eficaz de detectar la retención silenciosa de memoria en entornos administrados.

Puntos calientes de asignación de vías

Las herramientas de perfilado pueden identificar funciones o módulos responsables de la mayor cantidad de asignaciones de objetos. Los puntos críticos de asignación no siempre son una fuga en sí mismos, pero cuando ciertas áreas asignan constantemente una gran cantidad de objetos que nunca se recopilan, se convierte en una señal de alerta. Los perfiladores de memoria se pueden configurar para mostrar los recuentos de asignaciones y los seguimientos de pila que conducen a dichas asignaciones. En lenguajes como Java, jmap y JProfiler permiten a los desarrolladores identificar qué clases y métodos generan el mayor uso de memoria. Para aplicaciones nativas, la herramienta Massif de Valgrind resulta útil para rastrear picos de asignación. El seguimiento de estos puntos críticos permite a los equipos inspeccionar el diseño de funciones o bucles con alta rotación. Un servicio que asigna memoria repetidamente dentro de un hilo de sondeo, sin liberar nunca las referencias a esos objetos, puede generar una huella de memoria de crecimiento lento. Los desarrolladores pueden optimizar o reestructurar dichas rutas de código para garantizar que los objetos temporales se liberen una vez cumplido su propósito. Al abordar los puntos críticos de forma temprana, se minimizan las fugas a largo plazo antes de que se acumulen en las sesiones de usuario o los ciclos de servicio.

Observar el comportamiento de la aplicación bajo carga

Las pruebas de carga son una forma fiable de detectar fugas de memoria que permanecen ocultas en las cargas de trabajo de desarrollo habituales. Al simular alta concurrencia, tráfico sostenido o patrones de uso repetidos, los desarrolladores pueden observar el comportamiento de la aplicación bajo presión. En estos escenarios, las fugas de memoria suelen manifestarse mediante un mayor consumo de memoria, tiempos de respuesta más lentos y, finalmente, errores de memoria insuficiente. Los resultados de las pruebas de carga deben complementarse con la monitorización de la memoria y los registros para identificar si el uso de recursos se estabiliza tras la carga o si continúa aumentando. Herramientas como JMeter, Locust y k6 ayudan a simular la carga, mientras que las métricas del sistema y de la aplicación proporcionan bucles de retroalimentación. Este método es especialmente útil para identificar fugas en los flujos de autenticación, el procesamiento de archivos, la transmisión de datos o cualquier ruta de código que se ejecute por solicitud. Las pruebas de carga en un entorno de ensayo o preproducción permiten a los equipos descubrir fugas que, de otro modo, se manifestarían en producción, donde la detección se vuelve más arriesgada y la remediación más disruptiva.

Monitorear el número de subprocesos o controladores

Las fugas de memoria no se limitan al uso del montón de objetos. Los recursos a nivel de sistema, como subprocesos, descriptores de archivos, sockets y controladores de interfaz gráfica de usuario (GUI), también consumen memoria y deben liberarse explícitamente. La fuga de estos recursos puede agotar los límites del sistema operativo, lo que provoca inestabilidad del sistema o fallos de la aplicación. Los desarrolladores deben supervisar los grupos de subprocesos, el estado de los sockets y los controladores de archivos abiertos para detectar una retención anormal. Herramientas como lsof, netstatLos monitores de recursos específicos de la plataforma ayudan a rastrear los recursos abiertos en tiempo de ejecución. Por ejemplo, si una aplicación crea subprocesos para gestionar tareas, pero nunca los finaliza correctamente, el uso de memoria aumentará en paralelo con el número de subprocesos. De igual forma, los archivos o sockets sin cerrar pueden persistir en segundo plano, acumulando sobrecarga a nivel de sistema incluso si están inactivos. Este tipo de fugas son especialmente peligrosas en servicios y servidores de larga duración con alto rendimiento. Una gestión adecuada del ciclo de vida de estos recursos, junto con la limpieza automatizada y los ganchos de apagado, garantiza que la memoria del sistema se recupere de forma rápida y segura.

Utilice herramientas de monitorización de APM y tiempo de ejecución

Las herramientas de Monitoreo del Rendimiento de Aplicaciones (APM) brindan visibilidad continua del uso de memoria, el comportamiento de recolección de elementos no utilizados y la vida útil de los objetos en diferentes entornos. Soluciones como New Relic, Dynatrace, AppDynamics y Datadog ofrecen paneles de memoria integrados y detección de anomalías para aplicaciones en vivo. Estas plataformas pueden alertar a los equipos cuando el uso de memoria excede los umbrales o cuando servicios específicos muestran un comportamiento inusual bajo carga. Algunas herramientas también incluyen comparaciones históricas y análisis de retención, lo que ayuda a correlacionar las tendencias de memoria con las implementaciones o los picos de tráfico. En entornos de producción donde la generación de perfiles es demasiado intrusiva, las herramientas de APM sirven como el principal objetivo para detectar fugas de memoria. Ayudan a rastrear solicitudes con uso intensivo de memoria, identificar endpoints lentos y destacar los servicios que retienen objetos durante más tiempo del esperado. Muchas plataformas de APM también admiten activadores de volcado de pila o muestreo de objetos, lo que proporciona los datos de diagnóstico necesarios sin afectar el rendimiento en tiempo de ejecución. La integración de soluciones de APM en las primeras etapas del ciclo de vida del desarrollo permite la detección proactiva de fugas y acelera el análisis de la causa raíz cuando surgen problemas.

Comparar instantáneas de memoria antes y después de las tareas

Una técnica sencilla pero eficaz para detectar fugas de memoria consiste en tomar instantáneas de memoria en momentos clave del ciclo de vida de la aplicación: antes y después de ejecutar operaciones importantes. Por ejemplo, si la aplicación carga sesiones de usuario, procesa grandes conjuntos de datos o ejecuta trabajos por lotes, capturar una instantánea del montón antes de la operación y otra después permite analizar qué objetos se crearon y cuáles permanecen. Idealmente, los objetos temporales deberían liberarse una vez completada la tarea. Si grandes volúmenes de memoria permanecen ocupados sin motivo aparente, puede indicar que los objetos se están reteniendo involuntariamente. Las herramientas de análisis del montón permiten comparar instantáneas y destacar qué objetos han aumentado en número o tamaño. Esta investigación centrada en delta es especialmente eficaz para detectar fugas en módulos o funciones aislados. Al combinarse con registros, métricas y seguimiento de asignaciones, las comparaciones de instantáneas pueden conducir directamente a las rutas de código responsables de las fugas de memoria.

Prevención de pérdidas de memoria

Prevenir fugas de memoria es tan importante como detectarlas. Si bien las herramientas y los diagnósticos pueden ayudar a descubrir fugas tras su aparición, las prácticas de diseño robustas, la gestión rigurosa de recursos y el cumplimiento de las convenciones específicas del lenguaje pueden prevenir la mayoría de las fugas. La prevención proactiva reduce el tiempo de depuración, mejora la estabilidad de las aplicaciones y garantiza la escalabilidad a medida que los sistemas crecen. A continuación, se presentan técnicas y hábitos arquitectónicos probados que minimizan el riesgo de fugas de memoria en diferentes entornos de programación.

Utilice construcciones de gestión de recursos estructurados

Lenguajes como Java, C# y Python ofrecen construcciones estructuradas para la limpieza automática de recursos. Estas incluyen try-with-resources, using Declaraciones y administradores de contexto. Cuando se usan correctamente, garantizan el cierre de recursos como archivos, sockets y conexiones a bases de datos, incluso si se producen excepciones. Los desarrolladores deberían priorizar estas construcciones en lugar de las llamadas de cierre manuales, que son propensas a omisiones. En entornos no administrados como C y C++, el uso de RAII (Adquisición de Recursos es Inicialización) garantiza la liberación de recursos cuando los objetos quedan fuera del alcance. Estos patrones reducen la posibilidad de olvidar la limpieza y generan código más seguro y predecible. Los equipos deberían estandarizar estas construcciones y tratar cualquier gestión manual de recursos como un error de código que requiere un escrutinio especial durante las revisiones.

Anular el registro de escuchas de eventos y devoluciones de llamadas rápidamente

El código basado en eventos requiere la cancelación explícita de la suscripción de los oyentes cuando el objeto que los registra ya no es necesario. De lo contrario, se conservan referencias y memoria que no se puede liberar. En sistemas con elementos de interfaz gráfica de usuario (GUI), actualizaciones de datos en tiempo real o buses de eventos personalizados, cada registro debe reflejarse con una cancelación. Esta práctica es crucial en entornos de interfaz de usuario modulares o dinámicos, donde los componentes se montan y desmontan con frecuencia. Un error común es registrar un oyente durante la inicialización y no eliminarlo durante la destrucción o el desmontaje. Las fugas de memoria se acumulan cuando los componentes se destruyen visualmente, pero se mantienen referenciados lógicamente. Los desarrolladores deben centralizar la lógica de suscripción a eventos y garantizar que las rutinas de desmontaje se activen de forma consistente. Cuando sea posible, utilice patrones de eventos débiles o enlaces de ciclo de vida proporcionados por el entorno para automatizar la limpieza. Además, adopte pruebas unitarias y de integración que validen la eliminación de oyentes tras la desactivación de componentes o la descarga de páginas.

Limitar el uso de referencias estáticas y globales

Los campos estáticos y las variables globales se usan a menudo por conveniencia, pero tienen el costo de la permanencia. Cualquier objeto referenciado desde un contexto estático permanece en memoria durante todo el tiempo de ejecución de la aplicación, independientemente de si se sigue necesitando. Esto se vuelve especialmente peligroso cuando se almacenan estáticamente grandes colecciones, datos de sesión o elementos de la interfaz de usuario. Con el tiempo, estos objetos se acumulan y crean una retención de memoria no deseada. Para evitar esto, los desarrolladores deben usar campos estáticos solo para constantes inmutables, métodos de utilidad o singletons administrados por el ciclo de vida. Evite almacenar estáticamente objetos dependientes del contexto o pesados. Cuando se requieran referencias globales, combínelas con lógica de expiración, políticas de desalojo o estrategias de nulificación manual. Durante el apagado o el desmontaje de componentes, los recursos almacenados estáticamente deben borrarse explícitamente. El uso estático también debe revisarse durante las solicitudes de extracción para garantizar que los datos temporales o transaccionales no terminen en el almacenamiento de larga duración involuntariamente.

Romper las referencias circulares cuando sea necesario

En entornos con recolección de basura, las referencias circulares pueden impedir la recuperación de memoria. Esto es especialmente común al usar cierres, estructuras de datos enlazadas o relaciones bidireccionales. Los desarrolladores deben tener cuidado al formar ciclos entre objetos que se referencian entre sí. En C++, use weak_ptr para romper los ciclos formados por shared_ptrEn Java o Python, revise los grafos de objetos y use referencias débiles cuando sea apropiado para permitir la recopilación de objetos accesibles de otro modo. Al usar cierres o clases anónimas, minimice el alcance de las variables capturadas. Evite referenciar instancias completas de clase cuando solo se requiere un método o una pequeña parte del estado. Los cierres que capturan objetos grandes inadvertidamente son una fuente frecuente de fugas en código asíncrono o reactivo. Auditar regularmente estos patrones y probar el comportamiento de la memoria durante el desarrollo ayuda a evitar que las referencias circulares persistan más allá de su utilidad.

Utilice estructuras y patrones de datos que hagan un uso eficiente de la memoria

Elegir la estructura de datos correcta puede ayudar a evitar la retención innecesaria de memoria. Por ejemplo, usar WeakHashMap en Java o WeakKeyDictionary En Python, se garantiza que las claves o valores se descarten automáticamente cuando ya no se usan. Evite usar listas o mapas ilimitados por defecto cuando se pueda aplicar una estructura más adecuada, como una caché LRU o una cola limitada. En los casos en que se deban retener temporalmente grandes conjuntos de datos, segmente los datos y libere fragmentos periódicamente para reducir la presión de memoria. Además, evite la optimización prematura que lleva a almacenar todo en caché "por si acaso". Implementar políticas claras de expiración, expulsión o límites de tamaño ayuda al sistema a gestionar mejor la memoria sin la intervención del desarrollador. La creación de perfiles durante el diseño, no solo después de que se produzcan fugas, ayuda a validar las suposiciones sobre la retención de datos y el tamaño de la estructura bajo cargas realistas.

Desechar los objetos no utilizados de forma explícita

Aunque los lenguajes con recolección de basura liberan memoria automáticamente, el tiempo de recolección depende de la accesibilidad del objeto. Si quedan referencias, la memoria permanece asignada. Los desarrolladores pueden acelerar la liberación configurando explícitamente las variables en null (en Java) o None (en Python) una vez finalizado su uso. Esto indica al recolector de elementos no utilizados que el objeto ya no es necesario. Esta técnica es especialmente útil en ámbitos de larga duración, como trabajadores en segundo plano, bucles largos o controladores de sesión, donde los objetos permanecerían referenciados durante un periodo prolongado. En aplicaciones críticas para el rendimiento, un control preciso del ciclo de vida de los objetos puede reducir significativamente el uso máximo de memoria. Sin embargo, esto debe usarse con prudencia para evitar saturar el código o introducir errores. Como principio, asegúrese de que las variables que contienen datos grandes o sensibles se borren en cuanto finalice su tarea.

Adoptar estrategias de asignación defensiva

Las fugas de memoria se pueden reducir asignando memoria solo cuando realmente se necesita. Evite preasignar estructuras grandes a menos que sea necesario para el rendimiento. Utilice técnicas de inicialización diferida, donde la memoria se asigna justo a tiempo y se libera en cuanto se completa la tarea del objeto. Realice un seguimiento del uso de la memoria mediante estructuras con alcance y procese por lotes grandes conjuntos de datos en lugar de cargarlos completamente en memoria. En algunos entornos, la agrupación también puede causar fugas de memoria si los objetos nunca se devuelven a la agrupación. Asegúrese de que cualquier lógica de gestión de memoria personalizada incluya tiempos de espera o lógica de detección de fugas. Los desarrolladores deben adoptar la mentalidad de que cada asignación debe incluir un plan de desasignación, especialmente en sistemas sensibles al rendimiento o con recursos limitados.

Incorporar auditoría de memoria en CI/CD

La prevención no está completa sin una monitorización continua. Integrar auditorías de memoria en el flujo de trabajo de CI/CD ayuda a detectar regresiones de forma temprana. Herramientas como perfiladores automatizados, contadores de asignación o pruebas de carga sintéticas pueden programarse para que se ejecuten antes de cada implementación. Estos sistemas rastrean métricas clave como el tamaño del montón, la frecuencia de recolección de elementos no utilizados (GC), el número de objetos y los identificadores de recursos. Cuando se superan los umbrales o se detectan desviaciones de las líneas base, los equipos reciben una alerta antes de que los cambios lleguen a producción. Este enfoque proactivo convierte la gestión de memoria en una práctica continua, en lugar de una solución reactiva. Los equipos también deben incluir KPI relacionados con la memoria en sus criterios de calidad y realizar revisiones de código periódicas centradas en la gestión del ciclo de vida. Establecer una cultura de higiene de memoria garantiza que la prevención se integre en el proceso de desarrollo.

Pruebas unitarias para detectar fugas de memoria

Si bien las fugas de memoria suelen asociarse con el comportamiento en tiempo de ejecución y el rendimiento a largo plazo de las aplicaciones, pueden y deben detectarse durante las pruebas, especialmente mediante pruebas unitarias específicas. Integrar la verificación de memoria en los flujos de trabajo de las pruebas unitarias permite a los equipos identificar fugas en una etapa más temprana del proceso de desarrollo, antes de que se intensifiquen en producción. Las pruebas unitarias diseñadas para la seguridad de la memoria ayudan a garantizar que se respeten los límites del ciclo de vida de los objetos, que los recursos se liberen correctamente y que las operaciones se completen sin retener referencias no deseadas. Si bien las pruebas unitarias por sí solas no pueden descubrir todas las fugas, constituyen una primera línea de defensa fundamental que refuerza la buena disciplina de ingeniería y fomenta un diseño con capacidad de detectar fugas.

Pruebas de diseño en torno al comportamiento de asignación y limpieza

Las pruebas unitarias eficaces para la gestión de memoria se centran no solo en la corrección funcional, sino también en el ciclo de vida de los objetos. Cada prueba debe validar que los objetos temporales se creen, utilicen y descarten correctamente. Al trabajar con cachés personalizadas, gestores de sesiones o fábricas de servicios, escriba pruebas que simulen la creación de objetos y verifiquen que nada persista innecesariamente una vez finalizada la operación. Esto suele implicar invocar la misma lógica varias veces y comparar el uso de memoria o el número de objetos entre ejecuciones. Si el consumo de memoria aumenta con cada invocación, puede indicar una fuga. En sistemas que gestionan grandes cargas útiles o una alta rotación de objetos, incluya lógica de desmontaje en la prueba para forzar la limpieza. En algunos entornos, la instrumentación del código de prueba con contadores de asignación ligeros o comprobaciones de referencia ayuda a detectar objetos que no se salen del ámbito de aplicación. Estas afirmaciones garantizan que el uso de la memoria siga siendo predecible y autónomo dentro del ámbito de aplicación de la prueba.

Utilice bibliotecas y utilidades de detección de fugas

Los ecosistemas de programación modernos ofrecen bibliotecas que amplían los marcos de pruebas unitarias con capacidades de detección de fugas de memoria. Para C++, herramientas como Google Test pueden combinarse con Valgrind o AddressSanitizer para rastrear las asignaciones durante la ejecución de las pruebas. Los desarrolladores de Java pueden usar herramientas como junit-allocations or OpenJDK Flight Recorder en modo de prueba para observar la memoria retenida. Python ofrece objgraph, tracemallocy el ámbito gc Funciones de inspección de módulos para rastrear el crecimiento de objetos entre aserciones. Estas bibliotecas pueden incorporarse a conjuntos de pruebas estándar y utilizarse para establecer expectativas en torno al recuento de objetos o los cambios de memoria. Por ejemplo, una prueba puede afirmar que no quedan instancias adicionales de una clase tras la finalización de un método. Al encapsular los casos de prueba en ámbitos de asignación controlada o instantáneas de memoria, los desarrolladores pueden validar que no persistan referencias ocultas. Estas herramientas no solo detectan fugas de memoria de forma temprana, sino que también facilitan su reproducción consistente, lo que suele ser difícil durante el perfilado completo de la aplicación.

Simular el uso repetitivo y medir la estabilidad

Las fugas de memoria suelen ocurrir en operaciones repetitivas o de larga duración. Para detectar estos patrones mediante pruebas unitarias, simule la ejecución repetida de la misma función o característica dentro de un bucle. Este enfoque puede revelar un crecimiento gradual de la memoria que no sería evidente en una sola pasada de prueba. Por ejemplo, una función de caché que no logra expulsar entradas obsoletas puede aprobarse en circunstancias aisladas, pero fallar con una repetición sostenida. Estructure sus pruebas para ejecutar docenas o cientos de iteraciones y mida el estado de la memoria o del objeto una vez finalizadas. Algunos marcos de prueba permiten la configuración y desmontaje a nivel de accesorios que permiten la comprobación de recursos entre ciclos. Incluir estos bucles como parte de la automatización de pruebas ayuda a garantizar que el uso de la memoria se mantenga constante a lo largo del tiempo. Esto es especialmente valioso en servicios que deben mantener la estabilidad durante sesiones largas, como procesadores en segundo plano, puntos finales de API o trabajos por lotes. Al observar si la memoria se mantiene estable después de una ejecución repetida, los desarrolladores adquieren confianza temprana en la robustez de su gestión de memoria.

Afirmar la liberación adecuada de recursos en los desmontajes de prueba

Las pruebas unitarias siempre deben restaurar el entorno a un estado limpio, incluyendo la memoria. Además de las aserciones funcionales, los métodos de desmontaje de pruebas son ideales para verificar que se hayan liberado los recursos temporales. Ya sea que se trate de flujos de archivos, conexiones a bases de datos o instancias de servicio simuladas, los bloques de desmontaje pueden incluir... dispose, close o null Operaciones. Estos patrones refuerzan el principio de que todos los recursos deben liberarse al finalizar la tarea. Cuando corresponda, también se debe confirmar que las referencias clave ya no son accesibles o que se han activado los finalizadores. Esta práctica anima a los desarrolladores a escribir código más autocontenido y reduce la contaminación de las pruebas en las distintas suites. Cuando el código de desmontaje incluye la validación de los ciclos de vida de los objetos, resulta mucho más fácil detectar regresiones o cambios de comportamiento que introducen fugas de memoria. La integración de las afirmaciones de memoria en la limpieza de pruebas también mejora la fiabilidad en entornos de pruebas paralelas o continuas, donde el aislamiento de las pruebas es esencial.

Ejemplos de codificación

A continuación se muestran algunos ejemplos de codificación que demuestran fugas de memoria comunes y sus resoluciones:

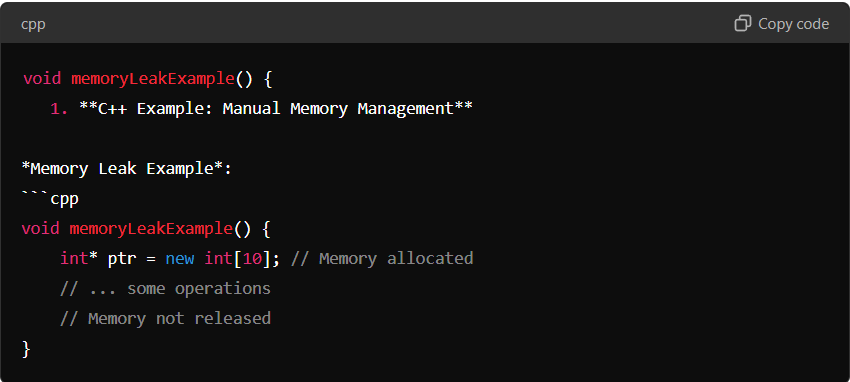

Ejemplo de C++: gestión manual de memoria

En este ejemplo, se asigna memoria mediante new[] para crear una matriz de números enteros. Sin embargo, la memoria no se libera porque no hay una llamada delete[] para liberarla, lo que genera una pérdida de memoria.

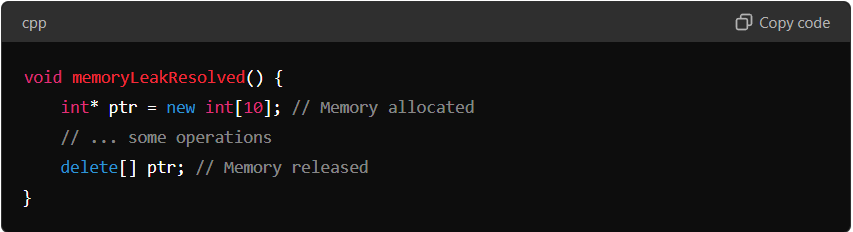

Ejemplo Resuelto:

Para resolver la pérdida, la memoria asignada se libera correctamente mediante delete[]. Esto garantiza que la memoria se devuelva al sistema una vez que ya no sea necesaria.

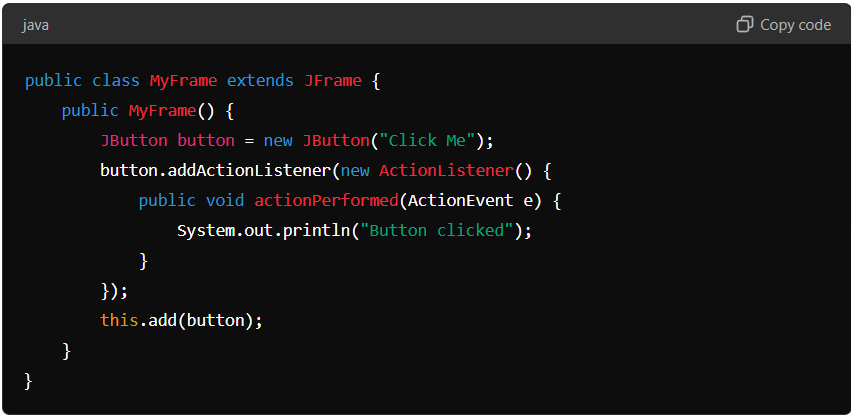

Ejemplo de Java: pérdida de memoria del receptor

Ejemplo de pérdida de memoria:

En este ejemplo, se utiliza una clase interna anónima para crear un ActionListener para un botón. Sin embargo, si se elimina el botón o se cierra el marco sin eliminar el detector, este puede provocar una pérdida de memoria al mantener el botón o el marco en la memoria.

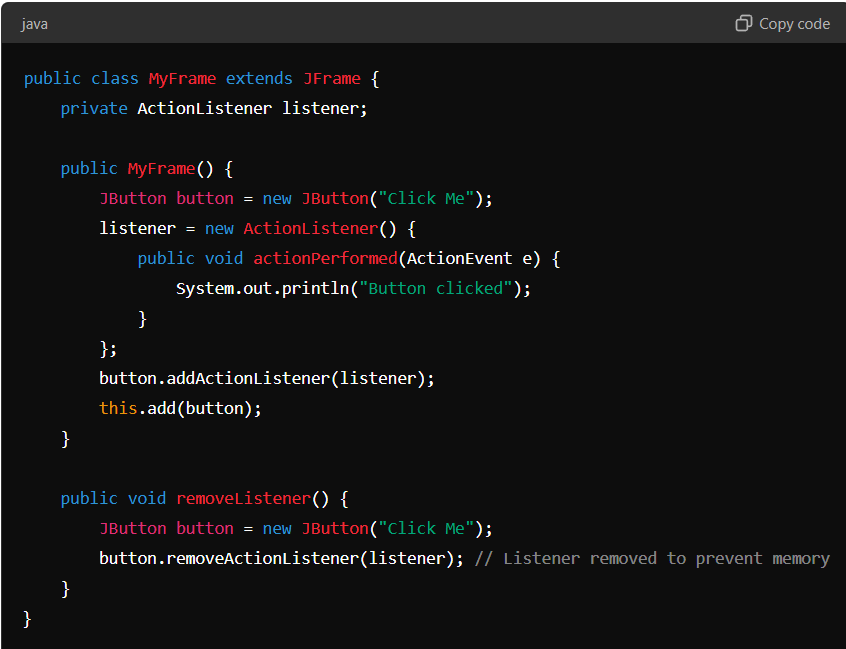

Ejemplo Resuelto:

Al mantener una referencia al oyente y eliminarlo explícitamente cuando el botón ya no es necesario, se mitiga la posibilidad de una pérdida de memoria.

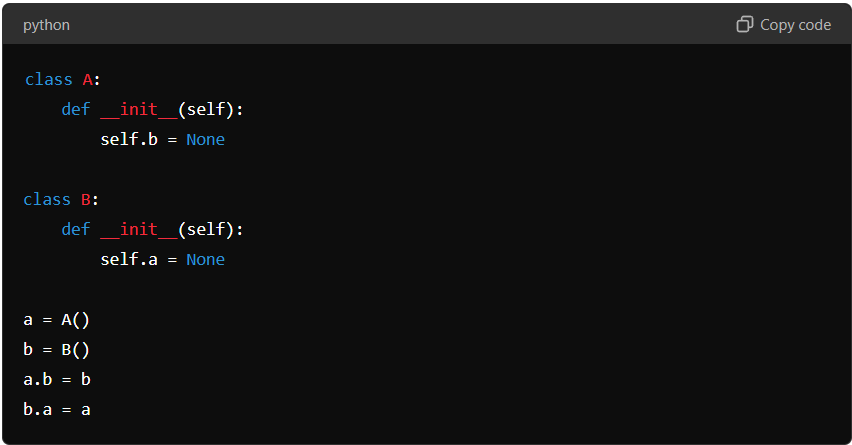

Ejemplo de Python: referencia circular

Ejemplo de pérdida de memoria:

En este ejemplo, a y b contienen referencias entre sí, lo que crea una referencia circular. Esto puede evitar que el recolector de elementos no utilizados de Python libere los objetos, lo que causaría una pérdida de memoria.

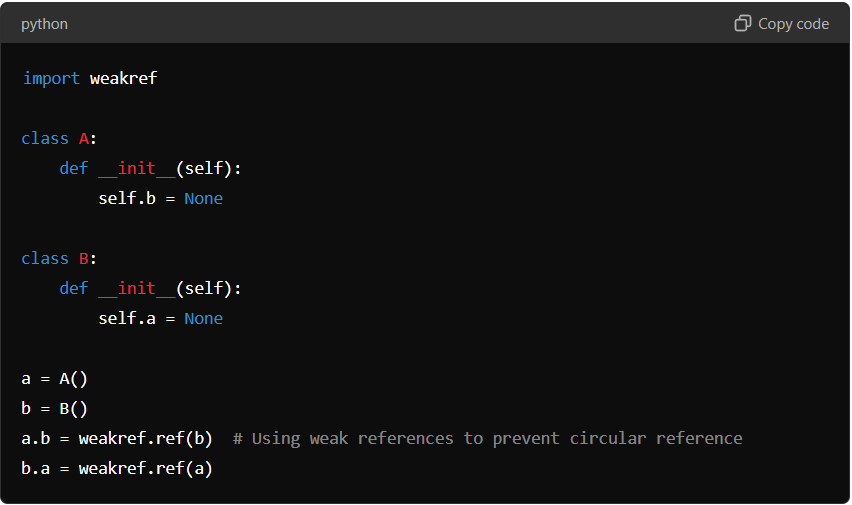

Ejemplo Resuelto:

Al utilizar weakref, se rompe la referencia circular, lo que permite que el recolector de basura recupere la memoria cuando los objetos ya no están en uso.

SMART TS XL:Una herramienta para la detección y resolución eficaz de pérdidas de memoria

SMART TS XL Puede mejorar significativamente el proceso de detección y resolución de fugas de memoria. A continuación, se muestra cómo se puede integrar esta herramienta en el flujo de trabajo de desarrollo:

Análisis de código estático: SMART TS XL ofrece Capacidades avanzadas de análisis estático, que permite identificar posibles fugas de memoria mediante el análisis del código. A diferencia de otras herramientas, proporciona información más detallada y una detección más precisa de patrones que pueden provocar fugas de memoria.

Diagrama de flujo de construcción: SMART TS XL puede generar diagramas de flujo automáticamente que visualizan los procesos de asignación y desasignación de memoria dentro de su código. Esta función es particularmente útil para comprender escenarios complejos de administración de memoria e identificar dónde pueden ocurrir fugas.

Análisis de impacto: Con SMART TS XL, puede Realizar análisis de impacto para ver cómo los cambios en una parte del código pueden afectar la gestión de memoria en otras áreas. Esto es especialmente beneficioso en proyectos grandes donde incluso cambios menores pueden tener repercusiones significativas en el uso de memoria.

Mejora de la calidad del código:Más allá de simplemente detectar fugas, SMART TS XL Proporciona sugerencias para Mejorar la calidad general del código, ayudándole a escribir código más sólido, fácil de mantener y resistente a fugas.

Incorporando SMART TS XL En su proceso de desarrollo, puede reducir significativamente el riesgo de fugas de memoria y garantizar que sus aplicaciones permanezcan estables y eficientes. Ya sea que esté lidiando con la administración manual de memoria en C++ o manejando referencias de objetos en lenguajes administrados como Java y Python, SMART TS XL ofrece las herramientas que necesita para mantener altos estándares de gestión de memoria y calidad general del código.