Los panoramas de software empresarial que entran en 2026 siguen creciendo en complejidad estructural en lugar de simplicidad. Décadas de lógica acumulada, lenguajes de programación mixtos, modelos de implementación híbridos y dependencias estrechamente acopladas limitan cada vez más la posibilidad de introducir cambios sin consecuencias imprevistas. En este entorno, las herramientas de análisis de código estático ya no se consideran controles de calidad opcionales, sino instrumentos fundamentales para comprender el comportamiento real de los sistemas antes de iniciar cualquier modernización, refactorización o iniciativa de seguridad.

Lo que diferencia el análisis de código estático a escala empresarial de las herramientas orientadas al desarrollador no es la capacidad de detectar defectos aislados, sino la capacidad de analizar todo el conjunto de aplicaciones. Las grandes organizaciones rara vez operan con un único entorno de ejecución o patrón arquitectónico. Las cargas de trabajo por lotes de mainframe coexisten con servicios distribuidos, las interfaces heredadas se intersecan con las API nativas de la nube, y los requisitos regulatorios imponen restricciones adicionales sobre cómo medir y mitigar el riesgo. Por lo tanto, el análisis estático debe operar a través de los límites, exponiendo rutas de ejecución, dependencias ocultas y riesgos estructurales que, de otro modo, serían invisibles mediante pruebas únicamente.

SMART TS XL

Solución ideal de análisis de código estático para empresas con grandes sistemas y activos distribuidos

Explora ahoraEl creciente énfasis en la entrega continua y la modernización acelerada ha elevado aún más el papel de la información basada en el análisis. A medida que las empresas buscan una visión más amplia modernización de aplicaciones En las iniciativas, el coste de una comprensión incompleta se hace cada vez más evidente. Las decisiones de refactorización, tomadas sin una visibilidad completa del flujo de control, la propagación de datos o el acoplamiento entre sistemas, suelen generar inestabilidad, regresiones del rendimiento o riesgos de cumplimiento normativo que solo se manifiestan tras la implementación. Ahora se espera que las herramientas de análisis de código estático reduzcan esta incertidumbre al proporcionar claridad arquitectónica antes de ejecutar el cambio.

En este contexto, los criterios para evaluar las herramientas de análisis de código estático en 2026 están cambiando. La precisión por sí sola no basta. Las empresas requieren análisis profundos, escalabilidad a través de millones de líneas de código, compatibilidad con entornos heterogéneos y la capacidad de traducir los hallazgos técnicos en información práctica para arquitectos, líderes de plataforma y responsables de riesgos. La siguiente comparación examina el rendimiento de las principales herramientas de análisis de código estático empresarial frente a estas demandas cambiantes y cómo sus capacidades se alinean con las realidades de los sistemas críticos a gran escala.

Comparación y clasificación de herramientas de análisis de código estático empresarial para 2026

La siguiente comparación evalúa las principales herramientas de análisis de código estático según criterios relevantes en entornos empresariales a gran escala, en lugar de en equipos de desarrollo individuales. Cada herramienta se evalúa en función de la profundidad del análisis, la escalabilidad en sistemas heterogéneos, la compatibilidad con plataformas heredadas y modernas, y su capacidad para extraer información valiosa de estructuras de dependencia complejas. La clasificación refleja la eficacia de estas herramientas para comprender la arquitectura, identificar riesgos y tomar decisiones informadas en entornos donde el cambio conlleva importantes consecuencias operativas y regulatorias.

SMART TS XL

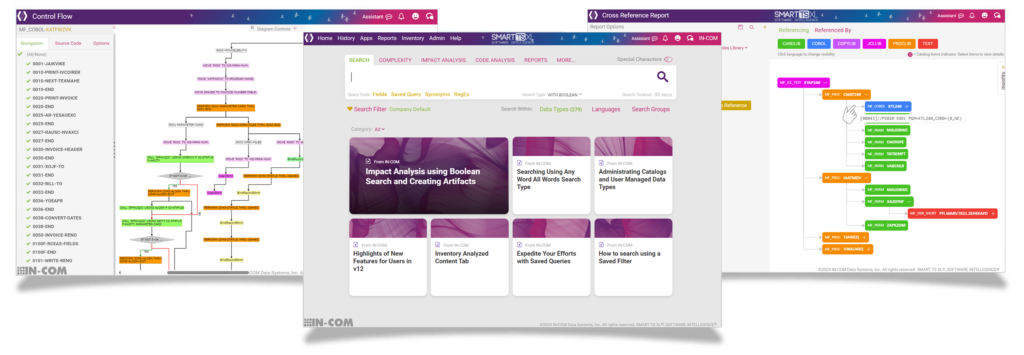

SMART TS XL Es una plataforma empresarial de análisis de código estático, evaluación de impacto e inteligencia de aplicaciones diseñada para entornos de software heterogéneos a gran escala. Está diseñada para dar soporte a organizaciones que operan en entornos mainframe, de rango medio y distribuidos, donde décadas de lógica acumulada, procesamiento por lotes y dependencias multiplataforma hacen que los cambios sean inherentemente riesgosos. En lugar de centrarse en hallazgos aislados sobre la calidad del código, SMART TS XL Está diseñado para exponer cómo se comportan realmente las aplicaciones al hacer visibles las rutas de ejecución, las relaciones de datos y las estructuras de dependencia en carteras completas.

La plataforma funciona como un sistema web de alto rendimiento capaz de indexar y analizar miles de millones de líneas de código y artefactos asociados en segundos. Al descargar las cargas de análisis de los sistemas de producción y centralizar la información en un entorno compartido, SMART TS XL Admite miles de usuarios simultáneos sin reducir el rendimiento. Esta escalabilidad lo hace ideal no solo para equipos de desarrollo, sino también para arquitectos, responsables de modernización, soporte de producción, auditores y responsables de cumplimiento normativo que requieren una visibilidad consistente y basada en la evidencia de sistemas complejos. Solicitar una demo.

Análisis y descubrimiento estático a escala empresarial

En esencia, SMART TS XL Proporciona un análisis estático profundo en una amplia gama de lenguajes de programación, construcciones de control de trabajos, bases de datos y artefactos de soporte. Es compatible con tecnologías heredadas y modernas, como COBOL, PL/I, Natural, RPG, ensamblador, Java, C#, Python, VB6, scripts de UNIX, JCL, PROC, artefactos CICS, definiciones MQ, esquemas de bases de datos y documentos estructurados. El código fuente, la lógica de lotes, los archivos de configuración e incluso artefactos no codificados, como documentación y diagramas, se pueden indexar y analizar conjuntamente, lo que permite descubrir relaciones entre repositorios tradicionalmente aislados.

Esta capacidad de descubrimiento unificado permite a las organizaciones ir más allá de la inspección a nivel de archivo y alcanzar la comprensión a nivel de sistema. Se pueden rastrear programas, trabajos, campos, archivos, tablas y mensajes entre plataformas, lo que revela cómo fluye la lógica de negocio a través de cadenas de lotes, transacciones en línea y procesos de generación de informes posteriores. Estas relaciones se revelan mediante informes interactivos de referencias cruzadas, mapas de dependencias y vistas de ejecución navegables, en lugar de listas estáticas.

Análisis de impacto multiplataforma y mapeo de dependencias

SMART TS XL Se hace especial hincapié en el análisis de impacto multiplataforma. Los cambios introducidos en una parte de una aplicación rara vez permanecen aislados en entornos empresariales, especialmente donde las cargas de trabajo del mainframe interactúan con servicios distribuidos y almacenes de datos compartidos. SMART TS XL analiza las relaciones de llamadas, el uso de datos, las rutas de ejecución de trabajos y el flujo de control para identificar zonas de impacto ascendentes y descendentes en todos los idiomas y sistemas.

Las capacidades de mapeo de dependencias presentan estas relaciones visualmente mediante diagramas interactivos con código de colores que resaltan los emisores, receptores, productores y consumidores de datos. El análisis de impacto puede iniciarse desde un programa, un campo, un elemento de la base de datos, un paso de trabajo o incluso desde los resultados de una búsqueda, lo que permite a los equipos definir el alcance de los cambios con precisión antes de comenzar el desarrollo. Este enfoque reduce las dependencias omitidas, limita el exceso de pruebas y proporciona una base sólida para la planificación de cambios y la evaluación de riesgos.

Vistas orientadas a la ejecución de la lógica de lotes y programas

Para entornos con procesamiento por lotes complejo, SMART TS XL Proporciona comprensión del estilo de ejecución sin necesidad de ejecutar código. Las capacidades de expansión de COBOL y JCL resuelven copybooks, PROCs, símbolos y anulaciones para presentar la lógica tal como se ejecuta eficazmente en producción. Las cadenas de lotes se pueden rastrear de principio a fin, revelando qué programas se ejecutan, en qué orden y con qué parámetros.

Los diagramas de flujo de control y los diagramas de flujo traducen la lógica profundamente anidada en representaciones visuales fáciles de navegar. Estas vistas permiten comprender el comportamiento de la ejecución, identificar rutas de código inactivas o inaccesibles y analizar la complejidad de las ramificaciones sin depender de conocimientos especializados ni de guías manuales. Los diagramas de seguimiento de campos amplían aún más esta capacidad al rastrear cómo se crean, transforman y propagan los elementos de datos entre programas, trabajos y bases de datos, lo que facilita cambios estructurales seguros y revisiones regulatorias.

Búsqueda avanzada, detección de patrones y análisis de precisión

SMART TS XL Incluye un motor de búsqueda empresarial de alto rendimiento optimizado para bases de código extensas y de tecnología mixta. Admite lógica booleana compleja, búsquedas de proximidad, búsquedas por bloques, expresiones regulares, gestión de sinónimos y filtros precisos que restringen el análisis a lenguajes, tipos de datos o secciones de código específicos. Las técnicas de búsqueda por capas permiten a los usuarios reducir progresivamente grandes conjuntos de resultados a ámbitos precisos, adecuados para análisis de impacto, auditorías o evaluaciones de modernización.

Estas capacidades de búsqueda están estrechamente integradas con funciones de referencia cruzada, impacto, complejidad y visualización. Los resultados se pueden integrar directamente en vistas de dependencia, informes o flujos de trabajo de análisis adicionales, lo que reduce la fricción entre el descubrimiento y la toma de decisiones. Las consultas guardadas y parametrizadas permiten a las organizaciones estandarizar las comprobaciones de riesgos y los patrones de análisis repetibles en todos los equipos y proyectos.

Análisis de complejidad y cuantificación de riesgos

SMART TS XL Proporciona un análisis de complejidad a nivel de portafolio que va más allá de los programas individuales. Se pueden calcular métricas de complejidad como líneas de código, complejidad ciclomática y medidas de Halstead en subconjuntos específicos de aplicaciones definidos por resultados de búsqueda o zonas de impacto. Esto permite a los equipos cuantificar el riesgo técnico dentro de funciones de negocio específicas o candidatos a modernización, en lugar de basarse en promedios aproximados de toda la aplicación.

Al combinar métricas de complejidad con análisis de dependencia e impacto, SMART TS XL Permite una estimación y priorización de esfuerzos más realistas. Las áreas con alto acoplamiento y alta complejidad se pueden identificar con antelación, lo que permite secuenciar las iniciativas de modernización y remediación basándose en el riesgo estructural real, en lugar de suposiciones.

Transferencia de conocimientos, preparación para auditorías y apoyo a la gobernanza

Un desafío recurrente en las grandes empresas es la pérdida de conocimiento institucional a medida que los sistemas envejecen y el personal experimentado se jubila o rota. SMART TS XL Se aborda este problema centralizando el conocimiento de las aplicaciones en una plataforma explorable y con capacidad de búsqueda que captura la estructura y el comportamiento de los sistemas. Se puede generar y compartir documentación, informes, diagramas y evidencias para facilitar la incorporación, las auditorías y las solicitudes regulatorias.

Las capacidades de exportación permiten empaquetar los resultados de los análisis como artefactos con marca de tiempo y listos para la evidencia, ideales para revisiones de cumplimiento, aprobaciones de cambios y auditorías externas. Los controles de acceso y el seguimiento del uso respaldan los requisitos de gobernanza, especialmente en entornos con desarrollo offshore o modelos de mantenimiento externalizados.

Implementación, integración y ajuste operativo

SMART TS XL Está diseñado para una implementación rápida y una mínima interrupción operativa. Las instalaciones se completan en cuestión de horas, con conectores disponibles para la ingesta de datos desde entornos mainframe, sistemas de control de código fuente distribuidos, bases de datos y repositorios compartidos. Admite cargas de datos completas e incrementales, lo que permite que los entornos se mantengan actualizados sin necesidad de intervención manual constante.

Las capacidades de automatización permiten que los procesos de análisis se ejecuten sin supervisión, lo que facilita la generación continua de información, alineada con los ciclos de cambio de la empresa. Al centralizar el análisis en una infraestructura rentable, las organizaciones pueden reducir la dependencia de costosos recursos de producción, a la vez que aumentan la profundidad analítica y la disponibilidad de todos los equipos.

Edición empresarial de SonarQube

SonarQube Enterprise Edition es una plataforma de análisis de código estático diseñada para apoyar a grandes organizaciones de desarrollo que buscan la aplicación consistente de estándares de calidad, mantenibilidad y seguridad del código en sus portafolios de software modernos. Su función principal en entornos empresariales es actuar como una capa de inspección continua integrada en los flujos de trabajo de desarrollo, proporcionando retroalimentación temprana sobre problemas de código antes de que los cambios lleguen a producción. En portafolios donde el rendimiento de la revisión se convierte en un cuello de botella, a menudo se integra con otros servicios más amplios. herramientas de revisión de código para formalizar el control de calidad y reducir la variación entre equipos.

A diferencia de las plataformas de análisis a nivel de portafolio, la fortaleza de SonarQube reside en su capacidad para operar cerca del flujo de trabajo del desarrollador. El análisis suele activarse como parte de los pipelines de compilación o la validación de solicitudes de extracción, lo que permite a los equipos detectar olores de código, errores y problemas de seguridad gradualmente a medida que el código evoluciona. Esto se alinea con las organizaciones que estandarizan las comprobaciones automatizadas en los pipelines de entrega, incluyendo los enfoques descritos en pipelines de CI / CD, donde el análisis estático se convierte en un control repetible en lugar de un paso de revisión ad hoc.

Análisis estático basado en reglas y puertas de calidad

En el núcleo de SonarQube Enterprise Edition se encuentra un motor de análisis estático basado en reglas que evalúa el código fuente con un amplio conjunto de reglas configurables. Estas reglas cubren categorías comunes como problemas de mantenimiento, defectos de fiabilidad y vulnerabilidades de seguridad. Los hallazgos se clasifican por gravedad y se asignan a criterios de calidad que determinan si el código puede avanzar en el proceso de entrega.

Los controles de calidad son un mecanismo fundamental para aplicar los estándares organizacionales a gran escala. Las empresas pueden definir umbrales para la nueva cobertura de código, la densidad de defectos y la exposición a vulnerabilidades, garantizando así que los cambios cumplan con los criterios predefinidos antes de la integración. Esta capacidad es especialmente valiosa en entornos con equipos distribuidos, desarrollo externalizado o alta rotación de desarrolladores, donde un control constante reduce la dependencia de las revisiones manuales.

Cobertura lingüística e integración del ecosistema de desarrollo

SonarQube es compatible con una amplia gama de lenguajes de programación modernos, como Java, C#, JavaScript, TypeScript, Python y otros de uso común en el desarrollo de aplicaciones empresariales. Su ecosistema de plugins e integraciones le permite conectarse con plataformas de CI/CD, sistemas de control de código fuente y sistemas de seguimiento de incidencias populares. Esta estrecha integración lo hace ideal para organizaciones que priorizan el control de calidad automatizado en sus procesos de entrega.

Sin embargo, el modelo de análisis de SonarQube se centra principalmente en el código fuente y en el repositorio. Si bien puede analizar múltiples proyectos en paralelo, su comprensión de las relaciones entre repositorios, plataformas y contextos de ejecución es limitada. El análisis suele limitarse a aplicaciones o servicios individuales, en lugar de abarcar entornos empresariales completos con datos compartidos, flujos de trabajo por lotes o dependencias multiplataforma.

Análisis de seguridad y soporte de cumplimiento

En sus ediciones empresariales, SonarQube incluye funciones mejoradas de análisis de seguridad, alineadas con las categorías de vulnerabilidad más comunes. Puede identificar patrones asociados con fallos de inyección, configuraciones inseguras y uso indebido de API. Los hallazgos se presentan en un formato accesible tanto para desarrolladores como para equipos de seguridad, lo que facilita los flujos de trabajo de remediación dentro de las herramientas existentes.

Desde la perspectiva del cumplimiento normativo, SonarQube proporciona trazabilidad e informes que ayudan a demostrar el cumplimiento de los estándares de codificación internos y las políticas de seguridad. Se pueden generar informes para mostrar las tendencias de los problemas, el progreso de la remediación y el cumplimiento de los controles de calidad a lo largo del tiempo. Si bien estas funciones facilitan la preparación para auditorías en los equipos de desarrollo, se centran menos en generar evidencia a nivel de sistema sobre el comportamiento de ejecución o el impacto entre sistemas.

Características de escalabilidad y consideraciones operativas

SonarQube Enterprise Edition está diseñado para escalar entre un gran número de repositorios y equipos de desarrollo, especialmente al implementarse en entornos distribuidos o en contenedores. Su rendimiento se adapta a la infraestructura disponible, lo que lo hace ideal para organizaciones con altos volúmenes de compromiso y ciclos de análisis frecuentes. Los paneles centralizados proporcionan visibilidad agregada de todos los proyectos, lo que ayuda a los líderes a supervisar las tendencias de calidad a un alto nivel.

Dicho esto, la escalabilidad de SonarQube es principalmente horizontal entre proyectos, en lugar de vertical entre la complejidad del sistema. No resuelve rutas de ejecución en tiempo de ejecución, lógica de orquestación por lotes ni un linaje profundo de datos entre plataformas heterogéneas. En entornos dominados por cargas de trabajo de mainframe, programación por lotes o sistemas heredados estrechamente acoplados, SonarQube se utiliza a menudo como una herramienta complementaria, en lugar de como una fuente independiente de información arquitectónica.

Casos de uso empresariales típicos y limitaciones

SonarQube Enterprise Edition es más eficaz en empresas con una sólida madurez en DevOps, stacks de desarrollo estandarizados y un enfoque en prevenir la degradación de la calidad en el código desarrollado activamente. Destaca por reforzar la consistencia, reducir los errores de código e integrar controles de calidad en los flujos de entrega dinámicos.

Sus limitaciones se hacen más evidentes en escenarios de modernización que requieren comprender cómo se propagan los cambios en sistemas grandes e interconectados. SonarQube no intenta modelar el orden de ejecución, la propagación de datos entre trabajos y plataformas, ni las cadenas de dependencia de todo el sistema. Por ello, suele combinarse con plataformas de análisis más profundas cuando las empresas necesitan evaluar el riesgo de la modernización, el impacto de los lotes o los efectos de los cambios en toda la cartera.

Checkmarx Uno

Checkmarx One es una plataforma de seguridad de aplicaciones empresarial centrada en pruebas estáticas de seguridad de aplicaciones dentro de canales de desarrollo y entrega modernos. Su función principal en grandes organizaciones es identificar vulnerabilidades de seguridad en las primeras etapas del ciclo de vida del software, especialmente en entornos donde los lanzamientos frecuentes, los equipos distribuidos y las arquitecturas nativas de la nube aumentan la exposición a vulnerabilidades explotables. En lugar de intentar modelar el comportamiento de ejecución de todo el sistema, Checkmarx One se centra en detectar patrones de codificación inseguros y debilidades de configuración que se alinean con las taxonomías de seguridad reconocidas.

La plataforma suele ser adoptada por empresas con prácticas DevSecOps consolidadas, donde se espera que el análisis de seguridad se realice de forma continua durante el desarrollo, en lugar de ser un control posterior al lanzamiento. En estos entornos, Checkmarx One funciona como un mecanismo preventivo, con el objetivo de reducir la probabilidad de que se introduzcan rutas de código vulnerables en los sistemas de producción.

Enfoque en las pruebas de seguridad de aplicaciones estáticas

Checkmarx One se basa en un motor estático de pruebas de seguridad de aplicaciones, optimizado para detectar vulnerabilidades a nivel de código fuente. El análisis se realiza sin ejecutar aplicaciones, lo que permite identificar problemas de forma temprana, a menudo durante las etapas de confirmación o compilación del código. La plataforma asigna los hallazgos a categorías de vulnerabilidad conocidas, lo que respalda a los equipos de seguridad que utilizan marcos estandarizados de clasificación de riesgos, como Vulnerabilidades de OWASP priorizar los esfuerzos de remediación.

El énfasis en hallazgos específicos de seguridad diferencia a Checkmarx One de las herramientas de análisis estático de propósito general. En lugar de destacar problemas de mantenimiento o arquitectura, la plataforma se centra en las debilidades que podrían provocar la exposición de datos, el acceso no autorizado o la escalada de privilegios. Esta especialización la hace especialmente relevante en sectores regulados donde la divulgación de vulnerabilidades y los plazos de remediación se supervisan de cerca.

Integración en pipelines de Enterprise DevSecOps

Checkmarx One está diseñado para integrarse perfectamente con los pipelines de CI/CD y los flujos de trabajo de los desarrolladores. Los análisis se pueden activar automáticamente como parte de los procesos de compilación, las solicitudes de incorporación de cambios o las puertas de lanzamiento, lo que garantiza que el análisis de seguridad se realice de forma consistente y sin intervención manual. Los resultados se muestran mediante paneles de control e integraciones con sistemas de seguimiento de incidencias, lo que permite enviar los hallazgos directamente a los equipos de desarrollo para su corrección.

Este modelo operativo centrado en pipelines permite una alta velocidad de desarrollo, manteniendo al mismo tiempo un nivel básico de garantía de seguridad. Sin embargo, el enfoque en repositorios y servicios individuales implica que el análisis generalmente se limita a bases de código discretas. Si bien esto se adapta bien a los microservicios y las arquitecturas modulares, limita la visibilidad de las dependencias entre aplicaciones o las cadenas de ejecución multiplataforma, comunes en los sistemas empresariales de larga duración.

Cobertura lingüística y orientación nativa de la nube

Checkmarx One es compatible con una amplia gama de lenguajes de programación y frameworks modernos, comúnmente utilizados en el desarrollo empresarial y nativo de la nube. Esta amplitud permite un análisis de seguridad consistente en equipos de desarrollo heterogéneos sin necesidad de múltiples herramientas especializadas. El modelo de entrega nativo de la nube de la plataforma simplifica aún más la implementación y el escalado, reduciendo la sobrecarga operativa para las organizaciones que gestionan un gran número de aplicaciones.

Dicho esto, la compatibilidad con tecnologías heredadas y entornos de procesamiento por lotes es más limitada. Los lenguajes de mainframe, las estructuras de control de trabajos y los flujos de trabajo heredados estrechamente acoplados suelen quedar fuera del alcance principal de la plataforma. Por ello, Checkmarx One suele implementarse junto con otras herramientas de análisis cuando las empresas necesitan proteger componentes modernos y heredados dentro del mismo entorno de aplicaciones.

Informes de riesgos y alineación de gobernanza

Desde una perspectiva de gobernanza, Checkmarx One ofrece funciones de generación de informes que facilitan el seguimiento de vulnerabilidades, el estado de remediación y la generación de informes de cumplimiento. Los responsables de seguridad pueden supervisar las tendencias en todas las aplicaciones, equipos y periodos, lo que ayuda a demostrar el cumplimiento de las políticas internas y las expectativas regulatorias externas. Los hallazgos se pueden agregar para mostrar la postura general de riesgo, lo que permite la priorización a nivel de cartera.

Sin embargo, estos informes se centran en la presencia de vulnerabilidades más que en el impacto operativo. La plataforma no intenta cuantificar cómo se propaga una vulnerabilidad a través de las rutas de ejecución ni cómo interactúa con el procesamiento por lotes, los flujos de datos o los sistemas posteriores. Esta distinción es importante en empresas donde comprender el radio de acción y el riesgo sistémico es tan crucial como identificar las debilidades individuales.

Casos de uso empresariales típicos y limitaciones

Checkmarx One es especialmente eficaz para empresas que buscan integrar controles de seguridad directamente en entornos de desarrollo dinámicos. Destaca por identificar problemas de seguridad a nivel de código de forma temprana, reducir la repetición de tareas y facilitar la gestión uniforme de vulnerabilidades en grandes grupos de desarrolladores. Para las organizaciones que se modernizan hacia arquitecturas nativas de la nube, proporciona un mecanismo escalable para garantizar la higiene de la seguridad.

Sus limitaciones surgen en escenarios que requieren una comprensión integral del comportamiento de las aplicaciones, las cadenas de dependencia o el impacto de la modernización en sistemas heterogéneos. En estos casos, Checkmarx One suele posicionarse como una capa de seguridad especializada en lugar de una plataforma de análisis integral, complementando herramientas centradas en el análisis de la ejecución, el mapeo de dependencias y la evaluación de riesgos estructurales.

Analizador de código estático Fortify

Fortify Static Code Analyzer es una plataforma empresarial de pruebas de seguridad de aplicaciones estáticas, diseñada para identificar vulnerabilidades de seguridad en entornos de software grandes y regulados. Su función principal en las empresas es la detección sistemática de patrones de codificación que generan riesgos de seguridad, especialmente en organizaciones donde el cumplimiento normativo, la auditabilidad y los procesos formales de gestión de riesgos determinan cómo se gestionan los cambios de software. Fortify se adopta comúnmente en sectores donde la garantía de seguridad debe ser demostrable, repetible y estar alineada con los controles empresariales establecidos.

En lugar de priorizar los ciclos de retroalimentación centrados en el desarrollador, Fortify suele posicionarse como un control de seguridad centralizado dentro de marcos de gobernanza más amplios. Apoya a las organizaciones que requieren una clasificación estandarizada de vulnerabilidades, informes consistentes y trazabilidad en grandes carteras de aplicaciones desarrolladas por equipos distribuidos o de terceros.

Motor de análisis estático centrado en la seguridad

Fortify Static Code Analyzer se basa en un motor de análisis centrado en la seguridad que inspecciona el código fuente para identificar vulnerabilidades sin ejecutar aplicaciones. El motor aplica un conjunto completo de reglas de seguridad diseñadas para detectar debilidades como fallos de inyección, manejo inseguro de datos, errores de autenticación y uso indebido de funciones criptográficas. Los hallazgos se clasifican por gravedad y tipo, lo que permite a los equipos de seguridad evaluar el riesgo de forma estructurada y coherente.

El énfasis en la corrección de la seguridad diferencia a Fortify de las herramientas de análisis estático de uso general. La profundidad del análisis se centra en la identificación de condiciones explotables, en lugar de problemas de mantenimiento o arquitectura. Esta especialización hace que Fortify sea especialmente adecuado para entornos donde se prioriza la detección de vulnerabilidades sobre una comprensión más amplia del sistema.

Alineación con los programas de riesgo empresarial y cumplimiento

Fortify se integra frecuentemente en programas de seguridad y gobernanza empresarial, donde el riesgo de software se gestiona junto con otros riesgos operativos y regulatorios. Sus capacidades de generación de informes y evidencia respaldan auditorías internas, evaluaciones externas y revisiones regulatorias. Los resultados se pueden agregar entre aplicaciones y unidades de negocio, lo que proporciona a los líderes de seguridad visibilidad de la exposición al riesgo a gran escala.

Esta alineación con lo formal Gestión de riesgos de TI Los procesos hacen de Fortify una opción común en organizaciones que deben demostrar la eficacia continua del control. Los informes permiten mostrar las tendencias de vulnerabilidades, el progreso de la remediación y el cumplimiento de las políticas de seguridad internas, lo que facilita la toma de decisiones justificables durante auditorías o revisiones de incidentes.

Cobertura lingüística y características de implementación

Fortify Static Code Analyzer es compatible con una amplia gama de lenguajes de programación comunes en entornos empresariales, incluyendo tanto pilas de aplicaciones modernas como tecnologías heredadas seleccionadas. Esto permite a las organizaciones aplicar un enfoque de análisis de seguridad consistente en diversos equipos de desarrollo y dominios tecnológicos. Los modelos de implementación varían, y Fortify suele instalarse localmente o en entornos empresariales controlados para cumplir con los requisitos de residencia de datos y seguridad.

Sin embargo, el análisis generalmente se realiza a nivel de aplicación o proyecto. Si bien Fortify puede escalar en múltiples aplicaciones, no intenta resolver el orden de ejecución, la orquestación de lotes ni los flujos de datos entre aplicaciones. Por lo tanto, su perspectiva sobre el riesgo se centra en los artefactos del código, en lugar del comportamiento de todo el sistema.

Integración en ciclos de vida de desarrollo seguros

Fortify suele integrarse en los ciclos de vida de desarrollo seguro como un mecanismo de control, en lugar de una herramienta de exploración continua. Los análisis pueden activarse en etapas definidas, como revisiones previas al lanzamiento, ventanas de cambios importantes o puntos de control de cumplimiento. Este modelo operativo se adapta a las organizaciones que priorizan los procesos de lanzamiento controlados y las aprobaciones formales en lugar de la implementación continua.

Si bien existen integraciones con herramientas de CI/CD, los patrones de uso de Fortify suelen reflejar un equilibrio entre la automatización y la supervisión centralizada. Los hallazgos de seguridad son revisados por equipos especializados que evalúan los requisitos de remediación y las decisiones de aceptación de riesgos, lo que refuerza la coherencia de la gobernanza en toda la empresa.

Casos de uso empresariales típicos y limitaciones

Fortify Static Code Analyzer es más eficaz en empresas donde la garantía de seguridad, la preparación para auditorías y el cumplimiento normativo son factores clave. Ofrece un enfoque estructurado y justificable para identificar vulnerabilidades de seguridad a nivel de código y demostrar que existen controles para detectarlas y abordarlas.

Sus limitaciones se hacen evidentes en escenarios que requieren comprender cómo interactúan las vulnerabilidades con el comportamiento de ejecución, el procesamiento por lotes o las dependencias multiplataforma. Fortify no modela el comportamiento en tiempo de ejecución ni el impacto en todo el sistema, y suele complementarse con herramientas que ofrecen una visión más profunda de la estructura de la aplicación, las cadenas de dependencia y el riesgo de modernización en entornos heterogéneos.

Destacado de CAST

CAST Highlight es una plataforma de inteligencia de aplicaciones empresariales y evaluación de portafolios diseñada para proporcionar una visibilidad de alto nivel sobre la calidad del software, el riesgo y la preparación para la modernización en grandes conjuntos de aplicaciones. Su función principal en entornos empresariales es respaldar la toma de decisiones estratégicas mediante el resumen de las características estructurales, los indicadores de deuda técnica y las señales de idoneidad para la nube, en lugar de realizar un análisis de código exhaustivo orientado a la ejecución. CAST Highlight se suele adoptar en las primeras etapas de los programas de modernización para establecer una comprensión básica del estado del portafolio.

A diferencia de las herramientas de análisis estático centradas en el desarrollador, CAST Highlight opera a nivel agregado. Su objetivo es ayudar a arquitectos, gestores de cartera y líderes de transformación a comparar aplicaciones, identificar candidatos para la modernización y priorizar las iniciativas de remediación en cientos o miles de sistemas.

Análisis a nivel de cartera e inteligencia de software

En el núcleo de CAST Highlight se encuentra un motor de análisis ligero que extrae metadatos estructurales del código fuente de la aplicación y los artefactos de configuración. Estos datos se normalizan en un modelo analítico común que permite evaluar diversas aplicaciones con criterios consistentes. Las métricas relacionadas con la calidad del código, la mantenibilidad, la exposición a la seguridad y la idoneidad arquitectónica se calculan y presentan mediante paneles y vistas comparativas.

Estas capacidades se alinean con objetivos más amplios inteligencia de software Iniciativas cuyo objetivo es transformar artefactos de código sin procesar en información útil para la toma de decisiones para las partes interesadas que no son desarrolladores. Al abstraer la complejidad en indicadores estandarizados, CAST Highlight permite a los equipos de liderazgo analizar grandes carteras sin necesidad de realizar inspecciones detalladas del código.

Evaluación de la preparación para la modernización y la idoneidad de la nube

CAST Highlight pone especial énfasis en evaluar la modernización y la preparación para la migración a la nube de las aplicaciones. Evalúa factores como el uso del framework, los patrones de dependencia y la vigencia de la tecnología para estimar el esfuerzo y el riesgo asociados a la migración de aplicaciones a plataformas modernas. Los resultados se utilizan a menudo para agrupar las aplicaciones en categorías como rehosting, refactorización, reemplazo o retiro.

Este enfoque basado en la evaluación facilita la planificación y presupuestación en las etapas iniciales. Las empresas pueden utilizar los resultados de CAST Highlight para crear planes de modernización, estimar el alcance de la transformación y comunicar los perfiles de riesgo a las partes interesadas. Sin embargo, el análisis es intencionalmente amplio y no pretende modelar el comportamiento detallado de la ejecución ni los efectos secundarios de la transformación.

Indicadores de deuda técnica y de seguridad

Además de las señales de modernización, CAST Highlight proporciona indicadores de alto nivel relacionados con las debilidades de seguridad y la deuda técnica. Estos indicadores se derivan de patrones conocidos asociados con un mayor coste de mantenimiento o una mayor exposición a vulnerabilidades. El objetivo no es reemplazar las herramientas de análisis de seguridad especializadas, sino destacar las áreas donde se justifica una investigación más profunda.

Dado que los hallazgos son agregados, son más adecuados para el análisis comparativo que para la planificación de remediación. Los indicadores de seguridad y deuda ayudan a las organizaciones a comprender la distribución relativa del riesgo entre las carteras, pero no identifican rutas de ejecución específicas, flujos de datos ni dependencias operativas que se verían afectadas por los cambios en el código.

Escalabilidad y modelo operativo

CAST Highlight está diseñado para escalar eficientemente en portafolios de aplicaciones muy amplios. Su enfoque de análisis ligero minimiza la sobrecarga de procesamiento y permite la rápida integración de nuevas aplicaciones. Esto lo hace especialmente adecuado para empresas que realizan estudios exhaustivos de sus entornos de software durante fusiones, desinversiones o iniciativas de modernización temprana.

La contrapartida de esta escalabilidad es la profundidad analítica. CAST Highlight no resuelve gráficos de llamadas, cadenas de ejecución por lotes ni la propagación de datos entre plataformas. Por ello, suele utilizarse junto con herramientas de análisis más profundas una vez que las aplicaciones o iniciativas de transformación específicas pasan de la fase de planificación a la de ejecución.

Casos de uso empresariales típicos y limitaciones

CAST Highlight es más eficaz en empresas que necesitan una visión comparativa de alto nivel de las carteras de aplicaciones para respaldar la planificación estratégica. Destaca en la identificación de candidatos para la modernización, la estimación de la complejidad de la transformación y la comunicación de riesgos técnicos a las partes interesadas sin conocimientos técnicos.

Sus limitaciones se hacen evidentes cuando las organizaciones requieren una comprensión precisa de cómo los cambios afectan el comportamiento de ejecución, las cadenas de dependencia o la estabilidad operativa. CAST Highlight no proporciona la información a nivel de ejecución necesaria para implementar de forma segura actividades de refactorización o modernización, y suele complementarse con herramientas que se centran en el análisis detallado del impacto y la visibilidad del comportamiento en aplicaciones seleccionadas.

Imágenes CAST

CAST Imaging es una plataforma de inteligencia de aplicaciones empresariales centrada en el análisis arquitectónico y la visualización de dependencias estructurales en sistemas de software complejos. Su función principal en grandes organizaciones es revelar cómo se ensamblan las aplicaciones, cómo interactúan los componentes y dónde el acoplamiento estructural supone un riesgo. CAST Imaging es utilizado habitualmente por arquitectos y equipos de modernización que requieren una comprensión integral de la estructura de la aplicación antes de planificar iniciativas de refactorización, migración o descomposición.

En lugar de funcionar como una herramienta de inspección de código o escaneo de seguridad, CAST Imaging se centra en la comprensión arquitectónica. Transforma el código fuente y los artefactos de configuración en modelos navegables que ilustran las relaciones entre componentes, capas y tecnologías, permitiendo a las partes interesadas analizar la complejidad a escala.

Mapeo arquitectónico y visualización de dependencias

La clave de CAST Imaging reside en su capacidad para generar representaciones arquitectónicas detalladas de aplicaciones y portafolios de aplicaciones. Estas representaciones incluyen diagramas de componentes, mapas de interacción y vistas en capas que revelan cómo los módulos se comunican y dependen entre sí. Al visualizar las relaciones estructurales, CAST Imaging permite a los equipos identificar acoplamientos estrechos, dependencias circulares y violaciones arquitectónicas difíciles de detectar mediante análisis a nivel de archivo.

Estos modelos visuales se alinean estrechamente con las prácticas centradas en gráficos de dependencia, donde comprender las interconexiones estructurales es esencial para gestionar el riesgo en sistemas grandes. CAST Imaging permite a los usuarios explorar las dependencias de forma interactiva, pasando de vistas arquitectónicas de alto nivel a representaciones más granulares según sea necesario.

Cobertura multitecnológica y multiaplicación

CAST Imaging admite el análisis en una amplia gama de lenguajes de programación, frameworks y plataformas comunes en entornos empresariales. Esta amplitud le permite modelar sistemas heterogéneos compuestos por componentes heredados, servicios distribuidos y bases de datos compartidas. Las capacidades de análisis entre aplicaciones permiten a los equipos comprender cómo se integran los sistemas individuales en carteras más amplias y cómo los cambios en una aplicación pueden influir en otras.

Sin embargo, el análisis sigue siendo estructural, no conductual. CAST Imaging modela relaciones estáticas entre componentes, pero no simula el orden de ejecución, las condiciones de ejecución ni la lógica de programación por lotes. Por lo tanto, proporciona claridad sobre cómo se conectan los sistemas, pero no necesariamente sobre su comportamiento durante la ejecución.

Apoyo a la modernización y gobernanza arquitectónica

CAST Imaging se utiliza con frecuencia para respaldar iniciativas de modernización donde la claridad arquitectónica es un requisito previo para el cambio. Al detectar infracciones de los principios arquitectónicos e identificar áreas de acoplamiento excesivo, ayuda a los equipos a planificar estrategias de transformación incremental. Esta información puede fundamentar decisiones sobre la extracción de servicios, el rediseño de interfaces o la migración por fases.

En contextos de gobernanza, CAST Imaging también puede utilizarse para evaluar el cumplimiento arquitectónico con los estándares definidos. Es posible identificar y documentar las desviaciones de las arquitecturas objetivo, lo que facilita la supervisión y la planificación de soluciones. Esto lo hace valioso en organizaciones que implementan controles arquitectónicos como parte de sus procesos de gestión de cambios.

Consideraciones sobre escalabilidad y modelado de cartera

La plataforma está diseñada para escalar en aplicaciones y portafolios de gran tamaño, generando modelos arquitectónicos que pueden compartirse entre las partes interesadas. Su enfoque centrado en la visualización facilita el análisis y la comunicación colaborativos, especialmente al explicar estructuras complejas a públicos no desarrolladores.

La desventaja de esta escalabilidad es la limitada comprensión de la dinámica operativa. CAST Imaging no resuelve el linaje de datos a nivel de campo, ni rastrea los flujos de ejecución por lotes, ni cuantifica el impacto de los cambios en el tiempo de ejecución. Para iniciativas que requieren una determinación precisa del impacto de los cambios o la validación del comportamiento de ejecución, suelen requerirse herramientas de análisis adicionales.

Casos de uso empresariales típicos y limitaciones

CAST Imaging es más eficaz en empresas que necesitan comprender y racionalizar la arquitectura de sus aplicaciones antes de implementar cambios significativos. Destaca por revelar la complejidad estructural, guiar la refactorización arquitectónica y respaldar la planificación de la modernización en sistemas heterogéneos.

Sus limitaciones se hacen evidentes cuando las organizaciones requieren información a nivel de ejecución, evaluación de impacto o validación de cómo se propagan los cambios a través del comportamiento en tiempo de ejecución. CAST Imaging proporciona un mapa estructural en lugar de un plan operativo, y suele complementarse con herramientas que ofrecen un análisis más profundo de las rutas de ejecución, el flujo de datos y el comportamiento del sistema.

Análisis estático de Veracode

Veracode Static Analysis es una plataforma de pruebas de seguridad de aplicaciones estáticas nativa de la nube, diseñada para integrar controles de seguridad directamente en los procesos de entrega de software modernos. Su función principal en entornos empresariales es identificar vulnerabilidades de seguridad de forma temprana y continua en grandes volúmenes de código de aplicación, especialmente en organizaciones que priorizan ciclos de lanzamiento rápidos, equipos de desarrollo distribuidos y una supervisión de seguridad centralizada. Veracode se adopta comúnmente cuando la seguridad debe escalar sin afectar la velocidad de desarrollo.

La plataforma prioriza la automatización y la consistencia, posicionando el análisis estático como un control de seguridad permanente en lugar de una actividad de revisión periódica. Este modelo operativo se adapta a las empresas que han estandarizado el uso de herramientas de desarrollo en la nube y requieren una visibilidad centralizada de la seguridad de las aplicaciones en diversos equipos y proyectos.

Pruebas de seguridad de aplicaciones estáticas nativas de la nube

El núcleo del Análisis Estático de Veracode es un motor de análisis de seguridad estático, distribuido íntegramente como un servicio en la nube gestionado. El código fuente y los binarios se cargan para su análisis, donde se inspeccionan en busca de vulnerabilidades como fallos de inyección, manejo inseguro de datos y debilidades de autenticación. El análisis no requiere acceso a entornos de producción, lo que permite realizar evaluaciones de seguridad en las primeras etapas del ciclo de vida sin riesgo operativo.

Este enfoque nativo de la nube permite una rápida incorporación y un escalado flexible en grandes portafolios. Las empresas pueden aplicar políticas de análisis de seguridad consistentes en cientos de aplicaciones sin necesidad de mantener una infraestructura local. Los hallazgos se normalizan y se presentan mediante paneles centralizados, lo que respalda a los equipos de seguridad responsables de la supervisión de riesgos en toda la empresa.

Integración en canales de entrega continua

Veracode está diseñado para integrarse perfectamente con los pipelines de CI/CD y las herramientas de desarrollo. Los análisis se pueden activar automáticamente durante las etapas de compilación o lanzamiento, y los resultados se devuelven en formatos que se integran con los flujos de trabajo de seguimiento y remediación de problemas. Esto respalda un modelo de seguridad de desplazamiento a la izquierda, donde las vulnerabilidades se abordan más cerca del punto de introducción.

En la práctica, el papel de Veracode dentro de los pipelines suele estar coordinado con controles de calidad y pruebas más amplios, incluidas actividades como pruebas de regresión de rendimientoPara garantizar que la aplicación de la seguridad no se realice de forma aislada de otros requisitos no funcionales. Esta alineación ayuda a las organizaciones a equilibrar el rigor de la seguridad con el rendimiento de la entrega.

Cobertura lingüística y coherencia del portafolio

El análisis estático de Veracode es compatible con una amplia gama de lenguajes y frameworks de programación modernos, comúnmente utilizados en el desarrollo de aplicaciones empresariales. Esta amplitud permite a los equipos de seguridad aplicar políticas de análisis uniformes en diferentes stacks de desarrollo, reduciendo así las brechas que podrían surgir entre equipos o plataformas.

Sin embargo, la plataforma se centra en el análisis de seguridad a nivel de aplicación. El análisis suele limitarse a aplicaciones o servicios individuales, y no se modelan las relaciones entre aplicaciones, flujos de trabajo por lotes ni estructuras de datos compartidas. Por lo tanto, Veracode ofrece una amplia cobertura de las vulnerabilidades a nivel de código, pero una visión limitada de cómo estas vulnerabilidades podrían propagarse entre sistemas interconectados.

Informes de riesgos y visibilidad de la gobernanza

Veracode ofrece funciones de generación de informes que permiten a los responsables de seguridad realizar un seguimiento de las tendencias de vulnerabilidad, el progreso de la remediación y el cumplimiento de las políticas en toda la empresa. Los paneles de control permiten visualizar la exposición al riesgo a nivel de cartera, lo que permite priorizar según la gravedad y el impacto en el negocio. Estos informes se utilizan a menudo para respaldar la gobernanza de seguridad interna, la generación de informes ejecutivos y las actividades de verificación de terceros.

Si bien estas capacidades facilitan la rendición de cuentas y la supervisión, el enfoque de los informes sigue siendo la vulnerabilidad. Veracode no intenta cuantificar el impacto operativo, la interrupción del flujo de ejecución ni el riesgo de modernización asociado con las iniciativas de remediación. Esta distinción es importante en entornos donde los cambios de seguridad deben evaluarse junto con consideraciones de estabilidad y gestión de cambios.

Casos de uso empresariales típicos y limitaciones

El análisis estático de Veracode es más eficaz en empresas que operan con alta velocidad de entrega y requieren un análisis de seguridad escalable y centralizado en las pilas de aplicaciones modernas. Destaca por aplicar estándares de seguridad consistentes, reducir el tiempo de detección de vulnerabilidades y respaldar los modelos operativos DevSecOps.

Sus limitaciones se hacen evidentes en escenarios que requieren un profundo conocimiento del comportamiento del sistema, las dependencias entre aplicaciones o el procesamiento por lotes tradicional. Veracode no proporciona información a nivel de ejecución ni mapeo de dependencias arquitectónicas, y suele posicionarse como una capa de seguridad especializada, complementada con herramientas centradas en el análisis de impacto, la visibilidad de las dependencias y la comprensión del sistema a escala empresarial.

Coverity (Sinopsis)

Coverity es una plataforma empresarial de análisis de código estático, reconocida por su capacidad para detectar defectos complejos en bases de código extensas y críticas para el rendimiento. Su función principal en entornos empresariales es identificar problemas profundos de corrección y fiabilidad que son difíciles de detectar únicamente mediante pruebas, especialmente en sistemas donde las fallas conllevan importantes consecuencias operativas, de seguridad o financieras. Coverity se adopta con frecuencia en sectores como el automotriz, el aeroespacial, las telecomunicaciones y el software de infraestructura, donde la precisión en los defectos y una baja tasa de falsos positivos son esenciales.

A diferencia de las plataformas de análisis a nivel de portafolio, Coverity se centra en la corrección a nivel de código en extensas bases de código. Está diseñada para analizar grandes volúmenes de código fuente de forma eficiente, manteniendo un alto nivel de rigor analítico, lo que la hace ideal para organizaciones que gestionan sistemas de larga duración con estrictos requisitos de fiabilidad.

Detección profunda de defectos y análisis de precisión

En el núcleo de Coverity se encuentra un motor de análisis estático optimizado para detectar defectos como corrupción de memoria, fugas de recursos, problemas de concurrencia y errores lógicos. El motor es conocido por su capacidad para analizar rutas de control complejas y escenarios de ejecución que abarcan múltiples funciones y módulos. Esta profundidad de análisis le permite identificar defectos que solo podrían manifestarse en condiciones de ejecución específicas.

El enfoque analítico de Coverity incorpora técnicas avanzadas relacionadas con ejecución simbólica, lo que le permite explorar múltiples rutas de ejecución sin ejecutar el código. Esta capacidad contribuye a su reputación de alta precisión y ayuda a reducir el ruido que suele asociarse con el análisis estático a gran escala en entornos empresariales.

Enfoque lingüístico y cobertura específica

Coverity ofrece un sólido soporte para lenguajes comúnmente utilizados en software de nivel de sistema y sensible al rendimiento, como C, C++ y Java. Este enfoque lo hace especialmente eficaz para analizar componentes de infraestructura central, sistemas embebidos y servicios backend donde los defectos de bajo nivel pueden tener un impacto considerable.

Si bien la plataforma puede escalar en grandes bases de código, su cobertura de lenguajes es más limitada que la de algunas herramientas de análisis estático de propósito general. Está menos orientada a entornos empresariales heterogéneos que incluyen lenguajes de procesamiento por lotes, entornos de scripting o tecnologías específicas de mainframe. Por ello, Coverity suele implementarse de forma selectiva dentro de las carteras, centrándose en componentes donde la precisión de los defectos es crucial.

Integración en flujos de trabajo de desarrollo empresarial

Coverity está diseñado para integrarse en los procesos de desarrollo empresarial, incluyendo los pipelines de CI/CD y los sistemas centralizados de gestión de defectos. Los análisis se pueden programar o activar automáticamente, y los hallazgos se envían a los equipos de desarrollo para su corrección. La plataforma admite el análisis incremental, lo que permite a los equipos centrarse en los problemas nuevos y, al mismo tiempo, mantener la visibilidad de los retrasos en los defectos existentes.

En muchas organizaciones, Coverity se posiciona como un control de calidad más que como una herramienta de exploración continua. Sus análisis suelen ejecutarse en hitos definidos, como antes de lanzamientos importantes o durante revisiones de calidad formales. Este patrón de uso refleja su función de garantizar la aplicación de estándares de fiabilidad en lugar de facilitar la iteración rápida.

Características de escalabilidad y rendimiento

Coverity está diseñado para gestionar bases de código muy grandes de forma eficiente, lo que lo hace ideal para empresas con millones de líneas de código crítico. Su rendimiento se adapta a la infraestructura disponible, lo que permite a las organizaciones analizar sistemas importantes sin tiempos de análisis excesivos. Los paneles centralizados proporcionan visibilidad sobre las tendencias de defectos y el progreso de la remediación en todos los proyectos.

Sin embargo, la escalabilidad de Coverity se centra en el volumen de código, no en la complejidad del sistema. No intenta modelar las dependencias entre aplicaciones, el orden de ejecución de lotes ni el linaje de datos entre plataformas. Su análisis se centra en la detección de defectos en bases de código individuales, más que en el comportamiento de todo el sistema.

Casos de uso empresariales típicos y limitaciones

Coverity es más eficaz en empresas que requieren una detección de defectos de alta fiabilidad en componentes críticos de software. Destaca por identificar problemas sutiles que podrían provocar fallos, vulnerabilidades de seguridad o comportamientos impredecibles en producción, especialmente en código de bajo nivel o sensible al rendimiento.

Sus limitaciones se hacen evidentes en iniciativas de modernización o transformación que requieren comprender cómo los cambios afectan a los sistemas interconectados. Coverity no proporciona mapeo de dependencias arquitectónicas ni análisis de impacto a nivel de ejecución, y suele complementarse con herramientas que se centran en la visibilidad del portafolio, el análisis de dependencias y la comprensión del comportamiento en entornos empresariales heterogéneos.

Prueba y autoedición de Parasoft C/C++

Parasoft C/C++test y su Plataforma de Pruebas de Desarrollo (DTP) constituyen una solución empresarial de análisis estático y pruebas de cumplimiento, diseñada para entornos de software críticos para la seguridad y altamente regulados. Su función principal en grandes organizaciones es respaldar la verificación rigurosa del código a nivel de sistema, donde los defectos pueden provocar fallos operativos, incumplimiento normativo o incidentes de seguridad. Parasoft se adopta comúnmente en sectores como el aeroespacial, el automotriz, el de defensa y el de sistemas industriales, donde el comportamiento del software debe ser demostrablemente correcto y auditable.

A diferencia de las herramientas de análisis estático de propósito general, Parasoft prioriza la conformidad con estándares definidos y objetivos de verificación. La plataforma está diseñada para entornos donde el desarrollo se rige por procesos formales, requisitos de certificación y casos de verificación documentados, en lugar de iteraciones rápidas.

Análisis estático basado en estándares y cumplimiento normativo

En el núcleo de Parasoft C/C++test se encuentra un motor de análisis estático alineado con los estándares de seguridad y codificación de la industria, como MISRA, CERT y las directrices ISO. El motor evalúa el código fuente con respecto a conjuntos de reglas estrictas que definen construcciones aceptables, patrones de uso y condiciones de error. Las infracciones se categorizan por gravedad y se asignan directamente a los requisitos de cumplimiento, lo que permite a las organizaciones demostrar el cumplimiento de las prácticas de desarrollo obligatorias.

Este enfoque basado en estándares se alinea con los entornos que dependen de verificación formal Conceptos donde la corrección se define no solo por el comportamiento funcional, sino también por el cumplimiento de las normas prescritas. Los resultados del análisis de Parasoft pueden utilizarse como evidencia en los procesos de certificación y auditoría, lo que reduce el esfuerzo de verificación manual.

Soporte lingüístico específico y profundidad de análisis específica

Parasoft C/C++test está específicamente optimizado para bases de código C y C++, lo que proporciona capacidades de análisis profundo para lenguajes comúnmente utilizados en software embebido y de sistema. Esta especialización permite a la plataforma identificar problemas de bajo nivel, como el uso indebido de memoria, errores de puntero y defectos de concurrencia, que pueden ser especialmente peligrosos en contextos críticos para la seguridad.

Si bien esta profundidad es valiosa dentro de su dominio objetivo, también limita la aplicabilidad de la plataforma en entornos empresariales más amplios. Parasoft no busca ofrecer una amplia cobertura en diversos lenguajes, entornos de procesamiento por lotes ni sistemas mainframe heredados. Por ello, suele implementarse en segmentos específicos de una cartera empresarial, en lugar de como una solución de análisis universal.

Integración con ciclos de vida de desarrollo regulados

Parasoft está diseñado para integrarse en ciclos de desarrollo estructurados que priorizan la trazabilidad, la documentación y el control de cambios. Los resultados del análisis estático pueden vincularse a requisitos, casos de prueba y sistemas de seguimiento de defectos mediante el componente DTP, lo que permite una trazabilidad integral desde la especificación hasta la verificación.

Esta integración admite modelos de desarrollo donde los cambios se introducen deliberadamente y se revisan formalmente. El análisis suele realizarse en hitos definidos, como antes de la presentación de certificaciones o lanzamientos importantes, en lugar de hacerlo continuamente en cada confirmación. Este modelo operativo refleja las prioridades de los entornos regulados, donde la previsibilidad y la seguridad priman sobre la velocidad.

Informes, trazabilidad y preparación para auditorías

La Plataforma de Pruebas de Desarrollo proporciona informes y análisis centralizados para todos los proyectos y equipos. Las métricas relacionadas con el estado de cumplimiento, las tendencias de defectos y la cobertura de la verificación pueden ser agregadas y revisadas por las partes interesadas en el control de calidad y el cumplimiento. Los informes están estructurados para respaldar las actividades de auditoría y certificación, proporcionando evidencia documentada de la ejecución y los resultados del análisis.

Sin embargo, estos informes se centran en el cumplimiento a nivel de código, más que en el comportamiento de todo el sistema. Parasoft no modela rutas de ejecución entre aplicaciones, orquestación por lotes ni dependencias multiplataforma. Su trazabilidad se centra en requisitos y estándares, más que en la interacción en tiempo de ejecución entre componentes.

Casos de uso empresariales típicos y limitaciones

Parasoft C/C++test y DTP son más eficaces en empresas donde la seguridad, la fiabilidad y el cumplimiento normativo son prioridades. Ofrecen un marco riguroso para verificar que el código crítico cumple con estándares estrictos y puede soportar una revisión formal.

Sus limitaciones se hacen evidentes en entornos que requieren una comprensión integral de sistemas grandes e interconectados o soporte para stacks tecnológicos heterogéneos. Parasoft no está diseñado para proporcionar visibilidad a nivel de portafolio ni análisis de impacto orientado a la ejecución, y suele complementarse con herramientas que se centran en las dependencias arquitectónicas, el riesgo de modernización y el comportamiento de los sistemas en entornos empresariales complejos.

Klocwork

Klocwork es una plataforma empresarial de análisis de código estático centrada en la identificación de defectos de seguridad, fiabilidad y concurrencia en bases de código extensas y complejas. Su función principal en entornos empresariales es detectar problemas que puedan comprometer la estabilidad o la seguridad del sistema, especialmente en software que opera bajo alta carga, ejecución paralela o tiempos de ejecución limitados. Klocwork se utiliza habitualmente en sectores donde el rendimiento y la precisión están estrechamente vinculados, como las telecomunicaciones, los sistemas embebidos, la infraestructura financiera y los servicios backend a gran escala.

La plataforma prioriza la detección temprana de defectos mediante análisis estático, lo que permite a las organizaciones identificar patrones problemáticos antes de que se manifiesten como fallos en tiempo de ejecución. Klocwork se posiciona generalmente como una herramienta de garantía de calidad y seguridad, más que como una solución de análisis integral.

Análisis estático orientado a la concurrencia y confiabilidad

En el núcleo de Klocwork se encuentra un motor de análisis estático diseñado para identificar defectos derivados de escenarios de ejecución complejos. Esto incluye problemas relacionados con la gestión de memoria, el manejo de recursos y la sincronización. El motor es especialmente eficaz para detectar defectos asociados con la ejecución paralela, donde las interacciones sutiles entre subprocesos pueden provocar un comportamiento impredecible.

Su capacidad para razonar sobre rutas de código concurrentes hace que Klocwork sea relevante en entornos donde el software debe funcionar de forma fiable bajo carga. Los resultados de los análisis suelen incluir hallazgos relacionados con interbloqueos, condiciones de carrera y construcciones de sincronización incorrectas. Estas capacidades respaldan a las organizaciones que buscan reducir la inestabilidad causada por defectos de concurrencia difíciles de reproducir, como... condiciones de carrera.

Enfoque lingüístico y dominios sensibles al rendimiento

Klocwork ofrece un sólido soporte para lenguajes comúnmente utilizados en software de nivel de sistema y de rendimiento crítico, como C, C++ y Java. Este enfoque se alinea con su adopción en dominios donde la corrección de bajo nivel y la eficiencia en tiempo de ejecución son cruciales. Al centrarse en un conjunto más reducido de lenguajes, la plataforma ofrece un análisis más profundo para dichos entornos en comparación con herramientas más amplias y generalizadas.

Sin embargo, esta especialización también limita su aplicabilidad en entornos empresariales heterogéneos. Klocwork no está diseñado para analizar cargas de trabajo orientadas a lotes, lenguajes de mainframe ni entornos de scripting de alto nivel, comunes en sistemas empresariales de larga duración. Por ello, suele implementarse de forma selectiva en lugar de como una solución de análisis universal.

Integración en los flujos de trabajo de calidad y seguridad empresarial

Klocwork se integra con los flujos de trabajo de desarrollo empresarial, incluyendo pipelines de CI/CD y sistemas de seguimiento de defectos. Los análisis se pueden automatizar y los resultados se envían a los equipos de desarrollo para su corrección. La plataforma admite análisis incrementales, lo que permite a los equipos centrarse en los problemas nuevos y mantener la visibilidad de los defectos existentes.

En muchas organizaciones, Klocwork se utiliza como parte de los procesos formales de control de calidad. El análisis puede activarse en etapas clave, como la validación previa al lanzamiento o en iniciativas importantes de refactorización. Este patrón de uso refleja su función de garantizar la fiabilidad y la seguridad, en lugar de apoyar la exploración arquitectónica continua.

Características de escalabilidad y alcance operativo

Klocwork está diseñado para escalar en grandes bases de código, lo que permite el análisis de sistemas importantes sin una sobrecarga de rendimiento excesiva. Los paneles centralizados proporcionan visibilidad sobre las tendencias de los defectos y el progreso de la corrección en todos los proyectos. Estas vistas facilitan la supervisión de la gestión y ayudan a los equipos a priorizar las acciones correctivas según su gravedad e impacto.

A pesar de su escalabilidad en términos de volumen de código, el alcance analítico de Klocwork se limita a aplicaciones o componentes individuales. No modela dependencias entre aplicaciones, orden de ejecución de lotes ni linaje de datos entre plataformas. Su análisis se centra en la corrección del código, no en el comportamiento de todo el sistema.

Casos de uso empresariales típicos y limitaciones

Klocwork es más eficaz en empresas que requieren una detección de alta fiabilidad de defectos de concurrencia y confiabilidad en software sensible al rendimiento. Destaca por descubrir problemas difíciles de reproducir mediante pruebas y que pueden causar fallos intermitentes o catastróficos en entornos de producción.

Sus limitaciones se hacen evidentes en iniciativas de transformación que requieren una comprensión integral de las carteras de aplicaciones, los flujos de ejecución o el impacto de la modernización. Klocwork no proporciona mapeo de dependencias arquitectónicas ni análisis de impacto a nivel de ejecución, y suele complementarse con herramientas que se centran en una comprensión más amplia del sistema y la evaluación del riesgo de cambio en entornos empresariales heterogéneos.

Análisis estático de OpenText DevOps Cloud

OpenText DevOps Cloud Static Analysis es una funcionalidad de análisis estático empresarial que forma parte de una suite más amplia de DevOps y gestión del ciclo de vida de las aplicaciones. Su función principal en grandes organizaciones es proporcionar comprobaciones estandarizadas de la calidad y seguridad del código, alineadas con los modelos de gobernanza de entrega establecidos. En lugar de funcionar como una plataforma independiente de análisis profundo, suele ser adoptada por empresas que priorizan la consolidación de la cadena de herramientas y la supervisión centralizada de los procesos de desarrollo, prueba y lanzamiento.

La plataforma se utiliza con mayor frecuencia en entornos donde la entrega de software debe cumplir con controles formales y donde la integración con las herramientas existentes de ALM, pruebas y gestión de lanzamientos es un requisito clave. Su valor reside en la consistencia y la alineación con la gobernanza, más que en un análisis exhaustivo del comportamiento o la arquitectura.

Capacidades de análisis estático orientadas a suites

En esencia, OpenText DevOps Cloud Static Analysis proporciona una inspección del código fuente basada en reglas para identificar problemas de calidad y vulnerabilidades de seguridad. El análisis se centra en categorías de defectos comunes, infracciones de estándares de codificación y patrones de vulnerabilidad que pueden detectarse sin ejecutar la aplicación. Los resultados se normalizan y se presentan mediante paneles centralizados junto con otras métricas de DevOps.

Este enfoque basado en suites apoya a las organizaciones que desean que el análisis estático funcione como un componente de un marco de control de entrega más amplio. Al integrar el análisis en una plataforma integrada, las empresas pueden aplicar estándares de referencia a todos los equipos sin necesidad de introducir herramientas adicionales en entornos ya complejos.

Integración con Enterprise Delivery Governance

Las capacidades de análisis estático de OpenText están estrechamente integradas con funciones más amplias de gestión del ciclo de vida, como el seguimiento de requisitos, las pruebas y la orquestación de versiones. Esta integración permite vincular los resultados del análisis con elementos de trabajo, defectos y aprobaciones, lo que facilita la trazabilidad durante todo el proceso de entrega. Para las organizaciones con modelos de gobernanza formales, esta alineación simplifica la supervisión y la generación de informes.

La plataforma a menudo se posiciona para soportar contenido estructurado. la gestión del cambio Procesos donde las modificaciones de software deben pasar por etapas definidas de revisión y aprobación. Los hallazgos del análisis estático se convierten en parte de la evidencia utilizada para evaluar la preparación para el lanzamiento, en lugar de ser una fuente independiente de información técnica.

Cobertura lingüística y enfoque de estandarización

OpenText DevOps Cloud Static Analysis es compatible con diversos lenguajes de programación empresarial de uso común, lo que permite la aplicación uniforme de estándares de codificación en diversos equipos de desarrollo. Su compatibilidad con lenguajes está orientada a stacks de desarrollo de aplicaciones comunes, en lugar de entornos específicos o heredados.

Si bien esta amplitud facilita la estandarización, la profundidad del análisis es relativamente limitada en comparación con herramientas especializadas. La plataforma no intenta modelar rutas de ejecución, resolver la lógica de orquestación por lotes ni analizar dependencias entre aplicaciones. Sus hallazgos son más adecuados para identificar problemas localizados en bases de código individuales.

Escalabilidad y características operativas

Diseñado para funcionar como parte de una suite en la nube, OpenText DevOps Cloud Static Analysis escala entre múltiples proyectos y equipos con administración centralizada. Esto lo hace ideal para empresas que buscan un control uniforme entre grandes grupos de desarrolladores. Su rendimiento escala con la infraestructura en la nube, lo que reduce la necesidad de recursos locales dedicados.

Sin embargo, en este contexto, la escalabilidad se refiere a la cobertura organizacional más que a la profundidad analítica. La plataforma ofrece una amplia visibilidad entre proyectos, pero una visión limitada del comportamiento de los sistemas en tiempo de ejecución o de cómo se propagan los cambios en entornos complejos e interconectados.

Casos de uso empresariales típicos y limitaciones

El Análisis Estático de OpenText DevOps Cloud es más eficaz en empresas que priorizan la gobernanza integrada de la entrega y los controles estandarizados sobre la exploración técnica exhaustiva. Es compatible con entornos donde el análisis estático es un punto de control entre muchos dentro de un proceso de lanzamiento controlado, lo que garantiza el cumplimiento constante de los requisitos básicos de calidad y seguridad.

Sus limitaciones se hacen evidentes en escenarios que requieren una comprensión detallada del comportamiento de ejecución, las cadenas de dependencia o el impacto de la modernización en sistemas heterogéneos. La plataforma no proporciona la visibilidad del comportamiento ni la evaluación del impacto necesarias para ejecutar con seguridad iniciativas de refactorización o modernización a gran escala, y suele complementarse con herramientas especializadas en análisis de ejecución y multiplataforma.

Tabla comparativa basada en la capacidad de las soluciones SCA

| Capacidad | SMART TS XL | SonarQube Ent | Checkmarx Uno | Fortificar SCA | Destacado de CAST | Imágenes CAST | Veracódigo | Cobertura | parasoft | Klocwork | OpenText |

|---|---|---|---|---|---|---|---|---|---|---|---|

| Escala de cartera empresarial | ✅ Excelente | ◐ Moderado | ◐ Moderado | ◐ Moderado | ✅ Excelente | ✅ Excelente | ◐ Moderado | ◐ Moderado | ◐ Moderado | ◐ Moderado | ◐ Moderado |

| Multiplataforma (Mainframe + Distribuido) | ✅ Completo | ❌No | ❌No | ❌ Limitado | ❌ Limitado | ❌ Limitado | ❌No | ❌No | ❌No | ❌No | ❌ Limitado |

| Compatibilidad con lenguajes heredados (COBOL, JCL, RPG) | ✅ Completo | ❌No | ❌No | ❌ Limitado | ❌ Limitado | ❌ Limitado | ❌No | ❌No | ❌No | ❌No | ❌No |

| Análisis de dependencia entre sistemas | ✅ Completo | ❌No | ❌No | ❌No | ◐ Alto nivel | ◐ Estructural | ❌No | ❌No | ❌No | ❌No | ❌No |

| Visibilidad de la ruta de ejecución (estática) | ✅ Completo | ❌No | ❌No | ❌No | ❌No | ❌No | ❌No | ◐ Parcial | ◐ Parcial | ◐ Parcial | ❌No |

| Análisis de lotes y flujos de trabajo | ✅ Completo | ❌No | ❌No | ❌No | ❌No | ❌No | ❌No | ❌No | ❌No | ❌No | ❌No |

| Análisis de impacto antes del cambio | ✅ Profundo | ◐ Poco profundo | ◐ Solo seguridad | ◐ Solo seguridad | ◐ Portafolio | ◐ Estructural | ◐ Solo seguridad | ◐ Nivel de código | ◐ Nivel de código | ◐ Nivel de código | ◐ Gobernanza |

| Detección de vulnerabilidades de seguridad (SAST) | ◐ Contextual | ◐ Básico | ✅ Fuerte | ✅ Fuerte | ◐ Indicativo | ❌No | ✅ Fuerte | ◐ Limitado | ◐ Limitado | ◐ Limitado | ◐ Básico |

| Conocimiento del rendimiento y la complejidad | ✅ Profundo | ◐ Métricas | ❌No | ❌No | ◐ Agregado | ◐ Estructural | ❌No | ◐ Basado en defectos | ◐ Cumplimiento | ◐ Basado en defectos | ❌No |

| Análisis de preparación para la modernización | ✅ Nativo | ❌No | ❌No | ❌No | ✅ Primaria | ◐ Estructural | ❌No | ❌No | ❌No | ❌No | ❌No |

| Buscar en todos los activos | ✅ Avanzado | ◐ Solo repo | ◐ Solo repo | ◐ Solo repo | ◐ Metadatos | ◐ Metadatos | ◐ Solo repo | ◐ Solo repo | ◐ Solo repo | ◐ Solo repo | ◐ Solo repo |

| Integración CI / CD | ◐ Opcional | ✅ Fuerte | ✅ Fuerte | ◐ Moderado | ❌No | ❌No | ✅ Fuerte | ◐ Moderado | ◐ Moderado | ◐ Moderado | ✅ Nativo |

| Generación de evidencia lista para auditoría | ✅ Nativo | ◐ Limitado | ◐ Limitado | ✅ Fuerte | ◐ Agregado | ◐ Estructural | ◐ Limitado | ◐ Limitado | ✅ Fuerte | ◐ Limitado | ◐ Fuerte |

Otras herramientas de análisis de código estático (aplicabilidad empresarial limitada)

- ESLint

- Ventajas: Hace cumplir los estándares de codificación en JavaScript y TypeScript con comentarios rápidos de los desarrolladores.

- Limitaciones: Opera a nivel de repositorio sin visibilidad de impacto entre sistemas o entre empresas.

- PMD

- Ventajas: Detecta problemas comunes de calidad del código en varios lenguajes de programación.

- Limitaciones: El análisis basado en reglas no es adecuado para grandes conjuntos empresariales heterogéneos.

- escama8

- Ventajas: Análisis estático ligero para la aplicación de sintaxis y estilo de Python.

- Limitaciones: No proporciona información a nivel arquitectónico o de ejecución.

- Bandit

- Ventajas: Identifica problemas de seguridad en el código Python mediante análisis basado en patrones.

- Limitaciones: Alcance limitado y sin conocimiento de las interacciones del sistema empresarial.

- CódigoQL

- Ventajas: Análisis basado en consultas capaz de identificar patrones complejos de vulnerabilidad.

- Limitaciones: Requiere experiencia especializada y carece de modelos de ejecución empresarial.

- Semgrep

- Ventajas: Coincidencia de patrones rápida y personalizable para controles de seguridad y calidad.

- Limitaciones: El enfoque basado en patrones carece de dependencia y contexto conductual.

- Código Snyk

- Ventajas: Análisis estático fácil de usar para desarrolladores integrado en flujos de trabajo nativos de la nube.

- Limitaciones: Centrado en la seguridad a nivel de aplicación en lugar de en la arquitectura empresarial.

- Pylint

- Ventajas: Proporciona controles detallados de la calidad del código para proyectos de Python.

- Limitaciones: No diseñado para análisis entre proyectos o múltiples plataformas.

- Comprobación de CPP

- Ventajas: Análisis estático de código abierto para C y C++ con bajas tasas de falsos positivos.

- Limitaciones: Escalabilidad limitada y soporte de gobernanza empresarial.

- Inferir

- Ventajas: Detecta problemas de memoria y concurrencia utilizando técnicas de análisis avanzadas.

- Limitaciones: Compatibilidad lingüística limitada e integración empresarial limitada.

- LGTM

- Ventajas: Combina el análisis estático con flujos de trabajo de revisión de código basados en la nube.

- Limitaciones: Centrado en el repositorio con información limitada a nivel de sistema.

- Analizadores de FxCop

- Ventajas: Hace cumplir las pautas de diseño y codificación para aplicaciones .NET.

- Limitaciones: No aborda las dependencias entre aplicaciones.

- PHPCS

- Ventajas: Hace cumplir los estándares de codificación en proyectos PHP.

- Limitaciones: Centrado en el estilo con una profundidad analítica mínima.

- SpotBugs

- Ventajas: Identifica patrones de errores comunes en el código de bytes de Java.

- Limitaciones: Detección basada en patrones sin modelado de ruta de ejecución.

- Guardafrenos

- Ventajas: Escaneo de seguridad especializado para aplicaciones Ruby on Rails.

- Limitaciones: Específico del marco y no adecuado para el análisis a nivel empresarial.

- Herramientas de línea de comandos de ReSharper

- Ventajas: Integra análisis estático en las canalizaciones de compilación .NET.

- Limitaciones: Enfoque en la productividad del desarrollador en lugar del conocimiento empresarial.

- fuente profunda

- Ventajas: Revisión de código automatizada y análisis de calidad para repositorios modernos.

- Limitaciones: Centrado en SaaS con profundidad de análisis estructural limitada.

- Codidad

- Ventajas: Informes de calidad centralizados en múltiples repositorios.