La verifica formale è diventata una capacità determinante per le organizzazioni responsabili della gestione di sistemi critici per la sicurezza e dipendenti dalla missione. Le iniziative di modernizzazione in ambito aeronautico, di compensazione finanziaria, di controllo industriale e nelle piattaforme del settore pubblico si basano sempre più su una convalida matematicamente rigorosa per garantire che i componenti critici si comportino in modo prevedibile in tutte le condizioni operative. Tecniche di ragionamento statico, come quelle descritte nell'articolo su metodi di tracciamento logico, ora integrano le dimostrazioni formali esponendo comportamenti strutturali che le specifiche devono riflettere accuratamente. Con l'aumentare della complessità del sistema, la verifica formale emerge come strumento strategico per garantire la correttezza prima dell'implementazione.

I componenti critici raramente operano in modo isolato e i team di verifica devono tenere conto di interazioni asincrone, percorsi di codice eterogenei e sottosistemi legacy integrati con le moderne architetture distribuite. Molti di questi sistemi contengono flussi di controllo approfonditi che non sono visibili senza un'analisi avanzata, simile a quanto illustrato nell'articolo su percorsi di codice nascostiQueste informazioni diventano input essenziali per modelli formali precisi, consentendo ai team di verifica di catturare invarianti, vincoli temporali e ipotesi di interfaccia che governano il comportamento tra componenti. Questo allineamento costituisce la base per dimostrazioni accurate su più livelli di runtime e piattaforme.

Garantire la correttezza formale

Smart TS XL trasforma grandi basi di codice in modelli pronti per la verifica che riducono i rischi durante la modernizzazione.

Esplora oraI quadri normativi esercitano ulteriore pressione sulle organizzazioni affinché dimostrino la correttezza attraverso prove deterministiche piuttosto che test probabilistici o una copertura comportamentale incompleta. Gli enti di certificazione nei settori dell'aviazione, dell'energia, della medicina e della finanza si aspettano sempre più artefatti di verifica che rispondano direttamente all'intento architettonico e ai vincoli di sistema documentati. Linee guida simili alle aspettative descritte in Conformità SOX e DORA illustra il passaggio verso un ragionamento strutturato e verificabile. La verifica formale diventa quindi sia una disciplina ingegneristica che un fattore abilitante per la conformità dei programmi di modernizzazione operanti sotto una rigorosa supervisione normativa.

Le aziende che passano da architetture legacy strettamente interconnesse a ecosistemi cloud distribuiti o a progetti orientati ai servizi si trovano ad affrontare una crescente complessità nel mantenimento della correttezza. Sottili deviazioni comportamentali introdotte durante la trasformazione possono propagare rischi significativi tra flussi di lavoro dipendenti, in linea con le preoccupazioni identificate nell'analisi di rilevamento dello spostamento logicoLa verifica formale offre il rigore matematico necessario per valutare questi rischi su larga scala, consentendo ai responsabili dell'ingegneria di convalidare le ipotesi, evidenziare le contraddizioni e garantire l'integrità funzionale durante la modernizzazione. Di conseguenza, la verifica formale svolge ora un ruolo centrale nella salvaguardia dei sistemi critici durante l'evoluzione dell'architettura.

Ruolo strategico della verifica formale nelle architetture di sicurezza e mission critical

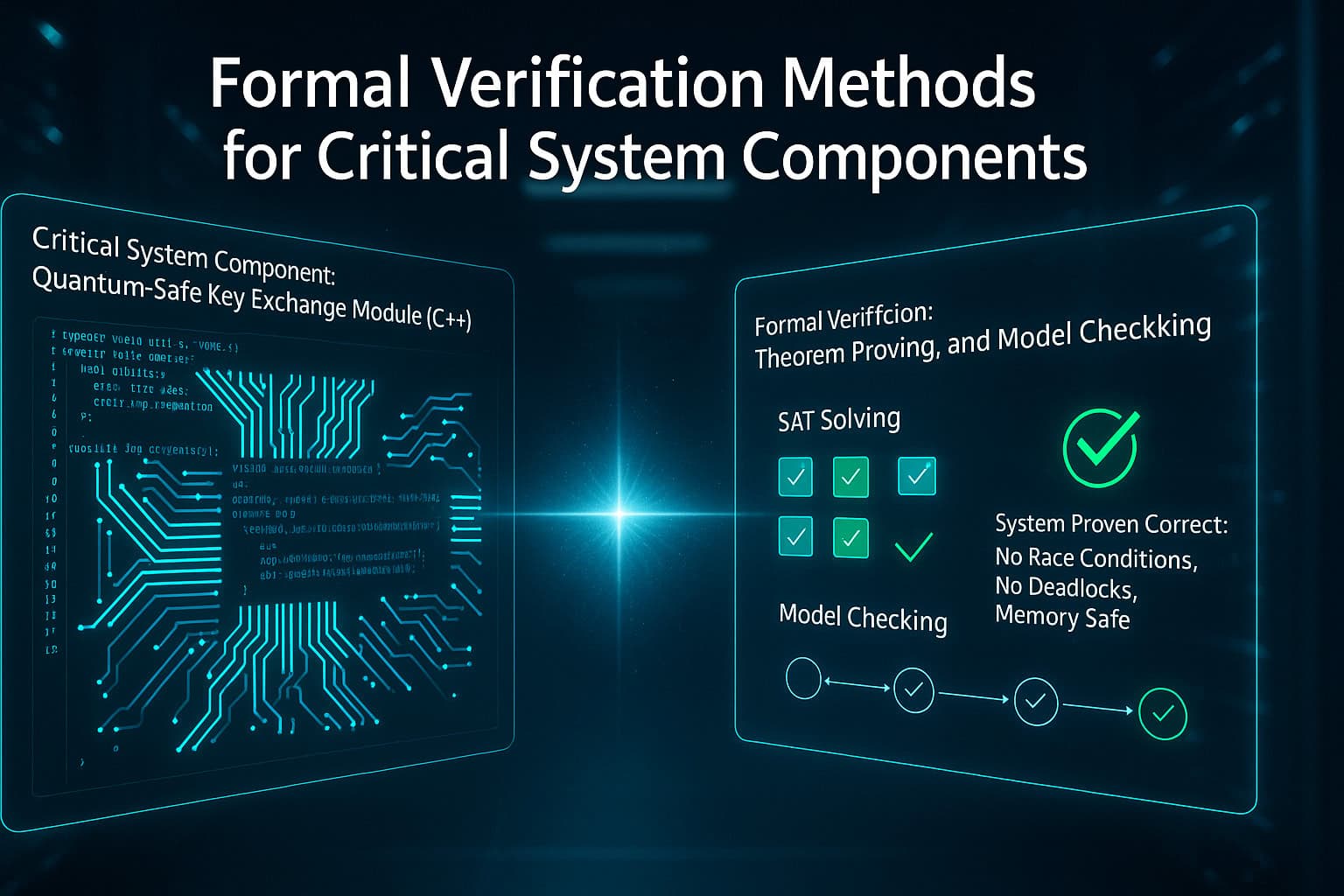

La verifica formale è diventata fondamentale per le aziende che gestiscono sistemi complessi e ad alta garanzia, in cui comportamenti scorretti generano guasti operativi a cascata. Nelle grandi organizzazioni, i componenti di missione spesso abbracciano più generazioni tecnologiche, si integrano con piattaforme cloud ibride e supportano flussi di lavoro rilevanti per la sicurezza che richiedono correttezza deterministica. I test tradizionali convalidano il comportamento in condizioni campionate, ma la verifica formale fornisce garanzie matematiche che le invarianti critiche siano valide in tutti gli stati di sistema raggiungibili. Questa distinzione diventa sempre più importante man mano che la modernizzazione introduce nuovi punti di integrazione, modelli di concorrenza e ambienti di runtime che espandono il potenziale spazio di stato. I team analitici combinano modelli di dominio, linguaggi di specifica e ragionamento basato sul flusso di controllo per creare framework di verifica che si evolvono con il ciclo di vita del sistema.

Gli architetti di sistema riconoscono inoltre che la verifica formale rafforza la governance della modernizzazione chiarendo le aspettative comportamentali prima dell'inizio della trasformazione. Gli artefatti di prova stabiliscono definizioni univoche delle responsabilità dei componenti, delle condizioni di errore e delle ipotesi ambientali. Evidenziano inoltre problemi strutturali che i test non possono rilevare in modo affidabile, rafforzando il ruolo dell'analisi statica come prerequisito per una verifica rigorosa. Tecniche per l'identificazione delle interazioni di percorsi nascosti, come quelle discusse in analisi dettagliata del percorso del codice, aiutano i team di verifica a definire con precisione l'ambito delle prove, esponendo dipendenze non ovvie incorporate nella logica legacy. Questo allineamento consente alle organizzazioni di sviluppare strategie di modernizzazione che preservino la correttezza durante l'evoluzione architettonica.

Stabilire garanzie di correttezza attraverso architetture eterogenee

I sistemi critici operano spesso su piattaforme eterogenee, tra cui mainframe, controller embedded, servizi cloud e pipeline di eventi distribuiti. La verifica formale fornisce un framework matematico unificato per garantire la correttezza indipendentemente dal linguaggio di implementazione o dall'ambiente di runtime. Si consideri uno scenario in cui un istituto finanziario gestisce un motore di regolamento scritto in COBOL, un servizio di calcolo del rischio in Java e un livello di orchestrazione cloud-native che gestisce eventi asincroni. Senza verifica, sottili differenze di temporizzazione o ordinamento tra questi livelli possono esporre a condizioni di competizione ad alto impatto. Le specifiche formali consentono ai team di progettazione di definire vincoli temporali, invarianti e protocolli di comunicazione che si applicano uniformemente a tutti i componenti.

Per convalidare questo comportamento, i team costruiscono modelli di transizione di stato che incorporano flussi di messaggi, tentativi, semantica di persistenza e timeout. Questi modelli supportano dimostrazioni logiche temporali che garantiscono che non si verifichino deadlock, riordini involontari o aggiornamenti parziali. Le tecniche di analisi statica aiutano a dare avvio a questi sforzi rivelando ramificazioni non strutturate o blocchi irraggiungibili che distorcono il flusso di controllo previsto. Approcci presentati nelle discussioni su metodi di tracciamento logico Spesso svolgono un ruolo di precursore essenziale, garantendo che i modelli formali riflettano accuratamente i percorsi del codice reale. Con il progredire della modernizzazione, le proprietà verificate guidano il refactoring, il disaccoppiamento dei componenti e la riprogettazione architettonica, mantenendo la correttezza in ambienti in evoluzione.

Gestire la complessità delle modalità di errore nei flussi di lavoro critici

Le condizioni di guasto nei sistemi critici vanno oltre le semplici eccezioni e includono deviazioni temporali, transizioni di stato parziali, servizi a valle non disponibili o regole di configurazione applicate in modo incoerente. La verifica formale consente alle organizzazioni di classificare le modalità di guasto, assegnarvi definizioni matematiche e dimostrare che i meccanismi di ripristino si comportano come previsto in tutte le permutazioni operative. In un sistema di pianificazione dei trasporti in tempo reale, ad esempio, la concorrenza tra aggiornamenti di dispatch, telemetria dei veicoli e ottimizzazione basata sui vincoli crea un'esplosione combinatoria di stati che i test tradizionali non possono coprire. I team di verifica formalizzano queste transizioni utilizzando comandi protetti o algebra di processo per garantire che, anche in condizioni degradate, gli invarianti di base rimangano intatti.

La creazione di tali garanzie richiede una comprensione accurata di come la logica legacy codifica i percorsi di ripristino degli errori. Molti sistemi storici, con più di vent'anni di esperienza, mantengono una logica di fallback implicita, integrata in profondità nelle strutture condizionali. L'utilizzo di modelli formali senza riconciliare questi percorsi rischia di trascurare comportamenti critici. Gli strumenti di analisi statica rivelano rami nascosti di gestione degli errori, condizionali inutilizzati o strutture di eccezione legacy che influenzano le transizioni di stato. Questo allineamento consente ai team di verifica di codificare la semantica completa degli errori nelle prove. Man mano che i sistemi si evolvono verso architetture distribuite nel cloud, ulteriori stati introdotti da nuovi tentativi, scalabilità automatica e modelli di coerenza distribuita possono essere acquisiti in specifiche estese, preservando le garanzie di sicurezza durante la modernizzazione.

Garantire l'integrità comportamentale durante la modernizzazione incrementale

Le aziende raramente sostituiscono i sistemi critici in un'unica fase, optando invece per strategie di modernizzazione incrementale che preservano la continuità operativa. Questa evoluzione graduale introduce incertezza su come i componenti parzialmente modernizzati interagiscono con i sottosistemi legacy che svolgono ancora funzioni essenziali. La verifica formale fornisce la disciplina necessaria per certificare l'integrità comportamentale a ogni fase della modernizzazione. Ad esempio, quando si migra una parte di una pipeline di riconciliazione finanziaria batch-driven a un'architettura di microservizi, le differenze nella granularità della pianificazione o nella semantica della concorrenza possono introdurre risultati non deterministici. Attraverso la verifica, i team di progettazione definiscono contratti comportamentali precisi sia per i componenti legacy che per quelli modernizzati, garantendo l'equivalenza in tutti gli output osservabili.

I team di verifica si affidano anche all'astrazione per mantenere la trattabilità. I sistemi legacy spesso includono migliaia di istruzioni procedurali che, se rappresentate direttamente, renderebbero impossibile il model checking o la dimostrazione di teoremi. L'astrazione di questi componenti in modelli finiti, preservando al contempo la correttezza semantica, garantisce che le dimostrazioni formali rimangano scalabili. Questo equilibrio rispecchia il più ampio principio di modernizzazione, che consiste nel preservare l'intento funzionale trasformando al contempo l'implementazione tecnica. Man mano che i servizi moderni sostituiscono le routine legacy, le proprietà precedentemente verificate fungono da contratti di regressione che prevengono lievi deviazioni durante il refactoring, l'integrazione o il re-platforming. Questo modello disciplinato riduce il rischio operativo durante l'evoluzione del sistema.

Utilizzo della verifica formale per rafforzare la governance aziendale e i controlli dei rischi

I framework di governance aziendale enfatizzano sempre di più un ragionamento rigoroso e basato sull'evidenza nella convalida di sistemi mission-critical. La verifica formale fornisce una garanzia deterministica allineata ai controlli di rischio interni e alla supervisione normativa. Nei settori altamente regolamentati, gli artefatti di prova diventano parte dei record di audit, dimostrando che il comportamento del sistema è in linea con le specifiche dichiarate. Tecniche come le prove di conservazione invarianti o le garanzie di vitalità forniscono agli enti regolatori prove misurabili e riproducibili di correttezza. Ciò rafforza le difese organizzative contro gli incidenti operativi e garantisce la conformità alle policy che regolano la sicurezza, la resilienza e l'integrità dei dati.

Inoltre, i team di governance traggono vantaggio dai modelli comportamentali strutturati prodotti dalla verifica formale. Questi modelli evidenziano le aree in cui i presupposti legacy sono in conflitto con i requisiti moderni, aiutando i comitati di modernizzazione a determinare quando è necessaria una riprogettazione architettonica. Gli artefatti di verifica chiariscono l'intento progettuale, facilitano l'allineamento degli stakeholder e riducono l'ambiguità durante le transizioni di sistema. Questa combinazione di evidenze matematiche e visibilità architettonica fornisce una base di governance sufficientemente resiliente da supportare programmi di modernizzazione pluriennali che abbracciano diversi stack tecnologici.

Modellazione di componenti critici con macchine a stati, logica temporale e algebre di processo

La modellazione costituisce la base per la verifica formale, consentendo ai team di ingegneria di esprimere il comportamento del sistema in costrutti matematicamente rigorosi. I componenti critici nei sistemi rilevanti per la sicurezza e dipendenti dalla missione richiedono rappresentazioni esplicite che catturino la semantica della concorrenza, l'evoluzione dello stato, le ipotesi ambientali e le transizioni di errore. Macchine a stati, framework di logica temporale e algebre di processo supportano questi requisiti fornendo astrazioni strutturate in grado di rappresentare modelli di interazione ad alto volume e vincoli deterministici. Questi formalismi consentono alle organizzazioni di ragionare sulla correttezza indipendentemente dai dettagli di implementazione, garantendo che gli sforzi di modernizzazione preservino le garanzie funzionali man mano che le basi di codice si evolvono.

Una delle principali sfide nella costruzione di modelli accurati risiede nel conciliare la logica legacy profondamente radicata con le aspettative architettoniche moderne. I sistemi vecchi di decenni spesso codificano il comportamento implicitamente attraverso ramificazioni annidate, stati mutabili condivisi e sequenze guidate da effetti collaterali che resistono a una rappresentazione diretta. I team di analisi si affidano spesso a informazioni statiche intermedie per guidare il processo di modellazione. Articoli come l'esplorazione di indicatori di complessità Fornire quadri concettuali per identificare i punti critici strutturali che influenzano la fedeltà del modello. Evidenziando strutture ramificate e loop illimitati, le informazioni statiche garantiscono che i modelli riflettano le realtà operative piuttosto che ipotesi semplificate.

Formalizzazione dell'evoluzione dello stato dei componenti con macchine a stati finiti ed estesi

I framework delle macchine a stati forniscono un meccanismo disciplinato per rappresentare il comportamento dei componenti in diverse modalità operative. Nei sistemi critici, i componenti raramente operano in semplici stati binari; al contrario, transitano attraverso un ricco insieme di stati condizionali, parametrici o gerarchici. Ad esempio, si consideri un sottosistema di interblocco di sicurezza in un ambiente di automazione industriale. Il suo comportamento dipende non solo dagli input dei sensori, ma anche dai comandi di supervisione, dalle condizioni di temporizzazione, dai contatori storici e dalle latenze di guasto. Le macchine a stati estese che incorporano variabili, protezioni, funzioni di effetto e gruppi di transizione diventano essenziali per catturare tale complessità.

I team di verifica costruiscono queste macchine a stati esaminando l'interazione tra eventi esterni e condizioni interne. Il codice legacy spesso rivela numerose transizioni non strutturate, in cui la logica di ramificazione incorporata in più moduli definisce indirettamente gli stati del sistema. L'identificazione di queste transizioni implicite richiede un'attenta analisi delle gerarchie delle chiamate e delle dipendenze persistenti dei dati. Approfondimenti tratti da metodi simili a quelli descritti nell'articolo su rilevamento ad alta complessità Guidano i modellatori nell'identificazione dei punti in cui i confini di stato devono essere resi espliciti. Una volta formalizzate, le macchine a stati supportano dimostrazioni invarianti, analisi di raggiungibilità e rilevamento di stati morti. Durante la modernizzazione, questi modelli di stato verificati fungono da ancore di correttezza, consentendo ai team di ingegneria di convalidare che le versioni cloud-native mantengano la stessa semantica di stato anche quando le caratteristiche di esecuzione cambiano.

Applicazione della logica temporale per catturare vincoli di ordinamento, durata e vitalità

La logica temporale svolge un ruolo fondamentale nella modellazione di comportamenti sensibili al tempo e dipendenti dall'ordine, caratteristici dei sistemi critici. Le specifiche espresse in logica temporale lineare o logica ad albero computazionale consentono alle organizzazioni di definire proprietà semantiche come la sequenza degli eventi, le condizioni di sicurezza, i tempi di reazione limitati e i requisiti di disponibilità. Si consideri una pipeline di autorizzazione di pagamento in cui una richiesta deve essere completata entro un timeout specificato o passare a un percorso di fallback controllato. La logica temporale consente agli architetti di codificare il vincolo che nessuna autorizzazione in sospeso possa rimanere irrisolta oltre la durata consentita.

La costruzione di specifiche logiche temporali richiede una profonda comprensione delle interazioni asincrone, dei nuovi tentativi e delle corse di eventi non deterministici. I sistemi critici che operano in ambienti distribuiti introducono ulteriore complessità, poiché guasti parziali o perdite di messaggi possono violare i presupposti impliciti incorporati nella logica legacy. Le tecniche di analisi statica aiutano a identificare questi presupposti evidenziando anomalie nella propagazione dei dati o strutture di ramificazione irregolari. Articoli che descrivono problemi di dipendenza Mostrano come le violazioni architetturali possano distorcere il ragionamento temporale. Allineando i vincoli logici temporali con le dipendenze identificate, i team garantiscono che le condizioni di correttezza rimangano valide in runtime eterogenei. Queste specifiche diventano risorse essenziali durante la modernizzazione incrementale, consentendo prove di regressione che verificano la vitalità e la reattività sostenute anche dopo la trasformazione architetturale.

Modellazione di protocolli di concorrenza e comunicazione con algebre di processo

Algebre di processo come CSP, CCS e ACP offrono un modo matematicamente disciplinato per rappresentare l'esecuzione simultanea, le primitive di sincronizzazione e la semantica della comunicazione. Questi modelli diventano indispensabili in ambiti come il controllo di volo, la navigazione autonoma, le reti di compensazione finanziaria e i motori di elaborazione di eventi su larga scala. In questi ambienti, i comportamenti di più componenti interagenti non possono essere caratterizzati solo da macchine a stati indipendenti; sono invece necessarie strutture di interazione formali per esprimere canali di messaggio, condizioni di rendezvous e contesti di operazioni parallele.

Uno scenario che illustra questa sfida è rappresentato dai sistemi di invio di comandi in tempo reale. Questi sistemi coordinano gli aggiornamenti basati sugli eventi su più sottosistemi, ognuno dei quali richiede una gestione precisa della semantica di ordinamento e blocco. Una piccola discrepanza tra la sincronizzazione prevista e il comportamento effettivo del codice può introdurre rischi di stallo o una propagazione incoerente dello stato. Informazioni statiche ottenute dall'analisi delle interazioni interprocedurali, come discusso in analisi di rafforzamento dell'impatto, aiutano a rivelare dove esistono modelli di comunicazione impliciti. I modelli di algebra di processo convertono questi modelli in operatori formali come composizione parallela, occultamento e scelta. Ciò consente un ragionamento automatizzato sulla libertà da deadlock, il raffinamento delle tracce e l'integrità della comunicazione. Con la transizione dei componenti legacy in equivalenti distribuiti nel cloud, le dimostrazioni di algebra di processo diventano fondamentali per convalidare che i microservizi preservino la semantica del protocollo prevista.

La modellazione formale come ponte tra il comportamento legacy e le architetture moderne

La modellazione formale fornisce la struttura di connessione tra l'intento operativo legacy e le architetture di modernizzazione emergenti. Man mano che le organizzazioni scompongono i sistemi monolitici in modelli orientati ai servizi o basati sugli eventi, possono sorgere discrepanze tra i presupposti storici e i modelli di esecuzione moderni. I processi batch pianificati possono evolversi in flussi di dati continui, le subroutine strettamente accoppiate possono essere ristrutturate in servizi asincroni e le operazioni sincronizzate possono essere sostituite da meccanismi di coordinamento distribuiti. Questi cambiamenti modificano caratteristiche fondamentali come l'ordine di esecuzione, la tolleranza alla latenza, le garanzie di coerenza e la semantica di ripristino.

La modellazione garantisce che queste differenze siano comprese e convalidate prima dell'implementazione. Quando i sistemi legacy contengono flussi condizionali non documentati o strutture di fallback profondamente radicate, la costruzione del modello diventa un processo di scoperta. Approfondimenti simili a quelli forniti dalla ricerca su convalida della resilienza dinamica Espongono comportamenti trascurati che devono essere rappresentati in modo esplicito. Una volta convertiti in macchine a stati, specifiche di logica temporale o descrizioni di algebra di processo, i team possono verificare formalmente che le strategie di modernizzazione preservino le garanzie essenziali di sicurezza e correttezza. Durante le transizioni a fasi, questi modelli fungono anche da oracoli di regressione, consentendo di verificare che ogni incremento di modernizzazione rispetti le proprietà di sistema precedentemente convalidate.

Tecniche di dimostrazione di teoremi per dimostrare la sicurezza, la vitalità e le proprietà invarianti

La dimostrazione di teoremi fornisce la base più espressiva e rigorosa per convalidare la correttezza di un sistema critico. A differenza del model checking, che esplora automaticamente gli spazi di stato, i dimostratori di teoremi si basano su un ragionamento logico strutturato per dimostrare che le proprietà specificate sono valide in tutte le condizioni. Questa capacità diventa essenziale per sistemi di grandi dimensioni e altamente parametrizzati, in cui gli spazi di stato sono troppo vasti per un'esplorazione automatizzata. Le organizzazioni che gestiscono piattaforme critiche per la sicurezza si affidano alla dimostrazione di teoremi per convalidare invarianti, obblighi di vitalità, aderenza al protocollo e assenza di transizioni di errore catastrofiche. Man mano che la modernizzazione introduce nuovi modelli di concorrenza, modelli di orchestrazione dei servizi o dipendenze distribuite, la dimostrazione di teoremi garantisce che le ipotesi di correttezza rimangano valide in tutte le architetture di transizione.

Un altro vantaggio della dimostrazione di teoremi risiede nella sua capacità di verificare proprietà di componenti che non si prestano ad astrazioni a stati finiti. I sistemi che incorporano strutture dati illimitate, logica ricorsiva o set di dati di dimensione variabile richiedono framework di ragionamento deduttivo in grado di gestire strutture matematiche generali. I team di ingegneria costruiscono definizioni formali delle operazioni di sistema e ragionano induttivamente su tutte le possibili combinazioni di input e stato. Prima di farlo, gli analisti spesso utilizzano intuizioni statiche per perfezionare le precondizioni e derivare astrazioni accurate. Discussioni sull'identificazione problemi di flusso di dati illustrano come le ipotesi ereditate possano propagarsi, influenzando la formazione di obblighi di prova corretti.

Utilizzo della conservazione invariante per garantire la sicurezza strutturale nei flussi complessi

Le dimostrazioni invarianti costituiscono il fondamento della verifica deduttiva. Un invariante definisce una proprietà che deve essere mantenuta in ogni stato del sistema, indipendentemente da transizioni, concorrenza o variazioni di input. I sistemi critici dipendono dagli invarianti per garantire la sicurezza strutturale, ad esempio per prevenire saldi negativi nelle piattaforme finanziarie, garantire limiti stabili degli attuatori nei sistemi di controllo o imporre intervalli operativi consentiti nei dispositivi medici. La costruzione di invarianti significativi richiede una gestione approfondita sia della logica esplicita che dei comportamenti impliciti incorporati nelle basi di codice legacy.

Si consideri uno scenario che prevede un flusso di lavoro di elaborazione dei reclami in più fasi, operante su mainframe e servizi distribuiti. Le routine storiche possono implementare aggiornamenti a cascata, fallback legacy o unioni condizionali raramente documentate. Per convalidare gli invarianti di sicurezza, gli ingegneri identificano innanzitutto le strutture dati principali e definiscono predicati matematici che rappresentano condizioni stabili, come la coerenza tra record replicati o la progressione monotona attraverso le fasi del flusso di lavoro. Tecniche di analisi statica simili a quelle descritte in convalida della coerenza dei dati rivelare segmenti procedurali in cui gli invarianti potrebbero essere violati durante la modernizzazione. Utilizzando un dimostratore di teoremi, gli ingegneri dimostrano induttivamente che ogni funzione di transizione preserva l'invariante. Questo approccio garantisce che, anche dopo la migrazione dei componenti a servizi cloud-native o la riprogettazione delle pipeline di dati, le garanzie di sicurezza essenziali rimangano intatte.

Dimostrare la vitalità per garantire progressi, completamento e assenza di stallo

Le proprietà di vitalità garantiscono che i sistemi raggiungano alla fine i risultati desiderati, come il completamento delle transazioni, l'emissione di risposte o l'uscita da stati operativi transitori. Nei sistemi distribuiti e asincroni, il ragionamento sulla vitalità diventa particolarmente complesso a causa di condizioni di competizione, ritardi nei messaggi e guasti parziali che possono intrappolare il sistema in stati di non avanzamento. La dimostrazione di teoremi consente alle organizzazioni di definire esplicitamente le aspettative di vitalità e di dimostrare che, in base a ipotesi formali, il sistema non può rimanere bloccato indefinitamente.

Immaginate un motore di elaborazione degli ordini basato su eventi, responsabile dell'orchestrazione di flussi di lavoro multifase su diversi microservizi. Durante la modernizzazione, alcuni servizi vengono scomposti, introducendo nuovi cicli di ripetizione o modelli di compensazione. Senza un ragionamento formale, le garanzie di avanzamento potrebbero essere compromesse. Gli ingegneri di verifica modellano i comportamenti di comunicazione e definiscono predicati di vitalità che riflettono i risultati garantiti di risposta o risoluzione. Anomalie strutturali simili a quelle identificate in studi di rilevamento di situazioni di stallo Forniscono informazioni su potenziali comportamenti di starvation o attesa indefinita. Grazie a queste informazioni, la dimostrazione di teoremi dimostra che nessuna sequenza di esecuzione valida può bloccarsi in modo permanente, garantendo una progressione affidabile anche in implementazioni ibride on-premise e cloud.

Dimostrazione di teoremi parametrici per sistemi con stato e dati illimitati

Molte piattaforme aziendali operano su set di dati illimitati, code dinamiche, sessioni di lunga durata o strutture di record nidificate in modo arbitrario. Queste caratteristiche superano la capacità del controllo di modelli a stati finiti. La dimostrazione di teoremi offre meccanismi matematicamente espressivi per ragionare su spazi di stato illimitati attraverso induzione, coinduzione e logica di ordine superiore. Questo diventa cruciale per settori come la finanza, le telecomunicazioni e l'aerospaziale, dove la correttezza del sistema deve essere garantita indipendentemente dalla scala dei dati, dalla durata operativa o dalla variabilità degli input.

Si consideri un sistema di fatturazione per le telecomunicazioni che gestisce milioni di sessioni simultanee con modelli di ciclo di vita dinamici. I progetti legacy possono implementare routine di elaborazione ricorsive che devono garantire l'accuratezza indipendentemente dalla scala. La dimostrazione parametrica di teoremi consente agli analisti di definire regole comportamentali generalizzate indipendenti dal numero di sessioni. Prima di costruire le dimostrazioni, i team di ingegneria spesso analizzano i modelli strutturali per individuare le aree in cui si verifica una ricorsione o un'iterazione illimitata. Articoli come l'esame di comportamento guidato dall'impatto illustrano come la complessità legacy debba essere compresa prima dell'astrazione. Con una specifica accurata, i dimostratori di teoremi convalidano la correttezza per tutte le possibili dimensioni di sistema, fornendo solide garanzie durante la modernizzazione, il ridimensionamento del carico o la migrazione verso un'infrastruttura cloud elastica.

Codifica della logica di errore, del ripristino degli errori e delle ipotesi ambientali in obblighi di prova

La gestione dei guasti svolge un ruolo fondamentale nella verifica, in particolare per i sistemi che devono mantenere un comportamento sicuro in ambienti avversi o degradati. La dimostrazione di teoremi consente agli analisti di codificare ipotesi su modalità di guasto, propagazione degli errori, routine di fallback e garanzie di sistema esterne. Ciò garantisce che le dimostrazioni rimangano valide anche in caso di interruzioni intermittenti dei componenti, incoerenze di configurazione o conflitti di risorse. Le architetture moderne amplificano queste problematiche a causa della comunicazione distribuita, dell'autoscaling e dei processori eterogenei, che introducono nuove categorie di guasti parziali.

Prendiamo il caso di un sistema di aggiudicazione dei sinistri multipiattaforma sottoposto a una modernizzazione graduale. Alcuni componenti vengono eseguiti su motori batch legacy, altri su servizi cloud basati su eventi. La semantica dei guasti differisce in questi ambienti, invalidando potenzialmente le precedenti ipotesi sulla propagazione degli errori. Gli ingegneri definiscono precondizioni precise che catturano comportamenti di guasto accettabili, quindi costruiscono prove che dimostrano che le proprietà di sicurezza a livello di sistema rimangono intatte in queste condizioni. Approfondimenti da studi su prevenire guasti a cascata Aiutare a identificare transizioni limite che richiedono un trattamento formale esplicito. Incorporarle negli obblighi di prova garantisce che la modernizzazione non comprometta la resilienza o la correttezza, anche quando i comportamenti di errore cambiano a causa di modifiche architetturali.

Flussi di lavoro di verifica del modello per sistemi di controllo integrati, in tempo reale e distribuiti

Il model checking fornisce un'esplorazione esaustiva e automatizzata degli stati del sistema, consentendo ai team di verifica di identificare violazioni di sicurezza, liveness o correttezza del protocollo senza dover costruire prove manuali. Per i controller embedded, le piattaforme real-time e i sistemi di orchestrazione distribuita, il model checking diventa essenziale a causa dell'elevata densità di stati interagenti e delle dipendenze temporali. Questi ambienti si basano spesso su processi concorrenti, transizioni guidate da interrupt e requisiti di scheduling deterministici. I model checker valutano queste dinamiche esplorando sistematicamente tutte le configurazioni raggiungibili in base a diversi ordini di eventi e condizioni ambientali. Man mano che le aziende modernizzano questi sistemi mission-critical, il model checking garantisce la coerenza comportamentale tra i sottosistemi legacy e i componenti distribuiti emergenti.

Un altro punto di forza del model checking risiede nella sua capacità di rivelare sottili incongruenze che non sono evidenti attraverso test o simulazioni. Vincoli di tempo reale, deriva del clock, nuovi tentativi di comunicazione e arrivi di messaggi asincroni creano percorsi di esecuzione che la convalida tradizionale raramente esercita. Le basi di codice legacy, in particolare quelle strutturate su decenni, possono contenere condizionali profondamente annidati, transizioni di fallback implicite o ipotesi di temporizzazione legate all'hardware più vecchio. Risultati analitici provenienti da fonti come lo studio di complessità del flusso di controllo illustrano come i modelli strutturali composti influenzino i risultati della verifica. Allineando il model checking a queste informazioni, le organizzazioni costruiscono astrazioni accurate che riflettono le reali condizioni operative.

Esplorazione esaustiva dello stato nei cicli di controllo incorporati

I sistemi embedded nei settori aerospaziale, della sicurezza automobilistica, dell'automazione industriale e della robotica dipendono da loop di controllo precisi che operano entro rigidi limiti di temporizzazione e sicurezza. Il model checking consente agli ingegneri di modellare cicli di controllo, interrupt, campionamento dei sensori, comandi degli attuatori e routine di fallback con elevata fedeltà. Uno scenario rappresentativo potrebbe prevedere un modulo di controllo di volo che gestisce le regolazioni di assetto in base agli input di fusione dei sensori. Il controllore deve garantire proprietà di sicurezza come l'oscillazione limitata, la convergenza monotona degli attuatori o l'evitamento degli stati non validi. I loop embedded spesso interagiscono con indicatori di guasto a livello hardware, timer watchdog e sottosistemi di correzione degli errori, rendendo lo spazio di stato completo significativamente più ampio del previsto.

I flussi di lavoro di model checking iniziano con la definizione di un modello di stato strutturato che incorpora caratteristiche sia funzionali che temporali. Questo può includere variabili di clock, intervalli di input, effetti di isteresi e condizioni di errore. Le implementazioni legacy in genere rivelano transizioni non documentate legate a ottimizzazioni delle prestazioni o vincoli hardware. Tecniche di analisi simili a quelle descritte in rilevamento di modelli sensibili alla latenza evidenziare le aree in cui ritardi impliciti o ipotesi sincrone influenzano il comportamento. Una volta definito il modello di stato, gli ingegneri applicano l'esplorazione limitata o illimitata per convalidare proprietà come stabilità, limiti di propagazione degli errori e comportamento di ripristino. Durante la modernizzazione, in particolare quando si migra la logica embedded verso livelli di astrazione hardware o piattaforme software-defined, il model checking garantisce che i vincoli di temporizzazione e sicurezza rimangano preservati nei motori di esecuzione aggiornati.

Modelli di pianificazione in tempo reale e verifica delle scadenze

I sistemi in tempo reale dipendono da garanzie di pianificazione prevedibili, in base alle quali le attività devono essere eseguite entro scadenze specifiche per mantenere l'integrità del sistema. Questi ambienti includono sistemi di navigazione autonoma, controller di infusioni mediche, robotica di fabbrica e piattaforme di invio di emergenza. Il model checking consente ai team di verifica di valutare le policy di pianificazione, le regole di prelazione, le gerarchie di priorità e i meccanismi di sincronizzazione dell'orologio in tutte le possibili variazioni temporali. Violazioni del tempo reale come il mancato rispetto delle scadenze, l'amplificazione del jitter o l'inversione di priorità possono causare guasti operativi catastrofici.

Uno scenario che illustra questa preoccupazione riguarda un sottosistema di veicolo autonomo che deve elaborare i dati dei sensori, valutare le traiettorie e inviare comandi agli attuatori entro cicli fissi. Quando si modernizza un sistema di questo tipo per funzionalità basate sul cloud o livelli di elaborazione aggiuntivi, i vincoli di pianificazione possono variare in modo sottile. Gli ingegneri di verifica costruiscono automi temporizzati o modelli di stato ibridi che rappresentano ogni attività, la sua scadenza e la sua interazione con gli orologi di sistema. Il lavoro analitico su produttività rispetto alla reattività Fornisce indicazioni per identificare le aree in cui la contesa temporale o i picchi di carico influenzano l'affidabilità della pianificazione. I model checker esplorano tutte le sequenze di attività, valutando se le scadenze sono rispettate in caso di ordinamento nel caso peggiore, ritardi nei messaggi o contesa delle risorse. Questo approccio garantisce che la modernizzazione non introduca difetti temporali latenti e che le garanzie di sicurezza e operative rimangano coerenti in ambienti di esecuzione eterogenei.

Verifica del comportamento del sistema distribuito, del consenso e dell'ordinamento dei messaggi

I sistemi distribuiti amplificano la complessità della verifica introducendo un ordinamento non deterministico dei messaggi, latenza variabile, partizioni di rete e interazioni dipendenti dalla scala. Il model checking diventa uno strumento essenziale per la verifica di algoritmi di consenso, logica di coordinamento distribuita e protocolli di ripristino multi-nodo. Le reti di transazioni finanziarie, i sistemi di gestione delle reti energetiche e le infrastrutture di comunicazione su scala nazionale dipendono da queste garanzie per evitare corruzione dei dati, aggiornamenti di stato incoerenti o interruzioni a cascata.

Ad esempio, si consideri una piattaforma distribuita di tracciamento delle risorse che coordina gli aggiornamenti in più aree geografiche. Le versioni legacy possono basarsi su chiamate sincrone, mentre le varianti modernizzate incorporano messaggistica asincrona, recapito basato su code o protocolli di gossip. Gli ingegneri di verifica costruiscono modelli che catturano la perdita di messaggi, il ritardo, la duplicazione e il partizionamento temporaneo. Approfondimenti dalla ricerca su analisi dell'iniezione di guasti Aiuta a definire le condizioni in base alle quali i componenti distribuiti devono preservare le proprietà di sicurezza. Il model checking valuta se il consenso è valido, se la vitalità persiste durante l'instabilità della rete e se gli stati replicati rimangono coerenti su tutti i nodi. Man mano che i sistemi migrano verso ambienti cloud o multi-regione, questi controlli garantiscono la continuità operativa indipendentemente da scala, latenza o cambiamenti di topologia.

Rilevamento di sottili interlacciamenti e violazioni parziali dell'ordine introdotte durante la modernizzazione

La modernizzazione modifica frequentemente i modelli di concorrenza, introducendo nuove sequenze di eventi o eliminando flussi di lavoro serializzati che un tempo garantivano la correttezza. Queste trasformazioni possono generare violazioni parziali dell'ordine, interlacciamenti imprevisti o condizioni di competizione precedentemente impossibili. Il model checking fornisce la visibilità granulare necessaria per rilevare questi problemi prima dell'implementazione. I team costruiscono modelli che riflettono sia le strutture di concorrenza legacy che quelle modernizzate e ne confrontano il comportamento attraverso il controllo di raffinamento, l'equivalenza di traccia o l'analisi dei controesempi.

Si consideri una piattaforma di regolamento dei pagamenti globale, storicamente basata su aggiornamenti batch. Durante la modernizzazione, la logica di regolamento viene scomposta in microservizi che operano in modo asincrono. Questa transizione migliora la scalabilità, ma introduce anche nuove combinazioni di tempi e ordini. Approfondimenti statici simili a quelli forniti in integrità del flusso basata sull'attore rivelano aree in cui la semantica di propagazione dei dati potrebbe variare. Applicando il model checking, gli ingegneri individuano i casi in cui gli aggiornamenti parziali si propagano in modo incoerente o in cui i tentativi asincroni riordinano gli eventi oltre i limiti accettabili. Con l'avanzare della modernizzazione, queste verifiche garantiscono che il comportamento distribuito sia conforme alla semantica di progettazione prevista e che la concorrenza di recente introduzione non comprometta la correttezza o la conformità normativa.

Interpretazione astratta e analisi statica come ponte verso la verifica formale completa

L'interpretazione astratta fornisce le basi matematiche necessarie per approssimare il comportamento dinamico senza eseguire codice, rendendola un precursore fondamentale per la verifica formale nei sistemi sensibili alla sicurezza. La sua semantica basata su reticoli consente alle organizzazioni di modellare intervalli di variabili, vincoli di flusso di controllo e caratteristiche di propagazione dei dati su larga scala, soprattutto in ambienti legacy con decine di milioni di righe di codice. Costruendo solide sovraapprossimazioni di tutti i percorsi di esecuzione possibili, l'interpretazione astratta identifica invarianti, stati impossibili e proprietà di stabilità su cui si baseranno in seguito la dimostrazione di teoremi e il model checking. Questo allineamento diventa indispensabile quando si modernizzano sistemi distribuiti e mission-critical contenenti complesse dipendenze di dati e flussi di lavoro non documentati.

L'analisi statica integra l'interpretazione astratta fornendo approfondimenti strutturali che chiariscono dove devono concentrarsi i modelli formali. Le architetture legacy contengono spesso condizionali profondamente annidati, flussi ricorsivi, ipotesi ambientali o comportamenti specifici della piattaforma che la verifica formale non può incorporare senza un'astrazione accurata. Metodi analitici come l'analisi di flusso multiprocedurale, la risoluzione delle dipendenze e il tracciamento del flusso di dati rivelano effetti collaterali nascosti o mutazioni di stato essenziali per la formalizzazione. Esplorazioni di argomenti come modelli di analisi di impatto illustrano come la comprensione organizzativa dei driver di esecuzione fornisca obblighi di prova più accurati. Se integrate strategicamente, l'analisi statica e l'interpretazione astratta formano una pipeline che trasforma basi di codice complesse in specifiche verificabili con precisione matematica.

Derivazione di approssimazioni eccessive del suono per basi di codice grandi ed eterogenee

I sistemi aziendali di grandi dimensioni contengono codice che abbraccia più paradigmi, decenni e domini operativi. L'interpretazione astratta è in una posizione unica per unificare questa diversità creando approssimazioni semantiche che rimangono valide indipendentemente dalle specifiche di implementazione. Un sistema di compensazione finanziaria globale, ad esempio, potrebbe includere logica di regolamento COBOL, servizi di orchestrazione Java, moduli di analisi Python e un'infrastruttura di messaggistica in tempo reale. Ognuno di essi introduce comportamenti unici, ma la verifica formale richiede un modello semantico coerente. L'interpretazione astratta raggiunge questo obiettivo mappando tutti i costrutti in intervalli di domini unificati, ottagoni, vincoli simbolici o astrazioni relazionali che generalizzano il comportamento preservandone la solidità.

La costruzione di queste astrazioni richiede un'attenta gestione di cicli, strutture dinamiche e flussi interprocedurali. I sistemi legacy utilizzano spesso cicli annidati con variabili di stato in evoluzione legate a regole di business codificate nei vari livelli procedurali. Per evitare sottoapprossimazioni, gli analisti calcolano punti fissi che rappresentano condizioni di equilibrio stabile per tutte le possibili esecuzioni. I risultati dell'analisi statica provenienti da aree come mappatura delle dipendenze scalabile evidenziano dove i limiti di astrazione devono essere adattati per catturare le transizioni di stato indirette. Una volta che le sovra-approssimazioni convergono, fungono da spina dorsale per la generazione di invarianti, la costruzione della macchina a stati e la successiva verifica deduttiva o automatizzata. Durante la modernizzazione, queste approssimazioni garantiscono che le nuove implementazioni mantengano l'intero inviluppo comportamentale richiesto per le garanzie di correttezza.

Estrazione di invarianti impliciti e vincoli comportamentali nascosti nella logica legacy

Le applicazioni legacy spesso codificano i vincoli di correttezza implicitamente anziché tramite documentazione esplicita o contratti di progettazione. Queste invarianti possono risiedere in convenzioni di utilizzo variabili, strutture di terminazione dei cicli, percorsi di fallback o logiche di recupero degli errori incorporate in decenni di sviluppo incrementale. L'interpretazione astratta rivela queste invarianti nascoste analizzando proprietà stabili lungo tutti i percorsi possibili. Ad esempio, in un sistema nazionale di elaborazione dei sussidi, i vincoli che garantiscono saldi non negativi, progressioni di stati monotoni o combinazioni di campi consentite potrebbero non essere mai dichiarati esplicitamente, ma rimanere validi per milioni di esecuzioni storiche. La verifica formale non può procedere in modo affidabile senza catturare queste proprietà.

Per farli emergere, gli analisti valutano gli stati astratti attraverso cicli, rami e confini di moduli. Poiché gli invarianti spesso emergono dalla convergenza ripetuta di stati astratti, l'identificazione richiede un ragionamento globale piuttosto che un'ispezione locale. Studi che esaminano anomalie nella propagazione dei dati mostrano come le sottili interazioni tra campi possano distorcere la correttezza se omesse dai modelli. Una volta estratti, gli invarianti vengono formalizzati come predicati negli ambienti di dimostrazione di teoremi o come proprietà nei framework di model checking. Questi vincoli diventano quindi garanzie formali che devono essere mantenute durante le attività di modernizzazione, come la migrazione di dati e schemi, il disaccoppiamento dei servizi o l'esecuzione distribuita. Con il progredire della modernizzazione, gli invarianti estratti fungono da contratti di regressione, preservando la correttezza storica nelle nuove architetture.

Utilizzo dell'interpretazione astratta per identificare i limiti di verifica e i punti di riduzione del modello

La verifica formale richiede confini ben definiti; dimostrare un intero sistema aziendale in modo monolitico non è né trattabile né necessario. L'interpretazione astratta identifica le partizioni naturali che supportano la verifica modulare. Ad esempio, una piattaforma di controllo della rete energetica può essere composta da moduli di previsione, filtri di input dei sensori, algoritmi di regolazione e logica di dispatch. Sebbene tutti interagiscano, non tutte le interazioni sono rilevanti per ogni obbligo di prova. L'interpretazione astratta aiuta a isolare le regioni semantiche in cui il comportamento si stabilizza o i rischi si propagano, consentendo agli ingegneri di verifica di determinare quali sottosistemi richiedono una prova approfondita e quali possono rimanere astratti.

Questa identificazione dei confini si basa in larga misura sull'analisi delle interdipendenze, dei modelli di condivisione dello stato e delle catene di propagazione delle mutazioni. Approfondimenti da argomenti come modernizzazione basata sulla dipendenza illustrano come la semplificazione strutturale supporti un ragionamento più efficace. Identificando aree di effetti collaterali controllati o transizioni deterministiche, gli analisti costruiscono modelli formali ridotti adatti alla dimostrazione di teoremi o al model checking. Queste riduzioni migliorano drasticamente le prestazioni di verifica eliminando variabili di stato o percorsi di esecuzione irrilevanti. Durante la modernizzazione, la riduzione del modello garantisce che le nuove funzionalità architetturali introdotte, come la messaggistica asincrona o le pipeline di streaming, non invalidino i presupposti necessari per un ragionamento solido.

Collegamento della semantica astratta agli obblighi di prova eseguibili negli strumenti di verifica moderni

Una volta stabilizzate, le astrazioni devono essere tradotte in obblighi di prova concreti per i motori di verifica formale. Questa traduzione include la generazione di invarianti induttivi, la definizione di precondizioni, la definizione di transizioni di stato ammissibili e la costruzione di contratti comportamentali che i model checker o i dimostratori di teoremi possano valutare. Questo passaggio costituisce il ponte tra il ragionamento statico e la verifica matematica. Ad esempio, un motore di routing per telecomunicazioni in fase di modernizzazione può basarsi su vincoli che garantiscono che nessuna tabella di routing si svuoti durante il failover. L'interpretazione astratta identifica le condizioni in base alle quali tali stati diventano raggiungibili. I team di verifica codificano quindi queste condizioni in logica temporale o in framework di ragionamento induttivo per garantire che la logica di failover si comporti come previsto in tutte le condizioni di rete.

Le intuizioni statiche forniscono un contesto critico quando si formano questi obblighi. Esplorazioni in metodologie di tracciamento dei modelli dimostrare come le sequenze operative modellano i requisiti di verifica. Allineando la semantica astratta a questi modelli di esecuzione, gli obblighi di prova risultanti mantengono la fedeltà al comportamento reale del sistema. Man mano che la modernizzazione introduce nuove astrazioni architettoniche, i team di verifica rigenerano gli obblighi in modo incrementale, garantendo che le varianti di sistema emergenti rimangano coerenti con le condizioni di correttezza convalidate storicamente. Ciò garantisce che la verifica formale rimanga una disciplina continua e allineata all'architettura piuttosto che un esercizio una tantum.

Progettazione basata su contratti e ragionamento basato su garanzie presunte per interfacce di sistemi complessi

La progettazione basata su contratti fornisce un metodo rigoroso per definire le aspettative comportamentali esatte dei componenti critici del sistema. In ambienti ad alta affidabilità e sensibili alla modernizzazione, i componenti raramente operano in modo isolato. Il loro corretto comportamento dipende invece dalle garanzie fornite dai moduli a monte e a valle. I contratti catturano queste relazioni come ipotesi e garanzie formalizzate che definiscono il comportamento dei componenti in ogni condizione ammissibile. Questi contratti diventano la base per la verifica sistematica poiché trasformano requisiti vagamente definiti in specifiche logiche precise. Con la sostituzione dei sistemi monolitici da parte di architetture distribuite e progetti orientati ai servizi, la progettazione basata su contratti diventa essenziale per mantenere un comportamento operativo prevedibile.

Il ragionamento basato sulla garanzia di assunzione consente ai team di verifica di scomporre sistemi di grandi dimensioni in sottoinsiemi gestibili. Invece di dimostrare le proprietà dell'intero sistema in una sola volta, ogni componente viene verificato in modo indipendente utilizzando il proprio contratto. Il sistema globale è corretto se tutti i contratti rimangono reciprocamente coerenti. Questo ragionamento composizionale è particolarmente importante nelle iniziative di modernizzazione, poiché i componenti legacy contengono spesso ipotesi implicite diverse da quelle previste nei servizi modernizzati. Il lavoro analitico correlato a coerenza multipiattaforma dimostra come le discrepanze introdotte durante la modernizzazione possano propagare errori sottili se i presupposti dell'interfaccia non vengono formalizzati. La progettazione basata su contratti previene queste incoerenze imponendo limiti comportamentali chiari e verificabili.

Definizione precisa delle responsabilità dell'interfaccia tra componenti eterogenei

I sistemi critici spesso coinvolgono componenti eterogenei che differiscono per modelli temporali, semantica di stato, convenzioni di gestione degli errori e formati dei messaggi. La progettazione basata su contratti fornisce un approccio strutturato per definire le responsabilità al di là di questi confini. Si consideri un programma di modernizzazione che migra un modulo di aggiudicazione dei reclami da un processo batch mainframe a un microservizio basato su eventi. Il componente legacy presuppone che i record arrivino in ordine ordinato e che i nuovi tentativi avvengano tramite ripetizioni batch pianificate. Il componente modernizzato, tuttavia, potrebbe ricevere eventi asincroni non ordinati con diversi livelli di completamento parziale. Senza contratti di interfaccia espliciti, il disallineamento tra le aspettative produce aggiornamenti di stato incoerenti o divergenze silenziose dei dati.

Gli ingegneri addetti alla verifica iniziano documentando le precondizioni che il servizio ricevente presuppone, come i vincoli di ordinamento dei dati o le combinazioni di campi validi. Definiscono quindi garanzie come aggiornamenti monotoni dei record o tempi di risposta limitati. Approfondimenti derivanti dalle analisi di impatto dell'evoluzione dello schema Spesso guidano la scoperta di convenzioni nascoste. Una volta stabiliti i contratti, gli ingegneri verificano che ogni componente soddisfi le sue garanzie quando i suoi presupposti sono validi. Questo processo garantisce l'integrità architettonica anche quando la modernizzazione modifica la topologia di esecuzione, la semantica di pianificazione o gli ambienti di distribuzione. I contratti fungono anche da artefatti di regressione che garantiscono che i miglioramenti futuri non violino silenziosamente i limiti comportamentali stabiliti.

Verifica compositiva per programmi di modernizzazione su larga scala

Il ragionamento basato sulla garanzia presuppone che consenta la verifica su larga scala scomponendo grandi obblighi di prova del sistema in unità più piccole e verificabili. Ciò è particolarmente rilevante per le aziende che modernizzano sistemi con milioni di righe di codice su più piattaforme. Tentare di ragionare su tali sistemi in modo monolitico è computazionalmente impossibile. Il ragionamento composizionale risolve questo problema verificando ogni componente in base a ipotesi esplicitamente dichiarate. Queste prove locali vengono quindi composte per dedurre la correttezza a livello di sistema.

Un sistema di routing per i trasporti offre uno scenario utile. I moduli legacy calcolano i percorsi ottimali utilizzando algoritmi deterministici. I microservizi modernizzati introducono l'esplorazione parallela dei percorsi, la messaggistica asincrona e le cache di dati distribuite. Senza una decomposizione strutturata, la verifica della correttezza del routing end-to-end diventa ardua. I team di verifica definiscono contratti che catturano i comportamenti richiesti, come la coerenza degli aggiornamenti del routing o la disponibilità di indici geospaziali. Studi correlati a analisi di impatto per la modernizzazione evidenziano come i presupposti legacy spesso rimangano impliciti. Una volta che i contratti chiariscono queste responsabilità, ogni componente viene verificato in modo indipendente, rendendo gestibile l'intero processo di ragionamento. Man mano che la modernizzazione procede per fasi, la verifica composizionale garantisce che i servizi di nuova introduzione mantengano la correttezza anche prima del completamento della migrazione completa.

Gestione di condizioni ambientali incerte e variabili nei sistemi distribuiti

I sistemi distribuiti operano in condizioni variabili che influiscono su latenza, throughput, ordinamento e comportamento in caso di errore. La progettazione basata su contratti tiene conto di queste incertezze formalizzando ipotesi ambientali che devono essere verificate affinché le garanzie del sistema rimangano valide. Ad esempio, un sistema di orchestrazione dei pagamenti può presupporre limiti superiori per i ritardi dei messaggi, garanzie di coerenza minima dai servizi di archiviazione o un comportamento prevedibile dei nuovi tentativi dai microservizi dipendenti. Queste ipotesi diventano parte del contratto e consentono ai team di verifica di determinare con precisione quando si applicano le garanzie.

Durante la modernizzazione di tali sistemi, le caratteristiche ambientali spesso cambiano. La migrazione verso regioni cloud introduce ulteriori variazioni di rete. La sostituzione delle chiamate sincrone al database con code asincrone modifica la semantica dell'ordinamento. Approfondimenti analitici da comportamenti di esecuzione simultanea rivelano come i cambiamenti ambientali influenzano la logica dei componenti. I contratti incorporano queste dipendenze per garantire la correttezza in diverse condizioni di runtime. I team di verifica utilizzano quindi il ragionamento basato su ipotesi di garanzia per dimostrare che, anche negli scenari peggiori ma ammissibili, proprietà globali come la vitalità, la coerenza dei dati e l'idempotenza rimangono intatte. Documentando esplicitamente le ipotesi ambientali, le aziende evitano regressioni accidentali durante le transizioni di architettura.

Garantire la stabilità comportamentale durante le distribuzioni incrementali e ibride

La modernizzazione raramente avviene in un'unica trasformazione. Le organizzazioni, invece, utilizzano architetture ibride in cui coesistono componenti legacy e servizi modernizzati. La progettazione basata su contratti aiuta a mantenere la stabilità durante questi stati di transizione specificando le interfacce comportamentali esatte che devono essere mantenute prima dell'integrazione. Si consideri un sistema logistico globale in cui gli aggiornamenti di tracciamento originariamente fluivano attraverso l'elaborazione centralizzata del mainframe. La migrazione introduce nodi di elaborazione distribuiti e servizi specifici per regione. La mancata documentazione delle ipotesi di interfaccia produce aggiornamenti incoerenti o transizioni di stato fuori ordine.

I team di verifica stabiliscono contratti precisi che descrivono le proprietà richieste, come le garanzie di ordinamento, la completezza degli eventi e la logica di convalida. Risultati analitici relativi a rischi di dipendenza dominanti può rivelare aree in cui sottili cambiamenti strutturali producono comportamenti inaspettati. Il ragionamento basato sulla garanzia di assunzione consente ai team di verificare la correttezza a livello locale prima che i componenti vengano integrati in implementazioni ibride. Con il progredire della modernizzazione, ogni nuovo componente viene convalidato nel contesto del quadro contrattuale in evoluzione. Questa convalida graduale garantisce che il sistema preservi le proprietà comportamentali globali anche quando i singoli moduli modificano i dettagli di implementazione o gli ambienti di esecuzione.

Integrazione di metodi formali in CI CD DevSecOps e pipeline di garanzia

L'integrazione della verifica formale nelle pipeline di distribuzione aziendale richiede il passaggio da controlli di correttezza isolati a ragionamenti continui e allineati all'automazione. I sistemi critici per la sicurezza e orientati alla modernizzazione operano in ambienti in cui i cambiamenti si verificano frequentemente, spesso tra team distribuiti e architetture ibride. Senza una verifica continua, anche gli aggiornamenti minori rischiano di alterare il comportamento in modi che violano i presupposti precedentemente convalidati. Le organizzazioni pertanto integrano la dimostrazione di teoremi, il model checking e la convalida basata su contratti nei flussi di lavoro di CI e CD per garantire che le aspettative di correttezza rimangano sincronizzate con le basi di codice in evoluzione. Questa integrazione collega sviluppo, ingegneria della qualità e governance architettonica.

Le pratiche DevSecOps rafforzano questo allineamento integrando responsabilità di sicurezza e correttezza lungo tutta la pipeline. I metodi formali potenziano queste responsabilità identificando rischi strutturali che i test automatizzati non sono in grado di rilevare. L'introduzione di servizi basati su cloud, confini di microservizi e modelli basati su eventi aumenta la superficie di rilevamento dei difetti derivanti da concorrenza, ordinamento o disallineamento dell'interfaccia. Studi come l'esame di Integrazione dell'analisi CI CD evidenziare come il ragionamento automatizzato supporti sia gli obiettivi di sicurezza che quelli di modernizzazione. Collegando controlli di verifica formali a ogni fase di commit, build o deployment, le organizzazioni trasformano la correttezza in una disciplina continua e applicabile.

Incorporamento del controllo del modello e della verifica delle proprietà nelle pipeline di compilazione

Il model checking si integra efficacemente nei flussi di lavoro CI CD perché può essere eseguito automaticamente dopo ogni modifica al codice, convalidando che le proprietà di sicurezza, vitalità e ordinamento rimangano intatte. Questo è particolarmente importante nelle iniziative di modernizzazione su larga scala in cui i componenti vengono gradualmente riscritti o riconfigurati. Si consideri un motore di calcolo del rischio aziendale che viene migrato da un'architettura mainframe batch-driven a una topologia di microservizi distribuita. Anche piccole modifiche al routing dei messaggi, agli intervalli di pianificazione o alle fasi di convalida dei dati possono introdurre nuovi percorsi di esecuzione che violano le invarianti previste.

I team di verifica configurano le fasi di model checking all'interno della pipeline in modo che vengano attivate a ogni unione o distribuzione. Queste fasi generano modelli di stato, applicano regole di astrazione e valutano le proprietà utilizzando strategie di ricerca limitate o illimitate. Il lavoro analitico su rilevamento del rischio di regressione Fornisce informazioni utili per identificare regressioni di prestazioni e correttezza che emergono solo in specifiche condizioni di temporizzazione o carico. Il model checking integra questi metodi garantendo che le condizioni strutturali e logiche siano mantenute in tutte le possibili tracce di esecuzione. Durante la modernizzazione, ogni controllo riuscito conferma che le trasformazioni incrementali non compromettono le garanzie di correttezza stabilite. Gli errori producono tracce di controesempio che guidano gli sviluppatori nella correzione dei problemi prima che raggiungano la produzione.

Utilizzo del ragionamento simbolico per rilevare sottili deviazioni logiche attraverso iterazioni rapide

Gli strumenti di ragionamento simbolico consentono alle pipeline di rilevare deviazioni logiche che aggirano i test convenzionali. Questi strumenti valutano i percorsi del codice rappresentando le variabili e gli stati del sistema in modo simbolico anziché concreto. Questo approccio rivela le deviazioni strutturali introdotte durante il refactoring, il replatforming o la riprogettazione dell'interfaccia. Uno scenario rappresentativo riguarda un modulo di autorizzazione dei pagamenti aziendali sottoposto a modernizzazione graduale. La logica legacy include un comportamento di fallback implicito che si attiva solo in rare condizioni temporali. Quando il modulo viene reimplementato come servizio asincrono, l'analisi simbolica identifica le differenze nel modo in cui si propagano i percorsi di errore.

Una volta integrato nei flussi di lavoro CI CD, il ragionamento simbolico cattura queste deviazioni durante le fasi iniziali della pipeline. Gli ingegneri definiscono proprietà simboliche come condizioni di normalizzazione, requisiti di ordinamento o obblighi di conservazione invarianti. Approfondimenti statici dal lavoro su modelli di revisione automatica del codice Dimostrare come il ragionamento statico e quello simbolico collaborino per far emergere problemi nascosti. I motori di ragionamento simbolico vengono eseguiti all'interno della pipeline per confrontare il comportamento prima e dopo ogni modifica. Questo processo garantisce che la modernizzazione non introduca errori logici sottili ma di impatto elevato. Man mano che i sistemi evolvono verso modelli distribuiti, i controlli simbolici aiutano a mantenere l'equivalenza tra il comportamento legacy e la semantica di implementazione moderna.

Incorporare la convalida del contratto nei gate di sicurezza DevSecOps

Con la modernizzazione che moltiplica le interfacce di sistema, la progettazione basata sui contratti diventa essenziale per verificare che i componenti si comportino in modo coerente in tutti gli ambienti. Le pipeline DevSecOps incorporano gate di convalida dei contratti che valutano se i componenti soddisfano presupposti e garanzie definiti. Questi gate impediscono che modifiche incompatibili vengano implementate a monte. Ad esempio, in un sistema informativo sanitario nazionale, i servizi di instradamento dei referral si basano su rigidi vincoli di ordinamento e convalida. Se la modernizzazione altera i formati dei messaggi, le regole di codifica o la semantica dell'ordinamento, l'assenza di convalida dei contratti consente la propagazione di aggiornamenti errati in tutto il sistema.

Gli strumenti di convalida dei contratti analizzano le modifiche in arrivo verificando se i componenti revisionati mantengono le garanzie comportamentali richieste. Convalidano inoltre che i presupposti ambientali rimangano soddisfatti, considerando le dipendenze a valle. Approfondimenti dalla ricerca su convalida dell'impatto basata sulla ricerca illustrano come la comprensione delle dipendenze transitorie influenzi la definizione del contratto. Durante l'esecuzione della pipeline, i validatori dei contratti bloccano le distribuzioni che violano i limiti di correttezza e forniscono una diagnostica fruibile. Ciò garantisce che la modernizzazione proceda in modo sicuro, anche quando i team lavorano in parallelo su più componenti e ambienti di esecuzione.

Stabilire prove di garanzia attraverso il ragionamento formale continuo

La verifica formale fornisce le prove di garanzia necessarie per la certificazione di sicurezza, la conformità normativa e la governance della modernizzazione. L'integrazione di queste prove nelle pipeline CI CD e DevSecOps trasforma la garanzia da un'attività periodica a un processo continuo. Ogni artefatto di prova, traccia di controllo del modello o record di convalida del contratto diventa parte di una cronologia verificabile che documenta la correttezza del sistema nel tempo. Ad esempio, una piattaforma di autenticazione biometrica a supporto dei servizi del settore pubblico potrebbe richiedere prove dimostrabili che tutti gli aggiornamenti preservino le garanzie di vitalità, l'integrità dei dati e la semantica di ripristino degli errori.

Le pipeline memorizzano automaticamente questi artefatti e li associano a identificatori di build, eventi di deployment e modifiche architetturali. Ciò garantisce che i team di conformità possano tracciare gli obblighi di correttezza in ogni fase di modernizzazione. Lavoro analitico su mappatura dei guasti critici Aiuta le organizzazioni a comprendere come si propagano le deviazioni, supportando argomentazioni di garanzia più solide. Integrando metodi formali nella governance della pipeline, le aziende mantengono l'affidabilità operativa anche con l'evoluzione dei sistemi. Questa registrazione continua di verifiche plasma la strategia di modernizzazione a lungo termine, identificando componenti stabili, aree fragili e vettori di rischio emergenti.

Scalabilità della verifica formale su basi di codice legacy, eterogenee e poliglotte

Scalare la verifica formale richiede alle organizzazioni di andare oltre le prove isolate e adottare strategie sistematiche in grado di gestire basi di codice di livello aziendale con una lunga storia operativa. I sistemi legacy spesso abbracciano più linguaggi, formati di dati e modelli di esecuzione, creando scenari di verifica che differiscono significativamente dalle moderne architetture modulari. Questi sistemi includono programmi batch, componenti basati su eventi, linguaggi specifici del dominio e regole aziendali integrate, frutto di decenni di cambiamenti incrementali. I team di verifica devono quindi unificare semantiche diverse in un framework di modellazione e ragionamento coerente. La sfida si intensifica quando la modernizzazione procede in parallelo, poiché sia il codice legacy che quello moderno devono essere verificati contemporaneamente. Prospettive analitiche su progettazione dell'integrazione delle applicazioni dimostrare come infrastrutture eterogenee complichino il ragionamento tra componenti. La verifica formale ha successo solo quando questa complessità viene gestita attraverso un'astrazione scalabile e una modularizzazione.

I sistemi poliglotti complicano ulteriormente la verifica introducendo linguaggi con regole di tipizzazione, semantica di concorrenza, convenzioni di gestione degli errori e caratteristiche di runtime diverse. In molte aziende, decenni di investimenti hanno prodotto ecosistemi in cui coesistono COBOL, Java, Python, SQL e scripting proprietario. Garantire la correttezza in tali ambienti richiede strategie di verifica che generalizzino il comportamento senza perdere la precisione necessaria per garantire la vitalità, la sicurezza e l'ordinamento. Approfondimenti dalla ricerca su analisi del grafico delle dipendenze dimostrare come la mappatura strutturale riveli interazioni interlinguistiche nascoste che devono essere incorporate nei modelli formali. Man mano che le organizzazioni modernizzano questi scenari poliglotti in architetture distribuite o cloud native, la verifica scalabile diventa essenziale per prevenire regressioni e preservare l'integrità operativa.

Armonizzazione della semantica tra più linguaggi e paradigmi di esecuzione

Una delle principali difficoltà nella verifica dei sistemi poliglotti risiede nel riconciliare le semantiche di linguaggi diversi in un'astrazione unificata. Ad esempio, una piattaforma di elaborazione assicurativa legacy può includere programmi batch COBOL, middleware Java, logica front-end JavaScript ed estensioni di analisi Python. Ogni linguaggio presenta semantiche uniche per la concorrenza, la gestione delle eccezioni, la mutazione di stato e la gestione della memoria. La verifica formale richiede un'astrazione coerente tra queste funzionalità, in modo che i modelli riflettano accuratamente il comportamento end-to-end del sistema.

Per raggiungere questo obiettivo, i team di verifica costruiscono profili semantici per ciascun linguaggio, identificando i costrutti che influenzano il flusso di controllo, le transizioni di stato e la propagazione degli errori. Questi profili costituiscono la base per modelli indipendenti dal linguaggio, come macchine a stati estesi o strutture relazionali simboliche. Il lavoro analitico su modernizzazione tecnologica mista Chiarisce come le dipendenze tra linguaggi si evolvono durante la modernizzazione. Ad esempio, la sostituzione di routine COBOL sincrone con microservizi asincroni altera la semantica della comunicazione che deve essere riflessa nei modelli formali. I team di verifica utilizzano ragionamento simbolico, interpretazione astratta e contratti di interfaccia per armonizzare il comportamento. Una volta stabilita una semantica unificata, i dimostratori di teoremi e i verificatori di modelli operano su un unico modello coerente, consentendo una convalida scalabile ed end-to-end delle proprietà di correttezza.

Partizionamento di grandi basi di codice in moduli pronti per la verifica

I sistemi di grandi dimensioni devono essere scomposti in segmenti pronti per la verifica per rimanere trattabili. Tentare di modellare e verificare un'intera applicazione monolitica contemporaneamente si traduce in un'esplosione di stato intrattabile e in obblighi di prova ingestibili. Un ridimensionamento efficace richiede un partizionamento basato su confini architettonici, proprietà dei dati, fasi di esecuzione o gerarchie di dipendenze. Si consideri un sistema di controllo della produzione globale con migliaia di programmi interagenti. Alcuni componenti gestiscono l'acquisizione dei sensori, altri coordinano la movimentazione dei materiali, mentre i moduli predittivi operano in modo asincrono su modelli statistici. I team di verifica devono identificare i confini di verifica naturali che isolano le unità comportamentali stabili.

Approfondimenti statici dallo studio di rischio di propagazione del guasto rivelano dove le dipendenze sono strettamente accoppiate e dove la decomposizione modulare è sicura. Con queste informazioni, gli ingegneri suddividono la base di codice in moduli che possono essere verificati indipendentemente in base a ipotesi ben definite. Ogni modulo riceve il proprio modello di stato, invarianti e garanzie temporali. Quando i moduli vengono riassemblati in un sistema globale, il ragionamento basato sulle garanzie presunte assicura la correttezza dell'intera architettura. Questo approccio consente alla verifica di scalare linearmente con le dimensioni del sistema, consentendone l'adozione pratica in basi di codice multimilionarie in fase di modernizzazione.

Integrazione di modelli formali con telemetria operativa reale per guidare l'ambito di verifica

La telemetria operativa fornisce informazioni preziose che aiutano i team di verifica a determinare quali comportamenti sono critici da modellare e dimostrare. I sistemi legacy spesso contengono percorsi di codice inattivi, funzionalità obsolete o stati di errore raramente attivati, che aumentano la complessità del modello senza migliorare il valore della verifica. La telemetria aiuta a identificare i percorsi utilizzati più frequentemente, le interazioni a più alto rischio e le anomalie ricorrenti. Ad esempio, un motore di transazione al dettaglio può presentare rari picchi di concorrenza o occasionali tempeste di tentativi in condizioni di carico stagionale elevato. La telemetria identifica queste condizioni in modo che i modelli di verifica incorporino i comportamenti rilevanti, escludendo in modo sicuro i percorsi irraggiungibili o di basso valore.

Studi su analisi di impatto guidata dalla telemetria dimostrare come i dati comportamentali reali perfezionino la pianificazione della modernizzazione. I team di verifica applicano tecniche simili correlando le informazioni di telemetria con modelli formali. Ad esempio, se la telemetria identifica un pattern di deadlock ricorrente in specifiche distribuzioni di dati, i modelli formali incorporano questi stati e li valutano rigorosamente. Al contrario, se la telemetria indica che un percorso di fallback legacy non è stato eseguito per anni a causa di una logica di business obsoleta, il percorso può essere astratto. Questa sinergia garantisce che la verifica rimanga focalizzata, scalabile e allineata ai rischi operativi reali durante la modernizzazione.

Garantire la continuità della verifica negli ambienti moderni ibridi legacy

La modernizzazione introduce ambienti ibridi in cui i componenti legacy operano insieme a microservizi moderni, piattaforme cloud e architetture basate su eventi. Garantire la continuità della verifica in queste topologie miste è uno degli aspetti più complessi del ragionamento formale su scala aziendale. Ogni ambiente impone regole di temporizzazione, meccanismi di comunicazione e garanzie di coerenza diversi. Un sistema che un tempo operava su cicli batch prevedibili può ora fare affidamento su eventi asincroni, cache distribuite e comportamenti di scalabilità automatica che introducono il non determinismo.

I team di verifica costruiscono modelli bridge che unificano la semantica legacy con le caratteristiche di runtime moderne. Studi analitici su riduzione del rischio attraverso la semplificazione della dipendenza mostrano come la semplificazione delle dipendenze migliori la resilienza del sistema. Approfondimenti simili informano i confini della verifica identificando dove le modifiche di modernizzazione introducono nuove condizioni di temporizzazione o ordinamento. I modelli formali combinano quindi vincoli legacy, come le letture deterministiche dei file, con costrutti moderni come la coerenza finale o l'arrivo asincrono dei messaggi. Questa modellazione ibrida garantisce che la verifica rimanga valida durante le fasi di transizione. Con il progredire della modernizzazione, i modelli verificati si evolvono iterativamente, preservando le garanzie di correttezza anche quando gli ambienti di esecuzione cambiano radicalmente.

Certificazione, conformità e percorsi di controllo con prove formali per sistemi critici

I quadri di certificazione per l'aviazione, la difesa, l'energia, la finanza e le infrastrutture pubbliche richiedono prove deterministiche che i sistemi critici si comportino correttamente in tutte le condizioni autorizzate. I test tradizionali offrono una copertura parziale che non può soddisfare questi rigorosi requisiti di garanzia. La verifica formale colma questa lacuna fornendo garanzie matematicamente fondate che le proprietà di sicurezza e vitalità siano mantenute in tutti gli stati raggiungibili. Con la modernizzazione che trasforma i sistemi legacy in architetture distribuite o orientate ai servizi, gli enti di certificazione si aspettano sempre più prove ad alta precisione che dimostrino l'equivalenza funzionale con il comportamento precedentemente convalidato. Questo cambiamento riflette una tendenza più ampia del settore in cui la correttezza deve essere dimostrata continuamente piuttosto che riesaminata periodicamente.