Gli scenari del software aziendale che entreranno nel 2026 continueranno a crescere in complessità strutturale piuttosto che in semplicità. Decenni di logica accumulata, linguaggi di programmazione misti, modelli di distribuzione ibridi e dipendenze strettamente interconnesse limitano sempre di più il modo in cui il cambiamento può essere introdotto senza conseguenze indesiderate. In questo contesto, gli strumenti di analisi statica del codice non sono più considerati controlli di qualità opzionali, ma strumenti fondamentali per comprendere il comportamento effettivo dei sistemi prima di avviare qualsiasi iniziativa di modernizzazione, refactoring o sicurezza.

Ciò che differenzia l'analisi statica del codice su scala aziendale dagli strumenti orientati agli sviluppatori non è la capacità di segnalare difetti isolati, ma la capacità di analizzare interi patrimoni applicativi. Le grandi organizzazioni raramente operano all'interno di un singolo runtime o modello architetturale. I carichi di lavoro batch mainframe coesistono con servizi distribuiti, le interfacce legacy si intersecano con le API cloud-native e i requisiti normativi impongono ulteriori vincoli su come misurare e mitigare il rischio. L'analisi statica deve quindi operare oltre i confini, esponendo percorsi di esecuzione, dipendenze nascoste e rischi strutturali altrimenti invisibili attraverso i soli test.

SMART TS XL

Soluzione ideale di analisi del codice statico per aziende con grandi sistemi e asset distribuiti

Esplora oraLa crescente enfasi sulla distribuzione continua e sulla modernizzazione accelerata ha ulteriormente elevato il ruolo delle informazioni basate sull'analisi. Man mano che le aziende perseguono obiettivi più ampi modernizzazione delle applicazioni Con le iniziative, il costo di una comprensione incompleta diventa sempre più evidente. Le decisioni di refactoring prese senza una piena visibilità sul flusso di controllo, sulla propagazione dei dati o sull'accoppiamento tra sistemi spesso introducono instabilità, regressioni delle prestazioni o problemi di conformità che emergono solo dopo l'implementazione. Ci si aspetta ora che gli strumenti di analisi statica del codice riducano questa incertezza fornendo chiarezza architetturale prima che la modifica venga eseguita.

In questo contesto, i criteri utilizzati per valutare gli strumenti di analisi statica del codice nel 2026 stanno cambiando. La sola accuratezza non è sufficiente. Le aziende richiedono analisi approfondite, scalabilità su milioni di righe di codice, supporto per ambienti eterogenei e la capacità di tradurre i risultati tecnici in informazioni fruibili per architetti, responsabili di piattaforma e responsabili del rischio. Il seguente confronto esamina le prestazioni dei principali strumenti di analisi statica del codice aziendale rispetto a queste esigenze in continua evoluzione e come le loro funzionalità si allineano alle realtà dei sistemi mission-critical su larga scala.

Confronto e classifica degli strumenti di analisi del codice statico aziendale per il 2026

Il confronto seguente valuta i principali strumenti di analisi statica del codice in base a criteri rilevanti in ambienti aziendali su larga scala, piuttosto che in base ai singoli team di sviluppo. Ogni strumento viene valutato in base alla profondità di analisi, alla scalabilità su sistemi eterogenei, al supporto per piattaforme legacy e moderne e alla sua capacità di estrarre informazioni significative da strutture di dipendenza complesse. La classifica riflette l'efficacia con cui questi strumenti consentono la comprensione dell'architettura, l'identificazione dei rischi e un processo decisionale informato in ambienti in cui il cambiamento comporta significative conseguenze operative e normative.

SMART TS XL

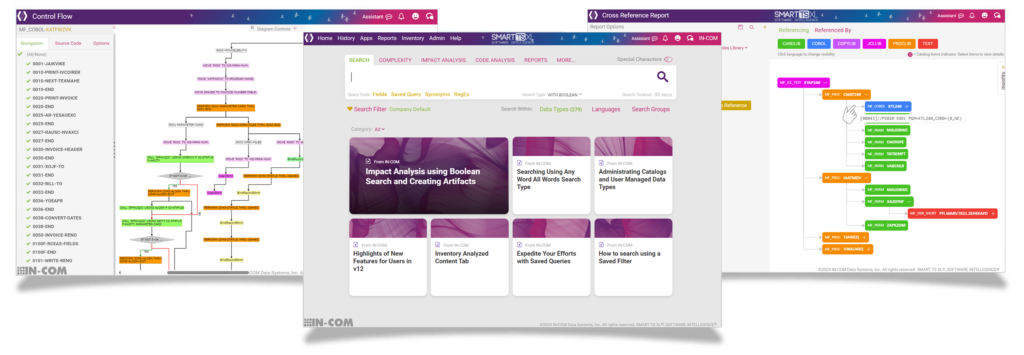

SMART TS XL è una piattaforma aziendale di analisi statica del codice, valutazione dell'impatto e intelligence applicativa progettata per patrimoni software eterogenei e di grandi dimensioni. È progettata per supportare le organizzazioni che operano in ambienti mainframe, midrange e distribuiti, dove decenni di logica accumulata, elaborazione batch e dipendenze multipiattaforma rendono il cambiamento intrinsecamente rischioso. Piuttosto che concentrarsi su risultati isolati sulla qualità del codice, SMART TS XL è progettato per mostrare come si comportano effettivamente le applicazioni rendendo visibili i percorsi di esecuzione, le relazioni tra i dati e le strutture di dipendenza nell'intero portfolio.

La piattaforma opera come un sistema web-based ad alte prestazioni, in grado di indicizzare e analizzare miliardi di righe di codice e relativi artefatti in pochi secondi. Alleggerendo i carichi di lavoro di analisi dai sistemi di produzione e centralizzando le informazioni in un ambiente condiviso, SMART TS XL Supporta migliaia di utenti simultanei senza degrado delle prestazioni. Questa scalabilità lo rende adatto non solo ai team di sviluppo, ma anche ad architetti, responsabili della modernizzazione, supporto alla produzione, audit e stakeholder della conformità che necessitano di una visibilità coerente e basata su prove concrete sui sistemi complessi. Richiedi un demo.

Analisi e scoperta statica su scala aziendale

Nel suo nucleo, SMART TS XL Fornisce un'analisi statica approfondita su un'ampia gamma di linguaggi di programmazione, costrutti di controllo dei processi, database e artefatti di supporto. Supporta tecnologie legacy e moderne, tra cui COBOL, PL/I, Natural, RPG, Assembler, Java, C#, Python, VB6, script UNIX, JCL, PROC, artefatti CICS, definizioni MQ, schemi di database e documenti strutturati. Codice sorgente, logica batch, file di configurazione e persino artefatti non di codice come documentazione e diagrammi possono essere indicizzati e analizzati insieme, consentendo di scoprire relazioni tra repository tradizionalmente isolati.

Questa capacità di discovery unificata consente alle organizzazioni di andare oltre l'ispezione a livello di file e di raggiungere una comprensione a livello di sistema. Programmi, processi, campi, file, tabelle e messaggi possono essere tracciati su più piattaforme, rivelando il flusso della logica aziendale attraverso catene batch, transazioni online e processi di reporting a valle. Queste relazioni vengono evidenziate tramite report interattivi con riferimenti incrociati, mappe delle dipendenze e viste di esecuzione navigabili, anziché elenchi statici.

Analisi dell'impatto multipiattaforma e mappatura delle dipendenze

SMART TS XL pone particolare enfasi sull'analisi dell'impatto multipiattaforma. Le modifiche introdotte in una parte di un'applicazione raramente rimangono isolate negli ambienti aziendali, soprattutto quando i carichi di lavoro mainframe interagiscono con servizi distribuiti e archivi dati condivisi. SMART TS XL analizza le relazioni tra chiamate, l'utilizzo dei dati, i percorsi di esecuzione dei lavori e il flusso di controllo per identificare le zone di impatto a monte e a valle nei diversi linguaggi e sistemi.

Le funzionalità di mappatura delle dipendenze presentano queste relazioni visivamente utilizzando diagrammi interattivi con codifica a colori che evidenziano chiamanti, destinatari, produttori di dati e consumatori. L'analisi dell'impatto può essere avviata da un programma, un campo, un elemento di database, una fase di processo o persino dai risultati di ricerca, consentendo ai team di definire con precisione l'ambito delle modifiche prima dell'inizio dello sviluppo. Questo approccio riduce le dipendenze mancanti, limita i test eccessivi e fornisce una base solida per la pianificazione delle modifiche e la valutazione dei rischi.

Viste orientate all'esecuzione della logica batch e del programma

Per ambienti con elaborazione batch complessa, SMART TS XL Fornisce una comprensione in stile runtime senza dover eseguire codice. Le funzionalità di espansione COBOL e JCL risolvono copybook, PROC, simboli e override per presentare la logica così come viene effettivamente eseguita in produzione. Le catene batch possono essere tracciate end-to-end, rivelando quali programmi vengono eseguiti, in quale ordine e con quali parametri.

I diagrammi di flusso e i diagrammi di controllo traducono la logica profondamente annidata in rappresentazioni visive navigabili. Queste visualizzazioni consentono di comprendere il comportamento di esecuzione, identificare percorsi di codice inattivi o irraggiungibili e analizzare la complessità delle diramazioni senza fare affidamento su conoscenze tribali o procedure dettagliate manuali. I diagrammi di tracciamento sul campo estendono ulteriormente questa capacità tracciando il modo in cui gli elementi dati vengono creati, trasformati e propagati tra programmi, processi e database, supportando modifiche strutturali sicure e revisioni normative.

Ricerca avanzata, rilevamento di modelli e analisi di precisione

SMART TS XL Include un motore di ricerca aziendale ad alte prestazioni, ottimizzato per basi di codice di grandi dimensioni e con tecnologie miste. Supporta logica booleana complessa, ricerche di prossimità, ricerche a blocchi, espressioni regolari, gestione dei sinonimi e filtri a grana fine che limitano l'analisi a linguaggi, tipi di dati o sezioni di codice specifici. Le tecniche di ricerca a strati consentono agli utenti di restringere progressivamente ampi set di risultati in ambiti precisi, adatti per analisi di impatto, audit o valutazioni di modernizzazione.

Queste funzionalità di ricerca sono strettamente integrate con funzioni di riferimento incrociato, impatto, complessità e visualizzazione. I risultati possono essere inseriti direttamente in viste di dipendenza, report o flussi di lavoro di analisi più approfonditi, riducendo l'attrito tra la fase di individuazione e il processo decisionale. Le query salvate e parametrizzate consentono alle organizzazioni di standardizzare i controlli dei rischi e i modelli di analisi ripetibili tra team e progetti.

Analisi della complessità e quantificazione del rischio

SMART TS XL Fornisce un'analisi della complessità a livello di portfolio che si estende oltre i singoli programmi. Metriche di complessità come linee di codice, complessità ciclomatica e misure di Halstead possono essere calcolate su sottoinsiemi mirati di applicazioni definiti dai risultati di ricerca o dalle zone di impatto. Ciò consente ai team di quantificare il rischio tecnico all'interno di specifiche funzioni aziendali o candidati alla modernizzazione, anziché basarsi su medie approssimative a livello di applicazione.

Combinando le metriche di complessità con l'analisi delle dipendenze e dell'impatto, SMART TS XL Supporta una stima più realistica degli sforzi e una definizione delle priorità. Le aree con elevata interazione e complessità possono essere identificate precocemente, consentendo di sequenziare le iniziative di modernizzazione e bonifica in base al rischio strutturale effettivo piuttosto che a ipotesi.

Trasferimento di conoscenze, preparazione all'audit e supporto alla governance

Una sfida ricorrente nelle grandi aziende è la perdita di conoscenze istituzionali dovuta all'invecchiamento dei sistemi e al pensionamento o alla rotazione del personale esperto. SMART TS XL Questo problema viene affrontato centralizzando la conoscenza delle applicazioni in una piattaforma consultabile ed esplorabile che cattura la struttura e il comportamento dei sistemi. Documentazione, report, diagrammi e artefatti di prova possono essere generati e condivisi a supporto di onboarding, audit e richieste normative.

Le funzionalità di esportazione consentono di confezionare i risultati delle analisi come artefatti con timestamp e pronti per la produzione di prove, adatti per revisioni di conformità, approvazioni di modifiche e audit esterni. I controlli di accesso e il monitoraggio dell'utilizzo supportano i requisiti di governance, in particolare in ambienti con modelli di sviluppo offshore o di manutenzione esternalizzata.

Distribuzione, integrazione e adattamento operativo

SMART TS XL è progettato per un'implementazione rapida e una minima interruzione operativa. Le installazioni possono essere completate in poche ore, con connettori disponibili per l'acquisizione di dati da ambienti mainframe, sistemi di controllo del codice sorgente distribuiti, database e repository condivisi. Sono supportati sia caricamenti di dati completi che incrementali, consentendo agli ambienti di rimanere aggiornati senza richiedere un intervento manuale costante.

Le funzionalità di automazione consentono l'esecuzione automatica dei processi di analisi, supportando la generazione continua di insight in linea con i cicli di cambiamento aziendali. Centralizzando l'analisi su un'infrastruttura conveniente, le organizzazioni possono ridurre la dipendenza da costose risorse di produzione, aumentando al contempo la profondità e la disponibilità analitica tra i team.

SonarQube Enterprise Edition

SonarQube Enterprise Edition è una piattaforma di analisi statica del codice progettata per supportare le grandi organizzazioni di sviluppo che cercano di applicare in modo coerente gli standard di qualità, manutenibilità e sicurezza del codice nei moderni portafogli software. Il suo ruolo principale negli ambienti aziendali è quello di fungere da livello di ispezione continua integrato nei flussi di lavoro di sviluppo, fornendo un feedback tempestivo sui problemi del codice prima che le modifiche raggiungano la produzione. Nei portafogli in cui la velocità di revisione diventa un collo di bottiglia, viene spesso affiancata a un approccio più ampio. strumenti di revisione del codice per formalizzare i controlli di qualità e ridurre le variazioni tra i team.

A differenza delle piattaforme di analisi a livello di portfolio, il punto di forza di SonarQube risiede nella sua capacità di operare in stretta prossimità del flusso di lavoro degli sviluppatori. L'analisi viene in genere attivata come parte delle pipeline di build o della convalida delle pull request, consentendo ai team di rilevare code smell, bug e problemi di sicurezza in modo incrementale man mano che il codice si evolve. Questo è in linea con le organizzazioni che standardizzano i controlli automatizzati lungo le pipeline di distribuzione, inclusi gli approcci descritti in Pipeline CI / CD, dove l'analisi statica diventa un controllo ripetibile piuttosto che una fase di revisione ad hoc.

Analisi statica basata su regole e Quality Gate

Al centro di SonarQube Enterprise Edition c'è un motore di analisi statica basato su regole che valuta il codice sorgente rispetto a un set di regole ampio e configurabile. Queste regole coprono categorie comuni come problemi di manutenibilità, difetti di affidabilità e vulnerabilità di sicurezza. I risultati vengono classificati in base alla gravità e mappati su quality gate che determinano se il codice può avanzare lungo la pipeline di distribuzione.

I quality gate sono un meccanismo fondamentale per l'applicazione degli standard organizzativi su larga scala. Le aziende possono definire soglie per la copertura del nuovo codice, la densità dei difetti e l'esposizione alle vulnerabilità, garantendo che le modifiche soddisfino criteri predefiniti prima dell'integrazione. Questa funzionalità è particolarmente preziosa in ambienti con team distribuiti, sviluppo esternalizzato o elevato turnover degli sviluppatori, dove l'applicazione coerente riduce la dipendenza dalle revisioni manuali.

Copertura linguistica e integrazione dell'ecosistema di sviluppo

SonarQube supporta un'ampia gamma di linguaggi di programmazione moderni, tra cui Java, C#, JavaScript, TypeScript, Python e altri comunemente utilizzati nello sviluppo di applicazioni aziendali. Il suo ecosistema di plugin e integrazioni gli consente di connettersi con le più diffuse piattaforme CI/CD, sistemi di controllo del codice sorgente e sistemi di tracciamento dei problemi. Questa stretta integrazione lo rende ideale per le organizzazioni che danno priorità al controllo qualità automatizzato come parte delle loro pipeline di distribuzione.

Tuttavia, il modello di analisi di SonarQube è principalmente incentrato sulla sorgente e limitato al repository. Sebbene possa analizzare più progetti in parallelo, la sua comprensione delle relazioni tra repository, piattaforme e contesti di esecuzione è limitata. L'analisi è in genere limitata a singole applicazioni o servizi, anziché estendersi a intere aree aziendali con dati condivisi, flussi di lavoro batch o dipendenze multipiattaforma.

Analisi della sicurezza e supporto alla conformità

Nelle sue edizioni enterprise, SonarQube include funzionalità avanzate di analisi della sicurezza, allineate alle categorie di vulnerabilità più comuni. È in grado di identificare pattern associati a difetti di iniezione, configurazioni non sicure e uso improprio delle API. I risultati vengono presentati in un formato accessibile sia agli sviluppatori che ai team di sicurezza, supportando i flussi di lavoro di correzione all'interno degli strumenti esistenti.

Dal punto di vista della conformità, SonarQube offre tracciabilità e reporting che aiutano a dimostrare l'aderenza agli standard di codifica interni e alle policy di sicurezza. È possibile generare report per mostrare l'andamento dei problemi, i progressi nelle azioni correttive e la conformità ai quality gate nel tempo. Sebbene queste funzionalità supportino la preparazione all'audit all'interno dei team di sviluppo, sono meno focalizzate sulla produzione di prove a livello di sistema del comportamento di esecuzione o dell'impatto tra sistemi.

Caratteristiche di scalabilità e considerazioni operative

SonarQube Enterprise Edition è progettato per essere scalabile su un gran numero di repository e team di sviluppo, in particolare se implementato in ambienti distribuiti o containerizzati. Le sue prestazioni si adattano all'infrastruttura disponibile, rendendolo adatto ad organizzazioni con elevati volumi di commit e cicli di analisi frequenti. Le dashboard centralizzate offrono una visibilità aggregata su tutti i progetti, aiutando la dirigenza a monitorare i trend di qualità ad alto livello.

Detto questo, la scalabilità di SonarQube è principalmente orizzontale tra i progetti piuttosto che verticale in termini di complessità del sistema. Non risolve i percorsi di esecuzione runtime, la logica di orchestrazione batch o la discendenza dei dati profonda tra piattaforme eterogenee. In ambienti dominati da carichi di lavoro mainframe, scheduling batch o sistemi legacy strettamente accoppiati, SonarQube viene spesso utilizzato come strumento complementare piuttosto che come fonte autonoma di informazioni architetturali.

Casi d'uso tipici aziendali e limitazioni

SonarQube Enterprise Edition è particolarmente efficace nelle aziende con una solida maturità DevOps, stack di sviluppo standardizzati e un'attenzione particolare alla prevenzione del degrado della qualità nel codice sviluppato attivamente. Eccelle nel garantire la coerenza, ridurre i code smell e integrare i controlli di qualità nelle pipeline di distribuzione in rapida evoluzione.

I suoi limiti diventano più evidenti negli scenari di modernizzazione che richiedono la comprensione di come i cambiamenti si propagano su sistemi di grandi dimensioni e interconnessi. SonarQube non tenta di modellare l'ordine di esecuzione, la propagazione dei dati tra job e piattaforme, né le catene di dipendenza a livello di sistema. Di conseguenza, viene spesso abbinato a piattaforme di analisi più approfondite quando le aziende devono valutare il rischio di modernizzazione, l'impatto dei batch o gli effetti dei cambiamenti su più portafogli.

Checkmarx Uno

Checkmarx One è una piattaforma di sicurezza applicativa incentrata sulle applicazioni aziendali, incentrata su test statici di sicurezza applicativa all'interno di moderne pipeline di sviluppo e distribuzione. Il suo ruolo principale nelle grandi organizzazioni è identificare le vulnerabilità di sicurezza nelle prime fasi del ciclo di vita del software, in particolare in ambienti in cui rilasci frequenti, team distribuiti e architetture cloud-native aumentano l'esposizione a falle sfruttabili. Anziché tentare di modellare il comportamento di esecuzione a livello di sistema, Checkmarx One si concentra sul rilevamento di modelli di codifica non sicuri e debolezze di configurazione in linea con le tassonomie di sicurezza riconosciute.

La piattaforma è in genere adottata da aziende con pratiche DevSecOps consolidate, in cui l'analisi della sicurezza deve essere eseguita in modo continuativo parallelamente allo sviluppo, anziché come controllo post-rilascio. In tali ambienti, Checkmarx One funge da meccanismo preventivo, mirando a ridurre la probabilità che percorsi di codice vulnerabili vengano introdotti nei sistemi di produzione.

Focus sui test di sicurezza delle applicazioni statiche

Il cuore di Checkmarx One è un motore di test di sicurezza statico delle applicazioni, ottimizzato per rilevare vulnerabilità a livello di codice sorgente. L'analisi viene eseguita senza eseguire le applicazioni, consentendo di identificare i problemi in anticipo, spesso durante le fasi di commit o build del codice. La piattaforma associa i risultati a categorie di vulnerabilità note, supportando i team di sicurezza che si affidano a framework di classificazione del rischio standardizzati come Vulnerabilità OWASP per dare priorità agli sforzi di bonifica.

L'enfasi sui risultati specifici per la sicurezza differenzia Checkmarx One dagli strumenti di analisi statica generici. Anziché evidenziare problemi di manutenibilità o architettura, la piattaforma si concentra sulle debolezze che potrebbero portare all'esposizione dei dati, all'accesso non autorizzato o all'escalation dei privilegi. Questa specializzazione la rende particolarmente rilevante nei settori regolamentati, in cui la divulgazione delle vulnerabilità e le tempistiche di correzione sono attentamente monitorate.

Integrazione nelle pipeline DevSecOps aziendali

Checkmarx One è progettato per integrarsi perfettamente con le pipeline CI/CD e i flussi di lavoro degli sviluppatori. Le scansioni possono essere attivate automaticamente come parte di processi di build, richieste pull o gate di rilascio, garantendo che l'analisi della sicurezza avvenga in modo coerente e senza interventi manuali. I risultati vengono visualizzati tramite dashboard e integrazioni con sistemi di tracciamento dei problemi, consentendo di inoltrare i risultati direttamente ai team di sviluppo per la correzione.

Questo modello operativo incentrato sulla pipeline supporta un'elevata velocità di sviluppo mantenendo al contempo un livello base di garanzia della sicurezza. Tuttavia, l'attenzione rivolta a singoli repository e servizi implica che l'analisi sia generalmente limitata a basi di codice discrete. Sebbene questo si adatti bene ai microservizi e alle architetture modulari, limita la visibilità sulle dipendenze tra applicazioni o sulle catene di esecuzione multipiattaforma comuni nei sistemi aziendali di lunga durata.

Copertura linguistica e orientamento cloud-native

Checkmarx One supporta un'ampia gamma di linguaggi di programmazione e framework moderni comunemente utilizzati nello sviluppo aziendale e cloud-native. Questa ampiezza consente una scansione di sicurezza coerente tra team di sviluppo eterogenei, senza richiedere molteplici strumenti specializzati. Il modello di distribuzione cloud-native della piattaforma semplifica ulteriormente l'implementazione e la scalabilità, riducendo i costi operativi per le organizzazioni che gestiscono un gran numero di applicazioni.

Detto questo, il supporto per tecnologie legacy e ambienti batch-oriented è più limitato. Linguaggi mainframe, costrutti di controllo dei processi e flussi di lavoro legacy strettamente interconnessi esulano in genere dall'ambito principale della piattaforma. Di conseguenza, Checkmarx One viene spesso implementato insieme ad altri strumenti di analisi quando le aziende devono proteggere sia componenti moderni che legacy all'interno dello stesso ambiente applicativo.

Reporting dei rischi e allineamento della governance

Dal punto di vista della governance, Checkmarx One offre funzionalità di reporting che supportano il monitoraggio delle vulnerabilità, lo stato di ripristino e la reportistica sulla conformità. I responsabili della sicurezza possono monitorare le tendenze tra applicazioni, team e periodi di tempo, contribuendo a dimostrare l'aderenza alle policy interne e alle aspettative normative esterne. I risultati possono essere aggregati per mostrare la situazione di rischio complessiva, consentendo la definizione delle priorità a livello di portafoglio.

Tuttavia, questi report si concentrano sulla presenza di vulnerabilità piuttosto che sull'impatto operativo. La piattaforma non tenta di quantificare come una vulnerabilità si propaga attraverso i percorsi di esecuzione o come interagisce con l'elaborazione batch, i flussi di dati o i sistemi downstream. Questa distinzione è importante nelle aziende in cui la comprensione del raggio di azione e del rischio sistemico è fondamentale quanto l'identificazione delle singole debolezze.

Casi d'uso e vincoli tipici delle aziende

Checkmarx One è particolarmente efficace nelle aziende che desiderano integrare controlli di sicurezza direttamente in ambienti di sviluppo in rapida evoluzione. È in grado di identificare tempestivamente i problemi di sicurezza a livello di codice, riducendo le rilavorazioni e supportando una gestione coerente delle vulnerabilità in un ampio numero di sviluppatori. Per le organizzazioni che si stanno modernizzando verso architetture cloud-native, fornisce un meccanismo scalabile per l'applicazione di misure di sicurezza idonee.

I suoi limiti emergono in scenari che richiedono una comprensione olistica del comportamento delle applicazioni, delle catene di dipendenza o dell'impatto della modernizzazione su sistemi eterogenei. In questi casi, Checkmarx One viene in genere posizionato come un livello di sicurezza specializzato piuttosto che come una piattaforma di analisi completa, integrando strumenti incentrati sulla comprensione dell'esecuzione, sulla mappatura delle dipendenze e sulla valutazione del rischio strutturale.

Analizzatore di codice statico Fortify

Fortify Static Code Analyzer è una piattaforma di test di sicurezza statica delle applicazioni di livello enterprise, progettata per identificare le vulnerabilità di sicurezza in ambienti software di grandi dimensioni e regolamentati. Il suo ruolo principale all'interno delle aziende è fornire un rilevamento sistematico di pattern di codice che introducono rischi per la sicurezza, in particolare nelle organizzazioni in cui conformità, verificabilità e processi formali di gestione del rischio influenzano il modo in cui vengono gestite le modifiche al software. Fortify è comunemente adottato in settori in cui la garanzia della sicurezza deve essere dimostrabile, ripetibile e allineata ai controlli aziendali consolidati.

Invece di enfatizzare i cicli di feedback incentrati sugli sviluppatori, Fortify viene spesso posizionato come un controllo di sicurezza centralizzato all'interno di framework di governance più ampi. Supporta le organizzazioni che richiedono una classificazione standardizzata delle vulnerabilità, reporting coerente e tracciabilità su ampi portafogli di applicazioni sviluppate da team distribuiti o di terze parti.

Motore di analisi statica incentrato sulla sicurezza

Il cuore di Fortify Static Code Analyzer è un motore di analisi incentrato sulla sicurezza che ispeziona il codice sorgente per identificare le vulnerabilità senza eseguire applicazioni. Il motore applica un set completo di regole di sicurezza progettate per rilevare debolezze come difetti di iniezione, gestione non sicura dei dati, errori di autenticazione e uso improprio delle funzioni crittografiche. I risultati sono classificati per gravità e tipologia, consentendo ai team di sicurezza di valutare il rischio in modo strutturato e coerente.

L'enfasi sulla correttezza della sicurezza differenzia Fortify dagli strumenti di analisi statica generici. La profondità dell'analisi è orientata all'identificazione di condizioni potenzialmente sfruttabili, piuttosto che a problemi di manutenibilità o architettura. Questa specializzazione rende Fortify particolarmente adatto ad ambienti in cui il rilevamento delle vulnerabilità è prioritario rispetto alla comprensione più ampia del sistema.

Allineamento con i programmi di conformità e rischio aziendale

Fortify viene spesso integrato nei programmi di sicurezza e governance aziendali, dove il rischio software viene gestito insieme ad altri rischi operativi e normativi. Le sue funzionalità di reporting e generazione di prove supportano audit interni, valutazioni esterne e revisioni normative. I risultati possono essere aggregati tra applicazioni e unità aziendali, offrendo alla leadership in materia di sicurezza visibilità sull'esposizione al rischio su larga scala.

Questo allineamento con il formale Gestione del rischio informatico I processi rendono Fortify una scelta comune nelle organizzazioni che devono dimostrare un'efficacia di controllo continua. I report possono essere utilizzati per mostrare le tendenze delle vulnerabilità, i progressi nelle azioni di ripristino e la conformità alle policy di sicurezza interne, supportando un processo decisionale difendibile durante gli audit o le revisioni degli incidenti.

Copertura linguistica e caratteristiche di distribuzione

Fortify Static Code Analyzer supporta un'ampia gamma di linguaggi di programmazione comunemente presenti negli ambienti aziendali, inclusi sia stack applicativi moderni che tecnologie legacy selezionate. Ciò consente alle organizzazioni di applicare un approccio di analisi della sicurezza coerente a diversi team di sviluppo e domini tecnologici. I modelli di distribuzione variano, con Fortify spesso installato on-premise o in ambienti aziendali controllati per soddisfare i requisiti di residenza e sicurezza dei dati.

Tuttavia, l'analisi viene generalmente eseguita a livello di applicazione o di progetto. Sebbene Fortify possa essere scalabile su molte applicazioni, non tenta di risolvere l'ordine di esecuzione, l'orchestrazione batch o i flussi di dati tra applicazioni. Di conseguenza, la sua prospettiva sul rischio rimane localizzata agli artefatti del codice piuttosto che al comportamento a livello di sistema.

Integrazione nei cicli di vita di sviluppo sicuri

Fortify è in genere integrato nei cicli di sviluppo sicuri come meccanismo di controllo piuttosto che come strumento di esplorazione continua. Le scansioni possono essere attivate in fasi definite, come revisioni pre-release, finestre di modifica importanti o checkpoint di conformità. Questo modello operativo è in linea con le organizzazioni che privilegiano processi di rilascio controllato e approvazioni formali rispetto al deployment continuo.

Sebbene siano disponibili integrazioni con strumenti CI/CD, i modelli di utilizzo di Fortify riflettono spesso un equilibrio tra automazione e supervisione centralizzata. I risultati in termini di sicurezza vengono esaminati da team specializzati che valutano i requisiti di ripristino e le decisioni di accettazione del rischio, rafforzando la coerenza della governance in tutta l'azienda.

Casi d'uso e vincoli tipici delle aziende

Fortify Static Code Analyzer è particolarmente efficace nelle aziende in cui la garanzia della sicurezza, la preparazione agli audit e la conformità normativa sono fattori determinanti. Fornisce un approccio strutturato e difendibile per identificare le vulnerabilità di sicurezza a livello di codice e dimostrare che sono in atto controlli per rilevarle e risolverle.

I suoi limiti diventano evidenti in scenari che richiedono la comprensione del modo in cui le vulnerabilità interagiscono con il comportamento di esecuzione, l'elaborazione batch o le dipendenze multipiattaforma. Fortify non modella il comportamento runtime o l'impatto a livello di sistema, ed è spesso integrato da strumenti che forniscono una visione più approfondita della struttura dell'applicazione, delle catene di dipendenza e del rischio di modernizzazione in ambienti eterogenei.

CAST in evidenza

CAST Highlight è una piattaforma di enterprise application intelligence e di valutazione del portfolio progettata per fornire una visibilità di alto livello sulla qualità del software, sul rischio e sulla prontezza alla modernizzazione in grandi patrimoni applicativi. Il suo ruolo principale negli ambienti aziendali è supportare il processo decisionale strategico riassumendo le caratteristiche strutturali, gli indicatori di debito tecnico e i segnali di idoneità del cloud, anziché eseguire un'analisi approfondita del codice orientata all'esecuzione. CAST Highlight viene spesso adottato nelle fasi iniziali dei programmi di modernizzazione per stabilire una comprensione di base dello stato di salute del portfolio.

A differenza degli strumenti di analisi statica incentrati sugli sviluppatori, CAST Highlight opera a livello aggregato. È pensato per aiutare architetti, gestori di portafoglio e responsabili della trasformazione a confrontare le applicazioni, identificare i candidati per la modernizzazione e stabilire le priorità per gli interventi di ripristino su centinaia o migliaia di sistemi.

Analisi a livello di portafoglio e intelligence del software

Il cuore di CAST Highlight è un motore di analisi leggero che estrae metadati strutturali dal codice sorgente dell'applicazione e dagli artefatti di configurazione. Questi dati vengono normalizzati in un modello analitico comune che consente di valutare diverse applicazioni utilizzando criteri coerenti. Le metriche relative alla qualità del codice, alla manutenibilità, all'esposizione alla sicurezza e all'idoneità architetturale vengono calcolate e presentate attraverso dashboard e viste comparative.

Queste capacità si allineano con un contesto più ampio intelligenza del software iniziative, il cui obiettivo è trasformare gli artefatti di codice grezzo in informazioni pronte per le decisioni per stakeholder non sviluppatori. Astraendo la complessità in indicatori standardizzati, CAST Highlight consente ai team di leadership di ragionare su ampi portafogli senza dover impegnarsi in un'ispezione dettagliata del codice.

Valutazione della prontezza alla modernizzazione e dell'idoneità al cloud

CAST Highlight pone particolare enfasi sulla valutazione delle applicazioni per la modernizzazione e la prontezza alla migrazione al cloud. Valuta fattori come l'utilizzo del framework, i modelli di dipendenza e l'attualità della tecnologia per stimare lo sforzo e il rischio associati allo spostamento delle applicazioni su piattaforme moderne. I risultati vengono spesso utilizzati per raggruppare le applicazioni in categorie come rehosting, refactoring, sostituzione o ritiro.

Questo approccio basato sulla valutazione supporta le attività di pianificazione e budgeting nelle fasi iniziali. Le aziende possono utilizzare i risultati di CAST Highlight per creare roadmap di modernizzazione, stimare l'ambito della trasformazione e comunicare i profili di rischio agli stakeholder aziendali. Tuttavia, l'analisi è volutamente ampia e non tenta di modellare dettagliatamente il comportamento di esecuzione o gli effetti collaterali della trasformazione.

Indicatori di sicurezza e debito tecnico

Oltre ai segnali di modernizzazione, CAST Highlight fornisce indicatori di alto livello relativi alle debolezze di sicurezza e al debito tecnico. Questi indicatori derivano da modelli noti associati a maggiori costi di manutenzione o a una maggiore esposizione alle vulnerabilità. L'intento non è quello di sostituire strumenti di scansione di sicurezza dedicati, ma di evidenziare aree in cui potrebbe essere necessaria un'indagine più approfondita.

Poiché i risultati sono aggregati, sono più adatti all'analisi comparativa piuttosto che alla pianificazione delle azioni correttive. Gli indicatori di sicurezza e di debito aiutano le organizzazioni a comprendere la distribuzione del rischio relativo tra i portafogli, ma non identificano percorsi di esecuzione, flussi di dati o dipendenze operative specifici che potrebbero essere interessati dalle modifiche al codice.

Scalabilità e modello operativo

CAST Highlight è progettato per scalare in modo efficiente su portafogli applicativi molto ampi. Il suo approccio di analisi leggero riduce al minimo il sovraccarico di elaborazione e consente un rapido onboarding di nuove applicazioni. Questo lo rende particolarmente adatto alle aziende che conducono ampie analisi del proprio panorama software durante fusioni, cessioni o iniziative di modernizzazione precoce.

Il compromesso per questa scalabilità è la profondità analitica. CAST Highlight non risolve i grafici delle chiamate, le catene di esecuzione batch o la propagazione dei dati multipiattaforma. Di conseguenza, viene spesso utilizzato in combinazione con strumenti di analisi più approfonditi quando specifiche applicazioni o iniziative di trasformazione passano dalla pianificazione all'esecuzione.

Casi d'uso e vincoli tipici delle aziende

CAST Highlight è particolarmente efficace nelle aziende che necessitano di una visione comparativa di alto livello dei portafogli applicativi a supporto della pianificazione strategica. È particolarmente indicato per identificare i candidati alla modernizzazione, stimare la complessità della trasformazione e comunicare il rischio tecnico agli stakeholder non tecnici.

I suoi limiti diventano evidenti quando le organizzazioni necessitano di una comprensione precisa di come i cambiamenti influenzino il comportamento di esecuzione, le catene di dipendenza o la stabilità operativa. CAST Highlight non fornisce le informazioni a livello di esecuzione necessarie per implementare in modo sicuro attività di refactoring o modernizzazione, ed è in genere integrato da strumenti che si concentrano su un'analisi dettagliata dell'impatto e sulla visibilità comportamentale all'interno di applicazioni selezionate.

Immagini CAST

CAST Imaging è una piattaforma di enterprise application intelligence focalizzata sull'analisi architetturale e sulla visualizzazione delle dipendenze strutturali in sistemi software complessi. Il suo ruolo principale all'interno di grandi organizzazioni è quello di mostrare come vengono assemblate le applicazioni, come interagiscono i componenti e dove l'accoppiamento strutturale introduce rischi. CAST Imaging è in genere utilizzato da architetti e team di modernizzazione che necessitano di una comprensione a livello di sistema della struttura delle applicazioni prima di pianificare iniziative di refactoring, migrazione o decomposizione.

Invece di operare come uno strumento di ispezione del codice o di scansione di sicurezza, CAST Imaging enfatizza la comprensione dell'architettura. Trasforma il codice sorgente e gli artefatti di configurazione in modelli navigabili che illustrano le relazioni tra componenti, livelli e tecnologie, consentendo alle parti interessate di ragionare sulla complessità su larga scala.

Mappatura architettonica e visualizzazione delle dipendenze

Il fulcro di CAST Imaging è la sua capacità di generare rappresentazioni architetturali dettagliate di applicazioni e portfolio di applicazioni. Queste rappresentazioni includono diagrammi dei componenti, mappe di interazione e viste a strati che mostrano come i moduli comunicano e dipendono l'uno dall'altro. Visualizzando le relazioni strutturali, CAST Imaging consente ai team di identificare accoppiamenti stretti, dipendenze circolari e violazioni architetturali difficili da rilevare tramite analisi a livello di file.

Questi modelli visivi si allineano strettamente con le pratiche incentrate su grafici di dipendenza, dove la comprensione delle interconnessioni strutturali è essenziale per la gestione del rischio nei sistemi di grandi dimensioni. CAST Imaging consente agli utenti di attraversare le dipendenze in modo interattivo, passando da viste architetturali di alto livello a rappresentazioni più granulari, a seconda delle necessità.

Copertura multitecnologica e multiapplicazione

CAST Imaging supporta l'analisi su un'ampia gamma di linguaggi di programmazione, framework e piattaforme comunemente presenti negli ambienti aziendali. Questa ampiezza consente di modellare sistemi eterogenei composti da componenti legacy, servizi distribuiti e database condivisi. Le funzionalità di analisi inter-applicazione consentono ai team di comprendere come i singoli sistemi si inseriscono in portafogli più ampi e come le modifiche in un'applicazione possano influenzare le altre.

Tuttavia, l'analisi rimane strutturale piuttosto che comportamentale. CAST Imaging modella relazioni statiche tra i componenti, ma non simula l'ordine di esecuzione, le condizioni di runtime o la logica di schedulazione batch. Di conseguenza, fornisce chiarezza su come i sistemi sono connessi, ma non necessariamente su come si comportano durante l'esecuzione.

Supporto per la modernizzazione e la governance architettonica

CAST Imaging viene spesso utilizzato per supportare iniziative di modernizzazione in cui la chiarezza architettonica è un prerequisito per il cambiamento. Evidenziando le violazioni dei principi architetturali e identificando le aree di eccessivo accoppiamento, aiuta i team a pianificare strategie di trasformazione incrementale. Queste informazioni possono orientare le decisioni sull'estrazione dei servizi, la riprogettazione dell'interfaccia o gli approcci di migrazione graduale.

In contesti di governance, CAST Imaging può essere utilizzato anche per valutare la conformità architettonica rispetto agli standard definiti. È possibile identificare e documentare eventuali deviazioni dalle architetture target, supportando la supervisione e la pianificazione delle azioni correttive. Questo lo rende prezioso nelle organizzazioni che applicano controlli architetturali come parte dei loro processi di change management.

Considerazioni sulla scalabilità e sulla modellazione del portafoglio

La piattaforma è progettata per essere scalabile su applicazioni e portafogli di grandi dimensioni, generando modelli architetturali condivisibili tra le parti interessate. Il suo approccio incentrato sulla visualizzazione supporta l'analisi e la comunicazione collaborative, in particolare quando si spiegano strutture complesse a un pubblico non specializzato in sviluppo.

Il compromesso per questa scalabilità è una visione limitata delle dinamiche operative. CAST Imaging non risolve la discendenza dei dati a livello di campo, non traccia i flussi di esecuzione batch né quantifica l'impatto delle modifiche in fase di esecuzione. Per le iniziative che richiedono una definizione precisa dell'impatto delle modifiche o la convalida del comportamento di esecuzione, sono in genere necessari strumenti di analisi aggiuntivi.

Casi d'uso e vincoli tipici delle aziende

CAST Imaging è particolarmente efficace nelle aziende che necessitano di comprendere e razionalizzare l'architettura applicativa prima di intraprendere cambiamenti significativi. È particolarmente indicato per rivelare la complessità strutturale, guidare il refactoring architettonico e supportare la pianificazione della modernizzazione in sistemi eterogenei.

I suoi limiti diventano evidenti quando le organizzazioni necessitano di insight a livello di esecuzione, valutazione dell'impatto o convalida di come le modifiche si propagano attraverso il comportamento runtime. CAST Imaging fornisce una mappa strutturale piuttosto che un modello operativo, ed è spesso integrato da strumenti che offrono un'analisi più approfondita dei percorsi di esecuzione, del flusso di dati e del comportamento del sistema.

Analisi statica Veracode

Veracode Static Analysis è una piattaforma cloud-native per il testing statico della sicurezza delle applicazioni, progettata per integrare i controlli di sicurezza direttamente nei moderni processi di distribuzione del software. Il suo ruolo principale negli ambienti aziendali è identificare tempestivamente e costantemente le vulnerabilità di sicurezza in grandi volumi di codice applicativo, in particolare nelle organizzazioni che danno priorità a cicli di rilascio rapidi, team di sviluppo distribuiti e supervisione centralizzata della sicurezza. Veracode è comunemente adottato laddove la garanzia della sicurezza deve essere scalabile senza introdurre attriti nella velocità di sviluppo.

La piattaforma enfatizza l'automazione e la coerenza, posizionando l'analisi statica come un controllo di sicurezza costante piuttosto che un'attività di revisione periodica. Questo modello operativo è in linea con le aziende che hanno standardizzato gli strumenti di sviluppo basati sul cloud e necessitano di una visibilità centralizzata sulla sicurezza delle applicazioni in diversi team e progetti.

Test di sicurezza delle applicazioni statiche cloud-native

Il cuore di Veracode Static Analysis è un motore di scansione statica della sicurezza, fornito interamente come servizio cloud gestito. Il codice sorgente e i binari vengono caricati per l'analisi, dove vengono ispezionati per individuare vulnerabilità come difetti di iniezione, gestione non sicura dei dati e debolezze di autenticazione. L'analisi non richiede l'accesso agli ambienti di produzione, consentendo di eseguire valutazioni di sicurezza nelle prime fasi del ciclo di vita senza rischi operativi.

Questo approccio cloud-native consente un rapido onboarding e una scalabilità elastica su portafogli di grandi dimensioni. Le aziende possono applicare policy di scansione di sicurezza coerenti su centinaia di applicazioni senza dover gestire un'infrastruttura on-premise. I risultati vengono normalizzati e presentati tramite dashboard centralizzate, supportando i team di sicurezza responsabili della supervisione dei rischi a livello aziendale.

Integrazione in pipeline di distribuzione continua

Veracode è progettato per integrarsi strettamente con le pipeline CI/CD e gli strumenti di sviluppo. Le scansioni possono essere attivate automaticamente durante le fasi di build o rilascio e i risultati vengono restituiti in formati che si integrano con i flussi di lavoro di tracciamento e correzione dei problemi. Questo supporta un modello di sicurezza "shift-left" in cui le vulnerabilità vengono affrontate più vicino al punto di introduzione.

In pratica, il ruolo di Veracode all'interno delle pipeline è spesso coordinato con controlli di qualità e test più ampi, tra cui attività come test di regressione delle prestazioni, per garantire che l'applicazione delle misure di sicurezza non avvenga in modo isolato rispetto ad altri requisiti non funzionali. Questo allineamento aiuta le organizzazioni a bilanciare il rigore della sicurezza con le prestazioni di distribuzione.

Copertura linguistica e coerenza del portfolio

L'analisi statica di Veracode supporta un'ampia gamma di linguaggi di programmazione e framework moderni comunemente utilizzati nello sviluppo di applicazioni aziendali. Questa ampiezza consente ai team di sicurezza di applicare policy di scansione uniformi su stack di sviluppo eterogenei, riducendo le lacune che altrimenti potrebbero emergere tra team o piattaforme.

Tuttavia, l'attenzione della piattaforma rimane focalizzata sulla scansione della sicurezza a livello applicativo. L'analisi è in genere limitata a singole applicazioni o servizi e le relazioni tra applicazioni, flussi di lavoro batch o strutture dati condivise non vengono modellate. Di conseguenza, Veracode offre una copertura completa delle vulnerabilità a livello di codice, ma una visione limitata di come tali vulnerabilità potrebbero propagarsi tra sistemi interconnessi.

Segnalazione dei rischi e visibilità della governance

Veracode offre funzionalità di reporting che consentono ai responsabili della sicurezza di monitorare l'andamento delle vulnerabilità, i progressi nelle azioni di ripristino e la conformità alle policy aziendali. Le dashboard supportano visualizzazioni a livello di portfolio dell'esposizione al rischio, consentendo una definizione delle priorità in base alla gravità e all'impatto aziendale. Questi report vengono spesso utilizzati a supporto della governance della sicurezza interna, del reporting esecutivo e delle attività di assurance di terze parti.

Sebbene queste funzionalità supportino la responsabilità e la supervisione, l'attenzione al reporting rimane incentrata sulla vulnerabilità. Veracode non tenta di quantificare l'impatto operativo, l'interruzione del flusso di esecuzione o il rischio di modernizzazione associato agli sforzi di ripristino. Questa distinzione è importante negli ambienti in cui le modifiche alla sicurezza devono essere valutate insieme a considerazioni di stabilità e gestione delle modifiche.

Casi d'uso e vincoli tipici delle aziende

L'analisi statica di Veracode è particolarmente efficace nelle aziende che operano ad alta velocità di distribuzione e richiedono una scansione di sicurezza scalabile e centralizzata su stack applicativi moderni. Eccelle nell'applicazione di standard di sicurezza coerenti, nella riduzione dei tempi di rilevamento delle vulnerabilità e nel supporto dei modelli operativi DevSecOps.

I suoi limiti diventano evidenti in scenari che richiedono una profonda comprensione del comportamento del sistema, delle dipendenze tra applicazioni o dell'elaborazione batch legacy. Veracode non fornisce informazioni a livello di esecuzione o mappatura delle dipendenze architetturali, e viene in genere posizionato come un livello di sicurezza specializzato, integrato da strumenti incentrati sull'analisi dell'impatto, sulla visibilità delle dipendenze e sulla comprensione del sistema su scala aziendale.

Coverity (Sinossi)

Coverity è una piattaforma di analisi statica del codice aziendale riconosciuta per la sua capacità di rilevare difetti complessi in basi di codice di grandi dimensioni e critiche per le prestazioni. Il suo ruolo principale negli ambienti aziendali è identificare problemi di correttezza e affidabilità complessi, difficili da individuare solo tramite test, in particolare nei sistemi in cui un guasto comporta significative conseguenze operative, di sicurezza o finanziarie. Coverity è frequentemente adottata in settori come quello automobilistico, aerospaziale, delle telecomunicazioni e del software per infrastrutture, dove la precisione dei difetti e bassi tassi di falsi positivi sono essenziali.

A differenza delle piattaforme di analisi a livello di portafoglio, Coverity si concentra sulla correttezza a livello di codice su basi di codice estese. È progettato per analizzare grandi volumi di codice sorgente in modo efficiente, mantenendo al contempo un elevato livello di rigore analitico, rendendolo adatto alle organizzazioni che gestiscono sistemi di lunga durata con rigorosi requisiti di affidabilità.

Rilevamento approfondito dei difetti e analisi di precisione

Il cuore di Coverity è un motore di analisi statica ottimizzato per rilevare difetti come corruzione della memoria, perdite di risorse, problemi di concorrenza ed errori logici. Il motore è noto per la sua capacità di elaborare percorsi di controllo complessi e scenari di esecuzione che abbracciano più funzioni e moduli. Questa profondità di analisi gli consente di identificare difetti che potrebbero manifestarsi solo in specifiche condizioni di runtime.

L'approccio analitico di Coverity incorpora tecniche avanzate relative a esecuzione simbolica, consentendogli di esplorare più percorsi di esecuzione senza dover eseguire il codice. Questa capacità contribuisce alla sua reputazione di elevata accuratezza e aiuta a ridurre il rumore spesso associato alle analisi statiche su larga scala negli ambienti aziendali.

Focus sulla lingua e copertura mirata

Coverity offre un solido supporto per i linguaggi comunemente utilizzati nel software a livello di sistema e sensibile alle prestazioni, tra cui C, C++ e Java. Questa attenzione lo rende particolarmente efficace per l'analisi di componenti infrastrutturali core, sistemi embedded e servizi backend, in cui difetti di basso livello possono avere un impatto notevole.

Sebbene la piattaforma possa scalare su ampie basi di codice, la sua copertura linguistica è più limitata rispetto ad alcuni strumenti di analisi statica generici. È meno orientata verso ambienti aziendali eterogenei che includono linguaggi di elaborazione batch, ambienti di scripting o tecnologie specifiche per mainframe. Di conseguenza, Coverity viene spesso implementato in modo selettivo all'interno dei portfolio, concentrandosi su componenti in cui la precisione dei difetti è più critica.

Integrazione nei flussi di lavoro di sviluppo aziendale

Coverity è progettato per integrarsi nei processi di sviluppo aziendale, inclusi pipeline CI/CD e sistemi centralizzati di gestione dei difetti. Le scansioni possono essere pianificate o attivate automaticamente e i risultati vengono inoltrati ai team di sviluppo per la correzione. La piattaforma supporta l'analisi incrementale, consentendo ai team di concentrarsi sui nuovi problemi introdotti, mantenendo al contempo la visibilità sui backlog dei difetti esistenti.

In molte organizzazioni, Coverity è considerato uno strumento di controllo della qualità piuttosto che uno strumento di esplorazione continua. Le sue scansioni vengono spesso eseguite in momenti specifici, ad esempio prima di release importanti o durante revisioni di qualità formali. Questo modello di utilizzo riflette il suo ruolo nell'applicazione di standard di affidabilità piuttosto che nel supportare iterazioni rapide.

Scalabilità e caratteristiche prestazionali

Coverity è progettato per gestire in modo efficiente basi di codice molto estese, rendendolo adatto alle aziende con milioni di righe di codice critico. Le sue prestazioni si adattano all'infrastruttura disponibile, consentendo alle organizzazioni di analizzare sistemi di grandi dimensioni senza tempi di analisi proibitivi. Le dashboard centralizzate offrono visibilità sulle tendenze dei difetti e sui progressi delle azioni di correzione nei vari progetti.

Tuttavia, la scalabilità di Coverity si concentra sul volume del codice piuttosto che sulla complessità del sistema. Non tenta di modellare le dipendenze tra applicazioni, l'ordine di esecuzione dei batch o la discendenza dei dati tra piattaforme. Le sue analisi rimangono incentrate sul rilevamento dei difetti all'interno delle singole basi di codice piuttosto che sul comportamento a livello di sistema.

Casi d'uso e vincoli tipici delle aziende

Coverity è particolarmente efficace nelle aziende che richiedono un rilevamento dei difetti ad alta affidabilità nei componenti software critici. È particolarmente efficace nell'identificare problemi sottili che potrebbero causare crash, vulnerabilità di sicurezza o comportamenti imprevedibili in produzione, in particolare nel codice di basso livello o sensibile alle prestazioni.

I suoi limiti diventano evidenti nelle iniziative di modernizzazione o trasformazione che richiedono la comprensione dell'impatto dei cambiamenti sui sistemi interconnessi. Coverity non fornisce la mappatura delle dipendenze architetturali o l'analisi dell'impatto a livello di esecuzione, ed è in genere integrato da strumenti incentrati sulla visibilità del portfolio, sull'analisi delle dipendenze e sulla comprensione del comportamento in ambienti aziendali eterogenei.

Parasoft C/C++test e DTP

Parasoft C/C++test e la relativa Development Testing Platform (DTP) costituiscono una soluzione di analisi statica e test di conformità di livello enterprise, pensata appositamente per ambienti software critici per la sicurezza e altamente regolamentati. Il suo ruolo principale all'interno delle grandi organizzazioni è supportare una rigorosa verifica del codice a livello di sistema, laddove eventuali difetti possano causare guasti operativi, non conformità normativa o incidenti di sicurezza. Parasoft è comunemente adottato in settori come l'aerospaziale, l'automotive, la difesa e i sistemi industriali, dove il comportamento del software deve essere dimostrabilmente corretto e verificabile.

A differenza degli strumenti di analisi statica generici, Parasoft pone l'accento sulla conformità a standard definiti e obiettivi di verifica. La piattaforma è progettata per supportare ambienti in cui lo sviluppo è regolato da processi formali, requisiti di certificazione e casi di garanzia documentati, piuttosto che da iterazioni rapide.

Analisi statica basata sugli standard e applicazione della conformità

Il cuore di Parasoft C/C++test è un motore di analisi statica allineato agli standard di sicurezza e di codifica del settore, come MISRA, CERT e le linee guida ISO. Il motore valuta il codice sorgente in base a rigidi set di regole che definiscono costrutti accettabili, modelli di utilizzo e condizioni di errore. Le violazioni vengono classificate in base alla gravità e mappate direttamente ai requisiti di conformità, consentendo alle organizzazioni di dimostrare la conformità alle pratiche di sviluppo obbligatorie.

Questo approccio basato sugli standard si allinea con gli ambienti che si basano su verifica formale concetti, in cui la correttezza è definita non solo dal comportamento funzionale, ma anche dal rispetto delle regole prescritte. I risultati delle analisi di Parasoft possono essere utilizzati come prova nei processi di certificazione e audit, riducendo lo sforzo di verifica manuale.

Supporto linguistico mirato e analisi approfondita mirata

Parasoft C/C++test è specificamente ottimizzato per le basi di codice C e C++, offrendo funzionalità di analisi approfondita per i linguaggi comunemente utilizzati nel software embedded e di sistema. Questa specializzazione consente alla piattaforma di identificare problemi di basso livello, come l'uso improprio della memoria, errori di puntatore e difetti di concorrenza, che possono essere particolarmente pericolosi in contesti critici per la sicurezza.

Sebbene questa profondità sia preziosa all'interno del suo dominio di riferimento, limita anche l'applicabilità della piattaforma a contesti aziendali più ampi. Parasoft non mira a fornire un'ampia copertura su diversi linguaggi, ambienti di elaborazione batch o sistemi mainframe legacy. Di conseguenza, viene in genere implementata in segmenti mirati di un portafoglio aziendale piuttosto che come soluzione di analisi universale.

Integrazione con cicli di vita di sviluppo regolamentati

Parasoft è progettato per integrarsi in cicli di sviluppo strutturati che enfatizzano tracciabilità, documentazione e modifiche controllate. I risultati delle analisi statiche possono essere collegati a requisiti, casi di test e sistemi di tracciamento dei difetti tramite il componente DTP, consentendo una tracciabilità end-to-end, dalla specifica alla verifica.

Questa integrazione supporta modelli di sviluppo in cui le modifiche vengono introdotte deliberatamente e riviste formalmente. L'analisi viene spesso eseguita a scadenze definite, ad esempio prima dell'invio di certificazioni o di release principali, anziché in modo continuativo a ogni commit. Questo modello operativo riflette le priorità degli ambienti regolamentati, in cui prevedibilità e garanzia prevalgono sulla velocità.

Segnalazione, tracciabilità e prontezza all'audit

La piattaforma di testing e sviluppo fornisce report e analisi centralizzati per progetti e team. Le metriche relative allo stato di conformità, all'andamento dei difetti e alla copertura delle verifiche possono essere aggregate e riviste dagli stakeholder addetti al controllo qualità e alla conformità. I report sono strutturati per supportare le attività di audit e certificazione, fornendo prove documentate dell'esecuzione e dei risultati delle analisi.

Tuttavia, questi report si concentrano sulla conformità a livello di codice piuttosto che sul comportamento a livello di sistema. Parasoft non modella i percorsi di esecuzione tra applicazioni, l'orchestrazione batch o le dipendenze multipiattaforma. La sua tracciabilità è orientata ai requisiti e agli standard piuttosto che all'interazione runtime tra i componenti.

Casi d'uso e vincoli tipici delle aziende

Parasoft C/C++test e DTP sono particolarmente efficaci nelle aziende in cui sicurezza, affidabilità e conformità normativa sono questioni prioritarie. Forniscono un framework rigoroso per verificare che il codice critico sia conforme a standard rigorosi e possa superare la revisione formale.

I loro limiti diventano evidenti in ambienti che richiedono una comprensione olistica di sistemi di grandi dimensioni e interconnessi o il supporto di stack tecnologici eterogenei. Parasoft non è progettato per fornire visibilità a livello di portfolio o analisi di impatto orientate all'esecuzione, ed è spesso integrato da strumenti incentrati sulle dipendenze architetturali, sul rischio di modernizzazione e sul comportamento dei sistemi in contesti aziendali complessi.

Klock

Klocwork è una piattaforma di analisi statica del codice aziendale focalizzata sull'identificazione di difetti relativi a sicurezza, affidabilità e concorrenza in basi di codice ampie e complesse. Il suo ruolo principale negli ambienti aziendali è rilevare problemi che possono compromettere la stabilità o la sicurezza del sistema, in particolare nel software che opera in condizioni di carico elevato, esecuzione parallela o runtime vincolate. Klocwork è comunemente utilizzato in settori in cui prestazioni e correttezza sono strettamente correlate, tra cui telecomunicazioni, sistemi embedded, infrastrutture finanziarie e servizi backend su larga scala.

La piattaforma enfatizza il rilevamento precoce dei difetti attraverso l'analisi statica, consentendo alle organizzazioni di identificare modelli problematici prima che si manifestino come errori di runtime. Klocwork è in genere posizionato come uno strumento di garanzia della qualità e della sicurezza piuttosto che come una soluzione di analisi a livello di portafoglio.

Analisi statica orientata alla concorrenza e all'affidabilità

Il cuore di Klocwork è un motore di analisi statica progettato per identificare i difetti derivanti da scenari di esecuzione complessi. Tra questi rientrano problemi relativi alla gestione della memoria, alla gestione delle risorse e alla sincronizzazione. Il motore è particolarmente efficace nel rilevare i difetti associati all'esecuzione parallela, in cui sottili interazioni tra thread possono portare a comportamenti imprevedibili.

La sua capacità di ragionare sui percorsi di codice concorrenti rende Klocwork rilevante in ambienti in cui il software deve funzionare in modo affidabile sotto carico. I risultati delle analisi includono spesso risultati relativi a deadlock, condizioni di gara e costrutti di sincronizzazione non corretti. Queste funzionalità supportano le organizzazioni che cercano di ridurre l'instabilità causata da difetti di concorrenza difficili da riprodurre, come condizioni di gara.

Domini sensibili al focus linguistico e alle prestazioni

Klocwork offre un solido supporto per i linguaggi comunemente utilizzati nel software a livello di sistema e critico per le prestazioni, tra cui C, C++ e Java. Questa attenzione è in linea con la sua adozione in domini in cui la correttezza a basso livello e l'efficienza in fase di esecuzione sono essenziali. Concentrandosi su un insieme più ristretto di linguaggi, la piattaforma offre analisi più approfondite per tali ambienti rispetto a strumenti più ampi e generalizzati.

Tuttavia, questa specializzazione ne limita anche l'applicabilità in ambienti aziendali eterogenei. Klocwork non è progettato per analizzare carichi di lavoro batch-oriented, linguaggi mainframe o ambienti di scripting di alto livello, comuni nei sistemi aziendali di lunga durata. Di conseguenza, viene spesso implementato in modo selettivo anziché come soluzione di analisi universale.

Integrazione nei flussi di lavoro di qualità e sicurezza aziendale

Klocwork si integra con i flussi di lavoro di sviluppo aziendale, inclusi pipeline CI/CD e sistemi di tracciamento dei difetti. Le scansioni possono essere automatizzate e i risultati inviati ai team di sviluppo per la correzione. La piattaforma supporta l'analisi incrementale, consentendo ai team di concentrarsi sui nuovi problemi introdotti, mantenendo al contempo la visibilità sui difetti esistenti.

In molte organizzazioni, Klocwork viene utilizzato come parte di processi formali di garanzia della qualità. L'analisi può essere attivata in fasi chiave, come la convalida pre-release o importanti attività di refactoring. Questo modello di utilizzo riflette il suo ruolo nel garantire affidabilità e sicurezza, piuttosto che nel supportare l'esplorazione continua dell'architettura.

Caratteristiche di scalabilità e ambito operativo

Klocwork è progettato per scalare su ampie basi di codice, consentendo l'analisi di sistemi complessi senza eccessivi sovraccarichi di prestazioni. Le dashboard centralizzate offrono visibilità sulle tendenze dei difetti e sui progressi delle azioni correttive nei vari progetti. Queste visualizzazioni supportano la supervisione del management e aiutano i team a stabilire le priorità delle azioni correttive in base alla gravità e all'impatto.

Nonostante la sua scalabilità in termini di volume di codice, l'ambito analitico di Klocwork rimane localizzato su singole applicazioni o componenti. Non modella le dipendenze tra applicazioni, l'ordine di esecuzione batch o la discendenza dei dati tra piattaforme. Le sue analisi si concentrano sulla correttezza del codice piuttosto che sul comportamento a livello di sistema.

Casi d'uso e vincoli tipici delle aziende

Klocwork è particolarmente efficace nelle aziende che richiedono un rilevamento altamente affidabile di difetti di concorrenza e affidabilità in software sensibili alle prestazioni. È particolarmente indicato per individuare problemi difficili da riprodurre tramite test e che possono causare guasti intermittenti o catastrofici negli ambienti di produzione.

I suoi limiti diventano evidenti nelle iniziative di trasformazione che richiedono una comprensione olistica dei portafogli applicativi, dei flussi di esecuzione o dell'impatto della modernizzazione. Klocwork non fornisce la mappatura delle dipendenze architetturali o l'analisi dell'impatto a livello di esecuzione, ed è in genere integrato da strumenti che si concentrano su una più ampia comprensione del sistema e sulla valutazione del rischio di cambiamento in ambienti aziendali eterogenei.

Analisi statica del cloud DevOps di OpenText

OpenText DevOps Cloud Static Analysis è una funzionalità di analisi statica aziendale fornita come parte di una suite più ampia di DevOps e gestione del ciclo di vita delle applicazioni. Il suo ruolo principale all'interno delle grandi organizzazioni è fornire controlli standardizzati di qualità e sicurezza del codice, in linea con i modelli di governance della distribuzione consolidati. Anziché operare come piattaforma di analisi approfondita autonoma, viene in genere adottata dalle aziende che danno priorità al consolidamento della toolchain e alla supervisione centralizzata dei processi di sviluppo, test e rilascio.

La piattaforma è più comunemente utilizzata in ambienti in cui la distribuzione del software deve rispettare controlli formali e in cui l'integrazione con gli strumenti di ALM, testing e release management esistenti è un requisito fondamentale. Il suo valore risiede nella coerenza e nell'allineamento della governance, piuttosto che in un'analisi approfondita del comportamento o dell'architettura.

Capacità di analisi statica orientate alla suite

Fondamentalmente, OpenText DevOps Cloud Static Analysis fornisce un'ispezione basata su regole del codice sorgente per identificare problemi di qualità e debolezze di sicurezza. L'analisi si concentra su categorie di difetti comuni, violazioni degli standard di codifica e modelli di vulnerabilità che possono essere rilevati senza eseguire l'applicazione. I risultati vengono normalizzati e presentati tramite dashboard centralizzate insieme ad altre metriche DevOps.

Questo approccio orientato alla suite supporta le organizzazioni che desiderano che l'analisi statica funzioni come componente di un framework di controllo della distribuzione più ampio. Integrando l'analisi in una piattaforma integrata, le aziende possono applicare standard di base a tutti i team senza dover introdurre strumenti aggiuntivi in ambienti già complessi.

Integrazione con Enterprise Delivery Governance

Le funzionalità di analisi statica di OpenText sono strettamente integrate con funzioni di gestione del ciclo di vita più ampie, come il monitoraggio dei requisiti, i test e l'orchestrazione delle release. Questa integrazione consente di collegare i risultati dell'analisi a work item, difetti e approvazioni, supportando la tracciabilità lungo tutto il processo di distribuzione. Per le organizzazioni con modelli di governance formali, questo allineamento semplifica la supervisione e il reporting.

La piattaforma è spesso posizionata per supportare progetti strutturati cambio gestione processi, in cui le modifiche al software devono superare fasi definite di revisione e approvazione. I risultati dell'analisi statica diventano parte delle prove utilizzate per valutare la prontezza al rilascio, piuttosto che una fonte autonoma di informazioni tecniche.

Copertura linguistica e focus sulla standardizzazione

OpenText DevOps Cloud Static Analysis supporta una vasta gamma di linguaggi di programmazione aziendale di uso comune, consentendo l'applicazione coerente degli standard di codifica tra diversi team di sviluppo. Il supporto linguistico è orientato agli stack di sviluppo applicativi tradizionali, piuttosto che ad ambienti di nicchia o legacy.

Sebbene questa ampiezza supporti la standardizzazione, la profondità di analisi rimane relativamente ridotta rispetto a strumenti specializzati. La piattaforma non tenta di modellare percorsi di esecuzione, risolvere la logica di orchestrazione batch o analizzare le dipendenze tra applicazioni. I suoi risultati sono più adatti all'identificazione di problemi localizzati all'interno di singole basi di codice.

Scalabilità e caratteristiche operative

Progettato per funzionare come parte di una suite cloud, OpenText DevOps Cloud Static Analysis è scalabile su più progetti e team con amministrazione centralizzata. Questo lo rende adatto alle aziende che cercano controlli uniformi per un ampio numero di sviluppatori. Le prestazioni si adattano all'infrastruttura cloud, riducendo la necessità di risorse on-premise dedicate.

Tuttavia, in questo contesto, la scalabilità si riferisce alla copertura organizzativa piuttosto che alla profondità analitica. La piattaforma offre un'ampia visibilità sui progetti, ma una visione limitata del comportamento dei sistemi in fase di esecuzione o di come le modifiche si propagano attraverso ambienti complessi e interconnessi.

Casi d'uso e vincoli tipici delle aziende

OpenText DevOps Cloud Static Analysis è particolarmente efficace nelle aziende che privilegiano la governance integrata della delivery e i controlli standardizzati rispetto all'esplorazione tecnica approfondita. Supporta ambienti in cui l'analisi statica è solo uno dei tanti punti di controllo all'interno di un processo di rilascio controllato, garantendo un'applicazione coerente dei requisiti di base di qualità e sicurezza.

I suoi limiti diventano evidenti in scenari che richiedono una comprensione dettagliata del comportamento di esecuzione, delle catene di dipendenza o dell'impatto della modernizzazione su sistemi eterogenei. La piattaforma non fornisce la visibilità comportamentale o la valutazione dell'impatto necessarie per eseguire in sicurezza iniziative di refactoring o modernizzazione su larga scala, ed è spesso integrata da strumenti specializzati nella comprensione dell'esecuzione e nell'analisi multipiattaforma.

Tabella di confronto basata sulle capacità delle soluzioni SCA

| Capacità | SMART TS XL | SonarQube Ent | Checkmarx Uno | Fortificare SCA | CAST in evidenza | Immagini CAST | VeraCode | copertura | Parasoft | Klock | OpenText |

|---|---|---|---|---|---|---|---|---|---|---|---|

| Scala del portafoglio aziendale | ✅ Eccellente | ◐ Moderato | ◐ Moderato | ◐ Moderato | ✅ Eccellente | ✅ Eccellente | ◐ Moderato | ◐ Moderato | ◐ Moderato | ◐ Moderato | ◐ Moderato |

| Multipiattaforma (Mainframe + Distribuito) | ✅ Pieno | No | No | ❌Limitato | ❌Limitato | ❌Limitato | No | No | No | No | ❌Limitato |

| Supporto per linguaggi legacy (COBOL, JCL, RPG) | ✅ Pieno | No | No | ❌Limitato | ❌Limitato | ❌Limitato | No | No | No | No | No |

| Analisi delle dipendenze tra sistemi | ✅ Pieno | No | No | No | ◐ Di alto livello | ◐ Strutturale | No | No | No | No | No |

| Visibilità del percorso di esecuzione (statica) | ✅ Pieno | No | No | No | No | No | No | ◐ Parziale | ◐ Parziale | ◐ Parziale | No |

| Analisi batch e del flusso di lavoro | ✅ Pieno | No | No | No | No | No | No | No | No | No | No |

| Analisi dell'impatto prima del cambiamento | ✅ Profondo | ◐ Poco profondo | ◐ Solo sicurezza | ◐ Solo sicurezza | ◐ Portafoglio | ◐ Strutturale | ◐ Solo sicurezza | ◐ A livello di codice | ◐ A livello di codice | ◐ A livello di codice | ◐ Governance |

| Rilevamento delle vulnerabilità di sicurezza (SAST) | ◐ Contestuale | ◐ Base | ✅ Forte | ✅ Forte | ◐ Indicativo | No | ✅ Forte | ◐ Limitato | ◐ Limitato | ◐ Limitato | ◐ Base |

| Approfondimenti su prestazioni e complessità | ✅ Profondo | ◐ Metriche | No | No | ◐ Aggregato | ◐ Strutturale | No | ◐ Basato sui difetti | ◐ Conformità | ◐ Basato sui difetti | No |

| Analisi della prontezza alla modernizzazione | ✅ Nativo | No | No | No | ✅ Primaria | ◐ Strutturale | No | No | No | No | No |

| Cerca in tutte le risorse | ✅ Avanzato | ◐ Solo repo | ◐ Solo repo | ◐ Solo repo | ◐ Metadati | ◐ Metadati | ◐ Solo repo | ◐ Solo repo | ◐ Solo repo | ◐ Solo repo | ◐ Solo repo |

| Integrazione CI / CD | ◐ Facoltativo | ✅ Forte | ✅ Forte | ◐ Moderato | No | No | ✅ Forte | ◐ Moderato | ◐ Moderato | ◐ Moderato | ✅ Nativo |

| Generazione di prove pronte per la revisione | ✅ Nativo | ◐ Limitato | ◐ Limitato | ✅ Forte | ◐ Aggregato | ◐ Strutturale | ◐ Limitato | ◐ Limitato | ✅ Forte | ◐ Limitato | ◐ Forte |

Altri strumenti di analisi del codice statico (applicabilità aziendale limitata)

- ESLint

- vantaggi: Applica gli standard di codifica in JavaScript e TypeScript con un rapido feedback degli sviluppatori.

- limitazioni: Funziona a livello di repository senza visibilità dell'impatto tra sistemi o aziende.

- PMD

- vantaggi: Rileva problemi comuni di qualità del codice in diversi linguaggi di programmazione.

- limitazioni: Analisi basata su regole non idonea per grandi patrimoni aziendali eterogenei.

- fiocco8

- vantaggi: Analisi statica leggera per l'applicazione della sintassi e dello stile Python.

- limitazioni: Non fornisce informazioni approfondite a livello architettonico o esecutivo.

- Bandito

- vantaggi: Identifica i problemi di sicurezza nel codice Python utilizzando l'analisi basata su pattern.

- limitazioni: Ambito ristretto e nessuna consapevolezza delle interazioni tra i sistemi aziendali.

- CodiceQL

- vantaggi: Analisi basata su query in grado di identificare modelli di vulnerabilità complessi.

- limitazioni: Richiede competenze specialistiche e non dispone di modelli di esecuzione aziendale.

- Segrep

- vantaggi: Corrispondenza di modelli rapida e personalizzabile per controlli di sicurezza e qualità.

- limitazioni: L'approccio basato sui modelli è privo di dipendenza e di contesto comportamentale.

- Codice Snyk

- vantaggi: Analisi statica intuitiva per gli sviluppatori, integrata nei flussi di lavoro cloud-native.

- limitazioni: Incentrato sulla sicurezza a livello applicativo piuttosto che sull'architettura aziendale.

- pylint

- vantaggi: Fornisce controlli dettagliati della qualità del codice per i progetti Python.

- limitazioni: Non progettato per analisi multiprogetto o multipiattaforma.

- Cppcheck

- vantaggi: Analisi statica open source per C e C++ con bassi tassi di falsi positivi.

- limitazioni: Supporto limitato per la scalabilità e la governance aziendale.

- Interf

- vantaggi: Rileva problemi di memoria e di concorrenza utilizzando tecniche di analisi avanzate.

- limitazioni: Supporto linguistico limitato e integrazione aziendale limitata.

- LG™

- vantaggi: Combina l'analisi statica con flussi di lavoro di revisione del codice basati su cloud.

- limitazioni: Incentrato sul repository con informazioni limitate a livello di sistema.

- Analizzatori FxCop

- vantaggi: Applica le linee guida di progettazione e codifica per le applicazioni .NET.

- limitazioni: Non risolve le dipendenze tra applicazioni.

- PHPCS

- vantaggi: Applica gli standard di codifica nei progetti PHP.

- limitazioni: Incentrato sullo stile con profondità analitica minima.

- Spot Bugs

- vantaggi: Identifica i modelli di bug più comuni nel bytecode Java.

- limitazioni: Rilevamento basato su pattern senza modellazione del percorso di esecuzione.

- frenatore

- vantaggi: Scansione di sicurezza specializzata per applicazioni Ruby on Rails.

- limitazioni: Specifico del framework e non adatto all'analisi a livello aziendale.

- Strumenti da riga di comando ReSharper

- vantaggi: Integra l'analisi statica nelle pipeline di build .NET.

- limitazioni: Concentrazione sulla produttività degli sviluppatori piuttosto che sulle informazioni aziendali.

- Deep Source

- vantaggi: Revisione automatica del codice e analisi della qualità per repository moderni.

- limitazioni: Incentrato su SaaS con profondità di analisi strutturale limitata.

- Codacy

- vantaggi: Reporting centralizzato sulla qualità su più repository.

- limitazioni: Focalizzato sull'aggregazione senza una profonda comprensione del sistema.

- Sollevamento Sonatype

- vantaggi: Scansione di sicurezza e qualità integrata nei flussi di lavoro DevOps.

- limitazioni: Visibilità limitata sul comportamento in fase di esecuzione e sui sistemi legacy.

- NDend

- vantaggi: Fornisce analisi delle dipendenze per le applicazioni .NET.

- limitazioni: Specifico della tecnologia e non adatto a patrimoni eterogenei.

- Scansione Coverity (Open Source)