A verificação formal tornou-se uma capacidade essencial para organizações responsáveis pela operação de sistemas críticos para a segurança e dependentes da missão. Iniciativas de modernização em plataformas de aviação, compensação financeira, controle industrial e setor público dependem cada vez mais de validação matematicamente rigorosa para garantir que os componentes críticos se comportem de maneira previsível em todas as condições operacionais. Técnicas de raciocínio estático, como as descritas no artigo sobre métodos de rastreamento lógicoAgora, as verificações formais complementam as provas formais, expondo comportamentos estruturais que as especificações devem refletir com precisão. À medida que a complexidade do sistema aumenta, a verificação formal emerge como um instrumento estratégico para garantir a correção antes da implementação.

Componentes críticos raramente operam isoladamente, e as equipes de verificação devem levar em conta interações assíncronas, caminhos de código heterogêneos e subsistemas legados integrados a arquiteturas distribuídas modernas. Muitos desses sistemas contêm fluxos de controle complexos que não são visíveis sem análises avançadas, semelhantes ao entendimento apresentado no artigo sobre caminhos de código ocultosEssas informações tornam-se insumos essenciais para modelos formais precisos, permitindo que as equipes de verificação capturem invariantes, restrições temporais e suposições de interface que regem o comportamento entre componentes. Esse alinhamento forma a base para provas precisas em múltiplas plataformas e ambientes de execução.

Garantir a correção formal

O Smart TS XL transforma grandes bases de código em modelos prontos para verificação, reduzindo o risco durante todo o processo de modernização.

Explore agoraOs marcos regulatórios exercem pressão adicional sobre as organizações para que demonstrem a correção por meio de evidências determinísticas, em vez de testes probabilísticos ou cobertura comportamental incompleta. Os órgãos de certificação nos setores de aviação, energia, medicina e finanças esperam cada vez mais artefatos de verificação que correspondam diretamente à intenção arquitetônica e às restrições documentadas do sistema. Orientações semelhantes às expectativas descritas em Conformidade com SOX e DORA Ilustra a tendência em direção a um raciocínio estruturado e auditável. A verificação formal torna-se, portanto, tanto uma disciplina de engenharia quanto um facilitador de conformidade para programas de modernização que operam sob rigorosa supervisão regulatória.

Empresas que migram de arquiteturas legadas fortemente acopladas para ecossistemas de nuvem distribuídos ou designs orientados a serviços enfrentam uma complexidade crescente na manutenção da correção. Desvios comportamentais sutis introduzidos durante a transformação podem propagar riscos significativos em fluxos de trabalho dependentes, o que está em consonância com as preocupações identificadas na análise de detecção de mudança lógicaA verificação formal oferece o rigor matemático necessário para avaliar esses riscos em larga escala, permitindo que os líderes de engenharia validem suposições, exponham contradições e garantam a integridade funcional durante a modernização. Como resultado, a verificação formal desempenha agora um papel central na proteção de sistemas críticos durante a evolução arquitetural.

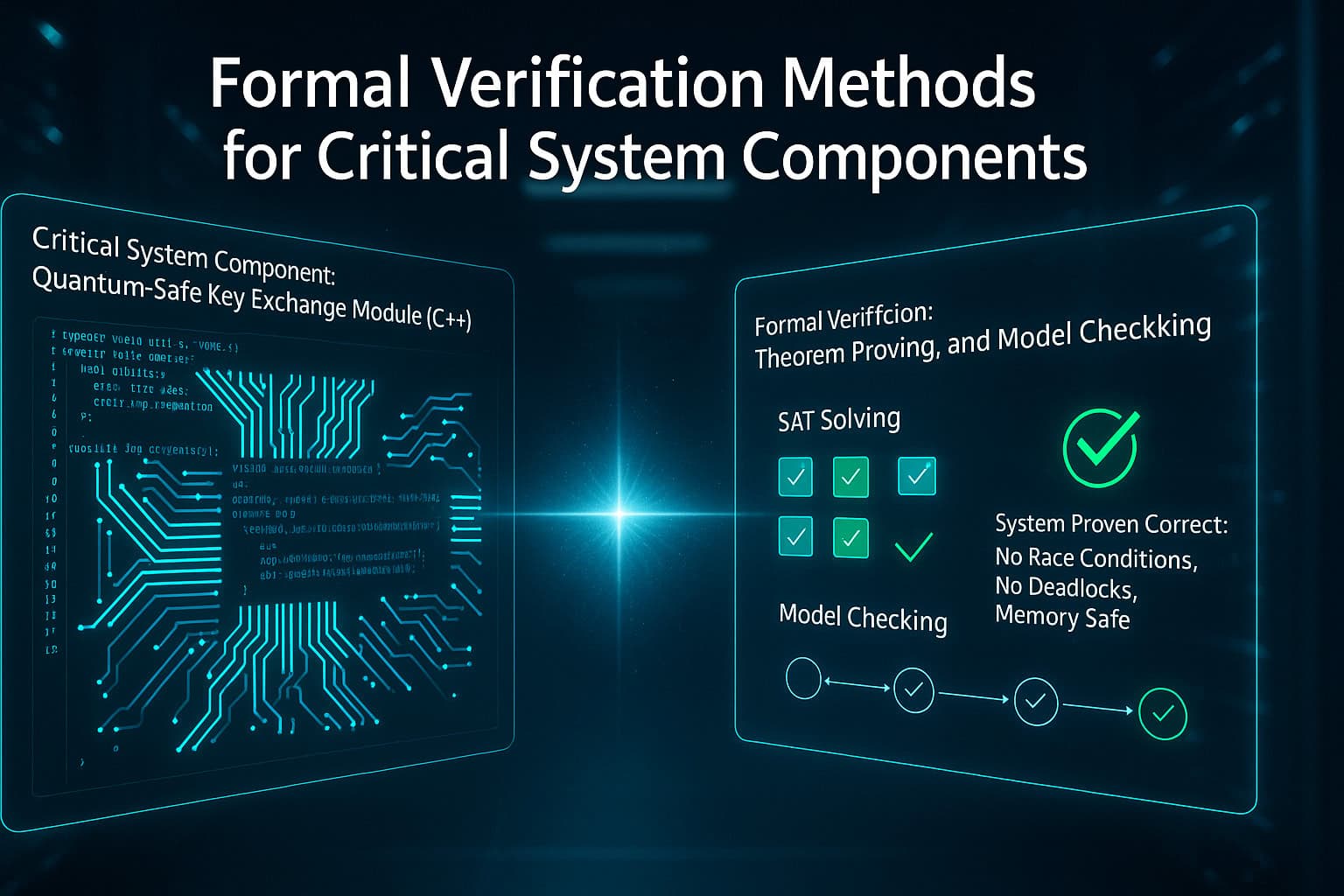

Papel estratégico da verificação formal em arquiteturas de segurança e missão crítica

A verificação formal tornou-se fundamental para empresas que operam sistemas complexos e de alta confiabilidade, onde comportamentos incorretos geram falhas operacionais em cascata. Em grandes organizações, os componentes da missão frequentemente abrangem múltiplas gerações de tecnologia, integram-se a plataformas de nuvem híbrida e suportam fluxos de trabalho críticos para a segurança que exigem correção determinística. Os testes tradicionais validam o comportamento sob condições amostradas, mas a verificação formal fornece garantias matemáticas de que as invariantes críticas se mantêm em todos os estados alcançáveis do sistema. Essa distinção torna-se cada vez mais importante à medida que a modernização introduz novos pontos de integração, modelos de concorrência e ambientes de execução que expandem o espaço de estados potencial. Equipes analíticas combinam modelos de domínio, linguagens de especificação e raciocínio de fluxo de controle para criar estruturas de verificação que evoluem com o ciclo de vida do sistema.

Os arquitetos de sistemas também reconhecem que a verificação formal fortalece a governança da modernização, esclarecendo as expectativas de comportamento antes do início da transformação. Os artefatos de prova estabelecem definições inequívocas das responsabilidades dos componentes, das condições de falha e das premissas ambientais. Eles também destacam problemas estruturais que os testes não conseguem detectar de forma confiável, reforçando o papel da análise estática como pré-requisito para uma verificação rigorosa. Técnicas para identificar interações de caminhos ocultos, como as discutidas em análise detalhada do caminho do código, ajuda as equipes de verificação a delimitar com precisão as provas, expondo dependências não óbvias incorporadas na lógica legada. Esse alinhamento permite que as organizações criem estratégias de modernização que preservem a correção ao longo da evolução arquitetônica.

Estabelecendo garantias de correção em arquiteturas heterogêneas

Sistemas críticos frequentemente operam em plataformas heterogêneas, incluindo mainframes, controladores embarcados, serviços em nuvem e pipelines de eventos distribuídos. A verificação formal fornece uma estrutura matemática unificada para garantir a correção, independentemente da linguagem de implementação ou do ambiente de execução. Considere um cenário em que uma instituição financeira mantém um mecanismo de liquidação escrito em COBOL, um serviço de computação de risco em Java e uma camada de orquestração nativa da nuvem que lida com eventos assíncronos. Sem verificação, diferenças sutis de temporização ou ordenação entre essas camadas podem expor condições de corrida de alto impacto. As especificações formais permitem que as equipes de engenharia definam restrições temporais, invariantes e protocolos de comunicação que se aplicam uniformemente a todos os componentes.

Para validar esse comportamento, as equipes constroem modelos de transição de estado que incorporam fluxos de mensagens, novas tentativas, semântica de persistência e tempos limite. Esses modelos suportam provas de lógica temporal, garantindo que impasses, reordenações não intencionais ou atualizações parciais não ocorram. Técnicas de análise estática ajudam a impulsionar esses esforços, revelando ramificações não estruturadas ou blocos inacessíveis que distorcem o fluxo de controle pretendido. Abordagens apresentadas em discussões sobre métodos de rastreamento lógico Frequentemente, servem como um precursor essencial, garantindo que os modelos formais reflitam com precisão os caminhos reais do código. À medida que a modernização avança, as propriedades verificadas orientam a refatoração, o desacoplamento de componentes e o redesenho arquitetônico, mantendo a correção em ambientes em constante evolução.

Gerenciando a complexidade dos modos de falha em fluxos de trabalho críticos

As condições de falha em sistemas críticos vão além de simples exceções, incluindo desvios de temporização, transições parciais de estado, indisponibilidade de serviços subsequentes ou aplicação inconsistente de regras de configuração. A verificação formal permite que as organizações classifiquem os modos de falha, atribuam definições matemáticas a eles e comprovem que os mecanismos de recuperação se comportam conforme o esperado em todas as permutações operacionais. Em um sistema de planejamento de transporte em tempo real, por exemplo, a concorrência entre atualizações de despacho, telemetria de veículos e otimização orientada por restrições cria uma explosão combinatória de estados que os testes tradicionais não conseguem abranger. As equipes de verificação formalizam essas transições usando comandos protegidos ou álgebra de processos para garantir que, mesmo em condições degradadas, os invariantes principais permaneçam intactos.

A construção dessas garantias exige uma compreensão precisa de como a lógica legada codifica os caminhos de recuperação de erros. Muitos sistemas históricos com mais de vinte anos mantêm lógica de fallback implícita, incorporada em estruturas condicionais. O uso de modelos formais sem a conciliação desses caminhos acarreta o risco de negligenciar comportamentos críticos. Ferramentas de análise estática revelam ramificações ocultas de tratamento de erros, condicionais não utilizadas ou estruturas de exceção legadas que influenciam as transições de estado. Esse alinhamento permite que as equipes de verificação codifiquem a semântica completa de falhas nas provas. À medida que os sistemas evoluem para arquiteturas distribuídas em nuvem, estados adicionais introduzidos por novas tentativas, escalonamento automático e modelos de consistência distribuída podem ser capturados em especificações estendidas, preservando as garantias de segurança durante a modernização.

Garantindo a integridade comportamental durante a modernização incremental.

As empresas raramente substituem sistemas críticos em uma única fase, optando, em vez disso, por estratégias de modernização incremental que preservem a continuidade operacional. Essa evolução em etapas introduz incertezas sobre como os componentes parcialmente modernizados interagem com os subsistemas legados que ainda executam funções essenciais. A verificação formal fornece a disciplina necessária para certificar a integridade comportamental em cada etapa da modernização. Por exemplo, ao migrar uma parte de um pipeline de reconciliação financeira baseado em lotes para uma arquitetura de microsserviços, diferenças na granularidade do agendamento ou na semântica de concorrência podem introduzir resultados não determinísticos. Por meio da verificação, as equipes de engenharia definem contratos de comportamento precisos para os componentes legados e modernizados, garantindo a equivalência em todas as saídas observáveis.

As equipes de verificação também dependem da abstração para manter a tratabilidade. Sistemas legados frequentemente incluem milhares de instruções procedimentais que sobrecarregariam a verificação de modelos ou a demonstração de teoremas se representadas diretamente. Abstrair esses componentes em modelos finitos, preservando a correção semântica, garante que as provas formais permaneçam escaláveis. Esse equilíbrio reflete o princípio mais amplo da modernização de preservar a intenção funcional enquanto transforma a implementação técnica. À medida que os serviços modernos substituem as rotinas legadas, as propriedades previamente verificadas servem como contratos de regressão que previnem desvios sutis durante a refatoração, integração ou replataforma. Esse padrão disciplinado reduz o risco operacional ao longo da evolução do sistema.

Utilizando a verificação formal para fortalecer a governança corporativa e os controles de risco.

As estruturas de governança corporativa enfatizam cada vez mais o raciocínio rigoroso e baseado em evidências na validação de sistemas de missão crítica. A verificação formal fornece garantia determinística alinhada aos controles de risco internos e à supervisão regulatória. Em setores altamente regulamentados, os artefatos de prova tornam-se parte dos registros de auditoria, demonstrando que o comportamento do sistema está em conformidade com as especificações declaradas. Técnicas como provas de preservação de invariantes ou garantias de vivacidade fornecem aos reguladores evidências mensuráveis e reproduzíveis de correção. Isso fortalece as defesas organizacionais contra incidentes operacionais e garante a conformidade com as políticas que regem segurança, resiliência e integridade de dados.

Além disso, as equipes de governança se beneficiam de modelos comportamentais estruturados produzidos pela verificação formal. Esses modelos expõem áreas onde as premissas legadas entram em conflito com os requisitos modernos, ajudando os comitês de modernização a determinar quando a reformulação da arquitetura é necessária. Os artefatos de verificação esclarecem a intenção do projeto, facilitam o alinhamento das partes interessadas e reduzem a ambiguidade durante as transições de sistema. Essa combinação de evidências matemáticas e visibilidade da arquitetura fornece uma base de governança robusta o suficiente para suportar programas de modernização plurianuais que abrangem diversas camadas de tecnologia.

Modelagem de componentes críticos com máquinas de estado, lógica temporal e álgebras de processos

A modelagem serve como base para a verificação formal, permitindo que as equipes de engenharia expressem o comportamento do sistema em construções matematicamente rigorosas. Componentes críticos em sistemas relevantes para a segurança e dependentes da missão exigem representações explícitas que capturem a semântica de concorrência, a evolução do estado, as suposições ambientais e as transições de falha. Máquinas de estado, estruturas de lógica temporal e álgebras de processo atendem a esses requisitos, fornecendo abstrações estruturadas capazes de representar padrões de interação de alto volume e restrições determinísticas. Esses formalismos permitem que as organizações raciocinem sobre a correção independentemente dos detalhes de implementação, garantindo que os esforços de modernização preservem as garantias funcionais à medida que as bases de código evoluem.

Um dos principais desafios na construção de modelos precisos reside em conciliar a lógica legada profundamente enraizada com as expectativas arquitetônicas modernas. Sistemas com décadas de existência frequentemente codificam o comportamento implicitamente por meio de ramificações aninhadas, estado mutável compartilhado e sequências orientadas por efeitos colaterais que resistem a uma representação direta. Equipes analíticas frequentemente se baseiam em insights estáticos intermediários para orientar o processo de modelagem. Artigos como a exploração de indicadores de complexidade Fornecem estruturas conceituais para identificar pontos críticos estruturais que influenciam a fidelidade do modelo. Ao revelar estruturas ramificadas e ciclos ilimitados, as análises estáticas garantem que os modelos reflitam as realidades operacionais em vez de suposições simplificadas.

Formalizando a evolução do estado dos componentes com máquinas de estado finitas e estendidas.

Os frameworks de máquinas de estado fornecem um mecanismo disciplinado para representar o comportamento de componentes em modos operacionais discretos. Em sistemas críticos, os componentes raramente operam em estados binários simples; em vez disso, eles transitam por um conjunto complexo de estados condicionais, parametrizados ou hierárquicos. Por exemplo, considere um subsistema de intertravamento de segurança em um ambiente de automação industrial. Seu comportamento depende não apenas das entradas dos sensores, mas também de comandos de supervisão, condições de temporização, contadores históricos e latências de falha. Máquinas de estado estendidas, que incorporam variáveis, guardas, funções de efeito e grupos de transição, tornam-se essenciais para capturar tal complexidade.

As equipes de verificação constroem essas máquinas de estado examinando a interação entre eventos externos e condições internas. O código legado frequentemente revela inúmeras transições não estruturadas, onde a lógica de ramificação incorporada em vários módulos define indiretamente os estados do sistema. Identificar essas transições implícitas requer uma análise cuidadosa das hierarquias de chamadas e das dependências de dados persistentes. Métodos semelhantes aos do artigo sobre detecção de alta complexidade Os modelos de estado orientam os modeladores na identificação de locais onde os limites de estado devem ser explicitados. Uma vez formalizadas, as máquinas de estado suportam provas de invariância, análise de alcançabilidade e detecção de estados mortos. Durante a modernização, esses modelos de estado verificados servem como âncoras de correção, permitindo que as equipes de engenharia validem se as versões nativas da nuvem mantêm a mesma semântica de estado mesmo quando as características de execução mudam.

Aplicando lógica temporal para capturar restrições de ordenação, duração e vivacidade.

A lógica temporal desempenha um papel fundamental na modelagem de comportamentos sensíveis ao tempo e dependentes da ordem, característicos de sistemas críticos. Especificações expressas em Lógica Temporal Linear ou Lógica de Árvore Computacional permitem que as organizações definam propriedades semânticas como sequenciamento de eventos, condições de segurança, tempos de reação limitados e requisitos de disponibilidade. Considere um fluxo de autorização de pagamento onde uma solicitação deve ser concluída dentro de um tempo limite especificado ou transitar para um caminho de fallback controlado. A lógica temporal permite que os arquitetos codifiquem a restrição de que nenhuma autorização pendente pode permanecer sem solução além da duração permitida.

A construção de especificações de lógica temporal exige um profundo conhecimento de interações assíncronas, novas tentativas e condições de corrida não determinísticas. Sistemas críticos que operam em ambientes distribuídos introduzem complexidade adicional, visto que falhas parciais ou perda de mensagens podem violar pressupostos implícitos incorporados na lógica legada. Técnicas de análise estática ajudam a identificar esses pressupostos, destacando anomalias na propagação de dados ou estruturas de ramificação irregulares. Artigos que descrevem problemas de dependência Este artigo demonstra como violações arquiteturais podem distorcer o raciocínio temporal. Ao alinhar as restrições da lógica temporal com as dependências identificadas, as equipes garantem que as condições de correção permaneçam válidas em diferentes ambientes de execução. Essas especificações tornam-se ativos essenciais durante a modernização incremental, permitindo provas de regressão que verificam a disponibilidade e a capacidade de resposta mesmo após a transformação arquitetural.

Modelagem de Concorrência e Protocolos de Comunicação com Álgebras de Processos

Álgebras de processos como CSP, CCS e ACP oferecem uma maneira matematicamente rigorosa de representar execução concorrente, primitivas de sincronização e semântica de comunicação. Esses modelos tornam-se indispensáveis em domínios como controle de voo, navegação autônoma, redes de compensação financeira e mecanismos de processamento de eventos em larga escala. Nesses ambientes, os comportamentos de múltiplos componentes interagindo não podem ser caracterizados apenas por máquinas de estado independentes; em vez disso, estruturas de interação formais são necessárias para expressar canais de mensagens, condições de encontro e contextos de operação paralela.

Um cenário que ilustra esse desafio pode ser encontrado em sistemas de despacho de comandos em tempo real. Esses sistemas coordenam atualizações orientadas a eventos em múltiplos subsistemas, cada um exigindo um tratamento preciso da semântica de ordenação e bloqueio. Uma pequena discrepância entre a sincronização pretendida e o comportamento real do código pode introduzir riscos de deadlock ou propagação inconsistente de estado. As percepções estáticas obtidas a partir da análise de interações interprocedurais, conforme discutido em análise de fortalecimento de impacto, ajudam a revelar onde existem padrões de comunicação implícitos. Os modelos de álgebra de processos convertem esses padrões em operadores formais, como composição paralela, ocultação e escolha. Isso permite o raciocínio automatizado sobre a ausência de deadlock, o refinamento de rastreamento e a integridade da comunicação. À medida que os componentes legados migram para equivalentes distribuídos na nuvem, as provas de álgebra de processos tornam-se cruciais para validar se os microsserviços preservam a semântica esperada do protocolo.

Modelagem formal como ponte entre o comportamento legado e as arquiteturas modernas

A modelagem formal fornece a estrutura de conexão entre a intenção operacional legada e as arquiteturas de modernização emergentes. À medida que as organizações decompõem sistemas monolíticos em padrões orientados a serviços ou a eventos, podem surgir discrepâncias entre as premissas históricas e os modelos de execução modernos. Processos em lote agendados podem evoluir para fluxos de dados contínuos, sub-rotinas fortemente acopladas podem ser reestruturadas em serviços assíncronos e operações sincronizadas podem ser substituídas por mecanismos de coordenação distribuída. Essas mudanças alteram características fundamentais, como ordem de execução, tolerância à latência, garantias de consistência e semântica de recuperação.

A modelagem garante que essas diferenças sejam compreendidas e validadas antes da implementação. Quando sistemas legados contêm fluxos condicionais não documentados ou estruturas de fallback profundamente incorporadas, a construção do modelo se torna um processo de descoberta. Isso fornece insights semelhantes aos obtidos em pesquisas sobre validação de resiliência dinâmica Revelam comportamentos negligenciados que precisam ser representados explicitamente. Uma vez convertidos em máquinas de estado, especificações de lógica temporal ou descrições de álgebra de processos, as equipes podem verificar formalmente se as estratégias de modernização preservam as garantias essenciais de segurança e correção. Durante transições em etapas, esses modelos também atuam como oráculos de regressão, permitindo a verificação de que cada incremento de modernização respeita as propriedades do sistema previamente validadas.

Técnicas de demonstração de teoremas para provar propriedades de segurança, vivacidade e invariância.

A demonstração de teoremas fornece a base mais expressiva e rigorosa para validar a correção de sistemas críticos. Ao contrário da verificação de modelos, que explora espaços de estado automaticamente, os demonstradores de teoremas se baseiam em raciocínio lógico estruturado para demonstrar que propriedades específicas são válidas sob todas as condições. Essa capacidade torna-se essencial para sistemas grandes e altamente parametrizados, onde os espaços de estado são vastos demais para exploração automatizada. Organizações que operam plataformas críticas para a segurança dependem da demonstração de teoremas para validar invariantes, obrigações de vivacidade, adesão a protocolos e a ausência de transições catastróficas para falhas. À medida que a modernização introduz novos modelos de concorrência, padrões de orquestração de serviços ou dependências distribuídas, a demonstração de teoremas garante que as suposições de correção permaneçam válidas em arquiteturas de transição.

Outra vantagem da demonstração de teoremas reside na sua capacidade de verificar propriedades de componentes que não se prestam a abstrações de estado finito. Sistemas que incorporam estruturas de dados ilimitadas, lógica recursiva ou conjuntos de dados de tamanho variável exigem estruturas de raciocínio dedutivo capazes de lidar com estruturas matemáticas gerais. As equipes de engenharia constroem definições formais das operações do sistema e raciocinam indutivamente sobre todas as combinações possíveis de entrada e estado. Antes disso, os analistas frequentemente utilizam insights estáticos para refinar as pré-condições e derivar abstrações precisas. Discussões sobre a identificação problemas de fluxo de dados Ilustrar como pressupostos antigos podem se propagar, influenciando a formação de obrigações de prova corretas.

Utilizando a preservação de invariantes para garantir a segurança estrutural em fluxos complexos.

As provas de invariantes servem como pedra angular da verificação dedutiva. Uma invariante define uma propriedade que deve ser válida em todos os estados do sistema, independentemente de transições, concorrência ou variações de entrada. Sistemas críticos dependem de invariantes para garantir a segurança estrutural, como evitar saldos negativos em plataformas financeiras, assegurar limites estáveis de atuadores em sistemas de controle ou impor faixas operacionais permitidas em dispositivos médicos. A construção de invariantes significativas exige um profundo conhecimento tanto da lógica explícita quanto dos comportamentos implícitos incorporados em códigos legados.

Considere um cenário envolvendo um fluxo de trabalho de processamento de sinistros em várias etapas, operando em mainframe e serviços distribuídos. Rotinas históricas podem implementar atualizações em cascata, soluções alternativas legadas ou fusões condicionais que raramente são documentadas. Para validar as invariantes de segurança, os engenheiros primeiro identificam as estruturas de dados principais e definem predicados matemáticos que representam condições estáveis, como consistência entre registros replicados ou progressão monotônica pelas etapas do fluxo de trabalho. Técnicas de análise estática semelhantes às descritas em validação da consistência dos dados Revelar segmentos procedurais onde invariantes podem ser violados durante a modernização. Usando um provador de teoremas, os engenheiros demonstram indutivamente que cada função de transição preserva o invariante. Essa abordagem garante que, mesmo após a migração de componentes para serviços nativos da nuvem ou a reengenharia de pipelines de dados, as garantias de segurança essenciais permaneçam intactas.

Comprovar a viabilidade para garantir o progresso, a conclusão e a ausência de impasses.

As propriedades de vivacidade garantem que os sistemas eventualmente alcancem os resultados desejados, como concluir transações, emitir respostas ou sair de estados operacionais transitórios. Em sistemas distribuídos e assíncronos, o raciocínio sobre vivacidade torna-se particularmente desafiador devido a condições de corrida, atrasos de mensagens e falhas parciais que podem aprisionar o sistema em estados de não progresso. A demonstração de teoremas permite que as organizações definam explicitamente as expectativas de vivacidade e demonstrem que, sob suposições formais, o sistema não pode permanecer indefinidamente paralisado.

Imagine um mecanismo de processamento de pedidos orientado a eventos, responsável por orquestrar fluxos de trabalho de várias etapas em diversos microsserviços. Durante a modernização, certos serviços são decompostos, introduzindo novos loops de repetição ou padrões de compensação. Sem um raciocínio formal, as garantias de progresso podem ser comprometidas. Engenheiros de verificação modelam comportamentos de comunicação e definem predicados de atividade que refletem resultados de resposta ou resolução garantidos. Anomalias estruturais semelhantes às identificadas em estudos de detecção de impasses Fornecem informações sobre possíveis comportamentos de inanição ou espera indefinida. Com essas informações, a demonstração de teoremas comprova que nenhuma sequência de execução válida pode bloquear permanentemente, garantindo uma progressão confiável mesmo em implantações híbridas, locais e em nuvem.

Demonstração de teoremas parametrizada para sistemas com estado e dados ilimitados

Muitas plataformas empresariais operam com conjuntos de dados ilimitados, filas dinâmicas, sessões de longa duração ou estruturas de registro aninhadas arbitrariamente. Essas características excedem a capacidade da verificação de modelos de estado finito. A demonstração de teoremas oferece mecanismos matematicamente expressivos para raciocinar sobre espaços de estado ilimitados por meio de indução, coindução e lógica de ordem superior. Isso se torna crucial para setores como o financeiro, o de telecomunicações e o aeroespacial, onde a correção do sistema deve ser mantida independentemente da escala dos dados, da duração da operação ou da variabilidade da entrada.

Considere um sistema de faturamento de telecomunicações que mantém milhões de sessões simultâneas com padrões de ciclo de vida dinâmicos. Projetos legados podem implementar rotinas de processamento recursivas que devem garantir precisão independentemente da escala. A demonstração de teoremas parametrizada permite que os analistas definam regras comportamentais generalizadas independentes da quantidade de sessões. Antes de construir as demonstrações, as equipes de engenharia frequentemente analisam padrões estruturais para localizar áreas onde ocorrem recursão ou iteração ilimitadas. Artigos como o exame de comportamento orientado por impacto Ilustrar como a complexidade legada deve ser compreendida antes da abstração. Com uma especificação precisa, os provadores de teoremas validam a correção para todos os tamanhos de sistema possíveis, fornecendo forte garantia durante a modernização, o escalonamento de carga ou a migração para infraestrutura de nuvem elástica.

Codificação da lógica de falhas, recuperação de erros e suposições ambientais em obrigações de prova.

O tratamento de falhas desempenha um papel crucial na verificação, especialmente para sistemas que precisam manter um comportamento seguro em ambientes adversos ou degradados. A demonstração de teoremas permite que os analistas codifiquem suposições sobre modos de falha, propagação de erros, rotinas de contingência e garantias externas do sistema. Isso assegura que as demonstrações permaneçam válidas mesmo quando os componentes sofrem interrupções intermitentes, inconsistências de configuração ou disputa por recursos. As arquiteturas modernas amplificam essas preocupações devido à comunicação distribuída, ao escalonamento automático e aos processadores heterogêneos, que introduzem novas categorias de falhas parciais.

Considere o caso de um sistema de análise de sinistros multiplataforma em processo de modernização faseada. Alguns componentes são executados em mecanismos de processamento em lote legados, outros em serviços de nuvem orientados a eventos. A semântica de falhas difere entre esses ambientes, o que pode invalidar suposições anteriores sobre a propagação de erros. Os engenheiros definem pré-condições precisas que capturam comportamentos de falha aceitáveis e, em seguida, constroem provas que demonstram que as propriedades de segurança em nível de sistema permanecem intactas sob essas condições. Insights de estudos sobre prevenção de falhas em cascata Ajudam a identificar transições de casos extremos que exigem tratamento formal explícito. Incorporar essas transições às obrigações de prova garante que a modernização não comprometa a resiliência ou a correção, mesmo quando os comportamentos de falha mudam devido a alterações arquitetônicas.

Fluxos de trabalho de verificação de modelos para sistemas de controle embarcados, em tempo real e distribuídos

A verificação de modelos proporciona uma exploração exaustiva e automatizada dos estados do sistema, permitindo que as equipes de verificação identifiquem violações de segurança, vivacidade ou correção de protocolo sem a necessidade de construir provas manuais. Para controladores embarcados, plataformas de tempo real e sistemas de orquestração distribuída, a verificação de modelos torna-se essencial devido à alta densidade de estados interagindo e às dependências de tempo. Esses ambientes frequentemente dependem de processos concorrentes, transições orientadas a interrupções e requisitos de agendamento determinísticos. Os verificadores de modelos avaliam essas dinâmicas explorando sistematicamente todas as configurações alcançáveis sob diferentes ordens de eventos e condições ambientais. À medida que as empresas modernizam esses sistemas de missão crítica, a verificação de modelos garante a consistência comportamental entre subsistemas legados e componentes distribuídos emergentes.

Outra vantagem da verificação de modelos reside na sua capacidade de revelar inconsistências sutis que não são aparentes por meio de testes ou simulações. Restrições de tempo real, deriva de relógio, novas tentativas de comunicação e chegadas assíncronas de mensagens criam caminhos de execução que a validação tradicional raramente considera. Bases de código legadas, particularmente aquelas estruturadas ao longo de décadas, podem conter condicionais profundamente aninhadas, transições de fallback implícitas ou suposições de temporização vinculadas a hardware antigo. Resultados analíticos de fontes como o estudo de complexidade do fluxo de controle Ilustrar como padrões estruturais complexos influenciam os resultados da verificação. Ao alinhar a verificação de modelos com essas percepções, as organizações constroem abstrações precisas que refletem as condições operacionais reais.

Exploração exaustiva do estado em malhas de controle embutidas

Sistemas embarcados em aplicações aeroespaciais, segurança automotiva, automação industrial e robótica dependem de malhas de controle precisas, operando dentro de limites rígidos de temporização e segurança. A verificação de modelos permite que os engenheiros modelem ciclos de controle, interrupções, amostragem de sensores, comandos de atuadores e rotinas de contingência com alta fidelidade. Um cenário representativo pode envolver um módulo de controle de voo que governa ajustes de atitude com base em entradas de fusão de sensores. O controlador deve garantir propriedades de segurança como oscilação limitada, convergência monotônica do atuador ou prevenção de estados inválidos. As malhas embarcadas frequentemente interagem com indicadores de falha em nível de hardware, temporizadores de vigilância e subsistemas de correção de erros, tornando o espaço de estados completo significativamente maior do que o esperado.

Os fluxos de trabalho de verificação de modelos começam com a definição de um modelo de estado estruturado que incorpora características funcionais e de temporização. Isso pode incluir variáveis de clock, faixas de entrada, efeitos de histerese e condições de falha. Implementações legadas normalmente revelam transições não documentadas vinculadas a otimizações de desempenho ou restrições de hardware. Técnicas de análise semelhantes às descritas em detecção de padrões sensíveis à latência Destacar áreas onde atrasos implícitos ou suposições de sincronismo influenciam o comportamento. Uma vez estabelecido o modelo de estado, os engenheiros aplicam exploração limitada ou ilimitada para validar propriedades como estabilidade, limites de propagação de erros e comportamento de recuperação. Durante a modernização, especialmente na migração de lógica embarcada para camadas de abstração de hardware ou plataformas definidas por software, a verificação de modelos garante que as restrições de temporização e segurança sejam preservadas em mecanismos de execução atualizados.

Modelos de agendamento em tempo real e verificação de prazos

Sistemas em tempo real dependem de garantias de agendamento previsíveis, onde as tarefas devem ser executadas dentro de prazos especificados para manter a integridade do sistema. Esses ambientes incluem sistemas de navegação autônoma, controladores de infusão médica, robótica industrial e plataformas de despacho de emergência. A verificação de modelos permite que as equipes de verificação avaliem políticas de agendamento, regras de preempção, hierarquias de prioridade e mecanismos de sincronização de relógios sob todas as variações de tempo possíveis. Violações de tempo real, como atrasos, amplificação de jitter ou inversão de prioridade, podem causar falhas operacionais catastróficas.

Um cenário que ilustra essa preocupação envolve um subsistema de veículo autônomo que deve processar dados de sensores, avaliar trajetórias e enviar comandos de atuadores dentro de ciclos fixos. Ao modernizar esse sistema para recursos com suporte em nuvem ou camadas de computação adicionais, as restrições de agendamento podem mudar de maneiras sutis. Engenheiros de verificação constroem autômatos temporizados ou modelos de estado híbridos que representam cada tarefa, seu prazo e sua interação com os relógios do sistema. Trabalho analítico sobre produtividade versus capacidade de resposta Fornece orientações para identificar áreas onde a disputa de tempo ou picos de carga influenciam a confiabilidade do agendamento. Os verificadores de modelo exploram todas as sequências de tarefas, avaliando se os prazos são mantidos considerando a pior ordem possível, atrasos nas mensagens ou disputa de recursos. Essa abordagem garante que a modernização não introduza defeitos de tempo latentes e que as garantias de segurança e operacionais permaneçam consistentes em ambientes de execução heterogêneos.

Comportamento de Sistemas Distribuídos, Consenso e Verificação da Ordenação de Mensagens

Sistemas distribuídos amplificam a complexidade da verificação ao introduzir ordenação não determinística de mensagens, latência variável, partições de rede e interações dependentes da escala. A verificação de modelos torna-se um instrumento essencial para verificar algoritmos de consenso, lógica de coordenação distribuída e protocolos de recuperação em múltiplos nós. Redes de transações financeiras, sistemas de gerenciamento de redes de energia e infraestruturas de comunicação em escala nacional dependem dessas garantias para evitar corrupção de dados, atualizações de estado inconsistentes ou interrupções em cascata.

Por exemplo, considere uma plataforma distribuída de rastreamento de ativos que coordena atualizações em várias regiões geográficas. Versões legadas podem depender de chamadas síncronas, enquanto variantes modernizadas incorporam mensagens assíncronas, entrega baseada em filas ou protocolos de disseminação de informações. Engenheiros de verificação constroem modelos que capturam perda de mensagens, atraso, duplicação e particionamento temporário. Informações obtidas a partir de pesquisas sobre análise de injeção de falhas Ajudam a definir as condições sob as quais os componentes distribuídos devem preservar as propriedades de segurança. A verificação de modelos avalia se o consenso se mantém, se a atividade persiste durante a instabilidade da rede e se os estados replicados permanecem consistentes em todos os nós. À medida que os sistemas migram para ambientes de nuvem ou multirregionais, essas verificações garantem a continuidade operacional independentemente da escala, da latência ou das mudanças de topologia.

Detecção de intercalações sutis e violações parciais de ordem introduzidas durante a modernização

A modernização frequentemente altera os padrões de concorrência, introduzindo novas sequências de eventos ou eliminando fluxos de trabalho serializados que antes garantiam a correção. Essas transformações podem gerar violações de ordem parcial, intercalações inesperadas ou condições de corrida que antes eram impossíveis. A verificação de modelos fornece a visibilidade granular necessária para detectar esses problemas antes da implementação. As equipes constroem modelos que refletem as estruturas de concorrência legadas e modernizadas e comparam o comportamento por meio de verificação de refinamento, equivalência de rastreamento ou análise de contraexemplos.

Considere uma plataforma global de liquidação de pagamentos historicamente baseada em atualizações em lote. Durante a modernização, a lógica de liquidação é decomposta em microsserviços que operam de forma assíncrona. Embora essa transição melhore a escalabilidade, ela também introduz novas combinações de tempo e ordem. Insights estáticos semelhantes aos fornecidos em integridade do fluxo baseado em atores Revelam áreas onde a semântica de propagação de dados pode mudar. Ao aplicar a verificação de modelos, os engenheiros detectam casos em que atualizações parciais se propagam de forma inconsistente ou em que novas tentativas assíncronas reordenam eventos além dos limites aceitáveis. À medida que a modernização avança, essas verificações garantem que o comportamento distribuído esteja em conformidade com a semântica de projeto pretendida e que a concorrência recém-introduzida não comprometa a correção ou a conformidade regulatória.

Interpretação abstrata e análise estática como ponte para a verificação formal completa.

A interpretação abstrata fornece a base matemática necessária para aproximar o comportamento dinâmico sem executar código, tornando-se um precursor crítico para a verificação formal em sistemas críticos para a segurança. Sua semântica baseada em reticulados permite que as organizações modelem intervalos de variáveis, restrições de fluxo de controle e características de propagação de dados em grande escala, especialmente em ambientes legados com dezenas de milhões de linhas de código. Ao construir sobreaproximações sólidas de todos os caminhos de execução viáveis, a interpretação abstrata identifica invariantes, estados impossíveis e propriedades de estabilidade que a demonstração de teoremas e a verificação de modelos utilizam posteriormente. Esse alinhamento torna-se indispensável na modernização de sistemas distribuídos e de missão crítica que contêm dependências de dados complexas e fluxos de trabalho não documentados.

A análise estática complementa a interpretação abstrata, fornecendo insights estruturais que esclarecem onde os modelos formais devem se concentrar. Arquiteturas legadas frequentemente contêm condicionais profundamente aninhadas, fluxos recursivos, suposições ambientais ou comportamentos específicos da plataforma que a verificação formal não consegue incorporar sem uma abstração precisa. Métodos analíticos como análise de fluxo multiprocedural, resolução de dependências e rastreamento de fluxo de dados revelam efeitos colaterais ocultos ou mutações de estado essenciais para a formalização. Explorações em tópicos como padrões de análise de impacto Ilustrar como a compreensão organizacional dos direcionadores de execução contribui para obrigações de prova mais precisas. Quando integradas estrategicamente, a análise estática e a interpretação abstrata formam um fluxo de trabalho que transforma bases de código complexas em especificações verificáveis com precisão matemática.

Obtendo superaproximações de som para bases de código grandes e heterogêneas

Sistemas empresariais de grande porte contêm código que abrange múltiplos paradigmas, décadas e domínios operacionais. A interpretação abstrata está em uma posição única para unificar essa diversidade, construindo aproximações semânticas que permanecem válidas independentemente das especificidades de implementação. Um sistema global de compensação financeira, por exemplo, pode incluir lógica de liquidação em COBOL, serviços de orquestração em Java, módulos de análise em Python e infraestrutura de mensagens em tempo real. Cada um introduz comportamentos únicos, mas a verificação formal requer um modelo semântico consistente. A interpretação abstrata alcança isso mapeando todas as construções em domínios unificados — intervalos, octógonos, restrições simbólicas ou abstrações relacionais — que generalizam o comportamento, preservando a solidez.

A construção dessas abstrações exige um tratamento cuidadoso de loops, estruturas dinâmicas e fluxos interprocedurais. Sistemas legados frequentemente utilizam loops aninhados com variáveis de estado em constante evolução, vinculadas a regras de negócio codificadas em diversas camadas procedurais. Para evitar subestimação, os analistas calculam pontos fixos que representam condições de equilíbrio estáveis para todas as execuções possíveis. Resultados de análises estáticas de áreas como mapeamento de dependências escalável Destacar onde os limites de abstração devem ser ajustados para capturar transições de estado indiretas. Uma vez que as sobreaproximações convergem, elas servem como base para a geração de invariantes, construção de máquinas de estado e subsequente verificação dedutiva ou automatizada. Durante a modernização, essas aproximações garantem que as novas implementações mantenham o envelope comportamental completo necessário para as garantias de correção.

Extraindo invariantes implícitos e restrições comportamentais ocultas na lógica legada.

Aplicações legadas frequentemente codificam restrições de correção implicitamente, em vez de por meio de documentação explícita ou contratos de projeto. Essas invariantes podem residir em convenções de uso de variáveis, estruturas de término de loops, caminhos de fallback ou lógica de recuperação de erros incorporadas ao longo de décadas de desenvolvimento incremental. A interpretação abstrata revela essas invariantes ocultas analisando propriedades estáveis em todos os caminhos possíveis. Por exemplo, em um sistema nacional de processamento de benefícios, restrições que garantem saldos não negativos, progressões de estado monotônicas ou combinações de campos permitidas podem nunca ser explicitamente declaradas, mas permanecem válidas em milhões de execuções históricas. A verificação formal não pode prosseguir de forma confiável sem capturar essas propriedades.

Para identificá-los, os analistas avaliam estados abstratos em loops, ramificações e limites de módulos. Como os invariantes frequentemente emergem da convergência repetida de estados abstratos, a identificação requer raciocínio global em vez de inspeção local. Estudos que examinam anomalias de propagação de dados Este trabalho demonstra como interações sutis entre campos podem distorcer a correção se omitidas dos modelos. Uma vez extraídas, as invariantes são formalizadas como predicados em ambientes de demonstração de teoremas ou como propriedades em frameworks de verificação de modelos. Essas restrições tornam-se, então, garantias formais que devem ser mantidas durante atividades de modernização, como migração de esquemas de dados, desacoplamento de serviços ou execução distribuída. Conforme a modernização avança, as invariantes extraídas servem como contratos de regressão, preservando a correção histórica sob novas arquiteturas.

Utilizando a interpretação abstrata para identificar limites de verificação e pontos de redução de modelo.

A verificação formal exige limites bem definidos; provar um sistema empresarial inteiro de forma monolítica não é viável nem necessário. A interpretação abstrata identifica partições naturais que suportam a verificação modular. Por exemplo, uma plataforma de controle de rede elétrica pode consistir em módulos de previsão, filtros de entrada de sensores, algoritmos de regulação e lógica de despacho. Embora todos interajam, nem toda interação é relevante para todas as obrigações de prova. A interpretação abstrata ajuda a isolar regiões semânticas onde o comportamento se estabiliza ou os riscos se propagam, permitindo que os engenheiros de verificação determinem quais subsistemas exigem provas detalhadas e quais podem permanecer abstratos.

Essa identificação de limites depende fortemente da análise de interdependências, padrões de compartilhamento de estados e cadeias de propagação de mutações. Insights de tópicos como modernização orientada por dependências Ilustrar como a simplificação estrutural apoia um raciocínio mais robusto. Ao identificar áreas de efeitos colaterais controlados ou transições determinísticas, os analistas constroem modelos formais reduzidos adequados para demonstração de teoremas ou verificação de modelos. Essas reduções melhoram drasticamente o desempenho da verificação, eliminando variáveis de estado ou caminhos de execução irrelevantes. Durante a modernização, a redução de modelos garante que recursos arquitetônicos recém-introduzidos, como mensagens assíncronas ou pipelines de streaming, não invalidem as premissas necessárias para um raciocínio sólido.

Conectando a semântica abstrata às obrigações de prova executáveis em ferramentas de verificação modernas.

Uma vez que as abstrações se estabilizam, elas devem ser traduzidas em obrigações de prova concretas para mecanismos de verificação formal. Essa tradução inclui a geração de invariantes indutivos, a formulação de pré-condições, a definição de transições de estado permitidas e a construção de contratos comportamentais que verificadores de modelos ou provadores de teoremas possam avaliar. Essa etapa forma a ponte entre o raciocínio estático e a verificação matemática. Por exemplo, um mecanismo de roteamento de telecomunicações em processo de modernização pode depender de restrições que garantam que nenhuma tabela de roteamento fique vazia durante uma falha (failover). A interpretação abstrata identifica as condições sob as quais tais estados se tornam alcançáveis. As equipes de verificação, então, codificam essas condições em lógica temporal ou em estruturas de raciocínio indutivo para garantir que a lógica de failover se comporte conforme o esperado em todas as condições de rede.

As percepções estáticas fornecem um contexto crítico na formulação dessas obrigações. Explorações em metodologias de rastreamento de padrões Demonstrar como as sequências operacionais moldam os requisitos de verificação. Ao alinhar a semântica abstrata com esses padrões de execução, as obrigações de prova resultantes mantêm a fidelidade ao comportamento real do sistema. À medida que a modernização introduz novas abstrações arquitetônicas, as equipes de verificação regeneram as obrigações incrementalmente, garantindo que as variações emergentes do sistema permaneçam consistentes com as condições de correção historicamente validadas. Isso garante que a verificação formal permaneça uma disciplina contínua e alinhada à arquitetura, em vez de um exercício pontual.

Projeto baseado em contratos e raciocínio de garantia assumida para interfaces de sistemas complexos

O projeto baseado em contratos fornece um método rigoroso para definir as expectativas comportamentais exatas de componentes críticos do sistema. Em ambientes de alta confiabilidade e sensíveis à modernização, os componentes raramente operam isoladamente. Em vez disso, seu comportamento correto depende das garantias fornecidas pelos módulos a montante e a jusante. Os contratos capturam esses relacionamentos como suposições e garantias formalizadas que definem como os componentes devem se comportar sob todas as condições permitidas. Esses contratos tornam-se a base para a verificação sistemática, pois transformam requisitos vagamente definidos em especificações lógicas precisas. À medida que arquiteturas distribuídas e projetos orientados a serviços substituem sistemas monolíticos, o projeto baseado em contratos torna-se essencial para manter um comportamento operacional previsível.

Suponha que o raciocínio baseado em garantias permita que as equipes de verificação decomponham grandes sistemas em subconjuntos gerenciáveis. Em vez de provar as propriedades de todo o sistema de uma só vez, cada componente é verificado independentemente usando seu contrato. O sistema global está correto se todos os contratos permanecerem mutuamente consistentes. Esse raciocínio composicional é especialmente importante em iniciativas de modernização, pois os componentes legados frequentemente contêm suposições implícitas que diferem daquelas esperadas nos serviços modernizados. Trabalho analítico relacionado a consistência entre plataformas Este trabalho demonstra como incompatibilidades introduzidas durante a modernização podem propagar erros sutis se as premissas da interface não forem formalizadas. O design baseado em contratos previne essas inconsistências ao impor limites comportamentais claros e verificáveis.

Definindo responsabilidades de interface precisas em componentes heterogêneos

Sistemas críticos frequentemente envolvem componentes heterogêneos que diferem em modelos de temporização, semântica de estado, convenções de tratamento de erros e formatos de mensagens. O design baseado em contratos fornece uma abordagem estruturada para definir responsabilidades entre essas fronteiras. Considere um programa de modernização que migra um módulo de análise de sinistros de um processo em lote de mainframe para um microsserviço orientado a eventos. O componente legado pressupõe que os registros cheguem em ordem classificada e que as novas tentativas ocorram por meio de execuções agendadas em lote. O componente modernizado, no entanto, pode receber eventos assíncronos não ordenados com diferentes níveis de conclusão parcial. Sem contratos de interface explícitos, o desalinhamento entre as expectativas produz atualizações de estado inconsistentes ou divergência silenciosa de dados.

Os engenheiros de verificação começam documentando as pré-condições que o serviço receptor pressupõe, como restrições de ordenação de dados ou combinações de campos válidas. Em seguida, definem garantias, como atualizações de registros monotônicas ou tempos de resposta limitados. As percepções obtidas a partir de análises de impacto da evolução do esquema Os contratos frequentemente orientam a descoberta de convenções ocultas. Uma vez estabelecidos os contratos, os engenheiros verificam se cada componente atende às suas garantias quando suas premissas são válidas. Esse processo assegura a integridade da arquitetura, mesmo quando a modernização modifica a topologia de execução, a semântica de agendamento ou os ambientes de implantação. Os contratos também servem como artefatos de regressão que garantem que melhorias futuras não violem silenciosamente os limites de comportamento estabelecidos.

Verificação Composicional para Programas de Modernização em Grande Escala

O raciocínio baseado em garantias permite a verificação em larga escala, decompondo obrigações de prova de grandes sistemas em unidades verificáveis menores. Isso é especialmente relevante para empresas que modernizam sistemas com milhões de linhas de código em múltiplas plataformas. Tentar raciocinar sobre tais sistemas de forma monolítica é computacionalmente inviável. O raciocínio composicional resolve esse problema verificando cada componente sob suposições explicitamente definidas. Essas provas locais são então compostas para inferir a correção em nível de sistema.

Um sistema de roteamento de transporte oferece um cenário útil. Módulos legados calculam rotas ótimas usando algoritmos determinísticos. Microsserviços modernizados introduzem exploração paralela de caminhos, mensagens assíncronas e caches de dados distribuídos. Sem decomposição estruturada, verificar a correção do roteamento de ponta a ponta torna-se inviável. Equipes de verificação definem contratos que capturam os comportamentos necessários, como a consistência das atualizações de roteamento ou a disponibilidade de índices geoespaciais. Estudos relacionados a análise de impacto para modernização Destaca-se como pressupostos legados muitas vezes permanecem implícitos. Uma vez que os contratos esclarecem essas responsabilidades, cada componente é verificado independentemente, tornando o processo geral de raciocínio viável. À medida que a modernização avança em fases, a verificação composicional garante que os serviços recém-introduzidos preservem a correção mesmo antes da conclusão total da migração.

Lidar com condições ambientais incertas e variáveis em sistemas distribuídos

Sistemas distribuídos operam sob condições variáveis que afetam a latência, a taxa de transferência, a ordenação e o comportamento em caso de falha. O projeto baseado em contratos acomoda essas incertezas formalizando as premissas ambientais que devem ser válidas para que as garantias do sistema permaneçam válidas. Por exemplo, um sistema de orquestração de pagamentos pode assumir limites superiores para atrasos de mensagens, garantias mínimas de consistência dos serviços de armazenamento ou comportamento previsível de novas tentativas de microsserviços dependentes. Essas premissas tornam-se parte do contrato e permitem que as equipes de verificação determinem precisamente quando as garantias se aplicam.

Ao modernizar esses sistemas, as características do ambiente frequentemente mudam. A migração para regiões de nuvem introduz variações adicionais na rede. A substituição de chamadas síncronas ao banco de dados por filas assíncronas altera a semântica de ordenação. Insights analíticos de comportamentos de execução concorrente Revela-se como as mudanças ambientais influenciam a lógica dos componentes. Os contratos incorporam essas dependências para garantir a correção em diversas condições de tempo de execução. As equipes de verificação, então, utilizam o raciocínio de garantia de suposição para provar que, mesmo nos piores cenários possíveis, porém admissíveis, propriedades globais como vivacidade, coerência de dados e idempotência permanecem intactas. Ao documentar explicitamente as suposições ambientais, as empresas evitam regressões acidentais durante transições de arquitetura.

Garantindo a estabilidade comportamental durante implantações incrementais e híbridas

A modernização raramente ocorre em uma única transformação. Em vez disso, as organizações operam arquiteturas híbridas onde componentes legados e serviços modernizados coexistem. O design baseado em contratos ajuda a manter a estabilidade durante esses estados de transição, especificando as interfaces comportamentais exatas que devem ser mantidas antes da integração. Considere um sistema de logística global onde as atualizações de rastreamento originalmente fluíam por meio de processamento centralizado em mainframe. A migração introduz nós de processamento distribuídos e serviços específicos da região. A falha em documentar as premissas da interface produz atualizações inconsistentes ou transições de estado fora de ordem.

As equipes de verificação estabelecem contratos precisos que descrevem as propriedades necessárias, como garantias de ordenação, integridade dos eventos e lógica de validação. Resultados analíticos relacionados a riscos de dependência dominantes Pode revelar áreas onde mudanças estruturais sutis produzem comportamentos inesperados. O raciocínio baseado em garantias permite que as equipes verifiquem a correção localmente antes que os componentes sejam integrados em implantações híbridas. À medida que a modernização avança, cada novo componente é validado dentro do contexto da estrutura contratual em evolução. Essa validação em etapas garante que o sistema preserve as propriedades comportamentais globais, mesmo quando módulos individuais alteram seus detalhes de implementação ou ambientes de execução.

Integrando métodos formais em pipelines de CI/CD, DevSecOps e Assurance.

A integração da verificação formal em pipelines de entrega corporativos exige uma mudança de paradigma, passando de verificações de correção isoladas para um raciocínio contínuo e alinhado à automação. Sistemas críticos para a segurança e orientados à modernização operam em ambientes onde as mudanças ocorrem frequentemente, muitas vezes em equipes distribuídas e arquiteturas híbridas. Sem verificação contínua, mesmo pequenas atualizações podem alterar o comportamento de maneiras que violem premissas previamente validadas. Portanto, as organizações incorporam a demonstração de teoremas, a verificação de modelos e a validação baseada em contratos em fluxos de trabalho de CI/CD para garantir que as expectativas de correção permaneçam sincronizadas com a evolução do código. Essa integração conecta desenvolvimento, engenharia de qualidade e governança arquitetural.

As práticas de DevSecOps fortalecem esse alinhamento ao incorporar responsabilidades de segurança e correção em todo o pipeline. Métodos formais aprimoram essas responsabilidades ao identificar riscos estruturais que os testes automatizados não conseguem detectar. A introdução de serviços baseados em nuvem, limites de microsserviços e padrões orientados a eventos aumenta a superfície de ataque para defeitos que surgem de concorrência, ordenação ou desalinhamento de interfaces. Estudos como a análise de integração da análise CI CD Destacamos como o raciocínio automatizado apoia os objetivos de segurança e modernização. Ao vincular verificações formais a cada etapa de commit, build ou implantação, as organizações transformam a correção em uma disciplina contínua e aplicável.

Incorporando a verificação de modelos e a verificação de propriedades em pipelines de construção.

A verificação de modelos se integra de forma eficaz aos fluxos de trabalho de CI/CD, pois pode ser executada automaticamente após cada alteração de código, validando se as propriedades de segurança, disponibilidade e ordenação permanecem intactas. Isso é especialmente importante em iniciativas de modernização em larga escala, onde os componentes são gradualmente reescritos ou replataformados. Considere um mecanismo de cálculo de risco corporativo sendo migrado de uma arquitetura mainframe orientada a lotes para uma topologia de microsserviços distribuída. Mesmo pequenas alterações no roteamento de mensagens, intervalos de agendamento ou etapas de validação de dados podem introduzir novos caminhos de execução que violam as invariantes esperadas.

As equipes de verificação configuram estágios de verificação de modelos dentro do pipeline para serem acionados a cada mesclagem ou implantação. Esses estágios geram modelos de estado, aplicam regras de abstração e avaliam propriedades usando estratégias de busca limitadas ou ilimitadas. Trabalho analítico sobre detecção de risco de regressão Fornece informações sobre como identificar regressões de desempenho e correção que surgem apenas sob condições específicas de tempo ou carga. A verificação de modelos complementa esses métodos, garantindo que as condições estruturais e lógicas sejam mantidas em todos os possíveis rastreamentos de execução. Durante a modernização, cada verificação bem-sucedida confirma que as transformações incrementais não comprometem as garantias de correção estabelecidas. As falhas geram rastreamentos de contraexemplos que orientam os desenvolvedores na correção de problemas antes que cheguem à produção.

Utilizando o raciocínio simbólico para detectar desvios lógicos sutis em iterações rápidas.

As ferramentas de raciocínio simbólico permitem que os pipelines detectem desvios lógicos que contornam os testes convencionais. Essas ferramentas avaliam caminhos de código representando variáveis e estados do sistema simbolicamente, em vez de concretamente. Essa abordagem revela desvios estruturais introduzidos durante refatorações, replataformas ou reformulações de interfaces. Um cenário representativo envolve um módulo de autorização de pagamentos corporativos passando por uma modernização em etapas. A lógica legada inclui um comportamento de fallback implícito que só é acionado em condições de tempo raras. Quando o módulo é reimplementado como um serviço assíncrono, a análise simbólica identifica diferenças na forma como os caminhos de falha se propagam.

Quando integrado aos fluxos de trabalho de CI/CD, o raciocínio simbólico captura esses desvios durante os estágios iniciais do pipeline. Os engenheiros definem propriedades simbólicas, como condições de normalização, requisitos de ordenação ou obrigações de preservação de invariantes. Insights estáticos de trabalhos sobre padrões de revisão de código automatizada Demonstrar como o raciocínio estático e o simbólico colaboram para revelar problemas ocultos. Mecanismos de raciocínio simbólico são executados dentro do pipeline para comparar o comportamento antes e depois de cada alteração. Esse processo garante que a modernização não introduza erros lógicos sutis, porém de alto impacto. À medida que os sistemas evoluem para padrões distribuídos, as verificações simbólicas ajudam a manter a equivalência entre o comportamento legado e a semântica da implementação moderna.

Incorporando a validação de contratos nos portões de segurança do DevSecOps

À medida que a modernização multiplica as interfaces do sistema, o design baseado em contratos torna-se essencial para verificar se os componentes se comportam de forma consistente em diferentes ambientes. Os pipelines DevSecOps incorporam mecanismos de validação de contratos que avaliam se os componentes atendem às premissas e garantias definidas. Esses mecanismos impedem que alterações incompatíveis se propaguem para os níveis superiores do sistema. Por exemplo, em um sistema nacional de informações de saúde, os serviços de encaminhamento de pacientes dependem de restrições rigorosas de ordenação e validação. Se a modernização alterar os formatos de mensagens, as regras de codificação ou a semântica de ordenação, a ausência de validação de contratos permite que atualizações errôneas se propaguem por todo o sistema.

As ferramentas de validação de contratos analisam as alterações recebidas, verificando se os componentes revisados mantêm as garantias comportamentais necessárias. Elas também validam se as premissas ambientais permanecem satisfeitas, considerando as dependências subsequentes. Informações obtidas a partir de pesquisas sobre validação de impacto orientada por pesquisa Ilustrar como a compreensão das dependências de transição influencia a definição de contratos. Durante a execução do pipeline, os validadores de contrato bloqueiam implantações que violam os limites de correção e fornecem diagnósticos acionáveis. Isso garante que a modernização prossiga com segurança, mesmo quando as equipes trabalham em paralelo em vários componentes e ambientes de execução.

Estabelecendo evidências de segurança por meio de raciocínio formal contínuo

A verificação formal fornece as evidências de garantia necessárias para certificação de segurança, conformidade regulatória e governança de modernização. Integrar essas evidências aos pipelines de CI/CD e DevSecOps transforma a garantia de uma atividade periódica em um processo contínuo. Cada artefato de prova, rastreamento de verificação de modelo ou registro de validação de contrato torna-se parte de um histórico auditável que documenta a correção do sistema ao longo do tempo. Por exemplo, uma plataforma de autenticação biométrica que dá suporte a serviços do setor público pode exigir evidências demonstráveis de que todas as atualizações preservam as garantias de disponibilidade, integridade dos dados e semântica de recuperação de falhas.

Os pipelines armazenam automaticamente esses artefatos e os associam a identificadores de compilação, eventos de implantação e alterações arquitetônicas. Isso garante que as equipes de conformidade possam rastrear as obrigações de correção em cada etapa da modernização. Trabalho analítico sobre mapeamento de falhas críticas Ajuda as organizações a entender como os desvios se propagam, fornecendo argumentos de garantia mais robustos. Ao incorporar métodos formais na governança de pipelines, as empresas mantêm a confiabilidade operacional mesmo com a evolução dos sistemas. Esse registro contínuo de verificação molda a estratégia de modernização a longo prazo, identificando componentes estáveis, áreas frágeis e vetores de risco emergentes.

Escalando a verificação formal em bases de código legadas, heterogêneas e poliglotas

A escalabilidade da verificação formal exige que as organizações vão além de provas isoladas e adotem estratégias sistemáticas capazes de lidar com bases de código de nível empresarial com longos históricos operacionais. Sistemas legados frequentemente abrangem múltiplas linguagens, formatos de dados e modelos de execução, criando cenários de verificação que diferem significativamente das arquiteturas modulares modernas. Esses sistemas incluem programas em lote, componentes orientados a eventos, linguagens específicas de domínio e regras de negócio incorporadas, tecidas ao longo de décadas de mudanças incrementais. As equipes de verificação devem, portanto, unificar semânticas diversas sob uma estrutura coerente de modelagem e raciocínio. O desafio se intensifica quando a modernização ocorre em paralelo, uma vez que tanto o código legado quanto o moderno devem ser verificados simultaneamente. Perspectivas analíticas sobre projeto de integração de aplicativos Este artigo demonstra como infraestruturas heterogêneas complicam o raciocínio entre componentes. A verificação formal só é bem-sucedida quando essa complexidade é considerada por meio de abstração escalável e modularização.

Sistemas poliglotas complicam ainda mais a verificação ao introduzir linguagens com diferentes regras de tipagem, semântica de concorrência, convenções de tratamento de erros e características de tempo de execução. Em muitas empresas, décadas de investimento criaram ecossistemas onde COBOL, Java, Python, SQL e scripts proprietários coexistem. Garantir a correção em tais ambientes exige estratégias de verificação que generalizem o comportamento sem perder a precisão necessária para garantir vivacidade, segurança e ordenação. [Insights from research on] análise de grafo de dependência Demonstrar como o mapeamento estrutural revela interações ocultas entre idiomas que devem ser incorporadas em modelos formais. À medida que as organizações modernizam esses ambientes poliglota em arquiteturas distribuídas ou nativas da nuvem, a verificação escalável torna-se essencial para prevenir regressões e preservar a integridade operacional.

Harmonizando a Semântica em Múltiplas Linguagens e Paradigmas de Execução

Uma dificuldade crucial na verificação de sistemas poliglota reside em conciliar semânticas de linguagens distintas em uma abstração unificada. Por exemplo, uma plataforma legada de processamento de seguros pode incluir programas em lote COBOL, middleware Java, lógica de front-end em JavaScript e extensões analíticas em Python. Cada linguagem apresenta semânticas únicas para concorrência, tratamento de exceções, mutação de estado e gerenciamento de memória. A verificação formal exige uma abstração consistente entre esses recursos para que os modelos reflitam com precisão o comportamento do sistema de ponta a ponta.

Para alcançar esse objetivo, as equipes de verificação constroem perfis semânticos para cada linguagem, identificando construções que influenciam o fluxo de controle, as transições de estado e a propagação de erros. Esses perfis formam a base para modelos independentes de linguagem, como máquinas de estado estendidas ou estruturas relacionais simbólicas. Trabalho analítico sobre modernização de tecnologia mista Esclarece como as dependências entre linguagens evoluem durante a modernização. Por exemplo, a substituição de rotinas COBOL síncronas por microsserviços assíncronos altera a semântica da comunicação, que deve ser refletida em modelos formais. As equipes de verificação usam raciocínio simbólico, interpretação abstrata e contratos de interface para harmonizar o comportamento. Uma vez estabelecida uma semântica unificada, os provadores de teoremas e os verificadores de modelos operam em um único modelo coerente, permitindo a validação escalável e de ponta a ponta das propriedades de correção.

Particionando grandes bases de código em módulos prontos para verificação

Para manter a viabilidade de sistemas complexos, é necessário decompô-los em segmentos prontos para verificação. Tentar modelar e verificar uma aplicação monolítica inteira de uma só vez resulta em uma explosão de estados incontrolável e obrigações de prova incontroláveis. O escalonamento eficaz requer particionamento baseado em limites arquitetônicos, propriedade de dados, fases de execução ou hierarquias de dependência. Considere um sistema global de controle de manufatura com milhares de programas interagindo. Alguns componentes gerenciam a ingestão de dados de sensores, outros coordenam o manuseio de materiais, enquanto módulos preditivos operam assincronamente em modelos estatísticos. As equipes de verificação devem identificar limites de verificação naturais que isolem unidades de comportamento estáveis.

Informações estáticas do estudo de risco de propagação de falhas Revela onde as dependências são fortemente acopladas e onde a decomposição modular é segura. Com essas informações, os engenheiros particionam a base de código em módulos que podem ser verificados independentemente sob suposições bem definidas. Cada módulo recebe seu próprio modelo de estado, invariantes e garantias temporais. Quando os módulos são remontados em um sistema global, o raciocínio baseado em garantias assegure a correção de toda a arquitetura. Essa abordagem permite que a verificação seja escalável linearmente com o tamanho do sistema, possibilitando a adoção prática em bases de código com milhões de linhas em processo de modernização.

Integração de modelos formais com telemetria operacional real para orientar o escopo da verificação.

A telemetria operacional fornece informações valiosas que ajudam as equipes de verificação a determinar quais comportamentos são críticos para modelar e comprovar. Sistemas legados frequentemente contêm caminhos de código inativos, recursos obsoletos ou estados de erro raramente acionados que aumentam a complexidade do modelo sem melhorar o valor da verificação. A telemetria ajuda a identificar os caminhos mais frequentemente usados, as interações de maior risco e as anomalias recorrentes. Por exemplo, um mecanismo de transações de varejo pode apresentar picos de concorrência raros ou tempestades de tentativas ocasionais sob alta carga sazonal. A telemetria identifica essas condições para que os modelos de verificação incorporem comportamentos relevantes, abstraindo com segurança caminhos inacessíveis ou de baixo valor.

Estudos sobre análise de impacto guiada por telemetria Demonstrar como dados comportamentais reais aprimoram o planejamento da modernização. As equipes de verificação aplicam técnicas semelhantes, correlacionando insights de telemetria com modelos formais. Por exemplo, se a telemetria identificar um padrão recorrente de impasse sob distribuições de dados específicas, os modelos formais incorporam esses estados e os avaliam rigorosamente. Por outro lado, se a telemetria indicar que um caminho de fallback legado não é executado há anos devido a uma lógica de negócios obsoleta, esse caminho pode ser abstraído. Essa sinergia garante que a verificação permaneça focada, escalável e alinhada aos riscos operacionais reais durante a modernização.

Garantir a continuidade da verificação em ambientes híbridos, legados e modernos.

A modernização introduz ambientes híbridos onde componentes legados operam juntamente com microsserviços modernos, plataformas em nuvem e arquiteturas orientadas a eventos. Garantir a continuidade da verificação nessas topologias mistas é um dos aspectos mais desafiadores do raciocínio formal em escala empresarial. Cada ambiente impõe diferentes regras de temporização, mecanismos de comunicação e garantias de consistência. Um sistema que antes operava em ciclos de processamento em lote previsíveis agora pode depender de eventos assíncronos, caches distribuídos e comportamentos de escalonamento automático que introduzem não determinismo.

As equipes de verificação constroem modelos de ponte que unificam a semântica legada com as características modernas de tempo de execução. Estudos analíticos sobre redução de riscos por meio da simplificação de dependências Demonstre como a simplificação das dependências melhora a resiliência do sistema. Insights semelhantes informam os limites da verificação, identificando onde as mudanças de modernização introduzem novas condições de temporização ou ordenação. Os modelos formais combinam então restrições legadas, como leituras determinísticas de arquivos, com construções modernas, como consistência eventual ou chegada assíncrona de mensagens. Essa modelagem híbrida garante que a verificação permaneça válida ao longo dos estágios de transição. À medida que a modernização progride, os modelos verificados evoluem iterativamente, preservando as garantias de correção mesmo quando os ambientes de execução mudam drasticamente.

Certificação, conformidade e trilhas de auditoria com evidências formais para sistemas críticos.

Os sistemas de certificação para aviação, defesa, energia, finanças e infraestrutura pública exigem evidências determinísticas de que os sistemas críticos se comportam corretamente em todas as condições autorizadas. Os testes tradicionais oferecem cobertura parcial que não consegue satisfazer esses rigorosos requisitos de garantia. A verificação formal preenche essa lacuna, fornecendo garantias matematicamente fundamentadas de que as propriedades de segurança e vivacidade se mantêm em todos os estados alcançáveis. À medida que a modernização transforma os sistemas legados em arquiteturas distribuídas ou orientadas a serviços, os organismos de certificação esperam cada vez mais evidências de alta precisão que demonstrem a equivalência funcional com o comportamento previamente validado. Essa mudança reflete uma tendência mais ampla do setor, na qual a correção deve ser demonstrada continuamente, em vez de reexaminada periodicamente.

Os regimes de conformidade impõem responsabilidades adicionais, exigindo que as organizações acompanhem e documentem como as obrigações de correção evoluem ao longo do tempo. As regulamentações frequentemente exigem artefatos de prova que demonstrem exatamente como as atualizações do sistema, as decisões de refatoração ou as transições arquitetônicas afetam o comportamento operacional. Sem esses artefatos, as organizações correm o risco de lacunas em auditorias ou atrasos na certificação. A capacidade de gerar evidências persistentes e rastreáveis torna-se especialmente importante durante a modernização, onde as premissas legadas, os contratos de interface e as restrições operacionais mudam rapidamente. Orientações analíticas provenientes de estudos de supervisão da governança na modernização Ilustra como a documentação estruturada dá suporte à governança de sistemas a longo prazo. A verificação formal estende essa estrutura ao domínio da correção, produzindo artefatos prontos para auditoria que garantem a conformidade ao longo de todo o ciclo de vida do sistema.

Demonstração das propriedades de segurança para padrões de certificação da indústria

A certificação de segurança exige comprovação de que os sistemas satisfazem invariantes críticos, como saídas limitadas, transições de estado monotônicas ou ausência de estados inseguros. Setores como o da aviação e o de fabricação de dispositivos médicos impõem padrões rigorosos que exigem evidências de propriedades de segurança em todas as condições permitidas. Por exemplo, um subsistema de gerenciamento de voo deve garantir que determinados comandos de controle não produzam comportamento oscilatório ou divergente. Implementações legadas frequentemente se baseiam em invariantes assumidos que nunca foram formalmente documentados. Durante a modernização, essas suposições podem deixar de ser válidas devido a mudanças no tempo de execução, na distribuição de mensagens ou na semântica de escalonamento.