Os ambientes de software corporativo que entrarão em 2026 continuarão a crescer em complexidade estrutural em vez de simplicidade. Décadas de lógica acumulada, linguagens de programação mistas, modelos de implantação híbridos e dependências fortemente acopladas restringem cada vez mais a forma como as mudanças podem ser introduzidas sem consequências indesejadas. Nesse ambiente, as ferramentas de análise estática de código não são mais vistas como verificações de qualidade opcionais, mas como instrumentos fundamentais para entender como os sistemas realmente se comportam antes de qualquer iniciativa de modernização, refatoração ou segurança.

O que diferencia a análise estática de código em escala empresarial das ferramentas voltadas para desenvolvedores não é a capacidade de sinalizar defeitos isolados, mas sim a capacidade de raciocinar sobre toda a infraestrutura de aplicações. Grandes organizações raramente operam dentro de um único padrão de ambiente de execução ou arquitetura. Cargas de trabalho em lote de mainframe coexistem com serviços distribuídos, interfaces legadas se interconectam com APIs nativas da nuvem e requisitos regulatórios impõem restrições adicionais sobre como o risco pode ser medido e mitigado. A análise estática deve, portanto, operar além das fronteiras, expondo caminhos de execução, dependências ocultas e riscos estruturais que, de outra forma, seriam invisíveis apenas por meio de testes.

SMART TS XL

Solução ideal de análise de código estático para empresas com grandes sistemas e ativos distribuídos

Explore agoraA crescente ênfase na entrega contínua e na modernização acelerada elevou ainda mais o papel da análise de dados. À medida que as empresas buscam soluções mais abrangentes, modernização de aplicativos Em iniciativas como essa, o custo da compreensão incompleta torna-se cada vez mais evidente. Decisões de refatoração tomadas sem visibilidade completa do fluxo de controle, da propagação de dados ou do acoplamento entre sistemas frequentemente introduzem instabilidade, regressões de desempenho ou vulnerabilidades de conformidade que só vêm à tona após a implementação. Espera-se que as ferramentas de análise estática de código reduzam essa incerteza, fornecendo clareza arquitetural antes da execução das alterações.

Nesse contexto, os critérios usados para avaliar ferramentas de análise estática de código em 2026 estão mudando. A precisão por si só não é suficiente. As empresas exigem análises aprofundadas, escalabilidade para milhões de linhas de código, suporte a ambientes heterogêneos e a capacidade de traduzir descobertas técnicas em insights acionáveis para arquitetos, líderes de plataforma e responsáveis pela gestão de riscos. A comparação a seguir examina o desempenho das principais ferramentas de análise estática de código para empresas em relação a essas demandas em constante evolução e como seus recursos se alinham com a realidade de sistemas de missão crítica em larga escala.

Comparação e classificação de ferramentas de análise estática de código empresarial para 2026

A comparação abaixo avalia as principais ferramentas de análise estática de código com base em critérios relevantes para ambientes corporativos de grande escala, em vez de equipes de desenvolvimento individuais. Cada ferramenta é avaliada considerando a profundidade da análise, a escalabilidade em sistemas heterogêneos, o suporte a plataformas legadas e modernas e sua capacidade de revelar insights significativos a partir de estruturas de dependência complexas. A classificação reflete a eficácia com que essas ferramentas possibilitam a compreensão da arquitetura, a identificação de riscos e a tomada de decisões informadas em ambientes onde mudanças acarretam consequências operacionais e regulatórias significativas.

SMART TS XL

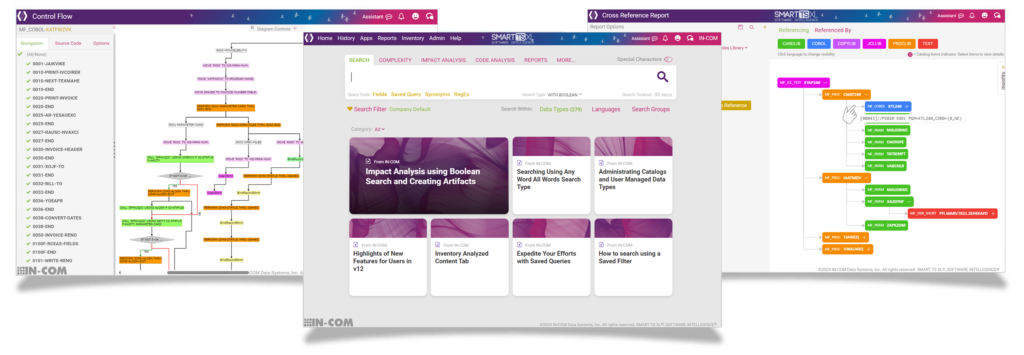

SMART TS XL é uma plataforma empresarial de análise estática de código, avaliação de impacto e inteligência de aplicações, projetada para grandes ambientes de software heterogêneos. Ela foi criada para dar suporte a organizações que operam em ambientes mainframe, midrange e distribuídos, onde décadas de lógica acumulada, processamento em lote e dependências entre plataformas tornam as mudanças inerentemente arriscadas. Em vez de se concentrar em descobertas isoladas sobre a qualidade do código, SMART TS XL Foi concebido para expor o comportamento real das aplicações, tornando visíveis os caminhos de execução, as relações de dados e as estruturas de dependência em portfólios inteiros.

A plataforma opera como um sistema web de alto desempenho, capaz de indexar e analisar bilhões de linhas de código e artefatos associados em segundos. Ao descarregar as cargas de trabalho de análise dos sistemas de produção e centralizar as informações em um ambiente compartilhado, SMART TS XL Suporta milhares de usuários simultâneos sem perda de desempenho. Essa escalabilidade o torna adequado não apenas para equipes de desenvolvimento, mas também para arquitetos, líderes de modernização, suporte à produção, auditoria e responsáveis pela conformidade que necessitam de visibilidade consistente e baseada em evidências de sistemas complexos. Solicite uma Demonstração.

Análise e Descoberta Estática em Escala Empresarial

Em sua essência, SMART TS XL Oferece análise estática profunda em um amplo conjunto de linguagens de programação, estruturas de controle de tarefas, bancos de dados e artefatos de suporte. Suporta tecnologias legadas e modernas, incluindo COBOL, PL/I, Natural, RPG, Assembler, Java, C#, Python, VB6, scripts UNIX, JCL, PROCs, artefatos CICS, definições MQ, esquemas de banco de dados e documentos estruturados. Código-fonte, lógica de lote, arquivos de configuração e até mesmo artefatos que não são código, como documentação e diagramas, podem ser indexados e analisados em conjunto, permitindo a descoberta de relações entre repositórios tradicionalmente isolados.

Essa capacidade de descoberta unificada permite que as organizações avancem além da inspeção em nível de arquivo e alcancem uma compreensão em nível de sistema. Programas, tarefas, campos, arquivos, tabelas e mensagens podem ser rastreados em todas as plataformas, revelando como a lógica de negócios flui por meio de cadeias de lotes, transações online e processos de geração de relatórios subsequentes. Esses relacionamentos são apresentados por meio de relatórios interativos de referência cruzada, mapas de dependência e visualizações de execução navegáveis, em vez de listas estáticas.

Análise de impacto multiplataforma e mapeamento de dependências

SMART TS XL Dá-se especial ênfase à análise de impacto multiplataforma. As alterações introduzidas numa parte de uma aplicação raramente permanecem isoladas em ambientes empresariais, especialmente onde as cargas de trabalho do mainframe interagem com serviços distribuídos e armazenamentos de dados partilhados. SMART TS XL Analisa relações de chamadas, uso de dados, caminhos de execução de tarefas e fluxo de controle para identificar zonas de impacto a montante e a jusante em diferentes linguagens e sistemas.

Os recursos de mapeamento de dependências apresentam essas relações visualmente usando diagramas interativos com código de cores que destacam quem chama, quem recebe a chamada, quem produz e quem consome dados. A análise de impacto pode ser iniciada a partir de um programa, um campo, um elemento de banco de dados, uma etapa de trabalho ou até mesmo dos resultados de pesquisa, permitindo que as equipes definam o escopo das mudanças com precisão antes do início do desenvolvimento. Essa abordagem reduz dependências não identificadas, limita o excesso de testes e fornece uma base sólida para o planejamento de mudanças e a avaliação de riscos.

Visões orientadas à execução da lógica de lote e de programa

Para ambientes com processamento em lote complexo, SMART TS XL Oferece compreensão em tempo de execução sem a necessidade de executar código. Os recursos de expansão de COBOL e JCL resolvem copybooks, PROCs, símbolos e sobrescritas para apresentar a lógica conforme ela é executada em produção. Cadeias de lotes podem ser rastreadas de ponta a ponta, revelando quais programas são executados, em que ordem e com quais parâmetros.

Os diagramas de fluxo de controle e os fluxogramas traduzem lógicas complexas em representações visuais navegáveis. Essas visualizações permitem compreender o comportamento da execução, identificar caminhos de código inativos ou inacessíveis e analisar a complexidade de ramificações sem depender de conhecimento tácito ou inspeções manuais. Os diagramas de rastreamento de campos ampliam ainda mais essa capacidade, rastreando como os elementos de dados são criados, transformados e propagados entre programas, tarefas e bancos de dados, auxiliando em mudanças estruturais seguras e revisões regulatórias.

Busca avançada, detecção de padrões e análise de precisão.

SMART TS XL Inclui um mecanismo de busca empresarial de alto desempenho otimizado para grandes bases de código com tecnologias mistas. Ele suporta lógica booleana complexa, buscas por proximidade, buscas em bloco, expressões regulares, tratamento de sinônimos e filtros refinados que restringem a análise a linguagens, tipos de dados ou seções de código específicos. Técnicas de busca em camadas permitem que os usuários reduzam progressivamente grandes conjuntos de resultados a escopos precisos, adequados para análises de impacto, auditorias ou avaliações de modernização.

Essas funcionalidades de busca estão intimamente integradas com funções de referência cruzada, impacto, complexidade e visualização. Os resultados podem ser diretamente incorporados em visualizações de dependência, relatórios ou fluxos de trabalho de análise adicionais, reduzindo o atrito entre a descoberta e a tomada de decisão. Consultas salvas e parametrizadas permitem que as organizações padronizem as verificações de risco e os padrões de análise repetíveis entre equipes e projetos.

Análise de complexidade e quantificação de riscos

SMART TS XL Oferece análises de complexidade em nível de portfólio que vão além de programas individuais. Métricas de complexidade, como linhas de código, complexidade ciclomática e medidas de Halstead, podem ser calculadas em subconjuntos específicos de aplicações definidos por resultados de pesquisa ou zonas de impacto. Isso permite que as equipes quantifiquem o risco técnico em funções de negócios específicas ou candidatos à modernização, em vez de depender de médias genéricas para toda a aplicação.

Ao combinar métricas de complexidade com análise de dependência e impacto, SMART TS XL Permite uma estimativa e priorização de esforços mais realistas. Áreas com alto acoplamento e alta complexidade podem ser identificadas precocemente, possibilitando que as iniciativas de modernização e remediação sejam sequenciadas com base no risco estrutural real, em vez de suposições.

Transferência de conhecimento, preparação para auditorias e apoio à governança

Um desafio recorrente em grandes empresas é a perda de conhecimento institucional à medida que os sistemas envelhecem e os funcionários experientes se aposentam ou mudam de função. SMART TS XL Isso é resolvido centralizando o conhecimento da aplicação em uma plataforma pesquisável e explorável que captura como os sistemas são estruturados e como se comportam. Documentação, relatórios, diagramas e artefatos de evidência podem ser gerados e compartilhados para dar suporte à integração, auditorias e solicitações regulatórias.

Os recursos de exportação permitem que os resultados das análises sejam agrupados em artefatos com registro de data e hora, prontos para serem utilizados como evidência em revisões de conformidade, aprovações de alterações e auditorias externas. Os controles de acesso e o rastreamento de uso atendem aos requisitos de governança, principalmente em ambientes com desenvolvimento offshore ou modelos de manutenção terceirizada.

Implantação, integração e adequação operacional

SMART TS XL É projetado para implantação rápida e mínima interrupção operacional. As instalações podem ser concluídas em poucas horas, com conectores disponíveis para ingestão de dados de ambientes mainframe, sistemas de controle de versão distribuídos, bancos de dados e repositórios compartilhados. Suporta cargas de dados completas e incrementais, permitindo que os ambientes permaneçam atualizados sem a necessidade de intervenção manual constante.

Os recursos de automação permitem que os processos de análise sejam executados sem supervisão, oferecendo suporte à geração contínua de insights alinhados aos ciclos de mudança da empresa. Ao centralizar a análise em uma infraestrutura de baixo custo, as organizações podem reduzir a dependência de recursos de produção dispendiosos, ao mesmo tempo que aumentam a profundidade analítica e a disponibilidade para todas as equipes.

SonarQube Enterprise Edition

O SonarQube Enterprise Edition é uma plataforma de análise estática de código projetada para dar suporte a grandes organizações de desenvolvimento que buscam a aplicação consistente de padrões de qualidade, manutenibilidade e segurança de código em portfólios de software modernos. Sua principal função em ambientes corporativos é atuar como uma camada de inspeção contínua incorporada aos fluxos de trabalho de desenvolvimento, fornecendo feedback antecipado sobre problemas no código antes que as alterações cheguem à produção. Em portfólios onde a capacidade de revisão se torna um gargalo, ele geralmente é posicionado ao lado de ferramentas mais abrangentes de análise estática de código. ferramentas de revisão de código Formalizar os controles de qualidade e reduzir a variação entre as equipes.

Ao contrário das plataformas de análise de portfólio, o ponto forte do SonarQube reside na sua capacidade de operar próximo ao fluxo de trabalho do desenvolvedor. A análise é normalmente acionada como parte dos pipelines de build ou da validação de pull requests, permitindo que as equipes detectem problemas de código, bugs e questões de segurança de forma incremental à medida que o código evolui. Isso está alinhado com organizações que padronizam verificações automatizadas em seus pipelines de entrega, incluindo as abordagens descritas em [referências/referências]. Pipelines de CI / CD, onde a análise estática se torna um controle repetível em vez de uma etapa de revisão ad hoc.

Análise Estática Baseada em Regras e Portões de Qualidade

No núcleo do SonarQube Enterprise Edition está um mecanismo de análise estática baseado em regras que avalia o código-fonte em relação a um conjunto de regras amplo e configurável. Essas regras abrangem categorias comuns, como problemas de manutenção, defeitos de confiabilidade e vulnerabilidades de segurança. Os resultados são classificados por gravidade e mapeados para pontos de controle de qualidade que determinam se o código pode prosseguir no pipeline de entrega.

Os portões de qualidade são um mecanismo central para garantir a aplicação de padrões organizacionais em larga escala. As empresas podem definir limites para a cobertura de novo código, densidade de defeitos e exposição a vulnerabilidades, assegurando que as alterações atendam a critérios predefinidos antes da integração. Essa capacidade é particularmente valiosa em ambientes com equipes distribuídas, desenvolvimento terceirizado ou alta rotatividade de desenvolvedores, onde a aplicação consistente desses critérios reduz a dependência de revisões manuais.

Cobertura linguística e integração do ecossistema de desenvolvimento

O SonarQube oferece suporte a um amplo conjunto de linguagens de programação modernas, incluindo Java, C#, JavaScript, TypeScript, Python e outras comumente usadas no desenvolvimento de aplicações corporativas. Seu ecossistema de plugins e integrações permite a conexão com plataformas populares de CI/CD, sistemas de controle de versão e rastreadores de problemas. Essa integração robusta o torna ideal para organizações que priorizam o controle de qualidade automatizado como parte de seus fluxos de entrega.

No entanto, o modelo de análise do SonarQube é essencialmente centrado na fonte e no escopo do repositório. Embora possa analisar vários projetos em paralelo, sua compreensão das relações entre repositórios, plataformas e contextos de execução é limitada. A análise geralmente se restringe a aplicativos ou serviços individuais, em vez de abranger ambientes corporativos inteiros com dados compartilhados, fluxos de trabalho em lote ou dependências entre plataformas.

Análise de segurança e suporte à conformidade

Em suas edições corporativas, o SonarQube inclui recursos aprimorados de análise de segurança alinhados a categorias comuns de vulnerabilidades. Ele pode identificar padrões associados a falhas de injeção, configurações inseguras e uso indevido de APIs. Os resultados são apresentados em um formato acessível tanto para desenvolvedores quanto para equipes de segurança, facilitando os fluxos de trabalho de correção dentro das ferramentas existentes.

Do ponto de vista da conformidade, o SonarQube oferece rastreabilidade e relatórios que ajudam a demonstrar a adesão aos padrões de codificação internos e às políticas de segurança. Relatórios podem ser gerados para mostrar tendências de problemas, progresso na correção e conformidade com os critérios de qualidade ao longo do tempo. Embora esses recursos auxiliem na preparação para auditorias dentro das equipes de desenvolvimento, eles são menos focados em produzir evidências em nível de sistema sobre o comportamento de execução ou o impacto entre sistemas.

Características de escalabilidade e considerações operacionais

O SonarQube Enterprise Edition foi projetado para escalar em um grande número de repositórios e equipes de desenvolvimento, especialmente quando implantado em ambientes distribuídos ou conteinerizados. Seu desempenho se adapta à infraestrutura disponível, tornando-o adequado para organizações com alto volume de commits e ciclos de análise frequentes. Painéis centralizados fornecem visibilidade agregada de todos os projetos, ajudando a liderança a monitorar as tendências de qualidade em alto nível.

Dito isso, a escalabilidade do SonarQube é principalmente horizontal entre projetos, e não vertical em relação à complexidade do sistema. Ele não resolve caminhos de execução em tempo de execução, lógica de orquestração de lotes ou linhagem de dados complexa em plataformas heterogêneas. Em ambientes dominados por cargas de trabalho de mainframe, agendamento de lotes ou sistemas legados fortemente acoplados, o SonarQube é frequentemente usado como uma ferramenta complementar, e não como uma fonte independente de insights arquitetônicos.

Casos de uso e limitações típicos em empresas

O SonarQube Enterprise Edition é mais eficaz em empresas com alta maturidade em DevOps, stacks de desenvolvimento padronizadas e foco na prevenção da degradação da qualidade em código em desenvolvimento ativo. Ele se destaca na promoção da consistência, na redução de problemas de código e na integração de verificações de qualidade em pipelines de entrega ágeis.

Suas limitações tornam-se mais evidentes em cenários de modernização que exigem a compreensão de como as mudanças se propagam por sistemas grandes e interconectados. O SonarQube não tenta modelar a ordem de execução, a propagação de dados entre tarefas e plataformas ou as cadeias de dependência em todo o sistema. Como resultado, ele costuma ser usado em conjunto com plataformas de análise mais aprofundadas quando as empresas precisam avaliar o risco da modernização, o impacto em lotes ou os efeitos das mudanças em todo o portfólio.

Checkmarx Um

Checkmarx One é uma plataforma de segurança de aplicações voltada para empresas, centrada em testes estáticos de segurança de aplicações dentro de fluxos de desenvolvimento e entrega modernos. Seu principal papel em grandes organizações é identificar vulnerabilidades de segurança no início do ciclo de vida do software, particularmente em ambientes onde lançamentos frequentes, equipes distribuídas e arquiteturas nativas da nuvem aumentam a exposição a falhas exploráveis. Em vez de tentar modelar o comportamento de execução em todo o sistema, o Checkmarx One concentra-se na detecção de padrões de codificação inseguros e fragilidades de configuração que se alinham com taxonomias de segurança reconhecidas.

A plataforma é normalmente adotada por empresas com práticas DevSecOps consolidadas, onde a análise de segurança deve operar continuamente em conjunto com o desenvolvimento, em vez de ser um controle pós-lançamento. Nesses ambientes, o Checkmarx One funciona como um mecanismo preventivo, visando reduzir a probabilidade de que caminhos de código vulneráveis sejam introduzidos em sistemas de produção.

Foco em testes estáticos de segurança de aplicações

No núcleo do Checkmarx One está um mecanismo de teste de segurança de aplicações estáticas otimizado para detectar vulnerabilidades no nível do código-fonte. A análise é realizada sem a execução das aplicações, permitindo a identificação precoce de problemas, frequentemente durante as fases de commit ou build do código. A plataforma mapeia as descobertas para categorias de vulnerabilidades conhecidas, auxiliando equipes de segurança que utilizam frameworks padronizados de classificação de riscos, como o [nome do framework]. Vulnerabilidades OWASP Priorizar os esforços de remediação.

A ênfase em descobertas específicas de segurança diferencia o Checkmarx One das ferramentas de análise estática de uso geral. Em vez de destacar problemas de manutenção ou arquitetura, a plataforma concentra-se em vulnerabilidades que podem levar à exposição de dados, acesso não autorizado ou escalonamento de privilégios. Essa especialização a torna particularmente relevante em setores regulamentados, onde a divulgação de vulnerabilidades e os prazos de correção são rigorosamente monitorados.

Integração em pipelines DevSecOps corporativos

O Checkmarx One foi projetado para se integrar perfeitamente aos pipelines de CI/CD e aos fluxos de trabalho dos desenvolvedores. As varreduras podem ser acionadas automaticamente como parte dos processos de build, pull requests ou etapas de lançamento, garantindo que a análise de segurança ocorra de forma consistente e sem intervenção manual. Os resultados são apresentados em dashboards e integrações com sistemas de rastreamento de problemas, permitindo que as descobertas sejam encaminhadas diretamente às equipes de desenvolvimento para correção.

Este modelo operacional centrado em pipelines suporta alta velocidade de desenvolvimento, mantendo um nível básico de garantia de segurança. No entanto, o foco em repositórios e serviços individuais significa que a análise geralmente se limita a bases de código discretas. Embora isso esteja alinhado com microsserviços e arquiteturas modulares, limita a visibilidade das dependências entre aplicações ou das cadeias de execução multiplataforma comuns em sistemas empresariais de longa duração.

Cobertura de idiomas e orientação nativa da nuvem

O Checkmarx One oferece suporte a uma ampla gama de linguagens de programação e frameworks modernos comumente usados no desenvolvimento corporativo e nativo em nuvem. Essa abrangência permite a realização de varreduras de segurança consistentes em equipes de desenvolvimento heterogêneas, sem a necessidade de múltiplas ferramentas especializadas. O modelo de entrega nativo em nuvem da plataforma simplifica ainda mais a implantação e o escalonamento, reduzindo a sobrecarga operacional para organizações que gerenciam um grande número de aplicações.

Dito isso, o suporte para tecnologias legadas e ambientes orientados a lotes é mais limitado. Linguagens de mainframe, estruturas de controle de tarefas e fluxos de trabalho legados fortemente acoplados geralmente estão fora do escopo principal da plataforma. Como resultado, o Checkmarx One costuma ser implementado juntamente com outras ferramentas de análise quando as empresas precisam proteger componentes modernos e legados no mesmo ambiente de aplicativos.

Alinhamento entre Relatórios de Risco e Governança

Do ponto de vista da governança, o Checkmarx One oferece recursos de geração de relatórios que auxiliam no rastreamento de vulnerabilidades, no acompanhamento do status de correção e na elaboração de relatórios de conformidade. Os líderes de segurança podem monitorar tendências em diferentes aplicações, equipes e períodos, demonstrando a adesão às políticas internas e às expectativas regulatórias externas. Os resultados podem ser agregados para apresentar o perfil de risco geral, permitindo a priorização em nível de portfólio.

No entanto, esses relatórios se concentram na presença da vulnerabilidade, e não no impacto operacional. A plataforma não tenta quantificar como uma vulnerabilidade se propaga pelos caminhos de execução ou como ela interage com o processamento em lote, fluxos de dados ou sistemas subsequentes. Essa distinção é importante em empresas onde a compreensão do raio de impacto e do risco sistêmico é tão crucial quanto a identificação de vulnerabilidades individuais.

Casos de uso e restrições típicas em empresas

O Checkmarx One é mais eficaz em empresas que buscam incorporar controles de segurança diretamente em ambientes de desenvolvimento dinâmicos. Ele se destaca na identificação precoce de problemas de segurança no código, reduzindo retrabalho e oferecendo suporte ao gerenciamento consistente de vulnerabilidades em grandes equipes de desenvolvedores. Para organizações que estão se modernizando para arquiteturas nativas da nuvem, ele fornece um mecanismo escalável para reforçar as práticas de segurança.

Suas limitações surgem em cenários que exigem uma compreensão holística do comportamento do aplicativo, das cadeias de dependência ou do impacto da modernização em sistemas heterogêneos. Nesses casos, o Checkmarx One geralmente se posiciona como uma camada de segurança especializada, em vez de uma plataforma de análise abrangente, complementando ferramentas que se concentram em insights de execução, mapeamento de dependências e avaliação de riscos estruturais.

Fortify Analisador de Código Estático

O Fortify Static Code Analyzer é uma plataforma de testes estáticos de segurança de aplicações de nível empresarial, projetada para identificar vulnerabilidades de segurança em grandes ambientes de software regulamentados. Sua principal função em empresas é fornecer detecção sistemática de padrões de codificação que introduzem riscos de segurança, especialmente em organizações onde a conformidade, a auditabilidade e os processos formais de gestão de riscos moldam a forma como as alterações de software são governadas. O Fortify é comumente adotado em setores onde a garantia de segurança deve ser demonstrável, repetível e alinhada aos controles empresariais estabelecidos.

Em vez de enfatizar os ciclos de feedback centrados no desenvolvedor, o Fortify é frequentemente posicionado como um controle de segurança centralizado dentro de estruturas de governança mais amplas. Ele oferece suporte a organizações que exigem classificação padronizada de vulnerabilidades, relatórios consistentes e rastreabilidade em grandes portfólios de aplicativos desenvolvidos por equipes distribuídas ou terceirizadas.

Motor de análise estática com foco em segurança

No núcleo do Fortify Static Code Analyzer está um mecanismo de análise focado em segurança que inspeciona o código-fonte para identificar vulnerabilidades sem executar os aplicativos. O mecanismo aplica um conjunto abrangente de regras de segurança projetadas para detectar fragilidades como falhas de injeção, manipulação insegura de dados, erros de autenticação e uso inadequado de funções criptográficas. As descobertas são categorizadas por gravidade e tipo, permitindo que as equipes de segurança avaliem o risco de forma estruturada e consistente.

A ênfase na correção de segurança diferencia o Fortify das ferramentas de análise estática de uso geral. A profundidade da análise é ajustada para identificar condições exploráveis, em vez de questões de manutenção ou arquitetura. Essa especialização torna o Fortify particularmente adequado para ambientes onde a detecção de vulnerabilidades é priorizada em relação a uma compreensão mais ampla do sistema.

Alinhamento com os Programas de Risco e Conformidade Empresarial

O Fortify é frequentemente integrado a programas de segurança e governança corporativa, onde o risco de software é gerenciado juntamente com outros riscos operacionais e regulatórios. Seus recursos de geração de relatórios e evidências dão suporte a auditorias internas, avaliações externas e revisões regulatórias. Os resultados podem ser agregados entre aplicativos e unidades de negócios, proporcionando à liderança de segurança visibilidade da exposição ao risco em grande escala.

Este alinhamento com o formal Gerenciamento de riscos de TI Os processos tornam o Fortify uma escolha comum em organizações que precisam demonstrar a eficácia contínua dos controles. Os relatórios podem ser usados para mostrar tendências de vulnerabilidades, progresso na remediação e conformidade com as políticas de segurança internas, apoiando a tomada de decisões fundamentadas durante auditorias ou análises de incidentes.

Cobertura de idiomas e características de implantação

O Fortify Static Code Analyzer oferece suporte a uma ampla gama de linguagens de programação comuns em ambientes corporativos, incluindo tanto as modernas plataformas de aplicativos quanto tecnologias legadas selecionadas. Isso permite que as organizações apliquem uma abordagem consistente de análise de segurança em diversas equipes de desenvolvimento e domínios tecnológicos. Os modelos de implantação variam, sendo o Fortify frequentemente instalado localmente ou em ambientes corporativos controlados para atender aos requisitos de residência de dados e segurança.

No entanto, a análise geralmente é realizada no nível da aplicação ou do projeto. Embora o Fortify possa ser dimensionado para diversas aplicações, ele não tenta resolver a ordem de execução, a orquestração de lotes ou os fluxos de dados entre aplicações. Como resultado, sua perspectiva sobre o risco permanece localizada em artefatos de código, em vez de no comportamento de todo o sistema.

Integração em ciclos de vida de desenvolvimento seguro

O Fortify é normalmente integrado aos ciclos de desenvolvimento seguro como um mecanismo de controle, em vez de uma ferramenta de exploração contínua. As varreduras podem ser acionadas em estágios definidos, como revisões pré-lançamento, janelas de grandes alterações ou pontos de verificação de conformidade. Esse modelo operacional está alinhado com organizações que priorizam processos de lançamento controlado e aprovações formais em detrimento da implantação contínua.

Embora haja integração com ferramentas de CI/CD, os padrões de uso do Fortify geralmente refletem um equilíbrio entre automação e supervisão centralizada. As constatações de segurança são revisadas por equipes especializadas que avaliam os requisitos de correção e as decisões de aceitação de riscos, reforçando a consistência da governança em toda a empresa.

Casos de uso e restrições típicas em empresas

O Fortify Static Code Analyzer é mais eficaz em empresas onde a garantia de segurança, a preparação para auditorias e a conformidade regulatória são os principais fatores de sucesso. Ele oferece uma abordagem estruturada e defensável para identificar vulnerabilidades de segurança no nível do código e demonstrar que os controles necessários para detectá-las e corrigi-las estão em vigor.

Suas limitações tornam-se evidentes em cenários que exigem a compreensão de como as vulnerabilidades interagem com o comportamento de execução, o processamento em lote ou as dependências entre plataformas. O Fortify não modela o comportamento em tempo de execução nem o impacto em todo o sistema, e geralmente é complementado por ferramentas que fornecem uma visão mais aprofundada da estrutura do aplicativo, das cadeias de dependência e do risco de modernização em ambientes heterogêneos.

Destaque do ELENCO

O CAST Highlight é uma plataforma de inteligência de aplicações empresariais e avaliação de portfólio, projetada para fornecer visibilidade de alto nível sobre a qualidade do software, riscos e prontidão para modernização em grandes conjuntos de aplicações. Sua principal função em ambientes empresariais é apoiar a tomada de decisões estratégicas, resumindo características estruturais, indicadores de dívida técnica e sinais de adequação à nuvem, em vez de realizar análises de código profundas e orientadas à execução. O CAST Highlight costuma ser adotado no início de programas de modernização para estabelecer uma compreensão básica da saúde do portfólio.

Diferentemente das ferramentas de análise estática voltadas para desenvolvedores, o CAST Highlight opera em um nível agregado. Ele foi projetado para ajudar arquitetos, gestores de portfólio e líderes de transformação a comparar aplicativos, identificar candidatos à modernização e priorizar os esforços de correção em centenas ou milhares de sistemas.

Análise de Portfólio e Inteligência de Software

No núcleo do CAST Highlight está um mecanismo de análise leve que extrai metadados estruturais do código-fonte e dos artefatos de configuração de aplicativos. Esses dados são normalizados em um modelo analítico comum que permite a avaliação de diversos aplicativos usando critérios consistentes. Métricas relacionadas à qualidade do código, manutenibilidade, exposição à segurança e adequação arquitetural são calculadas e apresentadas por meio de painéis e visualizações comparativas.

Essas capacidades estão alinhadas com um panorama mais amplo. inteligência de software Iniciativas cujo objetivo é transformar artefatos de código bruto em informações prontas para tomada de decisão para partes interessadas que não são desenvolvedoras. Ao abstrair a complexidade em indicadores padronizados, o CAST Highlight permite que as equipes de liderança analisem grandes portfólios sem a necessidade de realizar inspeções detalhadas de código.

Avaliação de prontidão para modernização e adequação à nuvem

O CAST Highlight dá especial ênfase à avaliação de aplicações para modernização e prontidão para migração para a nuvem. Ele avalia fatores como uso de frameworks, padrões de dependência e atualização tecnológica para estimar o esforço e o risco associados à migração de aplicações para plataformas modernas. Os resultados são frequentemente usados para agrupar aplicações em categorias como rehospedagem, refatoração, substituição ou desativação.

Essa abordagem baseada em avaliações auxilia nas atividades iniciais de planejamento e orçamento. As empresas podem usar os resultados do CAST Highlight para criar roteiros de modernização, estimar o escopo da transformação e comunicar os perfis de risco às partes interessadas do negócio. No entanto, a análise é intencionalmente ampla e não busca modelar o comportamento detalhado da execução ou os efeitos colaterais da transformação.

Indicadores de segurança e dívida técnica

Além de sinais de modernização, o CAST Highlight fornece indicadores de alto nível relacionados a vulnerabilidades de segurança e dívida técnica. Esses indicadores são derivados de padrões conhecidos associados ao aumento do custo de manutenção ou à maior exposição a vulnerabilidades. O objetivo não é substituir ferramentas dedicadas de varredura de segurança, mas sim destacar áreas onde uma investigação mais aprofundada pode ser necessária.

Como as conclusões são agregadas, elas são mais adequadas para análises comparativas do que para o planejamento de remediação. Os indicadores de segurança e dívida ajudam as organizações a entender a distribuição relativa de risco em seus portfólios, mas não identificam caminhos de execução específicos, fluxos de dados ou dependências operacionais que seriam impactados por alterações no código.

Escalabilidade e Modelo Operacional

O CAST Highlight foi projetado para escalar com eficiência em portfólios de aplicativos muito grandes. Sua abordagem de análise leve minimiza a sobrecarga de processamento e permite a rápida integração de novos aplicativos. Isso o torna particularmente adequado para empresas que realizam levantamentos abrangentes de seus ambientes de software durante fusões, desinvestimentos ou iniciativas iniciais de modernização.

A contrapartida dessa escalabilidade é a profundidade analítica. O CAST Highlight não resolve gráficos de chamadas, cadeias de execução em lote ou propagação de dados entre plataformas. Consequentemente, ele é frequentemente usado em conjunto com ferramentas de análise mais aprofundadas, quando aplicações específicas ou iniciativas de transformação passam da fase de planejamento para a execução.

Casos de uso e restrições típicas em empresas

O CAST Highlight é mais eficaz em empresas que precisam de uma visão comparativa de alto nível de seus portfólios de aplicativos para apoiar o planejamento estratégico. Ele se destaca na identificação de candidatos à modernização, na estimativa da complexidade da transformação e na comunicação de riscos técnicos para stakeholders não técnicos.

Suas limitações tornam-se evidentes quando as organizações precisam de uma compreensão precisa de como as mudanças afetam o comportamento de execução, as cadeias de dependência ou a estabilidade operacional. O CAST Highlight não fornece a visão em nível de execução necessária para implementar com segurança atividades de refatoração ou modernização, e geralmente é complementado por ferramentas que se concentram em análises de impacto detalhadas e visibilidade comportamental em aplicações selecionadas.

CAST Imaging

O CAST Imaging é uma plataforma de inteligência de aplicações empresariais focada na análise arquitetural e na visualização de dependências estruturais em sistemas de software complexos. Sua principal função em grandes organizações é revelar como as aplicações são montadas, como os componentes interagem e onde o acoplamento estrutural introduz riscos. O CAST Imaging é normalmente utilizado por arquitetos e equipes de modernização que necessitam de uma compreensão sistêmica da estrutura da aplicação antes de planejar iniciativas de refatoração, migração ou decomposição.

Em vez de funcionar como uma ferramenta de inspeção de código ou varredura de segurança, o CAST Imaging enfatiza a compreensão arquitetural. Ele transforma o código-fonte e os artefatos de configuração em modelos navegáveis que ilustram as relações entre componentes, camadas e tecnologias, permitindo que as partes interessadas raciocinem sobre a complexidade em grande escala.

Mapeamento arquitetônico e visualização de dependências

A essência do CAST Imaging reside na sua capacidade de gerar representações arquitetônicas detalhadas de aplicações e portfólios de aplicações. Essas representações incluem diagramas de componentes, mapas de interação e visualizações em camadas que revelam como os módulos se comunicam e dependem uns dos outros. Ao visualizar as relações estruturais, o CAST Imaging permite que as equipes identifiquem acoplamentos fortes, dependências circulares e violações arquitetônicas que são difíceis de detectar por meio de análises em nível de arquivo.

Esses modelos visuais estão em estreita consonância com as práticas centradas em gráficos de dependência, onde a compreensão das interconexões estruturais é essencial para a gestão de riscos em grandes sistemas. O CAST Imaging permite que os usuários naveguem pelas dependências de forma interativa, passando de visões arquitetônicas de alto nível para representações mais detalhadas, conforme necessário.

Cobertura multitecnológica e transversal a diversas aplicações

O CAST Imaging oferece suporte a análises em uma ampla gama de linguagens de programação, frameworks e plataformas comumente encontradas em ambientes corporativos. Essa abrangência permite modelar sistemas heterogêneos compostos por componentes legados, serviços distribuídos e bancos de dados compartilhados. Os recursos de análise entre aplicações permitem que as equipes entendam como os sistemas individuais se encaixam em portfólios maiores e como as mudanças em uma aplicação podem influenciar outras.

No entanto, a análise permanece estrutural em vez de comportamental. O CAST Imaging modela as relações estáticas entre os componentes, mas não simula a ordem de execução, as condições de tempo de execução ou a lógica de agendamento em lote. Como resultado, ele fornece clareza sobre como os sistemas estão conectados, mas não necessariamente sobre como se comportam durante a execução.

Apoio à Modernização e Governança Arquitetural

O CAST Imaging é frequentemente usado para apoiar iniciativas de modernização onde a clareza arquitetônica é um pré-requisito para a mudança. Ao expor violações de princípios arquitetônicos e identificar áreas de acoplamento excessivo, ele ajuda as equipes a planejar estratégias de transformação incremental. Essas informações podem orientar decisões sobre extração de serviços, redesenho de interfaces ou abordagens de migração faseada.

Em contextos de governança, o CAST Imaging também pode ser usado para avaliar a conformidade arquitetural com padrões definidos. Desvios das arquiteturas-alvo podem ser identificados e documentados, auxiliando na supervisão e no planejamento de remediação. Isso o torna valioso para organizações que aplicam controles arquiteturais como parte de seus processos de gestão de mudanças.

Considerações sobre escalabilidade e modelagem de portfólio

A plataforma foi projetada para ser escalável em grandes aplicações e portfólios, gerando modelos arquitetônicos que podem ser compartilhados entre as partes interessadas. Sua abordagem centrada na visualização facilita a análise e a comunicação colaborativas, especialmente ao explicar estruturas complexas para públicos não desenvolvedores.

A contrapartida dessa escalabilidade é a visibilidade limitada da dinâmica operacional. O CAST Imaging não resolve a linhagem de dados em nível de campo, não rastreia fluxos de execução em lote nem quantifica o impacto das alterações em tempo de execução. Para iniciativas que exigem uma delimitação precisa do impacto das alterações ou a validação do comportamento de execução, geralmente são necessárias ferramentas de análise adicionais.

Casos de uso e restrições típicas em empresas

O CAST Imaging é mais eficaz em empresas que precisam entender e racionalizar a arquitetura de aplicativos antes de implementar mudanças significativas. Ele se destaca na revelação da complexidade estrutural, orientando a refatoração arquitetural e apoiando o planejamento de modernização em sistemas heterogêneos.

Suas limitações tornam-se evidentes quando as organizações necessitam de insights em nível de execução, avaliação de impacto ou validação de como as mudanças se propagam pelo comportamento em tempo de execução. O CAST Imaging fornece um mapa estrutural em vez de um projeto operacional, e geralmente é complementado por ferramentas que oferecem análises mais aprofundadas dos caminhos de execução, fluxo de dados e comportamento do sistema.

Análise Estática Veracode

O Veracode Static Analysis é uma plataforma de testes estáticos de segurança de aplicações nativa da nuvem, projetada para incorporar controles de segurança diretamente em processos modernos de entrega de software. Sua principal função em ambientes corporativos é identificar vulnerabilidades de segurança de forma precoce e contínua em grandes volumes de código de aplicação, especialmente em organizações que priorizam ciclos de lançamento rápidos, equipes de desenvolvimento distribuídas e supervisão de segurança centralizada. O Veracode é comumente adotado onde a garantia de segurança precisa ser escalável sem comprometer a velocidade de desenvolvimento.

A plataforma enfatiza a automação e a consistência, posicionando a análise estática como um controle de segurança permanente, em vez de uma atividade de revisão periódica. Esse modelo operacional está alinhado com empresas que padronizaram o uso de ferramentas de desenvolvimento baseadas em nuvem e que necessitam de visibilidade centralizada da postura de segurança de aplicativos em diversas equipes e projetos.

Testes de segurança estáticos de aplicações nativas da nuvem

No núcleo da Análise Estática da Veracode está um mecanismo de varredura de segurança estática fornecido inteiramente como um serviço gerenciado em nuvem. O código-fonte e os binários são enviados para análise, onde são inspecionados em busca de vulnerabilidades como falhas de injeção, manipulação insegura de dados e fragilidades na autenticação. A análise não requer acesso a ambientes de produção, permitindo que as avaliações de segurança sejam realizadas no início do ciclo de vida sem risco operacional.

Essa abordagem nativa da nuvem permite integração rápida e escalabilidade elástica em grandes portfólios. As empresas podem aplicar políticas consistentes de varredura de segurança em centenas de aplicativos sem precisar manter infraestrutura local. Os resultados são normalizados e apresentados por meio de painéis centralizados, auxiliando as equipes de segurança responsáveis pela supervisão de riscos em toda a empresa.

Integração em fluxos de entrega contínua

O Veracode foi projetado para se integrar perfeitamente com pipelines de CI/CD e ferramentas de desenvolvimento. As varreduras podem ser acionadas automaticamente durante as fases de build ou release, e os resultados são retornados em formatos que se integram aos fluxos de trabalho de rastreamento e correção de problemas. Isso suporta um modelo de segurança "shift-left", onde as vulnerabilidades são corrigidas mais perto do ponto de sua introdução.

Na prática, o papel da Veracode nos pipelines é frequentemente coordenado com controles de qualidade e testes mais amplos, incluindo atividades como: testes de regressão de desempenhoPara garantir que a aplicação da segurança não ocorra isoladamente de outros requisitos não funcionais, esse alinhamento ajuda as organizações a equilibrar o rigor da segurança com o desempenho na entrega.

Cobertura linguística e consistência do portfólio

A Análise Estática da Veracode oferece suporte a uma ampla gama de linguagens de programação e frameworks modernos comumente usados no desenvolvimento de aplicações corporativas. Essa abrangência permite que as equipes de segurança apliquem políticas de varredura uniformes em diferentes ambientes de desenvolvimento, reduzindo as lacunas que poderiam surgir entre equipes ou plataformas.

No entanto, o foco da plataforma permanece na varredura de segurança em nível de aplicação. A análise geralmente se restringe a aplicações ou serviços individuais, e os relacionamentos entre aplicações, fluxos de trabalho em lote ou estruturas de dados compartilhadas não são modelados. Como resultado, o Veracode oferece uma cobertura robusta de vulnerabilidades em nível de código, mas uma visão limitada de como essas vulnerabilidades podem se propagar por sistemas interconectados.

Relatórios de risco e visibilidade da governança

A Veracode oferece recursos de geração de relatórios que permitem aos líderes de segurança acompanhar as tendências de vulnerabilidades, o progresso das correções e a conformidade com as políticas em toda a empresa. Os painéis oferecem visualizações em nível de portfólio da exposição ao risco, permitindo a priorização com base na gravidade e no impacto nos negócios. Esses relatórios são frequentemente usados para dar suporte à governança de segurança interna, relatórios executivos e atividades de auditoria de terceiros.

Embora essas funcionalidades apoiem a responsabilização e a supervisão, o foco dos relatórios permanece centrado nas vulnerabilidades. A Veracode não tenta quantificar o impacto operacional, a interrupção do fluxo de execução ou o risco de modernização associado aos esforços de remediação. Essa distinção é importante em ambientes onde as alterações de segurança devem ser avaliadas juntamente com considerações de estabilidade e gerenciamento de mudanças.

Casos de uso e restrições típicas em empresas

A Análise Estática da Veracode é mais eficaz em empresas que operam com alta velocidade de entrega e exigem varredura de segurança centralizada e escalável em todas as suas aplicações modernas. Ela se destaca na aplicação de padrões de segurança consistentes, na redução do tempo de detecção de vulnerabilidades e no suporte a modelos operacionais DevSecOps.

Suas limitações tornam-se evidentes em cenários que exigem um profundo conhecimento do comportamento do sistema, dependências entre aplicações ou processamento em lote legado. O Veracode não oferece insights em nível de execução nem mapeamento de dependências arquiteturais, sendo normalmente posicionado como uma camada de segurança especializada, complementada por ferramentas focadas em análise de impacto, visibilidade de dependências e compreensão de sistemas em escala empresarial.

Coverity (Sinopse)

O Coverity é uma plataforma empresarial de análise estática de código reconhecida por sua capacidade de detectar defeitos complexos em grandes bases de código críticas para o desempenho. Sua principal função em ambientes corporativos é identificar problemas profundos de correção e confiabilidade que são difíceis de detectar apenas por meio de testes, principalmente em sistemas onde falhas acarretam consequências operacionais, de segurança ou financeiras significativas. O Coverity é frequentemente adotado em setores como o automotivo, aeroespacial, de telecomunicações e de software de infraestrutura, onde a precisão na detecção de defeitos e baixas taxas de falsos positivos são essenciais.

Diferentemente das plataformas de análise de portfólio, o Coverity concentra-se na correção do código em grandes bases de código. Ele foi projetado para analisar grandes volumes de código-fonte com eficiência, mantendo um alto nível de rigor analítico, o que o torna adequado para organizações que gerenciam sistemas de longa duração com requisitos de confiabilidade rigorosos.

Detecção de defeitos profundos e análise de precisão

No núcleo do Coverity está um mecanismo de análise estática otimizado para detectar defeitos como corrupção de memória, vazamentos de recursos, problemas de concorrência e erros de lógica. O mecanismo é conhecido por sua capacidade de raciocinar sobre caminhos de controle complexos e cenários de execução que abrangem múltiplas funções e módulos. Essa profundidade de análise permite identificar defeitos que podem se manifestar apenas sob condições específicas de tempo de execução.

A abordagem analítica da Coverity incorpora técnicas avançadas relacionadas a execução simbólicaIsso permite explorar múltiplos caminhos de execução sem executar o código. Essa capacidade contribui para sua reputação de alta precisão e ajuda a reduzir o ruído frequentemente associado à análise estática em larga escala em ambientes corporativos.

Foco no idioma e cobertura direcionada

O Coverity oferece suporte robusto para linguagens comumente usadas em softwares de sistema e sensíveis ao desempenho, incluindo C, C++ e Java. Esse foco o torna particularmente eficaz para analisar componentes de infraestrutura essenciais, sistemas embarcados e serviços de back-end, onde defeitos de baixo nível podem ter um impacto desproporcional.

Embora a plataforma seja escalável para grandes bases de código, sua cobertura de linguagens é mais restrita do que a de algumas ferramentas de análise estática de uso geral. Ela é menos voltada para ambientes corporativos heterogêneos que incluem linguagens de processamento em lote, ambientes de script ou tecnologias específicas de mainframe. Como resultado, o Coverity costuma ser implementado seletivamente em portfólios, visando componentes onde a precisão na detecção de defeitos é mais crítica.

Integração em fluxos de trabalho de desenvolvimento empresarial

O Coverity foi projetado para se integrar aos processos de desenvolvimento corporativo, incluindo pipelines de CI/CD e sistemas centralizados de gerenciamento de defeitos. As varreduras podem ser agendadas ou acionadas automaticamente, e os resultados são encaminhados às equipes de desenvolvimento para correção. A plataforma oferece suporte à análise incremental, permitindo que as equipes se concentrem em problemas recém-introduzidos, mantendo a visibilidade do backlog de defeitos existente.

Em muitas organizações, o Coverity é posicionado como uma ferramenta de controle de garantia de qualidade, em vez de uma ferramenta de exploração contínua. Suas varreduras são frequentemente executadas em marcos definidos, como antes de grandes lançamentos ou durante revisões formais de qualidade. Esse padrão de uso reflete seu papel na imposição de padrões de confiabilidade, em vez de no suporte à iteração rápida.

Escalabilidade e características de desempenho

O Coverity foi projetado para lidar com bases de código muito grandes de forma eficiente, tornando-o adequado para empresas com milhões de linhas de código crítico. Seu desempenho se adapta à infraestrutura disponível, permitindo que as organizações analisem sistemas substanciais sem tempos de análise proibitivos. Painéis centralizados fornecem visibilidade das tendências de defeitos e do progresso da correção em todos os projetos.

No entanto, a escalabilidade do Coverity está focada no volume de código, e não na complexidade do sistema. Ele não tenta modelar dependências entre aplicações, ordem de execução em lote ou linhagem de dados entre plataformas. Suas análises permanecem centradas na detecção de defeitos em bases de código individuais, e não no comportamento de todo o sistema.

Casos de uso e restrições típicas em empresas

O Coverity é mais eficaz em empresas que exigem detecção de defeitos com alta confiabilidade em componentes de software críticos. Ele se destaca na identificação de problemas sutis que podem levar a falhas, vulnerabilidades de segurança ou comportamento imprevisível em produção, principalmente em código de baixo nível ou sensível ao desempenho.

Suas limitações tornam-se evidentes em iniciativas de modernização ou transformação que exigem a compreensão de como as mudanças afetam sistemas interconectados. O Coverity não oferece mapeamento de dependências arquiteturais nem análise de impacto em nível de execução, e geralmente é complementado por ferramentas que se concentram na visibilidade do portfólio, na análise de dependências e na compreensão comportamental em ambientes empresariais heterogêneos.

Parasoft C/C++test e DTP

O Parasoft C/C++test e a Plataforma de Teste de Desenvolvimento (DTP) associada formam uma solução de análise estática e teste de conformidade de nível empresarial, projetada especificamente para ambientes de software críticos para a segurança e altamente regulamentados. Sua principal função em grandes organizações é dar suporte à verificação rigorosa do código em nível de sistema, onde defeitos podem levar a falhas operacionais, não conformidade regulatória ou incidentes de segurança. O Parasoft é comumente adotado em setores como aeroespacial, automotivo, defesa e sistemas industriais, onde o comportamento do software deve ser comprovadamente correto e auditável.

Diferentemente das ferramentas de análise estática de uso geral, o Parasoft enfatiza a conformidade com padrões definidos e objetivos de verificação. A plataforma foi projetada para suportar ambientes onde o desenvolvimento é regido por processos formais, requisitos de certificação e casos de garantia documentados, em vez de iterações rápidas.

Análise Estática Orientada por Padrões e Aplicação da Conformidade

No núcleo do Parasoft C/C++test está um mecanismo de análise estática alinhado com padrões de segurança e codificação da indústria, como MISRA, CERT e diretrizes relacionadas à ISO. O mecanismo avalia o código-fonte com base em conjuntos de regras rigorosas que definem construções aceitáveis, padrões de uso e condições de erro. As violações são categorizadas por gravidade e mapeadas diretamente para os requisitos de conformidade, permitindo que as organizações demonstrem a adesão às práticas de desenvolvimento obrigatórias.

Essa abordagem orientada por padrões está alinhada com ambientes que dependem de verificação formal conceitos em que a correção é definida não apenas pelo comportamento funcional, mas também pela conformidade com as regras prescritas. Os resultados das análises da Parasoft podem ser usados como evidência em processos de certificação e auditoria, reduzindo o esforço de verificação manual.

Suporte linguístico focado e análise aprofundada e direcionada

O Parasoft C/C++test é especificamente otimizado para bases de código C e C++, oferecendo recursos de análise aprofundada para linguagens comumente usadas em software embarcado e de sistema. Essa especialização permite que a plataforma identifique problemas de baixo nível, como uso indevido de memória, erros de ponteiro e defeitos de concorrência, que podem ser particularmente perigosos em contextos críticos de segurança.

Embora essa profundidade seja valiosa dentro do seu domínio específico, ela também limita a aplicabilidade da plataforma em ambientes corporativos mais amplos. A Parasoft não visa fornecer ampla cobertura em diversas linguagens, ambientes de processamento em lote ou sistemas mainframe legados. Consequentemente, ela é normalmente implementada em segmentos específicos de um portfólio corporativo, em vez de como uma solução de análise universal.

Integração com ciclos de desenvolvimento regulamentados

O Parasoft foi projetado para se integrar a ciclos de desenvolvimento estruturados que enfatizam rastreabilidade, documentação e controle de mudanças. Os resultados da análise estática podem ser vinculados a requisitos, casos de teste e sistemas de rastreamento de defeitos por meio do componente DTP, permitindo rastreabilidade de ponta a ponta, da especificação à verificação.

Essa integração suporta modelos de desenvolvimento nos quais as mudanças são introduzidas de forma deliberada e revisadas formalmente. A análise geralmente é realizada em marcos definidos, como antes de submissões de certificação ou lançamentos principais, em vez de continuamente a cada commit. Esse modelo operacional reflete as prioridades de ambientes regulamentados, onde a previsibilidade e a segurança são mais importantes do que a velocidade.

Relatórios, rastreabilidade e preparação para auditoria

A Plataforma de Testes de Desenvolvimento oferece relatórios e análises centralizados para projetos e equipes. Métricas relacionadas ao status de conformidade, tendências de defeitos e cobertura de verificação podem ser agregadas e revisadas pelas partes interessadas em garantia da qualidade e conformidade. Os relatórios são estruturados para dar suporte a atividades de auditoria e certificação, fornecendo evidências documentadas da execução e dos resultados das análises.

No entanto, esses relatórios se concentram na conformidade em nível de código, e não no comportamento de todo o sistema. O Parasoft não modela caminhos de execução entre aplicativos, orquestração em lote ou dependências entre plataformas. Sua rastreabilidade é orientada para requisitos e padrões, e não para a interação em tempo de execução entre componentes.

Casos de uso e restrições típicas em empresas

O Parasoft C/C++test e o DTP são mais eficazes em empresas onde segurança, confiabilidade e conformidade regulatória são preocupações primordiais. Eles fornecem uma estrutura disciplinada para verificar se o código crítico está em conformidade com padrões rigorosos e pode resistir a uma revisão formal.

Suas limitações tornam-se evidentes em ambientes que exigem uma compreensão holística de sistemas grandes e interconectados ou suporte para conjuntos de tecnologias heterogêneas. O Parasoft não foi projetado para fornecer visibilidade em nível de portfólio ou análise de impacto orientada à execução, e geralmente é complementado por ferramentas que se concentram em dependências arquitetônicas, risco de modernização e comportamento do sistema em cenários empresariais complexos.

KlocworkName

Klocwork é uma plataforma empresarial de análise estática de código focada na identificação de defeitos relacionados à segurança, confiabilidade e concorrência em bases de código grandes e complexas. Sua principal função em ambientes corporativos é detectar problemas que possam comprometer a estabilidade ou a segurança do sistema, principalmente em softwares que operam sob alta carga, execução paralela ou condições de tempo de execução restritas. Klocwork é comumente utilizado em setores onde desempenho e correção estão intimamente ligados, incluindo telecomunicações, sistemas embarcados, infraestrutura financeira e serviços de back-end em larga escala.

A plataforma enfatiza a detecção precoce de defeitos por meio de análise estática, permitindo que as organizações identifiquem padrões problemáticos antes que se manifestem como falhas em tempo de execução. O Klocwork é geralmente posicionado como uma ferramenta de garantia de qualidade e segurança, em vez de uma solução de análise para todo o portfólio.

Análise Estática Orientada à Concorrência e à Confiabilidade

No núcleo do Klocwork está um mecanismo de análise estática projetado para identificar defeitos que surgem de cenários de execução complexos. Isso inclui problemas relacionados ao gerenciamento de memória, manipulação de recursos e sincronização. O mecanismo é particularmente eficaz na detecção de defeitos associados à execução paralela, onde interações sutis entre threads podem levar a comportamentos imprevisíveis.

Sua capacidade de analisar caminhos de código concorrentes torna o Klocwork relevante em ambientes onde o software precisa operar de forma confiável sob carga. Os resultados da análise frequentemente incluem descobertas relacionadas a impasses (deadlocks), condições de corrida e construções de sincronização inadequadas. Essas capacidades auxiliam organizações que buscam reduzir a instabilidade causada por defeitos de concorrência difíceis de reproduzir, como... condições da corrida.

Foco na linguagem e domínios sensíveis ao desempenho

O Klocwork oferece suporte robusto para linguagens comumente usadas em softwares de sistema e de desempenho crítico, incluindo C, C++ e Java. Esse foco está alinhado com sua adoção em domínios onde a correção em baixo nível e a eficiência em tempo de execução são cruciais. Ao se concentrar em um conjunto mais restrito de linguagens, a plataforma proporciona uma análise mais profunda para esses ambientes em comparação com ferramentas mais abrangentes e generalizadas.

No entanto, essa especialização também limita sua aplicabilidade em ambientes empresariais heterogêneos. O Klocwork não foi projetado para analisar cargas de trabalho orientadas a lotes, linguagens de mainframe ou ambientes de script de alto nível, comuns em sistemas empresariais de longa duração. Consequentemente, ele costuma ser implementado de forma seletiva, em vez de como uma solução de análise universal.

Integração em fluxos de trabalho de qualidade e segurança corporativos

O Klocwork integra-se aos fluxos de trabalho de desenvolvimento corporativo, incluindo pipelines de CI/CD e sistemas de rastreamento de defeitos. As varreduras podem ser automatizadas e os resultados encaminhados às equipes de desenvolvimento para correção. A plataforma suporta análise incremental, permitindo que as equipes se concentrem em problemas recém-introduzidos, mantendo a visibilidade dos defeitos existentes.

Em muitas organizações, o Klocwork é usado como parte de processos formais de garantia de qualidade. A análise pode ser acionada em etapas importantes, como validação pré-lançamento ou grandes esforços de refatoração. Esse padrão de uso reflete seu papel em garantir confiabilidade e segurança, em vez de dar suporte à exploração arquitetural contínua.

Características de escalabilidade e escopo operacional

O Klocwork foi projetado para escalar em grandes bases de código, permitindo a análise de sistemas substanciais sem sobrecarga excessiva de desempenho. Painéis centralizados fornecem visibilidade das tendências de defeitos e do progresso da correção em todos os projetos. Essas visualizações auxiliam na supervisão da gestão e ajudam as equipes a priorizar ações corretivas com base na gravidade e no impacto.

Apesar de sua escalabilidade em termos de volume de código, o escopo analítico do Klocwork permanece localizado em aplicações ou componentes individuais. Ele não modela dependências entre aplicações, ordem de execução em lote ou linhagem de dados entre plataformas. Suas análises se concentram na correção do código, e não no comportamento de todo o sistema.

Casos de uso e restrições típicas em empresas

O Klocwork é mais eficaz em empresas que exigem detecção de alta confiabilidade de defeitos de concorrência e confiabilidade em softwares críticos para o desempenho. Ele se destaca na descoberta de problemas difíceis de reproduzir por meio de testes e que podem causar falhas intermitentes ou catastróficas em ambientes de produção.

Suas limitações tornam-se evidentes em iniciativas de transformação que exigem uma compreensão holística de portfólios de aplicativos, fluxos de execução ou impacto da modernização. O Klocwork não oferece mapeamento de dependências arquiteturais nem análise de impacto em nível de execução e, normalmente, é complementado por ferramentas que se concentram em uma compreensão mais ampla do sistema e na avaliação de riscos de mudança em ambientes empresariais heterogêneos.

Análise Estática do OpenText DevOps Cloud

O OpenText DevOps Cloud Static Analysis é um recurso de análise estática empresarial oferecido como parte de um conjunto mais amplo de ferramentas DevOps e gerenciamento do ciclo de vida de aplicações. Sua principal função em grandes organizações é fornecer verificações padronizadas de qualidade e segurança de código, alinhadas aos modelos de governança de entrega estabelecidos. Em vez de operar como uma plataforma independente de análise profunda, geralmente é adotado por empresas que priorizam a consolidação do conjunto de ferramentas e a supervisão centralizada dos processos de desenvolvimento, teste e lançamento.

A plataforma é mais comumente usada em ambientes onde a entrega de software deve obedecer a controles formais e onde a integração com ferramentas existentes de ALM, testes e gerenciamento de versões é um requisito fundamental. Seu valor reside na consistência e no alinhamento com a governança, em vez de análises comportamentais ou arquiteturais aprofundadas.

Capacidades de análise estática orientadas a suítes

Em sua essência, o OpenText DevOps Cloud Static Analysis oferece inspeção de código-fonte baseada em regras para identificar problemas de qualidade e vulnerabilidades de segurança. A análise se concentra em categorias comuns de defeitos, violações de padrões de codificação e padrões de vulnerabilidade que podem ser detectados sem a necessidade de executar o aplicativo. Os resultados são normalizados e apresentados em painéis centralizados, juntamente com outras métricas de DevOps.

Essa abordagem orientada a suítes de ferramentas é ideal para organizações que desejam que a análise estática funcione como um componente de uma estrutura mais ampla de controle de entregas. Ao incorporar a análise em uma plataforma integrada, as empresas podem impor padrões básicos entre as equipes sem a necessidade de introduzir ferramentas adicionais em ambientes já complexos.

Integração com a Governança de Entrega Empresarial

Os recursos de análise estática da OpenText estão intimamente integrados a funções mais abrangentes de gerenciamento do ciclo de vida, como rastreamento de requisitos, testes e orquestração de versões. Essa integração permite que os resultados da análise sejam vinculados a itens de trabalho, defeitos e aprovações, garantindo a rastreabilidade em todo o processo de entrega. Para organizações com modelos formais de governança, esse alinhamento simplifica a supervisão e a geração de relatórios.

A plataforma geralmente é posicionada para suportar estruturas mudar a gestão processos em que as modificações de software devem passar por etapas definidas de revisão e aprovação. Os resultados da análise estática tornam-se parte das evidências usadas para avaliar a prontidão para o lançamento, em vez de uma fonte independente de conhecimento técnico.

Foco na Cobertura e Padronização de Idiomas

O OpenText DevOps Cloud Static Analysis oferece suporte a uma variedade de linguagens de programação corporativas comuns, permitindo a aplicação consistente de padrões de codificação em diversas equipes de desenvolvimento. Seu suporte a linguagens é voltado para as principais plataformas de desenvolvimento de aplicativos, em vez de ambientes legados ou de nicho.

Embora essa abrangência favoreça a padronização, a profundidade da análise permanece relativamente superficial em comparação com ferramentas especializadas. A plataforma não tenta modelar caminhos de execução, resolver a lógica de orquestração em lote ou analisar dependências entre aplicações. Suas descobertas são mais adequadas para identificar problemas localizados em bases de código individuais.

Escalabilidade e características operacionais

Projetado para operar como parte de um conjunto de ferramentas entregues na nuvem, o OpenText DevOps Cloud Static Analysis é escalável para múltiplos projetos e equipes, com administração centralizada. Isso o torna ideal para empresas que buscam controles uniformes para grandes equipes de desenvolvedores. O desempenho é escalável com a infraestrutura em nuvem, reduzindo a necessidade de recursos dedicados no local.

No entanto, a escalabilidade, neste contexto, refere-se à abrangência organizacional, e não à profundidade analítica. A plataforma oferece ampla visibilidade entre os projetos, mas insights limitados sobre o comportamento dos sistemas em tempo de execução ou sobre como as mudanças se propagam em ambientes complexos e interconectados.

Casos de uso e restrições típicas em empresas

O OpenText DevOps Cloud Static Analysis é mais eficaz em empresas que valorizam a governança de entrega integrada e controles padronizados em detrimento da exploração técnica aprofundada. Ele oferece suporte a ambientes onde a análise estática é apenas um ponto de verificação entre vários dentro de um processo de lançamento controlado, proporcionando a aplicação consistente dos requisitos básicos de qualidade e segurança.

Suas limitações tornam-se evidentes em cenários que exigem uma compreensão detalhada do comportamento de execução, das cadeias de dependência ou do impacto da modernização em sistemas heterogêneos. A plataforma não fornece a visibilidade comportamental ou a avaliação de impacto necessárias para executar com segurança iniciativas de refatoração ou modernização em larga escala, e geralmente é complementada por ferramentas especializadas em insights de execução e análise multiplataforma.

Tabela de comparação de capacidades da SCA Solutions

| Capacidade | SMART TS XL | SonarQube Ent | Checkmarx Um | Fortificar SCA | Destaque do ELENCO | CAST Imaging | veracode | Cobertura | parasoft | KlocworkName | OpenText |

|---|---|---|---|---|---|---|---|---|---|---|---|

| Escala do portfólio empresarial | ✅ Excelente | ◐ Moderado | ◐ Moderado | ◐ Moderado | ✅ Excelente | ✅ Excelente | ◐ Moderado | ◐ Moderado | ◐ Moderado | ◐ Moderado | ◐ Moderado |

| Multiplataforma (Mainframe + Distribuído) | ✅ Completo | ❌ Não | ❌ Não | ❌ Limitado | ❌ Limitado | ❌ Limitado | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ❌ Limitado |

| Suporte a linguagens legadas (COBOL, JCL, RPG) | ✅ Completo | ❌ Não | ❌ Não | ❌ Limitado | ❌ Limitado | ❌ Limitado | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ❌ Não |

| Análise de dependência entre sistemas | ✅ Completo | ❌ Não | ❌ Não | ❌ Não | ◐ Alto nível | ◐ Estrutural | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ❌ Não |

| Visibilidade do caminho de execução (estática) | ✅ Completo | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ◐ Parcial | ◐ Parcial | ◐ Parcial | ❌ Não |

| Análise de fluxo de lotes e tarefas | ✅ Completo | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ❌ Não |

| Análise de impacto antes da mudança | ✅ Profundo | ◐ Raso | ◐ Somente para segurança | ◐ Somente para segurança | ◐ Portfólio | ◐ Estrutural | ◐ Somente para segurança | ◐ Nível de código | ◐ Nível de código | ◐ Nível de código | ◐ Governança |

| Detecção de vulnerabilidades de segurança (SAST) | ◐ Contextual | ◐ Básico | ✅ Forte | ✅ Forte | ◐ Indicativo | ❌ Não | ✅ Forte | ◐ Limitado | ◐ Limitado | ◐ Limitado | ◐ Básico |

| Análise de desempenho e complexidade | ✅ Profundo | ◐ Métricas | ❌ Não | ❌ Não | ◐ Agregado | ◐ Estrutural | ❌ Não | ◐ Baseado em defeitos | ◐ Conformidade | ◐ Baseado em defeitos | ❌ Não |

| Análise de prontidão para modernização | ✅ Nativo | ❌ Não | ❌ Não | ❌ Não | ✅ Primário | ◐ Estrutural | ❌ Não | ❌ Não | ❌ Não | ❌ Não | ❌ Não |

| Pesquisar em todos os ativos | ✅ Avançado | ◐ Somente repositório | ◐ Somente repositório | ◐ Somente repositório | ◐ Metadados | ◐ Metadados | ◐ Somente repositório | ◐ Somente repositório | ◐ Somente repositório | ◐ Somente repositório | ◐ Somente repositório |

| Integração CI / CD | ◐ Opcional | ✅ Forte | ✅ Forte | ◐ Moderado | ❌ Não | ❌ Não | ✅ Forte | ◐ Moderado | ◐ Moderado | ◐ Moderado | ✅ Nativo |

| Geração de evidências prontas para auditoria | ✅ Nativo | ◐ Limitado | ◐ Limitado | ✅ Forte | ◐ Agregado | ◐ Estrutural | ◐ Limitado | ◐ Limitado | ✅ Forte | ◐ Limitado | ◐ Forte |

Outras ferramentas de análise estática de código (aplicabilidade empresarial limitada)

- ESLint

- Vantagens: Garante a aplicação de padrões de codificação em JavaScript e TypeScript com feedback rápido para desenvolvedores.

- Limitações: Opera em nível de repositório, sem visibilidade do impacto entre sistemas ou em toda a empresa.

- PMD

- Vantagens: Detecta problemas comuns de qualidade de código em diversas linguagens de programação.

- Limitações: A análise baseada em regras é inadequada para grandes empresas com ambientes heterogêneos.

- Floco8

- Vantagens: Análise estática leve para aplicação de sintaxe e estilo em Python.

- Limitações: Não oferece informações sobre arquitetura ou nível de execução.

- Bandido

- Vantagens: Identifica problemas de segurança em código Python usando análise baseada em padrões.

- Limitações: Escopo limitado e nenhuma compreensão das interações do sistema empresarial.

- Código QL

- Vantagens: Análise baseada em consultas capaz de identificar padrões complexos de vulnerabilidade.

- Limitações: Requer conhecimento especializado e carece de modelagem de execução empresarial.

- Semgrep

- Vantagens: Correspondência de padrões rápida e personalizável para verificações de segurança e qualidade.

- Limitações: A abordagem baseada em padrões carece de dependência e contexto comportamental.

- Código Snyk

- Vantagens: Análise estática amigável para desenvolvedores, integrada a fluxos de trabalho nativos da nuvem.

- Limitações: Com foco na segurança em nível de aplicação, em vez de arquitetura empresarial.

- Pilão

- Vantagens: Fornece verificações detalhadas da qualidade do código para projetos Python.

- Limitações: Não foi projetado para análises entre projetos ou multiplataforma.

- Cppverificar

- Vantagens: Análise estática de código aberto para C e C++ com baixas taxas de falsos positivos.

- Limitações: Escalabilidade e suporte à governança empresarial limitados.

- Inferir

- Vantagens: Detecta problemas de memória e concorrência usando técnicas avançadas de análise.

- Limitações: Suporte limitado a idiomas e integração empresarial restrita.

- LGTM

- Vantagens: Combina análise estática com fluxos de trabalho de revisão de código baseados em nuvem.

- Limitações: Centrado no repositório, com visão limitada do sistema como um todo.

- Analisadores FxCop

- Vantagens: Define diretrizes de design e codificação para aplicações .NET.

- Limitações: Não aborda dependências entre aplicações.

- PHPCS

- Vantagens: Garante o cumprimento dos padrões de codificação em projetos PHP.

- Limitações: Focado no estilo, com mínima profundidade analítica.

- SpotBugs

- Vantagens: Identifica padrões de erros comuns em bytecode Java.

- Limitações: Detecção baseada em padrões sem modelagem de trajetória de execução.

- Freio

- Vantagens: Análise de segurança especializada para aplicações Ruby on Rails.

- Limitações: Específico para determinada estrutura e inadequado para análises em toda a empresa.

- Ferramentas de linha de comando do ReSharper

- Vantagens: Integra a análise estática em pipelines de compilação .NET.

- Limitações: Foco na produtividade do desenvolvedor em vez de conhecimento da empresa.

- Fonte profunda

- Vantagens: Revisão de código automatizada e análise de qualidade para repositórios modernos.

- Limitações: Focado em SaaS com profundidade limitada na análise estrutural.

- Codificação

- Vantagens: Relatórios de qualidade centralizados em múltiplos repositórios.

- Limitações: Focado na agregação sem um profundo entendimento do sistema.

- Elevador Sonatype

- Vantagens: Análise de segurança e qualidade integrada aos fluxos de trabalho DevOps.

- Limitações: Visibilidade limitada do comportamento em tempo de execução e de sistemas legados.

- NDepende

- Vantagens: Fornece análise de dependências para aplicações .NET.

- Limitações: Tecnologia específica e inadequada para propriedades heterogêneas.

- Análise Coverity (Código Aberto)

- Vantagens: Análise estática gratuita para projetos de código aberto selecionados.

- Limitações: Não representa cenários de implantação empresarial.

- Verificação de dependência do OWASP

- Vantagens: Identifica dependências vulneráveis conhecidas.

- Limitações: Não analisa o comportamento ou a arquitetura do código-fonte.

- Clipe de ferrugem

- Vantagens: Analisa o código Rust em busca de problemas idiomáticos e erros comuns.

- Limitações: Específico para determinado idioma, sem contexto empresarial.

- GolangCI-Lint

- Vantagens: Agrega vários linters para projetos Go.

- Limitações: Focado no desenvolvedor, sem visão a nível de portfólio.

- SwiftLintName

- Vantagens: Aplica as convenções de codificação Swift em projetos para dispositivos móveis.