O gerenciamento de memória é um aspecto fundamental da programação, essencial para a estabilidade e o desempenho dos aplicativos. Entre os desafios associados ao gerenciamento de memória está o fenômeno de vazamentos de memória, que pode degradar significativamente o desempenho de um aplicativo ou até mesmo fazer com que ele trave. Este artigo se aprofunda no que são vazamentos de memória, suas causas, como podem ser detectados e métodos para preveni-los. Além disso, inclui exemplos práticos de codificação e discute como o uso de SMART TS XL pode aprimorar a detecção, análise e prevenção de vazamentos de memória por meio de análise estática avançada, criação de fluxogramas e melhorias na qualidade do código.

PRECISA CORRIGIR VAZAMENTOS DE MEMÓRIA?

SMART TS XL é a sua solução ideal para detectar vazamentos de memória em milhões de linhas de código

Explore agoraO que são vazamentos de memória?

Um vazamento de memória ocorre quando um programa aloca memória do heap, mas falha em liberá-la de volta quando ela não é mais necessária. Como resultado, a memória não está mais em uso pelo programa, mas não pode ser recuperada pelo sistema operacional ou outros processos. Com o tempo, esses blocos de memória não liberados se acumulam, reduzindo a quantidade de memória disponível, o que pode levar à redução do desempenho e, eventualmente, à falha do programa se o sistema ficar sem memória.

Em linguagens gerenciadas como Java ou C#, o gerenciamento de memória é feito pelo coletor de lixo, que automaticamente recupera a memória que não é mais referenciada. No entanto, mesmo nesses ambientes, vazamentos de memória podem ocorrer se os objetos ainda forem referenciados inadvertidamente, impedindo que o coletor de lixo libere a memória.

Causas de vazamentos de memória

Vazamentos de memória estão entre os problemas mais comuns e insidiosos no desenvolvimento de software, degradando silenciosamente o desempenho e desestabilizando os aplicativos ao longo do tempo. Em sua essência, vazamentos de memória ocorrem quando um programa aloca memória, mas não a libera depois que os dados não são mais necessários. Ao contrário de travamentos ou bugs óbvios, vazamentos geralmente passam despercebidos durante os testes iniciais, manifestando-se apenas após uso prolongado — quando o aplicativo fica lento ou encerra abruptamente devido ao esgotamento dos recursos do sistema.

O impacto de vazamentos de memória pode variar de pequenas ineficiências a falhas catastróficas, especialmente em sistemas de longa duração, como servidores, dispositivos embarcados ou aplicativos móveis. Em casos extremos, vazamentos podem causar lentidão em todo o sistema, forçando os usuários a reinicializar seus dispositivos ou serviços para recuperar memória. Mesmo em linguagens com coleta de lixo, como Java ou Python, onde se espera que o gerenciamento automático de memória cuide da limpeza, erros sutis de programação ainda podem levar a vazamentos por meio de referências persistentes ou recursos não fechados.

Compreender as causas-raiz dos vazamentos de memória é essencial para desenvolvedores de todos os níveis de especialização. Seja trabalhando com linguagens de baixo nível, como C++, que exigem gerenciamento manual de memória, ou linguagens de alto nível com coleta de lixo, os programadores devem adotar práticas disciplinadas para evitar vazamentos. Este artigo explora as fontes mais comuns de vazamentos de memória, oferecendo insights sobre como eles ocorrem e estratégias para mitigá-los. Ao reconhecer essas armadilhas, os desenvolvedores podem escrever códigos mais eficientes, confiáveis e sustentáveis, garantindo que suas aplicações tenham um desempenho ideal ao longo de seu ciclo de vida.

Erros de gerenciamento de memória manual

Em linguagens como C e C++, o gerenciamento de memória é totalmente manual. Isso significa que cada bloco de memória alocada dinamicamente usando malloc, calloc, ou new deve ser explicitamente desalocado com free or deleteUm vazamento de memória ocorre quando os desenvolvedores se esquecem de liberar essa memória depois que ela não é mais necessária. Essas omissões geralmente surgem de fluxos de controle complexos, retornos antecipados ou tratamento de exceções que ignoram chamadas de desalocação. Além da desalocação ausente, a realocação inadequada, como a perda de um ponteiro para a memória alocada antes de liberá-la, também leva à memória irrecuperável. Outra grande armadilha é o uso de ponteiros pendentes, que são referências à memória que já foi liberada. Isso pode resultar em comportamento indefinido ou travamentos difíceis de diagnosticar. Os desenvolvedores devem seguir padrões rígidos de disciplina e revisão de código ao lidar com o gerenciamento manual de memória. Ferramentas como Valgrind, AddressSanitizer e as verificações integradas do Clang são essenciais para ajudar a rastrear alocações e garantir que cada malloc or new tem um correspondente free or delete. Na programação de sistemas críticos, vazamentos de recursos causados por erros manuais de memória podem prejudicar o desempenho ou fazer com que o aplicativo se comporte de maneira imprevisível ao longo do tempo.

Estruturas de dados ilimitadas ou crescentes

Coleções que crescem ao longo do tempo sem limites adequados são uma fonte comum de vazamentos de memória, especialmente em aplicações de longa duração. Estruturas de dados como listas, filas, dicionários e caches são frequentemente usadas para armazenar objetos para processamento temporário ou consulta. Se entradas antigas nunca forem removidas ou expirarem, a estrutura continuará consumindo memória mesmo depois que os dados se tornarem irrelevantes. Por exemplo, um sistema de registro pode anexar todas as mensagens a uma lista que nunca é apagada, ou uma camada de cache pode armazenar resultados de consultas indefinidamente sem nenhuma estratégia de expiração. Em aplicações de alto volume, essas estruturas podem crescer para conter milhares ou milhões de objetos, eventualmente causando condições de falta de memória. Os desenvolvedores devem implementar limites, intervalos de limpeza ou políticas de remoção de dados menos usados recentemente (LRU) para garantir que as estruturas de dados não cresçam sem controle. Em linguagens com coleta de lixo, esse tipo de vazamento é particularmente complicado porque a memória é tecnicamente acessível, portanto, não será coletada. Monitorar o tamanho da coleção e estabelecer controles para eliminar entradas antigas ou não utilizadas ajuda a evitar o aumento lento da memória, que poderia passar despercebido durante o desenvolvimento ou testes em pequena escala.

Referências circulares em linguagens coletadas por lixo

Linguagens com coleta de lixo, como Java, Python e JavaScript, simplificam o gerenciamento de memória, limpando automaticamente objetos inacessíveis. No entanto, referências circulares representam um desafio sutil. Quando dois ou mais objetos se referem um ao outro e não estão mais em uso pela aplicação, suas referências mútuas impedem que o coletor de lixo determine que é seguro removê-los. Embora os coletores de lixo modernos tenham aprimorado sua capacidade de detectar esses ciclos, nem todos os ambientes ou tipos de coletores os manipulam de forma eficaz. Além disso, fechamentos ou lambdas nessas linguagens podem capturar variáveis de escopo pai involuntariamente, o que mantém os objetos vivos além do seu ciclo de vida pretendido. Esse problema frequentemente aparece em aplicações com programação reativa, sistemas de eventos ou grafos de objetos que formam loops estreitos. Interromper esses ciclos manualmente, anulando referências ou usando referências fracas, é a abordagem recomendada. Algumas linguagens também oferecem estruturas de dados especializadas ou gerenciadores de contexto que minimizam o risco de formação de cadeias de referência fortes. Sem atenção a esse detalhe, as referências circulares podem acumular memória silenciosamente, levando à degradação do desempenho e a vazamentos difíceis de rastrear.

Recursos não fechados

Aplicações que interagem com recursos do sistema, como arquivos, conexões de banco de dados, soquetes de rede ou fluxos, devem garantir que esses recursos sejam liberados explicitamente. Ao contrário de objetos comuns que podem ser coletados como lixo, esses recursos geralmente estão vinculados a identificadores do sistema operacional e exigem limpeza manual ou estruturada. Se um arquivo for aberto, mas nunca fechado, ou uma conexão com o banco de dados for deixada travada, ela não apenas consome memória, mas também reserva descritores de arquivo, conexões de soquete ou slots de pool de banco de dados. Com o tempo, isso pode resultar em exaustão de identificadores de arquivo ou bloqueio de pools de conexão. Linguagens de programação modernas frequentemente oferecem construções como try-with-resources em Java, using em C#, ou gerenciadores de contexto em Python para garantir que os recursos sejam fechados mesmo quando ocorrem exceções. Desenvolvedores que ignoram ou ignoram essas construções correm o risco de introduzir vazamentos de recursos silenciosos, porém prejudiciais. Em sistemas grandes, mesmo uma pequena porcentagem de recursos não fechados pode causar problemas em todo o sistema, especialmente quando os aplicativos escalam sob carga simultânea. Rastrear e fechar recursos de forma confiável deve ser uma prática fundamental em todo fluxo de trabalho de desenvolvimento.

Variáveis Estáticas e Globais

Variáveis estáticas e globais são projetadas para persistir durante toda a vida útil de uma aplicação, o que as torna inerentemente arriscadas se não forem gerenciadas com cuidado. Quando essas variáveis contêm objetos grandes, dados temporários ou referências a componentes da interface do usuário ou informações específicas da sessão, elas impedem que o coletor de lixo recupere essa memória mesmo depois que ela não for mais útil. Um cache estático que nunca é limpo ou um serviço global que retém resultados antigos indefinidamente consomem mais memória lentamente ao longo do tempo. Esse problema é especialmente problemático em sistemas que lidam com sessões de usuário, transações ou tarefas em lote, onde diferentes contextos são processados repetidamente. Se o campo estático acumular o estado de cada instância e nunca for redefinido, o custo de memória aumenta com o uso. Os desenvolvedores devem limitar o uso de variáveis estáticas a constantes ou pequenos utilitários que tenham a garantia de permanecer relevantes durante todo o ciclo de vida da aplicação. Se o armazenamento persistente for necessário, mecanismos para aparar ou invalidar periodicamente os valores armazenados devem ser implementados. Auditorias de memória de rotina e criação de perfil também podem ajudar a descobrir crescimentos inesperados de memória causados por referências estáticas com escopo incorreto.

Vazamentos relacionados a tópicos

Aplicações multithread apresentam desafios únicos para o gerenciamento de memória, particularmente em relação ao armazenamento local de threads e threads de longa duração. Quando os dados são armazenados em variáveis locais de threads, mas nunca limpos, os dados permanecem associados à thread enquanto ela existir. Isso se torna um vazamento de memória se a thread persistir por mais tempo do que o necessário ou for reutilizada indefinidamente em um pool de threads. Além disso, threads em segundo plano que estão bloqueadas, em modo de espera ou aguardando eventos podem reter objetos por muito tempo depois de serem necessários. Se uma thread referencia uma classe que deveria ser efêmera, como um objeto de solicitação ou um buffer temporário, essa classe não pode ser coletada até que a thread seja encerrada. Em casos em que as threads são mal gerenciadas ou abandonadas, esses vazamentos persistem silenciosamente e aumentam à medida que o sistema escala. As melhores práticas incluem limpar explicitamente as variáveis locais de threads, garantir que threads de longa execução liberem referências desnecessárias e projetar threads de trabalho para redefinir seu contexto entre as tarefas. Os pools de threads também devem ser monitorados quanto ao tamanho e ao consumo de memória para detectar quando threads ociosas estão retendo mais dados do que o esperado.

Problemas com bibliotecas de terceiros

Nem todos os vazamentos de memória se originam do seu próprio código. Bibliotecas e frameworks, especialmente aqueles que interagem com gráficos, áudio ou hardware externo, podem conter seus próprios vazamentos ou expor APIs que exigem limpeza explícita. Se essas APIs não forem usadas corretamente, como por exemplo, ao não chamar uma dispose() or shutdown() método, os recursos que eles gerenciam permanecerão alocados. Isso é particularmente comum em bibliotecas mais antigas ou em bibliotecas mais novas que abstraem a complexidade, mas não documentam bem os requisitos do ciclo de vida. Em alguns casos, as bibliotecas implementam suas próprias estratégias de cache ou pool de recursos, o que pode reter objetos na memória por mais tempo do que o previsto. Esses caches podem ser ajustáveis ou completamente opacos. Além disso, a integração de uma biblioteca pode inadvertidamente manter referências aos objetos do seu aplicativo — como registrar um retorno de chamada que nunca é removido — o que impede que seus objetos sejam coletados. Os desenvolvedores devem revisar cuidadosamente a documentação de qualquer código de terceiros que incluam e monitorar o uso de memória ao longo do tempo para detectar vazamentos introduzidos pelas bibliotecas. Testar integrações de terceiros sob carga ou usar ferramentas de criação de perfil ajuda a detectar esses problemas precocemente.

Vazamento de identificadores do sistema operacional

Vazamentos de memória não se limitam a alocações de heap. Os aplicativos também dependem fortemente de identificadores do sistema operacional, como descritores de arquivo, identificadores de GUI, soquetes e semáforos. Cada um desses recursos tem um limite finito no nível do sistema. Quando os identificadores não são fechados corretamente, o sistema eventualmente fica sem recursos, mesmo que a memória pareça estar disponível. Por exemplo, não fechar um descritor de arquivo no Linux leva a erros como "Muitos arquivos abertos", que podem interromper serviços inesperadamente. Em ambientes Windows, identificadores de interface gráfica de dispositivo (GDI) vazados podem impedir a renderização de novas janelas ou elementos da IU. Vazamentos de identificadores são particularmente difíceis de diagnosticar porque podem não aparecer em profilers de memória tradicionais. Ferramentas de monitoramento específicas para sua plataforma, como lsof para Unix ou Gerenciador de Tarefas no Windows, pode revelar uso anormal de identificadores. Os desenvolvedores devem auditar suas rotinas de tratamento de recursos cuidadosamente e garantir que cada alocação tenha uma versão correspondente. O uso de padrões RAII ou gerenciadores de recursos com escopo pode ajudar a impor o comportamento correto em sistemas de alto e baixo nível.

Assinaturas de eventos e retornos de chamada

Sistemas orientados a eventos são propensos a vazamentos de memória quando componentes se registram para eventos, mas nunca são desregistrados. Isso é especialmente verdadeiro em aplicações com publicadores de eventos de longa duração, como frameworks de interface do usuário (UI), barramentos de mensagens ou pipelines reativos. Quando um ouvinte é registrado e não removido, o publicador retém uma referência a esse ouvinte, mantendo todo o grafo de objetos ativo. Por exemplo, se um widget de interface do usuário (UI) escuta atualizações de um modelo compartilhado, mas nunca é desregistrado quando removido da tela, o widget permanece na memória. Em aplicações JavaScript, nós DOM anexados a eventos globais são uma causa frequente de vazamentos quando nós são removidos visualmente, mas não desvinculados programaticamente. A solução está no gerenciamento simétrico do ciclo de vida. Cada registro deve ser pareado com um desregistro explícito. Alguns frameworks suportam padrões de eventos fracos ou ganchos de limpeza automática para minimizar a carga sobre os desenvolvedores. No entanto, confiar apenas neles é arriscado, a menos que você confirme seu comportamento durante a desmontagem. Revisões e testes de código devem sempre incluir a verificação de que as assinaturas de eventos foram encerradas corretamente.

Uso indevido do ponteiro inteligente C++

Ponteiros inteligentes C++ como unique_ptr, shared_ptr e weak_ptr são ferramentas poderosas para gerenciamento automatizado de memória, mas, quando mal utilizadas, podem causar vazamentos sutis de memória. Um problema comum surge quando shared_ptr instâncias formam referências circulares. Como ponteiros compartilhados usam contagem de referências para gerenciar tempos de vida, objetos que apontam entre si com propriedade compartilhada nunca atingirão uma contagem de zero, impedindo a desalocação. Esse problema é frequentemente encontrado em estruturas pai-filho ou relacionamentos bidirecionais. Os desenvolvedores devem usar weak_ptr em uma direção para quebrar o ciclo e permitir uma limpeza adequada. Outro problema é a mistura de ponteiros brutos com ponteiros inteligentes. Se ponteiros brutos forem usados para armazenar referências que não são gerenciadas cuidadosamente, os benefícios dos ponteiros inteligentes são reduzidos. Alguns desenvolvedores alocam objetos erroneamente usando new e esquecem de envolvê-los em um ponteiro inteligente, perdendo o controle da propriedade. Seguir os princípios do RAII (Resource Acquisition Is Initialization) é essencial para garantir que os recursos sejam liberados de forma previsível. Ao projetar com a propriedade de ponteiro inteligente em mente e evitar modelos híbridos de gerenciamento de memória, os desenvolvedores podem reduzir significativamente as chances de introduzir vazamentos no código C++ moderno.

Detecção de vazamentos de memória

Vazamentos de memória costumam ser evasivos, pois se acumulam lentamente e nem sempre causam erros imediatos. Ao contrário de travamentos ou bugs de sintaxe, vazamentos podem aparecer somente após horas ou dias de atividade da aplicação, especialmente em sistemas com cargas de trabalho persistentes ou alta simultaneidade. Detectá-los requer uma combinação de observação, instrumentação e ferramentas. Abaixo, apresentamos estratégias práticas e eficazes para identificar vazamentos de memória em aplicações do mundo real.

Monitore o uso da memória ao longo do tempo

Um dos primeiros sinais de vazamento de memória é uma tendência crescente e consistente no uso de memória durante a operação normal. Isso pode ser observado usando ferramentas simples do sistema, como o Gerenciador de Tarefas do Windows. top or htop no Linux ou painéis de orquestração de contêineres em ambientes Kubernetes. O uso de memória deve flutuar com as cargas de trabalho, mas eventualmente se estabilizar. Se continuar a aumentar ao longo do tempo — especialmente durante períodos ociosos ou após tarefas repetitivas — é um forte indicador de que a memória não está sendo liberada. Em sistemas de produção, os gráficos de uso de memória podem ser rastreados usando métricas do sistema ou ferramentas de monitoramento de infraestrutura. Correlacionar picos de uso com eventos específicos do aplicativo ou interações do usuário pode ajudar a restringir a origem do vazamento. A detecção precoce por meio do monitoramento periódico ajuda a prevenir travamentos e degradação do desempenho.

Use perfis de heap e memória

Os profilers de heap são ferramentas essenciais para visualizar o uso de memória e identificar quais objetos estão consumindo espaço na aplicação. Essas ferramentas permitem que os desenvolvedores tirem snapshots da memória em diferentes momentos e os comparem para detectar quais objetos estão aumentando sem serem liberados. Em Java, o VisualVM e o Eclipse Memory Analyzer são comumente usados. Desenvolvedores .NET costumam usar dotMemory ou CLR Profiler, enquanto aplicações C/C++ se beneficiam do Valgrind ou AddressSanitizer. Python oferece ferramentas como objgraph e memory_profilerOs profilers de heap exibem cadeias de referência, tamanhos de memória retidos e árvores de alocação, ajudando a rastrear como a memória está sendo armazenada. Para aplicações complexas, a combinação de snapshots com lógica de filtragem e agrupamento pode destacar áreas problemáticas. Quando usados em conjunto com a depuração ao vivo, os profilers permitem a investigação em tempo real de objetos que permanecem na memória por mais tempo do que o esperado. Essa percepção é crucial para diagnosticar vazamentos lentos que escapam aos logs tradicionais ou às métricas do sistema.

Crescimento de objetos e coleções de log

Registrar o tamanho de estruturas de dados importantes ou pools de objetos ao longo do tempo é uma técnica leve, porém poderosa, para detectar vazamentos durante o desenvolvimento e os testes. Os desenvolvedores podem instrumentar o código para relatar periodicamente o tamanho de coleções, como listas, mapas, filas ou registros de sessão. Em cenários em que se espera que essas estruturas de dados cresçam temporariamente e depois diminuam, monitorar seu tamanho pode revelar se elas algum dia retornarão à linha de base. Por exemplo, se uma fila de mensagens processa tarefas, mas o tamanho de sua lista interna nunca diminui, os objetos podem estar se acumulando devido a lacunas lógicas. Isso é particularmente útil quando a criação de perfil não é viável ou quando há suspeita de vazamentos em áreas funcionais específicas. Ao incorporar esses logs juntamente com a execução de tarefas ou fluxos de usuários, os desenvolvedores ganham visibilidade sobre padrões anormais de retenção de objetos. Verificações automatizadas de limite podem ser adicionadas para detectar e alertar sobre crescimento descontrolado, permitindo a mitigação antecipada de vazamentos de memória antes que afetem o desempenho.

Analisar o comportamento de coleta de lixo

Linguagens de coleta de lixo como Java, Python e C# oferecem indicadores úteis da pressão de memória por meio de seus logs de coleta de lixo. Quando o sistema passa por ciclos frequentes de coleta de lixo com recuperação mínima de memória, isso normalmente indica que objetos estão sendo retidos desnecessariamente. A análise desses logs revela a frequência com que as coletas principais ocorrem, quanta memória é recuperada e como o uso do heap muda ao longo do tempo. Em Java, ferramentas como GCViewer ou logs JVM integrados (-XX:+PrintGCDetails) fornecem insights sobre a eficácia do desempenho do coletor de lixo. A atividade excessiva do coletor de lixo pode degradar o desempenho do aplicativo, mesmo que a memória ainda não esteja totalmente esgotada. Se o coletor de lixo estiver em execução com frequência, mas não conseguir recuperar espaço, os desenvolvedores devem investigar referências a objetos e caminhos de alocação. Padrões como o aumento do uso de memória da geração anterior e longos tempos de pausa do coletor de lixo geralmente indicam objetos persistentes que o sistema presume incorretamente que ainda estão em uso. Revisar esses padrões regularmente é uma maneira eficaz de detectar a retenção silenciosa de memória em ambientes gerenciados.

Pontos de acesso de alocação de trilhas

Ferramentas de criação de perfil podem destacar funções ou módulos responsáveis pelo maior número de alocações de objetos. Pontos críticos de alocação nem sempre são um vazamento por si só, mas quando certas áreas alocam consistentemente um grande número de objetos que nunca são coletados, isso se torna um sinal de alerta. Os criadores de perfil de memória podem ser configurados para exibir contagens de alocação e rastreamentos de pilha que levam a essas alocações. Em linguagens como Java, jmap e o JProfiler permitem que os desenvolvedores identifiquem quais classes e métodos estão produzindo o maior uso de memória. Para aplicações nativas, a ferramenta Massif da Valgrind é útil para rastrear picos de alocação. O rastreamento desses pontos críticos permite que as equipes inspecionem o design de funções ou loops com alta rotatividade. Um serviço que aloca memória repetidamente dentro de uma thread de polling, sem nunca liberar referências a esses objetos, pode levar a um consumo de memória de crescimento lento. Os desenvolvedores podem otimizar ou reestruturar esses caminhos de código para garantir que objetos temporários sejam liberados após seu propósito ser cumprido. Ao abordar os pontos críticos precocemente, vazamentos de longo prazo são minimizados antes que se acumulem nas sessões do usuário ou nos ciclos de serviço.

Observe o comportamento do aplicativo sob carga

Testes de carga são uma maneira confiável de revelar vazamentos de memória que permanecem ocultos em cargas de trabalho típicas de desenvolvimento. Ao simular alta simultaneidade, tráfego sustentado ou padrões de uso repetidos, os desenvolvedores podem observar como o aplicativo se comporta sob estresse. Vazamentos de memória frequentemente se revelam durante esses cenários por meio do aumento do consumo de memória, tempos de resposta mais lentos e, eventualmente, erros de falta de memória. Os resultados dos testes de carga devem ser pareados com o monitoramento e os logs de memória para identificar se o uso de recursos se estabiliza após o carregamento ou continua a aumentar. Ferramentas como JMeter, Locust e k6 ajudam a simular a carga, enquanto as métricas do sistema e do aplicativo fornecem loops de feedback. Esse método é especialmente útil para identificar vazamentos em fluxos de autenticação, processamento de arquivos, streaming de dados ou quaisquer caminhos de código que sejam executados por solicitação. Os testes de carga em um ambiente de preparação ou pré-produção permitem que as equipes descubram vazamentos que, de outra forma, se manifestariam na produção, onde a detecção se torna mais arriscada e a correção, mais disruptiva.

Monitorar contagens de threads ou identificadores

Vazamentos de memória não se limitam ao uso do heap de objetos. Recursos em nível de sistema, como threads, descritores de arquivo, soquetes e identificadores de GUI, também consomem memória e devem ser liberados explicitamente. O vazamento desses recursos pode esgotar os limites do sistema operacional, resultando em instabilidade do sistema ou travamentos de aplicativos. Os desenvolvedores devem monitorar pools de threads, estados de soquetes e identificadores de arquivos abertos para detectar retenção anormal. Ferramentas como lsof, netstat, ou monitores de recursos específicos da plataforma, ajudam a rastrear recursos abertos em tempo de execução. Por exemplo, se um aplicativo cria threads para lidar com tarefas, mas nunca as encerra corretamente, o uso de memória aumentará paralelamente à contagem de threads. Da mesma forma, arquivos ou soquetes não fechados podem persistir em segundo plano, acumulando sobrecarga no nível do sistema, mesmo se estiverem ociosos. Esses tipos de vazamentos são particularmente insidiosos em serviços e servidores de longa duração com alto throughput. O gerenciamento adequado do ciclo de vida desses recursos — juntamente com ganchos de limpeza e desligamento automatizados — garante que a memória do sistema seja recuperada de forma rápida e segura.

Use ferramentas de monitoramento de APM e tempo de execução

Ferramentas de Monitoramento de Desempenho de Aplicativos (APM) fornecem visibilidade contínua do uso de memória, comportamento da coleta de lixo e tempo de vida útil de objetos em todos os ambientes. Soluções como New Relic, Dynatrace, AppDynamics e Datadog oferecem painéis de memória integrados e detecção de anomalias para aplicativos em execução. Essas plataformas podem alertar as equipes quando o uso de memória excede os limites ou quando serviços específicos apresentam comportamento incomum sob carga. Algumas ferramentas também incluem comparações históricas e análises de retenção, ajudando a correlacionar tendências de memória com implantações ou picos de tráfego. Em ambientes de produção onde a criação de perfil é muito intrusiva, as ferramentas de APM servem como a lente principal para detectar vazamentos de memória. Elas ajudam a rastrear solicitações com uso intensivo de memória, identificar endpoints lentos e destacar serviços que retêm objetos por mais tempo do que o esperado. Muitas plataformas de APM também oferecem suporte a gatilhos de despejo de heap ou amostragem de objetos, fornecendo dados de diagnóstico suficientes sem afetar o desempenho do tempo de execução. A integração de soluções de APM no início do ciclo de vida de desenvolvimento permite a detecção proativa de vazamentos e acelera a análise da causa raiz quando os problemas surgem.

Compare instantâneos de memória antes e depois das tarefas

Uma técnica simples, porém eficaz, para detectar vazamentos de memória é tirar snapshots da memória em momentos-chave do ciclo de vida do aplicativo — antes e depois da execução de operações importantes. Por exemplo, se o seu aplicativo carrega sessões de usuário, processa grandes conjuntos de dados ou executa tarefas em lote, capturar um snapshot do heap antes da operação e outro depois permite analisar quais objetos foram criados e quais permanecem. Idealmente, objetos temporários devem ser liberados após a conclusão da tarefa. Se grandes volumes de memória permanecerem ocupados sem motivo aparente, isso pode indicar que os objetos estão sendo retidos involuntariamente. Ferramentas de análise de heap permitem comparar snapshots e destacar quais objetos aumentaram em número ou tamanho. Essa investigação com foco em delta é particularmente eficaz para detectar vazamentos em módulos ou recursos isolados. Quando combinadas com logs, métricas e rastreamento de alocação, as comparações de snapshots podem levar diretamente aos caminhos de código responsáveis pelo vazamento de memória.

Prevenção de vazamentos de memória

Prevenir vazamentos de memória é tão importante quanto detectá-los. Embora ferramentas e diagnósticos possam ajudar a descobrir vazamentos após seu surgimento, práticas de design robustas, gerenciamento disciplinado de recursos e adesão às convenções específicas da linguagem podem prevenir a maioria dos vazamentos. A prevenção proativa reduz o tempo de depuração, melhora a estabilidade do aplicativo e garante a escalabilidade à medida que os sistemas crescem. Abaixo, apresentamos técnicas comprovadas e hábitos arquitetônicos que minimizam o risco de vazamentos de memória em diferentes ambientes de programação.

Use construções de gerenciamento de recursos estruturados

Linguagens como Java, C# e Python fornecem construções estruturadas para limpeza automática de recursos. Isso inclui "try-with-resources", using instruções e gerenciadores de contexto. Quando usados corretamente, eles garantem que recursos como arquivos, soquetes e conexões de banco de dados sejam fechados mesmo que ocorram exceções. Os desenvolvedores devem favorecer essas construções em vez de chamadas de fechamento manuais, que são propensas a omissões. Em ambientes não gerenciados como C e C++, o uso de RAII (Resource Acquisition Is Initialization) garante que os recursos sejam liberados quando os objetos saem do escopo. Esses padrões reduzem a chance de esquecimento de limpeza e levam a um código mais seguro e previsível. As equipes devem padronizar essas construções e tratar qualquer gerenciamento manual de recursos como um código suspeito que requer um exame minucioso durante as revisões.

Cancele o registro de ouvintes de eventos e retornos de chamada imediatamente

Códigos orientados a eventos exigem o cancelamento explícito da assinatura de ouvintes quando o objeto que os registra não é mais necessário. Deixar de fazer isso leva à retenção de referências e à impossibilidade de liberar memória. Em sistemas com elementos de interface gráfica do usuário (GUI), atualizações de dados em tempo real ou barramentos de eventos personalizados, cada registro deve ser espelhado com um cancelamento de registro. Essa prática é crítica em estruturas de interface de usuário modulares ou dinâmicas, onde os componentes são frequentemente montados e desmontados. Um erro comum é registrar um ouvinte durante a inicialização, mas não removê-lo durante a destruição ou desmontagem. Vazamentos de memória se acumulam quando os componentes são destruídos visualmente, mas permanecem referenciados logicamente. Os desenvolvedores devem centralizar a lógica de assinatura de eventos e garantir que as rotinas de desmontagem sejam acionadas de forma consistente. Quando disponível, use padrões de eventos fracos ou ganchos de ciclo de vida fornecidos pela estrutura para automatizar a limpeza. Além disso, adote testes unitários e de integração que validem a remoção de ouvintes após a desativação de componentes ou o descarregamento de páginas.

Limite o uso de referências estáticas e globais

Campos estáticos e variáveis globais são frequentemente usados por conveniência, mas têm o custo da permanência. Qualquer objeto referenciado a partir de um contexto estático permanece na memória durante todo o tempo de execução do aplicativo, independentemente de ainda ser necessário. Isso se torna especialmente perigoso quando grandes coleções, dados de sessão ou elementos de interface do usuário são armazenados estaticamente. Com o tempo, esses objetos se acumulam e criam retenção de memória não intencional. Para evitar isso, os desenvolvedores devem usar campos estáticos apenas para constantes imutáveis, métodos utilitários ou singletons gerenciados por ciclo de vida. Evite armazenar objetos pesados ou dependentes de contexto estaticamente. Quando referências globais forem necessárias, combine-as com lógica de expiração, políticas de remoção ou estratégias de anulação manual. Durante o desligamento ou a desmontagem de componentes, os recursos mantidos estaticamente devem ser explicitamente limpos. O uso estático também deve ser revisado durante solicitações de pull para garantir que dados temporários ou transacionais não acabem em armazenamento de longa duração involuntariamente.

Quebre referências circulares quando necessário

Em ambientes com coleta de lixo, referências circulares ainda podem impedir a recuperação de memória. Isso é particularmente comum ao usar fechamentos, estruturas de dados vinculadas ou relacionamentos bidirecionais. Os desenvolvedores devem ter cuidado ao formar ciclos entre objetos que se referenciam. Em C++, use weak_ptr para quebrar ciclos formados por shared_ptrEm Java ou Python, revise grafos de objetos e use referências fracas quando apropriado para permitir a coleta de objetos que, de outra forma, seriam acessíveis. Ao usar closures ou classes anônimas, minimize o escopo das variáveis capturadas. Evite referenciar instâncias inteiras de classe quando apenas um método ou uma pequena parte do estado for necessária. Closures que capturam objetos grandes inadvertidamente são uma fonte frequente de vazamentos em código assíncrono ou reativo. Auditar regularmente esses padrões e testar o comportamento da memória durante o desenvolvimento ajuda a evitar que referências circulares persistam além de sua utilidade.

Use estruturas de dados e padrões com eficiência de memória

Escolher a estrutura de dados correta pode ajudar a evitar a retenção desnecessária de memória. Por exemplo, usar WeakHashMap em Java ou WeakKeyDictionary em Python garante que chaves ou valores sejam descartados automaticamente quando não estiverem mais em uso. Evite usar listas ou mapas ilimitados como padrão quando uma estrutura mais adequada — como um cache LRU ou uma fila limitada — puder ser aplicada. Em casos em que grandes conjuntos de dados precisam ser retidos temporariamente, segmente os dados e libere blocos periodicamente para reduzir a pressão de memória. Além disso, evite otimizações prematuras que levam ao armazenamento em cache de tudo "por precaução". Implementar políticas claras para expiração, remoção ou limites de tamanho ajuda o sistema a gerenciar melhor a memória sem a intervenção do desenvolvedor. A criação de perfil durante o projeto, não apenas após a ocorrência de vazamentos, ajuda a validar suposições sobre retenção de dados e tamanho da estrutura sob cargas realistas.

Descarte objetos não utilizados explicitamente

Embora linguagens com coleta de lixo liberem memória automaticamente, o momento da coleta depende da acessibilidade do objeto. Se as referências permanecerem, a memória permanece alocada. Os desenvolvedores podem acelerar o lançamento definindo explicitamente variáveis para null (em Java) ou None (em Python) após a conclusão do uso. Isso sinaliza ao coletor de lixo que o objeto não é mais necessário. Essa técnica é especialmente útil em escopos de longa duração, como trabalhadores em segundo plano, loops longos ou manipuladores de sessão, onde os objetos permaneceriam referenciados por um período prolongado. Em aplicações críticas de desempenho, ser intencional quanto ao ciclo de vida do objeto pode reduzir significativamente o uso máximo de memória. No entanto, isso deve ser usado criteriosamente para evitar código desorganizado ou a introdução de bugs. Como princípio, certifique-se de que as variáveis que contêm dados grandes ou confidenciais sejam apagadas assim que sua tarefa for concluída.

Adote estratégias de alocação defensiva

Vazamentos de memória podem ser reduzidos alocando memória apenas quando realmente necessário. Evite pré-alocar estruturas grandes, a menos que seja necessário para desempenho. Use técnicas de inicialização lenta, nas quais a memória é alocada just-in-time e liberada assim que a tarefa do objeto for concluída. Rastreie o uso de memória por meio de estruturas com escopo e processe grandes conjuntos de dados em lote, em vez de carregá-los inteiramente na memória. Em alguns ambientes, o pooling também pode causar vazamentos de memória se os objetos nunca forem retornados ao pool. Certifique-se de que qualquer lógica personalizada de gerenciamento de memória inclua timeouts ou lógica de detecção de vazamentos. Os desenvolvedores devem adotar a mentalidade de que toda alocação deve vir com um plano de desalocação, especialmente em sistemas sensíveis ao desempenho ou com recursos limitados.

Incorpore auditoria de memória em CI/CD

A prevenção não é completa sem monitoramento contínuo. A integração de auditorias de memória ao pipeline de CI/CD ajuda a detectar regressões precocemente. Ferramentas como profilers automatizados, contadores de alocação ou testes de carga sintéticos podem ser agendados para execução antes de cada implantação. Esses sistemas rastreiam métricas importantes, como tamanho do heap, frequência de coleta de lixo (GC), contagens de objetos e identificadores de recursos. Quando limites são excedidos ou desvios das linhas de base são detectados, as equipes são alertadas antes que as alterações cheguem à produção. Essa abordagem proativa transforma o gerenciamento de memória em uma prática contínua, em vez de uma correção reativa. As equipes também devem incluir KPIs relacionados à memória em seus critérios de qualidade e realizar revisões regulares de código com foco no gerenciamento do ciclo de vida. Estabelecer uma cultura de higiene da memória garante que a prevenção seja incorporada ao processo de desenvolvimento.

Teste de unidade para vazamentos de memória

Embora vazamentos de memória sejam normalmente associados ao comportamento em tempo de execução e ao desempenho de longo prazo do aplicativo, eles podem e devem ser detectados durante os testes — especialmente por meio de testes unitários direcionados. A integração da verificação de memória aos fluxos de trabalho de testes unitários permite que as equipes identifiquem vazamentos mais cedo no processo de desenvolvimento, antes que eles se expandam para a produção. Testes unitários projetados para segurança de memória ajudam a garantir que os limites do ciclo de vida do objeto sejam respeitados, os recursos sejam liberados corretamente e as operações sejam concluídas sem reter referências indesejadas. Embora os testes unitários por si só não consigam descobrir todos os vazamentos, eles são uma primeira linha de defesa crítica que reforça a boa disciplina de engenharia e incentiva o design com reconhecimento de vazamentos.

Testes de design em torno do comportamento de alocação e limpeza

Testes unitários eficazes para gerenciamento de memória focam não apenas na correção funcional, mas também no ciclo de vida dos objetos. Cada teste deve validar se objetos temporários são criados, usados e descartados adequadamente. Ao lidar com caches personalizados, gerenciadores de sessão ou fábricas de serviços, escreva testes que simulem a criação de objetos e verifiquem se nada persiste desnecessariamente após a conclusão da operação. Isso geralmente envolve invocar a mesma lógica várias vezes e comparar o uso de memória ou a contagem de objetos entre as execuções. Se o consumo de memória aumentar a cada invocação, isso pode indicar um vazamento. Para sistemas que lidam com grandes cargas úteis ou alta rotatividade de objetos, inclua lógica de desmontagem no teste para impor a limpeza. Em alguns ambientes, instrumentar o código de teste com contadores de alocação leves ou verificações de referência ajuda a revelar objetos que não saem do escopo. Essas asserções garantem que o uso de memória permaneça previsível e autocontido dentro do escopo do teste.

Use bibliotecas e utilitários de detecção de vazamentos

Ecossistemas de programação modernos fornecem bibliotecas que estendem frameworks de testes unitários com recursos de detecção de vazamento de memória. Para C++, ferramentas como o Google Test podem ser combinadas com Valgrind ou AddressSanitizer para rastrear alocações durante a execução dos testes. Desenvolvedores Java podem usar ferramentas como junit-allocations or OpenJDK Flight Recorder no modo de teste para observar a memória retida. Python oferece objgraph, tracemalloc e gc Recursos de inspeção de módulos para rastrear o crescimento de objetos entre asserções. Essas bibliotecas podem ser incorporadas a suítes de testes padrão e usadas para definir expectativas em relação à contagem de objetos ou alterações de memória. Por exemplo, um teste pode afirmar que não há instâncias adicionais de uma classe restantes após a conclusão de um método. Ao encapsular casos de teste em escopos de alocação controlada ou snapshots de memória, os desenvolvedores podem validar que nenhuma referência oculta persiste. Essas ferramentas não apenas detectam vazamentos de memória precocemente, como também facilitam sua reprodução consistente, o que geralmente é difícil durante a criação completa de perfil do aplicativo.

Simule o uso repetitivo e meça a estabilidade

Vazamentos de memória frequentemente ocorrem em operações repetitivas ou de longa duração. Para detectar esses padrões por meio de testes unitários, simule a execução repetida da mesma função ou recurso dentro de um loop. Essa abordagem pode revelar um crescimento gradual da memória que não seria óbvio em uma única passagem de teste. Por exemplo, uma função de cache que falha em remover entradas obsoletas pode passar em condições isoladas, mas falhar em repetição sustentada. Estruture seus testes para executar dezenas ou centenas de iterações e meça a memória ou o estado do objeto após a conclusão. Algumas estruturas de teste permitem ganchos de configuração e desmontagem em nível de fixação que permitem verificações de recursos entre os ciclos. Incluir esses loops como parte da automação de testes ajuda a garantir que o uso da memória permaneça consistente ao longo do tempo. Isso é particularmente valioso em serviços que precisam manter a estabilidade em sessões longas, como processadores em segundo plano, endpoints de API ou tarefas em lote. Ao observar se a memória permanece estável após execuções repetidas, os desenvolvedores ganham confiança antecipada na robustez de seu gerenciamento de memória.

Afirme a liberação adequada de recursos em desmontagens de testes

Os testes unitários devem sempre retornar o ambiente a um estado limpo, e isso inclui a memória. Além das asserções funcionais, os métodos de desmontagem de testes são ideais para verificar se recursos temporários foram liberados. Seja lidando com fluxos de arquivos, conexões de banco de dados ou instâncias de serviço simuladas, os blocos de desmontagem podem incluir dispose, close, ou null Operações. Esses padrões reforçam o princípio de que todos os recursos devem ser liberados quando a tarefa for concluída. Quando aplicável, assegure também que as referências de chave não estão mais acessíveis ou que os finalizadores foram acionados. Essa prática incentiva os desenvolvedores a escrever código mais autocontido e reduz a poluição dos testes em todas as suítes. Quando o código de desmontagem inclui a validação dos ciclos de vida dos objetos, torna-se muito mais fácil detectar regressões ou mudanças de comportamento que introduzem vazamentos de memória. A integração de asserções de memória na limpeza de testes também melhora a confiabilidade em ambientes de teste paralelos ou contínuos, onde o isolamento do teste é essencial.

Amostras de codificação

Aqui estão alguns exemplos de codificação que demonstram vazamentos de memória comuns e suas resoluções:

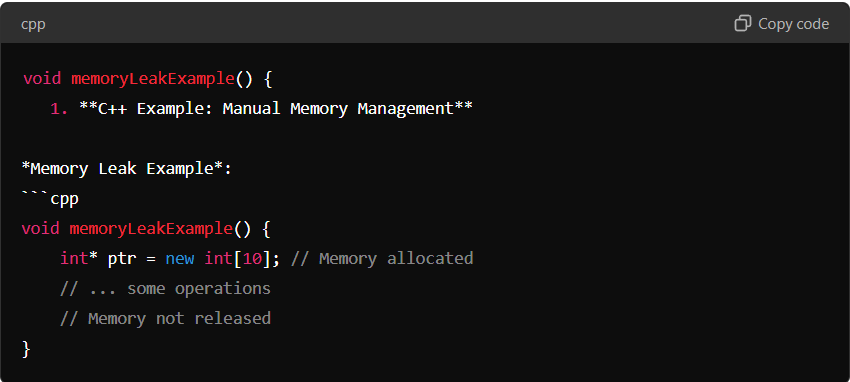

Exemplo de C++: Gerenciamento manual de memória

Neste exemplo, a memória é alocada usando new[] para criar um array de inteiros. No entanto, a memória não é liberada porque não há nenhuma chamada delete[] para liberá-la, levando a um vazamento de memória.

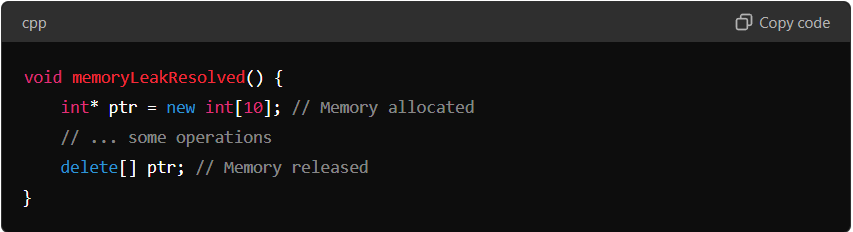

Exemplo resolvido:

Para resolver o vazamento, a memória alocada é liberada corretamente usando delete[]. Isso garante que a memória seja retornada ao sistema quando não for mais necessária.

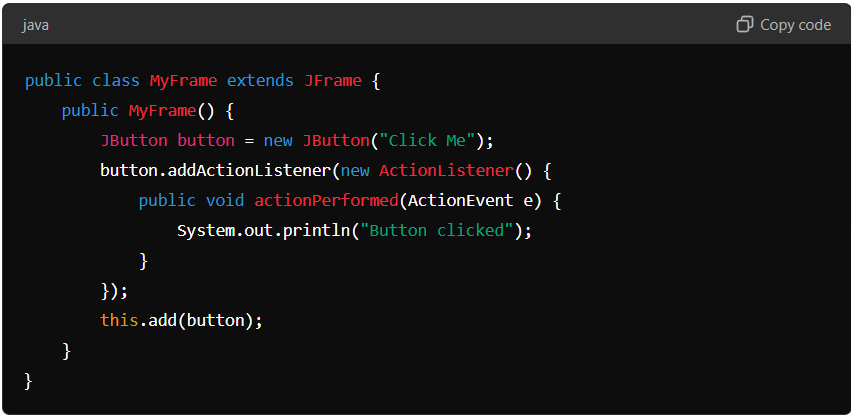

Exemplo Java: vazamento de memória do ouvinte

Exemplo de vazamento de memória:

Neste exemplo, uma classe interna anônima é usada para criar um ActionListener para um botão. No entanto, se o botão for removido ou o frame for fechado sem remover o listener, o listener pode causar um vazamento de memória ao manter o botão ou frame na memória.

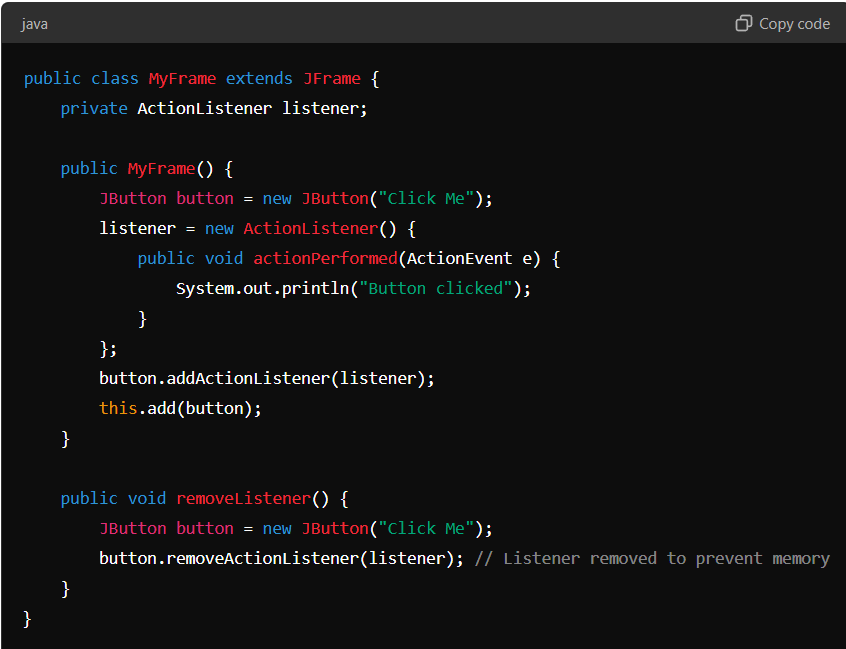

Exemplo resolvido:

Ao manter uma referência ao ouvinte e removê-la explicitamente quando o botão não for mais necessário, o potencial de vazamento de memória é mitigado.

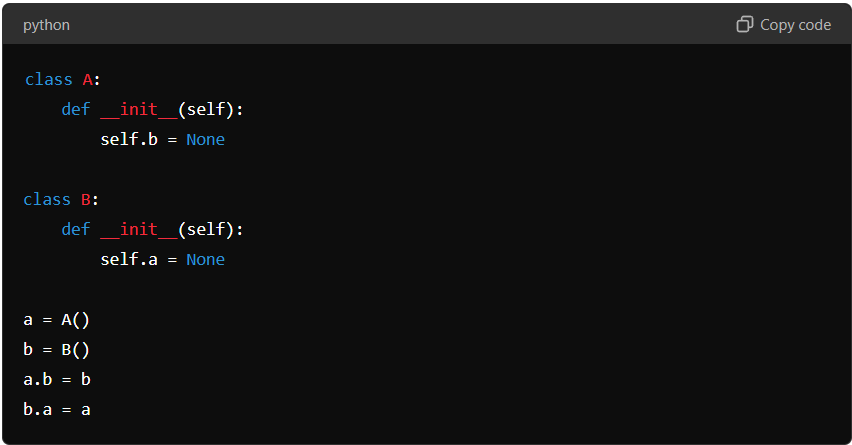

Exemplo Python: Referência Circular

Exemplo de vazamento de memória:

Neste exemplo, a e b mantêm referências um ao outro, criando uma referência circular. Isso pode impedir que o coletor de lixo do Python libere os objetos, causando um vazamento de memória.

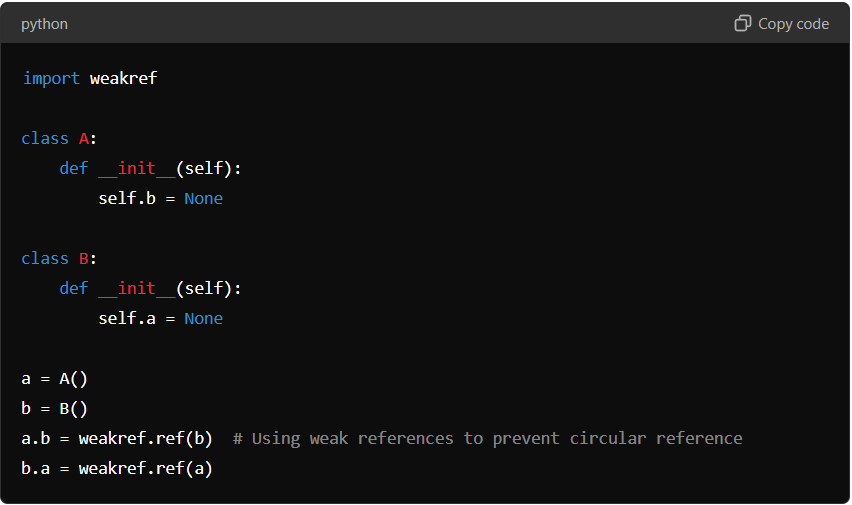

Exemplo resolvido:

Ao usar weakref, a referência circular é quebrada, permitindo que o coletor de lixo recupere a memória quando os objetos não estiverem mais em uso.

SMART TS XL: Uma ferramenta para detecção e resolução eficaz de vazamentos de memória

SMART TS XL pode melhorar significativamente o processo de detecção e resolução de vazamentos de memória. Veja como essa ferramenta pode ser integrada ao seu fluxo de trabalho de desenvolvimento:

Análise de código estático: SMART TS XL ofertas capacidades avançadas de análise estática, identificando potenciais vazamentos de memória analisando seu código. Diferentemente de outras ferramentas, ele fornece insights mais profundos e detecção mais precisa de padrões que podem levar a vazamentos de memória.

Construção de fluxograma: SMART TS XL pode gerar fluxogramas automaticamente que visualizam os processos de alocação e desalocação de memória dentro do seu código. Esse recurso é particularmente útil para entender cenários complexos de gerenciamento de memória e identificar onde vazamentos podem ocorrer.

Análise de impacto: Com SMART TS XL, você pode realizar análise de impacto para ver como mudanças em uma parte do código podem afetar o gerenciamento de memória em outras áreas. Isso é especialmente benéfico em grandes projetos, onde até mesmo pequenas mudanças podem ter repercussões significativas no uso da memória.

Melhoria da qualidade do código: Além de apenas detectar vazamentos, SMART TS XL fornece sugestões para melhorando a qualidade geral do código, ajudando você a escrever código mais robusto, sustentável e resistente a vazamentos.

Ao incorporar SMART TS XL no seu processo de desenvolvimento, você pode reduzir significativamente o risco de vazamentos de memória e garantir que seus aplicativos permaneçam estáveis e eficientes. Quer você esteja lidando com gerenciamento manual de memória em C++ ou manipulando referências de objetos em linguagens gerenciadas como Java e Python, SMART TS XL oferece as ferramentas necessárias para manter altos padrões de gerenciamento de memória e qualidade geral do código.