Landskap för företagsprogramvara som går in i 2026 fortsätter att växa i strukturell komplexitet snarare än enkelhet. Årtionden av ackumulerad logik, blandade programmeringsspråk, hybrida implementeringsmodeller och tätt kopplade beroenden begränsar i allt högre grad hur förändringar kan införas utan oavsiktliga konsekvenser. I denna miljö ses verktyg för statisk kodanalys inte längre som valfria kvalitetskontroller, utan som grundläggande instrument för att förstå hur system faktiskt beter sig innan någon modernisering, omstrukturering eller säkerhetsinitiativ påbörjas.

Det som skiljer statisk kodanalys i företagsskala från utvecklarorienterade verktyg är inte möjligheten att flagga isolerade fel, utan kapaciteten att resonera över hela applikationsområden. Stora organisationer arbetar sällan inom en enda runtime eller arkitekturmönster. Batchbelastningar för stordatorer samexisterar med distribuerade tjänster, äldre gränssnitt överlappar molnbaserade API:er, och myndighetskrav medför ytterligare begränsningar för hur risker kan mätas och minskas. Statisk analys måste därför fungera över gränser och exponera exekveringsvägar, dolda beroenden och strukturella risker som annars är osynliga enbart genom testning.

SMART TS XL

Idealisk lösning för statisk kodanalys för företag med stora utdelade system och tillgångar

Utforska nuDen växande betoningen på kontinuerlig leverans och accelererad modernisering har ytterligare stärkt rollen av analysdriven insikt. I takt med att företag strävar efter bredare utveckling applikationsmodernisering initiativ blir kostnaden för ofullständig förståelse alltmer uppenbar. Omstruktureringsbeslut som fattas utan fullständig insyn i kontrollflöde, dataspridning eller koppling mellan system introducerar ofta instabilitet, prestandaregressioner eller efterlevnadsexponering som först uppstår efter driftsättning. Statiska kodanalysverktyg förväntas nu minska denna osäkerhet genom att ge arkitektonisk tydlighet innan ändringen genomförs.

Mot denna bakgrund håller kriterierna som används för att utvärdera verktyg för statisk kodanalys år 2026 på att förändras. Noggrannhet ensam är otillräcklig. Företag behöver djupgående analys, skalbarhet över miljontals kodrader, stöd för heterogena miljöer och förmågan att omsätta tekniska resultat till handlingsbara insikter för arkitekter, plattformsledare och riskägare. Följande jämförelse undersöker hur ledande företagsverktyg för statisk kodanalys presterar mot dessa föränderliga krav och hur deras kapacitet överensstämmer med verkligheten i storskaliga, verksamhetskritiska system.

Jämförelse och ranking av verktyg för statisk kodanalys för företag för 2026

Jämförelsen nedan utvärderar ledande verktyg för statisk kodanalys mot kriterier som är viktiga i storskaliga företagsmiljöer snarare än individuella utvecklingsteam. Varje verktyg bedöms baserat på analysdjup, skalbarhet över heterogena system, stöd för äldre och moderna plattformar och dess förmåga att ge meningsfulla insikter från komplexa beroendestrukturer. Rankningen återspeglar hur effektivt dessa verktyg möjliggör arkitekturförståelse, riskidentifiering och välgrundat beslutsfattande i miljöer där förändringar medför betydande operativa och regulatoriska konsekvenser.

SMART TS XL

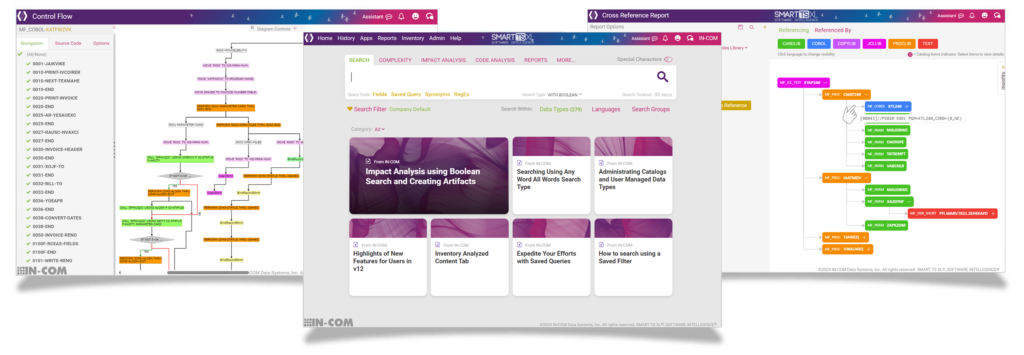

SMART TS XL är en plattform för statisk kodanalys, konsekvensbedömning och applikationsintelligens för företag, utformad för storskaliga, heterogena programvarusystem. Den är byggd för att stödja organisationer som arbetar i stordator-, mellanregister- och distribuerade miljöer där årtionden av ackumulerad logik, batchbearbetning och plattformsoberoenden gör förändringar i sig riskabla. Snarare än att fokusera på isolerade kodkvalitetsresultat, SMART TS XL är utformad för att exponera hur applikationer faktiskt beter sig genom att synliggöra exekveringsvägar, datarelationer och beroendestrukturer över hela portföljer.

Plattformen fungerar som ett högpresterande, webbaserat system som kan indexera och analysera miljarder kodrader och tillhörande artefakter på några sekunder. Genom att avlasta analysarbetsbelastningar från produktionssystem och centralisera insikter i en delad miljö, SMART TS XL stöder tusentals samtidiga användare utan prestandaförsämring. Denna skala gör den lämplig inte bara för utvecklingsteam, utan även för arkitekter, moderniseringsledare, produktionssupport, revision och efterlevnadsintressenter som behöver konsekvent, evidensbaserad insyn i komplexa system. Börja här.

Statisk analys och identifiering i företagsskala

I sin kärna, SMART TS XL erbjuder djupgående statisk analys över en bred uppsättning programmeringsspråk, jobbkontrollkonstruktioner, databaser och stödjande artefakter. Den stöder äldre och moderna tekniker inklusive COBOL, PL/I, Natural, RPG, Assembler, Java, C#, Python, VB6, UNIX-skript, JCL, PROC, CICS-artefakter, MQ-definitioner, databasscheman och strukturerade dokument. Källkod, batchlogik, konfigurationsfiler och även icke-kodartefakter som dokumentation och diagram kan indexeras och analyseras tillsammans, vilket gör att relationer kan upptäckas över traditionellt isolerade arkiv.

Denna enhetliga identifieringsfunktion gör det möjligt för organisationer att gå bortom inspektion på filnivå och mot förståelse på systemnivå. Program, jobb, fält, filer, tabeller och meddelanden kan spåras över plattformar, vilket avslöjar hur affärslogik flyter genom batchkedjor, onlinetransaktioner och rapporteringsprocesser nedströms. Dessa relationer framträder genom interaktiva korsreferensrapporter, beroendekartor och navigerbara körningsvyer snarare än statiska listor.

Analys av plattformsoberoende påverkan och beroendekartläggning

SMART TS XL lägger särskild vikt vid konsekvensanalys över flera plattformar. Förändringar som introduceras i en del av en applikation förblir sällan isolerade i företagsmiljöer, särskilt där stordatorarbetsbelastningar interagerar med distribuerade tjänster och delade datalager. SMART TS XL analyserar samtalsrelationer, dataanvändning, jobbkörningsvägar och kontrollflöde för att identifiera påverkanszoner uppströms och nedströms över språk och system.

Beroendekartläggningsfunktioner presenterar dessa relationer visuellt med hjälp av interaktiva, färgkodade diagram som markerar anropare, mottagare, dataproducenter och konsumenter. Konsekvensanalys kan initieras från ett program, ett fält, ett databaselement, ett jobbsteg eller till och med från sökresultat, vilket gör det möjligt för team att kartlägga ändringar exakt innan utvecklingen påbörjas. Denna metod minskar missade beroenden, begränsar övertestning och ger en försvarbar grund för förändringsplanering och riskbedömning.

Exekveringsorienterade vyer av batch- och programlogik

För miljöer med komplex batchbearbetning, SMART TS XL ger runtime-liknande förståelse utan att exekvera kod. COBOL- och JCL-expansionsfunktioner löser upp copybooks, PROC:er, symboler och overrides för att presentera logik som den faktiskt körs i produktion. Batchkedjor kan spåras från början till slut, vilket visar vilka program som exekveras, i vilken ordning och med vilka parametrar.

Kontrollflödesscheman och flödesscheman översätter djupt kapslad logik till navigerbara visuella representationer. Dessa vyer gör det möjligt att förstå exekveringsbeteende, identifiera döda eller oåtkomliga kodvägar och analysera förgreningskomplexitet utan att förlita sig på stamkunskap eller manuella genomgångar. Fältspårningsdiagram utökar denna funktion ytterligare genom att spåra hur dataelement skapas, transformeras och sprids över program, jobb och databaser, vilket stöder säkra strukturella förändringar och regulatoriska granskningar.

Avancerad sökning, mönsterdetektering och precisionsanalys

SMART TS XL inkluderar en högpresterande företagssökmotor optimerad för stora kodbaser med blandad teknik. Den stöder komplex boolesk logik, närhetssökningar, blocksökningar, reguljära uttryck, synonymhantering och finkorniga filter som begränsar analysen till specifika språk, datatyper eller kodavsnitt. Skiktade söktekniker gör det möjligt för användare att gradvis begränsa stora resultatmängder till exakta omfattningar som är lämpliga för konsekvensanalys, revisioner eller moderniseringsbedömningar.

Dessa sökfunktioner är tätt integrerade med funktioner för korsreferenser, påverkan, komplexitet och visualisering. Resultat kan pivoteras direkt till beroendevyer, rapporter eller ytterligare analysarbetsflöden, vilket minskar friktionen mellan identifiering och beslutsfattande. Sparade och parametriserade frågor gör det möjligt för organisationer att standardisera riskkontroller och repeterbara analysmönster över team och projekt.

Komplexitetsanalys och riskkvantifiering

SMART TS XL tillhandahåller komplexitetsanalys på portföljnivå som sträcker sig bortom enskilda program. Komplexitetsmått som kodrader, cyklomatisk komplexitet och Halstead-mått kan beräknas över riktade delmängder av applikationer definierade av sökresultat eller påverkanszoner. Detta gör det möjligt för team att kvantifiera teknisk risk inom specifika affärsfunktioner eller moderniseringskandidater snarare än att förlita sig på grova, applikationsomfattande medelvärden.

Genom att kombinera komplexitetsmått med beroende- och konsekvensanalys, SMART TS XL stöder mer realistisk uppskattning och prioritering av insatser. Områden med hög koppling och hög komplexitet kan identifieras tidigt, vilket gör att moderniserings- och saneringsinitiativ kan sekvenseras baserat på faktisk strukturell risk snarare än antaganden.

Kunskapsöverföring, revisionsberedskap och styrningsstöd

En återkommande utmaning i stora företag är förlusten av institutionell kunskap när systemen åldras och erfaren personal går i pension eller roterar. SMART TS XL åtgärdar detta genom att centralisera applikationskunskap i en sökbar och utforskande plattform som fångar upp hur system är strukturerade och hur de beter sig. Dokumentation, rapporter, diagram och bevisartefakter kan genereras och delas för att stödja onboarding, revisioner och myndighetsförfrågningar.

Exportfunktioner gör det möjligt att paketera analysresultat som tidsstämplade, bevisfärdiga artefakter som är lämpliga för efterlevnadsgranskningar, ändringsgodkännanden och externa revisioner. Åtkomstkontroller och användningsspårning stöder styrningskrav, särskilt i miljöer med offshore-utveckling eller outsourcade underhållsmodeller.

Implementering, integration och operativ anpassning

SMART TS XL är utformad för snabb driftsättning och minimala driftstörningar. Installationer kan slutföras inom några timmar, med tillgängliga anslutningar för att hämta data från stordatormiljöer, distribuerade källkontrollsystem, databaser och delade arkiv. Både fullständiga och stegvisa datainläsningar stöds, vilket gör att miljöer kan hållas aktuella utan att kräva ständig manuell intervention.

Automatiseringsfunktioner gör att analysprocesser kan köras obevakade, vilket stöder kontinuerlig insiktsgenerering i linje med företagets förändringscykler. Genom att centralisera analyser på kostnadseffektiv infrastruktur kan organisationer minska beroendet av dyra produktionsresurser samtidigt som de ökar analysdjupet och tillgängligheten i alla team.

SonarQube Enterprise Edition

SonarQube Enterprise Edition är en statisk kodanalysplattform utformad för att stödja stora utvecklingsorganisationer som söker konsekvent tillämpning av kodkvalitet, underhållbarhet och säkerhetsstandarder i moderna programvaruportföljer. Dess primära roll i företagsmiljöer är att fungera som ett kontinuerligt inspektionslager inbäddat i utvecklingsarbetsflöden och ge tidig feedback på kodproblem innan ändringar når produktion. I portföljer där granskningsflödet blir en flaskhals placeras den ofta tillsammans med bredare verktyg för kodgranskning att formalisera kvalitetskontroll och minska variationen mellan team.

Till skillnad från analysplattformar på portföljnivå ligger SonarQubes styrka i dess förmåga att arbeta nära utvecklarens arbetsflöde. Analysen utlöses vanligtvis som en del av byggpipelines eller pull request-validering, vilket gör det möjligt för team att upptäcka kodlukter, buggar och säkerhetsproblem stegvis allt eftersom koden utvecklas. Detta överensstämmer med organisationer som standardiserar automatiserade kontroller över leveranspipelines, inklusive metoder som beskrivs i CI / CD-rörledningar, där statisk analys blir en repeterbar kontroll snarare än ett ad hoc-granskningssteg.

Regelbaserad statisk analys och kvalitetsgrindar

Kärnan i SonarQube Enterprise Edition finns en regelbaserad statisk analysmotor som utvärderar källkod mot en stor och konfigurerbar regeluppsättning. Dessa regler täcker vanliga kategorier som underhållsproblem, tillförlitlighetsdefekter och säkerhetsbrister. Resultaten klassificeras efter allvarlighetsgrad och mappas till kvalitetsgränser som avgör om kod kan gå vidare genom leveranspipelinen.

Kvalitetsgrindar är en central mekanism för att upprätthålla organisatoriska standarder i stor skala. Företag kan definiera tröskelvärden för ny kodatäckning, defektdensitet och sårbarhetsexponering, vilket säkerställer att ändringar uppfyller fördefinierade kriterier före integration. Denna funktion är särskilt värdefull i miljöer med distribuerade team, outsourcad utveckling eller hög utvecklaromsättning, där konsekvent upprätthållande minskar beroendet av manuella granskningar.

Språktäckning och utvecklingsekosystemintegration

SonarQube stöder en bred uppsättning moderna programmeringsspråk, inklusive Java, C#, JavaScript, TypeScript, Python och andra som vanligtvis används inom utveckling av företagsapplikationer. Dess ekosystem av plugins och integrationer gör det möjligt att ansluta till populära CI/CD-plattformar, källkodskontrollsystem och ärendehanteringssystem. Denna täta integration gör det väl lämpat för organisationer som prioriterar automatiserad kvalitetskontroll som en del av sina leveransprocesser.

SonarQubes analysmodell är dock främst källcentrerad och arkivbaserad. Även om den kan analysera flera projekt parallellt är dess förståelse för relationer mellan arkiv, plattformar och exekveringskontexter begränsad. Analysen är vanligtvis begränsad till enskilda applikationer eller tjänster snarare än att den spänner över hela företagsområden med delade data, batch-arbetsflöden eller plattformsoberoenden.

Säkerhetsanalys och efterlevnadsstöd

I sina företagsutgåvor inkluderar SonarQube förbättrade säkerhetsanalysfunktioner i linje med vanliga sårbarhetskategorier. Den kan identifiera mönster associerade med injektionsbrister, osäkra konfigurationer och missbruk av API:er. Resultaten presenteras i ett format som är tillgängligt för både utvecklare och säkerhetsteam, vilket stöder åtgärdsarbetsflöden inom befintliga verktyg.

Ur ett efterlevnadsperspektiv erbjuder SonarQube spårbarhet och rapportering som hjälper till att visa efterlevnad av interna kodningsstandarder och säkerhetspolicyer. Rapporter kan genereras för att visa problemtrender, åtgärdsförlopp och efterlevnad av kvalitetsstandarder över tid. Även om dessa funktioner stöder granskningsberedskap inom utvecklingsteam, är de mindre fokuserade på att producera bevis på systemnivå för exekveringsbeteende eller systemövergripande påverkan.

Skalbarhetsegenskaper och operativa överväganden

SonarQube Enterprise Edition är utformad för att skalas över ett stort antal databaser och utvecklingsteam, särskilt vid driftsättning i distribuerade eller containeriserade miljöer. Dess prestanda skalas med tillgänglig infrastruktur, vilket gör den lämplig för organisationer med höga commit-volymer och frekventa analyscykler. Centraliserade dashboards ger aggregerad insyn i projekt, vilket hjälper ledningen att övervaka kvalitetstrender på hög nivå.

Med det sagt är SonarQubes skalbarhet främst horisontell över projekt snarare än vertikal över systemkomplexitet. Den löser inte körningsvägar, batch-orkestreringslogik eller djup datalinje över heterogena plattformar. I miljöer som domineras av stordatorarbetsbelastningar, batchschemaläggning eller tätt sammankopplade äldre system används SonarQube ofta som ett kompletterande verktyg snarare än en fristående källa till arkitekturinsikter.

Typiska användningsfall och begränsningar för företag

SonarQube Enterprise Edition är mest effektiv i företag med stark DevOps-mognad, standardiserade utvecklingsstackar och fokus på att förhindra kvalitetsförsämring i aktivt utvecklad kod. Den utmärker sig i att upprätthålla konsekvens, minska kodlukt och integrera kvalitetskontroller i snabba leveranspipelines.

Dess begränsningar blir tydligare i moderniseringsscenarier som kräver förståelse för hur förändringar sprider sig över stora, sammankopplade system. SonarQube försöker inte modellera exekveringsordning, dataspridning över jobb och plattformar, eller systemomfattande beroendekedjor. Som ett resultat paras det ofta ihop med djupare analysplattformar när företag behöver bedöma moderniseringsrisker, batchpåverkan eller effekter av förändringar över flera portföljer.

Checkmarx ett

Checkmarx One är en företagsfokuserad applikationssäkerhetsplattform centrerad kring statisk applikationssäkerhetstestning inom moderna utvecklings- och leveranspipelines. Dess primära roll i stora organisationer är att identifiera säkerhetsbrister tidigt i programvarans livscykel, särskilt i miljöer där frekventa utgåvor, distribuerade team och molnbaserade arkitekturer ökar exponeringen för exploaterbara brister. Snarare än att försöka modellera systemomfattande exekveringsbeteende fokuserar Checkmarx One på att upptäcka osäkra kodningsmönster och konfigurationssvagheter som överensstämmer med erkända säkerhetstaxonomier.

Plattformen används vanligtvis av företag med mogna DevSecOps-metoder, där säkerhetsanalys förväntas fungera kontinuerligt parallellt med utvecklingen snarare än som en kontroll efter lansering. I sådana miljöer fungerar Checkmarx One som en förebyggande mekanism som syftar till att minska sannolikheten för att sårbara kodvägar introduceras i produktionssystem.

Fokus på statisk applikationssäkerhetstestning

Kärnan i Checkmarx One är en statisk testmotor för applikationssäkerhet som är optimerad för att upptäcka sårbarheter på källkodsnivå. Analysen utförs utan att applikationer körs, vilket gör att problem kan identifieras tidigt, ofta under kodcommit- eller byggfaser. Plattformen mappar fynd till välkända sårbarhetskategorier och stöder säkerhetsteam som förlitar sig på standardiserade riskklassificeringsramverk som OWASP-sårbarheter att prioritera saneringsinsatser.

Betoningen på säkerhetsspecifika resultat skiljer Checkmarx One från generella statiska analysverktyg. Snarare än att lyfta fram underhålls- eller arkitekturproblem fokuserar plattformen på svagheter som kan leda till dataexponering, obehörig åtkomst eller eskalering av privilegier. Denna specialisering gör den särskilt relevant i reglerade branscher där tidslinjer för avslöjande av sårbarheter och åtgärdande övervakas noggrant.

Integrering i Enterprise DevSecOps-pipeliner

Checkmarx One är utformat för att integreras tätt med CI/CD-pipelines och utvecklararbetsflöden. Skanningar kan utlösas automatiskt som en del av byggprocesser, pull requests eller release gates, vilket säkerställer att säkerhetsanalyser sker konsekvent och utan manuella ingrepp. Resultaten visas via dashboards och integrationer med problemspårningssystem, vilket gör att resultaten kan dirigeras direkt till utvecklingsteam för åtgärd.

Denna pipeline-centrerade driftsmodell stöder hög utvecklingshastighet samtidigt som en grundläggande säkerhetsnivå bibehålls. Fokuset på enskilda databaser och tjänster innebär dock att analysen generellt sett är begränsad till diskreta kodbaser. Även om detta stämmer väl överens med mikrotjänster och modulära arkitekturer, begränsar det insynen i beroenden mellan applikationer eller exekveringskedjor på flera plattformar som är vanliga i långlivade företagssystem.

Språktäckning och molnbaserad orientering

Checkmarx One stöder ett brett utbud av moderna programmeringsspråk och ramverk som vanligtvis används inom företags- och molnbaserad utveckling. Denna bredd möjliggör konsekvent säkerhetsskanning över heterogena utvecklingsteam utan att flera specialiserade verktyg krävs. Plattformens molnbaserade leveransmodell förenklar ytterligare distribution och skalning, vilket minskar driftskostnaderna för organisationer som hanterar ett stort antal applikationer.

Med det sagt är stödet för äldre tekniker och batchorienterade miljöer mer begränsat. Stordatorspråk, jobbkontrollkonstruktioner och tätt kopplade äldre arbetsflöden ligger vanligtvis utanför plattformens primära omfattning. Som ett resultat distribueras Checkmarx One ofta tillsammans med andra analysverktyg när företag måste säkra både moderna och äldre komponenter inom samma applikationslandskap.

Riskrapportering och samordning av styrning

Ur ett styrningsperspektiv erbjuder Checkmarx One rapporteringsfunktioner som stöder spårning av sårbarheter, åtgärdsstatus och rapportering av efterlevnad. Säkerhetschefer kan övervaka trender över applikationer, team och tidsperioder, vilket hjälper till att visa efterlevnad av interna policyer och externa regulatoriska förväntningar. Resultaten kan aggregeras för att visa den övergripande riskpositionen, vilket möjliggör prioritering på portföljnivå.

Dessa rapporter fokuserar dock på närvaro av sårbarheter snarare än operativ påverkan. Plattformen försöker inte kvantifiera hur en sårbarhet sprids genom exekveringsvägar eller hur den interagerar med batchbearbetning, dataflöden eller nedströmssystem. Denna distinktion är viktig i företag där förståelse för explosionsradie och systemrisk är lika avgörande som att identifiera enskilda svagheter.

Typiska användningsfall och begränsningar för företag

Checkmarx One är mest effektivt för företag som vill integrera säkerhetskontroller direkt i snabbrörliga utvecklingsmiljöer. Det utmärker sig genom att identifiera säkerhetsproblem på kodnivå tidigt, minska omarbete och stödja konsekvent sårbarhetshantering över stora utvecklarpopulationer. För organisationer som moderniserar mot molnbaserade arkitekturer tillhandahåller det en skalbar mekanism för att upprätthålla säkerhetshygien.

Dess begränsningar uppstår i scenarier som kräver en helhetsförståelse av applikationsbeteende, beroendekedjor eller moderniseringens påverkan över heterogena system. I sådana fall positioneras Checkmarx One vanligtvis som ett specialiserat säkerhetslager snarare än en omfattande analysplattform, vilket kompletterar verktyg som fokuserar på exekveringsinsikter, beroendekartläggning och strukturell riskbedömning.

Fortify statisk kodanalysator

Fortify Static Code Analyzer är en statisk plattform för säkerhetstestning av applikationer i företagsklass, utformad för att identifiera säkerhetssårbarheter i stora, reglerade programvarumiljöer. Dess primära roll inom företag är att tillhandahålla systematisk detektering av kodmönster som introducerar säkerhetsrisker, särskilt i organisationer där efterlevnad, granskningsbarhet och formella riskhanteringsprocesser formar hur programvaruändringar styrs. Fortify används ofta i sektorer där säkerhetssäkring måste vara påvisbar, repeterbar och i linje med etablerade företagskontroller.

Snarare än att betona utvecklarcentrerade feedback-loopar positioneras Fortify ofta som en centraliserad säkerhetskontroll inom bredare styrningsramverk. Det stöder organisationer som kräver standardiserad sårbarhetsklassificering, konsekvent rapportering och spårbarhet över stora portföljer av applikationer som utvecklats av distribuerade eller tredjepartsteam.

Säkerhetscentrerad statisk analysmotor

Kärnan i Fortify Static Code Analyzer finns en säkerhetsfokuserad analysmotor som inspekterar källkod för att identifiera sårbarheter utan att köra applikationer. Motorn tillämpar en omfattande uppsättning säkerhetsregler utformade för att upptäcka svagheter som injektionsfel, osäker datahantering, autentiseringsfel och felaktig användning av kryptografiska funktioner. Resultaten kategoriseras efter allvarlighetsgrad och typ, vilket gör det möjligt för säkerhetsteam att bedöma risker på ett strukturerat och konsekvent sätt.

Betoningen på säkerhetskorrekthet skiljer Fortify från generella statiska analysverktyg. Analysdjupet är inriktat på att identifiera exploaterbara förhållanden snarare än underhålls- eller arkitekturproblem. Denna specialisering gör Fortify särskilt lämplig för miljöer där sårbarhetsdetektering prioriteras framför bredare systemförståelse.

Anpassning till Enterprise Risk and Compliance-program

Fortify integreras ofta i företags säkerhets- och styrningsprogram där programvarurisk hanteras tillsammans med andra operativa och regulatoriska risker. Dess rapporterings- och evidensgenereringsfunktioner stöder interna revisioner, externa bedömningar och regulatoriska granskningar. Resultaten kan aggregeras mellan applikationer och affärsenheter, vilket ger säkerhetsledarskapet insyn i riskexponering i stor skala.

Denna anpassning till formella IT-riskhantering processer gör Fortify till ett vanligt val i organisationer som måste visa på kontinuerlig kontrolleffektivitet. Rapporter kan användas för att visa sårbarhetstrender, åtgärdsframsteg och efterlevnad av interna säkerhetspolicyer, vilket stöder försvarbart beslutsfattande under revisioner eller incidentgranskningar.

Språktäckning och implementeringsegenskaper

Fortify Static Code Analyzer stöder ett brett utbud av programmeringsspråk som vanligtvis förekommer i företagsmiljöer, inklusive både moderna applikationsstackar och utvalda äldre tekniker. Detta gör det möjligt för organisationer att tillämpa en konsekvent säkerhetsanalysmetod över olika utvecklingsteam och teknikdomäner. Distributionsmodeller varierar, där Fortify ofta installeras lokalt eller inom kontrollerade företagsmiljöer för att uppfylla krav på datalagring och säkerhet.

Analys utförs dock generellt på applikations- eller projektnivå. Även om Fortify kan skalas över många applikationer, försöker det inte lösa exekveringsordning, batchorkestrering eller dataflöden mellan applikationer. Som ett resultat förblir dess perspektiv på risk lokaliserat till kodartefakter snarare än systemomfattande beteende.

Integrering i säkra utvecklingslivscykler

Fortify integreras vanligtvis i säkra utvecklingslivscykler som en grindningsmekanism snarare än ett kontinuerligt utforskande verktyg. Skanningar kan utlösas vid definierade skeden, såsom granskningar före utgivning, större ändringsfönster eller efterlevnadskontroller. Denna verksamhetsmodell överensstämmer med organisationer som föredrar kontrollerade utgivningsprocesser och formella godkännanden framför kontinuerlig driftsättning.

Även om integrationer med CI/CD-verktyg är tillgängliga, återspeglar Fortifys användningsmönster ofta en balans mellan automatisering och centraliserad tillsyn. Säkerhetsresultat granskas av specialiserade team som bedömer åtgärdskrav och beslut om riskacceptans, vilket stärker styrningens konsekvens i hela företaget.

Typiska användningsfall och begränsningar för företag

Fortify Static Code Analyzer är mest effektivt i företag där säkerhetssäkring, revisionsberedskap och regelefterlevnad är dominerande drivkrafter. Det ger en strukturerad och försvarbar metod för att identifiera säkerhetssårbarheter på kodnivå och visa att kontroller finns på plats för att upptäcka och åtgärda dem.

Dess begränsningar blir tydliga i scenarier som kräver förståelse för hur sårbarheter interagerar med exekveringsbeteende, batchbearbetning eller plattformsoberoenden. Fortify modellerar inte körningsbeteende eller systemomfattande påverkan, och det kompletteras ofta av verktyg som ger djupare insikt i applikationsstruktur, beroendekedjor och moderniseringsrisker i heterogena miljöer.

CAST-höjdpunkt

CAST Highlight är en plattform för intelligens och portföljbedömning av företagsapplikationer, utformad för att ge hög insyn i programvarukvalitet, risk och moderniseringsberedskap över stora applikationsområden. Dess primära roll i företagsmiljöer är att stödja strategiskt beslutsfattande genom att sammanfatta strukturella egenskaper, indikatorer på teknisk skuld och signaler om molnlämplighet snarare än att utföra djupgående, exekveringsorienterad kodanalys. CAST Highlight används ofta tidigt i moderniseringsprogram för att etablera en grundläggande förståelse för portföljernas hälsa.

Till skillnad från utvecklarcentrerade statiska analysverktyg fungerar CAST Highlight på en aggregerad nivå. Det är avsett att hjälpa arkitekter, portföljförvaltare och transformationsledare att jämföra applikationer, identifiera kandidater för modernisering och prioritera åtgärdsinsatser över hundratals eller tusentals system.

Portföljnivåanalys och programvaruintelligens

Kärnan i CAST Highlight är en lättviktig analysmotor som extraherar strukturella metadata från applikationskällkod och konfigurationsartefakter. Denna data normaliseras till en gemensam analysmodell som gör det möjligt att bedöma olika applikationer med hjälp av konsekventa kriterier. Mätvärden relaterade till kodkvalitet, underhållbarhet, säkerhetsexponering och arkitektonisk lämplighet beräknas och presenteras genom dashboards och jämförande vyer.

Dessa förmågor överensstämmer med bredare mjukvaruintelligens initiativ, där målet är att omvandla råa kodartefakter till beslutsklara insikter för intressenter som inte är utvecklare. Genom att abstrahera komplexitet till standardiserade indikatorer gör CAST Highlight det möjligt för ledningsgrupper att resonera kring stora portföljer utan att behöva utföra detaljerad kodinspektion.

Moderniseringsberedskap och bedömning av molnlämplighet

CAST Highlight lägger särskild vikt vid att utvärdera applikationer för modernisering och beredskap för molnmigrering. Den bedömer faktorer som ramverksanvändning, beroendemönster och teknikens aktualitet för att uppskatta den ansträngning och risk som är förknippad med att flytta applikationer till moderna plattformar. Resultaten används ofta för att gruppera applikationer i kategorier som omhostning, omstrukturering, ersättning eller pensionering.

Denna bedömningsdrivna metod stöder tidiga planerings- och budgeteringsaktiviteter. Företag kan använda CAST Highlight-resultat för att bygga moderniseringsplaner, uppskatta omfattningen av transformationen och kommunicera riskprofiler till affärsintressenter. Analysen är dock avsiktligt bred och försöker inte modellera detaljerat utförandebeteende eller bieffekter av transformationen.

Indikatorer för säkerhet och teknisk skuld

Utöver moderniseringssignaler tillhandahåller CAST Highlight övergripande indikatorer relaterade till säkerhetsbrister och teknisk skuld. Dessa indikatorer härleds från kända mönster i samband med ökade underhållskostnader eller ökad sårbarhetsexponering. Avsikten är inte att ersätta dedikerade säkerhetsskanningsverktyg, utan att belysa områden där djupare utredning kan vara motiverad.

Eftersom resultaten är aggregerade är de bäst lämpade för jämförande analyser snarare än åtgärdsplanering. Säkerhets- och skuldindikatorer hjälper organisationer att förstå den relativa riskfördelningen mellan portföljer, men de identifierar inte specifika exekveringsvägar, dataflöden eller operativa beroenden som skulle påverkas av kodändringar.

Skalbarhet och operativ modell

CAST Highlight är utformat för att skalas effektivt över mycket stora applikationsportföljer. Dess lätta analysmetod minimerar bearbetningskostnader och möjliggör snabb onboarding av nya applikationer. Detta gör den särskilt lämplig för företag som genomför breda undersökningar av sina programvarulandskap under fusioner, avyttringar eller tidiga moderniseringsinitiativ.

Avvägningen för denna skalbarhet är analytiskt djup. CAST Highlight löser inte anropsgrafer, batchexekveringskedjor eller dataspridning över plattformar. Som ett resultat används det ofta tillsammans med djupare analysverktyg när specifika applikationer eller transformationsinitiativ går från planering till utförande.

Typiska användningsfall och begränsningar för företag

CAST Highlight är mest effektivt i företag som behöver en övergripande, jämförande bild av applikationsportföljer för att stödja strategisk planering. Det utmärker sig på att identifiera moderniseringskandidater, uppskatta transformationskomplexitet och kommunicera teknisk risk till icke-tekniska intressenter.

Dess begränsningar blir uppenbara när organisationer behöver exakt förståelse för hur förändringar påverkar exekveringsbeteende, beroendekedjor eller driftsstabilitet. CAST Highlight ger inte den insikt på exekveringsnivå som behövs för att säkert implementera refactoring- eller moderniseringsaktiviteter, och det kompletteras vanligtvis av verktyg som fokuserar på detaljerad konsekvensanalys och beteendeinsyn inom utvalda applikationer.

CAST-avbildning

CAST Imaging är en plattform för affärsapplikationsanalys som fokuserar på arkitekturanalys och visualisering av strukturella beroenden i komplexa programvarusystem. Dess primära roll inom stora organisationer är att exponera hur applikationer sätts samman, hur komponenter interagerar och var strukturell koppling introducerar risker. CAST Imaging används vanligtvis av arkitekter och moderniseringsteam som behöver en förståelse för applikationsstruktur på systemnivå innan de planerar omstrukturering, migrering eller nedbrytningsinitiativ.

Snarare än att fungera som ett verktyg för kodinspektion eller säkerhetsskanning betonar CAST Imaging arkitekturförståelse. Det omvandlar källkod och konfigurationsartefakter till navigerbara modeller som illustrerar relationer mellan komponenter, lager och teknologier, vilket gör det möjligt för intressenter att resonera kring komplexitet i stor skala.

Arkitektonisk kartläggning och visualisering av beroenden

Kärnan i CAST Imaging är dess förmåga att generera detaljerade arkitekturrepresentationer av applikationer och applikationsportföljer. Dessa representationer inkluderar komponentdiagram, interaktionskartor och lagervyer som visar hur moduler kommunicerar och är beroende av varandra. Genom att visualisera strukturella relationer gör CAST Imaging det möjligt för team att identifiera täta kopplingar, cirkulära beroenden och arkitekturöverträdelser som är svåra att upptäcka genom analys på filnivå.

Dessa visuella modeller överensstämmer nära med metoder som är inriktade på beroendegrafer, där förståelse för strukturella sammankopplingar är avgörande för att hantera risker i stora system. CAST Imaging låter användare navigera beroenden interaktivt, från övergripande arkitektoniska vyer ner till mer detaljerade representationer efter behov.

Multiteknologisk och täckning över flera applikationer

CAST Imaging stöder analyser över ett brett spektrum av programmeringsspråk, ramverk och plattformar som vanligtvis finns i företagsmiljöer. Denna bredd gör det möjligt att modellera heterogena system som består av äldre komponenter, distribuerade tjänster och delade databaser. Funktioner för applikationsövergripande analys gör det möjligt för team att förstå hur enskilda system passar in i större portföljer och hur förändringar i en applikation kan påverka andra.

Analysen förblir dock strukturell snarare än beteendemässig. CAST Imaging modellerar statiska relationer mellan komponenter, men simulerar inte exekveringsordning, körtidsvillkor eller batchschemaläggningslogik. Som ett resultat ger den klarhet i hur system är anslutna, men inte nödvändigtvis hur de beter sig under exekvering.

Stöd för modernisering och arkitekturstyrning

CAST Imaging används ofta för att stödja moderniseringsinitiativ där arkitektonisk tydlighet är en förutsättning för förändring. Genom att avslöja brott mot arkitektoniska principer och identifiera områden med överdriven koppling hjälper det team att planera strategier för stegvis transformation. Dessa insikter kan ligga till grund för beslut om tjänsteutvinning, omdesign av gränssnitt eller stegvisa migreringsmetoder.

I styrningssammanhang kan CAST Imaging också användas för att bedöma arkitekturens efterlevnad mot definierade standarder. Avvikelser från målarkitekturer kan identifieras och dokumenteras, vilket stöder tillsyn och åtgärdsplanering. Detta gör det värdefullt i organisationer som tillämpar arkitekturkontroller som en del av sina förändringsledningsprocesser.

Skalbarhets- och portföljmodelleringsöverväganden

Plattformen är utformad för att skalas över stora applikationer och portföljer, och genererar arkitekturmodeller som kan delas mellan intressenter. Dess visualiseringscentrerade tillvägagångssätt stöder samarbetsinriktad analys och kommunikation, särskilt när man förklarar komplexa strukturer för målgrupper som inte är utvecklare.

Nackdelen med denna skalbarhet är begränsad insikt i operativ dynamik. CAST Imaging löser inte dataavstamning på fältnivå, spårar batch-exekveringsflöden eller kvantifierar effekten av ändringar under körning. För initiativ som kräver exakt omfattning av förändringseffekt eller validering av exekveringsbeteende krävs vanligtvis ytterligare analysverktyg.

Typiska användningsfall och begränsningar för företag

CAST Imaging är mest effektivt i företag som behöver förstå och rationalisera applikationsarkitekturen innan de genomför betydande förändringar. Det utmärker sig genom att avslöja strukturell komplexitet, vägleda arkitekturomstrukturering och stödja moderniseringsplanering över heterogena system.

Dess begränsningar blir uppenbara när organisationer behöver insikter på exekveringsnivå, konsekvensbedömningar eller validering av hur förändringar sprids genom körningsbeteende. CAST Imaging tillhandahåller en strukturell karta snarare än en operativ ritning, och kompletteras ofta av verktyg som erbjuder djupare analys av exekveringsvägar, dataflöde och systembeteende.

Veracode Statisk Analys

Veracode Static Analysis är en molnbaserad statisk plattform för applikationssäkerhetstestning, utformad för att bädda in säkerhetskontroller direkt i moderna programvaruleveransprocesser. Dess primära roll i företagsmiljöer är att identifiera säkerhetssårbarheter tidigt och kontinuerligt över stora volymer applikationskod, särskilt i organisationer som prioriterar snabba releasecykler, distribuerade utvecklingsteam och centraliserad säkerhetsövervakning. Veracode används ofta där säkerhetssäkring måste skalas utan att introducera friktion i utvecklingshastigheten.

Plattformen betonar automatisering och konsekvens, och positionerar statisk analys som en ständigt pågående säkerhetskontroll snarare än en periodisk granskningsaktivitet. Denna verksamhetsmodell är i linje med företag som har standardiserat molnbaserade utvecklingsverktyg och kräver centraliserad insyn i applikationssäkerhetsstatus i olika team och projekt.

Molnbaserad statisk applikationssäkerhetstestning

Kärnan i Veracode Static Analysis är en statisk säkerhetsskanningsmotor som levereras helt som en hanterad molntjänst. Källkod och binärfiler laddas upp för analys, där de inspekteras för sårbarheter som injektionsfel, osäker datahantering och autentiseringsbrister. Analysen kräver inte åtkomst till produktionsmiljöer, vilket gör att säkerhetsbedömningar kan utföras tidigt i livscykeln utan operativ risk.

Denna molnbaserade metod möjliggör snabb onboarding och elastisk skalning över stora portföljer. Företag kan tillämpa konsekventa säkerhetsskanningspolicyer över hundratals applikationer utan att behöva underhålla lokal infrastruktur. Resultaten normaliseras och presenteras via centraliserade dashboards, vilket stöder säkerhetsteam som ansvarar för företagsomfattande riskövervakning.

Integrering i kontinuerliga leveranspipeliner

Veracode är utformat för att integreras tätt med CI/CD-pipelines och utvecklarverktyg. Skanningar kan utlösas automatiskt under bygg- eller releasefaser, och resultaten returneras i format som integreras med arbetsflöden för problemspårning och åtgärdande. Detta stöder en shift-left-säkerhetsmodell där sårbarheter åtgärdas närmare introduktionstidpunkten.

I praktiken samordnas Veracodes roll inom pipelines ofta med bredare kvalitets- och testkontroller, inklusive aktiviteter som prestandaregressionstestning, för att säkerställa att säkerhetstillämpning inte sker isolerat från andra icke-funktionella krav. Denna anpassning hjälper organisationer att balansera säkerhetsnoggrannhet med leveransprestanda.

Språktäckning och portföljkonsekvens

Veracode Static Analysis stöder ett brett utbud av moderna programmeringsspråk och ramverk som vanligtvis används inom utveckling av företagsapplikationer. Denna bredd gör det möjligt för säkerhetsteam att tillämpa enhetliga skanningspolicyer över heterogena utvecklingsstackar, vilket minskar luckor som annars kan uppstå mellan team eller plattformar.

Plattformens fokus ligger dock fortfarande på säkerhetsskanning på applikationsnivå. Analysen är vanligtvis begränsad till enskilda applikationer eller tjänster, och relationer mellan applikationer, batch-arbetsflöden eller delade datastrukturer modelleras inte. Som ett resultat ger Veracode en god täckning av sårbarheter på kodnivå men begränsad insikt i hur dessa sårbarheter kan spridas över sammankopplade system.

Riskrapportering och styrningssynlighet

Veracode tillhandahåller rapporteringsfunktioner som gör det möjligt för säkerhetschefer att spåra sårbarhetstrender, åtgärdsförlopp och policyefterlevnad i hela företaget. Dashboards stöder portföljnivåvyer över riskexponering, vilket möjliggör prioritering baserat på allvarlighetsgrad och affärspåverkan. Dessa rapporter används ofta för att stödja intern säkerhetsstyrning, rapportering till chefer och tredjepartssäkringsaktiviteter.

Även om dessa funktioner stöder ansvarsskyldighet och tillsyn, är rapporteringen fortfarande sårbarhetscentrerad. Veracode försöker inte kvantifiera operativ påverkan, störningar i exekveringsflödet eller moderniseringsrisker i samband med åtgärdsinsatser. Denna distinktion är viktig i miljöer där säkerhetsförändringar måste utvärderas tillsammans med stabilitets- och ändringshanteringsöverväganden.

Typiska användningsfall och begränsningar för företag

Veracode Static Analysis är mest effektivt i företag som arbetar med hög leveranshastighet och kräver skalbar, centraliserad säkerhetsskanning över moderna applikationsstackar. Den utmärker sig i att upprätthålla konsekventa säkerhetsstandarder, minska tiden det tar att upptäcka sårbarheter och stödja DevSecOps-operativmodeller.

Dess begränsningar blir uppenbara i scenarier som kräver djup förståelse för systembeteende, beroenden mellan applikationer eller äldre batchbearbetning. Veracode tillhandahåller inte insikter på exekveringsnivå eller mappning av arkitekturberoenden, och det är vanligtvis positionerat som ett specialiserat säkerhetslager kompletterat med verktyg som fokuserar på konsekvensanalys, beroendesynlighet och systemförståelse på företagsnivå.

Coverity (Synopsys)

Coverity är en plattform för statisk kodanalys för företag, känd för sin förmåga att upptäcka komplexa defekter i stora, prestandakritiska kodbaser. Dess primära roll i företagsmiljöer är att identifiera djupa problem med korrekthet och tillförlitlighet som är svåra att upptäcka enbart genom testning, särskilt i system där fel medför betydande operativa, säkerhetsmässiga eller ekonomiska konsekvenser. Coverity används ofta inom industrier som fordonsindustrin, flygindustrin, telekommunikation och infrastrukturprogramvara, där defektprecision och låga falskpositiva resultat är avgörande.

Till skillnad från analysplattformar på portföljnivå fokuserar Coverity på korrekthet på kodnivå över omfattande kodbaser. Den är utformad för att analysera stora volymer källkod effektivt samtidigt som den bibehåller en hög nivå av analytisk noggrannhet, vilket gör den lämplig för organisationer som hanterar långlivade system med stränga tillförlitlighetskrav.

Djupgående defektdetektering och precisionsanalys

Kärnan i Coverity är en statisk analysmotor som är optimerad för att upptäcka defekter som minneskorruption, resursläckor, samtidighetsproblem och logiska fel. Motorn är känd för sin förmåga att resonera kring komplexa kontrollvägar och exekveringsscenarier som spänner över flera funktioner och moduler. Denna analysdjup gör det möjligt att identifiera defekter som bara kan uppstå under specifika körtidsförhållanden.

Coveritys analytiska metod använder avancerade tekniker relaterade till symbolisk avrättning, vilket gör att den kan utforska flera exekveringsvägar utan att köra koden. Denna funktion bidrar till dess rykte för hög noggrannhet och hjälper till att minska bruset som ofta är förknippat med storskalig statisk analys i företagsmiljöer.

Språkfokus och riktad täckning

Coverity ger starkt stöd för språk som vanligtvis används i systemnivå- och prestandakänslig programvara, inklusive C, C++ och Java. Detta fokus gör det särskilt effektivt för att analysera kärninfrastrukturkomponenter, inbyggda system och backend-tjänster där lågnivåfel kan ha en oproportionerlig inverkan.

Även om plattformen kan skalas över stora kodbaser är dess språktäckning smalare än vissa generella statiska analysverktyg. Den är mindre inriktad på heterogena företagsområden som inkluderar batchbehandlingsspråk, skriptmiljöer eller stordatorspecifika tekniker. Som ett resultat distribueras Coverity ofta selektivt inom portföljer, med inriktning på komponenter där defektprecision är mest kritisk.

Integrering i arbetsflöden för företagsutveckling

Coverity är utformat för att integreras i företagsutvecklingsprocesser, inklusive CI/CD-pipelines och centraliserade system för felhantering. Skanningar kan schemaläggas eller utlösas automatiskt, och resultaten dirigeras till utvecklingsteam för åtgärd. Plattformen stöder stegvis analys, vilket gör det möjligt för team att fokusera på nyligen introducerade problem samtidigt som de bibehåller insyn i befintliga felhanteringsproblem.

I många organisationer positioneras Coverity som en kvalitetssäkringskontroll snarare än ett kontinuerligt utforskande verktyg. Dess skanningar körs ofta vid definierade milstolpar, till exempel före större utgåvor eller under formella kvalitetsgranskningar. Detta användningsmönster återspeglar dess roll i att upprätthålla tillförlitlighetsstandarder snarare än att stödja snabb iteration.

Skalbarhet och prestandaegenskaper

Coverity är konstruerat för att hantera mycket stora kodbaser effektivt, vilket gör det lämpligt för företag med miljontals rader kritisk kod. Dess prestanda skalas med tillgänglig infrastruktur, vilket gör det möjligt för organisationer att analysera stora system utan oöverkomliga analystider. Centraliserade dashboards ger insyn i feltrender och åtgärdsframsteg i projekt.

Coveritys skalbarhet är dock fokuserad på kodvolym snarare än systemkomplexitet. Den försöker inte modellera beroenden mellan applikationer, batchkörningsordning eller datalinje över plattformar. Dess insikter är fortfarande centrerade kring defektdetektering inom enskilda kodbaser snarare än systemomfattande beteende.

Typiska användningsfall och begränsningar för företag

Coverity är mest effektivt i företag som kräver högkonfidensiell defektdetektering i kritiska programvarukomponenter. Det utmärker sig på att identifiera subtila problem som kan leda till krascher, säkerhetsbrister eller oförutsägbart beteende i produktion, särskilt i lågnivå- eller prestandakänslig kod.

Dess begränsningar blir tydliga i moderniserings- eller transformationsinitiativ som kräver förståelse för hur förändringar påverkar sammankopplade system. Coverity tillhandahåller inte kartläggning av arkitektoniska beroenden eller konsekvensanalys på exekveringsnivå, och det kompletteras vanligtvis av verktyg som fokuserar på portföljsynlighet, beroendeanalys och beteendeinsikter i heterogena företagsmiljöer.

Parasoft C/C++-testning och DTP

Parasoft C/C++test och den tillhörande Development Testing Platform (DTP) bildar en statisk analys- och efterlevnadstestlösning i företagsklass, skräddarsydd för säkerhetskritiska och hårt reglerade programvarumiljöer. Dess primära roll inom stora organisationer är att stödja rigorös verifiering av kod på systemnivå där fel kan leda till driftsfel, bristande efterlevnad av regelverk eller säkerhetsincidenter. Parasoft används ofta inom branscher som flyg-, fordons-, försvars- och industrisystem, där programvarubeteendet måste vara bevisbart korrekt och granskningsbart.

Till skillnad från generella statiska analysverktyg betonar Parasoft överensstämmelse med definierade standarder och verifieringsmål. Plattformen är utformad för att stödja miljöer där utveckling styrs av formella processer, certifieringskrav och dokumenterade försäkringsfall snarare än snabb iteration.

Standarddriven statisk analys och efterlevnad

Kärnan i Parasoft C/C++test finns en statisk analysmotor som är anpassad till branschsäkerhets- och kodningsstandarder som MISRA, CERT och ISO-relaterade riktlinjer. Motorn utvärderar källkod mot strikta regelverk som definierar acceptabla konstruktioner, användningsmönster och felförhållanden. Överträdelser kategoriseras efter allvarlighetsgrad och mappas direkt till efterlevnadskrav, vilket gör det möjligt för organisationer att visa att de följer obligatoriska utvecklingspraxis.

Denna standarddrivna metod är anpassad till miljöer som är beroende av formell verifiering koncept, där korrekthet definieras inte bara av funktionellt beteende utan också av efterlevnad av föreskrivna regler. Parasofts analysresultat kan användas som bevis inom certifierings- och revisionsprocesser, vilket minskar manuell verifieringsansträngning.

Fokuserat språkstöd och riktat analysdjup

Parasoft C/C++test är specifikt optimerat för C- och C++-kodbaser och tillhandahåller djupgående analysfunktioner för språk som vanligtvis används i inbäddad programvara och programvara på systemnivå. Denna specialisering gör det möjligt för plattformen att identifiera problem på låg nivå, såsom minnesmissbruk, pekarfel och samtidighetsfel, vilka kan vara särskilt farliga i säkerhetskritiska sammanhang.

Även om detta djup är värdefullt inom sitt målområde, begränsar det också plattformens tillämpbarhet över bredare företagsområden. Parasoft strävar inte efter att erbjuda bred täckning över olika språk, batchbehandlingsmiljöer eller äldre stordatorsystem. Som ett resultat används det vanligtvis i utvalda segment av en företagsportfölj snarare än som en universell analyslösning.

Integration med reglerade utvecklingslivscykler

Parasoft är utformat för att integreras i strukturerade utvecklingslivscykler som betonar spårbarhet, dokumentation och kontrollerad förändring. Statiska analysresultat kan kopplas till krav, testfall och felspårningssystem via DTP-komponenten, vilket möjliggör spårbarhet från specifikation till verifiering.

Denna integration stöder utvecklingsmodeller där förändringar introduceras medvetet och granskas formellt. Analys utförs ofta vid definierade milstolpar, till exempel före certifieringsinlämningar eller större utgåvor, snarare än kontinuerligt vid varje commit. Denna driftsmodell återspeglar prioriteringarna i reglerade miljöer, där förutsägbarhet och säkerhet väger tyngre än snabbhet.

Rapportering, spårbarhet och revisionsberedskap

Utvecklingstestplattformen tillhandahåller centraliserad rapportering och analys över projekt och team. Mätvärden relaterade till efterlevnadsstatus, feltrender och verifieringstäckning kan aggregeras och granskas av intressenter inom kvalitetssäkring och efterlevnad. Rapporterna är strukturerade för att stödja revisions- och certifieringsaktiviteter och ge dokumenterade bevis på analysutförande och resultat.

Dessa rapporter fokuserar dock på efterlevnad på kodnivå snarare än systemövergripande beteende. Parasoft modellerar inte exekveringsvägar mellan applikationer, batchorkestrering eller plattformsoberoenden. Dess spårbarhet är inriktad på krav och standarder snarare än körtidsinteraktion mellan komponenter.

Typiska användningsfall och begränsningar för företag

Parasoft C/C++-testning och DTP är mest effektiva i företag där säkerhet, tillförlitlighet och regelefterlevnad är dominerande frågor. De tillhandahåller ett disciplinerat ramverk för att verifiera att kritisk kod överensstämmer med strikta standarder och kan motstå formell granskning.

Deras begränsningar blir tydliga i miljöer som kräver en helhetsförståelse av stora, sammankopplade system eller stöd för heterogena teknikstackar. Parasoft är inte utformat för att ge insyn på portföljnivå eller utförandeorienterad konsekvensanalys, och det kompletteras ofta av verktyg som fokuserar på arkitektoniska beroenden, moderniseringsrisker och systembeteende över komplexa företagslandskap.

Klockwork

Klocwork är en plattform för statisk kodanalys för företag som fokuserar på att identifiera säkerhets-, tillförlitlighets- och samtidighetsrelaterade defekter i stora, komplexa kodbaser. Dess primära roll i företagsmiljöer är att upptäcka problem som kan äventyra systemstabilitet eller säkerhet, särskilt i programvara som körs under hög belastning, parallell exekvering eller begränsade körtidsförhållanden. Klocwork används ofta i branscher där prestanda och korrekthet är nära kopplade, inklusive telekommunikation, inbyggda system, finansiell infrastruktur och storskaliga backend-tjänster.

Plattformen betonar tidig feldetektering genom statisk analys, vilket gör det möjligt för organisationer att identifiera problematiska mönster innan de manifesterar sig som körtidsfel. Klocwork positioneras vanligtvis som ett kvalitets- och säkerhetssäkringsverktyg snarare än en portföljomfattande analyslösning.

Samtidighets- och tillförlitlighetsorienterad statisk analys

Kärnan i Klocwork är en statisk analysmotor utformad för att identifiera defekter som uppstår från komplexa exekveringsscenarier. Detta inkluderar problem relaterade till minneshantering, resurshantering och synkronisering. Motorn är särskilt effektiv på att upptäcka defekter associerade med parallell exekvering, där subtila interaktioner mellan trådar kan leda till oförutsägbart beteende.

Dess förmåga att resonera kring samtidiga kodvägar gör Klocwork relevant i miljöer där programvara måste fungera tillförlitligt under belastning. Analysresultat inkluderar ofta fynd relaterade till dödlägen, kapplöpningsförhållanden och felaktiga synkroniseringskonstruktioner. Dessa funktioner stöder organisationer som försöker minska instabilitet orsakad av svårreproducerade samtidighetsdefekter som loppförhållanden.

Språkfokus och prestationskänsliga domäner

Klocwork erbjuder starkt stöd för språk som vanligtvis används i systemnivå- och prestandakritisk programvara, inklusive C, C++ och Java. Detta fokus överensstämmer med dess användning inom områden där lågnivåkorrekthet och effektivitet i körning är avgörande. Genom att koncentrera sig på en smalare uppsättning språk levererar plattformen djupare analyser för dessa miljöer jämfört med bredare, mer generaliserade verktyg.

Denna specialisering begränsar dock även dess tillämpbarhet över heterogena företagsmiljöer. Klocwork är inte utformat för att analysera batchorienterade arbetsbelastningar, stordatorspråk eller skriptmiljöer på hög nivå som är vanliga i långlivade företagssystem. Som ett resultat används det ofta selektivt snarare än som en universell analyslösning.

Integrering i företagets kvalitets- och säkerhetsarbetsflöden

Klocwork integreras med arbetsflöden för företagsutveckling, inklusive CI/CD-pipelines och system för felspårning. Skanningar kan automatiseras och resultaten dirigeras till utvecklingsteam för åtgärd. Plattformen stöder stegvis analys, vilket gör att team kan fokusera på nyligen introducerade problem samtidigt som de bibehåller insyn i befintliga fel.

I många organisationer används Klocwork som en del av formella kvalitetssäkringsprocesser. Analys kan utlösas i viktiga skeden, såsom validering före release eller större omstruktureringar. Detta användningsmönster återspeglar dess roll i att säkerställa tillförlitlighet och säkerhet snarare än att stödja kontinuerlig arkitekturutforskning.

Skalbarhetsegenskaper och operativt omfång

Klocwork är konstruerat för att skalas över stora kodbaser, vilket möjliggör analys av betydande system utan överdriven prestandabelastning. Centraliserade dashboards ger insyn i feltrender och åtgärdsframsteg i projekt. Dessa vyer stöder ledningens tillsyn och hjälper team att prioritera korrigerande åtgärder baserat på allvarlighetsgrad och påverkan.

Trots sin skalbarhet vad gäller kodvolym är Klocworks analytiska omfattning fortfarande lokaliserad till enskilda applikationer eller komponenter. Den modellerar inte beroenden mellan applikationer, batchkörningsordning eller datalinje över plattformar. Dess insikter fokuserar på kodkorrekthet snarare än systemomfattande beteende.

Typiska användningsfall och begränsningar för företag

Klocwork är mest effektivt i företag som kräver högkonfidensdetektering av samtidighets- och tillförlitlighetsfel i prestandakänslig programvara. Det utmärker sig på att avslöja problem som är svåra att reproducera genom testning och som kan orsaka intermittenta eller katastrofala fel i produktionsmiljöer.

Dess begränsningar blir tydliga i transformationsinitiativ som kräver en helhetsförståelse av applikationsportföljer, exekveringsflöden eller moderniseringens påverkan. Klocwork tillhandahåller inte kartläggning av arkitekturberoenden eller konsekvensanalys på exekveringsnivå, och det kompletteras vanligtvis av verktyg som fokuserar på bredare systemförståelse och riskbedömning av förändringar i heterogena företagsmiljöer.

Statisk analys av OpenText DevOps Cloud

OpenText DevOps Cloud Static Analysis är en statisk analysfunktion för företag som levereras som en del av en bredare DevOps- och applikationslivscykelhanteringssvit. Dess primära roll inom stora organisationer är att tillhandahålla standardiserade kodkvalitets- och säkerhetskontroller som överensstämmer med etablerade leveransstyrningsmodeller. Snarare än att fungera som en fristående djupanalysplattform används den vanligtvis av företag som prioriterar verktygskedjekonsolidering och centraliserad tillsyn över utvecklings-, test- och releaseprocesser.

Plattformen används oftast i miljöer där programvaruleverans måste följa formella kontroller och där integration med befintliga ALM-, test- och releasehanteringsverktyg är ett centralt krav. Dess värde ligger i konsekvens och styrningsanpassning snarare än djupgående beteende- eller arkitekturanalys.

Suite-orienterade statiska analysfunktioner

I grund och botten tillhandahåller OpenText DevOps Cloud Static Analysis regelbaserad inspektion av källkod för att identifiera kvalitetsproblem och säkerhetsbrister. Analysen fokuserar på vanliga felkategorier, överträdelser av kodningsstandarder och sårbarhetsmönster som kan upptäckas utan att applikationen körs. Resultaten normaliseras och presenteras via centraliserade dashboards tillsammans med andra DevOps-mått.

Denna svitorienterade metod stöder organisationer som vill att statisk analys ska fungera som en komponent i ett större ramverk för leveranskontroll. Genom att bädda in analys i en integrerad plattform kan företag tillämpa grundläggande standarder i alla team utan att introducera ytterligare punktverktyg i redan komplexa miljöer.

Integrering med Enterprise Delivery Governance

OpenTexts statiska analysfunktioner är tätt integrerade med bredare livscykelhanteringsfunktioner som kravspårning, testning och releaseorkestrering. Denna integration gör det möjligt att länka analysresultat till arbetsuppgifter, defekter och godkännanden, vilket stöder spårbarhet genom hela leveransprocessen. För organisationer med formella styrningsmodeller förenklar denna anpassning tillsyn och rapportering.

Plattformen är ofta positionerad för att stödja strukturerade förändringsledning processer, där programvarumodifieringar måste gå igenom definierade gransknings- och godkännandefaser. Statiska analysresultat blir en del av de bevis som används för att bedöma beredskap för lansering snarare än en fristående källa till teknisk insikt.

Språktäckning och standardiseringsfokus

OpenText DevOps Cloud Static Analysis stöder en rad vanliga företagsprogrammeringsspråk, vilket möjliggör konsekvent tillämpning av kodningsstandarder i olika utvecklingsteam. Dess språkstöd är inriktat på vanliga applikationsutvecklingsstackar snarare än nisch- eller äldre miljöer.

Även om denna bredd stöder standardisering, förblir analysdjupet relativt grunt jämfört med specialiserade verktyg. Plattformen försöker inte modellera exekveringsvägar, lösa batch-orkestreringslogik eller analysera beroenden mellan applikationer. Dess resultat är bäst lämpade för att identifiera lokaliserade problem inom enskilda kodbaser.

Skalbarhet och operativa egenskaper

OpenText DevOps Cloud Static Analysis är utformad för att fungera som en del av en molnlevererad svit och skalar över flera projekt och team med centraliserad administration. Detta gör den lämplig för företag som söker enhetliga kontroller över stora utvecklarpopulationer. Prestandan skalas med molninfrastruktur, vilket minskar behovet av dedikerade lokala resurser.

Skalbarhet i detta sammanhang hänvisar dock till organisatorisk täckning snarare än analytiskt djup. Plattformen ger bred insyn i projekt men begränsad insikt i hur system beter sig vid körning eller hur förändringar sprids genom komplexa, sammankopplade miljöer.

Typiska användningsfall och begränsningar för företag

OpenText DevOps Cloud Static Analysis är mest effektivt i företag som värdesätter integrerad leveransstyrning och standardiserade kontroller framför djupgående teknisk utforskning. Det stöder miljöer där statisk analys är en kontrollpunkt bland många inom en kontrollerad releaseprocess, vilket ger konsekvent tillämpning av grundläggande kvalitets- och säkerhetskrav.

Dess begränsningar blir uppenbara i scenarier som kräver detaljerad förståelse av exekveringsbeteende, beroendekedjor eller moderniseringspåverkan över heterogena system. Plattformen tillhandahåller inte den beteendemässiga insyn eller konsekvensbedömning som behövs för att säkert genomföra storskaliga refaktorerings- eller moderniseringsinitiativ, och den kompletteras ofta av verktyg som specialiserar sig på exekveringsinsikt och plattformsoberoende analys.

SCA Solutions kapacitetsbaserad jämförelsetabell

| Capability | SMART TS XL | SonarQube Ent | Checkmarx ett | Befäst SCA | CAST-höjdpunkt | CAST-avbildning | Vera kod | Coverity | Parasoft | Klockwork | OpenText |

|---|---|---|---|---|---|---|---|---|---|---|---|

| Skala för företagsportföljen | ✅ Utmärkt | ◐ Måttlig | ◐ Måttlig | ◐ Måttlig | ✅ Utmärkt | ✅ Utmärkt | ◐ Måttlig | ◐ Måttlig | ◐ Måttlig | ◐ Måttlig | ◐ Måttlig |

| Multiplattform (stordator + distribuerad) | ✅ Full | ❌ Nej | ❌ Nej | ❌ Begränsat | ❌ Begränsat | ❌ Begränsat | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Begränsat |

| Stöd för äldre språk (COBOL, JCL, RPG) | ✅ Full | ❌ Nej | ❌ Nej | ❌ Begränsat | ❌ Begränsat | ❌ Begränsat | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej |

| Analys av systemberoenden | ✅ Full | ❌ Nej | ❌ Nej | ❌ Nej | ◐ Hög nivå | ◐ Strukturell | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej |

| Synlighet för exekveringsväg (statisk) | ✅ Full | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ◐ Delvis | ◐ Delvis | ◐ Delvis | ❌ Nej |

| Batch- och jobbflödesanalys | ✅ Full | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej |

| Konsekvensanalys före förändring | ✅ Djup | ◐ Grunt | ◐ Endast säkerhet | ◐ Endast säkerhet | ◐ Portfölj | ◐ Strukturell | ◐ Endast säkerhet | ◐ Kodnivå | ◐ Kodnivå | ◐ Kodnivå | ◐ Styrning |

| Detektering av säkerhetssårbarheter (SAST) | ◐ Kontextuell | ◐ Grundläggande | ✅ Stark | ✅ Stark | ◐ Indikativ | ❌ Nej | ✅ Stark | ◐ Begränsad | ◐ Begränsad | ◐ Begränsad | ◐ Grundläggande |

| Insikt i prestanda och komplexitet | ✅ Djup | ◐ Mätvärden | ❌ Nej | ❌ Nej | ◐ Aggregat | ◐ Strukturell | ❌ Nej | ◐ Defektbaserad | ◐ Efterlevnad | ◐ Defektbaserad | ❌ Nej |

| Analys av moderniseringsberedskap | ✅ Infödd | ❌ Nej | ❌ Nej | ❌ Nej | ✅ Primär | ◐ Strukturell | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej |

| Sök bland alla tillgångar | ✅ Avancerat | ◐ Endast förvaring | ◐ Endast förvaring | ◐ Endast förvaring | ◐ Metadata | ◐ Metadata | ◐ Endast förvaring | ◐ Endast förvaring | ◐ Endast förvaring | ◐ Endast förvaring | ◐ Endast förvaring |

| CI/CD-integration | ◐ Valfritt | ✅ Stark | ✅ Stark | ◐ Måttlig | ❌ Nej | ❌ Nej | ✅ Stark | ◐ Måttlig | ◐ Måttlig | ◐ Måttlig | ✅ Infödd |

| Revisionsklar bevisgenerering | ✅ Infödd | ◐ Begränsad | ◐ Begränsad | ✅ Stark | ◐ Aggregat | ◐ Strukturell | ◐ Begränsad | ◐ Begränsad | ✅ Stark | ◐ Begränsad | ◐ Stark |

Andra verktyg för statisk kodanalys (begränsad företagstillämplighet)

- ESLint

- fördelar: Upprätthåller kodningsstandarder i JavaScript och TypeScript med snabb feedback från utvecklare.

- Begränsningar: Fungerar på arkivnivå utan insyn i systemövergripande eller företagsövergripande påverkan.

- PMD

- fördelar: Upptäcker vanliga problem med kodkvalitet i flera programmeringsspråk.

- Begränsningar: Regelbaserad analys är olämplig för stora, heterogena företagsfastigheter.

- Flake8

- fördelar: Lätt statisk analys för Python-syntax och stiltillämpning.

- Begränsningar: Ger inte insikter på arkitektur- eller utförandenivå.

- Bandit

- fördelar: Identifierar säkerhetsproblem i Python-kod med hjälp av mönsterbaserad analys.

- Begränsningar: Begränsat omfattning och ingen medvetenhet om interaktioner mellan företagssystem.

- CodeQL

- fördelar: Frågebaserad analys som kan identifiera komplexa sårbarhetsmönster.

- Begränsningar: Kräver specialiserad expertis och saknar modellering för företagsexekvering.

- Semgrep

- fördelar: Snabb, anpassningsbar mönstermatchning för säkerhets- och kvalitetskontroller.

- Begränsningar: Mönsterdriven metod saknar beroende och beteendemässigt sammanhang.

- Snyk kod

- fördelar: Utvecklarvänlig statisk analys integrerad i molnbaserade arbetsflöden.

- Begränsningar: Fokuserad på säkerhet på applikationsnivå snarare än företagsarkitektur.

- pylint

- fördelar: Tillhandahåller detaljerade kodkvalitetskontroller för Python-projekt.

- Begränsningar: Inte utformad för analys över flera projekt eller plattformar.

- Cppcheck

- fördelar: Statisk analys med öppen källkod för C och C++ med låga falskt positiva resultat.

- Begränsningar: Begränsad skalbarhet och stöd för företagsstyrning.

- Antyda

- fördelar: Upptäcker minnes- och samtidighetsproblem med hjälp av avancerade analystekniker.

- Begränsningar: Begränsat språkstöd och begränsad företagsintegration.

- LGTM

- fördelar: Kombinerar statisk analys med molnbaserade arbetsflöden för kodgranskning.

- Begränsningar: Arkivcentrerad med begränsad insikt på systemnivå.

- FxCop-analysatorer

- fördelar: Upprätthåller design- och kodningsriktlinjer för .NET-applikationer.

- Begränsningar: Tar inte hänsyn till beroenden mellan applikationer.

- PHPCS

- fördelar: Upprätthåller kodningsstandarder i PHP-projekt.

- Begränsningar: Stilfokuserad med minimalt analytiskt djup.

- SpotBugs

- fördelar: Identifierar vanliga felmönster i Java-bytekod.

- Begränsningar: Mönsterbaserad detektion utan modellering av exekveringsväg.

- Bromsare

- fördelar: Specialiserad säkerhetsskanning för Ruby on Rails-applikationer.

- Begränsningar: Ramverksspecifik och olämplig för företagsomfattande analys.

- ReSharper kommandoradsverktyg

- fördelar: Integrerar statisk analys i .NET-byggpipelines.

- Begränsningar: Fokus på utvecklarproduktivitet snarare än företagsinsikt.

- DeepSource

- fördelar: Automatiserad kodgranskning och kvalitetsanalys för moderna arkiv.

- Begränsningar: SaaS-centrerad med begränsat strukturellt analysdjup.

- Codacy

- fördelar: Centraliserad kvalitetsrapportering över flera databaser.

- Begränsningar: Aggregeringsfokuserad utan djup systemförståelse.

- Sonatype Lift

- fördelar: Säkerhets- och kvalitetsskanning integrerad i DevOps-arbetsflöden.

- Begränsningar: Begränsad insyn i körningsbeteende och äldre system.

- NBeroende

- fördelar: Tillhandahåller beroendeanalys för .NET-applikationer.

- Begränsningar: Teknikspecifik och inte lämplig för heterogena fastigheter.

- Coverity Scan (öppen källkod)

- fördelar: Gratis statisk analys för utvalda projekt med öppen källkod.

- Begränsningar: Inte representativt för företagsdistributionsscenarier.

- OWASP-beroendekontroll

- fördelar: Identifierar kända sårbara beroenden.

- Begränsningar: Analyserar inte källkodens beteende eller arkitektur.

- Rostklippande

- fördelar: Lints Rust-kod för idiomatiska problem och vanliga misstag.

- Begränsningar: Språkspecifik utan företagskontext.

- GolangCI-Lint

- fördelar: Aggregerar flera linters för Go-projekt.

- Begränsningar: Utvecklarcentrerad utan insikt på portföljnivå.

- SwiftLint

- fördelar: Tillämpar Swift-kodningskonventioner i mobila projekt.

- Begränsningar: Begränsad omfattning och relevans för företagssystem.

I jämförelsen framträder en tydlig skillnad mellan verktyg utformade för att upprätthålla lokaliserade kvalitets- eller säkerhetskontroller och plattformar som kan stödja företagsomfattande förståelse. Många lösningar utmärker sig inom snävt definierade omfattningar, såsom feedback från utvecklare, sårbarhetsdetektering eller arkitektonisk visualisering, men förblir begränsade när de tillämpas på heterogena system som består av äldre plattformar, batch-arbetsbelastningar och tätt sammankopplade system. I dessa miljöer är den begränsande faktorn inte avsaknaden av analys, utan fragmenteringen av insikter mellan separata verktyg.

Modernisering, riskhantering och efterlevnadsinitiativ på företagsnivå kräver i allt högre grad analyser som spänner över språk, plattformar och exekveringsmodeller utan att offra djup eller prestanda. Verktyg som huvudsakligen arbetar vid databas- eller applikationsgränser kämpar för att ge tillräckligt sammanhang för ändringsbeslut som påverkar nedströmssystem, delade data eller driftsstabilitet. Som ett resultat av detta finner företag sig ofta kombinera flera verktyg för att få en helhetsbild, vilket introducerar ytterligare komplexitet och samordningskostnader.

Jämförelsen belyser att den mest avgörande skillnaden år 2026 inte är förmågan att upptäcka enskilda defekter eller upprätthålla kodningsstandarder, utan förmågan att exponera hur system beter sig som sammankopplade helheter. Statisk analys som förblir begränsad till isolerade artefakter ger minskande värde i takt med att den arkitektoniska komplexiteten växer. Plattformar som förenar identifiering, beroendeanalys och konsekvensbedömning över hela portföljer ger en mer hållbar grund för beslutsfattande i stora, verksamhetskritiska miljöer.

Hur verktyg för analys av statisk kod för företag utvärderas

Verktyg för statisk kodanalys i företag utvärderas mot en fundamentalt annan uppsättning kriterier än de som används för utvecklarcentrerade eller säkerhetsbaserade verktyg. I stora organisationer är den primära utmaningen sällan avsaknaden av analys, utan snarare fragmenteringen av insikter mellan separata verktyg, team och plattformar. Utvärderingen fokuserar därför på om ett verktyg kan fungera som ett enhetligt analyslager över heterogena miljöer snarare än som en lokal inspektionsmekanism.

I takt med att programvarutillgångar blir äldre och mer sammankopplade måste utvärderingen också ta hänsyn till de operativa konsekvenserna av förändringar. Statiska analysresultat som inte kan översättas till handlingsbar förståelse för exekveringsbeteende, beroendeomfattning eller nedströmspåverkan ger begränsat värde i miljöer där avbrott, regelöverträdelser eller prestandaregressioner medför väsentlig risk. Följande utvärderingsdimensioner återspeglar hur företag bedömer verktyg för statisk kodanalys år 2026 när arkitekturkomplexitet och moderniseringstryck möts.

Analysdjup kontra detektering på ytnivå

En av de viktigaste utvärderingsdimensionerna är djupet med vilket ett statiskt kodanalysverktyg kan resonera om programvarans beteende. Ytlig detektering fokuserar på att identifiera lokaliserade problem som syntaxöverträdelser, regelöverträdelser eller kända sårbarhetsmönster. Även om dessa resultat är användbara inom kontrollerade utvecklingsarbetsflöden, ger de begränsad insikt i hur förändringar påverkar komplexa system som består av många interagerande komponenter.

Djupanalys, däremot, undersöker hur kontrollflöde, dataspridning och beroendeförhållanden utvecklas över en applikation eller portfölj. Detta inkluderar att förstå hur en variabel fylls i, transformeras och konsumeras i flera exekveringskontexter, eller hur en till synes isolerad förändring i en modul påverkar batchjobb, nedströmstjänster eller rapporteringslager. Verktyg som kan hantera denna nivå av resonemang går bortom inspektion på filnivå och mot förståelse på systemnivå.

Företag prioriterar i allt högre grad djupgående analyser eftersom moderniseringsinitiativ ofta innebär att modifiera äldre logik utan fullständig dokumentation eller institutionell kunskap. I sådana fall skapar ytliga resultat en falsk känsla av förtroende, vilket uppmuntrar till förändringar som verkar säkra lokalt men introducerar instabilitet på andra ställen. Djupgående analyser minskar denna risk genom att avslöja dolda kopplingar och indirekta beroenden före genomförande.

Djup påverkar också hur analysresultat konsumeras. Grundläggande verktyg genererar vanligtvis stora volymer fynd som kräver manuell prioritering, medan djupare verktyg kan kontextualisera fynd inom exekveringsvägar eller påverkanszoner. Denna distinktion påverkar produktivitet och förtroende. När team upprepade gånger stöter på falska positiva resultat eller irrelevanta varningar, minskar förtroendet för analysen. Utvärderingen beaktar därför inte bara vad ett verktyg upptäcker, utan hur meningsfullt dessa upptäckter kopplas till verkligt systembeteende.

Denna distinktion är särskilt relevant i miljöer där prestandaegenskaper är lika viktiga som korrekthet. Att förstå varför latens uppstår eller var resurskonflikter uppstår kräver ofta insikt i exekveringsstrukturen snarare än isolerade defekter. Verktyg som stöder resonemang över kontrollflöden och beroendekedjor ger en starkare grund för prestandatekniska insatser som de som beskrivs i spårning av programvaruprestanda.

Skalbarhet över företagsportföljer

Skalbarhet inom analys av statisk kod i företag är inte begränsad till att bearbeta stora volymer källkod. Det omfattar också möjligheten att analysera, fråga och visualisera relationer över tusentals applikationer, flera plattformar och årtionden av ackumulerad logik utan att försämra responsivitet eller användbarhet. Utvärdering beaktar därför både beräkningsmässig skalbarhet och kognitiv skalbarhet.

Ur ett beräkningsperspektiv behöver företag verktyg som kan mata in miljontals eller miljarder rader kod och tillhörande artefakter inom rimliga tidsramar. Detta inkluderar inte bara källfiler, utan även definitioner för jobbkontroll, databasscheman, konfigurationsfiler och stödjande dokumentation. Verktyg som kräver långvariga indexeringscykler eller frekvent omarbetning kämpar för att hålla jämna steg med kontinuerliga förändringar, vilket minskar deras praktiska värde.

Kognitiv skalbarhet är lika viktigt. Allt eftersom portföljer växer, förskjuts utmaningen från att hitta information till att förstå den. Utvärderingen undersöker om ett verktyg kan presentera analysresultat på sätt som skalar med komplexiteten, såsom interaktiva beroendekartor, filtrerade konsekvensvyer eller lagerbaserade abstraktioner. Statiska rapporter eller platta listor blir alltmer oanvändbara i takt med att systemstorleken ökar.

En annan aspekt av skalbarhet handlar om användarnas samtidighet. Företagsanalysplattformar nås ofta av utvecklare, arkitekter, granskare och driftsteam samtidigt. Verktyg som främst är utformade för enskilda utvecklare kanske inte stöder delad åtkomst till analysresultat i realtid. Utvärdering inkluderar därför hur väl ett verktyg stöder samarbetsbaserad användning utan att skapa konkurrens eller prestandaflaskhalsar.

Skalbarhet överlappar också kostnadsmodeller. Verktyg som kräver stor beroende av produktionsmiljöer eller specialiserad infrastruktur kan medföra dolda driftskostnader. Företag utvärderar ofta om analysarbetsbelastningar kan flyttas över till kostnadseffektiva plattformar utan att offra noggrannhet eller aktualitet. Denna övervägning blir särskilt relevant i storskaliga miljöer där analyser utförs kontinuerligt snarare än periodiskt.

I slutändan utvärderas skalbarhet i termer av hållbar användbarhet under företagsförhållanden snarare än enbart maximal genomströmning. Ett verktyg som presterar bra på isolerade projekt men försämras i takt med att portföljens omfattning expanderar misslyckas med att uppfylla företagets krav.

Synlighet av beroende och medvetenhet om påverkan

Beroendesynlighet är ett avgörande kriterium för analys av statisk kod i företag eftersom det direkt påverkar förmågan att hantera förändringar på ett säkert sätt. I komplexa system är beroenden sällan i linje med organisationsgränser eller arkitekturdiagram. De uppstår organiskt över tid genom delade datastrukturer, återanvänd logik och implicit exekveringsordning. Utvärderingen fokuserar därför på om ett verktyg kan belysa dessa relationer korrekt och heltäckande.

Effektiv beroendesynlighet kräver mer än att identifiera direkta anropsrelationer. Det innebär att spåra indirekta beroenden över lager, plattformar och exekveringskontexter. Till exempel kan ett databasfält som modifieras i en applikation påverka rapporteringsjobb, regulatoriska utdrag eller nedströms analyspipelines. Verktyg som bara modellerar direkta kodreferenser missar dessa sekundära och tertiära effekter.