Virksomhedssoftwarelandskaber, der træder ind i 2026, fortsætter med at vokse i strukturel kompleksitet snarere end enkelhed. Årtiers akkumuleret logik, blandede programmeringssprog, hybride implementeringsmodeller og tæt koblede afhængigheder begrænser i stigende grad, hvordan ændringer kan introduceres uden utilsigtede konsekvenser. I dette miljø ses statiske kodeanalyseværktøjer ikke længere som valgfri kvalitetskontrol, men som grundlæggende instrumenter til at forstå, hvordan systemer rent faktisk opfører sig, før enhver modernisering, refactoring eller sikkerhedsinitiativ begynder.

Det, der adskiller statisk kodeanalyse i virksomhedsskala fra udviklerorienterede værktøjer, er ikke evnen til at markere isolerede defekter, men kapaciteten til at ræsonnere på tværs af hele applikationsområder. Store organisationer opererer sjældent inden for en enkelt runtime eller et enkelt arkitekturmønster. Mainframe-batchbelastninger sameksisterer med distribuerede tjenester, ældre grænseflader krydser hinanden med cloud-native API'er, og lovgivningsmæssige krav pålægger yderligere begrænsninger for, hvordan risiko kan måles og afbødes. Statisk analyse skal derfor operere på tværs af grænser og afsløre udførelsesstier, skjulte afhængigheder og strukturelle risici, der ellers er usynlige gennem test alene.

SMART TS XL

Ideel statisk kodeanalyseløsning til virksomheder med store fordelte systemer og aktiver

Udforsk nuDen stigende vægtning af kontinuerlig levering og accelereret modernisering har yderligere forstærket rollen af analysedrevet indsigt. Efterhånden som virksomheder stræber efter bredere applikationsmodernisering I forbindelse med implementering af initiativer bliver omkostningerne ved ufuldstændig forståelse stadig tydeligere. Refaktoreringsbeslutninger truffet uden fuldt indblik i kontrolflow, dataudbredelse eller tværsystemkobling introducerer ofte ustabilitet, præstationsregressioner eller compliance-eksponering, der først dukker op efter implementering. Statiske kodeanalyseværktøjer forventes nu at reducere denne usikkerhed ved at give arkitektonisk klarhed, før ændringer udføres.

På denne baggrund er kriterierne, der bruges til at evaluere værktøjer til statisk kodeanalyse i 2026, under forandring. Nøjagtighed alene er ikke tilstrækkelig. Virksomheder kræver dybdegående analyse, skalerbarhed på tværs af millioner af linjer kode, understøttelse af heterogene miljøer og evnen til at omsætte tekniske fund til handlingsrettet indsigt for arkitekter, platformledere og risikoejere. Den følgende sammenligning undersøger, hvordan førende værktøjer til statisk kodeanalyse i virksomheder klarer sig i forhold til disse udviklende krav, og hvordan deres muligheder stemmer overens med realiteterne i store, missionskritiske systemer.

Sammenligning og rangering af værktøjer til analyse af statiske koder i virksomheder for 2026

Sammenligningen nedenfor evaluerer førende værktøjer til statisk kodeanalyse i forhold til kriterier, der er vigtige i store virksomhedsmiljøer snarere end individuelle udviklingsteams. Hvert værktøj vurderes baseret på analysedybde, skalerbarhed på tværs af heterogene systemer, understøttelse af ældre og moderne platforme og dets evne til at frembringe meningsfuld indsigt fra komplekse afhængighedsstrukturer. Rangeringen afspejler, hvor effektivt disse værktøjer muliggør arkitekturforståelse, risikoidentifikation og informeret beslutningstagning i miljøer, hvor forandring har betydelige operationelle og lovgivningsmæssige konsekvenser.

SMART TS XL

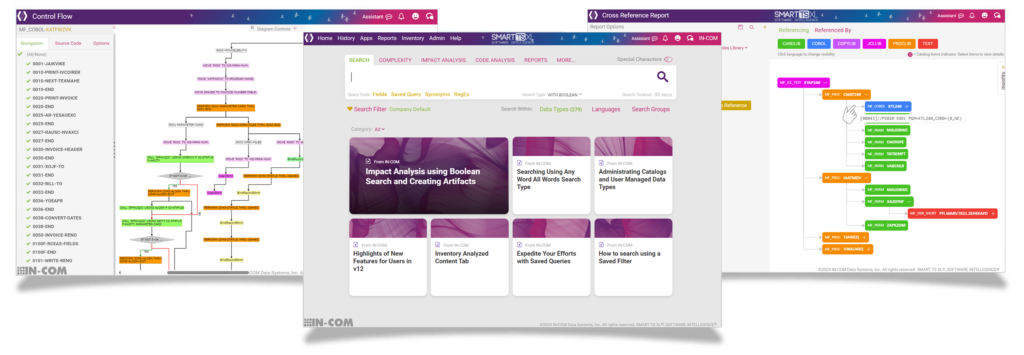

SMART TS XL er en platform til statisk kodeanalyse, konsekvensanalyse og applikationsintelligens i virksomheder, der er designet til store, heterogene softwareprogrammer. Den er bygget til at understøtte organisationer, der opererer på tværs af mainframe-, mellemstore og distribuerede miljøer, hvor årtiers akkumuleret logik, batchbehandling og afhængigheder på tværs af platforme gør ændringer i sagens natur risikable. I stedet for at fokusere på isolerede resultater af kodekvalitet, SMART TS XL er designet til at afdække, hvordan applikationer rent faktisk opfører sig, ved at gøre udførelsesstier, dataforhold og afhængighedsstrukturer synlige på tværs af hele porteføljer.

Platformen fungerer som et højtydende, webbaseret system, der er i stand til at indeksere og analysere milliarder af kodelinjer og tilhørende artefakter på få sekunder. Ved at aflaste analysearbejdsbyrder fra produktionssystemer og centralisere indsigt i et delt miljø, SMART TS XL understøtter tusindvis af samtidige brugere uden forringelse af ydeevnen. Denne skala gør den velegnet ikke kun til udviklingsteams, men også til arkitekter, moderniseringsledere, produktionssupport, revision og compliance-interessenter, der kræver ensartet, evidensbaseret indsigt i komplekse systemer. Anmod om en demo.

Statisk analyse og opdagelse i virksomhedsskala

I sin kerne SMART TS XL leverer dybdegående statisk analyse på tværs af et bredt sæt af programmeringssprog, jobkontrolkonstruktioner, databaser og understøttende artefakter. Den understøtter ældre og moderne teknologier, herunder COBOL, PL/I, Natural, RPG, Assembler, Java, C#, Python, VB6, UNIX-scripts, JCL, PROC'er, CICS-artefakter, MQ-definitioner, databaseskemaer og strukturerede dokumenter. Kildekode, batchlogik, konfigurationsfiler og endda ikke-kodeartefakter såsom dokumentation og diagrammer kan indekseres og analyseres sammen, hvilket gør det muligt at opdage relationer på tværs af traditionelt silobaserede repositorier.

Denne samlede opdagelsesfunktion giver organisationer mulighed for at bevæge sig ud over inspektion på filniveau og hen imod forståelse på systemniveau. Programmer, job, felter, filer, tabeller og meddelelser kan spores på tværs af platforme, hvilket afslører, hvordan forretningslogik flyder gennem batchkæder, onlinetransaktioner og downstream-rapporteringsprocesser. Disse relationer vises gennem interaktive krydsreferencerapporter, afhængighedskort og navigerbare udførelsesvisninger i stedet for statiske lister.

Analyse af påvirkning på tværs af platforme og afhængighedskortlægning

SMART TS XL lægger særlig vægt på tværs af platformskonsekvensanalyse. Ændringer, der introduceres i én del af en applikation, forbliver sjældent isolerede i virksomhedsmiljøer, især hvor mainframe-arbejdsbelastninger interagerer med distribuerede tjenester og delte datalagre. SMART TS XL analyserer opkaldsrelationer, dataforbrug, jobudførelsesstier og kontrolflow for at identificere upstream- og downstream-påvirkningszoner på tværs af sprog og systemer.

Funktioner til afhængighedskortlægning præsenterer disse relationer visuelt ved hjælp af interaktive, farvekodede diagrammer, der fremhæver opkaldere, opkaldte modtagere, dataproducenter og forbrugere. Konsekvensanalyse kan startes fra et program, et felt, et databaseelement, et jobtrin eller endda fra søgeresultater, hvilket giver teams mulighed for at vurdere ændringer præcist, før udviklingen begynder. Denne tilgang reducerer oversete afhængigheder, begrænser overtestning og giver et forsvarligt grundlag for ændringsplanlægning og risikovurdering.

Udførelsesorienterede synspunkter på batch- og programlogik

For miljøer med kompleks batchbehandling, SMART TS XL giver runtime-lignende forståelse uden at skulle udføre kode. COBOL- og JCL-udvidelsesfunktioner løser kopibøger, PROC'er, symboler og overrides for at præsentere logik, som den effektivt kører i produktion. Batchkæder kan spores fra ende til anden, hvilket viser, hvilke programmer der udføres, i hvilken rækkefølge og med hvilke parametre.

Kontrolflowdiagrammer og flowdiagrammer oversætter dybt indlejret logik til navigerbare visuelle repræsentationer. Disse visninger gør det muligt at forstå udførelsesadfærd, identificere døde eller utilgængelige kodestier og analysere forgreningskompleksitet uden at være afhængig af stamkundskaber eller manuelle gennemgange. Feltsporingsdiagrammer udvider denne funktion yderligere ved at spore, hvordan dataelementer oprettes, transformeres og formidles på tværs af programmer, job og databaser, hvilket understøtter sikre strukturelle ændringer og lovgivningsmæssige gennemgange.

Avanceret søgning, mønsterdetektion og præcisionsanalyse

SMART TS XL inkluderer en højtydende virksomhedssøgemaskine, der er optimeret til store kodebaser med blandet teknologi. Den understøtter kompleks boolsk logik, nærhedssøgninger, bloksøgninger, regulære udtryk, synonymhåndtering og finmaskede filtre, der begrænser analysen til specifikke sprog, datatyper eller kodeafsnit. Lagdelte søgeteknikker giver brugerne mulighed for gradvist at indsnævre store resultatsæt til præcise omfang, der er egnede til konsekvensanalyse, revisioner eller moderniseringsvurderinger.

Disse søgefunktioner er tæt integreret med krydsreferencer, effektmålinger, kompleksitetsmålinger og visualiseringsfunktioner. Resultater kan drejes direkte til afhængighedsvisninger, rapporter eller yderligere analysearbejdsgange, hvilket reducerer friktionen mellem opdagelse og beslutningstagning. Gemte og parametriserede forespørgsler giver organisationer mulighed for at standardisere risikokontroller og gentagelige analysemønstre på tværs af teams og projekter.

Kompleksitethedsanalyse og risikokvantificering

SMART TS XL leverer kompleksitetsanalyse på porteføljeniveau, der rækker ud over individuelle programmer. Kompleksitethedsmålinger såsom kodelinjer, cyklomatisk kompleksitet og Halstead-målinger kan beregnes på tværs af målrettede delmængder af applikationer defineret af søgeresultater eller impact zoner. Dette gør det muligt for teams at kvantificere teknisk risiko inden for specifikke forretningsfunktioner eller moderniseringskandidater i stedet for at stole på grove, applikationsdækkende gennemsnit.

Ved at kombinere kompleksitetsmålinger med afhængigheds- og effektanalyse, SMART TS XL understøtter mere realistisk indsatsestimering og prioritering. Områder med høj kobling og høj kompleksitet kan identificeres tidligt, hvilket gør det muligt at sekvensere moderniserings- og afhjælpningsinitiativer baseret på faktisk strukturel risiko snarere end antagelser.

Vidensoverførsel, revisionsberedskab og styringsstøtte

En tilbagevendende udfordring i store virksomheder er tabet af institutionel viden, når systemerne ældes, og erfarne medarbejdere går på pension eller roterer. SMART TS XL adresserer dette ved at centralisere applikationsviden i en søgbar og udforskbar platform, der indfanger, hvordan systemer er struktureret, og hvordan de opfører sig. Dokumentation, rapporter, diagrammer og evidensartefakter kan genereres og deles for at understøtte onboarding, revisioner og lovgivningsmæssige anmodninger.

Eksportfunktioner gør det muligt at pakke analyseresultater som tidsstemplede, bevisklare artefakter, der er egnede til compliance-gennemgange, ændringsgodkendelser og eksterne revisioner. Adgangskontroller og brugssporing understøtter styringskrav, især i miljøer med offshore-udvikling eller outsourcede vedligeholdelsesmodeller.

Implementering, integration og operationel tilpasning

SMART TS XL er designet til hurtig implementering og minimal driftsforstyrrelse. Installationer kan gennemføres inden for få timer, med tilgængelige forbindelser til at indtage data fra mainframe-miljøer, distribuerede kildekontrolsystemer, databaser og delte lagre. Både fulde og trinvise dataindlæsninger understøttes, hvilket gør det muligt for miljøer at forblive aktuelle uden konstant manuel indgriben.

Automatiseringsfunktioner gør det muligt for analyseprocesser at køre uovervåget og understøtter kontinuerlig indsigtsgenerering i overensstemmelse med virksomhedens forandringscyklusser. Ved at centralisere analyse på en omkostningseffektiv infrastruktur kan organisationer reducere afhængigheden af dyre produktionsressourcer, samtidig med at de øger den analytiske dybde og tilgængelighed på tværs af teams.

SonarQube Enterprise Edition

SonarQube Enterprise Edition er en statisk kodeanalyseplatform designet til at understøtte store udviklingsorganisationer, der søger ensartet håndhævelse af kodekvalitet, vedligeholdelsesvenlighed og sikkerhedsstandarder på tværs af moderne softwareporteføljer. Dens primære rolle i virksomhedsmiljøer er at fungere som et kontinuerligt inspektionslag indlejret i udviklingsworkflows og give tidlig feedback på kodeproblemer, før ændringer når produktion. I porteføljer, hvor gennemløbshastigheden for gennemgang bliver en flaskehals, placeres den ofte sammen med bredere værktøjer til gennemgang af kode at formalisere kvalitetsgating og reducere variation på tværs af teams.

I modsætning til analyseplatforme på porteføljeniveau ligger SonarQubes styrke i dens evne til at operere tæt på udviklerens arbejdsgang. Analyse udløses typisk som en del af build-pipelines eller pull request-validering, hvilket gør det muligt for teams at opdage kodelugt, fejl og sikkerhedsproblemer trinvist, efterhånden som koden udvikler sig. Dette stemmer overens med organisationer, der standardiserer automatiserede kontroller på tværs af leveringspipelines, herunder tilgange beskrevet i CI / CD-rørledninger, hvor statisk analyse bliver en gentagelig kontrol snarere end et ad hoc-gennemgangstrin.

Regelbaseret statisk analyse og kvalitetsporte

Kernen i SonarQube Enterprise Edition er en regelbaseret statisk analysemotor, der evaluerer kildekode i forhold til et stort og konfigurerbart regelsæt. Disse regler dækker almindelige kategorier såsom vedligeholdelsesproblemer, pålidelighedsfejl og sikkerhedssårbarheder. Resultaterne klassificeres efter alvorlighed og kortlægges til kvalitetsgrænser, der bestemmer, om koden kan fortsætte gennem leveringspipelinen.

Kvalitetsporte er en central mekanisme til at håndhæve organisatoriske standarder i stor skala. Virksomheder kan definere tærskler for ny kodedækning, defektdensitet og sårbarhedseksponering og dermed sikre, at ændringer opfylder foruddefinerede kriterier før integration. Denne funktion er især værdifuld i miljøer med distribuerede teams, outsourcet udvikling eller høj udviklerudskiftning, hvor konsekvent håndhævelse reducerer afhængigheden af manuelle gennemgange.

Sprogdækning og udviklingsøkosystemintegration

SonarQube understøtter en bred vifte af moderne programmeringssprog, herunder Java, C#, JavaScript, TypeScript, Python og andre, der almindeligvis anvendes i udvikling af virksomhedsapplikationer. Dets økosystem af plugins og integrationer gør det muligt at oprette forbindelse til populære CI/CD-platforme, kildekontrolsystemer og problemsporingssystemer. Denne tætte integration gør det velegnet til organisationer, der prioriterer automatiseret kvalitetskontrol som en del af deres leveringspipelines.

SonarQubes analysemodel er dog primært kildecentreret og repository-omfattet. Selvom den kan analysere flere projekter parallelt, er dens forståelse af relationer på tværs af repositorier, platforme og udførelseskontekster begrænset. Analyse er typisk begrænset til individuelle applikationer eller tjenester i stedet for at spænde over hele virksomhedsejendomme med delte data, batch-arbejdsgange eller afhængigheder på tværs af platforme.

Sikkerhedsanalyse og compliance-support

I sine enterprise-udgaver inkluderer SonarQube forbedrede sikkerhedsanalysefunktioner, der er afstemt med almindelige sårbarhedskategorier. Den kan identificere mønstre forbundet med injektionsfejl, usikre konfigurationer og misbrug af API'er. Resultaterne præsenteres i et format, der er tilgængeligt for både udviklere og sikkerhedsteams, og understøtter afhjælpningsarbejdsgange i eksisterende værktøjer.

Fra et compliance-perspektiv tilbyder SonarQube sporbarhed og rapportering, der hjælper med at demonstrere overholdelse af interne kodningsstandarder og sikkerhedspolitikker. Rapporter kan genereres for at vise problemtendenser, afhjælpningsfremskridt og overholdelse af Quality Gate over tid. Selvom disse funktioner understøtter revisionsberedskab i udviklingsteams, er de mindre fokuserede på at producere systemniveaubevis for udførelsesadfærd eller tværsystempåvirkning.

Skalerbarhedsegenskaber og operationelle overvejelser

SonarQube Enterprise Edition er designet til at skaleres på tværs af et stort antal repositories og udviklingsteams, især når den implementeres i distribuerede eller containeriserede miljøer. Dens ydeevne skaleres med tilgængelig infrastruktur, hvilket gør den velegnet til organisationer med høje commit-volumener og hyppige analysecyklusser. Centraliserede dashboards giver samlet overblik på tværs af projekter, hvilket hjælper ledelsen med at overvåge kvalitetstendenser på højt niveau.

Når det er sagt, er SonarQubes skalerbarhed primært horisontal på tværs af projekter snarere end vertikal på tværs af systemkompleksitet. Den løser ikke runtime-eksekveringsstier, batch-orkestreringslogik eller dyb dataafstamning på tværs af heterogene platforme. I miljøer domineret af mainframe-arbejdsbelastninger, batchplanlægning eller tæt koblede ældre systemer, bruges SonarQube ofte som et supplerende værktøj snarere end en selvstændig kilde til arkitektonisk indsigt.

Typiske virksomhedsbrugsscenarier og begrænsninger

SonarQube Enterprise Edition er mest effektiv i virksomheder med stærk DevOps-modenhed, standardiserede udviklingsstakke og fokus på at forhindre kvalitetsforringelse i aktivt udviklet kode. Den udmærker sig ved at håndhæve konsistens, reducere kodelugt og integrere kvalitetskontroller i hurtige leveringspipelines.

Dens begrænsninger bliver mere tydelige i moderniseringsscenarier, der kræver forståelse af, hvordan ændringer spreder sig på tværs af store, sammenkoblede systemer. SonarQube forsøger ikke at modellere udførelsesrækkefølge, dataudbredelse på tværs af job og platforme eller systemomfattende afhængighedskæder. Som et resultat parres den ofte med dybere analyseplatforme, når virksomheder har brug for at vurdere moderniseringsrisiko, batchpåvirkning eller ændringer på tværs af porteføljer.

Checkmarx One

Checkmarx One er en virksomhedsfokuseret applikationssikkerhedsplatform centreret omkring statisk applikationssikkerhedstestning inden for moderne udviklings- og leveringspipelines. Dens primære rolle i store organisationer er at identificere sikkerhedssårbarheder tidligt i softwarens livscyklus, især i miljøer, hvor hyppige udgivelser, distribuerede teams og cloud-native arkitekturer øger eksponeringen for udnyttelige fejl. I stedet for at forsøge at modellere systemomfattende udførelsesadfærd fokuserer Checkmarx One på at detektere usikre kodningsmønstre og konfigurationssvagheder, der stemmer overens med anerkendte sikkerhedstaksonomier.

Platformen anvendes typisk af virksomheder med modne DevSecOps-praksisser, hvor sikkerhedsanalyse forventes at fungere kontinuerligt sideløbende med udviklingen snarere end som en kontrol efter udgivelsen. I sådanne miljøer fungerer Checkmarx One som en forebyggende mekanisme, der sigter mod at reducere sandsynligheden for, at sårbare kodestier introduceres i produktionssystemer.

Fokus på statisk applikationssikkerhedstest

Kernen i Checkmarx One er en statisk testmotor til applikationssikkerhed, der er optimeret til at detektere sårbarheder på kildekodeniveau. Analyse udføres uden at køre applikationer, hvilket gør det muligt at identificere problemer tidligt, ofte under kode-commit- eller build-faser. Platformen kortlægger fund til velkendte sårbarhedskategorier og understøtter sikkerhedsteams, der er afhængige af standardiserede risikoklassificeringsrammer som f.eks. OWASP-sårbarheder at prioritere afhjælpningsindsatsen.

Vægten på sikkerhedsspecifikke resultater adskiller Checkmarx One fra generelle statiske analyseværktøjer. I stedet for at fremhæve vedligeholdelses- eller arkitekturproblemer fokuserer platformen på svagheder, der kan føre til dataeksponering, uautoriseret adgang eller eskalering af privilegier. Denne specialisering gør den særligt relevant i regulerede brancher, hvor tidslinjer for afsløring af sårbarheder og afhjælpning overvåges nøje.

Integration i Enterprise DevSecOps-pipelines

Checkmarx One er designet til at integrere tæt med CI/CD-pipelines og udviklerworkflows. Scanninger kan udløses automatisk som en del af byggeprocesser, pull requests eller release gates, hvilket sikrer, at sikkerhedsanalyser udføres konsekvent og uden manuel indgriben. Resultaterne vises via dashboards og integrationer med problemsporingssystemer, hvilket gør det muligt at sende resultater direkte til udviklingsteams til afhjælpning.

Denne pipeline-centrerede driftsmodel understøtter høj udviklingshastighed, samtidig med at den opretholder et grundlæggende sikkerhedsniveau. Fokuset på individuelle repositories og tjenester betyder dog, at analysen generelt er begrænset til diskrete kodebaser. Selvom dette stemmer godt overens med mikrotjenester og modulære arkitekturer, begrænser det indsigten i afhængigheder på tværs af applikationer eller udførelseskæder på flere platforme, der er almindelige i langlivede virksomhedssystemer.

Sprogdækning og cloud-native orientering

Checkmarx One understøtter en bred vifte af moderne programmeringssprog og frameworks, der almindeligvis anvendes i virksomheds- og cloud-native udvikling. Denne bredde muliggør ensartet sikkerhedsscanning på tværs af heterogene udviklingsteams uden behov for flere specialiserede værktøjer. Platformens cloud-native leveringsmodel forenkler yderligere implementering og skalering, hvilket reducerer driftsomkostninger for organisationer, der administrerer et stort antal applikationer.

Når det er sagt, er understøttelsen af ældre teknologier og batchorienterede miljøer mere begrænset. Mainframe-sprog, jobkontrolkonstruktioner og tæt koblede ældre arbejdsgange ligger typisk uden for platformens primære anvendelsesområde. Som et resultat implementeres Checkmarx One ofte sammen med andre analyseværktøjer, når virksomheder skal sikre både moderne og ældre komponenter inden for det samme applikationslandskab.

Risikorapportering og tilpasning af ledelse

Fra et governance-perspektiv tilbyder Checkmarx One rapporteringsfunktioner, der understøtter sporing af sårbarheder, afhjælpningsstatus og compliance-rapportering. Sikkerhedsledere kan overvåge tendenser på tværs af applikationer, teams og tidsperioder, hvilket hjælper med at demonstrere overholdelse af interne politikker og eksterne lovgivningsmæssige forventninger. Resultater kan aggregeres for at vise den samlede risikoprofil, hvilket muliggør prioritering på porteføljeniveau.

Disse rapporter fokuserer dog på tilstedeværelsen af sårbarheder snarere end operationel påvirkning. Platformen forsøger ikke at kvantificere, hvordan en sårbarhed spreder sig gennem udførelsesstier, eller hvordan den interagerer med batchbehandling, datastrømme eller downstream-systemer. Denne sondring er vigtig i virksomheder, hvor forståelsen af eksplosionsradius og systemisk risiko er lige så kritisk som at identificere individuelle svagheder.

Typiske virksomhedsbrugsscenarier og begrænsninger

Checkmarx One er mest effektiv i virksomheder, der søger at integrere sikkerhedskontroller direkte i hurtigt skiftende udviklingsmiljøer. Det udmærker sig ved at identificere sikkerhedsproblemer på kodeniveau tidligt, reducere omarbejde og understøtte ensartet sårbarhedsstyring på tværs af store udviklerpopulationer. For organisationer, der moderniserer mod cloud-native arkitekturer, tilbyder det en skalerbar mekanisme til at håndhæve sikkerhedshygiejne.

Dens begrænsninger opstår i scenarier, der kræver en holistisk forståelse af applikationsadfærd, afhængighedskæder eller moderniseringens påvirkning på tværs af heterogene systemer. I sådanne tilfælde positioneres Checkmarx One typisk som et specialiseret sikkerhedslag snarere end en omfattende analyseplatform, der supplerer værktøjer, der fokuserer på udførelsesindsigt, afhængighedskortlægning og strukturel risikovurdering.

Fortify Static Code Analyzer

Fortify Static Code Analyzer er en statisk sikkerhedstestplatform til virksomheder, der er designet til at identificere sikkerhedssårbarheder i store, regulerede softwaremiljøer. Dens primære rolle i virksomheder er at levere systematisk detektion af kodningsmønstre, der introducerer sikkerhedsrisici, især i organisationer, hvor compliance, revisionsbarhed og formelle risikostyringsprocesser former, hvordan softwareændringer styres. Fortify anvendes almindeligvis i sektorer, hvor sikkerhedssikring skal være påviselig, gentagelig og i overensstemmelse med etablerede virksomhedskontroller.

I stedet for at lægge vægt på udviklercentrerede feedback-loops, positioneres Fortify ofte som en centraliseret sikkerhedskontrol inden for bredere styringsrammer. Det understøtter organisationer, der kræver standardiseret sårbarhedsklassificering, ensartet rapportering og sporbarhed på tværs af store porteføljer af applikationer udviklet af distribuerede eller tredjepartsteams.

Sikkerhedscentreret statisk analysemotor

Kernen i Fortify Static Code Analyzer er en sikkerhedsfokuseret analysemotor, der inspicerer kildekode for at identificere sårbarheder uden at køre applikationer. Motoren anvender et omfattende sæt sikkerhedsregler designet til at opdage svagheder såsom injektionsfejl, usikker datahåndtering, godkendelsesfejl og forkert brug af kryptografiske funktioner. Resultaterne kategoriseres efter alvorlighed og type, hvilket gør det muligt for sikkerhedsteams at vurdere risikoen på en struktureret og ensartet måde.

Vægten på sikkerhedskorrekthed adskiller Fortify fra generelle statiske analyseværktøjer. Analysedybden er justeret mod at identificere udnyttelsesmuligheder snarere end vedligeholdelses- eller arkitekturproblemer. Denne specialisering gør Fortify særligt velegnet til miljøer, hvor sårbarhedsdetektion prioriteres over bredere systemforståelse.

Tilpasning til Enterprise Risk and Compliance-programmer

Fortify integreres ofte i virksomheders sikkerheds- og styringsprogrammer, hvor softwarerisiko styres sammen med andre operationelle og regulatoriske risici. Virksomhedens rapporterings- og evidensgenereringsfunktioner understøtter interne revisioner, eksterne vurderinger og regulatoriske gennemgange. Resultaterne kan aggregeres på tværs af applikationer og forretningsenheder, hvilket giver sikkerhedsledere indsigt i risikoeksponering i stor skala.

Denne tilpasning til formelle IT risikostyring processer gør Fortify til et almindeligt valg i organisationer, der skal demonstrere løbende kontroleffektivitet. Rapporter kan bruges til at vise sårbarhedstendenser, afhjælpningsfremskridt og overholdelse af interne sikkerhedspolitikker, hvilket understøtter forsvarlig beslutningstagning under revisioner eller hændelsesgennemgange.

Sprogdækning og implementeringskarakteristika

Fortify Static Code Analyzer understøtter en bred vifte af programmeringssprog, der almindeligvis findes i virksomhedsmiljøer, herunder både moderne applikationsstakke og udvalgte ældre teknologier. Dette giver organisationer mulighed for at anvende en ensartet sikkerhedsanalysetilgang på tværs af forskellige udviklingsteams og teknologidomæner. Implementeringsmodeller varierer, hvor Fortify ofte installeres lokalt eller i kontrollerede virksomhedsmiljøer for at opfylde krav til dataopbevaring og sikkerhed.

Analyse udføres dog generelt på applikations- eller projektniveau. Selvom Fortify kan skaleres på tværs af mange applikationer, forsøger det ikke at løse udførelsesrækkefølge, batchorkestrering eller datastrømme på tværs af applikationer. Som et resultat forbliver dets perspektiv på risiko lokaliseret til kodeartefakter snarere end systemomfattende adfærd.

Integration i sikre udviklingslivscyklusser

Fortify integreres typisk i sikre udviklingslivscyklusser som en gating-mekanisme snarere end et kontinuerligt udforskende værktøj. Scanninger kan udløses på definerede stadier, såsom gennemgange før udgivelse, større ændringsvinduer eller compliance-kontrolpunkter. Denne driftsmodel er i overensstemmelse med organisationer, der foretrækker kontrollerede udgivelsesprocesser og formelle godkendelser frem for kontinuerlig implementering.

Selvom integrationer med CI/CD-værktøjer er tilgængelige, afspejler Fortifys brugsmønstre ofte en balance mellem automatisering og centraliseret tilsyn. Sikkerhedsresultater gennemgås af specialiserede teams, der vurderer afhjælpningskrav og risikoacceptbeslutninger, hvilket styrker ensartetheden i styringen på tværs af virksomheden.

Typiske virksomhedsbrugsscenarier og begrænsninger

Fortify Static Code Analyzer er mest effektiv i virksomheder, hvor sikkerhedssikring, revisionsberedskab og overholdelse af lovgivning er dominerende drivkræfter. Den tilbyder en struktureret og forsvarlig tilgang til at identificere sikkerhedssårbarheder på kodeniveau og demonstrere, at der er kontroller på plads til at opdage og håndtere dem.

Dens begrænsninger bliver tydelige i scenarier, der kræver forståelse af, hvordan sårbarheder interagerer med udførelsesadfærd, batchbehandling eller afhængigheder på tværs af platforme. Fortify modellerer ikke runtime-adfærd eller systemomfattende påvirkning, og det suppleres ofte af værktøjer, der giver dybere indsigt i applikationsstruktur, afhængighedskæder og moderniseringsrisiko på tværs af heterogene miljøer.

CAST Fremhæv

CAST Highlight er en platform til intelligens og porteføljevurdering af virksomhedsapplikationer, der er designet til at give et højt niveau af indsigt i softwarekvalitet, risiko og moderniseringsberedskab på tværs af store applikationsområder. Dens primære rolle i virksomhedsmiljøer er at understøtte strategisk beslutningstagning ved at opsummere strukturelle karakteristika, indikatorer for teknisk gæld og signaler om cloud-egnethed i stedet for at udføre dybdegående, udførelsesorienteret kodeanalyse. CAST Highlight anvendes ofte tidligt i moderniseringsprogrammer for at etablere en grundlæggende forståelse af porteføljetilstanden.

I modsætning til udviklercentrerede statiske analyseværktøjer fungerer CAST Highlight på et aggregeret niveau. Det er beregnet til at hjælpe arkitekter, porteføljeforvaltere og transformationsledere med at sammenligne applikationer, identificere kandidater til modernisering og prioritere afhjælpningsindsatser på tværs af hundredvis eller tusindvis af systemer.

Analyse på porteføljeniveau og softwareintelligens

Kernen i CAST Highlight er en letvægtsanalysemotor, der udtrækker strukturelle metadata fra applikationens kildekode og konfigurationsartefakter. Disse data normaliseres til en fælles analytisk model, der gør det muligt at vurdere forskellige applikationer ved hjælp af ensartede kriterier. Metrikker relateret til kodekvalitet, vedligeholdelsesvenlighed, sikkerhedseksponering og arkitektonisk egnethed beregnes og præsenteres via dashboards og sammenlignende visninger.

Disse kapaciteter stemmer overens med bredere software intelligens initiativer, hvor målet er at omdanne rå kodeartefakter til beslutningsklar indsigt for interessenter, der ikke er udviklere. Ved at abstrahere kompleksitet til standardiserede indikatorer gør CAST Highlight det muligt for ledelsesteams at ræsonnere om store porteføljer uden at skulle udføre detaljeret kodeinspektion.

Moderniseringsberedskab og vurdering af cloud-egnethed

CAST Highlight lægger særlig vægt på at evaluere applikationer med henblik på modernisering og parathed til cloud-migrering. Den vurderer faktorer som brug af frameworks, afhængighedsmønstre og teknologiens aktualitet for at estimere den indsats og risiko, der er forbundet med at flytte applikationer til moderne platforme. Resultaterne bruges ofte til at gruppere applikationer i kategorier som rehosting, refactoring, replace eller pensioning.

Denne vurderingsdrevne tilgang understøtter planlægnings- og budgetteringsaktiviteter i den tidlige fase. Virksomheder kan bruge CAST Highlight-output til at opbygge moderniseringskøreplaner, estimere transformationsomfang og kommunikere risikoprofiler til virksomhedens interessenter. Analysen er dog bevidst bred og forsøger ikke at modellere detaljeret udførelsesadfærd eller bivirkninger af transformationen.

Indikatorer for sikkerhed og teknisk gæld

Ud over moderniseringssignaler leverer CAST Highlight overordnede indikatorer relateret til sikkerhedssvagheder og teknisk gæld. Disse indikatorer er afledt af kendte mønstre forbundet med øgede vedligeholdelsesomkostninger eller forhøjet sårbarhedseksponering. Hensigten er ikke at erstatte dedikerede sikkerhedsscanningsværktøjer, men at fremhæve områder, hvor en dybere undersøgelse kan være berettiget.

Fordi resultaterne er aggregerede, er de bedst egnede til sammenlignende analyser snarere end afhjælpningsplanlægning. Sikkerheds- og gældsindikatorer hjælper organisationer med at forstå den relative risikofordeling på tværs af porteføljer, men de identificerer ikke specifikke udførelsesstier, datastrømme eller operationelle afhængigheder, der ville blive påvirket af kodeændringer.

Skalerbarhed og operationel model

CAST Highlight er designet til effektivt at skalere på tværs af meget store applikationsporteføljer. Dens lette analysemetode minimerer behandlingsomkostninger og muliggør hurtig onboarding af nye applikationer. Dette gør den særligt velegnet til virksomheder, der udfører brede undersøgelser af deres softwarelandskaber under fusioner, frasalg eller tidlige moderniseringsinitiativer.

Ulempen ved denne skalerbarhed er analytisk dybde. CAST Highlight løser ikke kaldgrafer, batchudførelseskæder eller dataudbredelse på tværs af platforme. Som et resultat bruges det ofte i forbindelse med dybere analyseværktøjer, når specifikke applikationer eller transformationsinitiativer går fra planlægning til udførelse.

Typiske virksomhedsbrugsscenarier og begrænsninger

CAST Highlight er mest effektivt i virksomheder, der har brug for et overordnet, sammenlignende overblik over applikationsporteføljer for at understøtte strategisk planlægning. Det udmærker sig ved at identificere moderniseringskandidater, estimere transformationskompleksitet og kommunikere teknisk risiko til ikke-tekniske interessenter.

Dens begrænsninger bliver tydelige, når organisationer kræver en præcis forståelse af, hvordan ændringer påvirker udførelsesadfærd, afhængighedskæder eller driftsstabilitet. CAST Highlight giver ikke den indsigt på udførelsesniveau, der er nødvendig for at implementere refactoring- eller moderniseringsaktiviteter sikkert, og den suppleres typisk af værktøjer, der fokuserer på detaljeret konsekvensanalyse og adfærdsmæssig synlighed inden for udvalgte applikationer.

CAST-billeddannelse

CAST Imaging er en platform til intelligens inden for virksomhedsapplikationer, der fokuserer på arkitekturanalyse og visualisering af strukturelle afhængigheder på tværs af komplekse softwaresystemer. Dens primære rolle i store organisationer er at afdække, hvordan applikationer samles, hvordan komponenter interagerer, og hvor strukturel kobling introducerer risiko. CAST Imaging bruges typisk af arkitekter og moderniseringsteams, der har brug for en forståelse af applikationsstruktur på systemniveau, før de planlægger refactoring-, migrerings- eller dekomponeringsinitiativer.

I stedet for at fungere som et kodeinspektions- eller sikkerhedsscanningsværktøj, lægger CAST Imaging vægt på arkitektonisk forståelse. Det transformerer kildekode og konfigurationsartefakter til navigerbare modeller, der illustrerer forholdet mellem komponenter, lag og teknologier, hvilket gør det muligt for interessenter at ræsonnere om kompleksitet i stor skala.

Arkitektonisk kortlægning og afhængighedsvisualisering

Kernen i CAST Imaging er dens evne til at generere detaljerede arkitektoniske repræsentationer af applikationer og applikationsporteføljer. Disse repræsentationer omfatter komponentdiagrammer, interaktionskort og lagdelte visninger, der afslører, hvordan moduler kommunikerer og er afhængige af hinanden. Ved at visualisere strukturelle relationer gør CAST Imaging det muligt for teams at identificere tæt kobling, cirkulære afhængigheder og arkitektoniske overtrædelser, der er vanskelige at opdage gennem analyse på filniveau.

Disse visuelle modeller stemmer nøje overens med praksisser centreret omkring afhængighedsgrafer, hvor forståelse af strukturelle sammenkoblinger er afgørende for at håndtere risici i store systemer. CAST Imaging giver brugerne mulighed for at gennemgå afhængigheder interaktivt og bevæge sig fra arkitektoniske visninger på højt niveau ned til mere granulære repræsentationer efter behov.

Multiteknologi og dækning på tværs af applikationer

CAST Imaging understøtter analyse på tværs af en bred vifte af programmeringssprog, frameworks og platforme, der almindeligvis findes i virksomhedsmiljøer. Denne bredde gør det muligt at modellere heterogene systemer bestående af ældre komponenter, distribuerede tjenester og delte databaser. Analysefunktioner på tværs af applikationer gør det muligt for teams at forstå, hvordan individuelle systemer passer ind i større porteføljer, og hvordan ændringer i én applikation kan påvirke andre.

Analysen forbliver dog strukturel snarere end adfærdsmæssig. CAST Imaging modellerer statiske relationer mellem komponenter, men simulerer ikke udførelsesrækkefølge, runtime-betingelser eller batchplanlægningslogik. Som et resultat giver den klarhed over, hvordan systemer er forbundet, men ikke nødvendigvis over, hvordan de opfører sig under udførelse.

Støtte til modernisering og arkitektonisk styring

CAST Imaging bruges ofte til at understøtte moderniseringsinitiativer, hvor arkitektonisk klarhed er en forudsætning for forandring. Ved at afsløre overtrædelser af arkitektoniske principper og identificere områder med overdreven kobling hjælper det teams med at planlægge strategier for trinvis transformation. Disse indsigter kan informere beslutninger om serviceudtrækning, redesign af grænseflader eller fasede migreringstilgange.

I forbindelse med styring kan CAST Imaging også bruges til at vurdere arkitekturens overholdelse af definerede standarder. Afvigelser fra målarkitekturer kan identificeres og dokumenteres, hvilket understøtter tilsyn og afhjælpningsplanlægning. Dette gør det værdifuldt i organisationer, der håndhæver arkitekturkontroller som en del af deres forandringsstyringsprocesser.

Overvejelser vedrørende skalerbarhed og porteføljemodellering

Platformen er designet til at skalere på tværs af store applikationer og porteføljer og generere arkitektoniske modeller, der kan deles mellem interessenter. Dens visualiseringscentrerede tilgang understøtter samarbejdsbaseret analyse og kommunikation, især når komplekse strukturer forklares til ikke-udviklere.

Ulempen ved denne skalerbarhed er begrænset indsigt i driftsdynamik. CAST Imaging løser ikke dataafstamning på feltniveau, sporer ikke batchudførelsesflows eller kvantificerer ændringers kørselsmæssige påvirkning. For initiativer, der kræver præcis bestemmelse af ændringers påvirkning eller validering af udførelsesadfærd, kræves der typisk yderligere analyseværktøjer.

Typiske virksomhedsbrugsscenarier og begrænsninger

CAST Imaging er mest effektivt i virksomheder, der har brug for at forstå og rationalisere applikationsarkitekturen, før de foretager væsentlige ændringer. Det udmærker sig ved at afdække strukturel kompleksitet, vejlede arkitektonisk refaktorering og understøtte moderniseringsplanlægning på tværs af heterogene systemer.

Dens begrænsninger bliver tydelige, når organisationer har brug for indsigt på udførelsesniveau, konsekvensanalyse eller validering af, hvordan ændringer forplanter sig gennem runtime-adfærd. CAST Imaging leverer et strukturelt kort snarere end en operationel blueprint, og det suppleres ofte af værktøjer, der tilbyder dybere analyse af udførelsesstier, dataflow og systemadfærd.

Veracode Statisk Analyse

Veracode Static Analysis er en cloud-native statisk applikationssikkerhedstestplatform designet til at integrere sikkerhedskontroller direkte i moderne softwareleveringsprocesser. Dens primære rolle i virksomhedsmiljøer er at identificere sikkerhedssårbarheder tidligt og kontinuerligt på tværs af store mængder applikationskode, især i organisationer, der prioriterer hurtige udgivelsescyklusser, distribuerede udviklingsteams og centraliseret sikkerhedsovervågning. Veracode anvendes almindeligvis, hvor sikkerhedssikring skal skaleres uden at introducere friktion i udviklingshastigheden.

Platformen lægger vægt på automatisering og konsistens og positionerer statisk analyse som en konstant sikkerhedskontrol snarere end en periodisk gennemgangsaktivitet. Denne driftsmodel er i overensstemmelse med virksomheder, der har standardiseret cloudbaserede udviklingsværktøjer og kræver centraliseret indsigt i applikationssikkerhedstilstanden på tværs af forskellige teams og projekter.

Sikkerhedstestning af statiske applikationer i cloud-native programmer

Kernen i Veracode Static Analysis er en statisk sikkerhedsscanningsmotor, der leveres udelukkende som en administreret cloudtjeneste. Kildekode og binære filer uploades til analyse, hvor de inspiceres for sårbarheder såsom injektionsfejl, usikker datahåndtering og autentificeringssvagheder. Analysen kræver ikke adgang til produktionsmiljøer, hvilket gør det muligt at udføre sikkerhedsvurderinger tidligt i livscyklussen uden driftsrisiko.

Denne cloud-native tilgang muliggør hurtig onboarding og elastisk skalering på tværs af store porteføljer. Virksomheder kan anvende ensartede sikkerhedsscanningspolitikker på tværs af hundredvis af applikationer uden at skulle vedligeholde lokal infrastruktur. Resultaterne normaliseres og præsenteres via centraliserede dashboards, hvilket understøtter sikkerhedsteams, der er ansvarlige for virksomhedsomfattende risikoovervågning.

Integration i kontinuerlige leveringsrørledninger

Veracode er designet til at integrere tæt med CI/CD-pipelines og udviklerværktøjer. Scanninger kan udløses automatisk under bygge- eller udgivelsesfaser, og resultaterne returneres i formater, der integreres med arbejdsgange for problemsporing og afhjælpning. Dette understøtter en shift-left-sikkerhedsmodel, hvor sårbarheder adresseres tættere på introduktionstidspunktet.

I praksis koordineres Veracodes rolle inden for pipelines ofte med bredere kvalitets- og testkontroller, herunder aktiviteter som f.eks. præstationsregressionstest, for at sikre, at sikkerhedshåndhævelse ikke sker isoleret fra andre ikke-funktionelle krav. Denne tilpasning hjælper organisationer med at balancere sikkerhedsstringens med leveringsevne.

Sprogdækning og porteføljekonsistens

Veracode Static Analysis understøtter en bred vifte af moderne programmeringssprog og frameworks, der almindeligvis anvendes i udvikling af virksomhedsapplikationer. Denne bredde giver sikkerhedsteams mulighed for at anvende ensartede scanningspolitikker på tværs af heterogene udviklingsstacks, hvilket reducerer huller, der ellers kunne opstå mellem teams eller platforme.

Platformens fokus er dog fortsat på sikkerhedsscanning på applikationsniveau. Analysen er typisk begrænset til individuelle applikationer eller tjenester, og relationer mellem applikationer, batch-arbejdsgange eller delte datastrukturer modelleres ikke. Som et resultat giver Veracode en stærk dækning af sårbarheder på kodeniveau, men begrænset indsigt i, hvordan disse sårbarheder kan sprede sig på tværs af sammenkoblede systemer.

Risikorapportering og synlighed i styring

Veracode leverer rapporteringsfunktioner, der giver sikkerhedsledere mulighed for at spore sårbarhedstendenser, afhjælpningsfremskridt og overholdelse af politikker på tværs af virksomheden. Dashboards understøtter porteføljeniveauvisninger af risikoeksponering, hvilket muliggør prioritering baseret på alvorlighed og forretningsmæssig indvirkning. Disse rapporter bruges ofte til at understøtte intern sikkerhedsstyring, ledelsesrapportering og tredjepartssikringsaktiviteter.

Selvom disse funktioner understøtter ansvarlighed og tilsyn, forbliver rapporteringens fokus sårbarhedscentreret. Veracode forsøger ikke at kvantificere operationel påvirkning, forstyrrelser i udførelsesflowet eller moderniseringsrisiko forbundet med afhjælpningsindsatser. Denne sondring er vigtig i miljøer, hvor sikkerhedsændringer skal evalueres sammen med stabilitets- og ændringsstyringshensyn.

Typiske virksomhedsbrugsscenarier og begrænsninger

Veracode Static Analysis er mest effektiv i virksomheder, der opererer med høj leveringshastighed og kræver skalerbar, centraliseret sikkerhedsscanning på tværs af moderne applikationsstakke. Den udmærker sig ved at håndhæve ensartede sikkerhedsstandarder, reducere tiden det tager at opdage sårbarheder og understøtte DevSecOps-driftsmodeller.

Dens begrænsninger bliver tydelige i scenarier, der kræver dyb forståelse af systemadfærd, afhængigheder på tværs af applikationer eller ældre batchbehandling. Veracode giver ikke indsigt på udførelsesniveau eller kortlægning af arkitektoniske afhængigheder, og det er typisk positioneret som et specialiseret sikkerhedslag suppleret af værktøjer, der fokuserer på konsekvensanalyse, synlighed af afhængigheder og systemforståelse på virksomhedsniveau.

Coverity (Synopsys)

Coverity er en platform til statisk kodeanalyse i virksomheder, der er anerkendt for sin evne til at detektere komplekse defekter i store, ydeevnekritiske kodebaser. Dens primære rolle i virksomhedsmiljøer er at identificere dybe korrektheds- og pålidelighedsproblemer, der er vanskelige at afdække gennem test alene, især i systemer, hvor fejl har betydelige driftsmæssige, sikkerhedsmæssige eller økonomiske konsekvenser. Coverity anvendes ofte i brancher som bilindustrien, luftfart, telekommunikation og infrastruktursoftware, hvor præcision i defekter og lave falsk-positive rater er afgørende.

I modsætning til analyseplatforme på porteføljeniveau fokuserer Coverity på korrekthed på kodeniveau på tværs af omfattende kodebaser. Det er designet til at analysere store mængder kildekode effektivt, samtidig med at det opretholder et højt niveau af analytisk stringens, hvilket gør det velegnet til organisationer, der administrerer systemer med lang levetid med strenge krav til pålidelighed.

Dybdefektdetektion og præcisionsanalyse

Kernen i Coverity er en statisk analysemotor, der er optimeret til at detektere defekter såsom hukommelseskorruption, ressourcelækager, samtidighedsproblemer og logiske fejl. Motoren er kendt for sin evne til at ræsonnere om komplekse kontrolstier og udførelsesscenarier, der spænder over flere funktioner og moduler. Denne dybde af analyse gør det muligt at identificere defekter, der muligvis kun manifesterer sig under specifikke runtime-forhold.

Coveritys analytiske tilgang inkorporerer avancerede teknikker relateret til symbolsk udførelse, hvilket gør det muligt at udforske flere udførelsesstier uden at køre koden. Denne funktion bidrager til dens ry for høj nøjagtighed og hjælper med at reducere den støj, der ofte er forbundet med storstilet statisk analyse i virksomhedsmiljøer.

Sprogfokus og målrettet dækning

Coverity yder stærk understøttelse af sprog, der almindeligvis bruges i systemniveau- og ydeevnefølsom software, herunder C, C++ og Java. Dette fokus gør det særligt effektivt til at analysere kerneinfrastrukturkomponenter, indlejrede systemer og backend-tjenester, hvor lavniveaudefekter kan have en uforholdsmæssig stor indflydelse.

Selvom platformen kan skaleres på tværs af store kodebaser, er dens sprogdækning smallere end nogle generelle statiske analyseværktøjer. Den er mindre orienteret mod heterogene virksomhedsområder, der inkluderer batchbehandlingssprog, scriptmiljøer eller mainframe-specifikke teknologier. Som et resultat implementeres Coverity ofte selektivt inden for porteføljer og målretter komponenter, hvor præcision i fejl er mest kritisk.

Integration i virksomhedsudviklingsworkflows

Coverity er designet til at integreres i virksomhedens udviklingsprocesser, herunder CI/CD-pipelines og centraliserede fejlhåndteringssystemer. Scanninger kan planlægges eller udløses automatisk, og resultaterne sendes til udviklingsteams til afhjælpning. Platformen understøtter trinvis analyse, hvilket giver teams mulighed for at fokusere på nyligt introducerede problemer, samtidig med at de opretholder synligheden af eksisterende fejlbeholdninger.

I mange organisationer positioneres Coverity som en kvalitetssikringskontrol snarere end et kontinuerligt udforskende værktøj. Dens scanninger køres ofte ved definerede milepæle, f.eks. før større udgivelser eller under formelle kvalitetsgennemgange. Dette brugsmønster afspejler dens rolle i at håndhæve pålidelighedsstandarder snarere end at understøtte hurtig iteration.

Skalerbarhed og ydeevneegenskaber

Coverity er udviklet til effektivt at håndtere meget store kodebaser, hvilket gør det velegnet til virksomheder med millioner af linjer kritisk kode. Dens ydeevne skaleres med tilgængelig infrastruktur, hvilket giver organisationer mulighed for at analysere betydelige systemer uden uoverkommelige analysetider. Centraliserede dashboards giver overblik over fejltendenser og afhjælpningsfremskridt på tværs af projekter.

Coveritys skalerbarhed er dog fokuseret på kodevolumen snarere end systemkompleksitet. Den forsøger ikke at modellere afhængigheder på tværs af applikationer, batchudførelsesrækkefølge eller dataafstamning på tværs af platforme. Dens indsigter er fortsat centreret omkring defektdetektion inden for individuelle kodebaser snarere end systemomfattende adfærd.

Typiske virksomhedsbrugsscenarier og begrænsninger

Coverity er mest effektivt i virksomheder, der kræver højkonfidensiel fejldetektion i kritiske softwarekomponenter. Det udmærker sig ved at identificere subtile problemer, der kan føre til nedbrud, sikkerhedssårbarheder eller uforudsigelig adfærd i produktionen, især i lavniveau- eller ydeevnefølsom kode.

Dens begrænsninger bliver tydelige i moderniserings- eller transformationsinitiativer, der kræver forståelse af, hvordan ændringer påvirker sammenkoblede systemer. Coverity tilbyder ikke kortlægning af arkitektonisk afhængighed eller konsekvensanalyse på udførelsesniveau, og den suppleres typisk af værktøjer, der fokuserer på porteføljesynlighed, afhængighedsanalyse og adfærdsmæssig indsigt på tværs af heterogene virksomhedsmiljøer.

Parasoft C/C++ test og DTP

Parasoft C/C++test og den tilhørende Development Testing Platform (DTP) danner en statisk analyse- og compliance-testløsning i virksomhedsklassen, der er skræddersyet til sikkerhedskritiske og stærkt regulerede softwaremiljøer. Dens primære rolle i store organisationer er at understøtte streng verifikation af systemniveaukode, hvor defekter kan føre til driftsfejl, manglende overholdelse af lovgivningen eller sikkerhedshændelser. Parasoft anvendes almindeligvis i brancher som luftfart, bilindustri, forsvar og industrielle systemer, hvor softwareadfærd skal være beviseligt korrekt og auditerbar.

I modsætning til generelle statiske analyseværktøjer lægger Parasoft vægt på overholdelse af definerede standarder og verifikationsmål. Platformen er designet til at understøtte miljøer, hvor udvikling styres af formelle processer, certificeringskrav og dokumenterede sikkerhedssager snarere end hurtig iteration.

Standarddrevet statisk analyse og håndhævelse af overholdelse

Kernen i Parasoft C/C++test er en statisk analysemotor, der er i overensstemmelse med branchesikkerheds- og kodningsstandarder såsom MISRA, CERT og ISO-relaterede retningslinjer. Motoren evaluerer kildekode i forhold til strenge regelsæt, der definerer acceptable konstruktioner, brugsmønstre og fejlforhold. Overtrædelser kategoriseres efter alvorlighed og knyttes direkte til compliance-krav, hvilket gør det muligt for organisationer at demonstrere overholdelse af obligatoriske udviklingspraksisser.

Denne standarddrevne tilgang stemmer overens med miljøer, der er afhængige af formel verifikation koncepter, hvor korrekthed ikke kun defineres af funktionel adfærd, men også af overholdelse af foreskrevne regler. Parasofts analyseresultater kan bruges som bevis i certificerings- og revisionsprocesser, hvilket reducerer manuel verifikationsindsats.

Fokuseret sprogstøtte og målrettet analysedybde

Parasoft C/C++ test er specifikt optimeret til C- og C++-kodebaser og leverer dybdegående analysefunktioner til sprog, der almindeligvis anvendes i indlejret software og software på systemniveau. Denne specialisering gør det muligt for platformen at identificere problemer på lavt niveau, såsom hukommelsesmisbrug, pointerfejl og samtidighedsfejl, der kan være særligt farlige i sikkerhedskritiske sammenhænge.

Selvom denne dybde er værdifuld inden for sit måldomæne, begrænser den også platformens anvendelighed på tværs af bredere virksomhedsområder. Parasoft sigter ikke mod at tilbyde bred dækning på tværs af forskellige sprog, batchbehandlingsmiljøer eller ældre mainframe-systemer. Som et resultat implementeres den typisk i målrettede segmenter af en virksomhedsportefølje snarere end som en universel analyseløsning.

Integration med regulerede udviklingslivscyklusser

Parasoft er designet til at integreres i strukturerede udviklingslivscyklusser, der lægger vægt på sporbarhed, dokumentation og kontrollerede ændringer. Statiske analyseresultater kan linkes til krav, testcases og defektsporingssystemer via DTP-komponenten, hvilket muliggør end-to-end sporbarhed fra specifikation til verifikation.

Denne integration understøtter udviklingsmodeller, hvor ændringer introduceres bevidst og formelt gennemgås. Analyse udføres ofte ved definerede milepæle, f.eks. før certificeringsindsendelser eller større udgivelser, snarere end løbende ved hver commit. Denne driftsmodel afspejler prioriteterne i regulerede miljøer, hvor forudsigelighed og sikkerhed vejer tungere end hastighed.

Rapportering, sporbarhed og revisionsberedskab

Udviklingstestplatformen leverer centraliseret rapportering og analyse på tværs af projekter og teams. Målinger relateret til compliance-status, defekttendenser og verifikationsdækning kan aggregeres og gennemgås af interessenter inden for kvalitetssikring og compliance. Rapporterne er struktureret til at understøtte revisions- og certificeringsaktiviteter og giver dokumenteret bevis for analyseudførelse og resultater.

Disse rapporter fokuserer dog på overholdelse af kodeniveau snarere end systemomfattende adfærd. Parasoft modellerer ikke udførelsesstier på tværs af applikationer, batchorkestrering eller afhængigheder på tværs af platforme. Dens sporbarhed er orienteret mod krav og standarder snarere end runtime-interaktion mellem komponenter.

Typiske virksomhedsbrugsscenarier og begrænsninger

Parasoft C/C++ test og DTP er mest effektive i virksomheder, hvor sikkerhed, pålidelighed og overholdelse af regler er dominerende bekymringer. De giver en disciplineret ramme for at verificere, at kritisk kode overholder strenge standarder og kan modstå formel gennemgang.

Deres begrænsninger bliver tydelige i miljøer, der kræver en holistisk forståelse af store, sammenkoblede systemer eller understøttelse af heterogene teknologistakke. Parasoft er ikke designet til at give synlighed på porteføljeniveau eller eksekveringsorienteret konsekvensanalyse, og det suppleres ofte af værktøjer, der fokuserer på arkitektoniske afhængigheder, moderniseringsrisiko og systemadfærd på tværs af komplekse virksomhedslandskaber.

Klockwork

Klocwork er en platform til statisk kodeanalyse i virksomheder, der fokuserer på at identificere sikkerheds-, pålideligheds- og samtidighedsrelaterede defekter i store, komplekse kodebaser. Dens primære rolle i virksomhedsmiljøer er at opdage problemer, der kan kompromittere systemstabilitet eller sikkerhed, især i software, der opererer under høj belastning, parallel udførelse eller begrænsede runtime-forhold. Klocwork bruges almindeligvis i brancher, hvor ydeevne og korrekthed er tæt forbundet, herunder telekommunikation, indlejrede systemer, finansiel infrastruktur og store backend-tjenester.

Platformen lægger vægt på tidlig fejldetektion gennem statisk analyse, hvilket gør det muligt for organisationer at identificere problematiske mønstre, før de manifesterer sig som runtime-fejl. Klocwork positioneres typisk som et kvalitets- og sikkerhedssikringsværktøj snarere end en porteføljeomfattende analyseløsning.

Samtidigheds- og pålidelighedsorienteret statisk analyse

Kernen i Klocwork er en statisk analysemotor, der er designet til at identificere defekter, der opstår fra komplekse udførelsesscenarier. Dette inkluderer problemer relateret til hukommelsesstyring, ressourcehåndtering og synkronisering. Motoren er særligt effektiv til at detektere defekter forbundet med parallel udførelse, hvor subtile interaktioner mellem tråde kan føre til uforudsigelig adfærd.

Dens evne til at ræsonnere om samtidige kodestier gør Klocwork relevant i miljøer, hvor software skal fungere pålideligt under belastning. Analyseresultater inkluderer ofte fund relateret til deadlocks, race conditions og ukorrekte synkroniseringskonstruktioner. Disse funktioner understøtter organisationer, der søger at reducere ustabilitet forårsaget af svært reproducerede samtidighedsfejl såsom løb betingelser.

Sprogfokus og præstationsfølsomme domæner

Klocwork yder stærk understøttelse af sprog, der almindeligvis bruges i systemniveau- og ydeevnekritisk software, herunder C, C++ og Java. Dette fokus stemmer overens med dets anvendelse i domæner, hvor lavniveau-korrekthed og runtime-effektivitet er afgørende. Ved at koncentrere sig om et snævrere sæt af sprog leverer platformen dybere analyser for disse miljøer sammenlignet med bredere, mere generaliserede værktøjer.

Denne specialisering begrænser dog også dens anvendelighed på tværs af heterogene virksomhedsområder. Klocwork er ikke designet til at analysere batchorienterede arbejdsbelastninger, mainframe-sprog eller scripting-miljøer på højt niveau, der er almindelige i langlivede virksomhedssystemer. Som et resultat anvendes den ofte selektivt snarere end som en universel analyseløsning.

Integration i virksomhedens kvalitets- og sikkerhedsworkflows

Klocwork integrerer med virksomhedsudviklingsworkflows, herunder CI/CD-pipelines og fejlsporingssystemer. Scanninger kan automatiseres, og resultaterne kan sendes til udviklingsteams til afhjælpning. Platformen understøtter trinvis analyse, hvilket giver teams mulighed for at fokusere på nyligt introducerede problemer, samtidig med at de opretholder synligheden af eksisterende fejl.

I mange organisationer bruges Klocwork som en del af formelle kvalitetssikringsprocesser. Analyse kan udløses på nøglefaser, såsom validering før udgivelse eller større refaktoreringsindsatser. Dette brugsmønster afspejler dets rolle i at sikre pålidelighed og sikkerhed snarere end at understøtte kontinuerlig arkitekturudforskning.

Skalerbarhedskarakteristika og operationelt omfang

Klocwork er udviklet til at skalere på tværs af store kodebaser, hvilket muliggør analyse af betydelige systemer uden overdreven ydelsesoverhead. Centraliserede dashboards giver overblik over fejltendenser og afhjælpningsfremskridt på tværs af projekter. Disse visninger understøtter ledelsens tilsyn og hjælper teams med at prioritere korrigerende handlinger baseret på alvorlighed og effekt.

Trods sin skalerbarhed med hensyn til kodevolumen forbliver Klocworks analytiske omfang lokaliseret til individuelle applikationer eller komponenter. Den modellerer ikke afhængigheder på tværs af applikationer, batchudførelsesrækkefølge eller dataafstamning på tværs af platforme. Dens indsigter fokuserer på kodekorrekthed snarere end systemomfattende adfærd.

Typiske virksomhedsbrugsscenarier og begrænsninger

Klocwork er mest effektivt i virksomheder, der kræver højkonfidensdetektering af samtidigheds- og pålidelighedsfejl i ydeevnefølsom software. Det udmærker sig ved at afdække problemer, der er vanskelige at reproducere gennem test, og som kan forårsage periodiske eller katastrofale fejl i produktionsmiljøer.

Dens begrænsninger bliver tydelige i transformationsinitiativer, der kræver en holistisk forståelse af applikationsporteføljer, udførelsesflows eller moderniseringens påvirkning. Klocwork tilbyder ikke kortlægning af arkitektonisk afhængighed eller konsekvensanalyse på udførelsesniveau, og det suppleres typisk af værktøjer, der fokuserer på bredere systemforståelse og vurdering af ændringer i risikoen på tværs af heterogene virksomhedsmiljøer.

Statisk analyse af OpenText DevOps Cloud

OpenText DevOps Cloud Static Analysis er en statisk analysefunktion til virksomheder, der leveres som en del af en bredere DevOps- og applikationslivscyklusstyringssuite. Dens primære rolle i store organisationer er at levere standardiserede kodekvalitets- og sikkerhedskontroller, der stemmer overens med etablerede leveringsstyringsmodeller. I stedet for at fungere som en selvstændig platform til dybdegående analyse, anvendes den typisk af virksomheder, der prioriterer værktøjskædekonsolidering og centraliseret tilsyn på tværs af udviklings-, test- og udgivelsesprocesser.

Platformen bruges oftest i miljøer, hvor softwarelevering skal overholde formelle kontroller, og hvor integration med eksisterende ALM-, test- og release management-værktøjer er et centralt krav. Dens værdi ligger i konsistens og styringstilpasning snarere end dybdegående adfærds- eller arkitekturanalyse.

Suite-orienterede statiske analysefunktioner

I sin kerne leverer OpenText DevOps Cloud Static Analysis regelbaseret inspektion af kildekode for at identificere kvalitetsproblemer og sikkerhedssvagheder. Analysen fokuserer på almindelige defektkategorier, overtrædelser af kodningsstandarder og sårbarhedsmønstre, der kan detekteres uden at køre applikationen. Resultaterne normaliseres og præsenteres via centraliserede dashboards sammen med andre DevOps-målinger.

Denne suite-orienterede tilgang understøtter organisationer, der ønsker, at statisk analyse skal fungere som en komponent i et større leveringskontrolrammeværk. Ved at integrere analyse i en integreret platform kan virksomheder håndhæve grundlæggende standarder på tværs af teams uden at introducere yderligere punktværktøjer i allerede komplekse miljøer.

Integration med Enterprise Delivery Governance

OpenTexts statiske analysefunktioner er tæt integreret med bredere livscyklusstyringsfunktioner såsom kravsporing, testning og releaseorkestrering. Denne integration gør det muligt at linke analyseresultater til arbejdselementer, defekter og godkendelser, hvilket understøtter sporbarhed på tværs af leveringsprocessen. For organisationer med formelle styringsmodeller forenkler denne tilpasning tilsyn og rapportering.

Platformen er ofte positioneret til at understøtte struktureret forandringsledelse processer, hvor softwareændringer skal gennemgå definerede gennemgangs- og godkendelsesfaser. Statiske analyseresultater bliver en del af den dokumentation, der bruges til at vurdere klarhed til udgivelse, snarere end en selvstændig kilde til teknisk indsigt.

Sprogdækning og standardiseringsfokus

OpenText DevOps Cloud Static Analysis understøtter en række almindeligt anvendte virksomhedsprogrammeringssprog, hvilket muliggør ensartet håndhævelse af kodningsstandarder på tværs af forskellige udviklingsteams. Sprogunderstøttelsen er orienteret mod mainstream applikationsudviklingsstakke snarere end niche- eller ældre miljøer.

Selvom denne bredde understøtter standardisering, forbliver analysedybden relativt lav sammenlignet med specialiserede værktøjer. Platformen forsøger ikke at modellere udførelsesstier, løse batch-orkestreringslogik eller analysere afhængigheder på tværs af applikationer. Dens resultater er bedst egnede til at identificere lokaliserede problemer inden for individuelle kodebaser.

Skalerbarhed og operationelle egenskaber

OpenText DevOps Cloud Static Analysis er designet til at fungere som en del af en cloud-leveret pakke og skalerer på tværs af flere projekter og teams med centraliseret administration. Dette gør den velegnet til virksomheder, der søger ensartede kontroller på tværs af store udviklerpopulationer. Ydeevnen skaleres med cloud-infrastruktur, hvilket reducerer behovet for dedikerede lokale ressourcer.

Skalerbarhed i denne sammenhæng refererer dog til organisatorisk dækning snarere end analytisk dybde. Platformen giver bred synlighed på tværs af projekter, men begrænset indsigt i, hvordan systemer opfører sig under kørsel, eller hvordan ændringer spredes gennem komplekse, sammenkoblede miljøer.

Typiske virksomhedsbrugsscenarier og begrænsninger

OpenText DevOps Cloud Static Analysis er mest effektiv i virksomheder, der værdsætter integreret leveringsstyring og standardiserede kontroller frem for dybdegående teknisk udforskning. Det understøtter miljøer, hvor statisk analyse er ét kontrolpunkt blandt mange inden for en kontrolleret udgivelsesproces, hvilket giver ensartet håndhævelse af grundlæggende kvalitets- og sikkerhedskrav.

Dens begrænsninger bliver tydelige i scenarier, der kræver detaljeret forståelse af udførelsesadfærd, afhængighedskæder eller moderniseringspåvirkning på tværs af heterogene systemer. Platformen giver ikke den adfærdsmæssige synlighed eller konsekvensanalyse, der er nødvendig for sikkert at udføre storstilede refactoring- eller moderniseringsinitiativer, og den suppleres ofte af værktøjer, der specialiserer sig i udførelsesindsigt og analyse på tværs af platforme.

SCA Solutions kapacitetsbaseret sammenligningstabel

| Capability | SMART TS XL | SonarQube Ent | Checkmarx One | Befæste SCA | CAST Fremhæv | CAST-billeddannelse | Vera kode | Dækning | Parasoft | Klockwork | OpenText |

|---|---|---|---|---|---|---|---|---|---|---|---|

| Skala for virksomhedsportefølje | ✅ Fremragende | ◐ Moderat | ◐ Moderat | ◐ Moderat | ✅ Fremragende | ✅ Fremragende | ◐ Moderat | ◐ Moderat | ◐ Moderat | ◐ Moderat | ◐ Moderat |

| Multiplatform (mainframe + distribueret) | ✅ Fuld | ❌ Nej | ❌ Nej | ❌ Begrænset | ❌ Begrænset | ❌ Begrænset | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Begrænset |

| Understøttelse af ældre sprog (COBOL, JCL, RPG) | ✅ Fuld | ❌ Nej | ❌ Nej | ❌ Begrænset | ❌ Begrænset | ❌ Begrænset | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej |

| Analyse af systemafhængighed | ✅ Fuld | ❌ Nej | ❌ Nej | ❌ Nej | ◐ Højt niveau | ◐ Strukturel | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej |

| Synlighed af udførelsessti (statisk) | ✅ Fuld | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ◐ Delvis | ◐ Delvis | ◐ Delvis | ❌ Nej |

| Analyse af batch- og jobflow | ✅ Fuld | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej |

| Konsekvensanalyse før forandring | ✅ Dyb | ◐ Lavvandet | ◐ Kun sikkerhed | ◐ Kun sikkerhed | ◐ Portefølje | ◐ Strukturel | ◐ Kun sikkerhed | ◐ Kodeniveau | ◐ Kodeniveau | ◐ Kodeniveau | ◐ Styring |

| Detektion af sikkerhedssårbarheder (SAST) | ◐ Kontekstuel | ◐ Grundlæggende | ✅ Stærk | ✅ Stærk | ◐ Vejledende | ❌ Nej | ✅ Stærk | ◐ Begrænset | ◐ Begrænset | ◐ Begrænset | ◐ Grundlæggende |

| Indsigt i ydeevne og kompleksitet | ✅ Dyb | ◐ Målinger | ❌ Nej | ❌ Nej | ◐ Aggregat | ◐ Strukturel | ❌ Nej | ◐ Defektbaseret | ◐ Overholdelse | ◐ Defektbaseret | ❌ Nej |

| Analyse af moderniseringsberedskab | ✅ Indfødt | ❌ Nej | ❌ Nej | ❌ Nej | ✅ Primær | ◐ Strukturel | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej | ❌ Nej |

| Søg på tværs af alle aktiver | ✅ Avanceret | ◐ Kun depot | ◐ Kun depot | ◐ Kun depot | ◐ Metadata | ◐ Metadata | ◐ Kun depot | ◐ Kun depot | ◐ Kun depot | ◐ Kun depot | ◐ Kun depot |

| CI/CD integration | ◐ Valgfrit | ✅ Stærk | ✅ Stærk | ◐ Moderat | ❌ Nej | ❌ Nej | ✅ Stærk | ◐ Moderat | ◐ Moderat | ◐ Moderat | ✅ Indfødt |

| Revisionsklar dokumentation | ✅ Indfødt | ◐ Begrænset | ◐ Begrænset | ✅ Stærk | ◐ Aggregat | ◐ Strukturel | ◐ Begrænset | ◐ Begrænset | ✅ Stærk | ◐ Begrænset | ◐ Stærk |

Andre værktøjer til statisk kodeanalyse (begrænset virksomhedsanvendelse)

- ESLint

- fordele: Håndhæver kodningsstandarder i JavaScript og TypeScript med hurtig feedback fra udviklere.

- Begrænsninger: Fungerer på repository-niveau uden synlighed af tværsystem- eller virksomhedspåvirkning.

- PMD

- fordele: Registrerer almindelige problemer med kodekvalitet på tværs af flere programmeringssprog.

- Begrænsninger: Regelbaseret analyse er uegnet til store, heterogene virksomhedsbesiddelser.

- Flake8

- fordele: Letvægts statisk analyse til Python-syntaks og stilhåndhævelse.

- Begrænsninger: Giver ikke indsigt på arkitektur- eller udførelsesniveau.

- bandit

- fordele: Identificerer sikkerhedsproblemer i Python-kode ved hjælp af mønsterbaseret analyse.

- Begrænsninger: Snævert omfang og ingen bevidsthed om interaktioner mellem virksomhedssystemer.

- CodeQL

- fordele: Forespørgselsbaseret analyse, der er i stand til at identificere komplekse sårbarhedsmønstre.

- Begrænsninger: Kræver specialiseret ekspertise og mangler virksomhedsudførelsesmodellering.

- Semgrep

- fordele: Hurtig, brugerdefinerbar mønstermatchning til sikkerheds- og kvalitetstjek.

- Begrænsninger: Mønsterdrevet tilgang mangler afhængighed og adfærdsmæssig kontekst.

- Snyk kode

- fordele: Udviklervenlig statisk analyse integreret i cloud-native arbejdsgange.

- Begrænsninger: Fokuseret på sikkerhed på applikationsniveau frem for virksomhedsarkitektur.

- pylint

- fordele: Giver detaljerede kodekvalitetskontroller for Python-projekter.

- Begrænsninger: Ikke designet til analyse på tværs af projekter eller platforme.

- Cppcheck

- fordele: Statisk analyse i åben kildekode til C og C++ med lave falsk-positive rater.

- Begrænsninger: Begrænset skalerbarhed og understøttelse af virksomhedsstyring.

- Udlede

- fordele: Registrerer hukommelses- og samtidighedsproblemer ved hjælp af avancerede analyseteknikker.

- Begrænsninger: Begrænset sprogunderstøttelse og begrænset virksomhedsintegration.

- LGTM

- fordele: Kombinerer statisk analyse med cloudbaserede arbejdsgange til kodegennemgang.

- Begrænsninger: Repository-centreret med begrænset indsigt på systemniveau.

- FxCop-analysatorer

- fordele: Håndhæver design- og kodningsretningslinjer for .NET-applikationer.

- Begrænsninger: Omhandler ikke afhængigheder på tværs af applikationer.

- PHPCS

- fordele: Håndhæver kodningsstandarder i PHP-projekter.

- Begrænsninger: Stilfokuseret med minimal analytisk dybde.

- SpotBugs

- fordele: Identificerer almindelige fejlmønstre i Java bytecode.

- Begrænsninger: Mønsterbaseret detektion uden modellering af udførelsesstier.

- Bremser

- fordele: Specialiseret sikkerhedsscanning til Ruby on Rails-applikationer.

- Begrænsninger: Rammespecifik og uegnet til virksomhedsomfattende analyse.

- ReSharper kommandolinjeværktøjer

- fordele: Integrerer statisk analyse i .NET build-pipelines.

- Begrænsninger: Fokus på udviklerproduktivitet frem for virksomhedsindsigt.

- DeepSource

- fordele: Automatiseret kodegennemgang og kvalitetsanalyse til moderne repositories.

- Begrænsninger: SaaS-centreret med begrænset strukturel analysedybde.

- Codacy

- fordele: Centraliseret kvalitetsrapportering på tværs af flere databaser.

- Begrænsninger: Aggregeringsfokuseret uden dyb systemforståelse.

- Sonatype Lift

- fordele: Sikkerheds- og kvalitetsscanning integreret i DevOps-arbejdsgange.

- Begrænsninger: Begrænset indsigt i runtime-adfærd og ældre systemer.

- Afhængig

- fordele: Giver afhængighedsanalyse til .NET-applikationer.

- Begrænsninger: Teknologispecifik og ikke egnet til heterogene ejendomme.

- Coverity Scan (Open Source)

- fordele: Gratis statisk analyse for udvalgte open source-projekter.

- Begrænsninger: Ikke repræsentativt for implementeringsscenarier i virksomheder.

- OWASP-afhængighedskontrol

- fordele: Identificerer kendte sårbare afhængigheder.

- Begrænsninger: Analyserer ikke kildekodens adfærd eller arkitektur.

- Rust Clippy

- fordele: Lints Rust-kode til idiomatiske problemer og almindelige fejl.

- Begrænsninger: Sprogspecifik uden virksomhedskontekst.

- GolangCI-Lint

- fordele: Aggregerer flere linters til Go-projekter.

- Begrænsninger: Udviklercentreret uden indsigt på porteføljeniveau.

- SwiftLint

- fordele: Håndhæver Swift-kodningskonventioner i mobile projekter.

- Begrænsninger: Snævert omfang og begrænset relevans for virksomhedssystemer.

På tværs af sammenligningen ses en klar sondring mellem værktøjer designet til at håndhæve lokaliserede kvalitets- eller sikkerhedskontroller og platforme, der er i stand til at understøtte forståelse på tværs af hele virksomheden. Mange løsninger udmærker sig inden for snævert definerede områder, såsom feedback fra udviklere, sårbarhedsdetektion eller arkitektonisk visualisering, men forbliver begrænsede, når de anvendes på heterogene områder bestående af ældre platforme, batch-arbejdsbelastninger og tæt koblede systemer. I disse miljøer er den begrænsende faktor ikke fraværet af analyse, men fragmenteringen af indsigt på tværs af ikke-sammenhængende værktøjer.

Modernisering, risikostyring og compliance-initiativer på virksomhedsniveau kræver i stigende grad analyser, der spænder over sprog, platforme og udførelsesmodeller uden at ofre dybde eller ydeevne. Værktøjer, der primært opererer ved grænser til datalager eller applikationer, har svært ved at give tilstrækkelig kontekst til ændringsbeslutninger, der påvirker downstream-systemer, delte data eller driftsstabilitet. Som følge heraf finder virksomheder ofte sig selv i at kombinere flere værktøjer for at opnå et komplet overblik, hvilket introducerer yderligere kompleksitet og koordineringsomkostninger.

Sammenligningen fremhæver, at den mest afgørende differentieringsfaktor i 2026 ikke er evnen til at opdage individuelle defekter eller håndhæve kodningsstandarder, men kapaciteten til at afsløre, hvordan systemer opfører sig som sammenkoblede helheder. Statisk analyse, der forbliver begrænset til isolerede artefakter, leverer aftagende værdi, efterhånden som den arkitektoniske kompleksitet vokser. Platforme, der forener opdagelse, afhængighedsanalyse og konsekvensanalyse på tværs af hele porteføljer, giver et mere holdbart grundlag for beslutningstagning i store, missionskritiske miljøer.

Hvordan analyseværktøjer til statisk kode i virksomheder evalueres

Værktøjer til analyse af statisk kode i virksomheder evalueres ud fra et fundamentalt anderledes sæt kriterier end dem, der anvendes til udviklercentrerede eller sikkerhedsbaserede værktøjer. I store organisationer er den primære udfordring sjældent fraværet af analyse, men snarere fragmenteringen af indsigt på tværs af usammenhængende værktøjer, teams og platforme. Evalueringen fokuserer derfor på, om et værktøj kan fungere som et samlende analytisk lag på tværs af heterogene miljøer snarere end som en lokaliseret inspektionsmekanisme.

Efterhånden som softwarebeholdninger bliver ældre og mere sammenkoblede, skal evaluering også tage højde for de operationelle konsekvenser af ændringer. Statiske analyseresultater, der ikke kan omsættes til handlingsrettet forståelse af udførelsesadfærd, afhængighedsomfang eller downstream-påvirkning, giver begrænset værdi i miljøer, hvor nedbrud, overtrædelser af regler eller præstationsregressioner indebærer en væsentlig risiko. Følgende evalueringsdimensioner afspejler, hvordan virksomheder vurderer statiske kodeanalyseværktøjer i 2026, når arkitekturkompleksitet og moderniseringspres mødes.

Analysedybde versus detektion på overfladeniveau

En af de mest kritiske evalueringsdimensioner er den dybde, hvormed et statisk kodeanalyseværktøj kan ræsonnere om softwareadfærd. Overfladedetektion fokuserer på at identificere lokaliserede problemer såsom syntaksbrud, regelbrud eller kendte sårbarhedsmønstre. Selvom disse resultater er nyttige inden for kontrollerede udviklingsworkflows, giver de begrænset indsigt i, hvordan ændringer påvirker komplekse systemer, der er sammensat af mange interagerende komponenter.

Dybdegående analyse undersøger derimod, hvordan kontrolflow, dataudbredelse og afhængighedsrelationer udvikler sig på tværs af en applikation eller portefølje. Dette inkluderer forståelse af, hvordan en variabel udfyldes, transformeres og forbruges på tværs af flere udførelseskontekster, eller hvordan en tilsyneladende isoleret ændring i ét modul påvirker batchjob, downstream-tjenester eller rapporteringslag. Værktøjer, der er i stand til dette niveau af ræsonnement, bevæger sig ud over inspektion på filniveau og hen imod forståelse på systemniveau.

Virksomheder prioriterer i stigende grad dybdegående analyse, fordi moderniseringsinitiativer ofte involverer ændring af ældre logik uden fuld dokumentation eller institutionel viden. I sådanne tilfælde skaber overfladiske resultater en falsk følelse af tillid og tilskynder til ændringer, der virker sikre lokalt, men introducerer ustabilitet andre steder. Dybdegående analyse reducerer denne risiko ved at afsløre skjulte koblinger og indirekte afhængigheder før udførelse.

Dybde påvirker også, hvordan analyseresultater forbruges. Overfladiske værktøjer genererer typisk store mængder fund, der kræver manuel sortering, hvorimod dyberegående værktøjer kan kontekstualisere fund inden for udførelsesstier eller påvirkningszoner. Denne sondring påvirker produktivitet og tillid. Når teams gentagne gange støder på falske positiver eller irrelevante advarsler, mindskes tilliden til analysen. Evaluering overvejer derfor ikke kun, hvad et værktøj registrerer, men hvor meningsfuldt disse detektioner relaterer sig til den faktiske systemadfærd.

Denne sondring er især relevant i miljøer, hvor ydeevneegenskaber er lige så vigtige som korrekthed. Forståelse af, hvorfor latenstid opstår, eller hvor ressourcekonflikter stammer fra, kræver ofte indsigt i udførelsesstrukturen snarere end isolerede defekter. Værktøjer, der understøtter ræsonnement på tværs af kontrolflow og afhængighedskæder, giver et stærkere fundament for ydeevnetekniske bestræbelser som dem, der er beskrevet i sporing af softwareydelsesmålinger.

Skalerbarhed på tværs af virksomhedsporteføljer

Skalerbarhed i analyse af statisk kode i virksomheder er ikke begrænset til behandling af store mængder kildekode. Det omfatter også evnen til at analysere, forespørge på og visualisere relationer på tværs af tusindvis af applikationer, flere platforme og årtiers akkumuleret logik uden at forringe responsivitet eller brugervenlighed. Evaluering tager derfor hensyn til både beregningsmæssig skalerbarhed og kognitiv skalerbarhed.