Zarządzanie pamięcią to fundamentalny aspekt programowania, niezbędny dla stabilności i wydajności aplikacji. Jednym z wyzwań związanych z zarządzaniem pamięcią jest zjawisko wycieków pamięci, które mogą znacząco obniżyć wydajność aplikacji, a nawet spowodować jej awarię. Niniejszy artykuł omawia istotę wycieków pamięci, ich przyczyny, sposoby ich wykrywania oraz metody zapobiegania im. Dodatkowo zawiera praktyczne przykłady kodowania i omawia, jak wykorzystać… SMART TS XL może usprawnić wykrywanie, analizę i zapobieganie wyciekom pamięci poprzez zaawansowaną analizę statyczną, tworzenie schematów blokowych i poprawę jakości kodu.

POTRZEBUJESZ NAPRAWIĆ WYCIEKI PAMIĘCI?

SMART TS XL to idealne rozwiązanie do wykrywania wycieków pamięci w milionach wierszy kodu

Przeglądaj terazCzym są wycieki pamięci?

Wyciek pamięci występuje, gdy program przydziela pamięć ze sterty, ale nie zwalnia jej, gdy nie jest już potrzebna. W rezultacie pamięć nie jest już używana przez program, ale system operacyjny ani inne procesy nie mogą jej odzyskać. Z czasem te niewykorzystane bloki pamięci kumulują się, zmniejszając ilość dostępnej pamięci, co może prowadzić do spadku wydajności, a w końcu do awarii programu w przypadku wyczerpania się pamięci w systemie.

W językach zarządzanych, takich jak Java czy C#, zarządzaniem pamięcią zajmuje się moduł zbierający śmieci, który automatycznie odzyskuje pamięć, do której nie ma już odwołań. Jednak nawet w tych środowiskach mogą wystąpić wycieki pamięci, jeśli obiekty są nadal nieumyślnie odwoływane, uniemożliwiając modułowi zwalniającemu śmieci zwolnienie pamięci.

Przyczyny wycieków pamięci

Wycieki pamięci należą do najpowszechniejszych i najbardziej podstępnych problemów w rozwoju oprogramowania, po cichu obniżając wydajność i destabilizując aplikacje w miarę upływu czasu. W istocie, wycieki pamięci występują, gdy program przydziela pamięć, ale nie zwalnia jej, gdy dane nie są już potrzebne. W przeciwieństwie do awarii lub oczywistych błędów, wycieki często pozostają niezauważone podczas początkowych testów, ujawniając się dopiero po dłuższym użytkowaniu – gdy aplikacja zwalnia do granic możliwości lub nagle się zamyka z powodu wyczerpania zasobów systemowych.

Skutki wycieków pamięci mogą wahać się od drobnych niedociągnięć po katastrofalne awarie, szczególnie w długo działających systemach, takich jak serwery, urządzenia wbudowane czy aplikacje mobilne. W skrajnych przypadkach wycieki mogą powodować spowolnienia całego systemu, zmuszając użytkowników do ponownego uruchamiania urządzeń lub usług w celu odzyskania pamięci. Nawet w językach z odśmiecaniem pamięci, takich jak Java czy Python, gdzie automatyczne zarządzanie pamięcią ma obsługiwać czyszczenie, subtelne błędy programistyczne mogą nadal prowadzić do wycieków poprzez pozostawione odwołania lub niezamknięte zasoby.

Zrozumienie przyczyn wycieków pamięci jest kluczowe dla programistów na każdym poziomie zaawansowania. Niezależnie od tego, czy pracują z językami niskiego poziomu, takimi jak C++, które wymagają ręcznego zarządzania pamięcią, czy z językami wysokiego poziomu z odśmiecaniem pamięci, programiści muszą stosować zdyscyplinowane praktyki, aby zapobiegać wyciekom. W tym artykule omówiono najczęstsze źródła wycieków pamięci, oferując wgląd w ich powstawanie i strategie ich ograniczania. Rozpoznając te pułapki, programiści mogą pisać bardziej wydajny, niezawodny i łatwiejszy w utrzymaniu kod – zapewniając optymalne działanie aplikacji przez cały cykl ich życia.

Błędy ręcznego zarządzania pamięcią

W językach takich jak C i C++ zarządzanie pamięcią odbywa się całkowicie ręcznie. Oznacza to, że każdy blok dynamicznie przydzielanej pamięci, malloc, calloclub new musi zostać wyraźnie zwolniony z free or deleteWyciek pamięci występuje, gdy programiści zapominają zwolnić tę pamięć po tym, jak nie jest już potrzebna. Takie zaniedbania często wynikają ze złożonych przepływów sterowania, wczesnych zwrotów lub obsługi wyjątków, które pomijają wywołania dealokacji. Oprócz braku dealokacji, nieprawidłowa realokacja, taka jak utrata wskaźnika do przydzielonej pamięci przed jej zwolnieniem, również prowadzi do nieodwracalnej pamięci. Kolejną poważną pułapką jest używanie wiszących wskaźników, które są odwołaniami do pamięci, która została już zwolniona. Może to prowadzić do niezdefiniowanego zachowania lub trudnych do zdiagnozowania awarii. Programiści muszą przestrzegać ścisłej dyscypliny i standardów przeglądu kodu podczas ręcznego zarządzania pamięcią. Narzędzia takie jak Valgrind, AddressSanitizer i wbudowane kontrole Clang są niezbędne do śledzenia alokacji i zapewnienia, że każda malloc or new ma odpowiedni free or deleteW programowaniu systemów krytycznych wycieki zasobów spowodowane błędami pamięci ręcznej mogą obniżyć wydajność lub sprawić, że aplikacja będzie zachowywać się nieprzewidywalnie w dłuższej perspektywie.

Nieograniczone lub rosnące struktury danych

Kolekcje rozrastające się w czasie bez odpowiednich ograniczeń są częstym źródłem wycieków pamięci, szczególnie w długo działających aplikacjach. Struktury danych, takie jak listy, kolejki, słowniki i pamięci podręczne, są często używane do przechowywania obiektów do tymczasowego przetwarzania lub wyszukiwania. Jeśli stare wpisy nigdy nie są usuwane ani nie wygasają, struktura nadal zużywa pamięć, nawet gdy dane stają się nieistotne. Na przykład, system rejestrowania może dołączać każdą wiadomość do listy, która nigdy nie jest czyszczona, a warstwa buforowania może przechowywać wyniki zapytań w nieskończoność bez żadnej strategii wygasania. W aplikacjach o dużej objętości struktury te mogą rozrastać się do tysięcy, a nawet milionów obiektów, co ostatecznie prowadzi do braku pamięci. Programiści powinni wdrożyć ograniczenia, interwały czyszczenia lub zasady usuwania obiektów ostatnio używanych (LRU), aby zapobiec niekontrolowanemu rozrastaniu się struktur danych. W językach z odśmiecaniem pamięci tego typu wyciek jest szczególnie trudny do uniknięcia, ponieważ pamięć jest technicznie osiągalna, więc nie zostanie usunięta. Monitorowanie rozmiaru zbioru i ustanawianie mechanizmów kontroli usuwających stare lub nieużywane wpisy pomaga zapobiegać powolnemu rozrostowi pamięci, który mógłby pozostać niezauważony podczas opracowywania lub testowania na małą skalę.

Odwołania cykliczne w językach zbieranych w ramach zbiorczego zbioru śmieci

Języki z odśmiecaniem pamięci, takie jak Java, Python i JavaScript, upraszczają zarządzanie pamięcią poprzez automatyczne czyszczenie nieosiągalnych obiektów. Jednak odwołania cykliczne stanowią subtelne wyzwanie. Gdy dwa lub więcej obiektów odwołuje się do siebie nawzajem i nie są już używane przez aplikację, ich wzajemne odwołania uniemożliwiają modułowi odśmiecania pamięci stwierdzenie, że można je bezpiecznie usunąć. Chociaż współczesne moduły odśmiecania pamięci poprawiły swoje możliwości wykrywania tych cykli, nie wszystkie środowiska lub typy modułów odśmiecania pamięci radzą sobie z nimi skutecznie. Ponadto domknięcia lub wyrażenia lambda w tych językach mogą nieumyślnie przechwytywać zmienne zakresu nadrzędnego, co utrzymuje obiekty przy życiu dłużej niż ich zamierzony cykl życia. Problem ten często pojawia się w aplikacjach z programowaniem reaktywnym, systemach zdarzeń lub grafach obiektów tworzących ciasne pętle. Zalecanym podejściem jest ręczne przerywanie tych cykli poprzez zerowanie referencji lub używanie słabych referencji. Niektóre języki oferują również wyspecjalizowane struktury danych lub menedżery kontekstu, które minimalizują ryzyko tworzenia silnych łańcuchów referencji. Bez dbałości o ten szczegół odwołania cykliczne mogą po cichu gromadzić pamięć, co prowadzi do spadku wydajności i trudnych do wyśledzenia wycieków.

Niezamknięte zasoby

Aplikacje, które oddziałują z zasobami systemowymi, takimi jak pliki, połączenia z bazami danych, gniazda sieciowe czy strumienie, muszą zapewnić jawne zwalnianie tych zasobów. W przeciwieństwie do zwykłych obiektów, które można poddać procesowi odśmiecania pamięci, zasoby te są często powiązane z uchwytami systemu operacyjnego i wymagają ręcznego lub strukturalnego czyszczenia. Jeśli plik zostanie otwarty, ale nigdy zamknięty, lub połączenie z bazą danych pozostanie zawieszone, nie tylko zużywa pamięć, ale także rezerwuje deskryptory plików, połączenia z gniazdami lub sloty puli bazy danych. Z czasem może to doprowadzić do wyczerpania uchwytów plików lub zablokowania pul połączeń. Współczesne języki programowania często oferują konstrukcje takie jak: try-with-resources w Javie, using w C# lub menedżerów kontekstu w Pythonie, aby zagwarantować zamknięcie zasobów nawet w przypadku wystąpienia wyjątków. Programiści, którzy ignorują lub pomijają te konstrukcje, ryzykują wprowadzenie cichych, ale szkodliwych wycieków zasobów. W dużych systemach nawet niewielki odsetek niezamkniętych zasobów może powodować problemy w całym systemie, zwłaszcza gdy aplikacje skalują się pod wpływem współbieżnego obciążenia. Niezawodne śledzenie i zamykanie zasobów musi być podstawową praktyką w każdym procesie rozwoju oprogramowania.

Zmienne statyczne i globalne

Zmienne statyczne i globalne są projektowane tak, aby były trwałe przez cały okres istnienia aplikacji, co czyni je z natury ryzykownymi, jeśli nie są odpowiednio zarządzane. Gdy zmienne te przechowują duże obiekty, dane tymczasowe lub odwołania do komponentów interfejsu użytkownika lub informacji specyficznych dla sesji, uniemożliwiają modułowi zbierającemu śmieci odzyskanie tej pamięci, nawet gdy nie jest już ona użyteczna. Statyczna pamięć podręczna, która nigdy nie jest czyszczona, lub usługa globalna, która przechowuje stare wyniki w nieskończoność, powoli zużywają coraz więcej pamięci z upływem czasu. Problem ten jest szczególnie dotkliwy w systemach obsługujących sesje użytkowników, transakcje lub zadania wsadowe, w których różne konteksty są wielokrotnie przetwarzane. Jeśli pole statyczne gromadzi stan z każdej instancji i nigdy się nie resetuje, koszt pamięci rośnie wraz z wykorzystaniem. Programiści powinni ograniczyć użycie zmiennych statycznych do stałych lub niewielkich narzędzi, które z pewnością pozostaną aktualne przez cały cykl życia aplikacji. Jeśli wymagane jest trwałe przechowywanie, należy wdrożyć mechanizmy okresowego przycinania lub unieważniania przechowywanych wartości. Rutynowe audyty pamięci i profilowanie mogą również pomóc w wykryciu nieoczekiwanego wzrostu ilości pamięci spowodowanego nieprawidłowo określonym zakresem odwołań statycznych.

Wycieki związane z wątkami

Aplikacje wielowątkowe stwarzają wyjątkowe wyzwania w zakresie zarządzania pamięcią, szczególnie w zakresie pamięci lokalnej wątku i wątków o długim czasie życia. Gdy dane są przechowywane w zmiennych lokalnych wątku, ale nigdy nie są czyszczone, pozostają one powiązane z wątkiem tak długo, jak istnieje. Dochodzi do wycieku pamięci, jeśli wątek istnieje dłużej niż to konieczne lub jest ponownie wykorzystywany w puli wątków w nieskończoność. Ponadto wątki tła, które są zablokowane, uśpione lub oczekujące na zdarzenia, mogą przechowywać obiekty długo po tym, jak będą potrzebne. Jeśli wątek odwołuje się do klasy, która miała być efemeryczna, takiej jak obiekt żądania lub bufor tymczasowy, klasa ta nie może zostać pobrana do momentu zakończenia wątku. W przypadku, gdy wątki są źle zarządzane lub porzucane, wycieki te utrzymują się w ukryciu i rosną wraz ze skalowaniem systemu. Najlepsze praktyki obejmują jawne czyszczenie zmiennych lokalnych wątku, zapewnienie, że wątki o długim czasie działania zwalniają niepotrzebne odwołania, oraz projektowanie wątków roboczych w celu resetowania kontekstu między zadaniami. Należy również monitorować pule wątków pod kątem rozmiaru i zużycia pamięci, aby wykryć, kiedy bezczynne wątki przechowują więcej danych niż oczekiwano.

Problemy z bibliotekami innych firm

Nie wszystkie wycieki pamięci pochodzą z Twojego własnego kodu. Biblioteki i frameworki, zwłaszcza te, które komunikują się z grafiką, dźwiękiem lub sprzętem zewnętrznym, mogą zawierać własne wycieki lub ujawniać interfejsy API wymagające jawnego czyszczenia. Jeśli te interfejsy API nie są używane poprawnie, na przykład nie wywołują dispose() or shutdown() Metoda ta sprawia, że zarządzane przez nie zasoby pozostają przydzielone. Jest to szczególnie powszechne w starszych bibliotekach lub nowszych, które abstrahują złożoność, ale nie dokumentują dobrze wymagań cyklu życia. W niektórych przypadkach biblioteki implementują własne strategie buforowania lub łączenia zasobów, które mogą przechowywać obiekty w pamięci dłużej niż oczekiwano. Te bufory mogą być dostrajalne lub całkowicie nieprzejrzyste. Ponadto, integracja biblioteki może nieumyślnie zachować odwołania do obiektów aplikacji — na przykład rejestrując wywołanie zwrotne, które nigdy nie jest usuwane — co uniemożliwia gromadzenie obiektów. Programiści muszą uważnie przeglądać dokumentację wszelkiego dołączonego kodu stron trzecich i monitorować wykorzystanie pamięci w czasie, aby wykrywać wycieki wprowadzane przez biblioteki. Testowanie integracji stron trzecich pod obciążeniem lub korzystanie z narzędzi profilujących pomaga wykryć te problemy na wczesnym etapie.

System operacyjny radzi sobie z wyciekami

Wycieki pamięci nie ograniczają się do alokacji sterty. Aplikacje w dużym stopniu polegają również na uchwytach systemu operacyjnego, takich jak deskryptory plików, uchwyty GUI, gniazda i semafory. Każdy z tych zasobów ma skończony limit na poziomie systemu. Gdy uchwyty nie zostaną prawidłowo zamknięte, system ostatecznie wyczerpie zasoby, nawet jeśli pamięć wydaje się być dostępna. Na przykład, brak zamknięcia deskryptora pliku w systemie Linux prowadzi do błędów takich jak „Zbyt wiele otwartych plików”, które mogą nieoczekiwanie zatrzymać usługi. W środowiskach Windows wycieki uchwytów graficznego interfejsu urządzeń (GDI) mogą uniemożliwić renderowanie nowych okien lub elementów interfejsu użytkownika. Wycieki uchwytów są szczególnie trudne do zdiagnozowania, ponieważ mogą nie być widoczne w tradycyjnych profilatorach pamięci. Narzędzia do monitorowania specyficzne dla danej platformy, takie jak lsof W systemach Unix lub Menedżer zadań w systemie Windows może ujawnić nieprawidłowe użycie uchwytów. Programiści muszą dokładnie weryfikować procedury obsługi zasobów i upewnić się, że każda alokacja ma odpowiednią wersję. Korzystanie ze wzorców RAII lub menedżerów zasobów o określonym zakresie może pomóc w egzekwowaniu poprawnego działania zarówno w systemach wysokiego, jak i niskiego poziomu.

Subskrypcje i wywołania zwrotne wydarzeń

Systemy sterowane zdarzeniami są podatne na wycieki pamięci, gdy komponenty rejestrują się na zdarzenia, ale nigdy nie są wyrejestrowywane. Jest to szczególnie istotne w aplikacjach z długo działającymi wydawcami zdarzeń, takimi jak frameworki interfejsu użytkownika, magistrale komunikatów czy reaktywne potoki. Gdy nasłuchiwacz jest zarejestrowany i nie jest usuwany, wydawca zachowuje odwołanie do tego nasłuchiwacza, utrzymując przy życiu cały graf obiektów. Na przykład, jeśli widżet interfejsu użytkownika nasłuchuje aktualizacji z współdzielonego modelu, ale nigdy nie jest wyrejestrowywany po usunięciu z ekranu, widżet pozostaje w pamięci. W aplikacjach JavaScript węzły DOM dołączone do zdarzeń globalnych są częstą przyczyną wycieków pamięci, gdy węzły są usuwane wizualnie, ale nie są programowo odłączane. Rozwiązaniem jest symetryczne zarządzanie cyklem życia. Każda rejestracja musi być powiązana z jawnym wyrejestrowaniem. Niektóre frameworki obsługują słabe wzorce zdarzeń lub haki automatycznego czyszczenia, aby zminimalizować obciążenie programistów. Jednak poleganie wyłącznie na nich jest ryzykowne, chyba że potwierdzi się ich zachowanie podczas demontażu. Przeglądy kodu i testy powinny zawsze obejmować weryfikację, czy subskrypcje zdarzeń są poprawnie zamykane.

Nadużywanie inteligentnego wskaźnika C++

Inteligentne wskaźniki C++, takie jak unique_ptr, shared_ptr, weak_ptr To potężne narzędzia do automatycznego zarządzania pamięcią, ale niewłaściwie używane mogą powodować subtelne wycieki pamięci. Częstym problemem jest… shared_ptr Instancje tworzą odwołania cykliczne. Ponieważ wskaźniki współdzielone wykorzystują zliczanie referencji do zarządzania cyklami życia, obiekty, które wskazują na siebie nawzajem i mają wspólną własność, nigdy nie osiągną zerowego stanu, co zapobiega dealokacji. Ten problem często występuje w strukturach nadrzędny-podrzędny lub relacjach dwukierunkowych. Programiści muszą używać… weak_ptr w jednym kierunku, aby przerwać cykl i umożliwić prawidłowe czyszczenie. Innym problemem jest mieszanie surowych wskaźników ze wskaźnikami inteligentnymi. Jeśli surowe wskaźniki są używane do przechowywania referencji, którymi nie zarządza się ostrożnie, korzyści płynące ze wskaźników inteligentnych są zmniejszone. Niektórzy programiści błędnie alokują obiekty za pomocą new i zapominają o opakowywaniu ich w inteligentny wskaźnik, tracąc tym samym kontrolę nad ich własnością. Przestrzeganie zasad RAII (Resource Acquisition Is Initialization) jest kluczowe dla zapewnienia przewidywalnego zwalniania zasobów. Projektując z uwzględnieniem inteligentnego wskaźnika i unikając hybrydowych modeli zarządzania pamięcią, programiści mogą znacznie zmniejszyć ryzyko wystąpienia wycieków w nowoczesnym kodzie C++.

Wykrywanie wycieków pamięci

Wycieki pamięci są często trudne do wykrycia, ponieważ narastają powoli i nie zawsze powodują natychmiastowe błędy. W przeciwieństwie do awarii czy błędów składniowych, wycieki mogą pojawić się dopiero po kilku godzinach lub dniach nieprzerwanego działania aplikacji, szczególnie w systemach o stałym obciążeniu lub wysokiej współbieżności. Ich wykrycie wymaga połączenia obserwacji, instrumentacji i narzędzi. Poniżej przedstawiono praktyczne i skuteczne strategie identyfikacji wycieków pamięci w rzeczywistych aplikacjach.

Monitoruj wykorzystanie pamięci w czasie

Jednym z pierwszych objawów wycieku pamięci jest stały, rosnący trend w zużyciu pamięci podczas normalnej pracy. Można to zaobserwować za pomocą prostych narzędzi systemowych, takich jak Menedżer zadań w systemie Windows. top or htop w systemie Linux lub pulpity nawigacyjne do orkiestracji kontenerów w środowiskach Kubernetes. Użycie pamięci powinno wahać się wraz z obciążeniami, ale ostatecznie stabilizować. Jeśli nadal rośnie z czasem – zwłaszcza w okresach bezczynności lub po powtarzających się zadaniach – jest to wyraźny sygnał, że pamięć nie jest zwalniana. W systemach produkcyjnych wykresy wykorzystania pamięci można śledzić za pomocą metryk systemowych lub narzędzi do monitorowania infrastruktury. Korelacja skoków użycia z określonymi zdarzeniami aplikacji lub interakcjami użytkownika może pomóc w zawężeniu źródła wycieku. Wczesne wykrywanie poprzez okresowe monitorowanie pomaga zapobiegać awariom i spadkom wydajności.

Użyj profili sterty i pamięci

Profilery sterty to niezbędne narzędzia do wizualizacji wykorzystania pamięci i identyfikacji obiektów zajmujących miejsce w aplikacji. Narzędzia te umożliwiają programistom tworzenie migawek pamięci w różnych punktach czasowych, a następnie porównywanie ich w celu wykrycia, które obiekty zwiększają się bez zwalniania. W Javie powszechnie używane są narzędzia VisualVM i Eclipse Memory Analyzer. Programiści .NET często korzystają z dotMemory lub CLR Profiler, podczas gdy aplikacje C/C++ korzystają z Valgrind lub AddressSanitizer. Python oferuje narzędzia takie jak objgraph oraz memory_profilerProfilery sterty wyświetlają łańcuchy referencyjne, rozmiary pamięci retencyjnej i drzewa alokacji, pomagając śledzić sposób przechowywania pamięci. W przypadku złożonych aplikacji połączenie migawek z logiką filtrowania i grupowania może wskazać problematyczne obszary. W połączeniu z debugowaniem na żywo profilery umożliwiają badanie w czasie rzeczywistym obiektów, które pozostają w pamięci dłużej niż oczekiwano. Ta wiedza ma kluczowe znaczenie w diagnozowaniu powolnych wycieków, które umykają tradycyjnym logom lub metrykom systemowym.

Rejestruj wzrost obiektów i kolekcji

Rejestrowanie rozmiaru kluczowych struktur danych lub pul obiektów w czasie to lekka, ale skuteczna technika wykrywania wycieków podczas tworzenia i testowania. Programiści mogą instrumentować kod, aby okresowo raportować długość kolekcji, takich jak listy, mapy, kolejki lub rejestry sesji. W scenariuszach, w których oczekuje się, że te struktury danych tymczasowo się rozrosną, a następnie skurczą, monitorowanie ich rozmiaru może ujawnić, czy kiedykolwiek powrócą do stanu wyjściowego. Na przykład, jeśli kolejka komunikatów przetwarza zadania, ale rozmiar jej wewnętrznej listy nigdy się nie zmniejsza, obiekty mogą się kumulować z powodu luk logicznych. Jest to szczególnie przydatne, gdy profilowanie nie jest możliwe lub gdy podejrzewa się wycieki w określonych obszarach funkcjonalnych. Dzięki osadzaniu tych logów obok wykonywania zadań lub przepływów użytkowników, programiści zyskują wgląd w nieprawidłowe wzorce retencji obiektów. Można dodać automatyczne sprawdzanie progów w celu wykrywania i ostrzegania o niekontrolowanym wzroście, co pozwala na wczesne ograniczanie wycieków pamięci, zanim wpłyną one na wydajność.

Analiza zachowania w zakresie zbierania śmieci

Języki korzystające z odśmiecania pamięci, takie jak Java, Python i C#, oferują użyteczne wskaźniki obciążenia pamięci za pomocą logów odśmiecania pamięci. Gdy system doświadcza częstych cykli odśmiecania pamięci z minimalnym odzyskiwaniem pamięci, zazwyczaj sygnalizuje to niepotrzebne zatrzymywanie obiektów. Analiza tych logów ujawnia, jak często występują główne odśmiecania pamięci, ile pamięci jest odzyskiwane i jak zmienia się wykorzystanie sterty w czasie. W Javie narzędzia takie jak GCViewer lub wbudowanych dzienników JVM (-XX:+PrintGCDetails) dostarczają informacji o efektywności działania modułu zbierającego śmieci. Nadmierna aktywność modułu zbierającego śmieci może obniżyć wydajność aplikacji, nawet jeśli pamięć nie została jeszcze całkowicie wyczerpana. Jeśli moduł zbierający śmieci działa często, ale nie może odzyskać miejsca, programiści powinni zbadać odwołania do obiektów i ścieżki alokacji. Wzorce takie jak rosnące zużycie pamięci przez moduły starszej generacji i długie czasy pauzy modułu zbierającego śmieci często wskazują na obiekty, które system błędnie zakłada, że są nadal używane. Regularne analizowanie tych wzorców to skuteczny sposób wykrywania cichego retencji pamięci w środowiskach zarządzanych.

Punkty aktywne alokacji torów

Narzędzia profilowania mogą wskazywać funkcje lub moduły odpowiedzialne za największą liczbę alokacji obiektów. Punkty aktywne alokacji same w sobie nie zawsze stanowią wyciek, ale gdy pewne obszary konsekwentnie alokują dużą liczbę obiektów, które nigdy nie są zbierane, staje się to sygnałem ostrzegawczym. Profilery pamięci można skonfigurować tak, aby wyświetlały liczbę alokacji i ślady stosu prowadzące do tych alokacji. W językach takich jak Java, jmap i JProfiler pozwalają programistom zidentyfikować klasy i metody generujące największe zużycie pamięci. W przypadku aplikacji natywnych narzędzie Massif firmy Valgrind jest pomocne w śledzeniu szczytów alokacji. Śledzenie tych punktów aktywnych pozwala zespołom na inspekcję projektu funkcji lub pętli o wysokiej rotacji. Usługa, która wielokrotnie alokuje pamięć w wątku odpytywania, bez zwalniania odwołań do tych obiektów, może prowadzić do powolnego wzrostu zużycia pamięci. Programiści mogą optymalizować lub restrukturyzować takie ścieżki kodu, aby zapewnić zwalnianie obiektów tymczasowych po spełnieniu ich przeznaczenia. Wczesne reagowanie na punkty aktywne minimalizuje długoterminowe wycieki, zanim nagromadzą się one w sesjach użytkownika lub cyklach usługi.

Obserwuj zachowanie aplikacji pod obciążeniem

Testowanie obciążeniowe to niezawodny sposób na wykrycie wycieków pamięci, które pozostają ukryte w typowych obciążeniach programistycznych. Symulując wysoką współbieżność, stały ruch lub powtarzające się wzorce użycia, programiści mogą obserwować, jak aplikacja zachowuje się pod obciążeniem. Wycieki pamięci często ujawniają się w takich scenariuszach poprzez rosnące zużycie pamięci, dłuższy czas reakcji, a ostatecznie błędy braku pamięci. Wyniki testów obciążeniowych powinny być powiązane z monitorowaniem pamięci i dziennikami, aby określić, czy wykorzystanie zasobów stabilizuje się po obciążeniu, czy nadal rośnie. Narzędzia takie jak JMeter, Locust i k6 pomagają symulować obciążenie, a metryki systemowe i aplikacyjne zapewniają pętle sprzężenia zwrotnego. Ta metoda jest szczególnie przydatna do identyfikacji wycieków w przepływach uwierzytelniania, przetwarzaniu plików, strumieniowaniu danych lub ścieżkach kodu wykonywanych na żądanie. Testowanie obciążeniowe w środowisku testowym lub przedprodukcyjnym pozwala zespołom wykryć wycieki, które w przeciwnym razie ujawniłyby się w środowisku produkcyjnym, gdzie wykrywanie staje się bardziej ryzykowne, a usuwanie bardziej uciążliwe.

Monitoruj liczbę wątków lub uchwytów

Wycieki pamięci nie ograniczają się do wykorzystania sterty obiektów. Zasoby systemowe, takie jak wątki, deskryptory plików, gniazda i uchwyty graficznego interfejsu użytkownika, również zużywają pamięć i muszą zostać jawnie zwolnione. Wyciek tych zasobów może wyczerpać limity systemu operacyjnego, co prowadzi do niestabilności systemu lub awarii aplikacji. Programiści powinni monitorować pule wątków, stany gniazd i otwarte uchwyty plików, aby wykryć nieprawidłowe retencje. Narzędzia takie jak lsof, netstatMonitory zasobów specyficzne dla platformy pomagają śledzić otwarte zasoby w czasie wykonywania. Na przykład, jeśli aplikacja tworzy wątki do obsługi zadań, ale nigdy ich prawidłowo nie kończy, użycie pamięci będzie rosło równolegle z liczbą wątków. Podobnie, niezamknięte pliki lub gniazda mogą utrzymywać się w tle, akumulując obciążenie na poziomie systemu, nawet jeśli są bezczynne. Tego typu wycieki są szczególnie podstępne w przypadku usług o długim czasie życia i serwerów o wysokiej przepustowości. Prawidłowe zarządzanie cyklem życia tych zasobów – wraz z automatycznymi mechanizmami czyszczenia i zamykania systemu – zapewnia szybkie i bezpieczne odzyskiwanie pamięci systemowej.

Użyj narzędzi APM i monitorowania środowiska wykonawczego

Narzędzia do monitorowania wydajności aplikacji (APM) zapewniają ciągły wgląd w wykorzystanie pamięci, zachowanie mechanizmu odśmiecania pamięci i okres życia obiektów w różnych środowiskach. Rozwiązania takie jak New Relic, Dynatrace, AppDynamics i Datadog oferują zintegrowane pulpity nawigacyjne pamięci i wykrywanie anomalii w działających aplikacjach. Platformy te mogą powiadamiać zespoły o przekroczeniu progów wykorzystania pamięci lub o nietypowym zachowaniu określonych usług pod obciążeniem. Niektóre narzędzia obejmują również porównania historyczne i analizę retencji, pomagając korelować trendy dotyczące pamięci z wdrożeniami lub skokami ruchu. W środowiskach produkcyjnych, w których profilowanie jest zbyt inwazyjne, narzędzia APM stanowią główny punkt odniesienia w wykrywaniu wycieków pamięci. Pomagają one śledzić żądania intensywnie wykorzystujące pamięć, identyfikować wolne punkty końcowe i wyróżniać usługi, które przechowują obiekty dłużej niż oczekiwano. Wiele platform APM obsługuje również wyzwalacze zrzutu pamięci (heap dump) lub próbkowanie obiektów, dostarczając wystarczającą ilość danych diagnostycznych bez wpływu na wydajność środowiska uruchomieniowego. Integracja rozwiązań APM na wczesnym etapie cyklu rozwoju oprogramowania umożliwia proaktywne wykrywanie wycieków i przyspiesza analizę przyczyn źródłowych w przypadku wystąpienia problemów.

Porównaj migawki pamięci przed i po zadaniach

Prostą, a zarazem skuteczną techniką wykrywania wycieków pamięci jest wykonywanie migawek pamięci w kluczowych momentach cyklu życia aplikacji – przed i po wykonaniu głównych operacji. Na przykład, jeśli aplikacja ładuje sesje użytkowników, przetwarza duże zbiory danych lub uruchamia zadania wsadowe, wykonanie migawki stosu przed operacją i kolejnej po niej pozwala przeanalizować, które obiekty zostały utworzone, a które pozostały. W idealnym przypadku obiekty tymczasowe powinny być zwalniane po zakończeniu zadania. Jeśli duże wolumeny pamięci pozostają zajęte bez wyraźnego powodu, może to oznaczać, że obiekty są przetrzymywane nieumyślnie. Narzędzia do analizy stosu umożliwiają porównywanie migawek i wskazywanie obiektów, których liczba lub rozmiar wzrosły. Takie badanie skoncentrowane na delcie jest szczególnie skuteczne w wykrywaniu wycieków w izolowanych modułach lub funkcjach. W połączeniu z logami, metrykami i śledzeniem alokacji, porównania migawek mogą prowadzić bezpośrednio do ścieżek kodu odpowiedzialnych za wycieki pamięci.

Zapobieganie wyciekom pamięci

Zapobieganie wyciekom pamięci jest równie ważne, jak ich wykrywanie. Chociaż narzędzia i diagnostyka mogą pomóc w wykryciu wycieków po ich wystąpieniu, solidne praktyki projektowe, zdyscyplinowane zarządzanie zasobami i przestrzeganie konwencji specyficznych dla danego języka programowania mogą zapobiec wystąpieniu większości wycieków. Proaktywne zapobieganie skraca czas debugowania, poprawia stabilność aplikacji i zapewnia skalowalność wraz z rozwojem systemów. Poniżej przedstawiono sprawdzone techniki i nawyki architektoniczne, które minimalizują ryzyko wycieków pamięci w różnych środowiskach programistycznych.

Użyj struktur zarządzania zasobami

Języki takie jak Java, C# i Python oferują strukturalne konstrukcje do automatycznego czyszczenia zasobów. Należą do nich: try-with-resources, using instrukcje i menedżery kontekstu. Prawidłowo używane, zapewniają one zamknięcie zasobów, takich jak pliki, gniazda i połączenia z bazą danych, nawet w przypadku wystąpienia wyjątków. Programiści powinni preferować te konstrukcje zamiast ręcznych zamknięć wywołań, które są podatne na pominięcia. W środowiskach niezarządzanych, takich jak C i C++, użycie RAII (Resource Acquisition Is Initialization) gwarantuje, że zasoby zostaną zwolnione, gdy obiekty wyjdą poza zakres. Wzorce te zmniejszają ryzyko zapomnienia o czyszczeniu i prowadzą do bezpieczniejszego, bardziej przewidywalnego kodu. Zespoły powinny ujednolicić te konstrukcje i traktować każde ręczne zarządzanie zasobami jako błąd w kodzie, który wymaga szczególnej kontroli podczas przeglądów.

Szybkie wyrejestrowywanie nasłuchiwaczy zdarzeń i wywołań zwrotnych

Kod sterowany zdarzeniami wymaga jawnego anulowania subskrypcji obiektów nasłuchujących, gdy obiekt je rejestrujący nie jest już potrzebny. Niedopełnienie tego obowiązku prowadzi do zachowania referencji i braku możliwości zwolnienia pamięci. W systemach z elementami GUI, aktualizacjami danych w czasie rzeczywistym lub niestandardowymi magistralami zdarzeń, każda rejestracja powinna być dublowana poprzez wyrejestrowanie. Ta praktyka jest krytyczna w modułowych lub dynamicznych frameworkach interfejsu użytkownika, w których komponenty są często montowane i odmontowywane. Jednym z częstych błędów jest rejestrowanie obiektu nasłuchującego podczas inicjalizacji, ale nieusuwanie go podczas niszczenia lub odmontowywania. Wycieki pamięci narastają, gdy komponenty są niszczone wizualnie, ale logicznie pozostają do nich odwołania. Programiści powinni scentralizować logikę subskrypcji zdarzeń i zapewnić spójne uruchamianie procedur usuwania. Tam, gdzie to możliwe, należy używać słabych wzorców zdarzeń lub haków cyklu życia dostarczonych przez framework, aby zautomatyzować czyszczenie. Dodatkowo należy wdrożyć testy jednostkowe i integracyjne, które weryfikują usunięcie obiektów nasłuchujących po dezaktywacji komponentu lub wyładowaniu strony.

Ogranicz użycie odniesień statycznych i globalnych

Pola statyczne i zmienne globalne są często używane dla wygody, ale ich kosztem jest trwałość. Każdy obiekt, do którego odwołuje się kontekst statyczny, pozostaje w pamięci przez cały czas działania aplikacji, niezależnie od tego, czy jest nadal potrzebny. Staje się to szczególnie niebezpieczne, gdy duże kolekcje, dane sesji lub elementy interfejsu użytkownika są przechowywane statycznie. Z czasem obiekty te kumulują się i powodują niezamierzone zatrzymanie w pamięci. Aby temu zapobiec, programiści powinni używać pól statycznych tylko dla stałych niezmiennych, metod narzędziowych lub singletonów zarządzanych w cyklu życia. Należy unikać statycznego przechowywania obiektów zależnych od kontekstu lub dużych obiektów. Gdy wymagane są odwołania globalne, należy je połączyć z logiką wygasania, zasadami usuwania lub ręcznymi strategiami nullowania. Podczas wyłączania lub demontażu komponentu zasoby przechowywane statycznie powinny zostać jawnie wyczyszczone. Użycie statyczne należy również sprawdzać podczas żądań ściągnięcia (pull request), aby upewnić się, że dane tymczasowe lub transakcyjne nie trafią przypadkowo do pamięci masowej o długim okresie istnienia.

Przerwij odwołania cykliczne, gdy jest to konieczne

W środowiskach z odśmiecaniem pamięci odwołania cykliczne mogą nadal uniemożliwiać odzyskiwanie pamięci. Jest to szczególnie częste w przypadku używania domknięć, powiązanych struktur danych lub relacji dwukierunkowych. Programiści powinni zachować ostrożność, tworząc cykle między obiektami, które się do siebie odwołują. W C++ używaj weak_ptr przerwać cykle utworzone przez shared_ptrW Javie lub Pythonie należy analizować grafy obiektów i w razie potrzeby używać słabych referencji, aby umożliwić gromadzenie obiektów, które w innym przypadku byłyby osiągalne. Używając domknięć lub klas anonimowych, należy minimalizować zakres przechwytywanych zmiennych. Unikać odwoływania się do całych instancji klas, gdy wymagana jest tylko metoda lub niewielki fragment stanu. Domknięcia, które nieumyślnie przechwytują duże obiekty, są częstym źródłem wycieków w kodzie asynchronicznym lub reaktywnym. Regularne audytowanie tych wzorców i testowanie zachowania pamięci podczas tworzenia aplikacji pomaga zapobiegać utrwalaniu się referencji cyklicznych po osiągnięciu ich użyteczności.

Używaj struktur danych i wzorców oszczędzających pamięć

Wybór odpowiedniej struktury danych może pomóc uniknąć niepotrzebnego zatrzymywania danych w pamięci. Na przykład, używając WeakHashMap w Javie lub WeakKeyDictionary w Pythonie zapewnia automatyczne usuwanie kluczy lub wartości, gdy nie są już używane. Unikaj domyślnego korzystania z nieograniczonych list lub map, gdy można zastosować bardziej odpowiednią strukturę, taką jak pamięć podręczna LRU lub ograniczona kolejka. W przypadku konieczności tymczasowego przechowywania dużych zbiorów danych, segmentuj dane i okresowo zwalniaj fragmenty, aby zmniejszyć obciążenie pamięci. Ponadto unikaj przedwczesnej optymalizacji, która prowadzi do buforowania wszystkiego „na wszelki wypadek”. Wdrożenie jasnych zasad dotyczących wygasania, usuwania lub limitów rozmiaru pomaga systemowi lepiej zarządzać pamięcią bez interwencji programisty. Profilowanie podczas projektowania, a nie dopiero po wystąpieniu wycieków, pomaga weryfikować założenia dotyczące retencji danych i rozmiaru struktury przy realistycznych obciążeniach.

Wyraźnie pozbywaj się nieużywanych przedmiotów

Chociaż języki z odśmiecaniem pamięci automatycznie zwalniają pamięć, czas jej zbierania zależy od dostępności obiektów. Jeśli odwołania pozostają, pamięć pozostaje przydzielona. Programiści mogą przyspieszyć wydanie, jawnie ustawiając zmienne na null (w Javie) lub None (w Pythonie) po zakończeniu ich użycia. Sygnalizuje to modułowi zbierającemu śmieci, że obiekt nie jest już potrzebny. Ta technika jest szczególnie przydatna w zakresach o długim czasie życia, takich jak procesy robocze w tle, długie pętle czy procedury obsługi sesji, gdzie w przeciwnym razie obiekty pozostawałyby przedmiotem odwołań przez dłuższy czas. W aplikacjach o krytycznym znaczeniu dla wydajności, świadome podejście do cyklu życia obiektu może znacznie zmniejszyć szczytowe zużycie pamięci. Należy jednak stosować tę metodę rozsądnie, aby uniknąć zaśmiecania kodu lub wprowadzania błędów. Zasadniczo należy upewnić się, że zmienne zawierające duże lub wrażliwe dane są czyszczone natychmiast po zakończeniu ich zadania.

Przyjmij defensywne strategie alokacji

Wycieki pamięci można ograniczyć, alokując pamięć tylko wtedy, gdy jest ona rzeczywiście potrzebna. Unikaj wstępnego alokowania dużych struktur, chyba że jest to wymagane ze względu na wydajność. Stosuj techniki leniwej inicjalizacji, w których pamięć jest alokowana na bieżąco i zwalniana natychmiast po zakończeniu zadania obiektu. Śledź wykorzystanie pamięci za pomocą struktur o określonym zakresie i przetwarzaj wsadowo duże zbiory danych, zamiast ładować je w całości do pamięci. W niektórych środowiskach pulowanie może również powodować wycieki pamięci, jeśli obiekty nigdy nie są zwracane do puli. Upewnij się, że każda niestandardowa logika zarządzania pamięcią obejmuje limity czasu lub logikę wykrywania wycieków. Programiści powinni przyjąć zasadę, że każda alokacja powinna obejmować plan zwalniania, szczególnie w systemach wrażliwych na wydajność lub o ograniczonych zasobach.

Włącz audyt pamięci do CI/CD

Zapobieganie nie jest kompletne bez ciągłego monitorowania. Zintegrowanie audytów pamięci z procesem CI/CD pomaga wcześnie wykrywać regresje. Narzędzia takie jak automatyczne profilery, liczniki alokacji czy syntetyczne testy obciążenia można zaplanować do uruchomienia przed każdym wdrożeniem. Systemy te śledzą kluczowe wskaźniki, takie jak rozmiar sterty, częstotliwość GC, liczba obiektów i obsługa zasobów. W przypadku przekroczenia progów lub wykrycia odchyleń od wartości bazowych, zespoły są powiadamiane, zanim zmiany dotrą do produkcji. To proaktywne podejście sprawia, że zarządzanie pamięcią staje się ciągłą praktyką, a nie reaktywnym rozwiązaniem. Zespoły powinny również uwzględniać kluczowe wskaźniki efektywności (KPI) związane z pamięcią w swoich kryteriach jakości i przeprowadzać regularne przeglądy kodu skoncentrowane na zarządzaniu cyklem życia. Stworzenie kultury higieny pamięci gwarantuje, że zapobieganie jest wpisane w proces rozwoju oprogramowania.

Testowanie jednostkowe w celu wykrycia wycieków pamięci

Chociaż wycieki pamięci są zazwyczaj związane z zachowaniem środowiska wykonawczego i długoterminową wydajnością aplikacji, można i należy je wykrywać podczas testowania – zwłaszcza poprzez ukierunkowane testy jednostkowe. Zintegrowanie weryfikacji pamięci z procesami testowania jednostkowego pozwala zespołom identyfikować wycieki na wcześniejszym etapie procesu rozwoju, zanim nasilają się w środowisku produkcyjnym. Testy jednostkowe zaprojektowane z myślą o bezpieczeństwie pamięci pomagają zapewnić przestrzeganie granic cyklu życia obiektów, prawidłowe zwalnianie zasobów oraz wykonywanie operacji bez zachowywania niezamierzonych odwołań. Chociaż same testy jednostkowe nie są w stanie wykryć wszystkich wycieków, stanowią one kluczową pierwszą linię obrony, która wzmacnia dyscyplinę inżynierską i sprzyja projektowaniu uwzględniającemu wycieki.

Testy projektowe dotyczące alokacji i zachowania czyszczenia

Skuteczne testy jednostkowe w zarządzaniu pamięcią koncentrują się nie tylko na poprawności funkcjonalnej, ale także na cyklu życia obiektów. Każdy test powinien weryfikować, czy obiekty tymczasowe są tworzone, używane i usuwane prawidłowo. W przypadku niestandardowych pamięci podręcznych, menedżerów sesji lub fabryk usług, należy pisać testy symulujące tworzenie obiektów i weryfikować, czy nic nie jest niepotrzebnie zachowywane po zakończeniu operacji. Często wiąże się to z wielokrotnym wywoływaniem tej samej logiki i porównywaniem wykorzystania pamięci lub liczby obiektów między przebiegami. Jeśli wykorzystanie pamięci zwiększa się z każdym wywołaniem, może to wskazywać na wyciek. W systemach obsługujących duże obciążenia lub dużą rotację obiektów, należy uwzględnić w teście logikę usuwania, aby wymusić czyszczenie. W niektórych środowiskach instrumentacja kodu testowego za pomocą lekkich liczników alokacji lub kontroli referencji pomaga wykryć obiekty, które nie wykraczają poza zakres testu. Te asercje zapewniają, że wykorzystanie pamięci pozostaje przewidywalne i niezależne w zakresie testu.

Użyj bibliotek i narzędzi do wykrywania wycieków

Nowoczesne ekosystemy programistyczne oferują biblioteki rozszerzające frameworki testów jednostkowych o funkcje wykrywania wycieków pamięci. W przypadku języka C++ narzędzia takie jak Google Test można sparować z Valgrindem lub AddressSanitizerem, aby śledzić alokacje podczas wykonywania testów. Programiści Java mogą korzystać z narzędzi takich jak junit-allocations or OpenJDK Flight Recorder w trybie testowym, aby obserwować ilość zachowanej pamięci. Python oferuje objgraph, tracemalloc, gc Funkcje inspekcji modułów pozwalają śledzić wzrost obiektów pomiędzy asercjami. Biblioteki te można włączyć do standardowych zestawów testowych i wykorzystać do określania oczekiwań dotyczących liczby obiektów lub zmian w pamięci. Na przykład, test może potwierdzić, że po zakończeniu metody nie pozostały żadne dodatkowe instancje klasy. Opakowując przypadki testowe w kontrolowane zakresy alokacji lub migawki pamięci, programiści mogą sprawdzić, czy nie pozostały żadne ukryte odwołania. Narzędzia te nie tylko wcześnie wykrywają wycieki pamięci, ale także ułatwiają ich spójne odtwarzanie, co często jest trudne podczas pełnego profilowania aplikacji.

Symuluj powtarzalne użycie i mierz stabilność

Wycieki pamięci często występują w powtarzalnych lub długotrwałych operacjach. Aby wykryć te wzorce za pomocą testów jednostkowych, należy symulować wielokrotne wykonywanie tej samej funkcji lub cechy w pętli. Takie podejście może ujawnić stopniowy wzrost pamięci, który nie byłby widoczny w pojedynczym przebiegu testu. Na przykład funkcja buforująca, która nie usuwa nieaktualnych wpisów, może działać poprawnie w izolowanych warunkach, ale nie działać poprawnie w przypadku długotrwałego powtarzania. Strukturuj swoje testy tak, aby wykonywały dziesiątki lub setki iteracji i mierz stan pamięci lub obiektów po ich zakończeniu. Niektóre frameworki testowe umożliwiają konfigurowanie i usuwanie haczyków na poziomie osprzętu, które umożliwiają sprawdzanie zasobów między cyklami. Włączenie tych pętli do automatyzacji testów pomaga zapewnić spójność wykorzystania pamięci w czasie. Jest to szczególnie cenne w przypadku usług, które muszą zachować stabilność podczas długich sesji, takich jak procesory działające w tle, punkty końcowe API lub zadania wsadowe. Obserwując, czy pamięć pozostaje stabilna po wielokrotnym wykonaniu, programiści zyskują wcześnie pewność co do niezawodności zarządzania pamięcią.

Zapewnij prawidłowe zwolnienie zasobów podczas demontażu testów

Testy jednostkowe powinny zawsze przywracać środowisko do stanu czystego, co dotyczy również pamięci. Oprócz asercji funkcjonalnych, metody usuwania testów są idealnym sposobem na sprawdzenie, czy zasoby tymczasowe zostały zwolnione. Niezależnie od tego, czy masz do czynienia ze strumieniami plików, połączeniami z bazą danych, czy pozorowanymi instancjami usług, bloki usuwania testów mogą zawierać jawne dispose, closelub null Operacje. Wzorce te wzmacniają zasadę, że wszystkie zasoby muszą zostać zwolnione po zakończeniu zadania. W stosownych przypadkach należy również potwierdzić, że kluczowe odwołania nie są już osiągalne lub że finalizatory zostały uruchomione. Taka praktyka zachęca programistów do pisania bardziej autonomicznego kodu i zmniejsza zanieczyszczenie testami w różnych pakietach. Gdy kod rozbiórkowy obejmuje walidację cykli życia obiektów, znacznie łatwiej jest wykryć regresje lub zmiany w zachowaniu, które powodują wycieki pamięci. Integracja asercji pamięci z czyszczeniem testów poprawia również niezawodność w środowiskach testowania równoległego lub ciągłego, gdzie izolacja testów jest niezbędna.

Próbki kodowania

Poniżej przedstawiono kilka przykładów kodowania, które demonstrują typowe wycieki pamięci i sposoby ich rozwiązania:

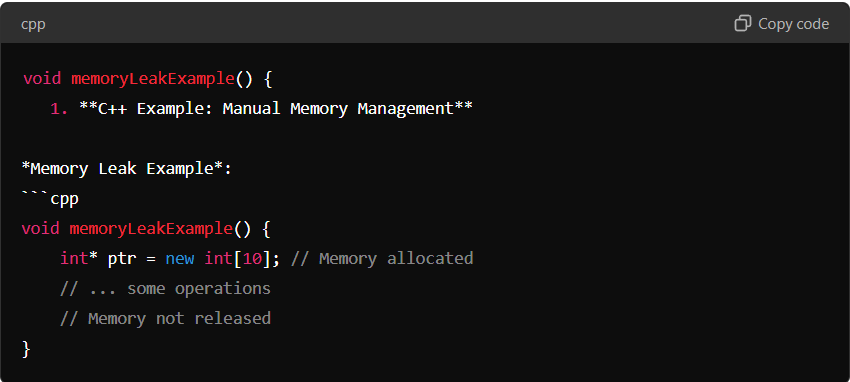

Przykład C++: ręczne zarządzanie pamięcią

W tym przykładzie pamięć jest przydzielana za pomocą new[] w celu utworzenia tablicy liczb całkowitych. Pamięć nie jest jednak zwalniana, ponieważ nie ma wywołania delete[], co prowadzi do wycieku pamięci.

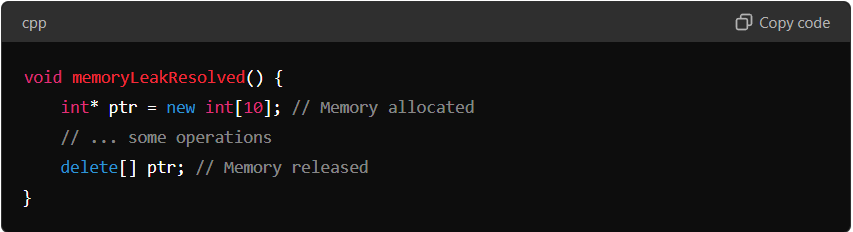

Rozwiązany przykład:

Aby rozwiązać problem wycieku, przydzielona pamięć jest prawidłowo zwalniana za pomocą polecenia delete[]. Gwarantuje to, że pamięć zostanie zwrócona systemowi, gdy nie będzie już potrzebna.

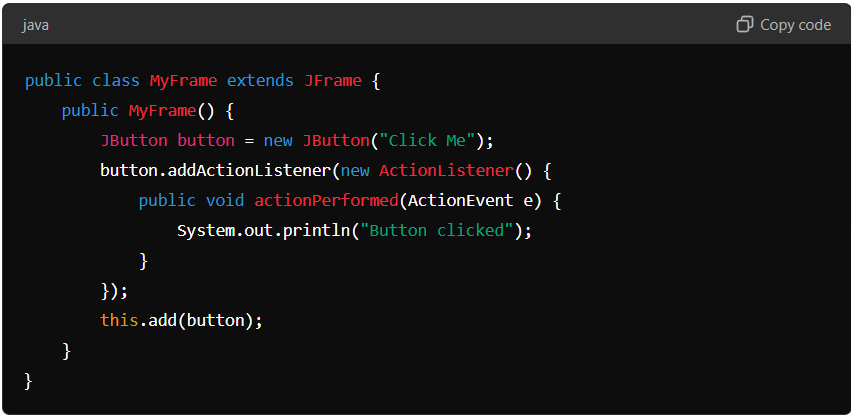

Przykład w Javie: wyciek pamięci dla programu nasłuchującego

Przykład wycieku pamięci:

W tym przykładzie anonimowa klasa wewnętrzna została użyta do utworzenia obiektu ActionListener dla przycisku. Jeśli jednak przycisk zostanie usunięty lub ramka zamknięta bez usunięcia obiektu nasłuchującego, obiekt nasłuchujący może spowodować wyciek pamięci, pozostawiając przycisk lub ramkę w pamięci.

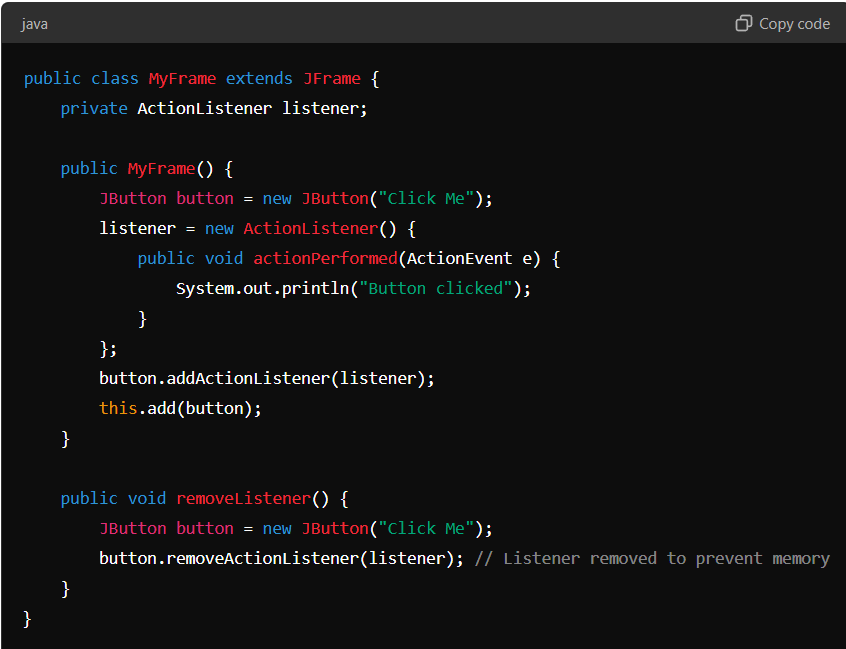

Rozwiązany przykład:

Zachowując odwołanie do obiektu nasłuchującego i jawnie usuwając je, gdy przycisk nie jest już potrzebny, zmniejsza się ryzyko wycieku pamięci.

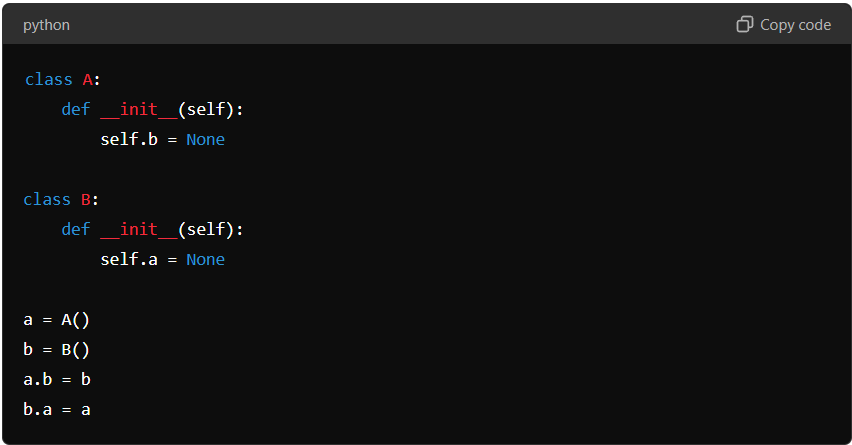

Przykład Pythona: odwołanie cykliczne

Przykład wycieku pamięci:

W tym przykładzie zmienne a i b zawierają odniesienia do siebie nawzajem, tworząc referencję cykliczną. Może to uniemożliwić modułowi zbierającemu śmieci Pythona zwolnienie obiektów, co prowadzi do wycieku pamięci.

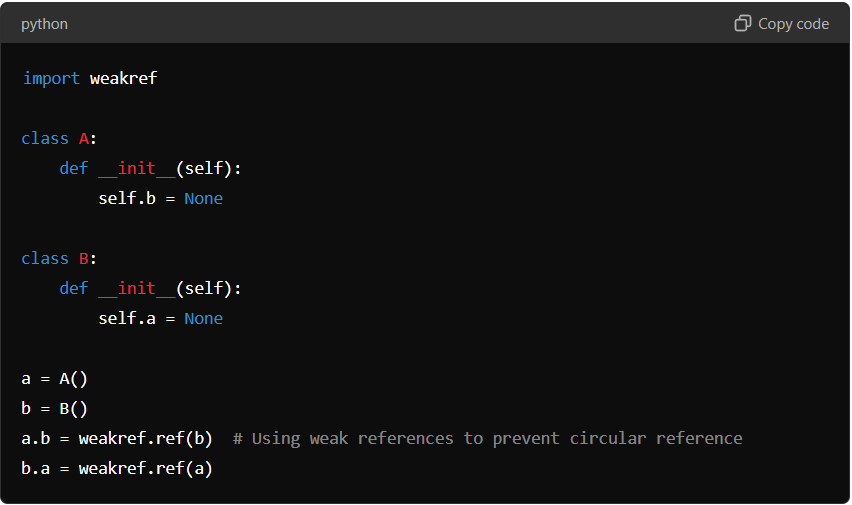

Rozwiązany przykład:

Użycie metody weakref przerywa cykliczne odwołanie, umożliwiając modułowi zbierającemu śmieci odzyskanie pamięci, gdy obiekty nie są już używane.

SMART TS XL:Narzędzie do skutecznego wykrywania i rozwiązywania wycieków pamięci

SMART TS XL może znacząco usprawnić proces wykrywania i usuwania wycieków pamięci. Oto jak można zintegrować to narzędzie z procesem rozwoju oprogramowania:

Statyczna analiza kodu: SMART TS XL oferuje zaawansowane możliwości analizy statycznejidentyfikując potencjalne wycieki pamięci poprzez analizę kodu. W przeciwieństwie do innych narzędzi, zapewnia głębszy wgląd i dokładniejsze wykrywanie wzorców, które mogą prowadzić do wycieków pamięci.

Budowanie schematu blokowego: SMART TS XL mogą automatycznie generuj schematy blokowe które wizualizują procesy alokacji i dealokacji pamięci w kodzie. Ta funkcja jest szczególnie przydatna do zrozumienia złożonych scenariuszy zarządzania pamięcią i identyfikacji miejsc, w których mogą wystąpić wycieki.

Analiza wpływu: Z SMART TS XL, Można przeprowadzić analizę wpływu aby zobaczyć, jak zmiany w jednej części kodu mogą wpłynąć na zarządzanie pamięcią w innych obszarach. Jest to szczególnie przydatne w dużych projektach, gdzie nawet drobne zmiany mogą mieć znaczący wpływ na wykorzystanie pamięci.

Poprawa jakości kodu:Poza samym wykrywaniem wycieków, SMART TS XL zapewnia sugestie dotyczące poprawa ogólnej jakości kodu, pomagając Ci pisać bardziej odporny, łatwy w utrzymaniu i odporny na wycieki kod.

Włączając SMART TS XL Wprowadzając do procesu rozwoju oprogramowania, możesz znacząco zmniejszyć ryzyko wycieków pamięci i zapewnić stabilność i wydajność aplikacji. Niezależnie od tego, czy masz do czynienia z ręcznym zarządzaniem pamięcią w C++, czy obsługujesz odwołania do obiektów w językach zarządzanych, takich jak Java i Python, SMART TS XL oferuje narzędzia niezbędne do utrzymania wysokich standardów zarządzania pamięcią i ogólnej jakości kodu.