Środowiska oprogramowania korporacyjnego wkraczające w rok 2026 nadal charakteryzują się złożonością strukturalną, a nie prostotą. Dziesięciolecia akumulacji logiki, mieszanych języków programowania, hybrydowych modeli wdrażania i ściśle powiązanych zależności coraz bardziej ograniczają możliwości wprowadzania zmian bez niepożądanych konsekwencji. W tym środowisku narzędzia do statycznej analizy kodu nie są już postrzegane jako opcjonalne kontrole jakości, lecz jako fundamentalne narzędzia do zrozumienia, jak systemy faktycznie zachowują się przed rozpoczęciem modernizacji, refaktoryzacji czy działań związanych z bezpieczeństwem.

Tym, co odróżnia statyczną analizę kodu na skalę korporacyjną od narzędzi zorientowanych na programistów, nie jest możliwość sygnalizowania pojedynczych defektów, ale możliwość wnioskowania w obrębie całych systemów aplikacji. Duże organizacje rzadko działają w ramach jednego środowiska uruchomieniowego lub wzorca architektonicznego. Obciążenia wsadowe komputerów mainframe współistnieją z usługami rozproszonymi, starsze interfejsy krzyżują się z natywnymi dla chmury interfejsami API, a wymogi prawne nakładają dodatkowe ograniczenia na sposób pomiaru i ograniczania ryzyka. Analiza statyczna musi zatem działać ponad granicami, ujawniając ścieżki wykonywania, ukryte zależności i ryzyka strukturalne, które w przeciwnym razie byłyby niewidoczne w samym testowaniu.

SMART TS XL

Idealne rozwiązanie do analizy kodu statycznego dla firm z dużymi rozproszonymi systemami i zasobami

Przeglądaj terazRosnący nacisk na ciągłe dostarczanie i przyspieszoną modernizację dodatkowo zwiększył rolę analizy opartej na analizie. W miarę jak przedsiębiorstwa dążą do szerszego modernizacja aplikacji W przypadku inicjatyw koszt niepełnego zrozumienia staje się coraz bardziej widoczny. Decyzje refaktoryzacyjne podejmowane bez pełnej widoczności przepływu sterowania, propagacji danych lub sprzężenia międzysystemowego często prowadzą do niestabilności, regresji wydajności lub narażenia na niezgodności, które ujawniają się dopiero po wdrożeniu. Oczekuje się obecnie, że narzędzia do statycznej analizy kodu zmniejszą tę niepewność, zapewniając przejrzystość architektury przed wprowadzeniem zmian.

W tym kontekście kryteria oceny narzędzi do statycznej analizy kodu w 2026 roku ulegają zmianie. Sama dokładność nie wystarczy. Przedsiębiorstwa potrzebują dogłębnej analizy, skalowalności obejmującej miliony linii kodu, obsługi środowisk heterogenicznych oraz umiejętności przełożenia ustaleń technicznych na praktyczne wnioski dla architektów, liderów platform i osób odpowiedzialnych za zarządzanie ryzykiem. Poniższe porównanie analizuje, jak wiodące narzędzia do statycznej analizy kodu dla przedsiębiorstw radzą sobie z tymi zmieniającymi się wymaganiami i jak ich możliwości dostosowują się do realiów dużych systemów o znaczeniu krytycznym.

Porównanie i ranking narzędzi do analizy statycznego kodu dla przedsiębiorstw w roku 2026

Poniższe porównanie ocenia wiodące narzędzia do statycznej analizy kodu pod kątem kryteriów, które mają znaczenie w dużych środowiskach korporacyjnych, a nie w przypadku indywidualnych zespołów programistycznych. Każde narzędzie jest oceniane pod kątem głębokości analizy, skalowalności w systemach heterogenicznych, obsługi starszych i nowoczesnych platform oraz zdolności do wydobywania istotnych wniosków ze złożonych struktur zależności. Ranking odzwierciedla skuteczność tych narzędzi w zrozumieniu architektury, identyfikacji ryzyka i podejmowaniu świadomych decyzji w środowiskach, w których zmiany niosą ze sobą istotne konsekwencje operacyjne i regulacyjne.

SMART TS XL

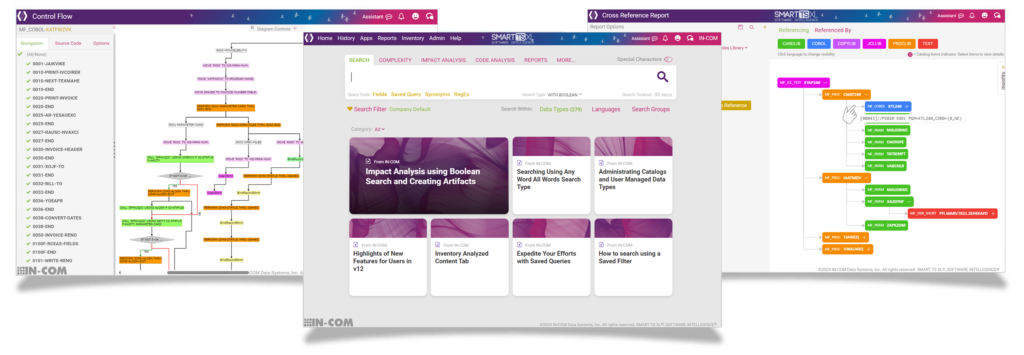

SMART TS XL to platforma do analizy statycznego kodu, oceny wpływu i analizy aplikacji dla przedsiębiorstw, przeznaczona dla dużych, heterogenicznych środowisk oprogramowania. Została stworzona z myślą o organizacjach działających w środowiskach mainframe, midrange i rozproszonych, w których dekady akumulacji logiki, przetwarzania wsadowego i zależności między platformami sprawiają, że zmiany są z natury ryzykowne. Zamiast koncentrować się na pojedynczych wynikach dotyczących jakości kodu, SMART TS XL ma na celu pokazanie, jak aplikacje faktycznie się zachowują, poprzez udostępnienie ścieżek wykonywania, relacji danych i struktur zależności w całych portfelach.

Platforma działa jako wydajny system internetowy, zdolny do indeksowania i analizowania miliardów linii kodu i powiązanych artefaktów w ciągu kilku sekund. Dzięki odciążeniu systemów produkcyjnych z zadań analitycznych i centralizacji analiz w środowisku współdzielonym, SMART TS XL Obsługuje tysiące równoczesnych użytkowników bez spadku wydajności. Taka skala sprawia, że rozwiązanie to jest odpowiednie nie tylko dla zespołów programistycznych, ale także dla architektów, kierowników modernizacji, wsparcia produkcji, audytorów i interesariuszy ds. zgodności, którzy wymagają spójnej, opartej na dowodach widoczności złożonych systemów. Poproś o demonstrację.

Statyczna analiza i odkrywanie na skalę przedsiębiorstwa

W jego rdzeniu SMART TS XL Zapewnia dogłębną analizę statyczną w szerokim zakresie języków programowania, konstrukcji kontroli zadań, baz danych i artefaktów pomocniczych. Obsługuje starsze i nowsze technologie, takie jak COBOL, PL/I, Natural, RPG, Assembler, Java, C#, Python, VB6, skrypty UNIX, JCL, PROC, artefakty CICS, definicje MQ, schematy baz danych i dokumenty strukturalne. Kod źródłowy, logika wsadowa, pliki konfiguracyjne, a nawet artefakty niekodowe, takie jak dokumentacja i diagramy, mogą być indeksowane i analizowane razem, co pozwala na odkrywanie powiązań w tradycyjnie wyizolowanych repozytoriach.

Ta ujednolicona funkcja wyszukiwania pozwala organizacjom wyjść poza inspekcję na poziomie plików i skupić się na zrozumieniu na poziomie systemu. Programy, zadania, pola, pliki, tabele i wiadomości można śledzić na różnych platformach, ujawniając przepływ logiki biznesowej w łańcuchach wsadowych, transakcjach online i dalszych procesach raportowania. Relacje te są prezentowane za pośrednictwem interaktywnych raportów z odniesieniami krzyżowymi, map zależności i nawigacyjnych widoków wykonania, a nie statycznych list.

Analiza wpływu międzyplatformowego i mapowanie zależności

SMART TS XL kładzie szczególny nacisk na analizę wpływu międzyplatformowego. Zmiany wprowadzone w jednej części aplikacji rzadko pozostają odizolowane w środowiskach korporacyjnych, zwłaszcza tam, gdzie obciążenia komputerów mainframe oddziałują na rozproszone usługi i współdzielone magazyny danych. SMART TS XL analizuje relacje połączeń, wykorzystanie danych, ścieżki wykonywania zadań i przepływ sterowania w celu identyfikacji stref wpływu w górę i w dół rzeki w różnych językach i systemach.

Funkcje mapowania zależności prezentują te relacje wizualnie za pomocą interaktywnych, kolorowych diagramów, które wyróżniają osoby wywołujące, osoby odbierające, twórcę danych i odbiorcę. Analizę wpływu można zainicjować z poziomu programu, pola, elementu bazy danych, kroku zadania, a nawet z wyników wyszukiwania, co pozwala zespołom precyzyjnie określić zakres zmian przed rozpoczęciem prac programistycznych. Takie podejście redukuje liczbę pominiętych zależności, ogranicza nadmierne testowanie i zapewnia solidną podstawę do planowania zmian i oceny ryzyka.

Widoki zorientowane na wykonanie logiki wsadowej i programowej

W środowiskach ze złożonym przetwarzaniem wsadowym SMART TS XL Zapewnia zrozumienie w stylu środowiska uruchomieniowego bez konieczności wykonywania kodu. Możliwości rozszerzeń COBOL i JCL rozwiązują copybooki, procedury, symbole i nadpisania, aby przedstawić logikę w sposób efektywny w środowisku produkcyjnym. Łańcuchy wsadowe można śledzić od początku do końca, ujawniając, które programy są wykonywane, w jakiej kolejności i z jakimi parametrami.

Diagramy przepływu sterowania i schematy blokowe przekładają głęboko zagnieżdżoną logikę na łatwe w nawigacji reprezentacje wizualne. Widoki te umożliwiają zrozumienie zachowań wykonawczych, identyfikację martwych lub niedostępnych ścieżek kodu oraz analizę złożoności rozgałęzień bez polegania na wiedzy plemiennej lub ręcznych instruktażach. Diagramy śledzenia pola dodatkowo rozszerzają te możliwości, śledząc sposób tworzenia, transformacji i propagacji elementów danych w programach, zadaniach i bazach danych, wspierając bezpieczne zmiany strukturalne i przeglądy regulacyjne.

Zaawansowane wyszukiwanie, wykrywanie wzorców i analiza precyzji

SMART TS XL Zawiera wydajną wyszukiwarkę korporacyjną zoptymalizowaną pod kątem dużych baz kodu o mieszanej technologii. Obsługuje złożoną logikę boolowską, wyszukiwanie bliskościowe, wyszukiwanie blokowe, wyrażenia regularne, obsługę synonimów oraz filtry precyzyjne, które ograniczają analizę do określonych języków, typów danych lub sekcji kodu. Warstwowe techniki wyszukiwania pozwalają użytkownikom stopniowo zawężać duże zbiory wyników do precyzyjnych zakresów odpowiednich do analizy wpływu, audytów lub ocen modernizacji.

Te możliwości wyszukiwania są ściśle zintegrowane z funkcjami wzajemnych odniesień, wpływu, złożoności i wizualizacji. Wyniki można bezpośrednio przekierować do widoków zależności, raportów lub dalszych przepływów pracy analitycznych, co zmniejsza tarcie między wyszukiwaniem a podejmowaniem decyzji. Zapisane i sparametryzowane zapytania pozwalają organizacjom standaryzować kontrole ryzyka i powtarzalne wzorce analizy w różnych zespołach i projektach.

Analiza złożoności i kwantyfikacja ryzyka

SMART TS XL Zapewnia analizę złożoności na poziomie portfela, wykraczającą poza pojedyncze programy. Metryki złożoności, takie jak liczba linii kodu, złożoność cyklomatyczna i miary Halsteada, można obliczyć dla docelowych podzbiorów aplikacji zdefiniowanych na podstawie wyników wyszukiwania lub stref wpływu. Pozwala to zespołom kwantyfikować ryzyko techniczne w obrębie konkretnych funkcji biznesowych lub kandydatów do modernizacji, zamiast polegać na zgrubnych średnich dla całej aplikacji.

Łącząc metryki złożoności z analizą zależności i wpływu, SMART TS XL wspiera bardziej realistyczne szacowanie nakładów i ustalanie priorytetów. Obszary o wysokim stopniu sprzężenia i złożoności można zidentyfikować wcześnie, co pozwala na ustalenie kolejności działań modernizacyjnych i naprawczych w oparciu o rzeczywiste ryzyko strukturalne, a nie założenia.

Transfer wiedzy, gotowość do audytu i wsparcie zarządzania

Powracającym wyzwaniem w dużych przedsiębiorstwach jest utrata wiedzy instytucjonalnej, wynikająca ze starzenia się systemów oraz przechodzenia na emeryturę lub rotacji doświadczonych pracowników. SMART TS XL rozwiązuje ten problem, centralizując wiedzę o aplikacjach na przeszukiwalnej i eksplorowalnej platformie, która rejestruje strukturę i zachowanie systemów. Dokumentacja, raporty, diagramy i artefakty dowodowe mogą być generowane i udostępniane w celu wsparcia wdrażania, audytów i wniosków regulacyjnych.

Funkcje eksportu umożliwiają pakowanie wyników analiz w postaci artefaktów z sygnaturą czasową i gotowych do weryfikacji, odpowiednich do przeglądów zgodności, zatwierdzania zmian i audytów zewnętrznych. Kontrola dostępu i śledzenie użytkowania wspierają wymogi zarządzania, szczególnie w środowiskach z offshorowym rozwojem oprogramowania lub outsourcingiem modeli utrzymania.

Wdrożenie, integracja i dopasowanie operacyjne

SMART TS XL Rozwiązanie zostało zaprojektowane z myślą o szybkim wdrożeniu i minimalnych zakłóceniach w działaniu. Instalacje można ukończyć w ciągu kilku godzin, a dostępne są konektory do pobierania danych ze środowisk mainframe, rozproszonych systemów kontroli wersji, baz danych i współdzielonych repozytoriów. Obsługiwane jest zarówno pełne, jak i przyrostowe ładowanie danych, co pozwala na utrzymanie aktualności środowisk bez konieczności ciągłej ręcznej interwencji.

Możliwości automatyzacji pozwalają na bezobsługowe działanie procesów analitycznych, wspierając ciągłe generowanie wniosków, zgodne z cyklem zmian w przedsiębiorstwie. Centralizując analizę w ramach ekonomicznej infrastruktury, organizacje mogą zmniejszyć zależność od kosztownych zasobów produkcyjnych, jednocześnie zwiększając głębokość analiz i ich dostępność w obrębie zespołów.

SonarQube Enterprise Edition

SonarQube Enterprise Edition to statyczna platforma do analizy kodu, zaprojektowana z myślą o dużych organizacjach deweloperskich, dążących do spójnego egzekwowania standardów jakości, łatwości utrzymania i bezpieczeństwa kodu w nowoczesnych portfolio oprogramowania. Jej główną rolą w środowiskach korporacyjnych jest pełnienie funkcji ciągłej warstwy inspekcji, wbudowanej w procesy rozwoju oprogramowania, zapewniając wczesną informację zwrotną o problemach z kodem, zanim zmiany trafią do produkcji. W portfolio, w którym przepustowość recenzji staje się wąskim gardłem, często jest ona umieszczana obok szerszego narzędzia do przeglądu kodu aby sformalizować kontrolę jakości i zmniejszyć różnice pomiędzy zespołami.

W przeciwieństwie do platform analitycznych na poziomie portfolio, siła SonarQube tkwi w jego możliwości działania blisko przepływu pracy programisty. Analiza jest zazwyczaj uruchamiana w ramach procesów kompilacji lub walidacji pull requestów, umożliwiając zespołom stopniowe wykrywanie nieprawidłowości w kodzie, błędów i problemów z bezpieczeństwem w miarę jego rozwoju. Jest to zgodne z podejściem organizacji, które standaryzują automatyczne kontrole w ramach procesów dostarczania, w tym podejścia opisane w… Potoki CI / CD, w którym analiza statyczna staje się powtarzalną kontrolą, a nie doraźnym krokiem przeglądu.

Analiza statyczna oparta na regułach i bramki jakości

Sercem SonarQube Enterprise Edition jest oparty na regułach silnik analizy statycznej, który ocenia kod źródłowy w oparciu o obszerny i konfigurowalny zestaw reguł. Reguły te obejmują typowe kategorie, takie jak problemy z konserwowalnością, defekty niezawodności i luki w zabezpieczeniach. Wyniki są klasyfikowane według ważności i mapowane na bramki jakości, które decydują o tym, czy kod może przejść przez proces dostarczania.

Bramki jakości stanowią centralny mechanizm egzekwowania standardów organizacyjnych na dużą skalę. Przedsiębiorstwa mogą definiować progi dla nowego kodu, gęstości defektów i narażenia na podatności, zapewniając, że zmiany spełniają predefiniowane kryteria przed integracją. Ta możliwość jest szczególnie cenna w środowiskach z rozproszonymi zespołami, outsourcingiem rozwoju lub dużą rotacją programistów, gdzie konsekwentne egzekwowanie ogranicza konieczność ręcznych przeglądów.

Zasięg językowy i integracja ekosystemu rozwoju

SonarQube obsługuje szeroki wachlarz nowoczesnych języków programowania, w tym Java, C#, JavaScript, TypeScript, Python i inne powszechnie używane w tworzeniu aplikacji korporacyjnych. Ekosystem wtyczek i integracji pozwala na integrację z popularnymi platformami CI/CD, systemami kontroli wersji i systemami śledzenia błędów. Ta ścisła integracja sprawia, że SonarQube doskonale nadaje się dla organizacji, które priorytetowo traktują automatyczną kontrolę jakości w ramach swoich procesów dostarczania oprogramowania.

Jednak model analizy SonarQube koncentruje się przede wszystkim na źródle i obejmuje zakres repozytorium. Chociaż SonarQube może analizować wiele projektów równolegle, jego rozumienie relacji między repozytoriami, platformami i kontekstami wykonania jest ograniczone. Analiza jest zazwyczaj ograniczona do pojedynczych aplikacji lub usług, a nie obejmuje całych systemów przedsiębiorstwa ze współdzielonymi danymi, przepływami pracy wsadowej lub zależnościami między platformami.

Analiza bezpieczeństwa i wsparcie zgodności

W wersjach Enterprise SonarQube oferuje ulepszone funkcje analizy bezpieczeństwa, dostosowane do typowych kategorii luk w zabezpieczeniach. Umożliwia identyfikację wzorców związanych z lukami w zabezpieczeniach, niebezpiecznymi konfiguracjami i niewłaściwym wykorzystaniem interfejsów API. Wyniki są prezentowane w formacie przystępnym zarówno dla programistów, jak i zespołów ds. bezpieczeństwa, wspierając procesy naprawcze w ramach istniejących narzędzi.

Z punktu widzenia zgodności, SonarQube zapewnia możliwość śledzenia i raportowania, które pomagają wykazać zgodność z wewnętrznymi standardami kodowania i politykami bezpieczeństwa. Można generować raporty, aby pokazać trendy problemów, postęp prac naprawczych i zgodność z bramkami jakościowymi w czasie. Chociaż funkcje te wspierają gotowość do audytu w zespołach programistycznych, są one mniej skoncentrowane na generowaniu dowodów na poziomie systemu dotyczących zachowań wykonawczych lub wpływu na wiele systemów.

Charakterystyka skalowalności i zagadnienia operacyjne

SonarQube Enterprise Edition został zaprojektowany z myślą o skalowalności w dużej liczbie repozytoriów i zespołów programistycznych, szczególnie w przypadku wdrożenia w środowiskach rozproszonych lub konteneryzowanych. Jego wydajność skaluje się wraz z dostępną infrastrukturą, dzięki czemu jest odpowiedni dla organizacji o dużej liczbie zatwierdzonych projektów i częstych cyklach analiz. Scentralizowane pulpity nawigacyjne zapewniają zagregowaną widoczność w projektach, pomagając kierownictwu monitorować trendy jakościowe na wysokim poziomie.

Mimo to, skalowalność SonarQube jest przede wszystkim horyzontalna w obrębie projektów, a nie wertykalna w obrębie złożoności systemu. SonarQube nie rozwiązuje problemów związanych ze ścieżkami wykonywania w czasie wykonywania, logiką orkiestracji wsadowej ani głębokim pochodzeniem danych na heterogenicznych platformach. W środowiskach zdominowanych przez obciążenia komputerów mainframe, harmonogramowanie wsadowe lub ściśle powiązane systemy starszej generacji, SonarQube jest często używany jako narzędzie uzupełniające, a nie jako samodzielne źródło wiedzy architektonicznej.

Typowe przypadki użycia w przedsiębiorstwach i ograniczenia

SonarQube Enterprise Edition sprawdza się najskuteczniej w przedsiębiorstwach o wysokim poziomie dojrzałości DevOps, ze standardowymi stosami programistycznymi i naciskiem na zapobieganie degradacji jakości aktywnie rozwijanego kodu. Doskonale sprawdza się w wymuszaniu spójności, redukcji błędów kodu i integracji kontroli jakości z dynamicznymi procesami dostarczania oprogramowania.

Jego ograniczenia stają się bardziej widoczne w scenariuszach modernizacji, które wymagają zrozumienia, jak zmiany rozchodzą się po dużych, połączonych systemach. SonarQube nie próbuje modelować kolejności wykonywania zadań, propagacji danych między zadaniami i platformami ani łańcuchów zależności w całym systemie. W rezultacie często jest łączony z platformami do głębszej analizy, gdy przedsiębiorstwa muszą ocenić ryzyko modernizacji, wpływ partii lub skutki zmian w obrębie całego portfela.

Checkmarx One

Checkmarx One to platforma bezpieczeństwa aplikacji dla przedsiębiorstw, koncentrująca się na statycznym testowaniu bezpieczeństwa aplikacji w ramach nowoczesnych procesów rozwoju i wdrażania. Jej główną rolą w dużych organizacjach jest identyfikacja luk w zabezpieczeniach na wczesnym etapie cyklu życia oprogramowania, szczególnie w środowiskach, w których częste publikacje, rozproszone zespoły i architektury chmurowe zwiększają ryzyko wykorzystania luk. Zamiast modelować zachowanie systemu w działaniu, Checkmarx One koncentruje się na wykrywaniu niebezpiecznych wzorców kodowania i luk w konfiguracji, które są zgodne z uznanymi taksonomiami bezpieczeństwa.

Platforma jest zazwyczaj wykorzystywana przez przedsiębiorstwa z dojrzałymi praktykami DevSecOps, w których analiza bezpieczeństwa ma działać w sposób ciągły równolegle z rozwojem oprogramowania, a nie jako mechanizm kontroli po wydaniu. W takich środowiskach Checkmarx One działa jako mechanizm zapobiegawczy, mający na celu zmniejszenie prawdopodobieństwa wprowadzenia podatnych ścieżek kodu do systemów produkcyjnych.

Skupienie się na testowaniu bezpieczeństwa aplikacji statycznych

Sercem Checkmarx One jest statyczny silnik testowania bezpieczeństwa aplikacji, zoptymalizowany pod kątem wykrywania luk w zabezpieczeniach na poziomie kodu źródłowego. Analiza odbywa się bez uruchamiania aplikacji, co pozwala na wczesną identyfikację problemów, często na etapie zatwierdzania lub kompilacji kodu. Platforma mapuje wyniki do dobrze znanych kategorii luk w zabezpieczeniach, wspierając zespoły ds. bezpieczeństwa, które opierają się na standardowych ramach klasyfikacji ryzyka, takich jak: Luki w zabezpieczeniach OWASP aby ustalić priorytety działań naprawczych.

Nacisk na ustalenia dotyczące bezpieczeństwa odróżnia Checkmarx One od uniwersalnych narzędzi do analizy statycznej. Zamiast podkreślać problemy związane z konserwowalnością czy architekturą, platforma koncentruje się na słabościach, które mogą prowadzić do ujawnienia danych, nieautoryzowanego dostępu lub eskalacji uprawnień. Ta specjalizacja sprawia, że jest ona szczególnie istotna w regulowanych branżach, w których terminy ujawniania i usuwania luk w zabezpieczeniach są ściśle monitorowane.

Integracja z korporacyjnymi procesami DevSecOps

Checkmarx One został zaprojektowany z myślą o ścisłej integracji z procesami CI/CD oraz przepływami pracy programistów. Skanowanie może być uruchamiane automatycznie w ramach procesów kompilacji, żądań ściągnięcia (pull request) lub bramek wydania, zapewniając spójną analizę bezpieczeństwa bez konieczności ręcznej interwencji. Wyniki są prezentowane za pośrednictwem pulpitów nawigacyjnych i integracji z systemami śledzenia błędów, co umożliwia przekazywanie ustaleń bezpośrednio do zespołów programistów w celu ich rozwiązania.

Ten model operacyjny skoncentrowany na potokach wspiera wysoką prędkość rozwoju przy jednoczesnym zachowaniu podstawowego poziomu bezpieczeństwa. Jednak koncentracja na indywidualnych repozytoriach i usługach oznacza, że analiza jest zazwyczaj ograniczona do odrębnych baz kodu. Chociaż jest to zgodne z mikrousługami i architekturami modułowymi, ogranicza to widoczność zależności międzyaplikacyjnych lub wieloplatformowych łańcuchów wykonywania, powszechnych w długowiecznych systemach korporacyjnych.

Zakres języków i orientacja na chmurę natywną

Checkmarx One obsługuje szeroką gamę nowoczesnych języków programowania i frameworków powszechnie używanych w przedsiębiorstwach i w środowisku chmurowym. Ta wszechstronność umożliwia spójne skanowanie bezpieczeństwa w heterogenicznych zespołach programistycznych bez konieczności stosowania wielu specjalistycznych narzędzi. Natywny dla chmury model dostarczania platformy dodatkowo upraszcza wdrażanie i skalowanie, redukując obciążenie operacyjne w organizacjach zarządzających dużą liczbą aplikacji.

Niemniej jednak, wsparcie dla starszych technologii i środowisk wsadowych jest bardziej ograniczone. Języki mainframe, konstrukcje kontroli zadań i ściśle powiązane starsze przepływy pracy zazwyczaj wykraczają poza podstawowy zakres platformy. W rezultacie Checkmarx One jest często wdrażany wraz z innymi narzędziami analitycznymi, gdy przedsiębiorstwa muszą zabezpieczyć zarówno nowoczesne, jak i starsze komponenty w ramach tego samego środowiska aplikacji.

Raportowanie ryzyka i dostosowanie zarządzania

Z perspektywy zarządzania, Checkmarx One oferuje funkcje raportowania, które wspierają śledzenie luk w zabezpieczeniach, status działań naprawczych i raportowanie zgodności. Liderzy bezpieczeństwa mogą monitorować trendy w aplikacjach, zespołach i okresach, pomagając wykazać zgodność z wewnętrznymi politykami i zewnętrznymi wymogami regulacyjnymi. Wyniki można agregować, aby pokazać ogólną postawę wobec ryzyka, co umożliwia priorytetyzację na poziomie portfela.

Raporty te koncentrują się jednak na obecności luk w zabezpieczeniach, a nie na ich wpływie operacyjnym. Platforma nie próbuje kwantyfikować sposobu, w jaki luka rozprzestrzenia się poprzez ścieżki wykonania, ani interakcji z przetwarzaniem wsadowym, przepływami danych czy systemami niższego szczebla. To rozróżnienie jest istotne w przedsiębiorstwach, w których zrozumienie zasięgu i ryzyka systemowego jest równie istotne, jak identyfikacja poszczególnych słabych punktów.

Typowe przypadki użycia i ograniczenia w przedsiębiorstwach

Checkmarx One sprawdza się najskuteczniej w przedsiębiorstwach, które chcą wdrożyć mechanizmy bezpieczeństwa bezpośrednio w dynamicznie zmieniających się środowiskach programistycznych. Doskonale identyfikuje problemy bezpieczeństwa na poziomie kodu na wczesnym etapie, redukując liczbę poprawek i wspierając spójne zarządzanie lukami w zabezpieczeniach w dużych populacjach programistów. Dla organizacji modernizujących się w kierunku architektur chmurowych, zapewnia skalowalny mechanizm egzekwowania higieny bezpieczeństwa.

Jego ograniczenia ujawniają się w scenariuszach wymagających holistycznego zrozumienia zachowania aplikacji, łańcuchów zależności lub wpływu modernizacji na systemy heterogeniczne. W takich przypadkach Checkmarx One jest zazwyczaj pozycjonowany jako specjalistyczna warstwa bezpieczeństwa, a nie kompleksowa platforma analityczna, uzupełniająca narzędzia koncentrujące się na analizie wykonania, mapowaniu zależności i ocenie ryzyka strukturalnego.

Analizator kodu statycznego Fortify

Fortify Static Code Analyzer to platforma do statycznego testowania bezpieczeństwa aplikacji klasy korporacyjnej, zaprojektowana w celu identyfikacji luk w zabezpieczeniach w dużych, regulowanych środowiskach oprogramowania. Jej głównym zadaniem w przedsiębiorstwach jest systematyczne wykrywanie wzorców kodowania, które stwarzają ryzyko dla bezpieczeństwa, szczególnie w organizacjach, w których zgodność, audytowalność i formalne procesy zarządzania ryzykiem wpływają na sposób zarządzania zmianami w oprogramowaniu. Fortify jest powszechnie stosowany w sektorach, w których zapewnienie bezpieczeństwa musi być możliwe do udowodnienia, powtarzalne i zgodne z ustalonymi mechanizmami kontroli w przedsiębiorstwie.

Zamiast kłaść nacisk na pętle sprzężenia zwrotnego skoncentrowane na deweloperach, Fortify jest często pozycjonowany jako scentralizowany system kontroli bezpieczeństwa w ramach szerszych ram zarządzania. Wspiera organizacje wymagające ujednoliconej klasyfikacji luk w zabezpieczeniach, spójnego raportowania i możliwości śledzenia w ramach dużych portfeli aplikacji opracowanych przez rozproszone lub zewnętrzne zespoły.

Silnik analizy statycznej zorientowany na bezpieczeństwo

Sercem narzędzia Fortify Static Code Analyzer jest skoncentrowany na bezpieczeństwie silnik analityczny, który analizuje kod źródłowy w celu identyfikacji luk w zabezpieczeniach bez uruchamiania aplikacji. Silnik stosuje kompleksowy zestaw reguł bezpieczeństwa, zaprojektowanych w celu wykrywania słabych punktów, takich jak luki w zabezpieczeniach, niebezpieczna obsługa danych, błędy uwierzytelniania i niewłaściwe użycie funkcji kryptograficznych. Wyniki są kategoryzowane według wagi i typu, co umożliwia zespołom ds. bezpieczeństwa ocenę ryzyka w sposób ustrukturyzowany i spójny.

Nacisk na poprawność zabezpieczeń odróżnia Fortify od uniwersalnych narzędzi do analizy statycznej. Głębokość analizy jest ukierunkowana na identyfikację zagrożeń podatnych na ataki, a nie na problemy z konserwacją czy architekturą. Ta specjalizacja sprawia, że Fortify jest szczególnie odpowiedni dla środowisk, w których wykrywanie luk w zabezpieczeniach jest priorytetem w stosunku do szerszego zrozumienia systemu.

Zgodność z programami zarządzania ryzykiem przedsiębiorstwa i zgodności

Rozwiązanie Fortify jest często integrowane z programami bezpieczeństwa i zarządzania przedsiębiorstwem, gdzie ryzyko związane z oprogramowaniem jest zarządzane równolegle z innymi ryzykami operacyjnymi i regulacyjnymi. Możliwości raportowania i generowania dowodów wspierają audyty wewnętrzne, oceny zewnętrzne i przeglądy regulacyjne. Wyniki można agregować w różnych aplikacjach i jednostkach biznesowych, zapewniając kierownictwu ds. bezpieczeństwa wgląd w poziom narażenia na ryzyko na dużą skalę.

To dostosowanie do formalnego Zarządzanie ryzykiem informatycznym Procesy sprawiają, że Fortify jest powszechnym wyborem w organizacjach, które muszą wykazać się ciągłą skutecznością kontroli. Raporty mogą służyć do prezentowania trendów podatności, postępów w pracach naprawczych i zgodności z wewnętrznymi zasadami bezpieczeństwa, wspierając podejmowanie uzasadnionych decyzji podczas audytów lub przeglądów incydentów.

Zakres językowy i charakterystyka wdrożenia

Fortify Static Code Analyzer obsługuje szeroką gamę języków programowania powszechnie spotykanych w środowiskach korporacyjnych, w tym zarówno nowoczesne stosy aplikacji, jak i wybrane starsze technologie. Pozwala to organizacjom na stosowanie spójnego podejścia do analizy bezpieczeństwa w różnych zespołach programistycznych i obszarach technologicznych. Modele wdrożenia są zróżnicowane, a Fortify jest często instalowany lokalnie lub w kontrolowanych środowiskach korporacyjnych, aby spełnić wymagania dotyczące rezydencji danych i bezpieczeństwa.

Analiza jest jednak zazwyczaj przeprowadzana na poziomie aplikacji lub projektu. Chociaż Fortify może skalować się w wielu aplikacjach, nie podejmuje próby określenia kolejności wykonywania, koordynacji wsadowej ani przepływów danych między aplikacjami. W rezultacie jego perspektywa ryzyka pozostaje ograniczona do artefaktów kodu, a nie do zachowania całego systemu.

Integracja z bezpiecznymi cyklami rozwoju

Rozwiązanie Fortify jest zazwyczaj zintegrowane z bezpiecznymi cyklami rozwoju oprogramowania jako mechanizm bramkujący, a nie narzędzie do ciągłej eksploracji. Skanowanie może być uruchamiane na określonych etapach, takich jak przeglądy przedpremierowe, okna wprowadzania istotnych zmian lub punkty kontrolne zgodności. Ten model operacyjny jest zgodny z potrzebami organizacji, które preferują kontrolowane procesy wydawania oprogramowania i formalne zatwierdzenia nad ciągłym wdrażaniem.

Chociaż dostępne są integracje z narzędziami CI/CD, wzorce użytkowania Fortify często odzwierciedlają równowagę między automatyzacją a scentralizowanym nadzorem. Wyniki dotyczące bezpieczeństwa są analizowane przez wyspecjalizowane zespoły, które oceniają wymagania dotyczące działań naprawczych i decyzje dotyczące akceptacji ryzyka, wzmacniając spójność zarządzania w całym przedsiębiorstwie.

Typowe przypadki użycia i ograniczenia w przedsiębiorstwach

Rozwiązanie Fortify Static Code Analyzer jest najskuteczniejsze w przedsiębiorstwach, w których zapewnienie bezpieczeństwa, gotowość do audytu i zgodność z przepisami są głównymi czynnikami napędzającymi. Zapewnia ono ustrukturyzowane, możliwe do obrony podejście do identyfikacji luk w zabezpieczeniach na poziomie kodu i wykazuje, że istnieją mechanizmy kontroli umożliwiające ich wykrywanie i eliminowanie.

Jego ograniczenia stają się widoczne w scenariuszach wymagających zrozumienia interakcji luk w zabezpieczeniach z zachowaniem wykonania, przetwarzaniem wsadowym lub zależnościami międzyplatformowymi. Fortify nie modeluje zachowania w czasie wykonywania ani wpływu na cały system i często jest uzupełniany narzędziami, które zapewniają głębszy wgląd w strukturę aplikacji, łańcuchy zależności i ryzyko modernizacji w środowiskach heterogenicznych.

Najważniejsze momenty obsady

CAST Highlight to platforma do analizy aplikacji i oceny portfela w przedsiębiorstwach, zaprojektowana w celu zapewnienia wysokiego poziomu wglądu w jakość oprogramowania, ryzyko i gotowość do modernizacji w dużych zbiorach aplikacji. Jej główną rolą w środowiskach korporacyjnych jest wspieranie strategicznego podejmowania decyzji poprzez podsumowanie cech strukturalnych, wskaźników zadłużenia technicznego i sygnałów przydatności w chmurze, zamiast przeprowadzania dogłębnej analizy kodu zorientowanej na wykonanie. CAST Highlight jest często wdrażany na wczesnym etapie programów modernizacji, aby uzyskać podstawową wiedzę na temat kondycji portfela.

W przeciwieństwie do narzędzi do analizy statycznej zorientowanych na deweloperów, CAST Highlight działa na poziomie zagregowanym. Ma on pomóc architektom, menedżerom portfeli i liderom transformacji w porównywaniu aplikacji, identyfikowaniu kandydatów do modernizacji i ustalaniu priorytetów działań naprawczych w setkach, a nawet tysiącach systemów.

Analiza na poziomie portfela i inteligencja oprogramowania

Sercem CAST Highlight jest lekki silnik analityczny, który wyodrębnia metadane strukturalne z kodu źródłowego aplikacji i artefaktów konfiguracyjnych. Dane te są normalizowane do wspólnego modelu analitycznego, który umożliwia ocenę różnorodnych aplikacji według spójnych kryteriów. Metryki dotyczące jakości kodu, łatwości utrzymania, narażenia na zagrożenia i sprawności architektury są obliczane i prezentowane za pomocą pulpitów nawigacyjnych i widoków porównawczych.

Możliwości te są zgodne z szerszym inteligencja oprogramowania Inicjatywy, których celem jest przekształcenie surowych artefaktów kodu w gotową do podjęcia decyzji wiedzę dla interesariuszy spoza grona programistów. Abstrahując złożoność i przekształcając ją w standardowe wskaźniki, CAST Highlight umożliwia zespołom kierowniczym analizowanie dużych portfeli bez konieczności przeprowadzania szczegółowej inspekcji kodu.

Ocena gotowości do modernizacji i przydatności w chmurze

CAST Highlight kładzie szczególny nacisk na ocenę aplikacji pod kątem modernizacji i gotowości do migracji do chmury. Ocenia takie czynniki, jak wykorzystanie infrastruktury, wzorce zależności i aktualność technologii, aby oszacować nakład pracy i ryzyko związane z przenoszeniem aplikacji na nowoczesne platformy. Wyniki są często wykorzystywane do grupowania aplikacji w kategorie, takie jak rehostowanie, refaktoryzacja, wymiana lub wycofanie.

To podejście oparte na ocenie wspiera wczesne planowanie i budżetowanie. Przedsiębiorstwa mogą wykorzystywać wyniki CAST Highlight do tworzenia planów modernizacji, szacowania zakresu transformacji i komunikowania profili ryzyka interesariuszom biznesowym. Analiza ma jednak celowo szeroki zakres i nie podejmuje próby modelowania szczegółowych zachowań wykonawczych ani skutków ubocznych transformacji.

Wskaźniki bezpieczeństwa i długu technicznego

Oprócz sygnałów modernizacji, CAST Highlight dostarcza wskaźników wysokiego poziomu związanych ze słabościami bezpieczeństwa i długiem technicznym. Wskaźniki te są oparte na znanych wzorcach związanych ze zwiększonymi kosztami utrzymania lub zwiększonym narażeniem na luki w zabezpieczeniach. Celem nie jest zastąpienie specjalistycznych narzędzi do skanowania bezpieczeństwa, lecz wskazanie obszarów, w których może być konieczne dokładniejsze zbadanie.

Ponieważ wyniki są agregowane, najlepiej nadają się do analizy porównawczej, a nie do planowania działań naprawczych. Wskaźniki bezpieczeństwa i zadłużenia pomagają organizacjom zrozumieć względny rozkład ryzyka w portfelach, ale nie identyfikują konkretnych ścieżek realizacji, przepływów danych ani zależności operacyjnych, na które mogłyby mieć wpływ zmiany w kodzie.

Skalowalność i model operacyjny

Rozwiązanie CAST Highlight zostało zaprojektowane z myślą o efektywnym skalowaniu w bardzo dużych portfelach aplikacji. Jego lekkie podejście analityczne minimalizuje obciążenie obliczeniowe i umożliwia szybkie wdrażanie nowych aplikacji. Dzięki temu jest ono szczególnie przydatne dla przedsiębiorstw przeprowadzających szeroko zakrojone badania środowiska programistycznego podczas fuzji, sprzedaży aktywów lub wczesnych etapów modernizacji.

Kompromisem w tej skalowalności jest głębokość analizy. CAST Highlight nie analizuje grafów wywołań, łańcuchów wykonywania wsadowego ani propagacji danych między platformami. W rezultacie jest często używany w połączeniu z narzędziami do głębszej analizy, gdy konkretne aplikacje lub inicjatywy transformacyjne przechodzą z etapu planowania do etapu realizacji.

Typowe przypadki użycia i ograniczenia w przedsiębiorstwach

Rozwiązanie CAST Highlight jest najskuteczniejsze w przedsiębiorstwach, które potrzebują kompleksowego, porównawczego wglądu w portfolio aplikacji, aby wspierać planowanie strategiczne. Doskonale identyfikuje potencjalne obszary modernizacji, szacuje złożoność transformacji i komunikuje ryzyko techniczne interesariuszom nieposiadającym wiedzy technicznej.

Jego ograniczenia stają się widoczne, gdy organizacje potrzebują precyzyjnego zrozumienia, jak zmiany wpływają na zachowanie wykonania, łańcuchy zależności lub stabilność operacyjną. CAST Highlight nie zapewnia wglądu na poziomie wykonania niezbędnego do bezpiecznego wdrożenia działań refaktoryzacyjnych lub modernizacyjnych i zazwyczaj jest uzupełniany narzędziami koncentrującymi się na szczegółowej analizie wpływu i widoczności zachowań w wybranych aplikacjach.

Obrazowanie CAST

CAST Imaging to platforma do analizy aplikacji korporacyjnych, koncentrująca się na analizie architektonicznej i wizualizacji zależności strukturalnych w złożonych systemach oprogramowania. Jej główną rolą w dużych organizacjach jest ujawnianie sposobu kompilacji aplikacji, interakcji komponentów oraz miejsc, w których sprzężenie strukturalne wprowadza ryzyko. CAST Imaging jest zazwyczaj wykorzystywane przez architektów i zespoły modernizacyjne, które potrzebują zrozumienia struktury aplikacji na poziomie systemowym przed planowaniem refaktoryzacji, migracji lub dekompozycji.

Zamiast działać jako narzędzie do inspekcji kodu lub skanowania bezpieczeństwa, CAST Imaging kładzie nacisk na zrozumienie architektury. Przekształca kod źródłowy i artefakty konfiguracji w łatwe do nawigacji modele, które ilustrują relacje między komponentami, warstwami i technologiami, umożliwiając interesariuszom wnioskowanie o złożoności na dużą skalę.

Mapowanie architektoniczne i wizualizacja zależności

Podstawą CAST Imaging jest możliwość generowania szczegółowych reprezentacji architektonicznych aplikacji i portfeli aplikacji. Reprezentacje te obejmują diagramy komponentów, mapy interakcji i widoki warstwowe, które pokazują, jak moduły komunikują się ze sobą i jak są od siebie zależne. Dzięki wizualizacji relacji strukturalnych, CAST Imaging umożliwia zespołom identyfikację ścisłych powiązań, zależności cyklicznych i naruszeń architektury, które są trudne do wykrycia poprzez analizę na poziomie plików.

Te modele wizualne są ściśle powiązane z praktykami skupionymi na wykresy zależności, gdzie zrozumienie strukturalnych powiązań jest niezbędne do zarządzania ryzykiem w dużych systemach. CAST Imaging pozwala użytkownikom na interaktywne przeglądanie zależności, przechodząc od widoków architektonicznych wysokiego poziomu do bardziej szczegółowych reprezentacji, w zależności od potrzeb.

Obsługa wielu technologii i aplikacji

CAST Imaging obsługuje analizę w szerokiej gamie języków programowania, frameworków i platform powszechnie spotykanych w środowiskach korporacyjnych. Ta wszechstronność pozwala na modelowanie heterogenicznych systemów składających się ze starszych komponentów, usług rozproszonych i współdzielonych baz danych. Możliwości analizy międzyaplikacyjnej pozwalają zespołom zrozumieć, jak poszczególne systemy wpisują się w większe portfolio i jak zmiany w jednej aplikacji mogą wpływać na inne.

Analiza ma jednak charakter strukturalny, a nie behawioralny. CAST Imaging modeluje statyczne relacje między komponentami, ale nie symuluje kolejności wykonywania, warunków środowiska wykonawczego ani logiki harmonogramowania wsadowego. W rezultacie zapewnia przejrzystość połączeń między systemami, ale niekoniecznie ich zachowania podczas wykonywania.

Wsparcie modernizacji i zarządzania architekturą

Obrazowanie CAST jest często wykorzystywane do wspierania inicjatyw modernizacyjnych, w których przejrzystość architektury jest warunkiem koniecznym do wprowadzenia zmian. Ujawniając naruszenia zasad architektonicznych i identyfikując obszary nadmiernego sprzężenia, pomaga zespołom planować strategie stopniowej transformacji. Te spostrzeżenia mogą pomóc w podejmowaniu decyzji dotyczących ekstrakcji usług, przeprojektowania interfejsu lub podejścia do migracji etapowej.

W kontekście zarządzania, CAST Imaging może być również wykorzystywane do oceny zgodności architektury z określonymi standardami. Odchylenia od architektur docelowych można identyfikować i dokumentować, co wspomaga nadzór i planowanie działań naprawczych. To sprawia, że jest to cenne narzędzie w organizacjach, które wdrażają kontrole architektoniczne w ramach procesów zarządzania zmianą.

Skalowalność i rozważania dotyczące modelowania portfela

Platforma została zaprojektowana z myślą o skalowaniu w dużych aplikacjach i portfolio, generując modele architektoniczne, którymi można współdzielić się między interesariuszami. Jej podejście skoncentrowane na wizualizacji wspiera wspólną analizę i komunikację, szczególnie podczas objaśniania złożonych struktur odbiorcom spoza branży programistycznej.

Wadą tej skalowalności jest ograniczony wgląd w dynamikę operacyjną. Obrazowanie CAST nie pozwala na ustalenie pochodzenia danych na poziomie terenowym, śledzenie przepływów wykonywania wsadowego ani ilościową ocenę wpływu zmian na środowisko wykonawcze. W przypadku inicjatyw wymagających precyzyjnego określenia zakresu wpływu zmian lub walidacji zachowania wykonania, zazwyczaj wymagane są dodatkowe narzędzia analityczne.

Typowe przypadki użycia i ograniczenia w przedsiębiorstwach

Obrazowanie CAST jest najskuteczniejsze w przedsiębiorstwach, które muszą zrozumieć i zracjonalizować architekturę aplikacji przed wprowadzeniem znaczących zmian. Doskonale wykrywa złożoność strukturalną, kieruje refaktoryzacją architektury i wspiera planowanie modernizacji w systemach heterogenicznych.

Jego ograniczenia stają się oczywiste, gdy organizacje potrzebują wglądu na poziomie wykonania, oceny wpływu lub walidacji sposobu propagacji zmian w czasie wykonywania. CAST Imaging dostarcza mapę strukturalną, a nie plan operacyjny, i często jest uzupełniane narzędziami oferującymi głębszą analizę ścieżek wykonania, przepływu danych i zachowania systemu.

Analiza statyczna Veracode

Veracode Static Analysis to chmurowa, statyczna platforma do testowania bezpieczeństwa aplikacji, zaprojektowana z myślą o wbudowywaniu mechanizmów kontroli bezpieczeństwa bezpośrednio w nowoczesne procesy dostarczania oprogramowania. Jej główną rolą w środowiskach korporacyjnych jest wczesna i ciągła identyfikacja luk w zabezpieczeniach w dużych wolumenach kodu aplikacji, szczególnie w organizacjach, które priorytetowo traktują szybkie cykle publikacji, rozproszone zespoły programistyczne i scentralizowany nadzór nad bezpieczeństwem. Veracode jest powszechnie stosowany tam, gdzie zapewnienie bezpieczeństwa musi być skalowalne bez zakłócania tempa rozwoju oprogramowania.

Platforma kładzie nacisk na automatyzację i spójność, pozycjonując analizę statyczną jako stałą kontrolę bezpieczeństwa, a nie okresowy przegląd. Ten model operacyjny jest zgodny z potrzebami przedsiębiorstw, które wprowadziły standaryzację w zakresie narzędzi programistycznych w chmurze i wymagają scentralizowanego wglądu w stan bezpieczeństwa aplikacji w różnych zespołach i projektach.

Testowanie bezpieczeństwa aplikacji statycznych w chmurze

Sercem Veracode Static Analysis jest statyczny silnik skanujący bezpieczeństwo, dostarczany w całości jako zarządzana usługa w chmurze. Kod źródłowy i pliki binarne są przesyłane do analizy, gdzie są sprawdzane pod kątem luk w zabezpieczeniach, takich jak błędy wstrzyknięcia, niebezpieczna obsługa danych i słabe punkty uwierzytelniania. Analiza nie wymaga dostępu do środowisk produkcyjnych, co pozwala na przeprowadzanie oceny bezpieczeństwa na wczesnym etapie cyklu życia, bez ryzyka operacyjnego.

To chmurowe podejście umożliwia szybkie wdrażanie i elastyczne skalowanie w dużych portfelach. Przedsiębiorstwa mogą stosować spójne zasady skanowania bezpieczeństwa w setkach aplikacji bez konieczności utrzymywania infrastruktury lokalnej. Wyniki są normalizowane i prezentowane za pośrednictwem scentralizowanych pulpitów nawigacyjnych, co wspiera zespoły ds. bezpieczeństwa odpowiedzialne za nadzór nad ryzykiem w całym przedsiębiorstwie.

Integracja z ciągłymi kanałami dostarczania

Veracode został zaprojektowany z myślą o ścisłej integracji z procesami CI/CD oraz narzędziami programistycznymi. Skanowanie może być uruchamiane automatycznie na etapie kompilacji lub wydania, a wyniki są zwracane w formatach integrujących się z procesami śledzenia błędów i ich usuwania. Wspiera to model bezpieczeństwa „shift-left”, w którym luki w zabezpieczeniach są usuwane bliżej momentu ich wystąpienia.

W praktyce rola Veracode w ramach procesów jest często koordynowana z szerszymi kontrolami jakości i testowania, obejmującymi takie działania, jak: testy regresji wydajności, aby zapewnić, że egzekwowanie bezpieczeństwa nie będzie odbywać się w oderwaniu od innych wymagań niefunkcjonalnych. Takie dopasowanie pomaga organizacjom zrównoważyć rygor bezpieczeństwa z wydajnością dostaw.

Zakres językowy i spójność portfolio

Veracode Static Analysis obsługuje szeroką gamę nowoczesnych języków programowania i frameworków powszechnie używanych w tworzeniu aplikacji korporacyjnych. Ta wszechstronność pozwala zespołom ds. bezpieczeństwa stosować jednolite zasady skanowania w heterogenicznych stosach programistycznych, redukując luki, które mogłyby powstać między zespołami lub platformami.

Platforma nadal koncentruje się na skanowaniu bezpieczeństwa na poziomie aplikacji. Analiza jest zazwyczaj ograniczona do pojedynczych aplikacji lub usług, a relacje między aplikacjami, przepływami pracy wsadowej czy współdzielonymi strukturami danych nie są modelowane. W rezultacie Veracode zapewnia solidne pokrycie luk w zabezpieczeniach na poziomie kodu, ale ograniczony wgląd w to, jak te luki mogą się rozprzestrzeniać w połączonych systemach.

Raportowanie ryzyka i widoczność zarządzania

Veracode oferuje funkcje raportowania, które pozwalają liderom ds. bezpieczeństwa śledzić trendy w zakresie luk w zabezpieczeniach, postęp prac naprawczych i zgodność z polityką bezpieczeństwa w całym przedsiębiorstwie. Pulpity nawigacyjne obsługują widok ekspozycji na ryzyko na poziomie portfela, umożliwiając priorytetyzację w oparciu o wagę i wpływ na działalność firmy. Raporty te są często wykorzystywane do wspierania wewnętrznego zarządzania bezpieczeństwem, sprawozdawczości dla kadry kierowniczej oraz działań zewnętrznych podmiotów zapewniających bezpieczeństwo.

Chociaż te możliwości wspierają rozliczalność i nadzór, raportowanie koncentruje się na lukach w zabezpieczeniach. Veracode nie podejmuje próby ilościowego określenia wpływu operacyjnego, zakłóceń w przepływie wykonywania zadań ani ryzyka modernizacji związanego z działaniami naprawczymi. To rozróżnienie jest istotne w środowiskach, w których zmiany w zakresie bezpieczeństwa muszą być oceniane równolegle ze stabilnością i kwestiami zarządzania zmianą.

Typowe przypadki użycia i ograniczenia w przedsiębiorstwach

Analiza statyczna Veracode jest najskuteczniejsza w przedsiębiorstwach, które działają z dużą szybkością i wymagają skalowalnego, scentralizowanego skanowania bezpieczeństwa w nowoczesnych stosach aplikacji. Doskonale sprawdza się w egzekwowaniu spójnych standardów bezpieczeństwa, skracaniu czasu wykrywania luk w zabezpieczeniach i obsłudze modeli operacyjnych DevSecOps.

Jego ograniczenia stają się widoczne w scenariuszach wymagających dogłębnego zrozumienia zachowania systemu, zależności międzyaplikacyjnych lub starszego przetwarzania wsadowego. Veracode nie zapewnia wglądu na poziomie wykonania ani mapowania zależności architektonicznych i jest zazwyczaj pozycjonowany jako specjalistyczna warstwa bezpieczeństwa, uzupełniona narzędziami koncentrującymi się na analizie wpływu, widoczności zależności i zrozumieniu systemu w skali przedsiębiorstwa.

Coverity (Synopsys)

Coverity to platforma do statycznej analizy kodu dla przedsiębiorstw, znana ze swojej zdolności do wykrywania złożonych defektów w dużych, krytycznych pod względem wydajności bazach kodu. Jej główną rolą w środowiskach korporacyjnych jest identyfikacja głębokich problemów z poprawnością i niezawodnością, które trudno wykryć wyłącznie za pomocą testów, szczególnie w systemach, w których awaria niesie ze sobą poważne konsekwencje operacyjne, finansowe lub związane z bezpieczeństwem. Platforma Coverity jest często wykorzystywana w branżach takich jak motoryzacja, lotnictwo, telekomunikacja i oprogramowanie infrastrukturalne, gdzie precyzja wykrywania defektów i niski wskaźnik fałszywie dodatnich wyników są kluczowe.

W przeciwieństwie do platform do analizy na poziomie portfela, Coverity koncentruje się na poprawności kodu na poziomie rozległych baz kodu. Został zaprojektowany z myślą o wydajnej analizie dużych ilości kodu źródłowego przy jednoczesnym zachowaniu wysokiego poziomu rygoru analitycznego, co czyni go odpowiednim dla organizacji zarządzających systemami o długim okresie eksploatacji i rygorystycznych wymaganiach dotyczących niezawodności.

Głębokie wykrywanie defektów i precyzyjna analiza

Sercem Coverity jest statyczny silnik analityczny zoptymalizowany pod kątem wykrywania defektów, takich jak uszkodzenia pamięci, wycieki zasobów, problemy ze współbieżnością i błędy logiczne. Silnik ten znany jest ze swojej zdolności do analizowania złożonych ścieżek sterowania i scenariuszy wykonania obejmujących wiele funkcji i modułów. Ta głębia analizy pozwala mu identyfikować defekty, które mogą ujawnić się tylko w określonych warunkach środowiska uruchomieniowego.

Analityczne podejście Coverity obejmuje zaawansowane techniki związane z symboliczne wykonanie, umożliwiając eksplorację wielu ścieżek wykonania bez konieczności uruchamiania kodu. Ta możliwość przyczynia się do reputacji narzędzia jako narzędzia o wysokiej dokładności i pomaga zredukować szum często towarzyszący analizie statycznej na dużą skalę w środowiskach korporacyjnych.

Koncentracja na języku i ukierunkowany zasięg

Coverity zapewnia solidne wsparcie dla języków powszechnie używanych w oprogramowaniu systemowym i wrażliwym na wydajność, w tym C, C++ i Java. To ukierunkowanie czyni je szczególnie skutecznym w analizie kluczowych komponentów infrastruktury, systemów wbudowanych i usług zaplecza, gdzie defekty niskiego poziomu mogą mieć nieproporcjonalnie duży wpływ.

Chociaż platforma może skalować się w dużych bazach kodu, jej zakres języków jest węższy niż w przypadku niektórych uniwersalnych narzędzi do analizy statycznej. Jest mniej zorientowana na heterogeniczne środowiska korporacyjne, które obejmują języki przetwarzania wsadowego, środowiska skryptowe lub technologie specyficzne dla komputerów mainframe. W rezultacie Coverity jest często wdrażany selektywnie w ramach portfolio, koncentrując się na komponentach, w których precyzja wykrywania defektów jest najbardziej krytyczna.

Integracja z przepływami pracy w zakresie rozwoju przedsiębiorstwa

Platforma Coverity została zaprojektowana z myślą o integracji z procesami rozwoju przedsiębiorstwa, w tym procesami CI/CD oraz scentralizowanymi systemami zarządzania defektami. Skanowanie może być planowane lub uruchamiane automatycznie, a wyniki są przekazywane zespołom programistycznym w celu ich naprawy. Platforma obsługuje analizę przyrostową, pozwalając zespołom skupić się na nowo pojawiających się problemach, zachowując jednocześnie wgląd w istniejące zaległości w zakresie defektów.

W wielu organizacjach Coverity jest pozycjonowany jako narzędzie kontroli jakości, a nie narzędzie do ciągłej eksploracji. Jego skanowanie jest często przeprowadzane w określonych punktach kontrolnych, na przykład przed premierami lub podczas formalnych przeglądów jakości. Ten sposób wykorzystania odzwierciedla jego rolę w egzekwowaniu standardów niezawodności, a nie wspieraniu szybkich iteracji.

Skalowalność i charakterystyka wydajności

Rozwiązanie Coverity zostało zaprojektowane z myślą o wydajnej obsłudze bardzo dużych baz kodu, co czyni je idealnym rozwiązaniem dla przedsiębiorstw z milionami linii kodu o znaczeniu krytycznym. Jego wydajność skaluje się wraz z dostępną infrastrukturą, umożliwiając organizacjom analizowanie rozbudowanych systemów bez konieczności czasochłonnej analizy. Scentralizowane pulpity nawigacyjne zapewniają wgląd w trendy dotyczące defektów i postęp prac naprawczych w ramach projektów.

Skalowalność Coverity koncentruje się jednak na ilości kodu, a nie na złożoności systemu. Nie próbuje on modelować zależności między aplikacjami, kolejności wykonywania zadań wsadowych ani pochodzenia danych na różnych platformach. Jego analizy nadal koncentrują się na wykrywaniu defektów w poszczególnych bazach kodu, a nie na zachowaniu całego systemu.

Typowe przypadki użycia i ograniczenia w przedsiębiorstwach

Coverity jest najskuteczniejszy w przedsiębiorstwach, które wymagają niezawodnego wykrywania defektów w krytycznych komponentach oprogramowania. Doskonale identyfikuje subtelne problemy, które mogą prowadzić do awarii, luk w zabezpieczeniach lub nieprzewidywalnego zachowania w środowisku produkcyjnym, szczególnie w kodzie niskopoziomowym lub wrażliwym na wydajność.

Jego ograniczenia stają się widoczne w inicjatywach modernizacji lub transformacji, które wymagają zrozumienia, jak zmiany wpływają na połączone systemy. Coverity nie zapewnia mapowania zależności architektonicznych ani analizy wpływu na poziomie wykonania i zazwyczaj jest uzupełniane narzędziami koncentrującymi się na widoczności portfela, analizie zależności i analizie zachowań w heterogenicznych środowiskach korporacyjnych.

Testy C/C++ i DTP Parasoft C/C++

Parasoft C/C++test i powiązana z nim platforma testowania programistycznego (DTP) tworzą rozwiązanie klasy korporacyjnej do analizy statycznej i testowania zgodności, dostosowane do środowisk oprogramowania o krytycznym znaczeniu dla bezpieczeństwa i podlegających ścisłym regulacjom. Jego główną rolą w dużych organizacjach jest wspieranie rygorystycznej weryfikacji kodu na poziomie systemowym, gdzie defekty mogą prowadzić do awarii operacyjnych, niezgodności z przepisami lub incydentów bezpieczeństwa. Parasoft jest powszechnie stosowany w branżach takich jak lotnictwo, motoryzacja, obronność i systemy przemysłowe, gdzie działanie oprogramowania musi być weryfikowalne i podlegać audytowi.

W przeciwieństwie do uniwersalnych narzędzi do analizy statycznej, Parasoft kładzie nacisk na zgodność ze zdefiniowanymi standardami i celami weryfikacji. Platforma została zaprojektowana z myślą o środowiskach, w których rozwój oprogramowania jest regulowany przez formalne procesy, wymagania certyfikacyjne i udokumentowane przypadki zapewnienia jakości, a nie przez szybką iterację.

Analiza statyczna oparta na standardach i egzekwowanie zgodności

Sercem Parasoft C/C++test jest statyczny silnik analizy, zgodny z branżowymi standardami bezpieczeństwa i kodowania, takimi jak MISRA, CERT i wytyczne ISO. Silnik analizuje kod źródłowy pod kątem ścisłych zestawów reguł, które definiują dopuszczalne konstrukcje, wzorce użycia i warunki błędów. Naruszenia są kategoryzowane według wagi i bezpośrednio odwzorowywane na wymagania zgodności, umożliwiając organizacjom wykazanie przestrzegania obowiązkowych praktyk programistycznych.

To podejście oparte na standardach jest zgodne ze środowiskami, które polegają na weryfikacja formalna Koncepcje, w których poprawność jest definiowana nie tylko przez zachowanie funkcjonalne, ale także przez zgodność z ustalonymi zasadami. Wyniki analiz Parasoft mogą być wykorzystywane jako dowody w procesach certyfikacji i audytu, redukując nakład pracy związany z ręczną weryfikacją.

Skoncentrowane wsparcie językowe i ukierunkowana głębokość analizy

Parasoft C/C++test jest zoptymalizowany specjalnie pod kątem baz kodu C i C++, zapewniając dogłębną analizę języków powszechnie używanych w oprogramowaniu wbudowanym i systemowym. Ta specjalizacja pozwala platformie identyfikować problemy niskiego poziomu, takie jak niewłaściwe wykorzystanie pamięci, błędy wskaźników i defekty współbieżności, które mogą być szczególnie niebezpieczne w kontekstach krytycznych dla bezpieczeństwa.

Choć ta głębia jest cenna w obrębie docelowej domeny, ogranicza ona również możliwości zastosowania platformy w szerszym zakresie przedsiębiorstw. Parasoft nie dąży do zapewnienia szerokiego pokrycia w różnych językach, środowiskach przetwarzania wsadowego ani starszych systemach mainframe. W rezultacie jest ona zazwyczaj wdrażana w docelowych segmentach portfolio przedsiębiorstwa, a nie jako uniwersalne rozwiązanie analityczne.

Integracja z regulowanymi cyklami rozwoju

Rozwiązanie Parasoft zostało zaprojektowane z myślą o integracji ze strukturalnymi cyklami rozwoju, które kładą nacisk na identyfikowalność, dokumentację i kontrolowane zmiany. Wyniki analizy statycznej można powiązać z wymaganiami, przypadkami testowymi i systemami śledzenia defektów za pośrednictwem komponentu DTP, co umożliwia kompleksowe identyfikowalność od specyfikacji do weryfikacji.

Ta integracja obsługuje modele rozwoju, w których zmiany są wprowadzane celowo i formalnie weryfikowane. Analiza jest często przeprowadzana w określonych punktach kontrolnych, na przykład przed złożeniem wniosku o certyfikację lub wydaniem wersji głównej, a nie w sposób ciągły przy każdym zatwierdzeniu. Ten model operacyjny odzwierciedla priorytety środowisk regulowanych, w których przewidywalność i pewność są ważniejsze niż szybkość.

Raportowanie, śledzenie i gotowość do audytu

Platforma Testów Rozwojowych (Development Testing Platform) zapewnia scentralizowane raportowanie i analitykę dla projektów i zespołów. Metryki dotyczące statusu zgodności, trendów defektów i zakresu weryfikacji mogą być agregowane i przeglądane przez interesariuszy ds. zapewnienia jakości i zgodności. Raporty są ustrukturyzowane w celu wspierania działań audytowych i certyfikacyjnych, dostarczając udokumentowane dowody wykonania analiz i ich wyników.

Raporty te koncentrują się jednak na zgodności na poziomie kodu, a nie na zachowaniu całego systemu. Parasoft nie modeluje ścieżek wykonywania w aplikacjach, nie koordynuje zadań wsadowych ani nie tworzy zależności między platformami. Jego identyfikowalność koncentruje się na wymaganiach i standardach, a nie na interakcji między komponentami w czasie wykonywania.

Typowe przypadki użycia i ograniczenia w przedsiębiorstwach

Testy C/C++ i DTP firmy Parasoft sprawdzają się najlepiej w przedsiębiorstwach, w których bezpieczeństwo, niezawodność i zgodność z przepisami odgrywają kluczową rolę. Zapewniają one zdyscyplinowane ramy weryfikacji zgodności krytycznego kodu z rygorystycznymi standardami i pozwalają na pomyślne przejście formalnej kontroli.

Ich ograniczenia stają się widoczne w środowiskach wymagających holistycznego zrozumienia dużych, połączonych systemów lub obsługi heterogenicznych stosów technologicznych. Parasoft nie został zaprojektowany z myślą o zapewnieniu widoczności na poziomie portfolio ani analizie wpływu zorientowanej na realizację, a często jest uzupełniany narzędziami koncentrującymi się na zależnościach architektonicznych, ryzyku modernizacji i zachowaniu systemów w złożonych środowiskach korporacyjnych.

Klocwork

Klocwork to platforma do statycznej analizy kodu dla przedsiębiorstw, koncentrująca się na identyfikacji defektów związanych z bezpieczeństwem, niezawodnością i współbieżnością w dużych, złożonych bazach kodu. Jej główną rolą w środowiskach korporacyjnych jest wykrywanie problemów, które mogą zagrozić stabilności lub bezpieczeństwu systemu, szczególnie w oprogramowaniu działającym pod dużym obciążeniem, w trybie równoległym lub w warunkach ograniczonego czasu wykonania. Klocwork jest powszechnie stosowany w branżach, w których wydajność i poprawność są ściśle powiązane, takich jak telekomunikacja, systemy wbudowane, infrastruktura finansowa i usługi zaplecza na dużą skalę.

Platforma kładzie nacisk na wczesne wykrywanie defektów poprzez analizę statyczną, umożliwiając organizacjom identyfikację problematycznych wzorców, zanim ujawnią się one jako awarie w czasie wykonywania. Klocwork jest zazwyczaj pozycjonowany jako narzędzie do zapewniania jakości i bezpieczeństwa, a nie jako rozwiązanie analityczne obejmujące cały portfel oprogramowania.

Analiza statyczna zorientowana na współbieżność i niezawodność

Sercem Klocwork jest statyczny silnik analityczny zaprojektowany do identyfikacji defektów wynikających ze złożonych scenariuszy wykonania. Obejmuje to problemy związane z zarządzaniem pamięcią, obsługą zasobów i synchronizacją. Silnik jest szczególnie skuteczny w wykrywaniu defektów związanych z wykonywaniem równoległym, gdzie subtelne interakcje między wątkami mogą prowadzić do nieprzewidywalnego zachowania.

Zdolność Klocwork do wnioskowania o współbieżnych ścieżkach kodu sprawia, że jest on przydatny w środowiskach, w których oprogramowanie musi działać niezawodnie pod obciążeniem. Wyniki analizy często zawierają ustalenia dotyczące blokad, wyścigów i nieprawidłowych konstrukcji synchronizacji. Te możliwości wspierają organizacje dążące do ograniczenia niestabilności spowodowanej trudnymi do odtworzenia defektami współbieżności, takimi jak: warunki wyścigu.

Skupienie na języku i domeny wrażliwe na wydajność

Klocwork zapewnia solidne wsparcie dla języków powszechnie używanych w oprogramowaniu systemowym i krytycznym pod względem wydajności, w tym C, C++ i Java. To ukierunkowanie jest zgodne z jego zastosowaniem w dziedzinach, w których poprawność niskopoziomowa i wydajność w czasie wykonywania mają kluczowe znaczenie. Koncentrując się na węższym zestawie języków, platforma zapewnia głębszą analizę tych środowisk w porównaniu z szerszymi, bardziej uogólnionymi narzędziami.

Specjalizacja ta ogranicza jednak jej zastosowanie w heterogenicznych środowiskach korporacyjnych. Klocwork nie został zaprojektowany do analizy obciążeń wsadowych, języków programowania mainframe ani środowisk skryptowych wysokiego poziomu, które są powszechne w długowiecznych systemach korporacyjnych. W rezultacie jest często wdrażany selektywnie, a nie jako uniwersalne rozwiązanie analityczne.

Integracja z procesami jakości i bezpieczeństwa przedsiębiorstwa

Klocwork integruje się z procesami rozwoju przedsiębiorstwa, w tym z procesami CI/CD i systemami śledzenia defektów. Skanowanie może być zautomatyzowane, a wyniki przekazywane zespołom programistycznym w celu ich naprawy. Platforma obsługuje analizę przyrostową, pozwalając zespołom skupić się na nowo pojawiających się problemach, zachowując jednocześnie wgląd w istniejące defekty.

W wielu organizacjach Klocwork jest wykorzystywany w ramach formalnych procesów zapewniania jakości. Analiza może być uruchamiana na kluczowych etapach, takich jak walidacja przed wydaniem lub gruntowne prace refaktoryzacyjne. Ten sposób wykorzystania odzwierciedla jego rolę w zapewnianiu niezawodności i bezpieczeństwa, a nie wspieraniu ciągłej eksploracji architektury.

Charakterystyka skalowalności i zakres operacyjny

Klocwork został zaprojektowany z myślą o skalowaniu w dużych bazach kodu, umożliwiając analizę rozległych systemów bez nadmiernego obciążenia wydajnościowego. Scentralizowane pulpity nawigacyjne zapewniają wgląd w trendy defektów i postęp prac naprawczych w różnych projektach. Widoki te wspomagają nadzór kierownictwa i pomagają zespołom w ustalaniu priorytetów działań naprawczych w oparciu o ich wagę i wpływ.

Pomimo skalowalności pod względem objętości kodu, zakres analityczny Klocwork pozostaje ograniczony do poszczególnych aplikacji lub komponentów. Nie modeluje zależności między aplikacjami, kolejności wykonywania zadań wsadowych ani pochodzenia danych na różnych platformach. Jego analizy koncentrują się na poprawności kodu, a nie na zachowaniu całego systemu.

Typowe przypadki użycia i ograniczenia w przedsiębiorstwach

Klocwork jest najskuteczniejszy w przedsiębiorstwach, które wymagają niezawodnego wykrywania defektów współbieżności i niezawodności w oprogramowaniu wrażliwym na wydajność. Doskonale radzi sobie z wykrywaniem problemów trudnych do odtworzenia w testach, które mogą powodować sporadyczne lub katastrofalne awarie w środowiskach produkcyjnych.

Jego ograniczenia stają się widoczne w inicjatywach transformacyjnych, które wymagają holistycznego zrozumienia portfeli aplikacji, przepływów wykonania lub wpływu modernizacji. Klocwork nie oferuje mapowania zależności architektonicznych ani analizy wpływu na poziomie wykonania i zazwyczaj jest uzupełniany narzędziami koncentrującymi się na szerszym zrozumieniu systemu i ocenie ryzyka zmian w heterogenicznych środowiskach korporacyjnych.

Analiza statyczna w chmurze OpenText DevOps

OpenText DevOps Cloud Static Analysis to narzędzie do analizy statycznej dla przedsiębiorstw, oferowane w ramach szerszego pakietu DevOps i zarządzania cyklem życia aplikacji. Jego główną rolą w dużych organizacjach jest zapewnienie ujednoliconych kontroli jakości kodu i bezpieczeństwa, zgodnych z ustalonymi modelami zarządzania dostarczaniem. Zamiast działać jako samodzielna platforma do głębokiej analizy, jest zazwyczaj wybierane przez przedsiębiorstwa, które priorytetowo traktują konsolidację łańcucha narzędzi i scentralizowany nadzór nad procesami rozwoju, testowania i wydawania oprogramowania.

Platforma jest najczęściej wykorzystywana w środowiskach, w których dostarczanie oprogramowania musi być zgodne z formalnymi procedurami kontroli, a integracja z istniejącymi narzędziami ALM, testowania i zarządzania wydaniami jest kluczowym wymogiem. Jej wartość tkwi w spójności i zgodności z zasadami zarządzania, a nie w dogłębnej analizie behawioralnej czy architektonicznej.

Możliwości analizy statycznej zorientowanej na pakiet

W swojej istocie, OpenText DevOps Cloud Static Analysis zapewnia opartą na regułach inspekcję kodu źródłowego w celu identyfikacji problemów z jakością i luk w zabezpieczeniach. Analiza koncentruje się na typowych kategoriach defektów, naruszeniach standardów kodowania oraz wzorcach podatności, które można wykryć bez uruchamiania aplikacji. Wyniki są normalizowane i prezentowane za pośrednictwem scentralizowanych pulpitów nawigacyjnych wraz z innymi metrykami DevOps.

To podejście zorientowane na pakiet wspiera organizacje, które chcą, aby analiza statyczna funkcjonowała jako jeden z elementów szerszego systemu kontroli dostaw. Dzięki osadzaniu analizy w zintegrowanej platformie, przedsiębiorstwa mogą egzekwować standardy bazowe w zespołach bez konieczności wprowadzania dodatkowych narzędzi punktowych do i tak już złożonych środowisk.

Integracja z zarządzaniem dostawami przedsiębiorstwa

Możliwości analizy statycznej OpenText są ściśle zintegrowane z szerszymi funkcjami zarządzania cyklem życia, takimi jak śledzenie wymagań, testowanie i koordynacja wydań. Ta integracja umożliwia powiązanie wyników analizy z zadaniami, defektami i zatwierdzeniami, wspierając identyfikowalność w całym procesie dostarczania. W organizacjach z formalnymi modelami zarządzania takie dopasowanie upraszcza nadzór i raportowanie.

Platforma jest często pozycjonowana w celu obsługi struktur Zarządzanie zmianami Procesy, w których modyfikacje oprogramowania muszą przejść przez zdefiniowane etapy przeglądu i zatwierdzenia. Wyniki analizy statycznej stają się częścią dowodów wykorzystywanych do oceny gotowości do wydania, a nie samodzielnym źródłem wiedzy technicznej.

Zakres językowy i nacisk na standaryzację

Rozwiązanie OpenText DevOps Cloud Static Analysis obsługuje szereg powszechnie używanych języków programowania dla przedsiębiorstw, umożliwiając spójne egzekwowanie standardów kodowania w różnych zespołach programistycznych. Obsługa języków jest zorientowana na popularne stosy programistyczne, a nie na niszowe lub starsze środowiska.

Chociaż ta szerokość wspiera standaryzację, głębokość analizy pozostaje stosunkowo niewielka w porównaniu ze specjalistycznymi narzędziami. Platforma nie podejmuje się modelowania ścieżek wykonywania, rozwiązywania logiki orkiestracji wsadowej ani analizowania zależności między aplikacjami. Jej wyniki najlepiej nadają się do identyfikacji lokalnych problemów w poszczególnych bazach kodu.

Skalowalność i cechy operacyjne

Zaprojektowany jako część pakietu chmurowego, OpenText DevOps Cloud Static Analysis skaluje się w wielu projektach i zespołach dzięki scentralizowanej administracji. Dzięki temu jest odpowiedni dla przedsiębiorstw poszukujących jednolitych mechanizmów kontroli dla dużej liczby programistów. Wydajność skaluje się wraz z infrastrukturą chmurową, zmniejszając zapotrzebowanie na dedykowane zasoby lokalne.

Skalowalność w tym kontekście odnosi się jednak do zasięgu organizacyjnego, a nie do głębokości analitycznej. Platforma zapewnia szeroki wgląd w projekty, ale ograniczony wgląd w zachowanie systemów w czasie wykonywania lub w to, jak zmiany rozprzestrzeniają się w złożonych, połączonych środowiskach.

Typowe przypadki użycia i ograniczenia w przedsiębiorstwach

Rozwiązanie OpenText DevOps Cloud Static Analysis jest najskuteczniejsze w przedsiębiorstwach, które cenią sobie zintegrowane zarządzanie dostawami i ujednolicone mechanizmy kontroli nad dogłębną analizą techniczną. Obsługuje ono środowiska, w których analiza statyczna jest jednym z wielu punktów kontrolnych w ramach kontrolowanego procesu udostępniania, zapewniając spójne egzekwowanie podstawowych wymagań jakościowych i bezpieczeństwa.

Jego ograniczenia stają się widoczne w scenariuszach wymagających szczegółowego zrozumienia zachowań wykonawczych, łańcuchów zależności lub wpływu modernizacji na systemy heterogeniczne. Platforma nie zapewnia widoczności behawioralnej ani oceny wpływu niezbędnej do bezpiecznego przeprowadzania szeroko zakrojonych inicjatyw refaktoryzacji lub modernizacji i często jest uzupełniana narzędziami specjalizującymi się w analizie wykonań i analizie międzyplatformowej.

Tabela porównawcza oparta na możliwościach rozwiązań SCA

| Zdolność | SMART TS XL | SonarQube Ent | Checkmarx One | Wzmocnij SCA | Najważniejsze momenty obsady | Obrazowanie CAST | Verakod | Ukrycie | Parasoft | Klocwork | OpenText |

|---|---|---|---|---|---|---|---|---|---|---|---|

| Skala portfela przedsiębiorstwa | ✅ Znakomity | ◐ Umiarkowany | ◐ Umiarkowany | ◐ Umiarkowany | ✅ Znakomity | ✅ Znakomity | ◐ Umiarkowany | ◐ Umiarkowany | ◐ Umiarkowany | ◐ Umiarkowany | ◐ Umiarkowany |

| Multiplatformowy (komputer mainframe + rozproszony) | ✅ Pełne | ❌ Nie | ❌ Nie | ❌ Ograniczona | ❌ Ograniczona | ❌ Ograniczona | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Ograniczona |

| Obsługa starszych języków (COBOL, JCL, RPG) | ✅ Pełne | ❌ Nie | ❌ Nie | ❌ Ograniczona | ❌ Ograniczona | ❌ Ograniczona | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie |

| Analiza zależności międzysystemowych | ✅ Pełne | ❌ Nie | ❌ Nie | ❌ Nie | ◐ Wysoki poziom | ◐ Strukturalny | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie |

| Widoczność ścieżki wykonania (statyczna) | ✅ Pełne | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ◐ Częściowy | ◐ Częściowy | ◐ Częściowy | ❌ Nie |

| Analiza przepływu partii i zadań | ✅ Pełne | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie |

| Analiza wpływu przed zmianą | ✅ Głęboki | ◐ Płytki | ◐ Tylko zabezpieczenia | ◐ Tylko zabezpieczenia | ◐ Portfolio | ◐ Strukturalny | ◐ Tylko zabezpieczenia | ◐ Poziom kodu | ◐ Poziom kodu | ◐ Poziom kodu | ◐ Zarządzanie |

| Wykrywanie luk w zabezpieczeniach (SAST) | ◐ Kontekstualny | ◐ Podstawowy | ✅ Silny | ✅ Silny | ◐ Orientacyjny | ❌ Nie | ✅ Silny | ◐ Ograniczone | ◐ Ograniczone | ◐ Ograniczone | ◐ Podstawowy |

| Wgląd w wydajność i złożoność | ✅ Głęboki | ◐ Metryki | ❌ Nie | ❌ Nie | ◐ Kruszywo | ◐ Strukturalny | ❌ Nie | ◐ Oparte na defektach | ◐ Zgodność | ◐ Oparte na defektach | ❌ Nie |

| Analiza gotowości do modernizacji | ✅ Natywny | ❌ Nie | ❌ Nie | ❌ Nie | ✅ Podstawowy | ◐ Strukturalny | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie | ❌ Nie |

| Przeszukaj wszystkie zasoby | ✅ Zaawansowany | ◐ Tylko repozytorium | ◐ Tylko repozytorium | ◐ Tylko repozytorium | ◐ Metadane | ◐ Metadane | ◐ Tylko repozytorium | ◐ Tylko repozytorium | ◐ Tylko repozytorium | ◐ Tylko repozytorium | ◐ Tylko repozytorium |

| Integracja CI / CD | ◐ Opcjonalne | ✅ Silny | ✅ Silny | ◐ Umiarkowany | ❌ Nie | ❌ Nie | ✅ Silny | ◐ Umiarkowany | ◐ Umiarkowany | ◐ Umiarkowany | ✅ Natywny |

| Generowanie dowodów gotowych do audytu | ✅ Natywny | ◐ Ograniczone | ◐ Ograniczone | ✅ Silny | ◐ Kruszywo | ◐ Strukturalny | ◐ Ograniczone | ◐ Ograniczone | ✅ Silny | ◐ Ograniczone | ◐ Silny |

Inne narzędzia do analizy kodu statycznego (ograniczone zastosowanie w przedsiębiorstwach)

- ESLint

- Zalety: Egzekwuje standardy kodowania w JavaScript i TypeScript dzięki szybkiemu sprzężeniu zwrotnemu od programistów.

- Ograniczenia: Działa na poziomie repozytorium, nie zapewniając widoczności oddziaływania na cały system lub całe przedsiębiorstwo.

- PMD

- Zalety: Wykrywa typowe problemy z jakością kodu w różnych językach programowania.

- Ograniczenia: Analiza oparta na regułach nie nadaje się do dużych, heterogenicznych przedsiębiorstw.

- Flake8

- Zalety: Lekka analiza statyczna składni Pythona i egzekwowanie stylu.

- Ograniczenia: Nie zapewnia wglądu w kwestie architektoniczne i wykonawcze.

- Bandyta

- Zalety: Identyfikuje problemy bezpieczeństwa w kodzie Pythona przy użyciu analizy opartej na wzorcach.

- Ograniczenia: Wąski zakres i brak świadomości interakcji z systemami przedsiębiorstwa.

- KodQL

- Zalety: Analiza oparta na zapytaniach, która umożliwia identyfikację złożonych wzorców podatności.

- Ograniczenia: Wymaga specjalistycznej wiedzy i brakuje modelowania realizacji przedsiębiorstwa.

- Semgrep

- Zalety: Szybkie, konfigurowalne dopasowywanie wzorców w celu zapewnienia bezpieczeństwa i kontroli jakości.

- Ograniczenia: Podejście oparte na wzorcach nie uwzględnia zależności i kontekstu behawioralnego.

- Kod Snyka

- Zalety: Przyjazna dla programistów analiza statyczna zintegrowana z natywnymi dla chmury przepływami pracy.

- Ograniczenia: Skupiamy się na bezpieczeństwie na poziomie aplikacji, a nie na architekturze korporacyjnej.

- Pylint

- Zalety: Zapewnia szczegółowe kontrole jakości kodu dla projektów Python.

- Ograniczenia: Nie jest przeznaczony do analiz międzyprojektowych lub wieloplatformowych.

- Kontrola Cpp

- Zalety: Statyczna analiza typu open source dla języków C i C++ z niskim wskaźnikiem fałszywych wyników.

- Ograniczenia: Ograniczona skalowalność i wsparcie zarządzania przedsiębiorstwem.

- Wnioskować

- Zalety: Wykrywa problemy z pamięcią i współbieżnością, wykorzystując zaawansowane techniki analizy.

- Ograniczenia: Obsługa wąskiego języka i ograniczona integracja korporacyjna.

- LGTM

- Zalety: Łączy analizę statyczną z opartymi na chmurze przepływami pracy związanymi z przeglądem kodu.

- Ograniczenia: Koncentracja na repozytorium z ograniczonym wglądem na poziomie systemu.

- Analizatory FxCop

- Zalety: Egzekwuje wytyczne dotyczące projektowania i kodowania aplikacji .NET.

- Ograniczenia: Nie dotyczy zależności między aplikacjami.

- PHPCS

- Zalety: Egzekwuje standardy kodowania w projektach PHP.

- Ograniczenia: Skupienie na stylu i minimalna głębokość analizy.

- SpotBug

- Zalety: Identyfikuje typowe wzorce błędów w bajtkodzie Java.

- Ograniczenia: Wykrywanie oparte na wzorcach bez modelowania ścieżki wykonywania.

- Hamulec;

- Zalety: Specjalistyczne skanowanie bezpieczeństwa aplikacji Ruby on Rails.

- Ograniczenia: Specyficzne dla danej struktury i nieodpowiednie do analizy obejmującej całe przedsiębiorstwo.

- Narzędzia wiersza poleceń ReSharper

- Zalety: Integruje analizę statyczną z procesami kompilacji .NET.

- Ograniczenia: Skupienie się na produktywności programistów, a nie na wiedzy o przedsiębiorstwie.

- Głębokie źródło

- Zalety: Zautomatyzowany przegląd kodu i analiza jakości nowoczesnych repozytoriów.

- Ograniczenia: Rozwiązanie SaaS z ograniczoną głębokością analizy strukturalnej.

- Codacy

- Zalety: Centralne raportowanie jakości w wielu repozytoriach.

- Ograniczenia: Skupienie na agregacji, bez głębokiego zrozumienia systemu.

- Sonatype Lift

- Zalety: Zintegrowane skanowanie bezpieczeństwa i jakości z przepływami pracy DevOps.

- Ograniczenia: Ograniczona widoczność zachowania środowiska wykonawczego i starszych systemów.

- Zależność

- Zalety: Zapewnia analizę zależności dla aplikacji .NET.

- Ograniczenia: Specyficzne dla danej technologii i nieodpowiednie dla heterogenicznych gospodarstw.

- Coverity Scan (oprogramowanie typu open source)

- Zalety: Bezpłatna analiza statyczna wybranych projektów open-source.

- Ograniczenia: Nie jest to reprezentatywne dla scenariuszy wdrożenia w przedsiębiorstwie.

- Sprawdzanie zależności OWASP

- Zalety: Identyfikuje znane podatne zależności.

- Ograniczenia: Nie analizuje zachowania ani architektury kodu źródłowego.

- Rust Clippy

- Zalety: Kod Lints Rust pozwala wykryć idiomatyczne problemy i typowe błędy.

- Ograniczenia: Specyficzne dla danego języka, bez kontekstu przedsiębiorstwa.

- GolangCI-Lint

- Zalety: Agreguje wiele linterów dla projektów Go.

- Ograniczenia: Skupienie na deweloperach, bez wglądu w portfolio.

- SwiftLint

- Zalety: Wymusza stosowanie konwencji kodowania Swift w projektach mobilnych.

- Ograniczenia: Wąski zakres i ograniczone znaczenie dla systemów korporacyjnych.

W całym porównaniu wyraźnie widać różnicę między narzędziami zaprojektowanymi do egzekwowania lokalnych kontroli jakości lub bezpieczeństwa a platformami zdolnymi do wspierania zrozumienia w skali całego przedsiębiorstwa. Wiele rozwiązań sprawdza się w wąsko zdefiniowanych zakresach, takich jak feedback dla programistów, wykrywanie luk w zabezpieczeniach czy wizualizacja architektoniczna, ale wciąż ma ograniczenia w przypadku zastosowania w heterogenicznych środowiskach składających się ze starszych platform, zadań wsadowych i ściśle powiązanych systemów. W tych środowiskach czynnikiem ograniczającym nie jest brak analizy, ale fragmentacja wniosków w rozproszonych narzędziach.