Les applications deviennent de plus en plus volumineuses et complexes, et les développeurs cherchent donc des moyens d'améliorer les performances et d'optimiser l'expérience utilisateur. Le fractionnement de code répond à ces défis en gérant comment et quand les différentes parties du code d'une application sont chargées. Découvrez le fractionnement de code, ses avantages, les méthodes de mise en œuvre, les meilleures pratiques et la façon dont des outils tels que SMART TS XL peut faciliter son adoption, notamment dans le contexte de la modernisation des applications existantes.

Qu'est-ce que le fractionnement de code ?

Le fractionnement de code est une technique utilisée pour décomposer de grandes bases de code en blocs ou bundles plus petits et plus faciles à gérer. Cette approche permet à une application de charger uniquement les parties nécessaires de son code à un moment précis, plutôt que de charger l'intégralité de la base de code en amont. Cela permet d'améliorer le temps de chargement initial, de réduire l'utilisation de la mémoire et d'offrir une expérience utilisateur plus fluide.

Par exemple, dans les applications monopages (SPA), tout le code peut traditionnellement être regroupé dans un seul gros fichier JavaScript. À mesure que l'application se développe, ce fichier devient plus volumineux, ce qui ralentit les temps de chargement. Le fractionnement de code résout ce problème en divisant le code en parties plus petites, ce qui permet à l'application de charger uniquement ce qui est nécessaire pour la page ou la fonctionnalité en cours.

Pourquoi le fractionnement de code est important

L'importance du fractionnement de code réside dans sa capacité à optimiser les performances des applications et l'expérience utilisateur. Les gros paquets de code peuvent affecter considérablement les temps de chargement, en particulier sur les réseaux ou les appareils mobiles plus lents. En réduisant la quantité de code à télécharger et à exécuter, le fractionnement de code permet des interactions plus rapides et une application plus réactive. Dans l'environnement numérique actuel, même un bref retard dans le temps de chargement peut amener les utilisateurs à abandonner une application, ce qui entraîne une perte d'engagement et de revenus potentiels.

La division de code permet également de minimiser l'empreinte mémoire d'une application en garantissant que seuls les modules nécessaires sont chargés en mémoire à un moment donné. Cela est bénéfique pour les applications dotées d'interfaces riches en fonctionnalités, où toutes les fonctionnalités ne sont pas requises simultanément.

Comment fonctionne le fractionnement de code

Fractionnement de code statique (fractionnement de code basé sur l'itinéraire)

Le fractionnement de code statique, également appelé « fractionnement de code basé sur les itinéraires », consiste à diviser le code en morceaux au moment de la création en fonction de règles prédéterminées. Cette approche est couramment utilisée dans les applications Web qui ont des itinéraires ou des vues distincts, comme les applications SPA.

Dans cette méthode, chaque itinéraire ou composant principal est regroupé dans son propre fichier pendant le processus de création. Lorsque l'utilisateur accède à un itinéraire particulier, l'application charge uniquement le bundle correspondant. Le fractionnement de code statique est souvent implémenté à l'aide de modules de regroupement, qui divisent automatiquement le code en bundles distincts comme spécifié par le développeur.

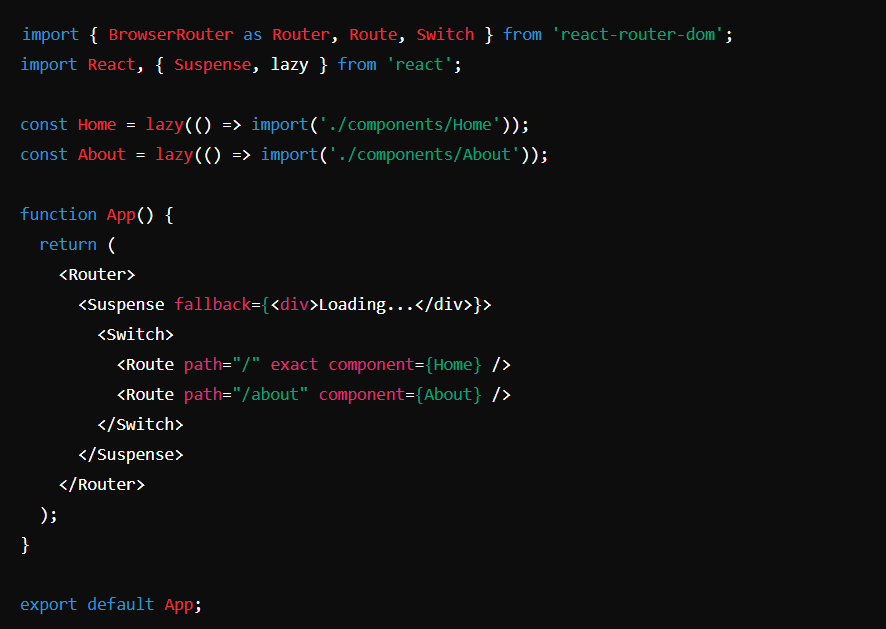

Par exemple, dans une application React, le fractionnement de code statique peut être réalisé à l'aide de la syntaxe import(). Le code ci-dessous montre comment différentes routes peuvent être divisées en bundles distincts :

Dans cet exemple, les composants Home et About sont divisés en bundles distincts. Ces bundles sont chargés de manière dynamique lorsque l'utilisateur accède aux itinéraires respectifs, réduisant ainsi la quantité de code à charger initialement.

Fractionnement de code dynamique (fractionnement de code à la demande)

Le fractionnement de code dynamique, également appelé « à la demande » ou « chargement différé », consiste à décomposer le code au moment de l'exécution en fonction des interactions de l'utilisateur. Cette stratégie utilise des importations dynamiques (import()) pour charger des segments de code spécifiques uniquement lorsqu'ils sont nécessaires. Contrairement au fractionnement de code statique, le fractionnement dynamique permet un contrôle plus précis, permettant aux développeurs de fractionner le code au sein des composants ou même au niveau de la fonction.

Le fractionnement de code dynamique est particulièrement utile pour charger des composants rarement utilisés, tels que des modaux, des widgets ou des bibliothèques tierces, réduisant ainsi la taille initiale du bundle. Voici un exemple de fractionnement de code dynamique dans un composant React :

Dans cet exemple, LazyComponent n'est chargé que lorsque l'utilisateur clique sur le bouton. Cela réduit le temps de chargement initial et garantit que le code inutile n'est pas exécuté tant que cela n'est pas nécessaire. Le composant Suspense est utilisé pour gérer l'état de chargement, en fournissant des informations à l'utilisateur pendant le chargement du composant.

Avantages du fractionnement de code

Temps de chargement initial amélioré

L'un des principaux avantages du fractionnement de code est l'amélioration du temps de chargement initial d'une application. En divisant la base de code en petits morceaux, le navigateur télécharge uniquement le code essentiel nécessaire au premier écran ou à l'interaction de l'utilisateur. Cela se traduit par un chargement initial plus rapide, car le navigateur n'a pas besoin de traiter de gros fichiers monolithiques avant de restituer l'application.

Dans les applications monopages (SPA), où tous les composants sont traditionnellement regroupés, le fractionnement de code permet à l'application de charger uniquement les composants nécessaires à la vue actuelle. Cela réduit considérablement le temps nécessaire à la première représentation significative, améliorant ainsi les performances perçues et la réactivité de l'application.

Performances d'application améliorées

Le fractionnement de code optimise les performances de l'application en réduisant l'empreinte mémoire et la quantité de JavaScript à exécuter. En chargeant le code en segments plus petits, l'application minimise la pression sur les ressources système, ce qui se traduit par des interactions plus fluides, en particulier sur les appareils dotés d'une puissance de traitement limitée.

Lorsque les utilisateurs naviguent dans différentes parties de l'application, le fractionnement du code garantit que seuls les segments requis sont chargés lorsque cela est nécessaire. Ce mécanisme de chargement à la demande empêche l'exécution de code inutile, ce qui peut améliorer les performances globales et conduire à une expérience utilisateur plus réactive.

Gestion efficace des ressources

Grâce au fractionnement de code, seuls les modules ou fonctionnalités nécessaires sont chargés en mémoire à un moment donné. Ce chargement sélectif garantit une utilisation plus efficace des ressources système, notamment de la mémoire. Lorsque l'application ne charge pas tout le code en amont, le système peut allouer des ressources aux composants essentiels en cours d'exécution, évitant ainsi les ralentissements potentiels causés par une utilisation excessive de la mémoire.

Cet aspect est particulièrement intéressant pour les applications riches en fonctionnalités et dotées d'interfaces utilisateur complexes. En gérant efficacement les ressources, l'application peut gérer davantage de fonctionnalités sans diminution correspondante des performances.

Chargements ultérieurs plus rapides grâce à la mise en cache

Un autre avantage clé du fractionnement de code est l'amélioration de la mise en cache. Lorsqu'une application est divisée en plusieurs groupes plus petits, le navigateur peut mettre en cache des segments individuels. Lors des visites suivantes, seuls les segments nouveaux ou mis à jour doivent être téléchargés. Cela signifie que les parties de l'application qui n'ont pas changé seront déjà dans le cache du navigateur, ce qui se traduira par des temps de chargement plus rapides pour les utilisateurs récurrents.

Dans les applications monolithiques traditionnelles, toute modification mineure obligerait les utilisateurs à télécharger à nouveau l'intégralité du bundle. Le fractionnement du code atténue ce problème en garantissant que seuls les segments modifiés sont récupérés à nouveau, réduisant ainsi l'utilisation des données et accélérant les interactions ultérieures.

Évolutivité et maintenabilité améliorées

La décomposition d'une application en modules plus petits et plus faciles à gérer facilite intrinsèquement sa maintenance et son évolution. La division du code encourage la conception modulaire, où les développeurs se concentrent sur la création et la mise à jour de blocs de code individuels. Cette modularité simplifie le processus de débogage puisque les problèmes peuvent être isolés dans des parties spécifiques de l'application.

À mesure que l'application se développe et que de nouvelles fonctionnalités sont introduites, les développeurs peuvent diviser les modules supplémentaires en nouveaux segments sans affecter les performances du code existant. Cette approche permet un développement et un déploiement continus, ce qui permet à l'application d'évoluer plus efficacement.

Expérience utilisateur plus fluide

Lorsque les utilisateurs interagissent avec une application, ils s'attendent à une expérience fluide avec un minimum de retards. Le fractionnement de code contribue à une expérience utilisateur plus fluide en chargeant de manière asynchrone de nouveaux modules en arrière-plan lorsque les utilisateurs naviguent dans différentes parties de l'application. En préchargeant ou en récupérant du code pour les prochaines interactions possibles, l'application peut fournir des réponses quasi instantanées, réduisant ainsi la latence perçue.

Par exemple, dans une application Web, le fractionnement de code permet à la page initiale de se charger rapidement tandis que la prélecture en arrière-plan charge des ressources supplémentaires. Cette stratégie garantit que les navigations suivantes sont rapides et fluides, car le code nécessaire a déjà été chargé avant que l'utilisateur ne le demande.

Meilleure gestion des applications complexes

Dans les applications à grande échelle, la gestion de fonctionnalités complexes peut entraîner la création d'un ensemble de codes extrêmement volumineux qui dégrade les performances. Le fractionnement de code répond à ce défi en permettant aux développeurs de décomposer ces fonctionnalités complexes en modules plus petits et indépendants qui peuvent être chargés en cas de besoin.

Cette modularisation garantit que seules les parties pertinentes de la base de code sont traitées lors des interactions avec l'utilisateur, ce qui évite les goulots d'étranglement des performances. En gérant la complexité de cette manière, le fractionnement du code permet aux développeurs de créer des applications riches en fonctionnalités sans compromettre les performances.

Flexibilité améliorée pour les mises à jour des fonctionnalités

Le fractionnement du code offre une certaine flexibilité lors de la mise à jour ou de l'ajout de fonctionnalités à une application. Étant donné que les différentes fonctionnalités sont isolées dans des blocs distincts, les développeurs peuvent modifier ou introduire de nouvelles fonctionnalités sans affecter l'ensemble de la base de code. Cette approche découplée minimise le risque d'introduction de bogues et garantit que les modifications ont un impact limité sur les autres parties de l'application.

Lorsqu'une nouvelle fonctionnalité est ajoutée, elle peut être regroupée dans son propre bloc, qui peut être chargé de manière dynamique si nécessaire. Cela accélère non seulement le processus de déploiement, mais réduit également le risque de problèmes de régression dans les fonctionnalités existantes.

Utilisation optimisée du réseau

En limitant la taille initiale du bundle, le fractionnement de code optimise l'utilisation du réseau. Cela est particulièrement avantageux pour les utilisateurs disposant de connexions plus lentes ou d'appareils mobiles, où les bundles volumineux peuvent entraîner des temps de chargement prolongés. Étant donné que seul le code nécessaire à l'interaction utilisateur actuelle est récupéré, les ressources réseau sont utilisées plus efficacement.

De plus, en préchargeant ou en pré-récupérant des ressources en fonction du comportement anticipé de l'utilisateur, le fractionnement de code garantit que l'application récupère uniquement ce qui est nécessaire, évitant ainsi le gaspillage de bande passante lié au téléchargement de modules inutilisés.

Facilite la mise en œuvre d'applications Web progressives (PWA)

Pour les développeurs qui créent des applications Web progressives (PWA), le fractionnement de code est essentiel. Les PWA visent à fournir une expérience de type application sur le Web, avec des temps de chargement rapides et des capacités hors ligne. Le fractionnement de code répond à cet objectif en réduisant la taille du téléchargement initial et en permettant le chargement dynamique du contenu en fonction de l'interaction de l'utilisateur. Il fonctionne également de manière transparente avec les service workers, qui peuvent mettre en cache des segments individuels pour faciliter l'accès hors ligne et les chargements rapides, améliorant ainsi encore l'expérience PWA.

Bonnes pratiques pour le fractionnement de code

Bien que le fractionnement de code puisse améliorer considérablement les performances des applications, les bonnes pratiques suivantes maximisent ses avantages :

Évitez de trop diviser

Diviser le code en trop de petits morceaux peut entraîner un nombre excessif de requêtes réseau, ce qui peut potentiellement causer plus de tort que de bien. Il est essentiel de trouver un équilibre entre la réduction de la taille du bundle et la minimisation du nombre de requêtes HTTP.

Regrouper les modules similaires

Lors de la division du code, regroupez les modules similaires qui sont souvent utilisés ensemble dans un seul bloc. Cela réduit le chargement redondant et garantit que les fonctionnalités associées sont disponibles en cas de besoin.

Optimiser la priorité de charge

Utilisez des techniques telles que le préchargement et la prélecture pour optimiser la priorité de chargement des segments de code. Cela permet de charger plus rapidement les segments critiques tout en préchargeant les segments moins urgents, améliorant ainsi encore l'expérience utilisateur.

Tests et profilage

Testez et profilez régulièrement l'application pour surveiller l'impact du fractionnement de code sur les performances. Les outils de test peuvent identifier les goulots d'étranglement et aider à optimiser la stratégie de fractionnement.

Défis et considérations

Bien que le fractionnement de code soit une technique puissante pour améliorer les performances des applications Web, il comporte son propre lot de défis et de considérations. Une mise en œuvre correcte du fractionnement de code nécessite une planification minutieuse et une compréhension approfondie de l'architecture de l'application, du comportement de l'utilisateur et des pièges potentiels. Voici quelques-uns des principaux défis et considérations auxquels les développeurs sont confrontés lors de la mise en œuvre du fractionnement de code :

Complexité accrue dans la gestion de la base de code

L'un des défis les plus importants du fractionnement de code est la complexité supplémentaire qu'il introduit dans la base de code. Lorsqu'une application est divisée en blocs plus petits et chargés indépendamment, les développeurs doivent gérer quand et comment ces blocs sont chargés. Cela implique de gérer le chargement asynchrone des modules, de s'assurer que les composants importés dynamiquement fonctionnent de manière transparente avec le reste de l'application et de gérer les erreurs potentielles pendant le chargement.

Cette complexité peut augmenter la courbe d'apprentissage pour les nouveaux développeurs qui rejoignent le projet et peut rendre le débogage plus difficile. Les erreurs dans la gestion du code fractionné peuvent entraîner des erreurs d'exécution ou un comportement inattendu, affectant la stabilité de l'application.

Gestion des dépendances et duplication de code

Lors de la division du code en bundles plus petits, il est essentiel de surveiller les dépendances incluses dans chaque segment. Si deux ou plusieurs segments partagent des dépendances communes, ils peuvent finir par inclure ces dépendances séparément, ce qui entraîne une duplication du code entre les bundles. Cette redondance augmente la taille totale des fichiers à télécharger, ce qui peut annuler les avantages de performance du fractionnement du code.

Pour atténuer ce problème, les développeurs doivent faire preuve de diligence analyser leur arbre de dépendance et en utilisant des stratégies d'optimisation telles que l'extraction des dépendances partagées dans des bundles distincts. Cependant, cela ajoute une couche supplémentaire de complexité au processus de construction et nécessite une surveillance régulière à mesure que l'application évolue.

Gestion de l'état de chargement

Lors de l'utilisation d'importations dynamiques, les composants ou modules sont chargés de manière asynchrone. Cela signifie qu'il peut y avoir un délai entre le moment où un utilisateur déclenche une action (par exemple, naviguer vers un nouvel itinéraire) et le moment où le fragment de code correspondant est téléchargé et exécuté. Pendant ce délai, l'interface utilisateur doit gérer l'état de chargement avec élégance, généralement en affichant un spinner de chargement ou un contenu d'espace réservé.

La gestion correcte de cet état de chargement est essentielle pour maintenir une expérience utilisateur fluide. Une mauvaise gestion peut entraîner une interface lente et peu réactive, ce qui peut frustrer les utilisateurs et les amener à abandonner l'application. De plus, les développeurs doivent gérer les erreurs de chargement potentielles (par exemple, les pannes de réseau) et fournir des commentaires utiles aux utilisateurs lorsque de telles situations se produisent.

Équilibrer le nombre de morceaux

Diviser le code en trop de petits morceaux peut entraîner un nombre excessif de requêtes réseau. Lorsque le navigateur effectue plusieurs requêtes pour récupérer chaque morceau, cela peut entraîner des retards dus à la latence du réseau, en particulier sur les connexions lentes. D'un autre côté, la création de morceaux moins nombreux et plus gros peut améliorer l'efficacité du réseau, mais peut toujours entraîner des fichiers de grande taille qui prennent plus de temps à télécharger et à analyser.

Il est essentiel de trouver le bon équilibre entre le nombre de segments et leurs tailles. Cela nécessite souvent que les développeurs profilent l'application, expérimentent différentes stratégies de segmentation et peaufinent la configuration pour l'adapter au cas d'utilisation spécifique. Ce processus est continu, car les modifications apportées à la base de code de l'application ou au comportement de l'utilisateur peuvent nécessiter des ajustements dans la façon dont le code est divisé.

Impact sur les performances de charge initiale

Bien que la division du code puisse améliorer les performances de chargement en retardant le chargement de certaines parties de la base de code, elle peut parfois avoir l'effet inverse si elle n'est pas mise en œuvre de manière réfléchie. Par exemple, si le bloc initial qui charge les fonctionnalités principales de l'application devient trop volumineux, cela peut ralentir le temps de rendu initial. De plus, si trop de composants critiques sont divisés en blocs distincts qui doivent être chargés immédiatement, cela peut entraîner plusieurs requêtes réseau simultanées, ce qui peut retarder le rendu initial.

Pour optimiser les performances de chargement initial, les développeurs doivent sélectionner soigneusement les parties de la base de code à inclure dans le bundle initial et celles à diviser en blocs distincts. Cela implique de comprendre quels composants et modules sont essentiels pour la première interaction avec l'utilisateur et de différer le chargement des fonctionnalités moins critiques jusqu'à ce qu'elles soient nécessaires.

Mise en cache et gestion des versions

La mise en cache est un élément clé pour améliorer les performances des applications. Grâce au fractionnement du code, chaque segment peut être mis en cache indépendamment, ce qui réduit la quantité de données à télécharger lors des visites suivantes. Cependant, cela introduit également la complexité de la gestion du cache et du contrôle de version. Lorsque le code change, comment garantir que les segments corrects et mis à jour sont chargés sans que l'utilisateur ne rencontre d'erreurs causées par des fichiers mis en cache obsolètes ?

Des stratégies de contournement du cache appropriées, telles que l'utilisation du hachage de contenu dans les noms de fichiers, sont essentielles pour garantir que les utilisateurs reçoivent toujours la dernière version de chaque fragment. Cependant, la mise en œuvre correcte de ces stratégies nécessite une planification minutieuse et une compréhension de la manière dont les navigateurs et les réseaux de diffusion de contenu (CDN) gèrent la mise en cache.

Surveillance et analyse

Le fractionnement du code peut affecter la manière dont les interactions des utilisateurs sont suivies et analysées. Lorsque les segments sont chargés de manière dynamique, il peut devenir plus difficile de surveiller efficacement le comportement des utilisateurs, par exemple en suivant le temps nécessaire à certaines fonctionnalités pour devenir interactives ou en mesurant l'impact de segments spécifiques sur les performances.

Pour résoudre ce problème, les développeurs doivent intégrer des outils de surveillance et d'analyse prenant en charge le chargement dynamique. Ces outils peuvent fournir des informations sur la manière dont le fractionnement du code affecte l'expérience utilisateur, aidant ainsi les développeurs à affiner leur stratégie de fractionnement.

Tests et profilage

Le test d'une application qui utilise le fractionnement de code nécessite des considérations supplémentaires. Les développeurs doivent s'assurer que les composants fractionnés fonctionnent ensemble de manière transparente et gèrent correctement les états de chargement asynchrones. Les tests automatisés doivent couvrir des scénarios tels que le chargement différé des composants, la gestion des erreurs lors des importations dynamiques et les interactions des utilisateurs pendant la récupération des segments.

Les outils de profilage deviennent essentiels pour optimiser la stratégie de fractionnement. Les développeurs doivent profiler régulièrement l'application pour identifier les goulots d'étranglement, surveiller la taille des blocs et analyser les requêtes réseau afin de s'assurer que le fractionnement du code produit les avantages de performances souhaités.

Impact sur l'expérience utilisateur

En fin de compte, l'objectif du fractionnement de code est d'améliorer l'expérience utilisateur. Cependant, une utilisation inappropriée peut entraîner des expériences négatives, telles que des interactions retardées, des chargements de spinners apparaissant trop souvent ou des comportements inattendus pendant la navigation. Les développeurs doivent garder à l'esprit le parcours utilisateur lors de la conception de leur stratégie de fractionnement de code, en s'assurant que l'application reste rapide, réactive et fluide.

Comment SMART TS XL Peut être utile à des fins de fractionnement de code

SMART TS XL est un outil sophistiqué conçu pour fournir une analyse approfondie des bases de code volumineuses, découvrant des modèles et mettant en évidence les domaines qui peuvent bénéficier d'une optimisation, d'une modernisation et d'une restructuration. En matière de fractionnement de code, SMART TS XL peut identifier quelles parties d'une application sont des candidats appropriés pour le fractionnement et aider les développeurs à prendre des décisions éclairées pour optimiser les performances.

SMART TS XL identifie également les fichiers de petite taille mais fortement référencés. Les développeurs peuvent utiliser ces informations pour déterminer si ces fichiers peuvent être refactorisés en modules plus petits et indépendants qui peuvent être chargés dynamiquement en cas de besoin.

Analyse des dépendances entre fichiers et des interactions entre programmes

Le fractionnement de code peut devenir complexe lorsqu'il existe des interdépendances entre différents modules. SMART TS XLLa capacité de 's à cartographier les références et les interactions des fichiers est ici inestimable. Elle permet aux développeurs de comprendre quels fichiers sont étroitement couplés et lesquels ont des dépendances plus larges dans l'application. Cette connaissance est essentielle pour décider où diviser le code afin d'éviter un chargement redondant et une complexité inutile.

En révélant les interactions et les dépendances, SMART TS XL permet aux développeurs pour créer un code clair stratégie de fractionnement qui minimise le code dupliqué entre les blocs, garantissant que les utilitaires communs et les modules partagés sont gérés de manière optimisée.

Découvrir les complexités cachées des petits fichiers à usage intensif

SMART TS XL peut identifier les petits fichiers qui ont un nombre de références étonnamment élevé. Ces fichiers représentent souvent des fonctions utilitaires utilisées dans tout le système. Comprendre leur rôle et leur répartition dans la base de code permet aux développeurs de décider comment ces utilitaires peuvent être intégrés dans une stratégie de fractionnement de code.

SMART TS XLLa capacité de à détecter ces modèles garantit que même les fonctions utilitaires fréquemment négligées sont prises en compte lors du fractionnement du code.

Prise en charge de la modernisation de l'héritage avec des informations sur le fractionnement de code

Les applications héritées contiennent souvent des structures monolithiques avec des composants étroitement couplés. SMART TS XL excelle dans l'analyse des bases de code existantes et l'identification des zones potentielles de modularisation. En mettant en évidence la présence de fichiers volumineux et en mappant leurs références étendues, l'outil aide les développeurs à hiérarchiser les parties du système existant qui doivent être divisées en modules plus petits.

Au cours du processus de moderniser l'héritage bases de code, SMART TS XL peut aider à identifier les segments de code les plus critiques pour le flux de données du système, tels que les programmes clés basés sur Natural ou les routines COBOL complexes. Cela permet aux développeurs d'implémenter le fractionnement de code d'une manière qui non seulement améliore les performances, mais maintient également l'intégrité de la logique héritée.

Surveillance des redondances potentielles pour les opportunités de nettoyage et de fractionnement de code

SMART TS XL peut détecter les fichiers avec un faible nombre de références et des tailles minimales. Ceux-ci pourraient indiquer un code redondant ou obsolète qui peuvent encombrer le système. En nettoyant ces fichiers, les développeurs peuvent rationaliser la base de code, ce qui facilite la mise en œuvre du fractionnement du code.

De plus, SMART TS XLL'analyse détaillée de peut aider les développeurs à identifier les modules dont les fonctionnalités se chevauchent ou qui pourraient être consolidés. Une fois les fichiers redondants consolidés ou supprimés, la base de code restante devient plus modulaire et adaptée au fractionnement du code.

Planification stratégique pour la division de code

SMART TS XLLes données de , notamment la distribution de la taille des fichiers, le nombre de références et les modèles d'interaction, permettent une planification stratégique du fractionnement du code. Les développeurs peuvent utiliser ces informations pour décider quelles parties de l'application doivent être incluses dans le bundle initial et quelles parties peuvent être chargées de manière asynchrone. En corrélant les nombres de références avec les tailles de fichiers, SMART TS XL permet d'identifier les « points chauds » au sein de l'application : les modules qui sont à la fois volumineux et très utilisés, qui sont d'excellents candidats au fractionnement pour améliorer les performances.

Conclusion

Le fractionnement de code n'est pas une solution universelle, mais plutôt un outil dynamique dans la boîte à outils du développeur. Lorsqu'il est mis en œuvre correctement, il peut transformer une application lente et monolithique en un système rapide, réactif et évolutif. Il améliore l'expérience utilisateur en chargeant uniquement les parties nécessaires du code, en réduisant l'utilisation de la mémoire et en optimisant la gestion des ressources. Cependant, sa mise en œuvre exige une prise en compte attentive des défis potentiels, notamment la complexité accrue, la gestion des états de chargement, la gestion des dépendances et l'équilibrage des tailles de blocs. En comprenant ces défis et en effectuant des analyses approfondies, vous pouvez facilement créer des applications qui vous aideront à résoudre les problèmes les plus complexes. analyse d’impact, analyse de code statique, et des tests continus, les développeurs peuvent maîtriser le fractionnement de code pour créer des applications performantes et centrées sur l'utilisateur. À une époque où les performances sont un facteur de différenciation clé dans les expériences numériques, le fractionnement de code offre une méthode sophistiquée pour garder les applications légères, réactives et adaptables aux demandes changeantes.

SMART TS XL fournit un aperçu approfondi de la structure et de l'utilisation du code au sein d'un système logiciel, ce qui en fait un outil indispensable pour guider les décisions de fractionnement de code. Sa capacité à analyser la taille des fichiers, le nombre de références, les dépendances et les interactions aide les développeurs à identifier les parties critiques de l'application qui bénéficieraient le plus du fractionnement de code. En révélant les complexités cachées, en surveillant les redondances potentielles et en prenant en charge la modernisation de l'héritage, SMART TS XL fournit aux développeurs les informations nécessaires pour optimiser leurs applications, réduire la taille des bundles et améliorer les temps de chargement. Cela se traduit au final par un système plus modulaire, évolutif et performant, adapté aux exigences uniques de chaque application.