Les environnements logiciels d'entreprise à l'aube de 2026 continuent de gagner en complexité structurelle plutôt qu'en simplicité. Des décennies de logique accumulée, de langages de programmation hétérogènes, de modèles de déploiement hybrides et de dépendances étroitement liées limitent de plus en plus la possibilité d'introduire des changements sans conséquences imprévues. Dans ce contexte, les outils d'analyse statique de code ne sont plus considérés comme de simples contrôles qualité optionnels, mais comme des instruments fondamentaux pour comprendre le comportement réel des systèmes avant toute modernisation, refactorisation ou initiative de sécurité.

Ce qui distingue l'analyse statique de code à l'échelle de l'entreprise des outils destinés aux développeurs, ce n'est pas la capacité à identifier des défauts isolés, mais celle de raisonner sur l'ensemble du parc applicatif. Les grandes organisations fonctionnent rarement avec un seul environnement d'exécution ou une seule architecture. Les charges de travail par lots sur mainframe coexistent avec des services distribués, les interfaces existantes s'entrecroisent avec des API natives du cloud, et les exigences réglementaires imposent des contraintes supplémentaires sur la mesure et la gestion des risques. L'analyse statique doit donc opérer au-delà des frontières, révélant les chemins d'exécution, les dépendances cachées et les risques structurels qui resteraient invisibles lors des seuls tests.

SMART TS XL

Solution idéale d'analyse de code statique pour les entreprises disposant de systèmes et d'actifs distribués de grande taille

Explorez maintenantL'importance croissante accordée à la livraison continue et à la modernisation accélérée a encore renforcé le rôle des analyses approfondies. À mesure que les entreprises poursuivent des objectifs plus ambitieux, elles étendent leur champ d'action. modernisation des applications Face aux initiatives de développement, le coût d'une compréhension incomplète devient de plus en plus évident. Les décisions de refactorisation prises sans visibilité complète sur le flux de contrôle, la propagation des données ou le couplage entre systèmes engendrent souvent une instabilité, des régressions de performance ou des problèmes de conformité qui ne se manifestent qu'après le déploiement. Les outils d'analyse statique de code sont désormais censés réduire cette incertitude en fournissant une clarté architecturale avant toute modification.

Dans ce contexte, les critères d'évaluation des outils d'analyse statique de code évoluent en 2026. La précision seule ne suffit plus. Les entreprises exigent une analyse approfondie, une capacité d'adaptation à des millions de lignes de code, la prise en charge d'environnements hétérogènes et la possibilité de traduire les résultats techniques en informations exploitables pour les architectes, les responsables de plateforme et les gestionnaires de risques. Le tableau comparatif ci-dessous examine la performance des principaux outils d'analyse statique de code pour entreprises face à ces exigences en constante évolution, et évalue l'adéquation de leurs fonctionnalités aux réalités des systèmes critiques à grande échelle.

Comparatif et classement des outils d'analyse statique de code pour entreprises (2026)

Le comparatif ci-dessous évalue les principaux outils d'analyse statique de code selon des critères pertinents pour les environnements d'entreprise à grande échelle, et non pour les équipes de développement individuelles. Chaque outil est évalué en fonction de la profondeur de son analyse, de son évolutivité sur des systèmes hétérogènes, de sa compatibilité avec les plateformes anciennes et modernes, et de sa capacité à extraire des informations pertinentes à partir de structures de dépendances complexes. Le classement reflète l'efficacité avec laquelle ces outils facilitent la compréhension de l'architecture, l'identification des risques et la prise de décision éclairée dans des environnements où les changements ont des conséquences opérationnelles et réglementaires importantes.

SMART TS XL

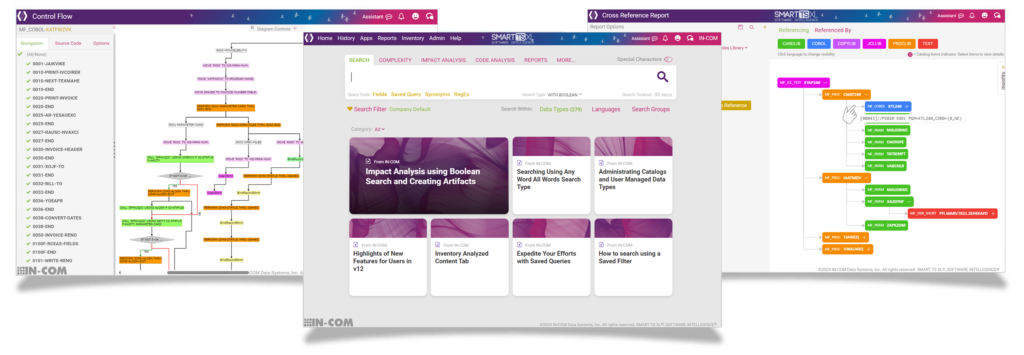

SMART TS XL est une plateforme d'analyse statique de code, d'évaluation d'impact et d'intelligence applicative conçue pour les environnements logiciels hétérogènes de grande envergure. Elle est conçue pour accompagner les organisations opérant sur des systèmes mainframe, midrange et distribués, où des décennies de logique accumulée, de traitement par lots et de dépendances multiplateformes rendent toute modification intrinsèquement risquée. Plutôt que de se concentrer sur des anomalies de qualité de code isolées, SMART TS XL est conçu pour exposer le comportement réel des applications en rendant visibles les chemins d'exécution, les relations de données et les structures de dépendance dans l'ensemble des portefeuilles.

La plateforme fonctionne comme un système web haute performance capable d'indexer et d'analyser des milliards de lignes de code et d'artefacts associés en quelques secondes. En déchargeant les systèmes de production des charges de travail d'analyse et en centralisant les informations dans un environnement partagé, SMART TS XL Il prend en charge des milliers d'utilisateurs simultanés sans dégradation des performances. Cette capacité le rend adapté non seulement aux équipes de développement, mais aussi aux architectes, aux responsables de la modernisation, au support de production, aux auditeurs et aux acteurs de la conformité qui exigent une visibilité cohérente et factuelle sur les systèmes complexes. Démonstration de la plateforme.

Analyse statique et découverte à l'échelle de l'entreprise

En son coeur, SMART TS XL Il offre une analyse statique approfondie pour un large éventail de langages de programmation, de structures de contrôle de tâches, de bases de données et d'artefacts associés. Il prend en charge les technologies anciennes et modernes, notamment COBOL, PL/I, Natural, RPG, Assembleur, Java, C#, Python, VB6, les scripts UNIX, le JCL, les procédures, les artefacts CICS, les définitions MQ, les schémas de bases de données et les documents structurés. Le code source, la logique de traitement par lots, les fichiers de configuration et même les artefacts non liés au code, tels que la documentation et les diagrammes, peuvent être indexés et analysés conjointement, permettant ainsi de découvrir les relations entre des référentiels traditionnellement cloisonnés.

Cette fonctionnalité de découverte unifiée permet aux organisations de dépasser l'inspection au niveau des fichiers et d'accéder à une compréhension globale du système. Programmes, tâches, champs, fichiers, tables et messages peuvent être suivis sur différentes plateformes, révélant ainsi le flux de la logique métier à travers les chaînes de traitement par lots, les transactions en ligne et les processus de reporting en aval. Ces relations sont présentées sous forme de rapports de références croisées interactifs, de cartes de dépendances et de vues d'exécution navigables, plutôt que de listes statiques.

Analyse d'impact et cartographie des dépendances multiplateformes

SMART TS XL L'accent est mis tout particulièrement sur l'analyse d'impact interplateforme. Les modifications apportées à une partie d'une application restent rarement isolées dans les environnements d'entreprise, notamment lorsque les charges de travail du mainframe interagissent avec des services distribués et des bases de données partagées. SMART TS XL analyse les relations d'appels, l'utilisation des données, les chemins d'exécution des tâches et le flux de contrôle afin d'identifier les zones d'impact en amont et en aval à travers les langages et les systèmes.

Les outils de cartographie des dépendances permettent de visualiser ces relations grâce à des diagrammes interactifs et colorés qui mettent en évidence les appelants, les appelés, les producteurs et les consommateurs de données. L'analyse d'impact peut être lancée à partir d'un programme, d'un champ, d'un élément de base de données, d'une étape de tâche ou même des résultats de recherche, permettant ainsi aux équipes de définir précisément le périmètre des modifications avant le début du développement. Cette approche réduit les dépendances non identifiées, limite les tests superflus et fournit une base solide pour la planification des changements et l'évaluation des risques.

Vues orientées exécution de la logique de traitement par lots et de la logique de programme

Pour les environnements à traitement par lots complexe, SMART TS XL Il offre une compréhension du fonctionnement en temps réel sans exécuter de code. Les fonctionnalités d'extension COBOL et JCL permettent de résoudre les copybooks, les procédures, les symboles et les surcharges afin de présenter la logique telle qu'elle s'exécute réellement en production. Les chaînes de traitement par lots sont traçables de bout en bout, révélant quels programmes sont exécutés, dans quel ordre et avec quels paramètres.

Les diagrammes de flux de contrôle et les organigrammes traduisent une logique profondément imbriquée en représentations visuelles navigables. Ces vues permettent de comprendre le comportement d'exécution, d'identifier les chemins d'exécution bloqués ou inaccessibles et d'analyser la complexité des embranchements sans recourir à des connaissances empiriques ni à des analyses manuelles. Les diagrammes de suivi des champs étendent encore cette capacité en traçant la création, la transformation et la propagation des éléments de données à travers les programmes, les tâches et les bases de données, facilitant ainsi les modifications structurelles sécurisées et les audits réglementaires.

Recherche avancée, détection de modèles et analyse de précision

SMART TS XL Il intègre un moteur de recherche d'entreprise haute performance, optimisé pour les vastes bases de code multi-technologies. Il prend en charge la logique booléenne complexe, la recherche de proximité, la recherche par bloc, les expressions régulières, la gestion des synonymes et des filtres précis permettant de restreindre l'analyse à des langages, des types de données ou des sections de code spécifiques. Des techniques de recherche par couches permettent aux utilisateurs d'affiner progressivement les grands ensembles de résultats pour obtenir des résultats précis, adaptés aux analyses d'impact, aux audits ou aux évaluations de modernisation.

Ces fonctionnalités de recherche sont étroitement intégrées aux fonctions de références croisées, d'impact, de complexité et de visualisation. Les résultats peuvent être directement intégrés à des vues de dépendances, des rapports ou des flux d'analyse plus poussés, fluidifiant ainsi le passage de la découverte à la prise de décision. Les requêtes enregistrées et paramétrées permettent aux organisations de standardiser les contrôles de risques et les modèles d'analyse reproductibles entre les équipes et les projets.

Analyse de la complexité et quantification des risques

SMART TS XL Cette solution propose une analyse de la complexité au niveau du portefeuille, qui s'étend au-delà des programmes individuels. Des indicateurs de complexité tels que le nombre de lignes de code, la complexité cyclomatique et les mesures de Halstead peuvent être calculés sur des sous-ensembles ciblés d'applications, définis par les résultats de recherche ou les zones d'impact. Les équipes peuvent ainsi quantifier le risque technique au sein de fonctions métier spécifiques ou de candidats à la modernisation, plutôt que de se fier à des moyennes globales et générales.

En combinant les mesures de complexité avec l'analyse des dépendances et des impacts, SMART TS XL Elle permet une estimation et une priorisation plus réalistes des efforts. Les zones à forte interdépendance et à forte complexité peuvent être identifiées rapidement, ce qui permet de séquencer les initiatives de modernisation et de remédiation en fonction du risque structurel réel plutôt que d'hypothèses.

Transfert de connaissances, préparation à l'audit et soutien à la gouvernance

Un défi récurrent pour les grandes entreprises est la perte de connaissances institutionnelles liée au vieillissement des systèmes et au départ à la retraite ou à la rotation du personnel expérimenté. SMART TS XL Cette solution centralise les connaissances applicatives sur une plateforme consultable et explorable qui décrit la structure et le fonctionnement des systèmes. Documentation, rapports, diagrammes et éléments de preuve peuvent être générés et partagés pour faciliter l'intégration, les audits et répondre aux exigences réglementaires.

Les fonctionnalités d'exportation permettent de conditionner les résultats d'analyse sous forme de documents horodatés et prêts à servir de preuves, adaptés aux revues de conformité, aux approbations de changement et aux audits externes. Les contrôles d'accès et le suivi de l'utilisation répondent aux exigences de gouvernance, notamment dans les environnements de développement offshore ou de maintenance externalisée.

Adéquation au déploiement, à l'intégration et à l'exploitation

SMART TS XL Conçu pour un déploiement rapide et une interruption d'exploitation minimale, ce système s'installe en quelques heures grâce à des connecteurs permettant d'ingérer des données provenant d'environnements mainframe, de systèmes de contrôle de version distribués, de bases de données et de référentiels partagés. Il prend en charge les chargements de données complets et incrémentiels, garantissant ainsi la mise à jour des environnements sans intervention manuelle constante.

Les capacités d'automatisation permettent aux processus d'analyse de s'exécuter sans intervention humaine, favorisant ainsi la production continue d'informations pertinentes, en phase avec les cycles de changement de l'entreprise. En centralisant l'analyse sur une infrastructure rentable, les organisations peuvent réduire leur dépendance aux ressources de production coûteuses tout en améliorant la profondeur et la disponibilité des analyses pour l'ensemble des équipes.

SonarQube Enterprise Edition

SonarQube Enterprise Edition est une plateforme d'analyse statique de code conçue pour les grandes organisations de développement qui souhaitent garantir une application cohérente des normes de qualité, de maintenabilité et de sécurité du code dans leurs portefeuilles logiciels modernes. Son rôle principal au sein des environnements d'entreprise est d'agir comme une couche d'inspection continue intégrée aux flux de développement, fournissant un retour d'information précoce sur les problèmes de code avant la mise en production. Dans les portefeuilles où le débit d'analyse devient un goulot d'étranglement, elle est souvent utilisée en complément d'autres outils d'analyse statique de code. outils de révision de code formaliser le contrôle qualité et réduire les variations entre les équipes.

Contrairement aux plateformes d'analyse de portefeuille, la force de SonarQube réside dans sa capacité à s'intégrer au flux de travail des développeurs. L'analyse est généralement déclenchée lors des pipelines de compilation ou de la validation des demandes d'extraction, permettant ainsi aux équipes de détecter progressivement les anomalies de code, les bogues et les failles de sécurité au fur et à mesure de l'évolution du code. Cette approche est en phase avec les organisations qui standardisent les contrôles automatisés tout au long des pipelines de livraison, notamment selon les méthodes décrites dans… Pipelines CI / CD, où l'analyse statique devient un contrôle reproductible plutôt qu'une étape d'examen ponctuelle.

Analyse statique basée sur des règles et contrôles de qualité

Au cœur de SonarQube Enterprise Edition se trouve un moteur d'analyse statique basé sur des règles qui évalue le code source à l'aide d'un ensemble de règles vaste et configurable. Ces règles couvrent des catégories courantes telles que les problèmes de maintenabilité, les défauts de fiabilité et les vulnérabilités de sécurité. Les résultats sont classés par niveau de gravité et associés à des critères de qualité qui déterminent si le code peut être déployé dans le pipeline de livraison.

Les contrôles qualité constituent un mécanisme essentiel pour garantir le respect des normes organisationnelles à grande échelle. Les entreprises peuvent définir des seuils pour la couverture du nouveau code, la densité des défauts et l'exposition aux vulnérabilités, s'assurant ainsi que les modifications répondent à des critères prédéfinis avant leur intégration. Cette fonctionnalité est particulièrement précieuse dans les environnements comportant des équipes distribuées, du développement externalisé ou un fort taux de rotation des développeurs, où une application cohérente des normes réduit la dépendance aux revues manuelles.

Couverture linguistique et intégration de l'écosystème de développement

SonarQube prend en charge un large éventail de langages de programmation modernes, notamment Java, C#, JavaScript, TypeScript, Python et d'autres couramment utilisés dans le développement d'applications d'entreprise. Son écosystème de plugins et d'intégrations lui permet de se connecter aux plateformes CI/CD, aux systèmes de gestion de versions et aux outils de suivi des problèmes les plus populaires. Cette intégration étroite le rend particulièrement adapté aux organisations qui privilégient le contrôle qualité automatisé dans leurs processus de livraison.

Cependant, le modèle d'analyse de SonarQube est principalement axé sur la source et limité au référentiel. Bien qu'il puisse analyser plusieurs projets en parallèle, sa compréhension des relations entre les référentiels, les plateformes et les contextes d'exécution reste limitée. L'analyse se restreint généralement à des applications ou services individuels, plutôt qu'à l'ensemble des infrastructures d'entreprise avec des données partagées, des flux de travail par lots ou des dépendances multiplateformes.

Analyse de sécurité et soutien à la conformité

Dans ses éditions Entreprise, SonarQube intègre des fonctionnalités d'analyse de sécurité avancées, alignées sur les catégories de vulnérabilités courantes. Il peut identifier les schémas associés aux failles d'injection, aux configurations non sécurisées et à l'utilisation abusive des API. Les résultats sont présentés dans un format accessible aux développeurs et aux équipes de sécurité, facilitant ainsi les processus de correction au sein des outils existants.

Du point de vue de la conformité, SonarQube offre une traçabilité et des rapports permettant de démontrer le respect des normes de codage internes et des politiques de sécurité. Des rapports peuvent être générés pour illustrer l'évolution des problèmes, la progression de leur résolution et la conformité aux critères d'assurance qualité au fil du temps. Bien que ces fonctionnalités facilitent la préparation aux audits au sein des équipes de développement, elles sont moins axées sur la production de preuves au niveau système du comportement d'exécution ou de l'impact inter-systèmes.

Caractéristiques d'évolutivité et considérations opérationnelles

SonarQube Enterprise Edition est conçu pour s'adapter à un grand nombre de dépôts et d'équipes de développement, notamment dans des environnements distribués ou conteneurisés. Ses performances s'adaptent à l'infrastructure disponible, ce qui le rend idéal pour les organisations ayant des volumes de commits élevés et des cycles d'analyse fréquents. Des tableaux de bord centralisés offrent une visibilité globale sur les projets, permettant ainsi aux responsables de suivre les tendances qualité de manière stratégique.

Cela dit, la scalabilité de SonarQube est principalement horizontale, entre les projets, plutôt que verticale, face à la complexité du système. Il ne résout pas les problèmes liés aux chemins d'exécution, à la logique d'orchestration des traitements par lots, ni à la traçabilité des données sur des plateformes hétérogènes. Dans les environnements dominés par les charges de travail mainframe, la planification des traitements par lots ou les systèmes hérités fortement couplés, SonarQube est souvent utilisé comme outil complémentaire plutôt que comme source autonome d'informations architecturales.

Cas d'utilisation et limitations typiques en entreprise

SonarQube Enterprise Edition est particulièrement efficace dans les entreprises ayant une forte maturité DevOps, des environnements de développement standardisés et une priorité accordée à la prévention de la dégradation de la qualité du code en développement. Il excelle dans l'application des principes de cohérence, la réduction des anomalies de code et l'intégration des contrôles qualité dans les pipelines de livraison rapides.

Ses limites apparaissent plus clairement dans les scénarios de modernisation qui exigent de comprendre comment les changements se répercutent sur de vastes systèmes interconnectés. SonarQube ne modélise ni l'ordre d'exécution, ni la propagation des données entre les tâches et les plateformes, ni les chaînes de dépendances à l'échelle du système. C'est pourquoi il est souvent associé à des plateformes d'analyse plus poussées lorsque les entreprises doivent évaluer les risques liés à la modernisation, l'impact des traitements par lots ou les effets des changements sur l'ensemble de leur portefeuille.

Checkmarx Un

Checkmarx One est une plateforme de sécurité applicative destinée aux entreprises et axée sur les tests statiques de sécurité des applications au sein des pipelines de développement et de déploiement modernes. Son rôle principal dans les grandes organisations est d'identifier les vulnérabilités de sécurité dès les premières étapes du cycle de vie du logiciel, notamment dans les environnements où les mises à jour fréquentes, les équipes distribuées et les architectures cloud-native accroissent l'exposition aux failles exploitables. Plutôt que de modéliser le comportement d'exécution à l'échelle du système, Checkmarx One se concentre sur la détection des schémas de codage non sécurisés et des faiblesses de configuration conformes aux taxonomies de sécurité reconnues.

Cette plateforme est généralement adoptée par les entreprises dotées de pratiques DevSecOps éprouvées, où l'analyse de sécurité est intégrée au développement et non pas un simple contrôle a posteriori. Dans ces environnements, Checkmarx One agit comme un mécanisme préventif, visant à réduire le risque d'introduction de failles de sécurité dans les systèmes de production.

Tests de sécurité statiques des applications

Au cœur de Checkmarx One se trouve un moteur de test de sécurité statique des applications, optimisé pour détecter les vulnérabilités au niveau du code source. L'analyse est effectuée sans exécuter les applications, ce qui permet d'identifier les problèmes au plus tôt, souvent lors des phases de validation ou de compilation du code. La plateforme associe les résultats à des catégories de vulnérabilités connues, facilitant ainsi le travail des équipes de sécurité qui s'appuient sur des cadres de classification des risques standardisés, tels que… vulnérabilités OWASP prioriser les efforts de remédiation.

L'accent mis sur les failles de sécurité distingue Checkmarx One des outils d'analyse statique généralistes. Plutôt que de se concentrer sur la maintenabilité ou les problèmes d'architecture, la plateforme met l'accent sur les faiblesses susceptibles d'entraîner une fuite de données, un accès non autorisé ou une élévation de privilèges. Cette spécialisation la rend particulièrement pertinente dans les secteurs réglementés où la divulgation des vulnérabilités et les délais de correction sont étroitement surveillés.

Intégration aux pipelines DevSecOps d'entreprise

Checkmarx One est conçu pour s'intégrer parfaitement aux pipelines CI/CD et aux flux de travail des développeurs. Les analyses peuvent être déclenchées automatiquement lors des processus de compilation, des demandes d'extraction ou des validations de déploiement, garantissant ainsi une analyse de sécurité continue et sans intervention manuelle. Les résultats sont affichés sur des tableaux de bord et intégrés aux systèmes de suivi des problèmes, permettant ainsi de transmettre directement les conclusions aux équipes de développement pour correction.

Ce modèle opérationnel centré sur les pipelines favorise une grande rapidité de développement tout en garantissant un niveau de sécurité minimal. Cependant, l'accent mis sur les dépôts et services individuels limite généralement l'analyse à des bases de code distinctes. Bien que cela soit compatible avec les microservices et les architectures modulaires, cela restreint la visibilité sur les dépendances entre applications ou les chaînes d'exécution multiplateformes, fréquentes dans les systèmes d'entreprise à longue durée de vie.

Couverture linguistique et orientation cloud-native

Checkmarx One prend en charge un large éventail de langages de programmation et de frameworks modernes couramment utilisés dans le développement d'applications d'entreprise et cloud-native. Cette compatibilité étendue permet une analyse de sécurité cohérente au sein d'équipes de développement hétérogènes, sans nécessiter de multiples outils spécialisés. Le modèle de déploiement cloud-native de la plateforme simplifie davantage le déploiement et la mise à l'échelle, réduisant ainsi les coûts opérationnels pour les organisations gérant un grand nombre d'applications.

Cela dit, la prise en charge des technologies héritées et des environnements de traitement par lots est plus limitée. Les langages mainframe, les structures de contrôle des tâches et les flux de travail hérités étroitement liés ne font généralement pas partie du périmètre principal de la plateforme. Par conséquent, Checkmarx One est souvent déployé en complément d'autres outils d'analyse lorsque les entreprises doivent sécuriser à la fois des composants modernes et hérités au sein d'un même environnement applicatif.

Alignement des rapports de risques et de la gouvernance

Du point de vue de la gouvernance, Checkmarx One offre des fonctionnalités de reporting permettant le suivi des vulnérabilités, l'état de leur correction et la production de rapports de conformité. Les responsables de la sécurité peuvent ainsi surveiller les tendances au sein des applications, des équipes et sur différentes périodes, ce qui contribue à démontrer le respect des politiques internes et des exigences réglementaires externes. Les résultats peuvent être agrégés afin d'obtenir une vision globale du niveau de risque, facilitant ainsi la priorisation des actions au niveau du portefeuille.

Cependant, ces rapports se concentrent sur la présence de vulnérabilités plutôt que sur leur impact opérationnel. La plateforme ne cherche pas à quantifier la propagation d'une vulnérabilité à travers les chemins d'exécution ni son interaction avec le traitement par lots, les flux de données ou les systèmes en aval. Cette distinction est importante dans les entreprises où la compréhension de l'impact et du risque systémique est aussi cruciale que l'identification des faiblesses individuelles.

Cas d'utilisation et contraintes typiques en entreprise

Checkmarx One est particulièrement efficace pour les entreprises souhaitant intégrer des contrôles de sécurité directement dans leurs environnements de développement dynamiques. Il excelle dans l'identification précoce des problèmes de sécurité au niveau du code, réduisant ainsi les corrections et assurant une gestion cohérente des vulnérabilités pour un grand nombre de développeurs. Pour les organisations qui migrent vers des architectures cloud-native, il offre un mécanisme évolutif pour garantir une sécurité optimale.

Ses limites apparaissent dans les scénarios exigeant une compréhension globale du comportement des applications, des chaînes de dépendances ou de l'impact de la modernisation sur des systèmes hétérogènes. Dans ces cas, Checkmarx One se positionne généralement comme une couche de sécurité spécialisée plutôt que comme une plateforme d'analyse complète, venant compléter les outils axés sur l'analyse de l'exécution, la cartographie des dépendances et l'évaluation des risques structurels.

Fortifier l'analyseur de code statique

Fortify Static Code Analyzer est une plateforme de test de sécurité statique d'applications de niveau entreprise, conçue pour identifier les vulnérabilités de sécurité dans les environnements logiciels complexes et réglementés. Son rôle principal au sein des entreprises est d'assurer la détection systématique des schémas de codage susceptibles d'introduire des risques de sécurité, notamment dans les organisations où la conformité, l'auditabilité et les processus formels de gestion des risques encadrent la gouvernance des modifications logicielles. Fortify est couramment adopté dans les secteurs où l'assurance de sécurité doit être démontrable, reproductible et conforme aux contrôles d'entreprise établis.

Plutôt que de privilégier les boucles de rétroaction centrées sur les développeurs, Fortify est souvent présenté comme un contrôle de sécurité centralisé au sein de cadres de gouvernance plus larges. Il accompagne les organisations qui exigent une classification standardisée des vulnérabilités, des rapports cohérents et une traçabilité pour l'ensemble de leurs applications développées par des équipes distribuées ou des prestataires externes.

Moteur d'analyse statique axé sur la sécurité

Au cœur de Fortify Static Code Analyzer se trouve un moteur d'analyse de sécurité qui inspecte le code source pour identifier les vulnérabilités sans exécuter les applications. Ce moteur applique un ensemble complet de règles de sécurité conçues pour détecter les faiblesses telles que les injections de vulnérabilités, la gestion non sécurisée des données, les erreurs d'authentification et l'utilisation inappropriée des fonctions cryptographiques. Les résultats sont classés par gravité et par type, permettant ainsi aux équipes de sécurité d'évaluer les risques de manière structurée et cohérente.

L'accent mis sur la sécurité distingue Fortify des outils d'analyse statique généralistes. La profondeur d'analyse est optimisée pour identifier les failles exploitables plutôt que pour se concentrer sur la maintenabilité ou les problématiques architecturales. Cette spécialisation rend Fortify particulièrement adapté aux environnements où la détection des vulnérabilités prime sur la compréhension globale du système.

Alignement avec les programmes de gestion des risques et de conformité de l'entreprise

Fortify est fréquemment intégré aux programmes de sécurité et de gouvernance d'entreprise, où les risques logiciels sont gérés conjointement aux autres risques opérationnels et réglementaires. Ses fonctionnalités de reporting et de génération de preuves facilitent les audits internes, les évaluations externes et les contrôles réglementaires. Les résultats peuvent être agrégés pour l'ensemble des applications et des unités opérationnelles, offrant ainsi aux responsables de la sécurité une visibilité complète sur l'exposition aux risques.

Cet alignement avec le formel Gestion des risques informatiques Grâce à ses processus, Fortify est souvent choisi par les organisations qui doivent démontrer en permanence l'efficacité de leurs contrôles. Les rapports permettent de visualiser les tendances en matière de vulnérabilités, l'avancement des corrections et la conformité aux politiques de sécurité internes, facilitant ainsi une prise de décision éclairée lors des audits ou des analyses d'incidents.

Couverture linguistique et caractéristiques de déploiement

Fortify Static Code Analyzer prend en charge un large éventail de langages de programmation couramment utilisés en entreprise, incluant les technologies modernes et certaines technologies plus anciennes. Les organisations peuvent ainsi appliquer une approche d'analyse de sécurité cohérente à leurs équipes de développement et domaines technologiques respectifs. Les modèles de déploiement varient : Fortify est souvent installé sur site ou au sein d'environnements d'entreprise contrôlés afin de répondre aux exigences de résidence et de sécurité des données.

Cependant, l'analyse est généralement effectuée au niveau de l'application ou du projet. Bien que Fortify puisse s'adapter à de nombreuses applications, il ne prend pas en charge l'ordre d'exécution, l'orchestration des traitements par lots ni les flux de données inter-applications. Par conséquent, son analyse des risques reste limitée aux artefacts de code et ne porte pas sur le comportement global du système.

Intégration dans les cycles de vie de développement sécurisés

Fortify est généralement intégré aux cycles de développement sécurisés comme mécanisme de contrôle plutôt que comme outil d'exploration continue. Les analyses peuvent être déclenchées à des étapes définies, telles que les revues de pré-lancement, les fenêtres de changement majeures ou les points de contrôle de conformité. Ce modèle opérationnel convient aux organisations qui privilégient les processus de déploiement contrôlés et les approbations formelles au déploiement continu.

Bien que des intégrations avec les outils CI/CD soient disponibles, Fortify privilégie généralement un équilibre entre automatisation et supervision centralisée. Les anomalies de sécurité sont analysées par des équipes spécialisées qui évaluent les mesures correctives nécessaires et les décisions d'acceptation des risques, garantissant ainsi la cohérence de la gouvernance à l'échelle de l'entreprise.

Cas d'utilisation et contraintes typiques en entreprise

Fortify Static Code Analyzer est particulièrement efficace dans les entreprises où la sécurité, la préparation aux audits et la conformité réglementaire sont des priorités absolues. Il offre une approche structurée et rigoureuse pour identifier les vulnérabilités de sécurité au niveau du code et démontrer la mise en place de contrôles permettant de les détecter et de les corriger.

Ses limites apparaissent clairement dans les scénarios nécessitant de comprendre comment les vulnérabilités interagissent avec le comportement d'exécution, le traitement par lots ou les dépendances multiplateformes. Fortify ne modélise ni le comportement d'exécution ni l'impact à l'échelle du système et est souvent complété par des outils offrant une analyse plus approfondie de la structure des applications, des chaînes de dépendances et des risques liés à la modernisation dans des environnements hétérogènes.

Temps forts du casting

CAST Highlight est une plateforme d'analyse et d'évaluation de portefeuilles d'applications d'entreprise, conçue pour offrir une visibilité globale sur la qualité logicielle, les risques et l'état de préparation à la modernisation des vastes parcs applicatifs. Son rôle principal au sein des environnements d'entreprise est d'appuyer la prise de décision stratégique en synthétisant les caractéristiques structurelles, les indicateurs de dette technique et les signaux d'adéquation au cloud, plutôt qu'en effectuant une analyse approfondie du code axée sur l'exécution. CAST Highlight est souvent adopté dès les premières phases des programmes de modernisation afin d'établir un état des lieux de l'état du portefeuille.

Contrairement aux outils d'analyse statique destinés aux développeurs, CAST Highlight fonctionne à un niveau agrégé. Il vise à aider les architectes, les gestionnaires de portefeuille et les responsables de la transformation à comparer les applications, à identifier les candidats à la modernisation et à prioriser les efforts de correction sur des centaines, voire des milliers de systèmes.

Analyse au niveau du portefeuille et intelligence logicielle

Au cœur de CAST Highlight se trouve un moteur d'analyse léger qui extrait les métadonnées structurelles du code source et des artefacts de configuration des applications. Ces données sont normalisées dans un modèle analytique commun, permettant ainsi d'évaluer diverses applications selon des critères cohérents. Les indicateurs relatifs à la qualité du code, à la maintenabilité, à la vulnérabilité et à l'adéquation architecturale sont calculés et présentés via des tableaux de bord et des vues comparatives.

Ces capacités s'inscrivent dans un cadre plus large intelligence logicielle CAST Highlight est une initiative visant à transformer le code brut en informations exploitables pour les parties prenantes non-développeuses. En simplifiant la complexité grâce à des indicateurs standardisés, CAST Highlight permet aux équipes dirigeantes d'analyser des portefeuilles de code importants sans avoir à procéder à une inspection détaillée.

Évaluation de l'état de préparation à la modernisation et de l'adéquation au cloud

CAST Highlight met l'accent sur l'évaluation des applications en vue de leur modernisation et de leur migration vers le cloud. Il analyse des facteurs tels que l'utilisation de frameworks, les modèles de dépendances et l'actualité technologique afin d'estimer l'effort et les risques liés à la migration des applications vers des plateformes modernes. Les résultats permettent souvent de classer les applications en différentes catégories : réhébergement, refactorisation, remplacement ou mise hors service.

Cette approche axée sur l'évaluation facilite la planification et la budgétisation en amont. Les entreprises peuvent exploiter les résultats de CAST Highlight pour élaborer des feuilles de route de modernisation, estimer la portée de la transformation et communiquer les profils de risque aux parties prenantes. Toutefois, l'analyse est volontairement générale et ne vise pas à modéliser en détail le comportement d'exécution ni les effets secondaires de la transformation.

Indicateurs de sécurité et de dette technique

Outre les signaux de modernisation, CAST Highlight fournit des indicateurs clés relatifs aux failles de sécurité et à la dette technique. Ces indicateurs s'appuient sur des schémas connus associés à une augmentation des coûts de maintenance ou à une exposition accrue aux vulnérabilités. L'objectif n'est pas de remplacer les outils d'analyse de sécurité dédiés, mais de mettre en évidence les domaines nécessitant une investigation plus approfondie.

Les résultats étant agrégés, ils se prêtent davantage à l'analyse comparative qu'à la planification des mesures correctives. Les indicateurs de sécurité et d'endettement aident les organisations à comprendre la répartition des risques relatifs au sein de leurs portefeuilles, mais ils n'identifient pas les chemins d'exécution, les flux de données ni les dépendances opérationnelles spécifiques qui seraient affectés par des modifications du code.

Modèle d'évolutivité et opérationnel

CAST Highlight est conçu pour s'adapter efficacement aux très grands portefeuilles d'applications. Son approche d'analyse légère minimise la charge de traitement et permet une intégration rapide des nouvelles applications. Il est ainsi particulièrement adapté aux entreprises réalisant des analyses approfondies de leur parc logiciel lors de fusions, de cessions ou d'initiatives de modernisation initiales.

Cette évolutivité a pour contrepartie une analyse moins poussée. CAST Highlight ne prend pas en charge les graphes d'appels, les chaînes d'exécution par lots ni la propagation des données entre plateformes. Par conséquent, il est souvent utilisé conjointement avec des outils d'analyse plus approfondis lorsque des applications ou des projets de transformation spécifiques passent de la phase de planification à la phase d'exécution.

Cas d'utilisation et contraintes typiques en entreprise

CAST Highlight est particulièrement efficace pour les entreprises qui ont besoin d'une vue comparative globale de leurs portefeuilles d'applications afin d'appuyer leur planification stratégique. Il excelle dans l'identification des applications à moderniser, l'estimation de la complexité de la transformation et la communication des risques techniques aux parties prenantes non techniques.

Ses limites apparaissent clairement lorsque les organisations ont besoin de comprendre précisément l'impact des modifications sur le comportement d'exécution, les chaînes de dépendances ou la stabilité opérationnelle. CAST Highlight ne fournit pas la visibilité au niveau de l'exécution nécessaire pour mener à bien des activités de refactorisation ou de modernisation en toute sécurité, et il est généralement complété par des outils axés sur l'analyse d'impact détaillée et la visibilité comportementale au sein d'applications sélectionnées.

Imagerie CAST

CAST Imaging est une plateforme d'intelligence applicative d'entreprise axée sur l'analyse architecturale et la visualisation des dépendances structurelles au sein de systèmes logiciels complexes. Son rôle principal dans les grandes organisations est de révéler comment les applications sont assemblées, comment les composants interagissent et où le couplage structurel engendre des risques. CAST Imaging est généralement utilisé par les architectes et les équipes de modernisation qui ont besoin d'une compréhension globale de la structure applicative avant de planifier des initiatives de refactorisation, de migration ou de décomposition.

Plutôt que de fonctionner comme un outil d'inspection de code ou d'analyse de sécurité, CAST Imaging privilégie la compréhension architecturale. Il transforme le code source et les artefacts de configuration en modèles navigables qui illustrent les relations entre les composants, les couches et les technologies, permettant ainsi aux parties prenantes d'appréhender la complexité à grande échelle.

Cartographie architecturale et visualisation des dépendances

Au cœur de CAST Imaging réside sa capacité à générer des représentations architecturales détaillées des applications et des portefeuilles d'applications. Ces représentations comprennent des diagrammes de composants, des cartes d'interaction et des vues en couches qui révèlent comment les modules communiquent et dépendent les uns des autres. En visualisant les relations structurelles, CAST Imaging permet aux équipes d'identifier les couplages forts, les dépendances circulaires et les violations architecturales difficiles à détecter par une analyse au niveau des fichiers.

Ces modèles visuels correspondent étroitement aux pratiques centrées sur graphes de dépendanceDans les systèmes complexes, la compréhension des interconnexions structurelles est essentielle à la gestion des risques. CAST Imaging permet aux utilisateurs d'explorer ces dépendances de manière interactive, en passant, selon les besoins, de vues architecturales de haut niveau à des représentations plus détaillées.

Couverture multi-technologique et inter-applications

CAST Imaging prend en charge l'analyse d'un large éventail de langages de programmation, de frameworks et de plateformes couramment utilisés en entreprise. Cette polyvalence lui permet de modéliser des systèmes hétérogènes composés de composants existants, de services distribués et de bases de données partagées. Ses capacités d'analyse inter-applications permettent aux équipes de comprendre comment chaque système s'intègre dans un portefeuille plus vaste et comment les modifications apportées à une application peuvent impacter les autres.

Cependant, l'analyse reste structurelle plutôt que comportementale. CAST Imaging modélise les relations statiques entre les composants, mais ne simule ni l'ordre d'exécution, ni les conditions d'exécution, ni la logique de planification par lots. Par conséquent, elle permet de comprendre comment les systèmes sont connectés, mais pas nécessairement comment ils se comportent lors de l'exécution.

Soutien à la modernisation et à la gouvernance architecturale

CAST Imaging est fréquemment utilisé pour accompagner les initiatives de modernisation où la clarté architecturale est une condition préalable au changement. En révélant les violations des principes architecturaux et en identifiant les zones de couplage excessif, il aide les équipes à planifier des stratégies de transformation progressive. Ces informations peuvent éclairer les décisions relatives à l'extraction de services, à la refonte des interfaces ou aux approches de migration par étapes.

Dans le cadre de la gouvernance, CAST Imaging permet également d'évaluer la conformité architecturale aux normes définies. Les écarts par rapport aux architectures cibles peuvent être identifiés et documentés, facilitant ainsi la supervision et la planification des actions correctives. Cet outil s'avère donc précieux pour les organisations qui intègrent des contrôles architecturaux à leurs processus de gestion du changement.

Considérations relatives à l'évolutivité et à la modélisation de portefeuille

La plateforme est conçue pour s'adapter aux applications et portefeuilles de grande envergure, en générant des modèles architecturaux partageables entre les parties prenantes. Son approche axée sur la visualisation favorise l'analyse collaborative et la communication, notamment pour expliquer des structures complexes à un public non développeur.

Cette évolutivité a pour contrepartie une visibilité limitée sur la dynamique opérationnelle. CAST Imaging ne permet pas de retracer la provenance des données au niveau des champs, de suivre les flux d'exécution des lots ni de quantifier l'impact des modifications en temps réel. Pour les projets nécessitant une évaluation précise de l'impact des modifications ou une validation du comportement d'exécution, des outils d'analyse supplémentaires sont généralement requis.

Cas d'utilisation et contraintes typiques en entreprise

CAST Imaging est particulièrement efficace dans les entreprises qui doivent comprendre et rationaliser l'architecture de leurs applications avant d'entreprendre des changements importants. Il excelle dans la mise en évidence de la complexité structurelle, l'accompagnement de la refonte architecturale et le soutien à la planification de la modernisation des systèmes hétérogènes.

Ses limites deviennent évidentes lorsque les organisations ont besoin d'une visibilité au niveau de l'exécution, d'une évaluation d'impact ou d'une validation de la propagation des modifications à travers le comportement en cours d'exécution. CAST Imaging fournit une cartographie structurelle plutôt qu'un plan opérationnel, et est souvent complété par des outils offrant une analyse plus approfondie des chemins d'exécution, des flux de données et du comportement du système.

Analyse statique de Veracode

Veracode Static Analysis est une plateforme de test de sécurité statique d'applications native du cloud, conçue pour intégrer les contrôles de sécurité directement dans les processus modernes de livraison de logiciels. Son rôle principal en entreprise est d'identifier les vulnérabilités de sécurité de manière précoce et continue dans de grands volumes de code applicatif, notamment au sein des organisations qui privilégient des cycles de publication rapides, des équipes de développement distribuées et une supervision centralisée de la sécurité. Veracode est couramment adopté lorsque l'assurance de la sécurité doit évoluer sans impacter la vitesse de développement.

La plateforme privilégie l'automatisation et la cohérence, faisant de l'analyse statique un contrôle de sécurité permanent plutôt qu'une activité d'examen périodique. Ce modèle opérationnel s'inscrit dans la stratégie des entreprises ayant standardisé leurs outils de développement sur le cloud et exigeant une visibilité centralisée sur la sécurité des applications au sein de leurs différentes équipes et projets.

Tests de sécurité des applications statiques natives du cloud

Au cœur de Veracode Static Analysis se trouve un moteur d'analyse de sécurité statique entièrement fourni en tant que service cloud géré. Le code source et les binaires sont téléchargés pour analyse, où ils sont inspectés afin de détecter les vulnérabilités telles que les failles d'injection, la gestion non sécurisée des données et les faiblesses d'authentification. L'analyse ne nécessite aucun accès aux environnements de production, ce qui permet de réaliser des évaluations de sécurité dès les premières étapes du cycle de vie, sans risque opérationnel.

Cette approche native du cloud permet une intégration rapide et une mise à l'échelle flexible pour les grands portefeuilles d'applications. Les entreprises peuvent appliquer des politiques d'analyse de sécurité cohérentes à des centaines d'applications sans avoir à gérer d'infrastructure sur site. Les résultats sont normalisés et présentés via des tableaux de bord centralisés, facilitant ainsi le travail des équipes de sécurité chargées de la supervision des risques à l'échelle de l'entreprise.

Intégration dans les pipelines de livraison continue

Veracode est conçu pour s'intégrer parfaitement aux pipelines CI/CD et aux outils de développement. Les analyses peuvent être déclenchées automatiquement lors des phases de compilation ou de déploiement, et les résultats sont renvoyés dans des formats compatibles avec les processus de suivi et de correction des problèmes. Ceci favorise un modèle de sécurité « shift-left » où les vulnérabilités sont traitées au plus près de leur point d'introduction.

En pratique, le rôle de Veracode au sein des pipelines est souvent coordonné avec des contrôles de qualité et de test plus larges, incluant des activités telles que : tests de régression des performances, afin de garantir que la mise en œuvre des mesures de sécurité ne soit pas dissociée des autres exigences non fonctionnelles. Cet alignement permet aux organisations de concilier rigueur en matière de sécurité et performance opérationnelle.

Couverture linguistique et cohérence du portefeuille

L'analyse statique de Veracode prend en charge un large éventail de langages de programmation et de frameworks modernes couramment utilisés dans le développement d'applications d'entreprise. Cette compatibilité étendue permet aux équipes de sécurité d'appliquer des politiques d'analyse uniformes sur des environnements de développement hétérogènes, réduisant ainsi les risques de failles entre équipes ou plateformes.

Cependant, la plateforme reste axée sur l'analyse de sécurité au niveau applicatif. L'analyse se limite généralement à des applications ou services individuels, et les relations entre applications, les traitements par lots ou les structures de données partagées ne sont pas modélisées. Par conséquent, Veracode offre une couverture étendue des vulnérabilités au niveau du code, mais une visibilité limitée sur la manière dont ces vulnérabilités peuvent se propager à travers des systèmes interconnectés.

Visibilité des rapports de risques et de la gouvernance

Veracode offre des fonctionnalités de reporting permettant aux responsables de la sécurité de suivre les tendances en matière de vulnérabilités, l'avancement des corrections et la conformité aux politiques de sécurité à l'échelle de l'entreprise. Des tableaux de bord permettent d'obtenir une vue d'ensemble de l'exposition aux risques, facilitant ainsi la priorisation en fonction de leur gravité et de leur impact sur l'activité. Ces rapports sont fréquemment utilisés pour appuyer la gouvernance de la sécurité interne, les rapports de direction et les activités d'assurance menées par des tiers.

Bien que ces fonctionnalités favorisent la responsabilisation et le contrôle, les rapports restent axés sur les vulnérabilités. Veracode ne cherche pas à quantifier l'impact opérationnel, les perturbations des flux d'exécution ni les risques de modernisation liés aux efforts de correction. Cette distinction est importante dans les environnements où les modifications de sécurité doivent être évaluées en tenant compte de la stabilité et des impératifs de gestion du changement.

Cas d'utilisation et contraintes typiques en entreprise

L'analyse statique Veracode est particulièrement efficace dans les entreprises à forte cadence de déploiement qui exigent une analyse de sécurité centralisée et évolutive de leurs applications modernes. Elle excelle dans l'application de normes de sécurité cohérentes, la réduction du délai de détection des vulnérabilités et la prise en charge des modèles opérationnels DevSecOps.

Ses limites se manifestent dans les scénarios exigeant une compréhension approfondie du comportement du système, des dépendances entre applications ou du traitement par lots traditionnel. Veracode ne fournit pas d'informations au niveau de l'exécution ni de cartographie des dépendances architecturales ; il est généralement positionné comme une couche de sécurité spécialisée, complétée par des outils axés sur l'analyse d'impact, la visibilité des dépendances et la compréhension des systèmes à l'échelle de l'entreprise.

Coverity (Synopsis)

Coverity est une plateforme d'analyse statique de code d'entreprise reconnue pour sa capacité à détecter des défauts complexes dans des bases de code volumineuses et critiques en termes de performances. Son rôle principal au sein des environnements d'entreprise est d'identifier les problèmes de correction et de fiabilité profonds, difficiles à déceler par les seuls tests, notamment dans les systèmes où une défaillance a des conséquences opérationnelles, de sécurité ou financières importantes. Coverity est fréquemment adopté dans des secteurs tels que l'automobile, l'aérospatiale, les télécommunications et les logiciels d'infrastructure, où la précision de la détection des défauts et un faible taux de faux positifs sont essentiels.

Contrairement aux plateformes d'analyse de portefeuille, Coverity se concentre sur la correction du code source au sein de vastes bases de code. Conçu pour analyser efficacement de grands volumes de code source tout en maintenant un haut niveau de rigueur analytique, il convient parfaitement aux organisations gérant des systèmes à longue durée de vie avec des exigences de fiabilité strictes.

Détection approfondie des défauts et analyse de précision

Au cœur de Coverity se trouve un moteur d'analyse statique optimisé pour détecter les défauts tels que la corruption de mémoire, les fuites de ressources, les problèmes de concurrence et les erreurs logiques. Ce moteur est reconnu pour sa capacité à appréhender des chemins de contrôle et des scénarios d'exécution complexes s'étendant sur plusieurs fonctions et modules. Cette analyse approfondie lui permet d'identifier des défauts susceptibles de ne se manifester que dans des conditions d'exécution spécifiques.

L'approche analytique de Coverity intègre des techniques avancées liées à exécution symboliqueCette capacité lui permet d'explorer plusieurs chemins d'exécution sans exécuter le code. Elle contribue à sa réputation de grande précision et permet de réduire le bruit souvent associé aux analyses statiques à grande échelle dans les environnements d'entreprise.

Priorité à la langue et couverture ciblée

Coverity offre une prise en charge performante des langages couramment utilisés dans les logiciels système et critiques en termes de performances, notamment C, C++ et Java. Cette spécialisation le rend particulièrement efficace pour l'analyse des composants d'infrastructure essentiels, des systèmes embarqués et des services backend, où les défauts de bas niveau peuvent avoir des conséquences importantes.

Bien que la plateforme puisse gérer des bases de code importantes, sa couverture linguistique est plus restreinte que celle de certains outils d'analyse statique généralistes. Elle est moins adaptée aux environnements d'entreprise hétérogènes comprenant des langages de traitement par lots, des environnements de script ou des technologies spécifiques aux mainframes. Par conséquent, Coverity est souvent déployé de manière sélective au sein des portefeuilles, en ciblant les composants où la précision de la détection des défauts est primordiale.

Intégration dans les flux de travail de développement d'entreprise

Coverity est conçu pour s'intégrer aux processus de développement d'entreprise, notamment aux pipelines CI/CD et aux systèmes centralisés de gestion des anomalies. Les analyses peuvent être planifiées ou déclenchées automatiquement, et les résultats sont transmis aux équipes de développement pour correction. La plateforme prend en charge l'analyse incrémentale, permettant aux équipes de se concentrer sur les nouveaux problèmes tout en conservant la visibilité sur les anomalies en attente.

Dans de nombreuses organisations, Coverity est perçu comme un outil de contrôle qualité plutôt que comme un outil d'exploration continue. Ses analyses sont généralement effectuées à des étapes clés, par exemple avant les mises en production majeures ou lors de revues qualité formelles. Ce mode d'utilisation reflète son rôle dans le respect des normes de fiabilité plutôt que dans le soutien à l'itération rapide.

Caractéristiques d'évolutivité et de performance

Coverity est conçu pour gérer efficacement de très grandes bases de code, ce qui le rend idéal pour les entreprises possédant des millions de lignes de code critique. Ses performances s'adaptent à l'infrastructure disponible, permettant ainsi aux organisations d'analyser des systèmes importants sans délais d'analyse prohibitifs. Des tableaux de bord centralisés offrent une visibilité sur les tendances des défauts et l'avancement de leur correction dans l'ensemble des projets.

Cependant, la scalabilité de Coverity est axée sur le volume de code plutôt que sur la complexité du système. Elle ne cherche pas à modéliser les dépendances entre applications, l'ordre d'exécution des lots ni la traçabilité des données entre les plateformes. Ses analyses restent centrées sur la détection des défauts au sein de chaque base de code, et non sur le comportement global du système.

Cas d'utilisation et contraintes typiques en entreprise

Coverity est particulièrement efficace dans les entreprises exigeant une détection fiable des défauts dans leurs composants logiciels critiques. Il excelle dans l'identification de problèmes subtils susceptibles d'entraîner des plantages, des failles de sécurité ou des comportements imprévisibles en production, notamment dans le code de bas niveau ou sensible aux performances.

Ses limites deviennent évidentes lors d'initiatives de modernisation ou de transformation nécessitant de comprendre l'impact des changements sur les systèmes interconnectés. Coverity ne propose ni cartographie des dépendances architecturales ni analyse d'impact au niveau de l'exécution ; il est généralement complété par des outils axés sur la visibilité du portefeuille, l'analyse des dépendances et la compréhension des comportements au sein d'environnements d'entreprise hétérogènes.

Parasoft C/C++test et PAO

Parasoft C/C++test et sa plateforme de tests de développement (DTP) constituent une solution d'analyse statique et de tests de conformité de niveau entreprise, conçue pour les environnements logiciels critiques et hautement réglementés. Au sein des grandes organisations, son rôle principal est de garantir une vérification rigoureuse du code système, là où les défauts peuvent entraîner des défaillances opérationnelles, des non-conformités réglementaires ou des incidents de sécurité. Parasoft est couramment utilisé dans des secteurs tels que l'aérospatiale, l'automobile, la défense et les systèmes industriels, où le comportement des logiciels doit être prouvé correct et auditable.

Contrairement aux outils d'analyse statique généralistes, Parasoft privilégie la conformité aux normes définies et aux objectifs de vérification. La plateforme est conçue pour les environnements où le développement est régi par des processus formels, des exigences de certification et des dossiers d'assurance qualité documentés, plutôt que par des itérations rapides.

Analyse statique axée sur les normes et application de la conformité

Au cœur de Parasoft C/C++test se trouve un moteur d'analyse statique conforme aux normes de sécurité et de codage du secteur, telles que MISRA, CERT et les directives ISO. Ce moteur évalue le code source en fonction d'ensembles de règles strictes définissant les constructions acceptables, les modèles d'utilisation et les conditions d'erreur. Les violations sont classées par gravité et directement associées aux exigences de conformité, permettant ainsi aux organisations de démontrer leur respect des pratiques de développement obligatoires.

Cette approche fondée sur des normes s'aligne sur les environnements qui s'appuient sur vérification formelle Les concepts de correction sont définis non seulement par le comportement fonctionnel, mais aussi par la conformité aux règles établies. Les résultats d'analyse de Parasoft peuvent servir de preuves dans les processus de certification et d'audit, réduisant ainsi les efforts de vérification manuelle.

Soutien linguistique ciblé et analyse approfondie

Parasoft C/C++test est spécifiquement optimisé pour les bases de code C et C++, offrant des capacités d'analyse approfondie pour les langages couramment utilisés dans les logiciels embarqués et système. Cette spécialisation permet à la plateforme d'identifier des problèmes de bas niveau tels que les erreurs de mémoire, les erreurs de pointeurs et les défauts de concurrence, qui peuvent s'avérer particulièrement dangereux dans les contextes critiques pour la sécurité.

Bien que cette expertise soit précieuse dans son domaine cible, elle limite également l'applicabilité de la plateforme à des environnements d'entreprise plus vastes. Parasoft ne vise pas une couverture étendue des différents langages, environnements de traitement par lots ou systèmes mainframe existants. Par conséquent, elle est généralement déployée sur des segments ciblés d'un portefeuille d'entreprise plutôt que comme solution d'analyse universelle.

Intégration aux cycles de vie de développement réglementés

Parasoft est conçu pour s'intégrer aux cycles de développement structurés qui privilégient la traçabilité, la documentation et la gestion des modifications. Les résultats d'analyse statique peuvent être liés aux exigences, aux cas de test et aux systèmes de suivi des anomalies via le composant DTP, permettant ainsi une traçabilité complète, de la spécification à la vérification.

Cette intégration prend en charge les modèles de développement où les modifications sont introduites de manière délibérée et font l'objet d'un examen formel. L'analyse est généralement effectuée à des étapes clés définies, comme avant les soumissions de certification ou les mises en production majeures, plutôt qu'en continu à chaque modification. Ce modèle opérationnel reflète les priorités des environnements réglementés, où la prévisibilité et la fiabilité priment sur la rapidité.

Rapports, traçabilité et préparation aux audits

La plateforme de tests de développement centralise les rapports et les analyses pour l'ensemble des projets et des équipes. Les indicateurs relatifs à la conformité, aux tendances des anomalies et à la couverture des vérifications peuvent être agrégés et analysés par les responsables de l'assurance qualité et de la conformité. Les rapports sont structurés pour faciliter les activités d'audit et de certification, en fournissant une documentation détaillée sur l'exécution et les résultats des analyses.

Cependant, ces rapports se concentrent sur la conformité au niveau du code plutôt que sur le comportement global du système. Parasoft ne modélise pas les chemins d'exécution entre les applications, l'orchestration par lots ni les dépendances multiplateformes. Sa traçabilité est axée sur les exigences et les normes plutôt que sur l'interaction d'exécution entre les composants.

Cas d'utilisation et contraintes typiques en entreprise

Les outils de test et de PAO Parasoft C/C++ sont particulièrement efficaces dans les entreprises où la sécurité, la fiabilité et la conformité réglementaire sont des priorités absolues. Ils offrent un cadre rigoureux pour vérifier que le code critique respecte des normes strictes et résiste à un examen formel.

Leurs limites se manifestent dans les environnements exigeant une compréhension globale des grands systèmes interconnectés ou la prise en charge de technologies hétérogènes. Parasoft n'est pas conçu pour offrir une visibilité à l'échelle du portefeuille ni une analyse d'impact axée sur l'exécution ; il est souvent complété par des outils qui se concentrent sur les dépendances architecturales, les risques liés à la modernisation et le comportement des systèmes au sein d'environnements d'entreprise complexes.

Klocwork

Klocwork est une plateforme d'analyse statique de code d'entreprise, conçue pour identifier les failles de sécurité, de fiabilité et de concurrence dans les vastes bases de code complexes. Son rôle principal au sein des environnements d'entreprise est de détecter les problèmes susceptibles de compromettre la stabilité ou la sécurité du système, notamment dans les logiciels fonctionnant sous forte charge, en exécution parallèle ou dans des conditions d'exécution contraintes. Klocwork est couramment utilisé dans les secteurs où performance et fiabilité sont étroitement liées, tels que les télécommunications, les systèmes embarqués, les infrastructures financières et les services backend à grande échelle.

La plateforme met l'accent sur la détection précoce des défauts grâce à l'analyse statique, permettant ainsi aux organisations d'identifier les schémas problématiques avant qu'ils ne se traduisent par des défaillances en production. Klocwork est généralement positionné comme un outil d'assurance qualité et de sécurité plutôt que comme une solution d'analyse globale du portefeuille.

Analyse statique axée sur la concurrence et la fiabilité

Au cœur de Klocwork se trouve un moteur d'analyse statique conçu pour identifier les défauts résultant de scénarios d'exécution complexes. Cela inclut les problèmes liés à la gestion de la mémoire, à la gestion des ressources et à la synchronisation. Ce moteur est particulièrement efficace pour détecter les défauts associés à l'exécution parallèle, où des interactions subtiles entre les threads peuvent engendrer un comportement imprévisible.

Sa capacité à analyser les chemins d'exécution concurrents rend Klocwork pertinent dans les environnements où les logiciels doivent fonctionner de manière fiable sous charge. Les résultats d'analyse révèlent souvent des problèmes de blocage, des conditions de concurrence et des erreurs de synchronisation. Ces fonctionnalités aident les organisations à réduire l'instabilité causée par des défauts de concurrence difficiles à reproduire, tels que : conditions de course.

Domaines axés sur la langue et la performance

Klocwork offre une prise en charge performante des langages couramment utilisés dans les logiciels système et critiques en termes de performances, notamment C, C++ et Java. Cette spécialisation explique son adoption dans les domaines où la correction de bas niveau et l'efficacité d'exécution sont essentielles. En se concentrant sur un ensemble plus restreint de langages, la plateforme propose une analyse plus approfondie pour ces environnements que les outils plus généralistes.

Toutefois, cette spécialisation limite également son applicabilité aux environnements d'entreprise hétérogènes. Klocwork n'est pas conçu pour analyser les charges de travail par lots, les langages mainframe ou les environnements de script de haut niveau, pourtant courants dans les systèmes d'entreprise à longue durée de vie. De ce fait, il est souvent déployé de manière sélective plutôt que comme solution d'analyse universelle.

Intégration dans les flux de travail de qualité et de sécurité de l'entreprise

Klocwork s'intègre aux flux de travail de développement d'entreprise, notamment aux pipelines CI/CD et aux systèmes de suivi des anomalies. Les analyses peuvent être automatisées et les résultats transmis aux équipes de développement pour correction. La plateforme prend en charge l'analyse incrémentale, permettant aux équipes de se concentrer sur les nouveaux problèmes tout en conservant la visibilité sur les anomalies existantes.

Dans de nombreuses organisations, Klocwork est utilisé dans le cadre de processus d'assurance qualité formels. L'analyse peut être déclenchée à des étapes clés telles que la validation avant mise en production ou les refontes majeures. Ce mode d'utilisation reflète son rôle dans la garantie de la fiabilité et de la sécurité plutôt que dans le soutien à l'exploration architecturale continue.

Caractéristiques d'évolutivité et étendue opérationnelle

Klocwork est conçu pour s'adapter aux vastes bases de code, permettant l'analyse de systèmes importants sans impact excessif sur les performances. Des tableaux de bord centralisés offrent une visibilité sur les tendances des anomalies et l'avancement de leur correction dans l'ensemble des projets. Ces vues facilitent le pilotage par la direction et aident les équipes à prioriser les actions correctives en fonction de leur gravité et de leur impact.

Malgré sa capacité d'adaptation au volume de code, la portée analytique de Klocwork reste limitée aux applications ou composants individuels. Il ne modélise pas les dépendances entre applications, l'ordre d'exécution des lots ni la traçabilité des données entre les plateformes. Ses analyses portent sur la correction du code plutôt que sur le comportement global du système.

Cas d'utilisation et contraintes typiques en entreprise

Klocwork est particulièrement efficace dans les entreprises qui exigent une détection fiable des défauts de concurrence et de fiabilité dans les logiciels critiques. Il excelle dans la mise au jour de problèmes difficiles à reproduire par des tests et susceptibles d'entraîner des pannes intermittentes ou catastrophiques en production.

Ses limites apparaissent clairement lors d'initiatives de transformation exigeant une compréhension globale des portefeuilles d'applications, des flux d'exécution ou de l'impact de la modernisation. Klocwork ne propose ni cartographie des dépendances architecturales ni analyse d'impact au niveau de l'exécution ; il est généralement complété par des outils axés sur une compréhension systémique plus large et une évaluation des risques liés aux changements dans des environnements d'entreprise hétérogènes.

Analyse statique du cloud DevOps d'OpenText

OpenText DevOps Cloud Static Analysis est une solution d'analyse statique d'entreprise intégrée à une suite DevOps et de gestion du cycle de vie des applications. Au sein des grandes organisations, son rôle principal est de fournir des contrôles standardisés de la qualité et de la sécurité du code, conformes aux modèles de gouvernance de déploiement établis. Plutôt que de fonctionner comme une plateforme d'analyse approfondie autonome, elle est généralement adoptée par les entreprises qui privilégient la consolidation de leur chaîne d'outils et la supervision centralisée des processus de développement, de test et de mise en production.

Cette plateforme est principalement utilisée dans les environnements où la livraison de logiciels doit respecter des contrôles formels et où l'intégration avec les outils ALM, de test et de gestion des versions existants est essentielle. Sa valeur réside dans la cohérence et l'alignement de la gouvernance plutôt que dans une analyse comportementale ou architecturale approfondie.

Capacités d'analyse statique orientées suite

OpenText DevOps Cloud Static Analysis propose une inspection du code source basée sur des règles afin d'identifier les problèmes de qualité et les failles de sécurité. L'analyse se concentre sur les catégories de défauts courants, les violations des normes de codage et les schémas de vulnérabilité détectables sans exécuter l'application. Les résultats sont normalisés et présentés sur des tableaux de bord centralisés, associés à d'autres indicateurs DevOps.

Cette approche modulaire permet aux organisations d'intégrer l'analyse statique à un cadre de contrôle de livraison plus vaste. En l'intégrant à une plateforme unifiée, les entreprises peuvent imposer des normes de base à toutes les équipes sans complexifier des environnements déjà complexes grâce à des outils supplémentaires.

Intégration avec la gouvernance de la livraison d'entreprise

Les fonctionnalités d'analyse statique d'OpenText sont étroitement intégrées aux fonctions de gestion du cycle de vie, telles que le suivi des exigences, les tests et l'orchestration des mises en production. Cette intégration permet de lier les résultats d'analyse aux éléments de travail, aux anomalies et aux approbations, assurant ainsi la traçabilité tout au long du processus de livraison. Pour les organisations dotées de modèles de gouvernance formels, cet alignement simplifie la supervision et le reporting.

La plateforme est souvent conçue pour soutenir des structures la gestion du changement Les processus prévoient que les modifications logicielles doivent passer par des étapes d'examen et d'approbation définies. Les résultats de l'analyse statique font partie des éléments de preuve utilisés pour évaluer l'aptitude à la mise en production, au lieu de constituer une source d'information technique isolée.

Couverture linguistique et focus sur la normalisation

OpenText DevOps Cloud Static Analysis prend en charge un large éventail de langages de programmation d'entreprise courants, garantissant ainsi l'application uniforme des normes de codage au sein d'équipes de développement diverses. Sa compatibilité linguistique est axée sur les environnements de développement d'applications les plus répandus, plutôt que sur des environnements de niche ou anciens.

Bien que cette étendue favorise la standardisation, la profondeur d'analyse reste relativement superficielle comparée aux outils spécialisés. La plateforme ne modélise pas les chemins d'exécution, ne résout pas la logique d'orchestration par lots et n'analyse pas les dépendances entre applications. Ses résultats sont surtout adaptés à l'identification de problèmes localisés au sein de bases de code individuelles.

Évolutivité et caractéristiques opérationnelles

Conçu pour fonctionner au sein d'une suite logicielle cloud, OpenText DevOps Cloud Static Analysis s'adapte à de multiples projets et équipes grâce à une administration centralisée. Il convient ainsi aux entreprises recherchant un contrôle uniforme pour un grand nombre de développeurs. Ses performances évoluent avec l'infrastructure cloud, réduisant le besoin de ressources dédiées sur site.

Toutefois, dans ce contexte, la scalabilité se réfère à la couverture organisationnelle plutôt qu'à la profondeur analytique. La plateforme offre une large visibilité sur les projets, mais une compréhension limitée du comportement des systèmes en cours d'exécution ou de la propagation des modifications dans des environnements complexes et interconnectés.

Cas d'utilisation et contraintes typiques en entreprise

OpenText DevOps Cloud Static Analysis est particulièrement efficace dans les entreprises qui privilégient une gouvernance intégrée des livraisons et des contrôles standardisés à l'exploration technique approfondie. Il prend en charge les environnements où l'analyse statique constitue un point de contrôle parmi d'autres au sein d'un processus de publication contrôlé, garantissant ainsi le respect constant des exigences minimales de qualité et de sécurité.

Ses limites apparaissent clairement dans les scénarios exigeant une compréhension approfondie du comportement d'exécution, des chaînes de dépendances ou de l'impact de la modernisation sur des systèmes hétérogènes. La plateforme ne fournit pas la visibilité comportementale ni l'évaluation d'impact nécessaires à la mise en œuvre sécurisée de projets de refactorisation ou de modernisation à grande échelle, et elle est souvent complétée par des outils spécialisés dans l'analyse de l'exécution et l'analyse multiplateforme.

Tableau comparatif des capacités des solutions SCA

| Capability | SMART TS XL | SonarQube Ent | Checkmarx Un | Renforcer SCA | Temps forts du casting | Imagerie CAST | Véracode | Couverture | Parasoft | Klocwork | OpenText |

|---|---|---|---|---|---|---|---|---|---|---|---|

| Échelle du portefeuille d'entreprise | ✅Excellent | ◐ Modéré | ◐ Modéré | ◐ Modéré | ✅Excellent | ✅Excellent | ◐ Modéré | ◐ Modéré | ◐ Modéré | ◐ Modéré | ◐ Modéré |

| Multiplateforme (Mainframe + Distribué) | ✅ Complet | ❌ Non | ❌ Non | ❌ Limité | ❌ Limité | ❌ Limité | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ❌ Limité |

| Prise en charge des langages hérités (COBOL, JCL, RPG) | ✅ Complet | ❌ Non | ❌ Non | ❌ Limité | ❌ Limité | ❌ Limité | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ❌ Non |

| Analyse de la dépendance inter-systèmes | ✅ Complet | ❌ Non | ❌ Non | ❌ Non | ◐ Niveau élevé | ◐ Structurel | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ❌ Non |

| Visibilité du chemin d'exécution (statique) | ✅ Complet | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ◐ Partiel | ◐ Partiel | ◐ Partiel | ❌ Non |

| Analyse des lots et des flux de tâches | ✅ Complet | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ❌ Non |

| Analyse d'impact avant changement | ✅ Profond | ◐ Peu profond | ◐ Sécurité uniquement | ◐ Sécurité uniquement | ◐ Portfolio | ◐ Structurel | ◐ Sécurité uniquement | ◐ Niveau du code | ◐ Niveau du code | ◐ Niveau du code | ◐ Gouvernance |

| Détection des vulnérabilités de sécurité (SAST) | ◐ Contextuel | ◐ Basique | ✅ Fort | ✅ Fort | ◐ Indicatif | ❌ Non | ✅ Fort | ◐ Limité | ◐ Limité | ◐ Limité | ◐ Basique |

| Analyse des performances et de la complexité | ✅ Profond | ◐ Métriques | ❌ Non | ❌ Non | ◐ Agrégat | ◐ Structurel | ❌ Non | ◐ Basé sur les défauts | ◐ Conformité | ◐ Basé sur les défauts | ❌ Non |

| Analyse de l'état de préparation à la modernisation | ✅ Natif | ❌ Non | ❌ Non | ❌ Non | ✅ Primaire | ◐ Structurel | ❌ Non | ❌ Non | ❌ Non | ❌ Non | ❌ Non |

| Recherche dans tous les actifs | ✅ Avancé | ◐ Dépôt uniquement | ◐ Dépôt uniquement | ◐ Dépôt uniquement | ◐ Métadonnées | ◐ Métadonnées | ◐ Dépôt uniquement | ◐ Dépôt uniquement | ◐ Dépôt uniquement | ◐ Dépôt uniquement | ◐ Dépôt uniquement |

| Intégration CI / CD | ◐ Optionnel | ✅ Fort | ✅ Fort | ◐ Modéré | ❌ Non | ❌ Non | ✅ Fort | ◐ Modéré | ◐ Modéré | ◐ Modéré | ✅ Natif |

| Génération de preuves prêtes pour l'audit | ✅ Natif | ◐ Limité | ◐ Limité | ✅ Fort | ◐ Agrégat | ◐ Structurel | ◐ Limité | ◐ Limité | ✅ Fort | ◐ Limité | ◐ Fort |

Autres outils d'analyse statique de code (applicabilité limitée aux entreprises)

- ESLint

- Avantages : Garantit le respect des normes de codage en JavaScript et TypeScript et offre un retour d'information rapide aux développeurs.

- Limitations: Fonctionne au niveau du référentiel sans visibilité sur l'impact inter-systèmes ou d'entreprise.

- PMD

- Avantages : Détecte les problèmes de qualité de code courants dans plusieurs langages de programmation.