La vérification formelle est devenue une compétence essentielle pour les organisations chargées de l'exploitation de systèmes critiques pour la sécurité et dépendants de la mission. Les initiatives de modernisation dans les secteurs de l'aviation, de la compensation financière, du contrôle industriel et des plateformes du secteur public s'appuient de plus en plus sur une validation mathématique rigoureuse afin de garantir le comportement prévisible des composants critiques dans toutes les conditions opérationnelles. Les techniques de raisonnement statique, telles que celles décrites dans l'article sur méthodes de traçage logiqueLes preuves formelles sont désormais complétées par la mise en évidence des comportements structurels que les spécifications doivent refléter fidèlement. À mesure que la complexité des systèmes augmente, la vérification formelle s'impose comme un outil stratégique pour garantir l'exactitude des systèmes avant leur déploiement.

Les composants critiques fonctionnent rarement de manière isolée, et les équipes de vérification doivent tenir compte des interactions asynchrones, des chemins d'exécution hétérogènes et des sous-systèmes existants intégrés aux architectures distribuées modernes. Nombre de ces systèmes contiennent des flux de contrôle complexes qui ne sont pas visibles sans une analyse avancée, similaire à celle présentée dans l'article sur chemins de code cachésCes informations constituent des données essentielles pour l'élaboration de modèles formels précis, permettant aux équipes de vérification de saisir les invariants, les contraintes temporelles et les hypothèses d'interface qui régissent le comportement entre les composants. Cet alignement est fondamental pour des preuves exactes, indépendamment de l'environnement d'exécution et de la plateforme.

Garantir l'exactitude formelle

Smart TS XL transforme les vastes bases de code en modèles prêts pour la vérification, réduisant ainsi les risques tout au long de la modernisation.

Explorez maintenantLes cadres réglementaires exercent une pression supplémentaire sur les organisations pour qu'elles démontrent la conformité de leurs systèmes par des preuves déterministes plutôt que par des tests probabilistes ou une couverture comportementale incomplète. Les organismes de certification des secteurs de l'aéronautique, de l'énergie, du médical et de la finance exigent de plus en plus des artefacts de vérification qui correspondent directement à l'intention architecturale et aux contraintes système documentées. Des recommandations similaires aux attentes décrites dans Conformité SOX et DORA Cela illustre l'évolution vers un raisonnement structuré et vérifiable. La vérification formelle devient ainsi à la fois une discipline d'ingénierie et un outil de conformité pour les programmes de modernisation soumis à un contrôle réglementaire rigoureux.

Les entreprises qui passent d'architectures traditionnelles fortement couplées à des écosystèmes cloud distribués ou à des architectures orientées services sont confrontées à une complexité croissante pour garantir leur exactitude. De subtiles déviations comportementales introduites lors de la transformation peuvent propager des risques importants à travers les flux de travail dépendants, conformément aux préoccupations identifiées dans l'analyse de détection de décalage logiqueLa vérification formelle offre la rigueur mathématique nécessaire à l'évaluation de ces risques à grande échelle, permettant aux responsables de l'ingénierie de valider les hypothèses, de déceler les contradictions et de garantir l'intégrité fonctionnelle tout au long de la modernisation. De ce fait, la vérification formelle joue désormais un rôle central dans la protection des systèmes critiques lors de l'évolution architecturale.

Rôle stratégique de la vérification formelle dans les architectures critiques pour la sécurité et les missions

La vérification formelle est devenue fondamentale pour les entreprises exploitant des systèmes complexes à haute fiabilité, où un comportement incorrect peut entraîner des défaillances opérationnelles en cascade. Dans les grandes organisations, les composants opérationnels s'étendent souvent sur plusieurs générations technologiques, s'intègrent à des plateformes cloud hybrides et prennent en charge des flux de travail critiques pour la sécurité qui exigent une correction déterministe. Les tests traditionnels valident le comportement dans des conditions échantillonnées, tandis que la vérification formelle fournit des garanties mathématiques que les invariants critiques sont respectés pour tous les états accessibles du système. Cette distinction prend une importance croissante à mesure que la modernisation introduit de nouveaux points d'intégration, des modèles de concurrence et des environnements d'exécution qui élargissent l'espace des états potentiels. Les équipes d'analyse combinent modèles de domaine, langages de spécification et raisonnement sur les flux de contrôle pour créer des cadres de vérification qui évoluent avec le cycle de vie du système.

Les architectes système reconnaissent également que la vérification formelle renforce la gouvernance de la modernisation en clarifiant les attentes comportementales avant le début de la transformation. Les artefacts de preuve établissent des définitions non ambiguës des responsabilités des composants, des conditions de défaillance et des hypothèses environnementales. Ils mettent également en évidence les problèmes structurels que les tests ne peuvent pas détecter de manière fiable, renforçant ainsi le rôle de l'analyse statique comme prérequis à une vérification rigoureuse. Les techniques d'identification des interactions de chemin caché, telles que celles abordées dans analyse détaillée du chemin de code, aident les équipes de vérification à définir précisément le périmètre des preuves en révélant les dépendances non évidentes au sein de la logique existante. Cet alignement permet aux organisations d'élaborer des stratégies de modernisation qui préservent l'exactitude tout au long de l'évolution architecturale.

Établir des garanties de correction dans des architectures hétérogènes

Les systèmes critiques fonctionnent fréquemment sur des plateformes hétérogènes, notamment des mainframes, des contrôleurs embarqués, des services cloud et des pipelines d'événements distribués. La vérification formelle fournit un cadre mathématique unifié garantissant la correction, indépendamment du langage d'implémentation ou de l'environnement d'exécution. Prenons l'exemple d'une institution financière qui gère un moteur de règlement écrit en COBOL, un service de calcul des risques en Java et une couche d'orchestration native du cloud traitant des événements asynchrones. Sans vérification, de subtiles différences de synchronisation ou d'ordonnancement entre ces couches peuvent engendrer des conditions de concurrence critiques. Les spécifications formelles permettent aux équipes d'ingénierie de définir des contraintes temporelles, des invariants et des protocoles de communication applicables uniformément à tous les composants.

Pour valider ce comportement, les équipes élaborent des modèles de transition d'état intégrant les flux de messages, les tentatives de nouvelle connexion, la sémantique de persistance et les délais d'expiration. Ces modèles prennent en charge des preuves de logique temporelle garantissant l'absence de blocages, de réordonnancements non intentionnels ou de mises à jour partielles. Les techniques d'analyse statique facilitent ces efforts en révélant les branches non structurées ou les blocs inaccessibles qui perturbent le flux de contrôle prévu. Les approches présentées dans les discussions sur méthodes de traçage logique Ils servent souvent de précurseur essentiel, garantissant que les modèles formels reflètent fidèlement les chemins d'exécution réels. À mesure que la modernisation progresse, les propriétés vérifiées guident la refactorisation, le découplage des composants et la refonte architecturale, assurant ainsi la correction dans des environnements en constante évolution.

Gérer la complexité des modes de défaillance dans les flux de travail critiques

Dans les systèmes critiques, les défaillances ne se limitent pas aux simples exceptions ; elles peuvent inclure des écarts de synchronisation, des transitions d'état partielles, l'indisponibilité de services en aval ou l'application incohérente de règles de configuration. La vérification formelle permet aux organisations de classifier les modes de défaillance, de leur attribuer des définitions mathématiques et de prouver que les mécanismes de récupération fonctionnent comme prévu dans toutes les situations opérationnelles. Dans un système de planification des transports en temps réel, par exemple, la concurrence entre les mises à jour de répartition, la télémétrie des véhicules et l'optimisation sous contraintes engendre une explosion combinatoire d'états que les tests traditionnels ne peuvent couvrir. Les équipes de vérification formalisent ces transitions à l'aide de commandes protégées ou d'algèbre de processus afin de garantir que, même en conditions dégradées, les invariants fondamentaux restent intacts.

L'élaboration de telles garanties exige une compréhension précise de la manière dont la logique existante encode les chemins de récupération d'erreurs. De nombreux systèmes historiques de plus de vingt ans conservent une logique de repli implicite profondément ancrée dans les structures conditionnelles. L'utilisation de modèles formels sans concilier ces chemins risque d'occulter des comportements critiques. Les outils d'analyse statique révèlent les branches de gestion d'erreurs cachées, les conditions inutilisées ou les structures d'exceptions héritées qui influencent les transitions d'état. Cet alignement permet aux équipes de vérification d'encoder la sémantique complète des défaillances dans les preuves. À mesure que les systèmes évoluent vers des architectures distribuées dans le cloud, les états supplémentaires introduits par les nouvelles tentatives, la mise à l'échelle automatique et les modèles de cohérence distribuée peuvent être capturés dans des spécifications étendues, préservant ainsi les garanties de sécurité tout au long de la modernisation.

Garantir l'intégrité comportementale lors d'une modernisation progressive

Les entreprises remplacent rarement leurs systèmes critiques en une seule phase, préférant des stratégies de modernisation progressive qui préservent la continuité opérationnelle. Cette évolution par étapes introduit une incertitude quant à l'interaction des composants partiellement modernisés avec les sous-systèmes existants qui continuent d'assurer des fonctions essentielles. La vérification formelle apporte le cadre nécessaire pour garantir l'intégrité comportementale à chaque étape de la modernisation. Par exemple, lors de la migration d'une partie d'un pipeline de rapprochement financier par lots vers une architecture de microservices, des différences de granularité de planification ou de sémantique de concurrence peuvent engendrer des résultats non déterministes. Grâce à la vérification, les équipes d'ingénierie définissent des contrats de comportement précis pour les composants existants et modernisés, garantissant ainsi l'équivalence de tous les résultats observables.

Les équipes de vérification s'appuient également sur l'abstraction pour garantir la traçabilité. Les systèmes existants comportent souvent des milliers d'instructions procédurales qui, si elles étaient représentées directement, submergeraient les opérations de vérification de modèles ou de démonstration de théorèmes. L'abstraction de ces composants en modèles finis, tout en préservant leur exactitude sémantique, assure la scalabilité des preuves formelles. Cet équilibre reflète le principe plus général de modernisation qui consiste à préserver l'intention fonctionnelle tout en transformant l'implémentation technique. À mesure que les services modernes remplacent les routines existantes, les propriétés précédemment vérifiées servent de contrats de régression, empêchant ainsi les écarts subtils lors des refactorisations, des intégrations ou des migrations de plateforme. Cette approche rigoureuse réduit les risques opérationnels tout au long de l'évolution du système.

Utiliser la vérification formelle pour renforcer la gouvernance d'entreprise et les contrôles des risques

Les cadres de gouvernance d'entreprise mettent de plus en plus l'accent sur un raisonnement rigoureux et fondé sur des preuves lors de la validation des systèmes critiques. La vérification formelle offre une assurance déterministe, conforme aux contrôles des risques internes et à la surveillance réglementaire. Dans les secteurs fortement réglementés, les éléments de preuve sont intégrés aux dossiers d'audit, démontrant que le comportement du système est conforme aux spécifications déclarées. Des techniques telles que les preuves de préservation d'invariants ou les garanties de disponibilité fournissent aux organismes de réglementation des preuves mesurables et reproductibles de la conformité. Ceci renforce la protection de l'organisation contre les incidents opérationnels et garantit le respect des politiques régissant la sécurité, la résilience et l'intégrité des données.

De plus, les équipes de gouvernance bénéficient de modèles comportementaux structurés produits par la vérification formelle. Ces modèles mettent en évidence les points de conflit entre les hypothèses héritées et les exigences modernes, aidant ainsi les comités de modernisation à déterminer la nécessité d'une refonte architecturale. Les artefacts de vérification clarifient l'intention de conception, facilitent l'adhésion des parties prenantes et réduisent l'ambiguïté lors des transitions de systèmes. Cette combinaison de preuves mathématiques et de visibilité architecturale offre une base de gouvernance suffisamment robuste pour soutenir des programmes de modernisation pluriannuels couvrant diverses technologies.

Modélisation des composants critiques à l'aide de machines à états, de logique temporelle et d'algèbres de processus

La modélisation constitue le fondement de la vérification formelle, permettant aux équipes d'ingénierie d'exprimer le comportement du système à l'aide de constructions mathématiques rigoureuses. Les composants critiques des systèmes à haut risque et dépendants de la mission nécessitent des représentations explicites qui capturent la sémantique de la concurrence, l'évolution des états, les hypothèses environnementales et les transitions de défaillance. Les automates à états finis, les cadres logiques temporels et les algèbres de processus répondent à ces exigences en fournissant des abstractions structurées capables de représenter des modèles d'interaction complexes et des contraintes déterministes. Ces formalismes permettent aux organisations de raisonner sur la correction indépendamment des détails d'implémentation, garantissant ainsi que les efforts de modernisation préservent les garanties fonctionnelles à mesure que les bases de code évoluent.

L'un des principaux défis de la construction de modèles précis réside dans la conciliation entre la logique héritée profondément ancrée et les exigences architecturales modernes. Les systèmes vieux de plusieurs décennies encodent souvent leur comportement implicitement par le biais de branches imbriquées, d'états mutables partagés et de séquences pilotées par des effets de bord, ce qui rend leur représentation directe difficile. Les équipes d'analyse s'appuient fréquemment sur des observations statiques intermédiaires pour guider le processus de modélisation. Des articles tels que l'exploration de indicateurs de complexité Fournir des cadres conceptuels pour identifier les points critiques structurels qui influencent la fidélité du modèle. En mettant en évidence les structures ramifiées et les boucles non bornées, les analyses statiques garantissent que les modèles reflètent les réalités opérationnelles plutôt que des hypothèses simplifiées.

Formalisation de l'évolution de l'état des composants avec des machines à états finies et étendues

Les automates à états finis offrent un mécanisme structuré pour représenter le comportement des composants selon différents modes de fonctionnement. Dans les systèmes critiques, les composants fonctionnent rarement dans de simples états binaires ; ils transitent plutôt par un ensemble complexe d’états conditionnels, paramétrés ou hiérarchiques. Prenons l’exemple d’un sous-système de verrouillage de sécurité dans un environnement d’automatisation industrielle. Son comportement dépend non seulement des entrées des capteurs, mais aussi des commandes de supervision, des conditions de temporisation, des compteurs historiques et des latences de défaut. Les automates à états finis étendus, intégrant des variables, des gardes, des fonctions d’effet et des groupes de transition, deviennent indispensables pour modéliser cette complexité.

Les équipes de vérification construisent ces automates à états finis en examinant l'interaction entre les événements externes et les conditions internes. Le code existant révèle souvent de nombreuses transitions non structurées, où la logique de branchement, imbriquée dans plusieurs modules, définit indirectement les états du système. L'identification de ces transitions implicites nécessite une analyse approfondie des hiérarchies d'appels et des dépendances de données persistantes. Des méthodes similaires à celles décrites dans l'article sur détection de haute complexité Ce guide aide les modélisateurs à identifier les endroits où les limites d'état doivent être explicitées. Une fois formalisées, les machines à états prennent en charge les preuves d'invariance, l'analyse d'accessibilité et la détection des états morts. Lors de la modernisation, ces modèles d'état vérifiés servent de points d'ancrage pour la correction, permettant aux équipes d'ingénierie de valider que les versions cloud-native conservent la même sémantique d'état, même lorsque les caractéristiques d'exécution changent.

Application de la logique temporelle pour la capture des contraintes d'ordre, de durée et de disponibilité

La logique temporelle joue un rôle essentiel dans la modélisation des comportements sensibles au temps et dépendants de l'ordre, caractéristiques des systèmes critiques. Les spécifications exprimées en logique temporelle linéaire ou en logique arborescente de calcul permettent aux organisations de définir des propriétés sémantiques telles que la séquence d'événements, les conditions de sécurité, les temps de réaction limités et les exigences de disponibilité. Prenons l'exemple d'un pipeline d'autorisation de paiement où une requête doit soit aboutir dans un délai imparti, soit basculer vers un chemin de repli contrôlé. La logique temporelle permet aux architectes d'intégrer la contrainte selon laquelle aucune autorisation en attente ne peut rester non résolue au-delà de la durée autorisée.

L'élaboration de spécifications de logique temporelle exige une compréhension approfondie des interactions asynchrones, des tentatives de resynchronisation et des conflits d'événements non déterministes. Les systèmes critiques fonctionnant dans des environnements distribués introduisent une complexité supplémentaire, car des défaillances partielles ou des pertes de messages peuvent enfreindre les hypothèses implicites de la logique existante. Les techniques d'analyse statique permettent d'identifier ces hypothèses en mettant en évidence les anomalies de propagation des données ou les structures de branchement irrégulières. Articles décrivant problèmes de dépendance Cette méthode permet de démontrer comment les violations architecturales peuvent fausser le raisonnement temporel. En alignant les contraintes de logique temporelle sur les dépendances identifiées, les équipes s'assurent de la validité des conditions de correction dans des environnements d'exécution hétérogènes. Ces spécifications deviennent des atouts essentiels lors des modernisations progressives, permettant de fournir des preuves de régression qui garantissent la disponibilité et la réactivité continues, même après une transformation architecturale.

Modélisation de la concurrence et des protocoles de communication à l'aide d'algèbres de processus

Les algèbres de processus telles que CSP, CCS et ACP offrent une approche mathématique rigoureuse pour représenter l'exécution concurrente, les primitives de synchronisation et la sémantique de communication. Ces modèles deviennent indispensables dans des domaines comme le contrôle aérien, la navigation autonome, les réseaux de compensation financière et les moteurs de traitement d'événements à grande échelle. Dans ces environnements, les comportements de multiples composants interagissant ne peuvent être caractérisés par de simples automates à états finis indépendants ; des structures d'interaction formelles sont nécessaires pour exprimer les canaux de communication, les conditions de rendez-vous et les contextes d'opérations parallèles.

Un exemple illustrant ce défi se trouve dans les systèmes de répartition de commandes en temps réel. Ces systèmes coordonnent les mises à jour événementielles entre plusieurs sous-systèmes, chacun nécessitant une gestion précise de l'ordonnancement et des mécanismes de verrouillage. Un léger décalage entre la synchronisation prévue et le comportement réel du code peut engendrer des risques de blocage ou une propagation d'état incohérente. Les enseignements statiques tirés de l'analyse des interactions inter-procédurales, comme évoqué dans… analyse de renforcement de l'impactCes modèles permettent de révéler l'existence de schémas de communication implicites. Les modèles d'algèbre de processus convertissent ces schémas en opérateurs formels tels que la composition parallèle, le masquage et le choix. Ceci permet un raisonnement automatisé sur l'absence d'interblocage, l'affinage des traces et l'intégrité des communications. À mesure que les composants existants migrent vers des équivalents distribués dans le cloud, les preuves d'algèbre de processus deviennent essentielles pour garantir que les microservices préservent la sémantique attendue du protocole.

La modélisation formelle comme pont entre les comportements hérités et les architectures modernes

La modélisation formelle assure la cohérence entre les intentions opérationnelles existantes et les architectures de modernisation émergentes. À mesure que les organisations décomposent les systèmes monolithiques en modèles orientés services ou événementiels, des divergences peuvent apparaître entre les hypothèses historiques et les modèles d'exécution modernes. Les processus par lots planifiés peuvent évoluer vers des flux de données continus, les sous-routines étroitement couplées peuvent être restructurées en services asynchrones et les opérations synchronisées peuvent être remplacées par des mécanismes de coordination distribués. Ces changements modifient des caractéristiques fondamentales telles que l'ordre d'exécution, la tolérance à la latence, les garanties de cohérence et la sémantique de récupération.

La modélisation permet de s'assurer que ces différences sont comprises et validées avant la mise en œuvre. Lorsque les systèmes existants contiennent des flux conditionnels non documentés ou des structures de repli profondément imbriquées, la construction du modèle devient un processus de découverte. Des enseignements similaires à ceux fournis par les recherches sur validation de la résilience dynamique Ces modèles révèlent des comportements négligés qui doivent être explicitement représentés. Une fois convertis en automates à états finis, en spécifications de logique temporelle ou en descriptions d'algèbre de processus, ils permettent aux équipes de vérifier formellement que les stratégies de modernisation préservent les garanties essentielles de sécurité et d'exactitude. Lors de transitions par étapes, ces modèles servent également d'oracles de régression, permettant de vérifier que chaque incrément de modernisation respecte les propriétés système préalablement validées.

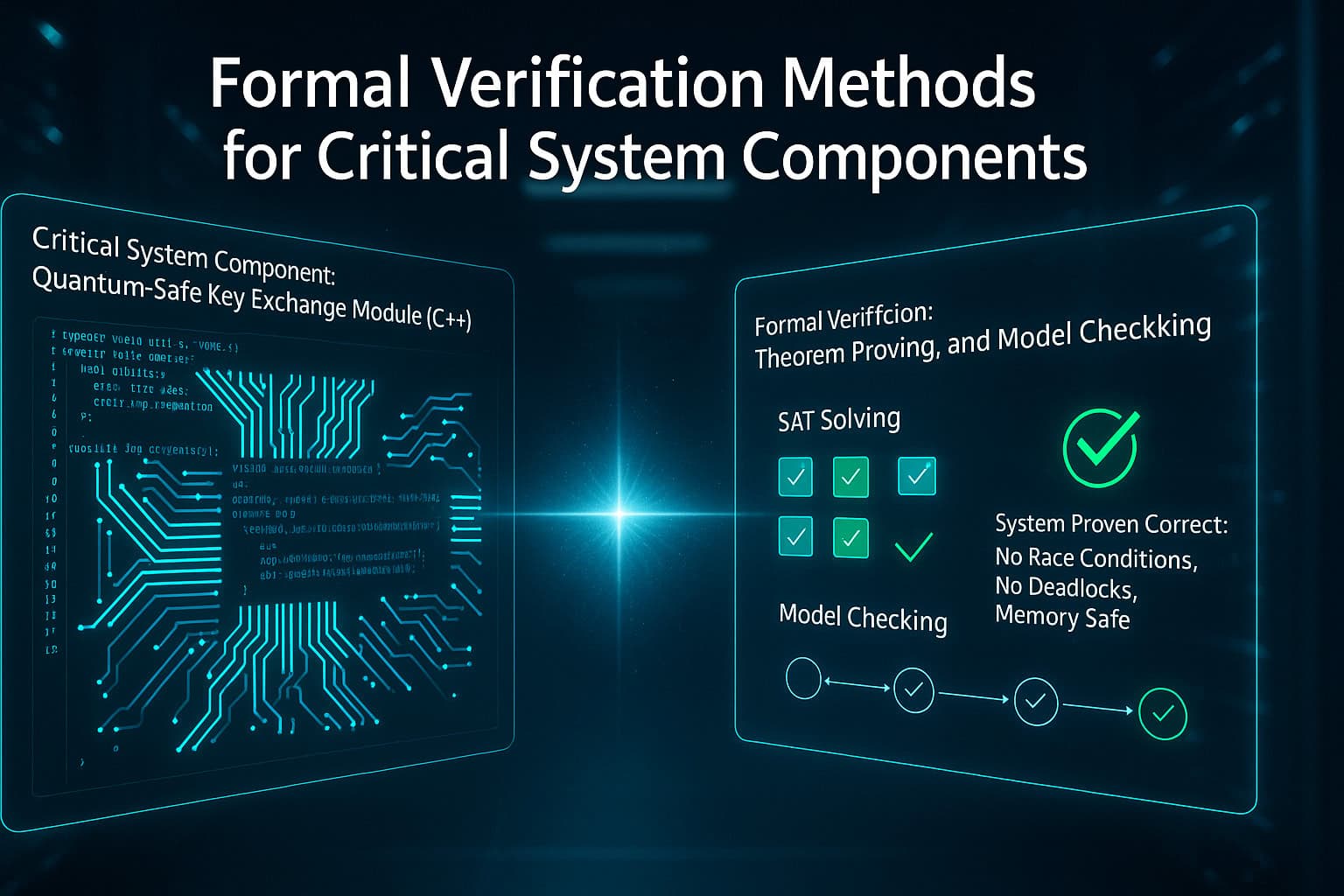

Techniques de démonstration de théorèmes pour prouver les propriétés de sûreté, de vivacité et d'invariance

La démonstration de théorèmes offre le fondement le plus expressif et rigoureux pour valider la correction des systèmes critiques. Contrairement à la vérification de modèles, qui explore automatiquement les espaces d'états, les démonstrateurs de théorèmes s'appuient sur un raisonnement logique structuré pour démontrer que les propriétés spécifiées sont vérifiées en toutes circonstances. Cette capacité devient essentielle pour les grands systèmes fortement paramétrés, où les espaces d'états sont trop vastes pour une exploration automatisée. Les organisations exploitant des plateformes critiques pour la sécurité dépendent de la démonstration de théorèmes pour valider les invariants, les obligations de disponibilité, la conformité aux protocoles et l'absence de transitions vers des défaillances catastrophiques. À mesure que la modernisation introduit de nouveaux modèles de concurrence, des schémas d'orchestration de services ou des dépendances distribuées, la démonstration de théorèmes garantit la validité des hypothèses de correction à travers les architectures de transition.

Un autre avantage de la démonstration de théorèmes réside dans sa capacité à vérifier les propriétés de composants qui ne se prêtent pas à des abstractions à états finis. Les systèmes intégrant des structures de données non bornées, une logique récursive ou des ensembles de données de taille variable nécessitent des cadres de raisonnement déductif capables de traiter des structures mathématiques générales. Les équipes d'ingénierie élaborent des définitions formelles du fonctionnement du système et raisonnent inductivement sur toutes les combinaisons possibles d'entrées et d'états. Auparavant, les analystes utilisent souvent des observations statiques pour affiner les préconditions et obtenir des abstractions précises. Les discussions sur l'identification problèmes de flux de données illustrer comment les hypothèses héritées peuvent se propager, influençant la formation d'obligations de preuve correctes.

Utilisation de la préservation des invariants pour garantir la sécurité structurelle dans des écoulements complexes

Les preuves d'invariants constituent la pierre angulaire de la vérification déductive. Un invariant définit une propriété qui doit être vérifiée quel que soit l'état du système, indépendamment des transitions, de la concurrence ou des variations d'entrée. Les systèmes critiques dépendent des invariants pour garantir leur sécurité structurelle, par exemple en empêchant les soldes négatifs sur les plateformes financières, en assurant la stabilité des limites des actionneurs dans les systèmes de contrôle ou en respectant les plages de fonctionnement autorisées pour les dispositifs médicaux. La construction d'invariants pertinents exige une analyse approfondie de la logique explicite et des comportements implicites intégrés aux bases de code existantes.

Prenons l'exemple d'un flux de traitement des réclamations en plusieurs étapes, s'exécutant sur un système central et des services distribués. Les routines existantes peuvent implémenter des mises à jour en cascade, des mécanismes de repli hérités ou des fusions conditionnelles rarement documentées. Pour valider les invariants de sécurité, les ingénieurs identifient d'abord les structures de données essentielles et définissent des prédicats mathématiques représentant des conditions stables, telles que la cohérence entre les enregistrements répliqués ou la progression monotone à travers les étapes du flux de travail. Des techniques d'analyse statique similaires à celles décrites dans validation de la cohérence des données Cette approche permet de révéler les segments procéduraux où les invariants pourraient être violés lors de la modernisation. À l'aide d'un démonstrateur de théorèmes, les ingénieurs démontrent par induction que chaque fonction de transition préserve l'invariant. Ainsi, même après la migration de composants vers des services natifs du cloud ou la refonte des pipelines de données, les garanties de sécurité essentielles restent intactes.

Preuve de disponibilité pour garantir la progression, l'achèvement et l'absence de blocage

Les propriétés de disponibilité garantissent que les systèmes finissent par atteindre les résultats souhaités, tels que la finalisation des transactions, l'émission de réponses ou la sortie d'états opérationnels transitoires. Dans les systèmes distribués et asynchrones, le raisonnement sur la disponibilité devient particulièrement complexe en raison des conditions de concurrence, des délais de transmission des messages et des défaillances partielles susceptibles de bloquer le système dans des états d'arrêt. La démonstration de théorèmes permet aux organisations de définir explicitement les exigences de disponibilité et de démontrer que, sous certaines hypothèses formelles, le système ne peut pas rester indéfiniment bloqué.

Imaginez un moteur de traitement des commandes événementiel chargé d'orchestrer des flux de travail en plusieurs étapes à travers plusieurs microservices. Lors de la modernisation, certains services sont décomposés, introduisant de nouvelles boucles de nouvelle tentative ou des mécanismes de compensation. Sans justification formelle, les garanties de progression peuvent être compromises. Les ingénieurs de vérification modélisent les comportements de communication et définissent des prédicats de disponibilité reflétant les résultats de réponse ou de résolution garantis. Des anomalies structurelles similaires à celles identifiées dans études de détection des blocages Ces informations permettent de mieux comprendre les comportements potentiels de blocage ou d'attente indéfinie. Grâce à ces analyses, la démonstration par théorèmes prouve qu'aucune séquence d'exécution valide ne peut se bloquer définitivement, garantissant ainsi une progression fiable même dans les déploiements hybrides sur site et dans le cloud.

Démonstration de théorèmes paramétrés pour les systèmes à état et données non bornés

De nombreuses plateformes d'entreprise fonctionnent avec des ensembles de données illimités, des files d'attente dynamiques, des sessions de longue durée ou des structures d'enregistrements imbriquées de manière arbitraire. Ces caractéristiques dépassent les capacités de la vérification de modèles à états finis. La démonstration de théorèmes offre des mécanismes mathématiquement expressifs pour raisonner sur des espaces d'états illimités par induction, coinduction et logique d'ordre supérieur. Ceci devient crucial pour des secteurs tels que la finance, les télécommunications et l'aérospatiale, où la correction du système doit être garantie quelles que soient la taille des données, la durée d'exécution ou la variabilité des entrées.

Prenons l'exemple d'un système de facturation de télécommunications gérant des millions de sessions simultanées aux cycles de vie dynamiques. Les architectures existantes peuvent implémenter des routines de traitement récursives qui doivent garantir l'exactitude quelle que soit l'échelle. La démonstration de théorèmes paramétrée permet aux analystes de définir des règles comportementales généralisées, indépendantes du nombre de sessions. Avant de construire les preuves, les équipes d'ingénierie analysent souvent les structures pour identifier les zones de récursion ou d'itération non bornée. Des articles tels que l'examen de comportement axé sur l'impact Cet exemple illustre la nécessité de comprendre la complexité des systèmes existants avant toute abstraction. Grâce à une spécification précise, les démonstrateurs de théorèmes valident l'exactitude des résultats pour toutes les tailles de système possibles, offrant ainsi une garantie solide lors de la modernisation, de la mise à l'échelle de la charge ou de la migration vers une infrastructure cloud élastique.

Intégration de la logique de défaillance, de la récupération d'erreurs et des hypothèses environnementales dans les obligations de preuve

La gestion des défaillances joue un rôle crucial dans la vérification, notamment pour les systèmes devant garantir un fonctionnement sûr dans des environnements difficiles ou dégradés. La démonstration de théorèmes permet aux analystes d'intégrer les hypothèses relatives aux modes de défaillance, à la propagation des erreurs, aux routines de repli et aux garanties des systèmes externes. Ceci assure la validité des preuves même en cas de pannes intermittentes, d'incohérences de configuration ou de conflits d'accès aux ressources. Les architectures modernes accentuent ces problématiques en raison de la communication distribuée, de la mise à l'échelle automatique et de l'hétérogénéité des processeurs, qui introduisent de nouvelles catégories de défaillances partielles.

Prenons l'exemple d'un système de traitement des sinistres multiplateforme en cours de modernisation progressive. Certains composants fonctionnent sur des moteurs de traitement par lots traditionnels, d'autres sur des services cloud événementiels. La sémantique des défaillances diffère selon ces environnements, ce qui peut invalider les hypothèses initiales concernant la propagation des erreurs. Les ingénieurs définissent des préconditions précises décrivant les comportements de défaillance acceptables, puis élaborent des preuves démontrant que les propriétés de sécurité du système restent intactes dans ces conditions. Des études sur prévenir les défaillances en cascade Cela permet d'identifier les transitions de cas limites nécessitant un traitement formel explicite. Leur intégration dans les obligations de preuve garantit que la modernisation ne compromet ni la résilience ni l'exactitude, même lorsque les comportements en cas de défaillance évoluent suite à des changements architecturaux.

Flux de travail de vérification de modèles pour les systèmes de contrôle embarqués, temps réel et distribués

La vérification de modèles offre une exploration exhaustive et automatisée des états du système, permettant aux équipes de vérification d'identifier les violations de sécurité, de disponibilité ou de conformité aux protocoles sans avoir à élaborer de preuves manuelles. Pour les automates embarqués, les plateformes temps réel et les systèmes d'orchestration distribués, la vérification de modèles devient essentielle en raison de la forte densité d'états interagissant et des dépendances temporelles. Ces environnements reposent souvent sur des processus concurrents, des transitions pilotées par interruption et des exigences d'ordonnancement déterministes. Les vérificateurs de modèles évaluent ces dynamiques en explorant systématiquement toutes les configurations accessibles sous différentes séquences d'événements et conditions environnementales. À mesure que les entreprises modernisent ces systèmes critiques, la vérification de modèles garantit la cohérence comportementale entre les sous-systèmes existants et les nouveaux composants distribués.

Un autre atout de la vérification de modèles réside dans sa capacité à révéler des incohérences subtiles qui ne sont pas apparentes lors des tests ou des simulations. Les contraintes de temps réel, la dérive d'horloge, les tentatives de communication et l'arrivée asynchrone des messages créent des chemins d'exécution que la validation traditionnelle explore rarement. Les bases de code existantes, en particulier celles structurées sur plusieurs décennies, peuvent contenir des conditions profondément imbriquées, des transitions de repli implicites ou des hypothèses de synchronisation liées à du matériel ancien. Les résultats analytiques issus de sources telles que l'étude de complexité du flux de contrôle Illustrer comment les schémas structurels complexes influencent les résultats de vérification. En alignant la vérification de modèles sur ces observations, les organisations élaborent des abstractions précises qui reflètent les conditions opérationnelles réelles.

Exploration exhaustive des états dans les boucles de contrôle embarquées

Les systèmes embarqués dans les secteurs de l'aérospatiale, de la sécurité automobile, de l'automatisation industrielle et de la robotique reposent sur des boucles de contrôle précises fonctionnant dans des limites strictes de synchronisation et de sécurité. La vérification de modèles permet aux ingénieurs de modéliser avec une grande fidélité les cycles de contrôle, les interruptions, l'échantillonnage des capteurs, les commandes des actionneurs et les routines de repli. Un scénario représentatif pourrait concerner un module de commande de vol gérant les ajustements d'attitude à partir des données de fusion de capteurs. Le contrôleur doit garantir des propriétés de sécurité telles que l'absence d'oscillations bornées, la convergence monotone des actionneurs et l'évitement des états invalides. Les boucles embarquées interagissent souvent avec des indicateurs de défauts matériels, des temporisateurs de surveillance et des sous-systèmes de correction d'erreurs, ce qui rend l'espace d'états complet beaucoup plus vaste que prévu.

Les processus de vérification de modèles commencent par la définition d'un modèle d'état structuré qui intègre les caractéristiques fonctionnelles et temporelles. Ce modèle peut inclure les variables d'horloge, les plages d'entrée, les effets d'hystérésis et les conditions de défaut. Les implémentations existantes révèlent généralement des transitions non documentées liées à des optimisations de performance ou à des contraintes matérielles. Des techniques d'analyse similaires à celles décrites dans détection de motifs sensible à la latence Il convient de mettre en évidence les zones où des délais implicites ou des hypothèses de synchronisation influencent le comportement. Une fois le modèle d'état établi, les ingénieurs procèdent à une exploration bornée ou non bornée afin de valider des propriétés telles que la stabilité, les limites de propagation des erreurs et le comportement de récupération. Lors de la modernisation, notamment lors de la migration de la logique embarquée vers des couches d'abstraction matérielles ou des plateformes logicielles, la vérification de modèles garantit le maintien des contraintes de synchronisation et de sécurité entre les différents moteurs d'exécution mis à jour.

Modèles de planification en temps réel et vérification des délais

Les systèmes temps réel reposent sur des garanties d'ordonnancement prévisibles, où les tâches doivent s'exécuter dans des délais précis pour maintenir l'intégrité du système. Ces environnements incluent les systèmes de navigation autonome, les contrôleurs de perfusion médicale, la robotique industrielle et les plateformes de répartition des urgences. La vérification de modèles permet aux équipes de vérification d'évaluer les politiques d'ordonnancement, les règles de préemption, les hiérarchies de priorité et les mécanismes de synchronisation d'horloge en tenant compte de toutes les variations temporelles possibles. Les violations du temps réel, telles que les dépassements de délais, l'amplification de la gigue ou l'inversion de priorité, peuvent entraîner des défaillances opérationnelles catastrophiques.

Un scénario illustrant ce problème concerne un sous-système de véhicule autonome qui doit traiter les données des capteurs, évaluer les trajectoires et envoyer des commandes aux actionneurs selon des cycles fixes. Lors de la modernisation d'un tel système pour intégrer des fonctionnalités assistées par le cloud ou des couches de calcul supplémentaires, les contraintes d'ordonnancement peuvent évoluer subtilement. Les ingénieurs en vérification conçoivent des automates temporisés ou des modèles d'état hybrides qui représentent chaque tâche, son échéance et son interaction avec les horloges système. Des travaux analytiques sur débit versus réactivité Ce système fournit des indications pour identifier les zones où les conflits de synchronisation ou les pics de charge affectent la fiabilité de l'ordonnancement. Des outils de vérification de modèles analysent toutes les séquences de tâches, évaluant le respect des délais malgré les pires scénarios : ordre d'exécution, délais de messages ou conflits de ressources. Cette approche garantit que la modernisation n'introduit pas de défauts de synchronisation latents et que les garanties de sécurité et de fonctionnement restent constantes dans des environnements d'exécution hétérogènes.

Comportement des systèmes distribués, consensus et vérification de l'ordre des messages

Les systèmes distribués amplifient la complexité de la vérification en introduisant un ordre des messages non déterministe, une latence variable, des partitions de réseau et des interactions dépendantes de l'échelle. La vérification de modèles devient un outil essentiel pour vérifier les algorithmes de consensus, la logique de coordination distribuée et les protocoles de récupération multi-nœuds. Les réseaux de transactions financières, les systèmes de gestion des réseaux électriques et les infrastructures de communication à l'échelle nationale dépendent de ces garanties pour éviter la corruption des données, les mises à jour d'état incohérentes ou les pannes en cascade.

Prenons l'exemple d'une plateforme distribuée de suivi des actifs coordonnant les mises à jour sur plusieurs régions géographiques. Les versions traditionnelles peuvent s'appuyer sur des appels synchrones, tandis que les versions modernisées intègrent la messagerie asynchrone, la distribution par file d'attente ou les protocoles de diffusion. Les ingénieurs en vérification élaborent des modèles qui capturent la perte, le retard, la duplication et le partitionnement temporaire des messages. Les enseignements tirés de la recherche sur analyse d'injection de défauts Ces vérifications permettent de définir les conditions dans lesquelles les composants distribués doivent préserver leurs propriétés de sécurité. Elles évaluent le maintien du consensus, la persistance de la disponibilité en cas d'instabilité du réseau et la cohérence des états répliqués sur l'ensemble des nœuds. Lors de la migration des systèmes vers le cloud ou des environnements multirégionaux, ces vérifications garantissent la continuité opérationnelle, quelles que soient l'échelle, la latence ou les modifications de la topologie.

Détection des entrelacements subtils et des violations partielles de l'ordre introduits lors de la modernisation

La modernisation modifie fréquemment les schémas de concurrence, introduisant de nouvelles séquences d'événements ou supprimant des flux de travail sérialisés qui garantissaient autrefois l'exactitude des opérations. Ces transformations peuvent générer des violations partielles d'ordre, des entrelacements inattendus ou des conditions de concurrence auparavant impossibles. La vérification de modèles offre la visibilité granulaire nécessaire pour détecter ces problèmes avant le déploiement. Les équipes construisent des modèles reflétant les structures de concurrence héritées et modernisées, et comparent les comportements par le biais de vérifications d'affinage, d'équivalence de traces ou d'analyse de contre-exemples.

Prenons l'exemple d'une plateforme de règlement de paiements internationaux, historiquement gérée par des mises à jour par lots. Lors de sa modernisation, la logique de règlement est décomposée en microservices fonctionnant de manière asynchrone. Si cette transition améliore la scalabilité, elle introduit également de nouvelles combinaisons de synchronisation et d'ordonnancement. Des informations statiques similaires à celles fournies dans intégrité du flux basée sur les acteurs Ces vérifications permettent de mettre en évidence les zones où la sémantique de propagation des données peut évoluer. En appliquant une vérification de modèle, les ingénieurs détectent les cas où les mises à jour partielles se propagent de manière incohérente ou lorsque les tentatives de reconnexion asynchrones réorganisent les événements au-delà des contraintes acceptables. À mesure que la modernisation progresse, ces vérifications garantissent que le comportement distribué est conforme à la sémantique de conception prévue et que la concurrence nouvellement introduite ne compromet ni l'exactitude des données ni la conformité réglementaire.

Interprétation abstraite et analyse statique comme pont vers la vérification formelle complète

L'interprétation abstraite fournit le cadre mathématique nécessaire à l'approximation du comportement dynamique sans exécution de code, ce qui en fait un précurseur essentiel de la vérification formelle dans les systèmes critiques. Sa sémantique basée sur les treillis permet aux organisations de modéliser à grande échelle les plages de valeurs des variables, les contraintes de flux de contrôle et les caractéristiques de propagation des données, notamment dans les environnements existants comportant des dizaines de millions de lignes de code. En construisant des sur-approximations robustes de tous les chemins d'exécution possibles, l'interprétation abstraite identifie les invariants, les états impossibles et les propriétés de stabilité sur lesquels s'appuient ultérieurement la démonstration de théorèmes et la vérification de modèles. Cet alignement devient indispensable lors de la modernisation de systèmes distribués critiques présentant des dépendances de données complexes et des flux de travail non documentés.

L'analyse statique complète l'interprétation abstraite en fournissant des informations structurelles qui permettent de clarifier les points clés des modèles formels. Les architectures existantes contiennent souvent des conditions profondément imbriquées, des flux récursifs, des hypothèses environnementales ou des comportements spécifiques à la plateforme que la vérification formelle ne peut intégrer sans une abstraction précise. Des méthodes analytiques telles que l'analyse de flux multiprocédural, la résolution des dépendances et le traçage des flux de données révèlent des effets secondaires cachés ou des mutations d'état essentiels à la formalisation. L'exploration de sujets tels que… modèles d'analyse d'impact Illustrer comment la compréhension organisationnelle des facteurs d'exécution permet d'établir des obligations de preuve plus précises. Intégrées de manière stratégique, l'analyse statique et l'interprétation abstraite forment un processus qui transforme des bases de code complexes en spécifications vérifiables avec une précision mathématique.

Dérivation de surapproximations fiables pour des bases de code volumineuses et hétérogènes

Les systèmes d'entreprise de grande envergure contiennent du code couvrant de multiples paradigmes, décennies et domaines opérationnels. L'interprétation abstraite est particulièrement bien placée pour unifier cette diversité en construisant des approximations sémantiques qui restent valides quelles que soient les spécificités d'implémentation. Un système de compensation financière mondial, par exemple, peut inclure une logique de règlement COBOL, des services d'orchestration Java, des modules d'analyse Python et une infrastructure de messagerie en temps réel. Chacun de ces éléments introduit des comportements uniques, mais la vérification formelle exige un modèle sémantique cohérent. L'interprétation abstraite y parvient en mappant toutes les constructions dans des domaines unifiés : intervalles, octogones, contraintes symboliques ou abstractions relationnelles qui généralisent le comportement tout en préservant la validité du modèle.

La construction de ces abstractions exige une gestion rigoureuse des boucles, des structures dynamiques et des flux inter-procéduraux. Les systèmes existants utilisent souvent des boucles imbriquées avec des variables d'état évolutives liées à des règles métier encodées à travers les couches procédurales. Afin d'éviter une sous-approximation, les analystes calculent des points fixes représentant des conditions d'équilibre stables pour toutes les exécutions possibles. Les résultats d'analyses statiques proviennent notamment de domaines tels que… cartographie des dépendances évolutive Il convient de mettre en évidence les ajustements nécessaires aux limites d'abstraction pour prendre en compte les transitions d'état indirectes. Une fois les sur-approximations convergées, elles servent de base à la génération d'invariants, à la construction de machines à états et à la vérification déductive ou automatisée ultérieure. Lors de la modernisation, ces approximations garantissent que les nouvelles implémentations conservent l'ensemble des comportements requis pour assurer la correction.

Extraction des invariants implicites et des contraintes comportementales cachées dans la logique héritée

Les applications existantes intègrent souvent les contraintes de correction implicitement, plutôt que par une documentation explicite ou des contrats de conception. Ces invariants peuvent résider dans les conventions d'utilisation des variables, les structures de terminaison de boucle, les chemins de repli ou la logique de récupération d'erreurs, intégrés au fil de décennies de développement incrémental. L'interprétation abstraite révèle ces invariants cachés en analysant les propriétés stables sur l'ensemble des chemins possibles. Par exemple, dans un système national de traitement des prestations sociales, les contraintes garantissant des soldes non négatifs, des progressions d'état monotones ou des combinaisons de champs autorisées peuvent ne jamais être explicitement énoncées, mais rester valides sur des millions d'exécutions historiques. La vérification formelle ne peut être menée de manière fiable sans prendre en compte ces propriétés.

Pour les mettre en évidence, les analystes évaluent les états abstraits à travers les boucles, les branches et les frontières des modules. Comme les invariants émergent souvent de la convergence répétée d'états abstraits, leur identification requiert un raisonnement global plutôt qu'une inspection locale. Des études examinant anomalies de propagation des données Il s'agit de montrer comment des interactions subtiles entre les champs peuvent fausser la correction des modèles si elles sont omises. Une fois extraits, les invariants sont formalisés comme prédicats dans les environnements de démonstration de théorèmes ou comme propriétés dans les cadres de vérification de modèles. Ces contraintes deviennent alors des garanties formelles qui doivent être respectées lors des activités de modernisation telles que la migration de schémas de données, le découplage de services ou l'exécution distribuée. Au fur et à mesure de la modernisation, les invariants extraits servent de contrats de régression, préservant ainsi la correction historique sous les nouvelles architectures.

Utilisation de l'interprétation abstraite pour identifier les limites de vérification et les points de réduction du modèle

La vérification formelle exige des limites bien définies ; prouver l’intégralité d’un système d’entreprise de manière monolithique est irréalisable et inutile. L’interprétation abstraite identifie des partitions naturelles qui facilitent la vérification modulaire. Par exemple, une plateforme de contrôle de réseau électrique peut comprendre des modules de prévision, des filtres d’entrée de capteurs, des algorithmes de régulation et une logique de répartition. Bien que tous ces éléments interagissent, toutes les interactions ne sont pas pertinentes pour chaque obligation de preuve. L’interprétation abstraite permet d’isoler les régions sémantiques où le comportement se stabilise ou où les risques de propagation augmentent, permettant ainsi aux ingénieurs de vérification de déterminer quels sous-systèmes nécessitent une preuve approfondie et lesquels peuvent rester abstraits.

Cette identification des limites repose largement sur l'analyse des interdépendances, des modèles de partage d'état et des chaînes de propagation des mutations. Elle s'appuie notamment sur des sujets tels que : modernisation axée sur la dépendance Cet exemple illustre comment la simplification structurelle favorise un raisonnement plus robuste. En identifiant les zones d'effets secondaires contrôlés ou de transitions déterministes, les analystes construisent des modèles formels réduits, adaptés à la démonstration de théorèmes ou à la vérification de modèles. Ces réductions améliorent considérablement les performances de vérification en éliminant les variables d'état ou les chemins d'exécution superflus. Lors de la modernisation, la réduction de modèles garantit que les nouvelles fonctionnalités architecturales, telles que la messagerie asynchrone ou les pipelines de flux, ne remettent pas en cause les hypothèses nécessaires à un raisonnement valide.

Relier la sémantique abstraite aux obligations de preuve exécutables dans les outils de vérification modernes

Une fois les abstractions stabilisées, elles doivent être traduites en obligations de preuve concrètes pour les moteurs de vérification formelle. Cette traduction comprend la génération d'invariants inductifs, la formulation de préconditions, la définition des transitions d'état autorisées et la construction de contrats comportementaux que les vérificateurs de modèles ou les démonstrateurs de théorèmes peuvent évaluer. Cette étape constitue le lien entre le raisonnement statique et la vérification mathématique. Par exemple, un moteur de routage de télécommunications en cours de modernisation peut s'appuyer sur des contraintes garantissant qu'aucune table de routage ne devienne vide lors d'un basculement. L'interprétation abstraite identifie les conditions dans lesquelles de tels états deviennent accessibles. Les équipes de vérification encodent ensuite ces conditions dans des cadres de logique temporelle ou de raisonnement inductif afin de garantir que la logique de basculement se comporte comme prévu quelles que soient les conditions du réseau.

Les données statiques fournissent un contexte essentiel à la formulation de ces obligations. Explorations dans méthodologies de suivi de modèles Démontrer comment les séquences opérationnelles façonnent les exigences de vérification. En alignant la sémantique abstraite sur ces modèles d'exécution, les obligations de preuve qui en résultent restent fidèles au comportement réel du système. À mesure que la modernisation introduit de nouvelles abstractions architecturales, les équipes de vérification régénèrent les obligations de manière incrémentale, garantissant ainsi que les variations émergentes du système restent cohérentes avec les conditions de correction historiquement validées. Ceci assure que la vérification formelle demeure une discipline continue et alignée sur l'architecture, et non un exercice ponctuel.

Conception contractuelle et raisonnement par garantie pour les interfaces de systèmes complexes

La conception contractuelle offre une méthode rigoureuse pour définir précisément les comportements attendus des composants critiques d'un système. Dans les environnements à haute fiabilité et sensibles à la modernisation, les composants fonctionnent rarement de manière isolée. Leur bon fonctionnement dépend plutôt des garanties fournies par les modules en amont et en aval. Les contrats formalisent ces relations sous forme d'hypothèses et de garanties qui définissent le comportement des composants dans toutes les conditions admissibles. Ces contrats constituent le fondement d'une vérification systématique, car ils transforment des exigences initialement vagues en spécifications logiques précises. Avec le remplacement des systèmes monolithiques par des architectures distribuées et des conceptions orientées services, la conception contractuelle devient essentielle pour garantir un comportement opérationnel prévisible.

Le raisonnement par garantie d'hypothèses permet aux équipes de vérification de décomposer les grands systèmes en sous-ensembles gérables. Au lieu de prouver les propriétés de l'ensemble du système simultanément, chaque composant est vérifié indépendamment à l'aide de son contrat. Le système global est correct si tous les contrats restent mutuellement cohérents. Ce raisonnement compositionnel est particulièrement important dans les initiatives de modernisation, car les composants existants contiennent souvent des hypothèses implicites différentes de celles attendues dans les services modernisés. Travaux analytiques liés à cohérence multiplateforme Cet exemple montre comment les incohérences introduites lors de la modernisation peuvent engendrer des erreurs subtiles si les hypothèses d'interface ne sont pas formalisées. La conception contractuelle prévient ces incohérences en imposant des limites comportementales claires et vérifiables.

Définition précise des responsabilités d'interface entre composants hétérogènes

Les systèmes critiques comportent souvent des composants hétérogènes qui diffèrent par leurs modèles temporels, leur sémantique d'état, leurs conventions de gestion des erreurs et leurs formats de messages. La conception par contrats offre une approche structurée pour définir les responsabilités au-delà de ces frontières. Prenons l'exemple d'un programme de modernisation migrant un module de traitement des réclamations d'un processus batch mainframe vers un microservice événementiel. Le composant hérité suppose que les enregistrements arrivent triés et que les nouvelles tentatives sont effectuées par des exécutions batch planifiées. Le composant modernisé, en revanche, peut recevoir des événements asynchrones non ordonnés avec différents niveaux d'achèvement partiel. Sans contrats d'interface explicites, le décalage entre les attentes entraîne des mises à jour d'état incohérentes ou une divergence silencieuse des données.

Les ingénieurs en vérification commencent par documenter les prérequis du service de réception, tels que les contraintes d'ordonnancement des données ou les combinaisons de champs valides. Ils définissent ensuite des garanties, comme la mise à jour monotone des enregistrements ou des temps de réponse bornés. Les enseignements tirés des analyses de impact de l'évolution des schémas Les contrats guident souvent la découverte des conventions implicites. Une fois les contrats établis, les ingénieurs vérifient que chaque composant respecte ses garanties lorsque ses hypothèses sont valides. Ce processus assure l'intégrité de l'architecture même lorsque la modernisation modifie la topologie d'exécution, la sémantique de planification ou les environnements de déploiement. Les contrats servent également d'artefacts de régression, garantissant que les améliorations futures ne violent pas insidieusement les limites comportementales établies.

Vérification de la composition pour les programmes de modernisation à grande échelle

Le raisonnement par garantie d'hypothèses permet une vérification à grande échelle en décomposant les obligations de preuve des grands systèmes en unités vérifiables plus petites. Ceci est particulièrement pertinent pour les entreprises qui modernisent des systèmes comportant des millions de lignes de code réparties sur de multiples plateformes. Tenter de raisonner de manière monolithique sur de tels systèmes est informatiquement irréalisable. Le raisonnement compositionnel résout ce problème en vérifiant chaque composant sous des hypothèses explicitement énoncées. Ces preuves locales sont ensuite combinées pour inférer la correction au niveau du système.

Un système de planification d'itinéraires de transport offre un exemple pertinent. Les modules existants calculent les itinéraires optimaux à l'aide d'algorithmes déterministes. Les microservices modernisés introduisent l'exploration parallèle des chemins, la messagerie asynchrone et les caches de données distribués. Sans décomposition structurée, la vérification de l'exactitude du routage de bout en bout devient impossible. Les équipes de vérification définissent des contrats qui capturent les comportements requis, tels que la cohérence des mises à jour de routage ou la disponibilité des index géospatiaux. Des études connexes analyse d'impact pour la modernisation Il convient de souligner que les hypothèses héritées restent souvent implicites. Une fois les responsabilités clairement définies par les contrats, chaque composant est vérifié indépendamment, ce qui rend le processus de raisonnement global plus gérable. La modernisation se déroulant par phases, la vérification compositionnelle garantit que les services nouvellement introduits conservent leur exactitude avant même la fin de la migration complète.

Gestion des conditions environnementales incertaines et variables dans les systèmes distribués

Les systèmes distribués fonctionnent dans des conditions variables qui influent sur la latence, le débit, l'ordonnancement et le comportement en cas de panne. La conception contractuelle permet de gérer ces incertitudes en formalisant les hypothèses environnementales qui doivent être respectées pour que les garanties du système restent valides. Par exemple, un système d'orchestration des paiements peut supposer des limites supérieures pour les délais de transmission des messages, des garanties minimales de cohérence pour les services de stockage ou un comportement prévisible des microservices dépendants en matière de nouvelles tentatives. Ces hypothèses sont intégrées au contrat et permettent aux équipes de vérification de déterminer précisément quand les garanties s'appliquent.

Lors de la modernisation de tels systèmes, les caractéristiques environnementales évoluent souvent. La migration vers le cloud introduit une variabilité réseau supplémentaire. Le remplacement des appels de base de données synchrones par des files d'attente asynchrones modifie la sémantique d'ordonnancement. Analyses issues de comportements d'exécution simultanée Il est essentiel de comprendre comment les changements environnementaux influencent la logique des composants. Les contrats intègrent ces dépendances afin de garantir la correction dans diverses conditions d'exécution. Les équipes de vérification utilisent ensuite le principe de garantie par hypothèse pour prouver que, même dans les scénarios les plus défavorables mais admissibles, des propriétés globales telles que la disponibilité, la cohérence des données et l'idempotence restent intactes. En documentant explicitement les hypothèses environnementales, les entreprises évitent les régressions accidentelles lors des transitions d'architecture.

Garantir la stabilité comportementale lors des déploiements progressifs et hybrides

La modernisation se déroule rarement en une seule transformation. Les organisations exploitent plutôt des architectures hybrides où coexistent composants existants et services modernisés. La conception contractuelle contribue à maintenir la stabilité durant ces phases de transition en spécifiant les interfaces comportementales exactes qui doivent être respectées avant l'intégration. Prenons l'exemple d'un système logistique mondial où les mises à jour de suivi transitaient initialement par un système centralisé. La migration introduit des nœuds de traitement distribués et des services spécifiques à chaque région. Un défaut de documentation des hypothèses d'interface entraîne des mises à jour incohérentes ou des transitions d'état désordonnées.

Les équipes de vérification établissent des contrats précis qui décrivent les propriétés requises, telles que les garanties d'ordonnancement, l'exhaustivité des événements et la logique de validation. Les résultats analytiques relatifs à risques de dépendance dominants Cette approche permet de révéler les zones où des modifications structurelles subtiles engendrent des comportements inattendus. Le raisonnement par garantie d'hypothèses permet aux équipes de vérifier localement l'exactitude des composants avant leur intégration dans des déploiements hybrides. À mesure que la modernisation progresse, chaque nouveau composant est validé dans le contexte du cadre contractuel en constante évolution. Cette validation par étapes garantit que le système préserve ses propriétés comportementales globales, même lorsque des modules individuels modifient leurs détails d'implémentation ou leurs environnements d'exécution.

Intégration des méthodes formelles dans les pipelines CI/CD DevSecOps et d'assurance qualité

L'intégration de la vérification formelle dans les pipelines de déploiement d'entreprise exige de passer de contrôles de correction isolés à un raisonnement continu et automatisé. Les systèmes critiques pour la sécurité et les systèmes d'évolution fonctionnent dans des environnements où les changements sont fréquents, souvent au sein d'équipes distribuées et d'architectures hybrides. Sans vérification continue, même des mises à jour mineures risquent de modifier le comportement et de remettre en cause des hypothèses validées. Les organisations intègrent donc la démonstration de théorèmes, la vérification de modèles et la validation par contrat dans leurs flux de travail CI/CD afin de garantir que les exigences de correction restent synchronisées avec l'évolution du code. Cette intégration fait le lien entre le développement, l'assurance qualité et la gouvernance architecturale.

Les pratiques DevSecOps renforcent cet alignement en intégrant les responsabilités de sécurité et de correction tout au long du pipeline. Les méthodes formelles renforcent ces responsabilités en identifiant les risques structurels que les tests automatisés ne peuvent pas détecter. L'introduction de services cloud, de limites de microservices et de modèles événementiels accroît la surface d'exposition aux défauts liés à la concurrence, à l'ordonnancement ou à un mauvais alignement des interfaces. Des études telles que l'examen de Intégration de l'analyse CI/CD Il convient de souligner comment le raisonnement automatisé contribue à la fois à la sécurité et à la modernisation. En intégrant des contrôles de vérification formels à chaque étape de validation, de compilation ou de déploiement, les organisations transforment la conformité en une discipline continue et applicable.

Intégration de la vérification de modèles et de la vérification de propriétés dans les pipelines de construction

La vérification de modèles s'intègre efficacement aux flux de travail CI/CD car elle peut s'exécuter automatiquement après chaque modification de code, validant ainsi le maintien des propriétés de sécurité, de disponibilité et d'ordonnancement. Ceci est particulièrement important dans les initiatives de modernisation à grande échelle où les composants sont progressivement réécrits ou migrés vers une nouvelle plateforme. Prenons l'exemple d'un moteur de calcul des risques d'entreprise en cours de migration d'une architecture mainframe par lots vers une topologie de microservices distribuée. Même de petites modifications dans le routage des messages, les intervalles de planification ou les étapes de validation des données peuvent introduire de nouveaux chemins d'exécution qui enfreignent les invariants attendus.

Les équipes de vérification configurent les étapes de vérification de modèles au sein du pipeline afin qu'elles se déclenchent à chaque fusion ou déploiement. Ces étapes génèrent des modèles d'état, appliquent des règles d'abstraction et évaluent les propriétés à l'aide de stratégies de recherche bornées ou non bornées. Un travail analytique est effectué sur détection du risque de régression Cette méthode permet d'identifier les régressions de performance et de correction qui n'apparaissent que dans certaines conditions de temps ou de charge. La vérification de modèles complète ces méthodes en garantissant la validité des conditions structurelles et logiques pour toutes les traces d'exécution possibles. Lors de la modernisation, chaque vérification réussie confirme que les transformations incrémentales ne compromettent pas les garanties de correction établies. Les échecs génèrent des traces de contre-exemples qui guident les développeurs dans la correction des problèmes avant leur mise en production.

Utilisation du raisonnement symbolique pour détecter des écarts logiques subtils lors d'itérations rapides

Les outils de raisonnement symbolique permettent aux pipelines de détecter les écarts logiques qui échappent aux tests conventionnels. Ces outils évaluent les chemins d'exécution en représentant les variables et les états du système de manière symbolique plutôt que concrète. Cette approche révèle les écarts structurels introduits lors de la refactorisation, du changement de plateforme ou de la refonte d'interface. Un scénario représentatif concerne un module d'autorisation de paiement d'entreprise en cours de modernisation progressive. La logique existante inclut un comportement de repli implicite qui ne se déclenche que dans de rares conditions temporelles. Lorsque le module est réimplémenté en tant que service asynchrone, l'analyse symbolique identifie les différences dans la propagation des erreurs.

Intégré aux flux de travail CI/CD, le raisonnement symbolique permet de détecter ces écarts dès les premières étapes du pipeline. Les ingénieurs définissent des propriétés symboliques telles que les conditions de normalisation, les exigences d'ordonnancement ou les obligations de préservation des invariants. Des enseignements statiques tirés de travaux sur modèles de revue de code automatisée Démontrer comment le raisonnement statique et symbolique collaborent pour mettre au jour des problèmes cachés. Les moteurs de raisonnement symbolique s'exécutent au sein du pipeline afin de comparer le comportement avant et après chaque modification. Ce processus garantit que la modernisation n'introduit pas d'erreurs logiques subtiles mais à fort impact. À mesure que les systèmes évoluent vers des modèles distribués, les contrôles symboliques contribuent à maintenir l'équivalence entre le comportement existant et la sémantique des implémentations modernes.

Intégrer la validation des contrats aux portes de sécurité DevSecOps

Avec la multiplication des interfaces système liée à la modernisation, la conception basée sur les contrats devient essentielle pour garantir le comportement cohérent des composants dans différents environnements. Les pipelines DevSecOps intègrent des mécanismes de validation de contrats qui vérifient si les composants respectent les hypothèses et garanties définies. Ces mécanismes empêchent la propagation de modifications incompatibles en amont. Par exemple, dans un système national d'information de santé, les services d'acheminement des demandes d'orientation reposent sur des contraintes strictes d'ordonnancement et de validation. Si la modernisation modifie les formats de messages, les règles d'encodage ou la sémantique d'ordonnancement, l'absence de validation de contrats permet à des mises à jour erronées de se propager à l'ensemble du système.

Les outils de validation de contrats analysent les modifications entrantes en vérifiant si les composants révisés conservent les garanties comportementales requises. Ils vérifient également que les hypothèses environnementales restent satisfaites compte tenu des dépendances en aval. Les enseignements tirés de la recherche sur validation d'impact axée sur la recherche Cet exemple illustre comment la compréhension des dépendances transitoires influence la définition des contrats. Lors de l'exécution du pipeline, les validateurs de contrats bloquent les déploiements qui enfreignent les limites de conformité et fournissent des diagnostics exploitables. Ceci garantit une modernisation sécurisée, même lorsque les équipes travaillent en parallèle sur plusieurs composants et environnements d'exécution.

Établir des preuves d'assurance par un raisonnement formel continu

La vérification formelle fournit les preuves d'assurance requises pour la certification de sécurité, la conformité réglementaire et la gouvernance de la modernisation. L'intégration de ces preuves dans les pipelines CI/CD et DevSecOps transforme l'assurance d'une activité périodique en un processus continu. Chaque artefact de preuve, trace de vérification de modèle ou enregistrement de validation de contrat est intégré à un historique auditable qui documente la correction du système au fil du temps. Par exemple, une plateforme d'authentification biométrique utilisée dans les services du secteur public peut exiger la preuve que toutes les mises à jour préservent les garanties de disponibilité, l'intégrité des données et la sémantique de reprise après incident.

Les pipelines stockent automatiquement ces artefacts et les associent aux identifiants de build, aux événements de déploiement et aux modifications architecturales. Cela permet aux équipes de conformité de suivre les obligations de correction à chaque étape de la modernisation. Travaux analytiques sur cartographie des défaillances critiques Cela aide les organisations à comprendre la propagation des écarts, renforçant ainsi les arguments en matière d'assurance. En intégrant des méthodes formelles à la gouvernance des pipelines, les entreprises préservent la fiabilité opérationnelle malgré l'évolution des systèmes. Cet enregistrement continu des vérifications permet d'orienter la stratégie de modernisation à long terme en identifiant les composants stables, les zones fragiles et les vecteurs de risque émergents.

Mise à l'échelle de la vérification formelle sur des bases de code héritées, hétérogènes et polyglottes

Le passage à l'échelle de la vérification formelle exige des organisations qu'elles dépassent le cadre des preuves isolées et adoptent des stratégies systématiques capables de gérer des bases de code d'entreprise avec un long historique opérationnel. Les systèmes existants utilisent souvent plusieurs langages, formats de données et modèles d'exécution, créant ainsi des environnements de vérification très différents des architectures modulaires modernes. Ces systèmes comprennent des programmes par lots, des composants événementiels, des langages spécifiques au domaine et des règles métier intégrées, tissées au fil de décennies d'évolutions progressives. Les équipes de vérification doivent donc unifier des sémantiques diverses au sein d'un cadre de modélisation et de raisonnement cohérent. Le défi s'intensifie lorsque la modernisation se déroule en parallèle, car le code existant et le code moderne doivent être vérifiés simultanément. Perspectives analytiques sur conception d'intégration d'applications Démontrer comment les infrastructures hétérogènes compliquent le raisonnement inter-composants. La vérification formelle n'est réussie que si cette complexité est prise en compte grâce à une abstraction et une modularisation évolutives.

Les systèmes polyglottes complexifient davantage la vérification en introduisant des langages aux règles de typage, sémantiques de concurrence, conventions de gestion des erreurs et caractéristiques d'exécution différentes. Dans de nombreuses entreprises, des décennies d'investissement ont engendré des écosystèmes où coexistent COBOL, Java, Python, SQL et des langages de script propriétaires. Garantir l'exactitude dans de tels environnements exige des stratégies de vérification qui généralisent le comportement sans compromettre la précision nécessaire aux garanties de disponibilité, de sécurité et d'ordonnancement. Les enseignements tirés de recherches sur analyse des graphes de dépendance Démontrer comment la cartographie structurelle révèle des interactions interlinguistiques cachées qui doivent être intégrées aux modèles formels. À mesure que les organisations modernisent ces environnements polyglottes en architectures distribuées ou natives du cloud, la vérification à grande échelle devient essentielle pour prévenir les régressions et préserver l'intégrité opérationnelle.

Harmonisation de la sémantique entre plusieurs langages et paradigmes d'exécution

L'une des principales difficultés de la vérification des systèmes polyglottes réside dans la conciliation des sémantiques disparates des différents langages au sein d'une abstraction unifiée. Par exemple, une plateforme de traitement d'assurance existante peut inclure des programmes batch COBOL, des intergiciels Java, une logique frontale JavaScript et des extensions analytiques Python. Chaque langage présente une sémantique unique pour la concurrence, la gestion des exceptions, la modification d'état et la gestion de la mémoire. La vérification formelle exige une abstraction cohérente de ces fonctionnalités afin que les modèles reflètent fidèlement le comportement global du système.

Pour ce faire, les équipes de vérification élaborent des profils sémantiques pour chaque langage, identifiant les constructions qui influencent le flux de contrôle, les transitions d'état et la propagation des erreurs. Ces profils constituent la base de modèles indépendants du langage, tels que les machines à états étendus ou les structures relationnelles symboliques. Des travaux analytiques sur modernisation des technologies mixtes Ce document explique comment les dépendances entre langages évoluent lors de la modernisation. Par exemple, le remplacement des routines COBOL synchrones par des microservices asynchrones modifie la sémantique de communication, ce qui doit être reflété dans les modèles formels. Les équipes de vérification utilisent le raisonnement symbolique, l'interprétation abstraite et les contrats d'interface pour harmoniser les comportements. Une fois la sémantique unifiée établie, les démonstrateurs de théorèmes et les vérificateurs de modèles opèrent sur un modèle unique et cohérent, permettant une validation de bout en bout et à grande échelle des propriétés de correction.

Partitionnement des grandes bases de code en modules prêts pour la vérification

Pour rester gérables, les grands systèmes doivent être décomposés en segments prêts à être vérifiés. Tenter de modéliser et de vérifier simultanément une application monolithique entière conduit à une explosion d'états ingérable et à des obligations de preuve ingérables. Une mise à l'échelle efficace nécessite un partitionnement basé sur les limites architecturales, la propriété des données, les phases d'exécution ou les hiérarchies de dépendances. Prenons l'exemple d'un système de contrôle de production global comportant des milliers de programmes interagissant. Certains composants gèrent l'acquisition des données des capteurs, d'autres coordonnent la manutention des matériaux, tandis que des modules prédictifs fonctionnent de manière asynchrone sur des modèles statistiques. Les équipes de vérification doivent identifier des frontières de vérification naturelles qui isolent les unités de comportement stables.