La gestion de la mémoire est un aspect fondamental de la programmation, essentiel à la stabilité et aux performances des applications. Parmi les défis associés à la gestion de la mémoire figure le phénomène des fuites de mémoire, qui peuvent dégrader considérablement les performances d'une application, voire la faire planter. Cet article explique ce que sont les fuites de mémoire, leurs causes, comment elles peuvent être détectées et les méthodes pour les éviter. De plus, il comprend des exemples de codage pratiques et explique comment utiliser SMART TS XL peut améliorer la détection, l'analyse et la prévention des fuites de mémoire grâce à une analyse statique avancée, à la création d'organigrammes et à des améliorations de la qualité du code.

BESOIN DE RÉPARER LES FUITES DE MÉMOIRE ?

SMART TS XL est votre solution idéale pour détecter les fuites de mémoire dans des millions de lignes de code

Explorez maintenantQue sont les fuites de mémoire ?

Une fuite de mémoire se produit lorsqu'un programme alloue de la mémoire à partir du tas, mais ne parvient pas à la libérer lorsqu'elle n'est plus nécessaire. Par conséquent, la mémoire n'est plus utilisée par le programme, mais ne peut pas être récupérée par le système d'exploitation ou d'autres processus. Au fil du temps, ces blocs de mémoire non libérés s'accumulent, réduisant la quantité de mémoire disponible, ce qui peut entraîner une baisse des performances et éventuellement le blocage du programme si le système manque de mémoire.

Dans les langages gérés comme Java ou C#, la gestion de la mémoire est assurée par le garbage collector, qui récupère automatiquement la mémoire qui n'est plus référencée. Cependant, même dans ces environnements, des fuites de mémoire peuvent se produire si des objets sont toujours référencés par inadvertance, empêchant le garbage collector de libérer la mémoire.

Causes des fuites de mémoire

Les fuites de mémoire comptent parmi les problèmes les plus répandus et les plus insidieux du développement logiciel. Elles dégradent silencieusement les performances et déstabilisent les applications au fil du temps. Elles se produisent généralement lorsqu'un programme alloue de la mémoire, mais ne la libère plus une fois les données devenues inutiles. Contrairement aux plantages ou aux bugs évidents, les fuites passent souvent inaperçues lors des tests initiaux et n'apparaissent qu'après une utilisation prolongée, lorsque l'application ralentit considérablement ou s'arrête brutalement en raison d'un épuisement des ressources système.

L'impact des fuites de mémoire peut aller de simples inefficacités à des pannes catastrophiques, notamment sur les systèmes à exécution longue comme les serveurs, les appareils embarqués ou les applications mobiles. Dans les cas extrêmes, les fuites peuvent provoquer des ralentissements à l'échelle du système, obligeant les utilisateurs à redémarrer leurs appareils ou services pour récupérer de la mémoire. Même dans les langages utilisant le ramasse-miettes comme Java ou Python, où la gestion automatique de la mémoire est censée gérer le nettoyage, de subtiles erreurs de programmation peuvent néanmoins entraîner des fuites via des références persistantes ou des ressources non fermées.

Comprendre les causes profondes des fuites de mémoire est essentiel pour les développeurs, quel que soit leur niveau d'expertise. Qu'ils travaillent avec des langages de bas niveau comme C++, qui nécessitent une gestion manuelle de la mémoire, ou avec des langages de haut niveau utilisant le ramasse-miettes, les programmeurs doivent adopter des pratiques rigoureuses pour prévenir les fuites. Cet article explore les sources les plus courantes de fuites de mémoire, offrant un aperçu de leur apparition et des stratégies pour les atténuer. En identifiant ces pièges, les développeurs peuvent écrire du code plus efficace, plus fiable et plus facile à maintenir, garantissant ainsi des performances optimales à leurs applications tout au long de leur cycle de vie.

Erreurs de gestion manuelle de la mémoire

Dans des langages comme C et C++, la gestion de la mémoire est entièrement manuelle. Cela signifie que chaque bloc de mémoire alloué dynamiquement utilise malloc, calloc, ou new doit être explicitement désalloué avec free or deleteUne fuite de mémoire se produit lorsque les développeurs oublient de libérer cette mémoire lorsqu'elle n'est plus nécessaire. Ces omissions sont souvent dues à des flux de contrôle complexes, des retours prématurés ou une gestion des exceptions qui contournent les appels de désallocation. Outre l'absence de désallocation, une réallocation incorrecte, comme la perte d'un pointeur vers la mémoire allouée avant sa libération, conduit également à une mémoire irrécupérable. Un autre piège majeur est l'utilisation de pointeurs suspendus, qui sont des références à de la mémoire déjà libérée. Cela peut entraîner un comportement indéfini ou des plantages difficiles à diagnostiquer. Les développeurs doivent respecter une discipline stricte et des normes de revue de code lorsqu'ils gèrent manuellement la mémoire. Des outils comme Valgrind, AddressSanitizer et les vérifications intégrées de Clang sont essentiels pour suivre les allocations et garantir que chaque malloc or new a un correspondant free or deleteDans la programmation de systèmes critiques, les fuites de ressources causées par des erreurs de mémoire manuelles peuvent dégrader les performances ou entraîner un comportement imprévisible de l'application au fil du temps.

Structures de données illimitées ou croissantes

Les collections qui croissent au fil du temps sans limites appropriées sont une source fréquente de fuites de mémoire, notamment dans les applications de longue durée. Les structures de données telles que les listes, les files d'attente, les dictionnaires et les caches sont souvent utilisées pour stocker des objets destinés à un traitement ou à une recherche temporaires. Si les anciennes entrées ne sont jamais supprimées ou n'expirent jamais, la structure continue de consommer de la mémoire même après que les données deviennent inutiles. Par exemple, un système de journalisation peut ajouter chaque message à une liste qui n'est jamais effacée, ou une couche de mise en cache peut stocker les résultats de requêtes indéfiniment sans aucune stratégie d'expiration. Dans les applications à haut volume, ces structures peuvent croître jusqu'à contenir des milliers, voire des millions d'objets, provoquant à terme des situations de saturation de mémoire. Les développeurs doivent implémenter des limites, des intervalles de nettoyage ou des politiques d'éviction des données les moins récemment utilisées (LRU) pour garantir que les structures de données ne croissent pas sans contrôle. Dans les langages utilisant le ramasse-miettes, ce type de fuite est particulièrement délicat, car la mémoire est techniquement accessible et ne sera donc pas collectée. La surveillance de la taille de la collection et la mise en place de contrôles pour éliminer les entrées anciennes ou inutilisées permettent d'éviter une lente progression de la mémoire qui pourrait autrement passer inaperçue lors du développement ou des tests à petite échelle.

Références circulaires dans les langages à collecte de mémoire

Les langages utilisant le ramasse-miettes comme Java, Python et JavaScript simplifient la gestion de la mémoire en nettoyant automatiquement les objets inaccessibles. Cependant, les références circulaires posent un problème subtil. Lorsque deux objets ou plus se réfèrent l'un à l'autre et ne sont plus utilisés par l'application, leurs références mutuelles empêchent le ramasse-miettes de déterminer s'ils peuvent être supprimés en toute sécurité. Bien que les ramasse-miettes modernes aient amélioré leur capacité à détecter ces cycles, tous les environnements ou types de collecteurs ne les gèrent pas efficacement. De plus, les fermetures ou les lambdas de ces langages peuvent capturer involontairement des variables de portée parente, ce qui maintient les objets en vie au-delà de leur cycle de vie prévu. Ce problème survient souvent dans les applications utilisant une programmation réactive, des systèmes d'événements ou des graphes d'objets formant des boucles serrées. Il est recommandé de rompre manuellement ces cycles en annulant les références ou en utilisant des références faibles. Certains langages proposent également des structures de données spécialisées ou des gestionnaires de contexte qui minimisent le risque de formation de chaînes de références fortes. Sans attention à ce détail, les références circulaires peuvent accumuler silencieusement de la mémoire, entraînant une dégradation des performances et des fuites difficiles à détecter.

Ressources non fermées

Les applications qui interagissent avec des ressources système telles que des fichiers, des connexions à des bases de données, des sockets réseau ou des flux doivent s'assurer que ces ressources sont explicitement libérées. Contrairement aux objets classiques qui peuvent être récupérés par le ramasse-miettes, ces ressources sont souvent liées à des handles du système d'exploitation et nécessitent un nettoyage manuel ou structuré. Si un fichier est ouvert mais jamais fermé, ou si une connexion à une base de données est laissée en suspens, cela consomme non seulement de la mémoire, mais réserve également des descripteurs de fichiers, des connexions socket ou des emplacements de pool de base de données. À terme, cela peut entraîner l'épuisement des handles de fichiers ou le blocage des pools de connexions. Les langages de programmation modernes proposent souvent des constructions telles que try-with-resources en Java, using en C#, ou des gestionnaires de contexte en Python pour garantir la fermeture des ressources même en cas d'exception. Les développeurs qui ignorent ou contournent ces constructions risquent d'introduire des fuites de ressources silencieuses mais dommageables. Dans les grands systèmes, même un faible pourcentage de ressources non fermées peut entraîner des problèmes à l'échelle du système, en particulier lorsque les applications évoluent sous des charges simultanées. Le suivi et la fermeture fiables des ressources doivent être une pratique fondamentale dans tout workflow de développement.

Variables statiques et globales

Les variables statiques et globales sont conçues pour persister pendant toute la durée de vie d'une application, ce qui les rend intrinsèquement risquées si elles ne sont pas gérées avec soin. Lorsque ces variables contiennent des objets volumineux, des données temporaires ou des références à des composants d'interface utilisateur ou à des informations spécifiques à une session, elles empêchent le ramasse-miettes de récupérer cette mémoire, même lorsqu'elle n'est plus utile. Un cache statique qui n'est jamais vidé, ou un service global qui conserve indéfiniment d'anciens résultats, consomme progressivement de la mémoire. Ce problème est particulièrement problématique dans les systèmes qui gèrent des sessions utilisateur, des transactions ou des tâches par lots où différents contextes sont traités de manière répétée. Si le champ statique accumule l'état de chaque instance et ne se réinitialise jamais, le coût mémoire augmente avec l'utilisation. Les développeurs doivent limiter l'utilisation des variables statiques à des constantes ou à des utilitaires simples dont la pertinence est garantie tout au long du cycle de vie de l'application. Si un stockage persistant est requis, des mécanismes de suppression ou d'invalidation périodiques des valeurs stockées doivent être mis en œuvre. Des audits et un profilage réguliers de la mémoire peuvent également aider à détecter une croissance inattendue de la mémoire causée par des références statiques mal définies.

Fuites liées aux fils de discussion

Les applications multithread présentent des défis uniques en matière de gestion de la mémoire, notamment en ce qui concerne le stockage local des threads et les threads à longue durée de vie. Lorsque des données sont stockées dans des variables locales de thread mais jamais effacées, elles restent associées au thread tant qu'il existe. Cela provoque une fuite mémoire si le thread persiste plus longtemps que nécessaire ou est réutilisé indéfiniment dans un pool de threads. De plus, les threads d'arrière-plan bloqués, en veille ou en attente d'événements peuvent conserver des objets longtemps après leur utilisation. Si un thread référence une classe censée être éphémère, comme un objet de requête ou un tampon temporaire, cette classe ne peut être récupérée qu'à la fin du thread. Lorsque les threads sont mal gérés ou abandonnés, ces fuites persistent silencieusement et augmentent avec l'évolution du système. Les bonnes pratiques incluent le nettoyage explicite des variables locales de thread, la garantie que les threads à longue durée d'exécution libèrent les références inutiles et la conception des threads de travail pour réinitialiser leur contexte entre les tâches. La taille et la consommation de mémoire des pools de threads doivent également être surveillées afin de détecter si les threads inactifs conservent plus de données que prévu.

Problèmes liés aux bibliothèques tierces

Les fuites de mémoire ne proviennent pas toutes de votre propre code. Les bibliothèques et les frameworks, en particulier ceux qui interagissent avec des composants graphiques, audio ou du matériel externe, peuvent contenir leurs propres fuites ou exposer des API nécessitant un nettoyage explicite. Si ces API ne sont pas utilisées correctement, par exemple en cas d'échec de l'appel d'une fonction, dispose() or shutdown() méthode, les ressources qu'elles gèrent restent allouées. Ce phénomène est particulièrement fréquent dans les bibliothèques anciennes, ou plus récentes, qui s'abstraient de la complexité, mais ne documentaient pas correctement les exigences du cycle de vie. Dans certains cas, les bibliothèques implémentent leurs propres stratégies de mise en cache ou de pool de ressources, ce qui peut conserver les objets en mémoire plus longtemps que prévu. Ces caches peuvent être paramétrables ou totalement opaques. De plus, l'intégration d'une bibliothèque peut conserver par inadvertance des références aux objets de votre application (par exemple, l'enregistrement d'un rappel qui n'est jamais supprimé), ce qui empêche la collecte de vos objets. Les développeurs doivent examiner attentivement la documentation de tout code tiers qu'ils incluent et surveiller l'utilisation de la mémoire au fil du temps afin de détecter les fuites introduites par les bibliothèques. Tester les intégrations tierces sous charge ou utiliser des outils de profilage permet de détecter ces problèmes au plus tôt.

Fuite des poignées du système d'exploitation

Les fuites de mémoire ne se limitent pas aux allocations de tas. Les applications dépendent également fortement des handles du système d'exploitation, tels que les descripteurs de fichiers, les handles d'interface graphique, les sockets et les sémaphores. Chacune de ces ressources possède une limite définie au niveau du système. Lorsque les handles ne sont pas fermés correctement, le système finit par manquer de ressources, même si la mémoire semble disponible. Par exemple, l'échec de la fermeture d'un descripteur de fichier sous Linux entraîne des erreurs telles que « Trop de fichiers ouverts », qui peuvent interrompre les services de manière inattendue. Dans les environnements Windows, les handles d'interface graphique (GDI) divulgués peuvent empêcher l'affichage de nouvelles fenêtres ou d'éléments d'interface utilisateur. Les fuites de handles sont particulièrement difficiles à diagnostiquer, car elles peuvent ne pas être détectées par les profileurs de mémoire traditionnels. Des outils de surveillance spécifiques à votre plateforme, tels que lsof sous Unix ou le Gestionnaire des tâches sous Windows, peut révéler une utilisation anormale des handles. Les développeurs doivent auditer attentivement leurs routines de gestion des ressources et s'assurer que chaque allocation correspond à une version. L'utilisation de modèles RAII ou de gestionnaires de ressources à portée limitée peut contribuer à garantir un comportement correct, tant dans les systèmes de haut niveau que de bas niveau.

Abonnements et rappels aux événements

Les systèmes pilotés par événements sont sujets aux fuites de mémoire lorsque les composants s'enregistrent à des événements sans jamais être désenregistrés. Cela est particulièrement vrai pour les applications utilisant des éditeurs d'événements à longue durée de vie, comme les frameworks d'interface utilisateur, les bus de messagerie ou les pipelines réactifs. Lorsqu'un écouteur est enregistré et non supprimé, l'éditeur conserve une référence à cet écouteur, préservant ainsi l'intégralité du graphe d'objets. Par exemple, si un widget d'interface utilisateur écoute les mises à jour d'un modèle partagé mais n'est jamais désenregistré lorsqu'il est supprimé de l'écran, il reste en mémoire. Dans les applications JavaScript, les nœuds DOM attachés aux événements globaux sont une cause fréquente de fuites lorsque les nœuds sont supprimés visuellement, mais non détachés programmatiquement. La solution réside dans une gestion symétrique du cycle de vie. Chaque enregistrement doit être associé à une désinscription explicite. Certains frameworks prennent en charge les modèles d'événements faibles ou les hooks de nettoyage automatique afin de minimiser la charge de travail des développeurs. Cependant, se fier uniquement à ces éléments est risqué, sauf si leur comportement est confirmé lors du démontage. Les revues de code et les tests doivent toujours inclure la vérification de la résiliation correcte des abonnements aux événements.

Mauvaise utilisation du pointeur intelligent C++

Pointeurs intelligents C++ comme unique_ptr, shared_ptr et weak_ptr sont des outils puissants pour la gestion automatisée de la mémoire, mais mal utilisés, ils peuvent provoquer des fuites de mémoire subtiles. Un problème fréquent survient lorsque shared_ptr Les instances forment des références circulaires. Puisque les pointeurs partagés utilisent le comptage de références pour gérer leur durée de vie, les objets pointant entre eux avec une propriété partagée n'atteindront jamais un compte nul, empêchant ainsi la désallocation. Ce problème se rencontre souvent dans les structures parent-enfant ou les relations bidirectionnelles. Les développeurs doivent utiliser weak_ptr dans un sens pour briser le cycle et permettre un nettoyage approprié. Un autre problème réside dans le mélange de pointeurs bruts et de pointeurs intelligents. Si des pointeurs bruts sont utilisés pour contenir des références mal gérées, les avantages des pointeurs intelligents sont réduits. Certains développeurs allouent des objets par erreur en utilisant new et oublier de les encapsuler dans un pointeur intelligent, perdant ainsi la trace de leur propriété. Le respect des principes RAII (Resource Acquisition Is Initialization) est essentiel pour garantir une libération prévisible des ressources. En concevant en tenant compte de la propriété des pointeurs intelligents et en évitant les modèles hybrides de gestion de la mémoire, les développeurs peuvent réduire considérablement les risques de fuites dans le code C++ moderne.

Détection des fuites de mémoire

Les fuites de mémoire sont souvent difficiles à détecter, car elles se développent lentement et ne provoquent pas toujours d'erreurs immédiates. Contrairement aux plantages ou aux bugs de syntaxe, elles peuvent n'apparaître qu'après plusieurs heures ou jours de disponibilité des applications, notamment sur les systèmes soumis à des charges de travail persistantes ou à une forte concurrence. Leur détection nécessite une combinaison d'observation, d'instrumentation et d'outils. Vous trouverez ci-dessous des stratégies pratiques et efficaces pour identifier les fuites de mémoire dans des applications réelles.

Surveiller l'utilisation de la mémoire au fil du temps

L'un des premiers signes d'une fuite de mémoire est une augmentation constante de l'utilisation de la mémoire en fonctionnement normal. On peut l'observer à l'aide d'outils système simples comme le Gestionnaire des tâches sous Windows. top or htop Sous Linux, ou tableaux de bord d'orchestration de conteneurs dans les environnements Kubernetes. L'utilisation de la mémoire devrait fluctuer avec les charges de travail, mais finir par se stabiliser. Si elle continue d'augmenter au fil du temps, notamment pendant les périodes d'inactivité ou après des tâches répétitives, c'est un indicateur fort que la mémoire n'est pas libérée. Dans les systèmes de production, les graphiques d'utilisation de la mémoire peuvent être suivis à l'aide de métriques système ou d'outils de surveillance de l'infrastructure. La corrélation des pics d'utilisation avec des événements applicatifs spécifiques ou des interactions utilisateur peut aider à identifier l'origine de la fuite. Une détection précoce grâce à une surveillance périodique permet d'éviter les pannes et la dégradation des performances.

Utiliser les profileurs de tas et de mémoire

Les profileurs de tas sont des outils essentiels pour visualiser l'utilisation de la mémoire et identifier les objets qui en consomment dans l'application. Ces outils permettent aux développeurs de prendre des instantanés de la mémoire à différents moments, puis de les comparer pour détecter les objets qui augmentent sans être libérés. En Java, VisualVM et Eclipse Memory Analyzer sont couramment utilisés. Les développeurs .NET utilisent souvent dotMemory ou CLR Profiler, tandis que les applications C/C++ bénéficient de Valgrind ou AddressSanitizer. Python propose des outils tels que objgraph et memory_profilerLes profileurs de tas affichent les chaînes de référence, les tailles de mémoire conservées et les arbres d'allocation, permettant ainsi de suivre la conservation de la mémoire. Pour les applications complexes, la combinaison d'instantanés avec une logique de filtrage et de regroupement peut mettre en évidence les zones problématiques. Associés au débogage en direct, les profileurs permettent d'analyser en temps réel les objets qui restent en mémoire plus longtemps que prévu. Ces informations sont essentielles pour diagnostiquer les fuites lentes qui échappent aux journaux traditionnels ou aux métriques système.

Journal de croissance des objets et des collections

L'enregistrement de la taille des structures de données clés ou des pools d'objets au fil du temps est une technique légère mais puissante pour détecter les fuites pendant le développement et les tests. Les développeurs peuvent instrumenter le code pour signaler périodiquement la taille des collections telles que les listes, les cartes, les files d'attente ou les registres de sessions. Dans les scénarios où ces structures de données sont censées croître temporairement puis diminuer, la surveillance de leur taille peut révéler si elles reviennent à leur niveau de référence. Par exemple, si une file de messages traite des tâches mais que la taille de sa liste interne ne diminue jamais, les objets peuvent s'accumuler en raison de lacunes logiques. Ceci est particulièrement utile lorsque le profilage est impossible ou lorsque des fuites sont suspectées dans des domaines fonctionnels spécifiques. En intégrant ces journaux à l'exécution des tâches ou aux flux utilisateurs, les développeurs gagnent en visibilité sur les schémas de rétention d'objets anormaux. Des contrôles de seuil automatisés peuvent être ajoutés pour détecter et alerter en cas de croissance incontrôlée, permettant ainsi de limiter les fuites de mémoire avant qu'elles n'affectent les performances.

Analyser le comportement de la collecte des déchets

Les langages utilisant le ramasse-miettes comme Java, Python et C# offrent des indicateurs utiles de la pression mémoire grâce à leurs journaux de ramasse-miettes. Lorsque le système subit de fréquents cycles de ramasse-miettes avec une récupération de mémoire minimale, cela indique généralement que des objets sont conservés inutilement. L'analyse de ces journaux révèle la fréquence des ramasse-miettes majeures, la quantité de mémoire récupérée et l'évolution de l'utilisation du tas au fil du temps. En Java, des outils comme GCViewer ou journaux JVM intégrés (-XX:+PrintGCDetails) fournissent des informations sur l'efficacité du ramasse-miettes. Une activité excessive du ramasse-miettes peut dégrader les performances de l'application, même si la mémoire n'est pas encore totalement épuisée. Si le ramasse-miettes s'exécute fréquemment mais ne parvient pas à récupérer de l'espace, les développeurs doivent examiner les références d'objet et les chemins d'allocation. Des schémas tels qu'une utilisation croissante de la mémoire d'ancienne génération et de longs temps de pause du ramasse-miettes indiquent souvent la présence d'objets persistants que le système suppose à tort comme étant toujours utilisés. Examiner régulièrement ces schémas est un moyen efficace de détecter la rétention silencieuse de mémoire dans les environnements gérés.

Points chauds d'attribution des pistes

Les outils de profilage peuvent mettre en évidence les fonctions ou modules responsables du plus grand nombre d'allocations d'objets. Les zones sensibles d'allocation ne constituent pas toujours une fuite en soi, mais lorsque certaines zones allouent systématiquement un grand nombre d'objets qui ne sont jamais collectés, cela devient un signal d'alarme. Les profileurs de mémoire peuvent être configurés pour afficher le nombre d'allocations et les traces de pile menant à ces allocations. Dans des langages comme Java, jmap et JProfiler permettent aux développeurs d'identifier les classes et méthodes qui consomment le plus de mémoire. Pour les applications natives, l'outil massif de Valgrind est utile pour tracer les pics d'allocation. Le suivi de ces points chauds permet aux équipes d'inspecter la conception des fonctions ou boucles à forte rotation. Un service qui alloue de la mémoire de manière répétée dans un thread d'interrogation, sans jamais libérer les références à ces objets, peut entraîner une empreinte mémoire à croissance lente. Les développeurs peuvent optimiser ou restructurer ces chemins de code afin de garantir que les objets temporaires soient libérés une fois leur fonction atteinte. En s'attaquant aux points chauds en amont, les fuites à long terme sont minimisées avant qu'elles ne s'accumulent au fil des sessions utilisateur ou des cycles de service.

Observer le comportement de l'application sous charge

Les tests de charge constituent un moyen fiable de détecter les fuites de mémoire qui restent cachées sous les charges de travail de développement classiques. En simulant une forte concurrence, un trafic soutenu ou des schémas d'utilisation répétés, les développeurs peuvent observer le comportement de l'application en situation de stress. Les fuites de mémoire se révèlent souvent dans ces scénarios par une consommation accrue de mémoire, des temps de réponse plus lents et, à terme, des erreurs de mémoire insuffisante. Les résultats des tests de charge doivent être associés à la surveillance et aux journaux de la mémoire afin de déterminer si l'utilisation des ressources se stabilise après la charge ou continue d'augmenter. Des outils comme JMeter, Locust et k6 permettent de simuler la charge, tandis que les métriques système et applicatives fournissent des boucles de rétroaction. Cette méthode est particulièrement utile pour identifier les fuites dans les flux d'authentification, le traitement des fichiers, le streaming de données ou tout chemin de code exécuté par requête. Les tests de charge en environnement de test ou de préproduction permettent aux équipes de découvrir des fuites qui se manifesteraient autrement en production, où la détection devient plus risquée et la correction plus perturbatrice.

Surveiller le nombre de threads ou de handles

Les fuites de mémoire ne se limitent pas à l'utilisation du tas d'objets. Les ressources système telles que les threads, les descripteurs de fichiers, les sockets et les handles d'interface graphique consomment également de la mémoire et doivent être explicitement libérées. La fuite de ces ressources peut épuiser les limites du système d'exploitation, entraînant une instabilité du système ou des plantages d'applications. Les développeurs doivent surveiller les pools de threads, l'état des sockets et les handles de fichiers ouverts pour détecter toute rétention anormale. Des outils comme lsof, netstat, ou des moniteurs de ressources spécifiques à la plateforme, permettent de suivre les ressources ouvertes lors de l'exécution. Par exemple, si une application crée des threads pour gérer des tâches, mais ne les termine jamais correctement, l'utilisation de la mémoire augmentera parallèlement au nombre de threads. De même, des fichiers ou des sockets non fermés peuvent persister en arrière-plan, accumulant une surcharge système même s'ils sont inactifs. Ces types de fuites sont particulièrement insidieuses pour les services à longue durée de vie et les serveurs à haut débit. Une gestion adéquate du cycle de vie de ces ressources, associée à des hooks de nettoyage et d'arrêt automatisés, garantit une récupération rapide et sécurisée de la mémoire système.

Utiliser les outils de surveillance APM et d'exécution

Les outils de surveillance des performances applicatives (APM) offrent une visibilité continue sur l'utilisation de la mémoire, le comportement du garbage collection et la durée de vie des objets dans tous les environnements. Des solutions comme New Relic, Dynatrace, AppDynamics et Datadog proposent des tableaux de bord de mémoire intégrés et la détection des anomalies pour les applications en production. Ces plateformes peuvent alerter les équipes lorsque l'utilisation de la mémoire dépasse les seuils ou lorsque des services spécifiques présentent un comportement inhabituel sous charge. Certains outils incluent également des comparaisons historiques et des analyses de rétention, permettant de corréler les tendances de mémoire avec les déploiements ou les pics de trafic. Dans les environnements de production où le profilage est trop intrusif, les outils APM constituent la principale source de détection des fuites de mémoire. Ils permettent de tracer les requêtes gourmandes en mémoire, d'identifier les points de terminaison lents et de mettre en évidence les services qui conservent les objets plus longtemps que prévu. De nombreuses plateformes APM prennent également en charge les déclencheurs de vidage de tas ou l'échantillonnage d'objets, fournissant ainsi juste assez de données de diagnostic sans impacter les performances d'exécution. L'intégration des solutions APM dès le début du cycle de développement permet une détection proactive des fuites et accélère l'analyse des causes profondes en cas de problème.

Comparer les instantanés de mémoire avant et après les tâches

Une technique simple et efficace pour détecter les fuites de mémoire consiste à prendre des instantanés de mémoire à des moments clés du cycle de vie de l'application, avant et après l'exécution d'opérations majeures. Par exemple, si votre application charge des sessions utilisateur, traite de grands ensembles de données ou exécute des tâches par lots, la capture d'un instantané du tas avant l'opération, puis d'un autre après, vous permet d'analyser les objets créés et ceux qui restent. Idéalement, les objets temporaires devraient être libérés une fois la tâche terminée. Si d'importants volumes de mémoire restent occupés sans raison apparente, cela peut indiquer que des objets sont retenus involontairement. Les outils d'analyse du tas permettent de comparer les instantanés et de mettre en évidence les objets dont le nombre ou la taille a augmenté. Cette analyse, axée sur les deltas, est particulièrement efficace pour repérer les fuites dans des modules ou des fonctionnalités isolés. Associées aux journaux, aux métriques et au suivi des allocations, les comparaisons d'instantanés peuvent mener directement aux chemins de code responsables des fuites de mémoire.

Prévention des fuites de mémoire

Prévenir les fuites de mémoire est aussi important que les détecter. Si les outils et les diagnostics permettent de détecter les fuites dès leur apparition, des pratiques de conception rigoureuses, une gestion rigoureuse des ressources et le respect des conventions propres à chaque langage peuvent prévenir la plupart des fuites. La prévention proactive réduit le temps de débogage, améliore la stabilité des applications et garantit l'évolutivité des systèmes à mesure qu'ils se développent. Vous trouverez ci-dessous des techniques et des pratiques architecturales éprouvées qui minimisent le risque de fuites de mémoire dans différents environnements de programmation.

Utiliser des structures de gestion des ressources structurées

Des langages comme Java, C# et Python proposent des constructions structurées pour le nettoyage automatique des ressources. Parmi celles-ci, on trouve try-with-resources. using Instructions et gestionnaires de contexte. Utilisés correctement, ils garantissent la fermeture des ressources telles que les fichiers, les sockets et les connexions aux bases de données, même en cas d'exception. Les développeurs devraient privilégier ces constructions aux appels de fermeture manuels, sujets aux omissions. Dans les environnements non gérés comme C et C++, l'utilisation de RAII (Resource Acquisition Is Initialization) garantit la libération des ressources lorsque les objets sortent du périmètre. Ces modèles réduisent le risque d'oubli de nettoyage et permettent d'obtenir un code plus sûr et plus prévisible. Les équipes doivent standardiser ces constructions et traiter toute gestion manuelle des ressources comme une odeur de code nécessitant une attention particulière lors des revues.

Désinscrire rapidement les auditeurs d'événements et les rappels

Le code piloté par événements nécessite la désinscription explicite des écouteurs lorsque l'objet qui les enregistre n'est plus nécessaire. Dans le cas contraire, des références et de la mémoire sont conservées et ne peuvent être libérées. Dans les systèmes dotés d'éléments d'interface utilisateur graphique, de mises à jour de données en temps réel ou de bus d'événements personnalisés, chaque inscription doit être répliquée par une désinscription. Cette pratique est essentielle dans les frameworks d'interface utilisateur modulaires ou dynamiques, où les composants sont fréquemment montés et démontés. Une erreur courante consiste à enregistrer un écouteur lors de l'initialisation, mais à ne pas le supprimer lors de la destruction ou du démontage. Les fuites de mémoire s'accumulent lorsque les composants sont détruits visuellement, mais restent référencés logiquement. Les développeurs doivent centraliser la logique d'inscription aux événements et s'assurer que les routines de suppression sont déclenchées de manière cohérente. Lorsque cela est possible, utilisez des modèles d'événements faibles ou des hooks de cycle de vie fournis par le framework pour automatiser le nettoyage. De plus, adoptez des tests unitaires et d'intégration qui valident la suppression des écouteurs après la désactivation des composants ou le déchargement des pages.

Limiter l'utilisation des références statiques et globales

Les champs statiques et les variables globales sont souvent utilisés par commodité, mais ils ont un coût : la permanence. Tout objet référencé depuis un contexte statique reste en mémoire pendant toute la durée d'exécution de l'application, qu'il soit encore nécessaire ou non. Cela devient particulièrement dangereux lorsque de volumineuses collections, données de session ou éléments d'interface utilisateur sont stockés de manière statique. Au fil du temps, ces objets s'accumulent et créent une rétention mémoire involontaire. Pour éviter cela, les développeurs doivent utiliser des champs statiques uniquement pour les constantes immuables, les méthodes utilitaires ou les singletons gérés par le cycle de vie. Évitez de stocker statiquement des objets dépendants du contexte ou lourds. Lorsque des références globales sont requises, associez-les à une logique d'expiration, des politiques d'éviction ou des stratégies de nulling manuelles. Lors de l'arrêt ou du démontage d'un composant, les ressources statiques doivent être explicitement effacées. L'utilisation statique doit également être vérifiée lors des requêtes d'extraction afin de garantir que des données temporaires ou transactionnelles ne se retrouvent pas involontairement dans un stockage longue durée.

Rompre les références circulaires lorsque cela est nécessaire

Dans les environnements avec ramasse-miettes, les références circulaires peuvent empêcher la récupération de mémoire. Ceci est particulièrement fréquent lors de l'utilisation de fermetures, de structures de données liées ou de relations bidirectionnelles. Les développeurs doivent être prudents lors de la création de cycles entre des objets qui se référencent mutuellement. En C++, utilisez weak_ptr pour briser les cycles formés par shared_ptrEn Java ou Python, examinez les graphes d'objets et utilisez des références faibles si nécessaire pour permettre la collecte d'objets autrement accessibles. Lorsque vous utilisez des fermetures ou des classes anonymes, réduisez la portée des variables capturées. Évitez de référencer des instances de classe entières lorsqu'une seule méthode ou un petit fragment d'état est requis. Les fermetures qui capturent par inadvertance des objets volumineux sont une source fréquente de fuites dans le code asynchrone ou réactif. Auditer régulièrement ces modèles et tester le comportement de la mémoire pendant le développement permet d'éviter que les références circulaires ne persistent au-delà de leur utilité.

Utiliser des structures de données et des modèles économes en mémoire

Choisir la bonne structure de données peut contribuer à éviter une rétention mémoire inutile. Par exemple, utiliser WeakHashMap en Java ou WeakKeyDictionary En Python, les clés ou valeurs sont automatiquement supprimées lorsqu'elles ne sont plus utilisées. Évitez d'utiliser par défaut des listes ou des cartes illimitées lorsqu'une structure plus adaptée, comme un cache LRU ou une file d'attente limitée, peut être appliquée. Si de grands ensembles de données doivent être conservés temporairement, segmentez-les et libérez-en des fragments régulièrement afin de réduire la pression sur la mémoire. De plus, évitez toute optimisation prématurée qui conduirait à tout mettre en cache « au cas où ». La mise en œuvre de politiques claires d'expiration, d'éviction ou de limites de taille permet au système de mieux gérer la mémoire sans intervention du développeur. Le profilage dès la conception, et non seulement après une fuite, permet de valider les hypothèses sur la conservation des données et la taille de la structure sous des charges réalistes.

Éliminer explicitement les objets inutilisés

Bien que les langages utilisant le ramasse-miettes libèrent automatiquement la mémoire, le moment de la collecte dépend de l'accessibilité des objets. Si des références subsistent, la mémoire reste allouée. Les développeurs peuvent accélérer la publication en définissant explicitement des variables à null (en Java) ou None (en Python) une fois leur utilisation terminée. Cela signale au ramasse-miettes que l'objet n'est plus nécessaire. Cette technique est particulièrement utile pour les portées à longue durée de vie, telles que les tâches en arrière-plan, les boucles longues ou les gestionnaires de session, où les objets resteraient autrement référencés pendant une période prolongée. Dans les applications critiques pour les performances, une gestion ciblée du cycle de vie des objets peut réduire considérablement l'utilisation maximale de la mémoire. Cependant, cette approche doit être utilisée avec prudence afin d'éviter d'encombrer le code ou d'introduire des bugs. En principe, assurez-vous que les variables contenant des données volumineuses ou sensibles sont effacées dès la fin de leur tâche.

Adopter des stratégies d'allocation défensive

Les fuites de mémoire peuvent être réduites en allouant de la mémoire uniquement lorsque cela est réellement nécessaire. Évitez de préallouer de grandes structures, sauf si cela est nécessaire pour les performances. Utilisez des techniques d'initialisation différée où la mémoire est allouée juste-à-temps et libérée dès que la tâche de l'objet est terminée. Suivez l'utilisation de la mémoire grâce à des structures étendues et traitez par lots les grands ensembles de données plutôt que de les charger entièrement en mémoire. Dans certains environnements, le pooling peut également provoquer des fuites de mémoire si les objets ne sont jamais renvoyés au pool. Assurez-vous que toute logique de gestion de mémoire personnalisée inclut des délais d'expiration ou une logique de détection des fuites. Les développeurs doivent adopter l'idée que chaque allocation doit être accompagnée d'un plan de désallocation, en particulier dans les systèmes sensibles aux performances ou aux ressources limitées.

Intégrer l'audit de la mémoire dans CI/CD

La prévention n'est pas complète sans une surveillance continue. L'intégration d'audits de mémoire au pipeline CI/CD permet de détecter les régressions en amont. Des outils tels que des profileurs automatisés, des compteurs d'allocation ou des tests de charge synthétiques peuvent être programmés pour s'exécuter avant chaque déploiement. Ces systèmes suivent des indicateurs clés tels que la taille du tas, la fréquence de GC, le nombre d'objets et la gestion des ressources. En cas de dépassement des seuils ou de détection d'écarts par rapport aux valeurs de référence, les équipes sont alertées avant que les modifications n'atteignent la production. Cette approche proactive transforme la gestion de la mémoire en une pratique continue, plutôt qu'une simple correction réactive. Les équipes doivent également inclure des indicateurs clés de performance liés à la mémoire dans leurs critères de qualité et effectuer des revues de code régulières axées sur la gestion du cycle de vie. L'instauration d'une culture d'hygiène de la mémoire garantit l'intégration de la prévention au processus de développement.

Tests unitaires pour les fuites de mémoire

Bien que les fuites de mémoire soient généralement associées au comportement d'exécution et aux performances à long terme des applications, elles peuvent et doivent être détectées lors des tests, notamment par des tests unitaires ciblés. L'intégration de la vérification de la mémoire aux workflows de tests unitaires permet aux équipes d'identifier les fuites plus tôt dans le processus de développement, avant qu'elles ne s'aggravent en production. Les tests unitaires conçus pour la sécurité de la mémoire garantissent le respect des limites du cycle de vie des objets, la libération correcte des ressources et l'exécution des opérations sans conserver de références imprévues. Bien que les tests unitaires ne puissent à eux seuls détecter toutes les fuites, ils constituent une première ligne de défense essentielle qui renforce la rigueur de l'ingénierie et encourage une conception consciente des fuites.

Concevoir des tests autour du comportement d'allocation et de nettoyage

Des tests unitaires efficaces pour la gestion de la mémoire se concentrent non seulement sur l'exactitude fonctionnelle, mais aussi sur le cycle de vie des objets. Chaque test doit valider la création, l'utilisation et la suppression appropriées des objets temporaires. Pour les caches personnalisés, les gestionnaires de sessions ou les usines de services, écrivez des tests simulant la création d'objets et vérifiant que rien ne persiste inutilement une fois l'opération terminée. Cela implique souvent d'invoquer la même logique plusieurs fois et de comparer l'utilisation de la mémoire ou le nombre d'objets entre les exécutions. Si l'empreinte mémoire augmente à chaque invocation, cela peut indiquer une fuite. Pour les systèmes gérant des charges utiles importantes ou une forte rotation des objets, incluez une logique de suppression dans le test pour renforcer le nettoyage. Dans certains environnements, l'instrumentation du code de test avec des compteurs d'allocation légers ou des vérifications de références permet d'identifier les objets qui ne parviennent pas à sortir du périmètre. Ces assertions garantissent que l'utilisation de la mémoire reste prévisible et autonome dans le périmètre du test.

Utiliser les bibliothèques et utilitaires de détection des fuites

Les écosystèmes de programmation modernes proposent des bibliothèques qui étendent les frameworks de tests unitaires avec des fonctionnalités de détection des fuites mémoire. Pour le C++, des outils comme Google Test peuvent être associés à Valgrind ou AddressSanitizer pour suivre les allocations pendant l'exécution des tests. Les développeurs Java peuvent utiliser des outils comme junit-allocations or OpenJDK Flight Recorder en mode test pour observer la mémoire conservée. Python propose objgraph, tracemalloc et gc Fonctionnalités d'inspection de modules permettant de suivre la croissance des objets entre les assertions. Ces bibliothèques peuvent être intégrées à des suites de tests standard et utilisées pour définir des attentes concernant le nombre d'objets ou les modifications de mémoire. Par exemple, un test peut affirmer qu'il ne reste aucune instance supplémentaire d'une classe après l'exécution d'une méthode. En englobant les cas de test dans des portées d'allocation contrôlée ou des instantanés de mémoire, les développeurs peuvent vérifier qu'aucune référence cachée ne persiste. Ces outils détectent non seulement les fuites de mémoire en amont, mais facilitent également leur reproduction cohérente, souvent difficile lors du profilage complet d'une application.

Simuler une utilisation répétitive et mesurer la stabilité

Les fuites de mémoire surviennent souvent lors d'opérations répétitives ou de longue durée. Pour détecter ces schémas grâce aux tests unitaires, simulez l'exécution répétée de la même fonction ou fonctionnalité dans une boucle. Cette approche permet de mettre en évidence une croissance progressive de la mémoire qui ne serait pas visible lors d'un seul test. Par exemple, une fonction de mise en cache qui ne parvient pas à supprimer les entrées obsolètes peut réussir dans des conditions isolées, mais échouer en cas de répétition prolongée. Structurez vos tests pour exécuter des dizaines ou des centaines d'itérations, et mesurez l'état de la mémoire ou des objets une fois terminés. Certains frameworks de test permettent des hooks de configuration et de démontage au niveau des composants, permettant ainsi des vérifications des ressources entre les cycles. L'intégration de ces boucles dans l'automatisation des tests permet de garantir une utilisation constante de la mémoire au fil du temps. Ceci est particulièrement utile pour les services qui doivent maintenir la stabilité sur de longues sessions, tels que les processeurs d'arrière-plan, les points de terminaison d'API ou les tâches par lots. En observant si la mémoire reste stable après des exécutions répétées, les développeurs acquièrent rapidement confiance dans la robustesse de leur gestion de la mémoire.

Affirmer la bonne libération des ressources lors des démontages de tests

Les tests unitaires doivent toujours remettre l'environnement dans un état propre, y compris la mémoire. Outre les assertions fonctionnelles, les méthodes de test de suppression constituent un moyen idéal de vérifier que les ressources temporaires ont été libérées. Qu'il s'agisse de flux de fichiers, de connexions à des bases de données ou d'instances de service fictives, les blocs de suppression peuvent inclure des informations explicites. dispose, close, ou null Opérations. Ces modèles renforcent le principe selon lequel toutes les ressources doivent être libérées une fois la tâche terminée. Le cas échéant, assurez-vous également que les références clés ne sont plus accessibles ou que les finaliseurs ont été déclenchés. Cette pratique encourage les développeurs à écrire du code plus autonome et réduit la pollution des tests entre les suites. Lorsque le code de suppression inclut la validation du cycle de vie des objets, il est beaucoup plus facile de détecter les régressions ou les changements de comportement introduisant des fuites mémoire. L'intégration des assertions mémoire au nettoyage des tests améliore également la fiabilité dans les environnements de tests parallèles ou continus, où l'isolation des tests est essentielle.

Exemples de codage

Voici quelques exemples de codage qui illustrent les fuites de mémoire courantes et leurs résolutions :

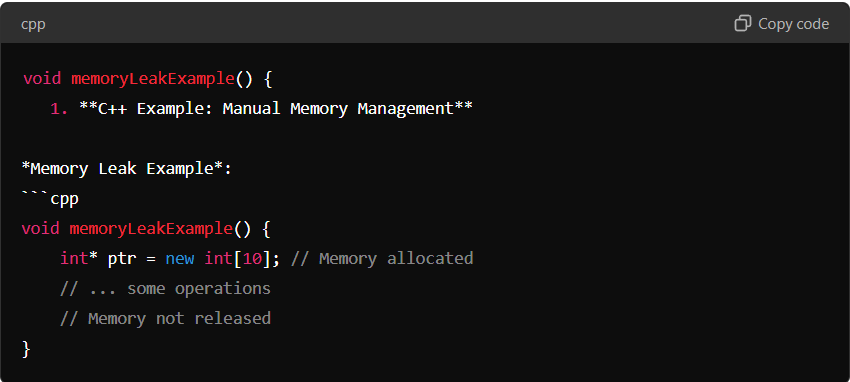

Exemple C++ : gestion manuelle de la mémoire

Dans cet exemple, la mémoire est allouée à l'aide de new[] pour créer un tableau d'entiers. Cependant, la mémoire n'est pas libérée car il n'y a pas d'appel delete[] pour la libérer, ce qui entraîne une fuite de mémoire.

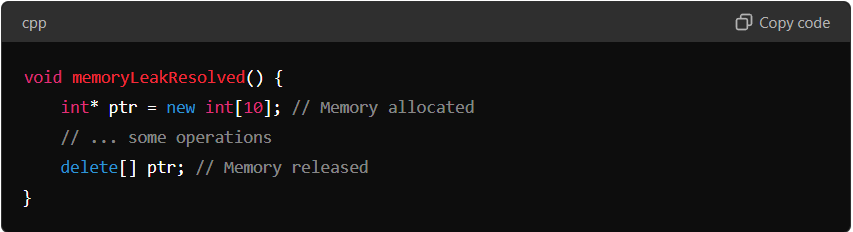

Exemple résolu:

Pour résoudre la fuite, la mémoire allouée est correctement libérée à l'aide de delete[]. Cela garantit que la mémoire est renvoyée au système une fois qu'elle n'est plus nécessaire.

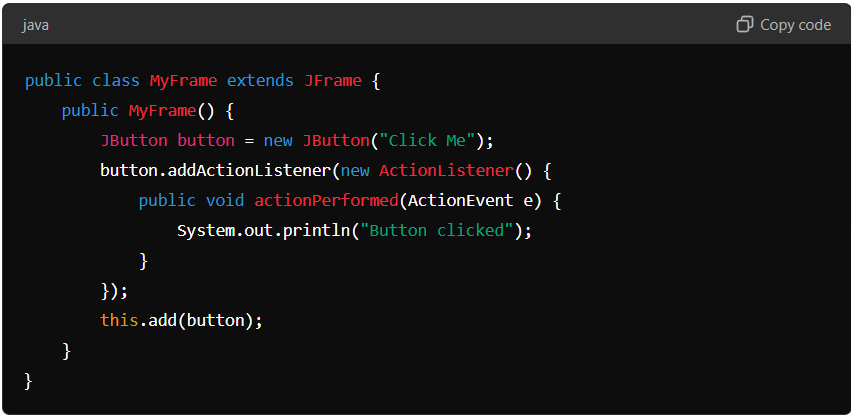

Exemple Java : fuite de mémoire au niveau de l'écouteur

Exemple de fuite de mémoire:

Dans cet exemple, une classe interne anonyme est utilisée pour créer un ActionListener pour un bouton. Cependant, si le bouton est supprimé ou si le cadre est fermé sans supprimer l'écouteur, ce dernier peut provoquer une fuite de mémoire en conservant le bouton ou le cadre en mémoire.

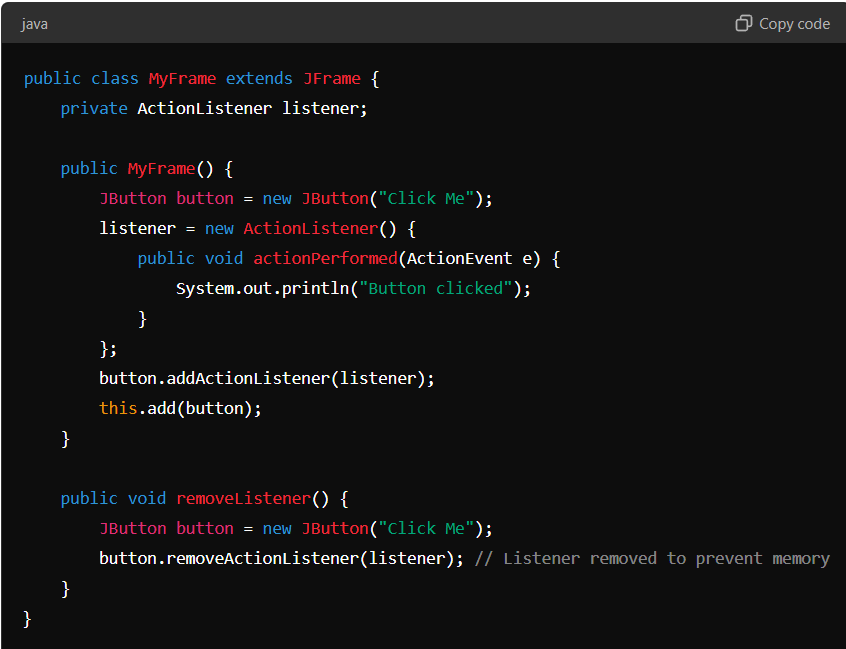

Exemple résolu:

En conservant une référence à l'écouteur et en le supprimant explicitement lorsque le bouton n'est plus nécessaire, le risque de fuite de mémoire est atténué.

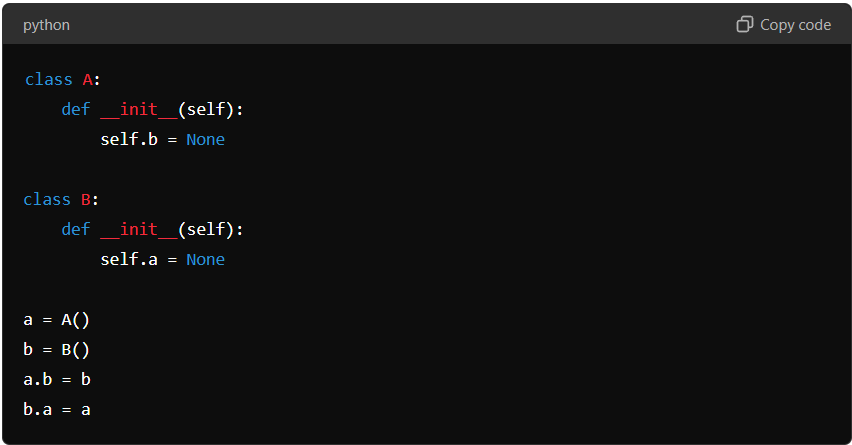

Exemple Python : référence circulaire

Exemple de fuite de mémoire:

Dans cet exemple, a et b contiennent des références l'une à l'autre, créant ainsi une référence circulaire. Cela peut empêcher le garbage collector de Python de libérer les objets, provoquant ainsi une fuite de mémoire.

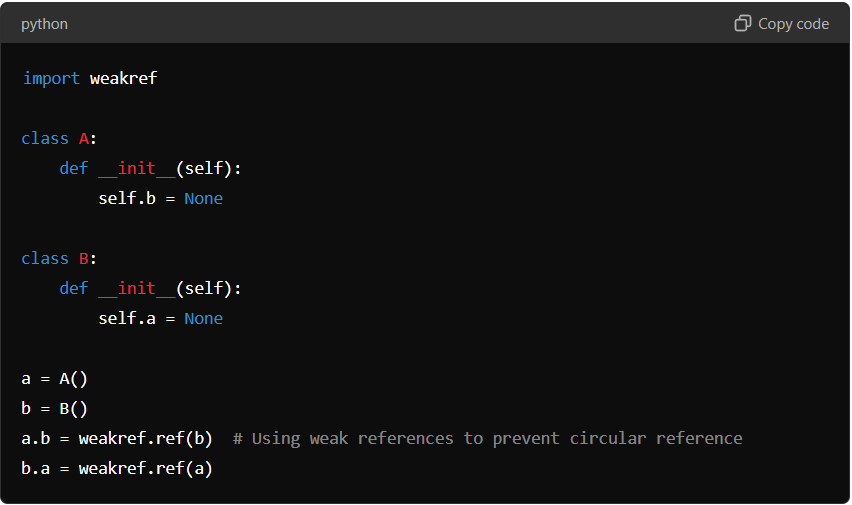

Exemple résolu:

En utilisant weakref, la référence circulaire est rompue, ce qui permet au garbage collector de récupérer la mémoire lorsque les objets ne sont plus utilisés.

SMART TS XL:Un outil pour la détection et la résolution efficaces des fuites de mémoire

SMART TS XL peut améliorer considérablement le processus de détection et de résolution des fuites de mémoire. Voici comment cet outil peut être intégré à votre flux de travail de développement :

Analyse de code statique: SMART TS XL offre capacités d'analyse statique avancées, identifiez les fuites de mémoire potentielles en analysant votre code. Contrairement à d'autres outils, il fournit des informations plus approfondies et une détection plus précise des modèles pouvant conduire à des fuites de mémoire.

Création d'un organigramme: SMART TS XL Vous pouvez générer automatiquement des organigrammes qui visualisent les processus d'allocation et de désallocation de mémoire dans votre code. Cette fonctionnalité est particulièrement utile pour comprendre les scénarios complexes de gestion de la mémoire et identifier les endroits où des fuites peuvent se produire.

Analyse d'impact: Avec SMART TS XL, vous pouvez effectuer une analyse d'impact pour voir comment les changements apportés à une partie du code peuvent affecter la gestion de la mémoire dans d'autres domaines. Cela est particulièrement utile dans les projets de grande envergure où même des changements mineurs peuvent avoir des répercussions importantes sur l'utilisation de la mémoire.

Amélioration de la qualité du code:Au-delà de la simple détection des fuites, SMART TS XL fournit des suggestions pour améliorer la qualité globale du code, vous aidant à écrire du code plus robuste, maintenable et résistant aux fuites.

En incorporant SMART TS XL dans votre processus de développement, vous pouvez réduire considérablement le risque de fuites de mémoire et garantir que vos applications restent stables et efficaces. Que vous ayez affaire à une gestion manuelle de la mémoire en C++ ou à la gestion de références d'objets dans des langages gérés comme Java et Python, SMART TS XL offre les outils dont vous avez besoin pour maintenir des normes élevées de gestion de la mémoire et de qualité globale du code.