Die Softwarelandschaften von Unternehmen werden bis 2026 zunehmend komplexer statt einfacher. Jahrzehntelang angesammelte Logik, unterschiedliche Programmiersprachen, hybride Bereitstellungsmodelle und eng verzahnte Abhängigkeiten schränken die Möglichkeiten für Änderungen immer stärker ein, ohne unbeabsichtigte Folgen zu riskieren. In diesem Umfeld gelten statische Codeanalyse-Tools nicht mehr als optionale Qualitätsprüfungen, sondern als grundlegende Instrumente, um das tatsächliche Verhalten von Systemen zu verstehen, bevor Modernisierungs-, Refactoring- oder Sicherheitsinitiativen beginnen.

Was die statische Codeanalyse im Unternehmensmaßstab von entwicklerorientierten Tools unterscheidet, ist nicht die Fähigkeit, einzelne Fehler zu erkennen, sondern die Fähigkeit, ganze Anwendungslandschaften zu analysieren. Große Organisationen arbeiten selten mit einer einzigen Laufzeitumgebung oder einem einheitlichen Architekturmuster. Mainframe-Batch-Workloads existieren neben verteilten Diensten, Legacy-Schnittstellen treffen auf Cloud-native APIs, und regulatorische Anforderungen schränken die Risikomessung und -minderung zusätzlich ein. Die statische Analyse muss daher grenzenlos arbeiten und Ausführungspfade, versteckte Abhängigkeiten und strukturelle Risiken aufdecken, die durch reine Tests nicht erkennbar sind.

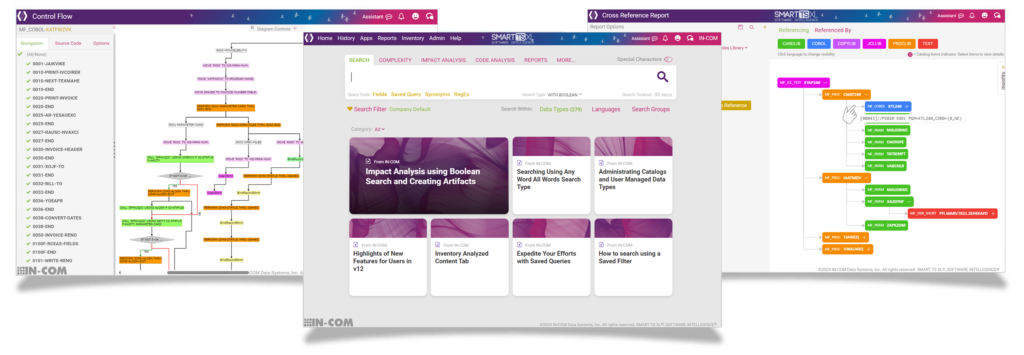

SMART TS XL

Ideale Lösung zur statischen Codeanalyse für Unternehmen mit großen verteilten Systemen und Assets

Jetzt entdeckenDie zunehmende Betonung von Continuous Delivery und beschleunigter Modernisierung hat die Bedeutung analysebasierter Erkenntnisse weiter gestärkt. Da Unternehmen umfassendere Ziele verfolgen, … Anwendungsmodernisierung Bei Initiativen dieser Art werden die Kosten unvollständigen Verständnisses immer deutlicher. Refactoring-Entscheidungen, die ohne vollständige Transparenz hinsichtlich Kontrollfluss, Datenweitergabe oder systemübergreifender Kopplung getroffen werden, führen häufig zu Instabilität, Leistungseinbußen oder Compliance-Verstößen, die erst nach der Implementierung sichtbar werden. Statische Codeanalyse-Tools sollen diese Unsicherheit verringern, indem sie vor der Umsetzung von Änderungen für architektonische Klarheit sorgen.

Vor diesem Hintergrund verändern sich die Kriterien zur Bewertung von Tools für die statische Codeanalyse im Jahr 2026. Genauigkeit allein reicht nicht mehr aus. Unternehmen benötigen tiefgreifende Analysen, Skalierbarkeit über Millionen von Codezeilen, Unterstützung heterogener Umgebungen und die Fähigkeit, technische Erkenntnisse in handlungsrelevante Informationen für Architekten, Plattformverantwortliche und Risikomanager zu übersetzen. Der folgende Vergleich untersucht, wie führende Tools für die statische Codeanalyse in Unternehmen diesen sich wandelnden Anforderungen gerecht werden und wie ihre Fähigkeiten mit den Realitäten großer, unternehmenskritischer Systeme übereinstimmen.

Vergleich und Ranking von Tools zur statischen Codeanalyse für Unternehmen bis 2026

Der folgende Vergleich bewertet führende Tools zur statischen Codeanalyse anhand von Kriterien, die in großen Unternehmensumgebungen und nicht für einzelne Entwicklungsteams relevant sind. Jedes Tool wird hinsichtlich Analysetiefe, Skalierbarkeit über heterogene Systeme hinweg, Unterstützung für ältere und moderne Plattformen sowie seiner Fähigkeit, aussagekräftige Erkenntnisse aus komplexen Abhängigkeitsstrukturen zu gewinnen, beurteilt. Das Ranking spiegelt wider, wie effektiv diese Tools das Architekturverständnis, die Risikoidentifizierung und fundierte Entscheidungsfindung in Umgebungen ermöglichen, in denen Änderungen erhebliche betriebliche und regulatorische Konsequenzen haben.

SMART TS XL

SMART TS XL ist eine Plattform für statische Codeanalyse, Folgenabschätzung und Anwendungsintelligenz für große, heterogene Softwarelandschaften. Sie unterstützt Unternehmen, die in Mainframe-, Midrange- und verteilten Umgebungen arbeiten, in denen jahrzehntelang gewachsene Logik, Stapelverarbeitung und plattformübergreifende Abhängigkeiten Änderungen mit einem inhärenten Risiko begründen. Anstatt sich auf isolierte Ergebnisse zur Codequalität zu konzentrieren, SMART TS XL ist darauf ausgelegt, das tatsächliche Verhalten von Anwendungen offenzulegen, indem Ausführungspfade, Datenbeziehungen und Abhängigkeitsstrukturen über ganze Portfolios hinweg sichtbar gemacht werden.

Die Plattform fungiert als leistungsstarkes, webbasiertes System, das Milliarden von Codezeilen und zugehörige Artefakte in Sekundenschnelle indexieren und analysieren kann. Durch die Auslagerung von Analyse-Workloads von Produktionssystemen und die Zentralisierung von Erkenntnissen in einer gemeinsamen Umgebung, SMART TS XL Es unterstützt Tausende gleichzeitiger Nutzer ohne Leistungseinbußen. Dank dieser Skalierbarkeit eignet es sich nicht nur für Entwicklungsteams, sondern auch für Architekten, Modernisierungsverantwortliche, Produktionssupport, Audit- und Compliance-Beauftragte, die einen konsistenten, faktenbasierten Einblick in komplexe Systeme benötigen. Demo anfordern.

Statische Analyse und Erkennung im Unternehmensmaßstab

Im Kern, SMART TS XL Es bietet tiefgreifende statische Analysen für eine Vielzahl von Programmiersprachen, Jobsteuerungsstrukturen, Datenbanken und zugehörigen Artefakten. Unterstützt werden sowohl ältere als auch moderne Technologien wie COBOL, PL/I, Natural, RPG, Assembler, Java, C#, Python, VB6, UNIX-Skripte, JCL, PROCs, CICS-Artefakte, MQ-Definitionen, Datenbankschemata und strukturierte Dokumente. Quellcode, Batch-Logik, Konfigurationsdateien und sogar Nicht-Code-Artefakte wie Dokumentationen und Diagramme können gemeinsam indiziert und analysiert werden. Dadurch lassen sich Zusammenhänge zwischen traditionell isolierten Datenbeständen aufdecken.

Diese einheitliche Erkennungsfunktion ermöglicht es Unternehmen, über die reine Dateianalyse hinauszugehen und ein umfassendes Systemverständnis zu erlangen. Programme, Jobs, Felder, Dateien, Tabellen und Nachrichten lassen sich plattformübergreifend verfolgen und zeigen so, wie Geschäftslogik durch Batch-Verarbeitung, Online-Transaktionen und nachgelagerte Berichtsprozesse fließt. Diese Zusammenhänge werden durch interaktive Querverweisberichte, Abhängigkeitsdiagramme und navigierbare Ausführungsansichten anstelle statischer Listen visualisiert.

Plattformübergreifende Wirkungsanalyse und Abhängigkeitsanalyse

SMART TS XL Besonderes Augenmerk wird auf die plattformübergreifende Wirkungsanalyse gelegt. Änderungen, die in einem Teil einer Anwendung eingeführt werden, bleiben in Unternehmensumgebungen selten isoliert, insbesondere dort, wo Mainframe-Workloads mit verteilten Diensten und gemeinsam genutzten Datenspeichern interagieren. SMART TS XL Analysiert Aufrufbeziehungen, Datennutzung, Jobausführungspfade und Kontrollflüsse, um vorgelagerte und nachgelagerte Wirkungsbereiche über verschiedene Sprachen und Systeme hinweg zu identifizieren.

Die Funktionen zur Abhängigkeitsanalyse visualisieren diese Beziehungen mithilfe interaktiver, farbcodierter Diagramme, die Aufrufer, Angerufene, Datenproduzenten und -konsumenten hervorheben. Die Wirkungsanalyse kann von einem Programm, einem Feld, einem Datenbankelement, einem Arbeitsschritt oder sogar von Suchergebnissen aus gestartet werden. So können Teams Änderungen präzise abgrenzen, bevor die Entwicklung beginnt. Dieser Ansatz reduziert übersehene Abhängigkeiten, begrenzt übermäßige Tests und bietet eine fundierte Grundlage für die Änderungsplanung und Risikobewertung.

Ausführungsorientierte Sichten der Batch- und Programmlogik

Für Umgebungen mit komplexer Stapelverarbeitung, SMART TS XL Ermöglicht das Verständnis von Laufzeitlogik ohne Codeausführung. Die Erweiterungsfunktionen für COBOL und JCL lösen Copybooks, PROCs, Symbolics und Overrides auf und stellen die Logik so dar, wie sie im Produktivbetrieb ausgeführt wird. Batch-Ketten lassen sich vollständig nachverfolgen, sodass ersichtlich ist, welche Programme in welcher Reihenfolge und mit welchen Parametern ausgeführt werden.

Kontrollflussdiagramme und Ablaufdiagramme übersetzen tief verschachtelte Logik in übersichtliche visuelle Darstellungen. Diese Ansichten ermöglichen es, das Ausführungsverhalten zu verstehen, nicht erreichbare oder nicht mehr nutzbare Codepfade zu identifizieren und die Komplexität von Verzweigungen zu analysieren, ohne auf Erfahrungswissen oder manuelle Durchläufe angewiesen zu sein. Feldverfolgungsdiagramme erweitern diese Funktionalität, indem sie nachverfolgen, wie Datenelemente erstellt, transformiert und über Programme, Jobs und Datenbanken hinweg weitergegeben werden. Dies unterstützt sichere Strukturänderungen und regulatorische Prüfungen.

Erweiterte Suche, Mustererkennung und Präzisionsanalyse

SMART TS XL Die Lösung umfasst eine leistungsstarke Unternehmenssuchmaschine, die für große, technologieübergreifende Codebasen optimiert ist. Sie unterstützt komplexe Boolesche Logik, Proximity-Suchen, Block-Suchen, reguläre Ausdrücke, Synonymverarbeitung und detaillierte Filter, die die Analyse auf bestimmte Sprachen, Datentypen oder Codeabschnitte beschränken. Mehrstufige Suchtechniken ermöglichen es Benutzern, große Ergebnismengen schrittweise in präzise Bereiche einzugrenzen, die sich für Wirkungsanalysen, Audits oder Modernisierungsbewertungen eignen.

Diese Suchfunktionen sind eng mit Querverweis-, Wirkungs-, Komplexitäts- und Visualisierungsfunktionen verknüpft. Ergebnisse lassen sich direkt in Abhängigkeitsansichten, Berichte oder weiterführende Analyse-Workflows einbinden, wodurch die Reibungsverluste zwischen Datenerhebung und Entscheidungsfindung reduziert werden. Gespeicherte und parametrisierte Abfragen ermöglichen es Unternehmen, Risikoprüfungen und wiederholbare Analysemuster team- und projektübergreifend zu standardisieren.

Komplexitätsanalyse und Risikobewertung

SMART TS XL Die Software bietet eine Komplexitätsanalyse auf Portfolioebene, die über einzelne Programme hinausgeht. Komplexitätskennzahlen wie Codezeilen, zyklomatische Komplexität und Halstead-Maße lassen sich für gezielte Anwendungsteilmengen berechnen, die durch Suchergebnisse oder Wirkungszonen definiert werden. So können Teams das technische Risiko innerhalb spezifischer Geschäftsfunktionen oder Modernisierungskandidaten quantifizieren, anstatt sich auf grobe, anwendungsweite Durchschnittswerte zu verlassen.

Durch die Kombination von Komplexitätsmetriken mit Abhängigkeits- und Wirkungsanalysen, SMART TS XL Unterstützt eine realistischere Aufwandsschätzung und Priorisierung. Bereiche mit hoher Kopplung und hoher Komplexität können frühzeitig identifiziert werden, sodass Modernisierungs- und Sanierungsmaßnahmen auf der Grundlage des tatsächlichen strukturellen Risikos und nicht auf der Grundlage von Annahmen priorisiert werden können.

Wissenstransfer, Auditvorbereitung und Unterstützung der Unternehmensführung

Eine immer wiederkehrende Herausforderung in großen Unternehmen ist der Verlust von institutionellem Wissen, wenn Systeme altern und erfahrene Mitarbeiter in den Ruhestand gehen oder die Position wechseln. SMART TS XL Dies wird durch die zentrale Speicherung von Anwendungswissen auf einer durchsuchbaren und explorierbaren Plattform erreicht, die die Struktur und das Verhalten von Systemen erfasst. Dokumentationen, Berichte, Diagramme und Nachweise können generiert und geteilt werden, um Onboarding, Audits und behördliche Anfragen zu unterstützen.

Die Exportfunktionen ermöglichen die Bereitstellung von Analyseergebnissen als zeitgestempelte, nachweisbereite Dokumente, die sich für Compliance-Prüfungen, Änderungsfreigaben und externe Audits eignen. Zugriffskontrollen und Nutzungsnachverfolgung unterstützen Governance-Anforderungen, insbesondere in Umgebungen mit Offshore-Entwicklung oder ausgelagerten Wartungsmodellen.

Einsatz-, Integrations- und Betriebstauglichkeit

SMART TS XL Es ist auf schnelle Bereitstellung und minimale Betriebsunterbrechung ausgelegt. Installationen lassen sich innerhalb weniger Stunden abschließen; es stehen Konnektoren zur Verfügung, um Daten aus Mainframe-Umgebungen, verteilten Versionskontrollsystemen, Datenbanken und gemeinsam genutzten Repositories zu importieren. Sowohl vollständige als auch inkrementelle Datenimporte werden unterstützt, sodass Umgebungen ohne ständige manuelle Eingriffe stets aktuell bleiben.

Automatisierungsfunktionen ermöglichen den unbeaufsichtigten Ablauf von Analyseprozessen und unterstützen so die kontinuierliche Generierung von Erkenntnissen, abgestimmt auf die Veränderungszyklen des Unternehmens. Durch die Zentralisierung der Analyse auf einer kosteneffizienten Infrastruktur können Unternehmen ihre Abhängigkeit von teuren Produktionsressourcen reduzieren und gleichzeitig die Analysetiefe und -verfügbarkeit teamübergreifend erhöhen.

SonarQube Enterprise Edition

SonarQube Enterprise Edition ist eine Plattform für statische Codeanalyse, die große Entwicklungsorganisationen bei der konsequenten Einhaltung von Standards für Codequalität, Wartbarkeit und Sicherheit in ihren modernen Softwareportfolios unterstützt. Ihre Hauptaufgabe in Unternehmensumgebungen besteht darin, als kontinuierliche Prüfschicht in Entwicklungsworkflows integriert zu werden und frühzeitig Feedback zu Codeproblemen zu geben, bevor Änderungen in die Produktion gelangen. In Portfolios, in denen der Durchsatz von Codeprüfungen zum Engpass wird, wird sie häufig zusammen mit umfassenderen Lösungen eingesetzt. Tools zur Codeüberprüfung um die Qualitätskontrolle zu formalisieren und die Unterschiede zwischen den Teams zu reduzieren.

Im Gegensatz zu Portfolio-Analyseplattformen liegt die Stärke von SonarQube in seiner Fähigkeit, eng mit dem Entwickler-Workflow zusammenzuarbeiten. Die Analyse wird typischerweise im Rahmen von Build-Pipelines oder der Pull-Request-Validierung ausgelöst, sodass Teams Code-Smells, Bugs und Sicherheitsprobleme inkrementell während der Codeentwicklung erkennen können. Dies entspricht den Ansätzen von Organisationen, die automatisierte Prüfungen entlang ihrer Delivery-Pipelines standardisieren, einschließlich der in [Referenz einfügen] beschriebenen Vorgehensweisen. CI / CD-Pipelines, wobei die statische Analyse zu einer wiederholbaren Kontrollmaßnahme und nicht zu einem ad-hoc-Prüfschritt wird.

Regelbasierte statische Analyse und Qualitätskontrollen

Kernstück der SonarQube Enterprise Edition ist eine regelbasierte statische Codeanalyse, die Quellcode anhand eines umfangreichen und konfigurierbaren Regelsatzes auswertet. Diese Regeln decken gängige Kategorien wie Wartbarkeitsprobleme, Zuverlässigkeitsmängel und Sicherheitslücken ab. Die Ergebnisse werden nach Schweregrad klassifiziert und Qualitätskriterien zugeordnet, die darüber entscheiden, ob der Code den Auslieferungsprozess durchlaufen darf.

Qualitätsprüfungen sind ein zentraler Mechanismus zur Durchsetzung von Unternehmensstandards im großen Maßstab. Unternehmen können Schwellenwerte für die Codeabdeckung, die Fehlerdichte und die Gefährdung durch Sicherheitslücken definieren und so sicherstellen, dass Änderungen vor der Integration vordefinierte Kriterien erfüllen. Diese Funktion ist besonders wertvoll in Umgebungen mit verteilten Teams, ausgelagerter Entwicklung oder hoher Entwicklerfluktuation, da die konsequente Durchsetzung die Abhängigkeit von manuellen Prüfungen reduziert.

Sprachabdeckung und Integration des Entwicklungsökosystems

SonarQube unterstützt eine Vielzahl moderner Programmiersprachen, darunter Java, C#, JavaScript, TypeScript, Python und weitere, die häufig in der Entwicklung von Unternehmensanwendungen eingesetzt werden. Dank seines umfangreichen Ökosystems an Plugins und Integrationen lässt es sich mit gängigen CI/CD-Plattformen, Versionskontrollsystemen und Issue-Trackern verbinden. Diese enge Integration macht es ideal für Unternehmen, die der automatisierten Qualitätssicherung in ihren Entwicklungsprozessen höchste Priorität einräumen.

Das Analysemodell von SonarQube ist jedoch primär quellenzentriert und auf das Repository beschränkt. Zwar kann es mehrere Projekte parallel analysieren, sein Verständnis von Beziehungen zwischen Repositories, Plattformen und Ausführungskontexten ist jedoch begrenzt. Die Analyse beschränkt sich typischerweise auf einzelne Anwendungen oder Dienste und erstreckt sich nicht über ganze Unternehmensumgebungen mit gemeinsam genutzten Daten, Batch-Workflows oder plattformübergreifenden Abhängigkeiten.

Sicherheitsanalyse und Compliance-Unterstützung

In seinen Enterprise-Editionen bietet SonarQube erweiterte Sicherheitsanalysefunktionen, die auf gängige Schwachstellenkategorien abgestimmt sind. Es kann Muster im Zusammenhang mit Injection-Schwachstellen, unsicheren Konfigurationen und dem Missbrauch von APIs identifizieren. Die Ergebnisse werden in einem Format präsentiert, das sowohl für Entwickler als auch für Sicherheitsteams verständlich ist und die Behebung von Schwachstellen in bestehenden Tools unterstützt.

Aus Compliance-Sicht bietet SonarQube Rückverfolgbarkeit und Berichtsfunktionen, die die Einhaltung interner Codierungsstandards und Sicherheitsrichtlinien belegen. Berichte können generiert werden, um Problemtrends, Fortschritte bei der Behebung und die Einhaltung von Qualitätsstandards im Zeitverlauf darzustellen. Diese Funktionen unterstützen zwar die Auditvorbereitung von Entwicklungsteams, konzentrieren sich aber weniger auf die Erstellung von Nachweisen zum Ausführungsverhalten auf Systemebene oder zu systemübergreifenden Auswirkungen.

Skalierbarkeitseigenschaften und betriebliche Überlegungen

SonarQube Enterprise Edition ist für die Skalierung über eine große Anzahl von Repositories und Entwicklungsteams hinweg ausgelegt, insbesondere in verteilten oder containerisierten Umgebungen. Die Performance skaliert mit der verfügbaren Infrastruktur und eignet sich daher ideal für Organisationen mit hohem Commit-Volumen und häufigen Analysezyklen. Zentrale Dashboards bieten einen umfassenden Überblick über alle Projekte und unterstützen die Führungsebene bei der Überwachung von Qualitätstrends.

SonarQubes Skalierbarkeit ist primär horizontal über Projekte hinweg und weniger vertikal über die Systemkomplexität hinweg. Es löst weder Laufzeitausführungspfade noch Batch-Orchestrierungslogik oder die detaillierte Datenherkunft über heterogene Plattformen hinweg auf. In Umgebungen, die von Mainframe-Workloads, Batch-Scheduling oder eng gekoppelten Legacy-Systemen dominiert werden, dient SonarQube häufig eher als ergänzendes Werkzeug denn als eigenständige Quelle für Architekturanalysen.

Typische Anwendungsfälle und Einschränkungen in Unternehmen

SonarQube Enterprise Edition ist besonders effektiv in Unternehmen mit hohem DevOps-Reifegrad, standardisierten Entwicklungsumgebungen und dem Fokus auf die Vermeidung von Qualitätseinbußen im aktiv entwickelten Code. Es zeichnet sich durch die Gewährleistung von Konsistenz, die Reduzierung von Code-Smells und die Integration von Qualitätsprüfungen in dynamische Entwicklungspipelines aus.

Seine Grenzen werden in Modernisierungsszenarien deutlicher, die ein Verständnis der Auswirkungen von Änderungen auf große, vernetzte Systeme erfordern. SonarQube modelliert weder die Ausführungsreihenfolge noch die Datenweitergabe zwischen Jobs und Plattformen oder systemweite Abhängigkeitsketten. Daher wird es häufig mit umfassenderen Analyseplattformen kombiniert, wenn Unternehmen Modernisierungsrisiken, Auswirkungen auf Batch-Verarbeitung oder portfolioübergreifende Änderungen bewerten müssen.

Checkmarx Eins

Checkmarx One ist eine unternehmensorientierte Plattform für Anwendungssicherheit, die auf statischen Sicherheitstests in modernen Entwicklungs- und Bereitstellungspipelines basiert. Ihre Hauptaufgabe in großen Organisationen besteht darin, Sicherheitslücken frühzeitig im Softwarelebenszyklus zu identifizieren, insbesondere in Umgebungen mit häufigen Releases, verteilten Teams und Cloud-nativen Architekturen, die das Risiko ausnutzbarer Schwachstellen erhöhen. Anstatt das systemweite Ausführungsverhalten zu modellieren, konzentriert sich Checkmarx One auf die Erkennung unsicherer Codierungsmuster und Konfigurationsschwächen, die anerkannten Sicherheitsklassifikationen entsprechen.

Die Plattform wird typischerweise von Unternehmen mit ausgereiften DevSecOps-Praktiken eingesetzt, in denen die Sicherheitsanalyse kontinuierlich parallel zur Entwicklung und nicht erst nach der Veröffentlichung erfolgt. In solchen Umgebungen dient Checkmarx One als Präventivmechanismus, der die Wahrscheinlichkeit verringert, dass anfällige Codepfade in Produktionssysteme gelangen.

Fokus auf statische Anwendungssicherheitstests

Kernstück von Checkmarx One ist eine statische Anwendungssicherheitstest-Engine, die für die Erkennung von Schwachstellen auf Quellcodeebene optimiert ist. Die Analyse erfolgt ohne Ausführung der Anwendungen, wodurch Probleme frühzeitig, oft bereits während des Code-Commits oder Build-Prozesses, identifiziert werden können. Die Plattform ordnet die Ergebnisse bekannten Schwachstellenkategorien zu und unterstützt so Sicherheitsteams, die auf standardisierte Risikoklassifizierungsframeworks wie beispielsweise [Beispiel einfügen] setzen. OWASP-Schwachstellen um die Sanierungsmaßnahmen zu priorisieren.

Der Fokus auf sicherheitsrelevante Ergebnisse unterscheidet Checkmarx One von allgemeinen statischen Analysetools. Anstatt Wartbarkeits- oder Architekturprobleme hervorzuheben, konzentriert sich die Plattform auf Schwachstellen, die zu Datenverlust, unberechtigtem Zugriff oder Rechteausweitung führen können. Diese Spezialisierung macht sie besonders relevant für regulierte Branchen, in denen die Fristen für die Offenlegung und Behebung von Schwachstellen genau überwacht werden.

Integration in Enterprise DevSecOps-Pipelines

Checkmarx One ist für die nahtlose Integration in CI/CD-Pipelines und Entwickler-Workflows konzipiert. Scans können automatisch im Rahmen von Build-Prozessen, Pull Requests oder Release-Phasen ausgelöst werden, wodurch eine konsistente Sicherheitsanalyse ohne manuelle Eingriffe gewährleistet wird. Die Ergebnisse werden über Dashboards und Integrationen mit Issue-Tracking-Systemen visualisiert, sodass die gefundenen Schwachstellen direkt an die Entwicklungsteams zur Behebung weitergeleitet werden können.

Dieses pipelineorientierte Betriebsmodell ermöglicht eine hohe Entwicklungsgeschwindigkeit bei gleichzeitiger Gewährleistung eines grundlegenden Sicherheitsniveaus. Die Fokussierung auf einzelne Repositories und Services führt jedoch dazu, dass sich die Analyse in der Regel auf separate Codebasen beschränkt. Dies passt zwar gut zu Microservices und modularen Architekturen, schränkt aber die Transparenz hinsichtlich anwendungsübergreifender Abhängigkeiten oder plattformübergreifender Ausführungsketten ein, wie sie in langlebigen Unternehmenssystemen üblich sind.

Sprachabdeckung und Cloud-native Ausrichtung

Checkmarx One unterstützt eine Vielzahl moderner Programmiersprachen und Frameworks, die in der Unternehmens- und Cloud-nativen Entwicklung weit verbreitet sind. Diese breite Unterstützung ermöglicht konsistente Sicherheitsüberprüfungen durch heterogene Entwicklungsteams, ohne dass mehrere spezialisierte Tools erforderlich sind. Das Cloud-native Bereitstellungsmodell der Plattform vereinfacht zudem die Bereitstellung und Skalierung und reduziert den Betriebsaufwand für Unternehmen, die eine große Anzahl von Anwendungen verwalten.

Allerdings ist die Unterstützung für ältere Technologien und Batch-Verarbeitungsumgebungen eingeschränkter. Mainframe-Sprachen, Jobsteuerungsstrukturen und eng verknüpfte Legacy-Workflows liegen typischerweise außerhalb des primären Anwendungsbereichs der Plattform. Daher wird Checkmarx One häufig zusammen mit anderen Analysetools eingesetzt, wenn Unternehmen sowohl moderne als auch ältere Komponenten innerhalb derselben Anwendungslandschaft absichern müssen.

Risikoberichterstattung und Governance-Ausrichtung

Aus Governance-Sicht bietet Checkmarx One Reporting-Funktionen zur Nachverfolgung von Schwachstellen, des Status von Behebungsmaßnahmen und zur Erstellung von Compliance-Berichten. Sicherheitsverantwortliche können Trends über Anwendungen, Teams und Zeiträume hinweg überwachen und so die Einhaltung interner Richtlinien und externer regulatorischer Vorgaben nachweisen. Die Ergebnisse lassen sich aggregieren, um die Gesamtrisikolage darzustellen und eine Priorisierung auf Portfolioebene zu ermöglichen.

Diese Berichte konzentrieren sich jedoch auf das Vorhandensein von Schwachstellen und nicht auf deren Auswirkungen auf den Betrieb. Die Plattform versucht nicht zu quantifizieren, wie sich eine Schwachstelle entlang von Ausführungspfaden ausbreitet oder wie sie mit Stapelverarbeitung, Datenflüssen oder nachgelagerten Systemen interagiert. Diese Unterscheidung ist in Unternehmen wichtig, in denen das Verständnis des Wirkungsradius und des systemischen Risikos ebenso entscheidend ist wie die Identifizierung einzelner Schwachstellen.

Typische Anwendungsfälle und Einschränkungen in Unternehmen

Checkmarx One eignet sich besonders für Unternehmen, die Sicherheitskontrollen direkt in dynamische Entwicklungsumgebungen integrieren möchten. Es zeichnet sich durch die frühzeitige Erkennung von Sicherheitslücken auf Codeebene aus, reduziert Nacharbeiten und unterstützt ein einheitliches Schwachstellenmanagement für große Entwicklergruppen. Für Organisationen, die ihre Architekturen in Richtung Cloud-nativer Architekturen modernisieren, bietet es einen skalierbaren Mechanismus zur Durchsetzung von Sicherheitsstandards.

Seine Grenzen zeigen sich in Szenarien, die ein umfassendes Verständnis des Anwendungsverhaltens, der Abhängigkeitsketten oder der Auswirkungen von Modernisierungen auf heterogene Systeme erfordern. In solchen Fällen positioniert sich Checkmarx One typischerweise eher als spezialisierte Sicherheitsebene denn als umfassende Analyseplattform und ergänzt Tools, die sich auf Einblicke in die Ausführung, die Abbildung von Abhängigkeiten und die Bewertung struktureller Risiken konzentrieren.

Statischen Code-Analysator verstärken

Fortify Static Code Analyzer ist eine Plattform für statische Anwendungssicherheitstests der Enterprise-Klasse, die Sicherheitslücken in großen, regulierten Softwareumgebungen identifiziert. Ihre Hauptaufgabe in Unternehmen besteht in der systematischen Erkennung von Codierungsmustern, die Sicherheitsrisiken bergen. Dies ist insbesondere in Organisationen relevant, in denen Compliance, Auditierbarkeit und formale Risikomanagementprozesse die Steuerung von Softwareänderungen prägen. Fortify wird häufig in Branchen eingesetzt, in denen die Sicherheitsgewährleistung nachweisbar, wiederholbar und mit etablierten Unternehmenskontrollen abgestimmt sein muss.

Anstatt entwicklerzentrierte Feedbackschleifen zu betonen, positioniert sich Fortify häufig als zentrale Sicherheitskontrolle innerhalb umfassenderer Governance-Frameworks. Es unterstützt Organisationen, die eine standardisierte Schwachstellenklassifizierung, konsistente Berichterstattung und Rückverfolgbarkeit über große Anwendungsportfolios hinweg benötigen, die von verteilten Teams oder Drittanbietern entwickelt wurden.

Sicherheitsorientierte statische Analyse-Engine

Das Herzstück des Fortify Static Code Analyzer ist eine sicherheitsorientierte Analyse-Engine, die Quellcode untersucht, um Schwachstellen zu identifizieren, ohne Anwendungen auszuführen. Die Engine wendet umfassende Sicherheitsregeln an, die Schwächen wie Injection-Fehler, unsichere Datenverarbeitung, Authentifizierungsfehler und unsachgemäße Verwendung kryptografischer Funktionen aufdecken. Die Ergebnisse werden nach Schweregrad und Art kategorisiert, sodass Sicherheitsteams Risiken strukturiert und konsistent bewerten können.

Der Fokus auf sicherheitsrelevante Korrektheit unterscheidet Fortify von allgemeinen statischen Analysetools. Die Analysetiefe ist auf die Identifizierung ausnutzbarer Schwachstellen ausgerichtet, anstatt auf Wartbarkeit oder Architekturaspekte. Diese Spezialisierung macht Fortify besonders geeignet für Umgebungen, in denen die Schwachstellenerkennung Vorrang vor einem umfassenden Systemverständnis hat.

Ausrichtung an unternehmensweiten Risiko- und Compliance-Programmen

Fortify wird häufig in Sicherheits- und Governance-Programme von Unternehmen integriert, um Softwarerisiken neben anderen betrieblichen und regulatorischen Risiken zu managen. Die Berichts- und Nachweisfunktionen unterstützen interne Audits, externe Bewertungen und behördliche Prüfungen. Die Ergebnisse lassen sich anwendungs- und geschäftsbereichsübergreifend aggregieren und bieten der Sicherheitsleitung einen umfassenden Überblick über das Risikoexposure.

Diese Ausrichtung auf formale IT-Risikomanagement Die Prozesse machen Fortify zu einer gängigen Wahl für Organisationen, die die Wirksamkeit ihrer Kontrollmaßnahmen kontinuierlich nachweisen müssen. Berichte können genutzt werden, um Schwachstellentrends, Fortschritte bei der Behebung von Sicherheitslücken und die Einhaltung interner Sicherheitsrichtlinien aufzuzeigen und so eine fundierte Entscheidungsfindung bei Audits oder Vorfallanalysen zu unterstützen.

Sprachabdeckung und Bereitstellungsmerkmale

Fortify Static Code Analyzer unterstützt eine breite Palette an Programmiersprachen, die in Unternehmensumgebungen häufig anzutreffen sind, darunter sowohl moderne Anwendungsstacks als auch ausgewählte Legacy-Technologien. Dies ermöglicht es Unternehmen, einen einheitlichen Sicherheitsanalyseansatz über verschiedene Entwicklungsteams und Technologiebereiche hinweg anzuwenden. Die Bereitstellungsmodelle variieren; Fortify wird häufig lokal oder in kontrollierten Unternehmensumgebungen installiert, um die Anforderungen an Datenresidenz und Sicherheit zu erfüllen.

Die Analyse erfolgt jedoch üblicherweise auf Anwendungs- oder Projektebene. Obwohl Fortify für viele Anwendungen skalierbar ist, werden Ausführungsreihenfolge, Batch-Verarbeitung oder anwendungsübergreifende Datenflüsse nicht berücksichtigt. Daher beschränkt sich die Risikobewertung auf Code-Artefakte und betrachtet nicht das systemweite Verhalten.

Integration in sichere Entwicklungslebenszyklen

Fortify wird typischerweise als Kontrollmechanismus in sichere Entwicklungsprozesse integriert und nicht als kontinuierliches Erkundungswerkzeug. Scans können in definierten Phasen ausgelöst werden, beispielsweise bei Vorabprüfungen, größeren Änderungsphasen oder Compliance-Checks. Dieses Betriebsmodell eignet sich für Organisationen, die kontrollierte Release-Prozesse und formale Genehmigungen gegenüber Continuous Deployment bevorzugen.

Obwohl Integrationen mit CI/CD-Tools verfügbar sind, spiegelt die Nutzung von Fortify häufig ein ausgewogenes Verhältnis zwischen Automatisierung und zentralisierter Überwachung wider. Sicherheitsbefunde werden von spezialisierten Teams geprüft, die den Bedarf an Abhilfemaßnahmen bewerten und über die Risikoakzeptanz entscheiden. Dies stärkt die unternehmensweite Governance-Konsistenz.

Typische Anwendungsfälle und Einschränkungen in Unternehmen

Fortify Static Code Analyzer ist besonders effektiv in Unternehmen, in denen Sicherheitsgewährleistung, Auditvorbereitung und die Einhaltung gesetzlicher Vorschriften im Vordergrund stehen. Er bietet einen strukturierten und nachvollziehbaren Ansatz zur Identifizierung von Sicherheitslücken im Quellcode und zeigt auf, dass Kontrollmechanismen zur Erkennung und Behebung dieser Schwachstellen vorhanden sind.

Seine Grenzen werden in Szenarien deutlich, die ein Verständnis dafür erfordern, wie Schwachstellen mit dem Ausführungsverhalten, der Stapelverarbeitung oder plattformübergreifenden Abhängigkeiten interagieren. Fortify modelliert weder das Laufzeitverhalten noch die systemweiten Auswirkungen und wird häufig durch Tools ergänzt, die tiefergehende Einblicke in die Anwendungsstruktur, Abhängigkeitsketten und Modernisierungsrisiken in heterogenen Umgebungen ermöglichen.

CAST-Highlight

CAST Highlight ist eine Plattform für Anwendungsanalyse und Portfoliobewertung in Unternehmen. Sie bietet umfassende Transparenz hinsichtlich Softwarequalität, Risiken und Modernisierungsbereitschaft in großen Anwendungslandschaften. In Unternehmensumgebungen unterstützt sie primär strategische Entscheidungen, indem sie Strukturmerkmale, Indikatoren für technische Schulden und Cloud-Eignungssignale zusammenfasst, anstatt tiefgreifende, ausführungsorientierte Codeanalysen durchzuführen. CAST Highlight wird häufig frühzeitig in Modernisierungsprogrammen eingesetzt, um ein grundlegendes Verständnis des Portfoliozustands zu schaffen.

Im Gegensatz zu entwicklerzentrierten statischen Analysetools arbeitet CAST Highlight auf aggregierter Ebene. Es soll Architekten, Portfoliomanagern und Transformationsleitern helfen, Anwendungen zu vergleichen, Modernisierungskandidaten zu identifizieren und Sanierungsmaßnahmen in Hunderten oder Tausenden von Systemen zu priorisieren.

Portfolioanalyse und Softwareintelligenz

Kernstück von CAST Highlight ist eine schlanke Analyse-Engine, die strukturelle Metadaten aus dem Quellcode und den Konfigurationsartefakten von Anwendungen extrahiert. Diese Daten werden in ein gemeinsames Analysemodell normalisiert, das die Bewertung verschiedenster Anwendungen anhand einheitlicher Kriterien ermöglicht. Kennzahlen zu Codequalität, Wartbarkeit, Sicherheitsrisiken und Architekturtauglichkeit werden berechnet und in Dashboards und Vergleichsansichten dargestellt.

Diese Fähigkeiten stehen im Einklang mit einem breiteren Software-Intelligenz Initiativen, deren Ziel es ist, unstrukturierten Quellcode in entscheidungsrelevante Erkenntnisse für Stakeholder ohne Entwicklerhintergrund umzuwandeln. Durch die Abstraktion komplexer Sachverhalte in standardisierte Indikatoren ermöglicht CAST Highlight Führungsteams, große Portfolios zu analysieren, ohne detaillierte Codeanalysen durchführen zu müssen.

Bewertung der Modernisierungsbereitschaft und Cloud-Eignung

CAST Highlight legt besonderen Wert auf die Bewertung von Anwendungen hinsichtlich ihrer Modernisierungs- und Cloud-Migrationsfähigkeit. Es analysiert Faktoren wie Framework-Nutzung, Abhängigkeitsmuster und Aktualität der Technologie, um den Aufwand und das Risiko einer Migration von Anwendungen auf moderne Plattformen abzuschätzen. Die Ergebnisse dienen häufig dazu, Anwendungen in Kategorien wie „Rehosting“, „Refactoring“, „Ersetzen“ oder „Außerbetriebnahme“ einzuteilen.

Dieser bewertungsbasierte Ansatz unterstützt die Planung und Budgetierung in der frühen Phase. Unternehmen können die Ergebnisse von CAST Highlight nutzen, um Modernisierungsfahrpläne zu erstellen, den Transformationsumfang abzuschätzen und Risikoprofile an die relevanten Stakeholder zu kommunizieren. Die Analyse ist jedoch bewusst breit gefasst und versucht nicht, das detaillierte Ausführungsverhalten oder Nebenwirkungen der Transformation zu modellieren.

Sicherheits- und technische Schuldenindikatoren

Zusätzlich zu Modernisierungssignalen liefert CAST Highlight übergeordnete Indikatoren für Sicherheitslücken und technische Schulden. Diese Indikatoren basieren auf bekannten Mustern, die mit erhöhten Wartungskosten oder einem gesteigerten Risiko von Sicherheitslücken einhergehen. Ziel ist es nicht, dedizierte Sicherheits-Scanning-Tools zu ersetzen, sondern Bereiche aufzuzeigen, in denen eine eingehendere Untersuchung ratsam sein kann.

Da die Ergebnisse aggregiert werden, eignen sie sich am besten für vergleichende Analysen und weniger für die Planung von Sanierungsmaßnahmen. Sicherheits- und Schuldenindikatoren helfen Unternehmen zwar, die relative Risikoverteilung innerhalb ihrer Portfolios zu verstehen, sie identifizieren jedoch keine spezifischen Ausführungspfade, Datenflüsse oder betrieblichen Abhängigkeiten, die durch Codeänderungen beeinträchtigt würden.

Skalierbarkeit und Betriebsmodell

CAST Highlight ist für die effiziente Skalierung über sehr große Anwendungsportfolios hinweg konzipiert. Sein ressourcenschonender Analyseansatz minimiert den Verarbeitungsaufwand und ermöglicht die schnelle Integration neuer Anwendungen. Dadurch eignet es sich besonders für Unternehmen, die im Rahmen von Fusionen, Veräußerungen oder frühen Modernisierungsinitiativen umfassende Analysen ihrer Softwarelandschaften durchführen.

Der Nachteil dieser Skalierbarkeit liegt in der geringeren Analysetiefe. CAST Highlight kann weder Aufrufdiagramme noch Batch-Verarbeitungsketten oder plattformübergreifende Datenweitergabe auflösen. Daher wird es häufig in Verbindung mit tiefergehenden Analysetools eingesetzt, sobald spezifische Anwendungen oder Transformationsinitiativen von der Planungs- in die Umsetzungsphase übergehen.

Typische Anwendungsfälle und Einschränkungen in Unternehmen

CAST Highlight ist besonders effektiv in Unternehmen, die einen vergleichenden Überblick über ihre Anwendungsportfolios benötigen, um ihre strategische Planung zu unterstützen. Es eignet sich hervorragend zur Identifizierung von Modernisierungskandidaten, zur Abschätzung der Transformationskomplexität und zur Kommunikation technischer Risiken an nicht-technische Stakeholder.

Seine Grenzen werden deutlich, wenn Unternehmen ein präzises Verständnis davon benötigen, wie sich Änderungen auf das Ausführungsverhalten, Abhängigkeitsketten oder die Betriebsstabilität auswirken. CAST Highlight bietet nicht die notwendigen Einblicke auf Ausführungsebene, um Refactoring- oder Modernisierungsmaßnahmen sicher durchzuführen, und wird daher typischerweise durch Tools ergänzt, die sich auf detaillierte Wirkungsanalysen und die Verhaltensanalyse innerhalb ausgewählter Anwendungen konzentrieren.

CAST-Bildgebung

CAST Imaging ist eine Plattform für Enterprise Application Intelligence mit Fokus auf Architekturanalyse und Visualisierung struktureller Abhängigkeiten in komplexen Softwaresystemen. In großen Organisationen dient sie primär dazu, aufzuzeigen, wie Anwendungen aufgebaut sind, wie Komponenten interagieren und wo strukturelle Kopplungen Risiken bergen. CAST Imaging wird typischerweise von Architekten und Modernisierungsteams eingesetzt, die ein umfassendes Verständnis der Anwendungsstruktur auf Systemebene benötigen, bevor sie Refactoring-, Migrations- oder Dekompositionsinitiativen planen.

Anstatt als Code-Inspektions- oder Sicherheitsscanning-Tool zu fungieren, legt CAST Imaging den Schwerpunkt auf das Architekturverständnis. Es wandelt Quellcode und Konfigurationsartefakte in navigierbare Modelle um, die Beziehungen zwischen Komponenten, Schichten und Technologien veranschaulichen und es den Beteiligten ermöglichen, Komplexität in großem Umfang zu analysieren.

Architekturkartierung und Abhängigkeitsvisualisierung

Kernstück von CAST Imaging ist die Fähigkeit, detaillierte Architekturdarstellungen von Anwendungen und Anwendungsportfolios zu generieren. Diese Darstellungen umfassen Komponentendiagramme, Interaktionsdiagramme und mehrschichtige Ansichten, die die Kommunikation und Abhängigkeiten zwischen Modulen aufzeigen. Durch die Visualisierung struktureller Beziehungen ermöglicht CAST Imaging Teams, enge Kopplungen, zirkuläre Abhängigkeiten und Architekturverstöße zu identifizieren, die durch eine Analyse auf Dateiebene schwer zu erkennen sind.

Diese visuellen Modelle stimmen eng mit Praktiken überein, die sich auf Folgendes konzentrieren AbhängigkeitsgraphenDas Verständnis struktureller Zusammenhänge ist für das Risikomanagement in großen Systemen unerlässlich. CAST Imaging ermöglicht es Nutzern, Abhängigkeiten interaktiv zu durchlaufen und je nach Bedarf von übergeordneten Architekturansichten zu detaillierteren Darstellungen zu wechseln.

Multitechnologie- und anwendungsübergreifende Abdeckung

CAST Imaging unterstützt Analysen über eine Vielzahl von Programmiersprachen, Frameworks und Plattformen hinweg, die in Unternehmensumgebungen häufig anzutreffen sind. Diese breite Unterstützung ermöglicht die Modellierung heterogener Systeme, die aus Legacy-Komponenten, verteilten Diensten und gemeinsam genutzten Datenbanken bestehen. Die anwendungsübergreifenden Analysefunktionen versetzen Teams in die Lage zu verstehen, wie einzelne Systeme in größere Portfolios eingebettet sind und wie sich Änderungen in einer Anwendung auf andere auswirken können.

Die Analyse bleibt jedoch strukturell und nicht verhaltensbezogen. CAST Imaging modelliert statische Beziehungen zwischen Komponenten, simuliert aber weder die Ausführungsreihenfolge noch Laufzeitbedingungen oder die Logik der Stapelverarbeitung. Daher liefert es zwar Klarheit darüber, wie Systeme miteinander verbunden sind, aber nicht unbedingt darüber, wie sie sich während der Ausführung verhalten.

Unterstützung für Modernisierung und Architektursteuerung

CAST Imaging wird häufig zur Unterstützung von Modernisierungsinitiativen eingesetzt, bei denen architektonische Klarheit eine Grundvoraussetzung für Veränderungen ist. Durch das Aufdecken von Verstößen gegen Architekturprinzipien und das Identifizieren von Bereichen übermäßiger Kopplung hilft es Teams bei der Planung inkrementeller Transformationsstrategien. Diese Erkenntnisse können Entscheidungen über Service-Extraktion, Schnittstellen-Redesign oder phasenweise Migrationsansätze beeinflussen.

Im Kontext von Governance kann CAST Imaging auch zur Bewertung der Architekturkonformität mit definierten Standards eingesetzt werden. Abweichungen von Zielarchitekturen lassen sich identifizieren und dokumentieren, was die Überwachung und die Planung von Korrekturmaßnahmen unterstützt. Dies macht es wertvoll für Organisationen, die Architekturkontrollen als Teil ihrer Änderungsmanagementprozesse durchsetzen.

Überlegungen zur Skalierbarkeit und Portfoliomodellierung

Die Plattform ist für die Skalierung auf große Anwendungen und Portfolios ausgelegt und generiert Architekturmodelle, die mit allen Beteiligten geteilt werden können. Ihr visualisierungsorientierter Ansatz unterstützt die kollaborative Analyse und Kommunikation, insbesondere bei der Erläuterung komplexer Strukturen für Nicht-Entwickler.

Der Nachteil dieser Skalierbarkeit besteht in der eingeschränkten Transparenz der Betriebsabläufe. CAST Imaging kann die Datenherkunft auf Feldebene nicht auflösen, Batch-Verarbeitungsabläufe nicht verfolgen und die Auswirkungen von Änderungen zur Laufzeit nicht quantifizieren. Für Projekte, die eine präzise Abgrenzung der Änderungsfolgen oder die Validierung des Ausführungsverhaltens erfordern, sind in der Regel zusätzliche Analysetools notwendig.

Typische Anwendungsfälle und Einschränkungen in Unternehmen

CAST Imaging ist besonders effektiv in Unternehmen, die ihre Anwendungsarchitektur verstehen und rationalisieren müssen, bevor sie größere Änderungen vornehmen. Es eignet sich hervorragend, um strukturelle Komplexität aufzudecken, architektonische Refaktorierungen zu steuern und die Modernisierungsplanung heterogener Systeme zu unterstützen.

Seine Grenzen werden deutlich, wenn Organisationen Einblicke auf Ausführungsebene, Folgenabschätzungen oder die Validierung der Auswirkungen von Änderungen auf das Laufzeitverhalten benötigen. CAST Imaging liefert eher eine Strukturkarte als einen operativen Fahrplan und wird häufig durch Tools ergänzt, die eine tiefergehende Analyse von Ausführungspfaden, Datenflüssen und Systemverhalten ermöglichen.

Statische Veracode-Analyse

Veracode Static Analysis ist eine Cloud-native Plattform für statische Anwendungssicherheitstests, die Sicherheitskontrollen direkt in moderne Softwareentwicklungsprozesse integriert. Ihre Hauptaufgabe in Unternehmensumgebungen besteht darin, Sicherheitslücken frühzeitig und kontinuierlich in großen Mengen Anwendungscode zu identifizieren, insbesondere in Organisationen, die schnelle Release-Zyklen, verteilte Entwicklungsteams und eine zentrale Sicherheitsaufsicht priorisieren. Veracode wird häufig dort eingesetzt, wo die Sicherheitsgewährleistung skalierbar sein muss, ohne die Entwicklungsgeschwindigkeit zu beeinträchtigen.

Die Plattform setzt auf Automatisierung und Konsistenz und positioniert die statische Analyse als permanente Sicherheitsmaßnahme anstatt als periodische Überprüfung. Dieses Betriebsmodell eignet sich für Unternehmen, die auf cloudbasierte Entwicklungswerkzeuge umgestellt haben und einen zentralen Überblick über den Sicherheitsstatus ihrer Anwendungen über verschiedene Teams und Projekte hinweg benötigen.

Sicherheitstests für statische Cloud-Anwendungen

Kernstück der statischen Sicherheitsanalyse von Veracode ist eine Engine für statische Sicherheitsscans, die vollständig als Managed Cloud Service bereitgestellt wird. Quellcode und Binärdateien werden zur Analyse hochgeladen und auf Schwachstellen wie Injection-Fehler, unsichere Datenverarbeitung und Authentifizierungsschwächen untersucht. Die Analyse benötigt keinen Zugriff auf Produktionsumgebungen, sodass Sicherheitsbewertungen frühzeitig im Lebenszyklus ohne Betriebsrisiko durchgeführt werden können.

Dieser Cloud-native Ansatz ermöglicht eine schnelle Integration und flexible Skalierung über große Portfolios hinweg. Unternehmen können einheitliche Sicherheitsrichtlinien für Hunderte von Anwendungen anwenden, ohne eigene Infrastruktur betreiben zu müssen. Die Ergebnisse werden normalisiert und in zentralen Dashboards dargestellt, um die Sicherheitsteams bei der unternehmensweiten Risikoüberwachung zu unterstützen.

Integration in Continuous-Delivery-Pipelines

Veracode ist für die nahtlose Integration in CI/CD-Pipelines und Entwicklerwerkzeuge konzipiert. Scans können während der Build- oder Release-Phase automatisch ausgelöst werden, und die Ergebnisse werden in Formaten zurückgegeben, die sich in Issue-Tracking- und Remediation-Workflows integrieren lassen. Dies unterstützt ein Shift-Left-Sicherheitsmodell, bei dem Schwachstellen möglichst früh nach ihrem Auftreten behoben werden.

In der Praxis wird die Rolle von Veracode innerhalb von Pipelines häufig mit umfassenderen Qualitäts- und Testkontrollen koordiniert, einschließlich Aktivitäten wie beispielsweise LeistungsregressionstestsUm sicherzustellen, dass die Durchsetzung von Sicherheitsmaßnahmen nicht isoliert von anderen nicht-funktionalen Anforderungen erfolgt, wird diese Abstimmung gefördert. Sie hilft Unternehmen, ein Gleichgewicht zwischen strengen Sicherheitsstandards und hoher Leistungsfähigkeit zu finden.

Sprachliche Abdeckung und Portfoliokonsistenz

Veracode Static Analysis unterstützt eine Vielzahl moderner Programmiersprachen und Frameworks, die häufig in der Entwicklung von Unternehmensanwendungen eingesetzt werden. Diese breite Unterstützung ermöglicht es Sicherheitsteams, einheitliche Scanrichtlinien über heterogene Entwicklungsumgebungen hinweg anzuwenden und so potenzielle Sicherheitslücken zwischen Teams oder Plattformen zu schließen.

Der Fokus der Plattform liegt jedoch weiterhin auf der Sicherheitsprüfung von Anwendungen. Die Analyse beschränkt sich typischerweise auf einzelne Anwendungen oder Dienste, und Beziehungen zwischen Anwendungen, Batch-Workflows oder gemeinsam genutzten Datenstrukturen werden nicht modelliert. Daher bietet Veracode zwar eine umfassende Abdeckung von Schwachstellen auf Codeebene, jedoch nur begrenzte Einblicke in deren mögliche Ausbreitung in vernetzten Systemen.

Risikoberichterstattung und Transparenz der Unternehmensführung

Veracode bietet Reporting-Funktionen, mit denen Sicherheitsverantwortliche unternehmensweit Schwachstellentrends, Fortschritte bei der Behebung und die Einhaltung von Richtlinien verfolgen können. Dashboards ermöglichen eine Portfolio-Ansicht des Risikos und somit eine Priorisierung nach Schweregrad und geschäftlichen Auswirkungen. Diese Berichte werden häufig zur Unterstützung der internen Sicherheits-Governance, des Management-Reportings und von externen Prüfaktivitäten eingesetzt.

Diese Funktionen unterstützen zwar Verantwortlichkeit und Aufsicht, der Fokus der Berichterstattung liegt jedoch weiterhin auf Schwachstellen. Veracode quantifiziert weder die betrieblichen Auswirkungen noch die Unterbrechung von Ausführungsabläufen oder das Modernisierungsrisiko im Zusammenhang mit Behebungsmaßnahmen. Diese Unterscheidung ist wichtig in Umgebungen, in denen Sicherheitsänderungen im Hinblick auf Stabilität und Änderungsmanagement bewertet werden müssen.

Typische Anwendungsfälle und Einschränkungen in Unternehmen

Veracode Static Analysis ist besonders effektiv in Unternehmen mit hohem Entwicklungstempo, die skalierbare, zentralisierte Sicherheitsüberprüfungen moderner Anwendungsarchitekturen benötigen. Es zeichnet sich durch die Durchsetzung einheitlicher Sicherheitsstandards, die Verkürzung der Erkennungszeit von Schwachstellen und die Unterstützung von DevSecOps-Betriebsmodellen aus.

Seine Grenzen werden in Szenarien deutlich, die ein tiefes Verständnis des Systemverhaltens, anwendungsübergreifender Abhängigkeiten oder älterer Stapelverarbeitung erfordern. Veracode bietet keine Einblicke auf Ausführungsebene oder eine Abbildung architektonischer Abhängigkeiten und positioniert sich typischerweise als spezialisierte Sicherheitsebene, ergänzt durch Tools, die sich auf Wirkungsanalyse, Transparenz von Abhängigkeiten und das Verständnis von Systemen im Unternehmensmaßstab konzentrieren.

Coverity (Synopsen)

Coverity ist eine Plattform für statische Codeanalyse in Unternehmen, die für ihre Fähigkeit bekannt ist, komplexe Fehler in großen, leistungskritischen Codebasen zu erkennen. Ihre Hauptaufgabe in Unternehmensumgebungen besteht darin, tiefgreifende Korrektheits- und Zuverlässigkeitsprobleme aufzudecken, die sich durch Tests allein nur schwer finden lassen, insbesondere in Systemen, deren Ausfall erhebliche betriebliche, sicherheitsrelevante oder finanzielle Konsequenzen hat. Coverity wird häufig in Branchen wie der Automobil-, Luft- und Raumfahrt-, Telekommunikations- und Infrastruktursoftware eingesetzt, wo Genauigkeit bei der Fehlererkennung und niedrige Fehlalarmraten unerlässlich sind.

Im Gegensatz zu Portfolio-Analyseplattformen konzentriert sich Coverity auf die Korrektheit des Quellcodes in umfangreichen Codebasen. Es ist darauf ausgelegt, große Mengen an Quellcode effizient zu analysieren und dabei ein hohes Maß an analytischer Genauigkeit zu gewährleisten. Dadurch eignet es sich für Organisationen, die langlebige Systeme mit strengen Zuverlässigkeitsanforderungen verwalten.

Tiefenfehlererkennung und Präzisionsanalyse

Kernstück von Coverity ist eine statische Analyse-Engine, die für die Erkennung von Fehlern wie Speicherbeschädigung, Ressourcenlecks, Parallelitätsproblemen und Logikfehlern optimiert ist. Die Engine ist bekannt für ihre Fähigkeit, komplexe Kontrollpfade und Ausführungsszenarien zu analysieren, die sich über mehrere Funktionen und Module erstrecken. Diese detaillierte Analyse ermöglicht es ihr, Fehler zu identifizieren, die möglicherweise nur unter bestimmten Laufzeitbedingungen auftreten.

Der analytische Ansatz von Coverity umfasst fortschrittliche Techniken im Zusammenhang mit symbolische AusführungDadurch kann es mehrere Ausführungspfade untersuchen, ohne den Code auszuführen. Diese Fähigkeit trägt zu seinem Ruf für hohe Genauigkeit bei und hilft, das Rauschen zu reduzieren, das häufig bei umfangreichen statischen Analysen in Unternehmensumgebungen auftritt.

Sprachfokus und gezielte Berichterstattung

Coverity bietet umfassende Unterstützung für Sprachen, die häufig in systemnaher und leistungskritischer Software verwendet werden, darunter C, C++ und Java. Durch diesen Fokus eignet es sich besonders gut für die Analyse von Kerninfrastrukturkomponenten, eingebetteten Systemen und Backend-Diensten, wo Fehler auf niedriger Ebene besonders gravierende Auswirkungen haben können.

Die Plattform ist zwar für große Codebasen skalierbar, ihre Sprachabdeckung ist jedoch geringer als bei manchen universellen statischen Analysetools. Sie ist weniger auf heterogene Unternehmensumgebungen mit Batchverarbeitungssprachen, Skriptumgebungen oder Mainframe-spezifischen Technologien ausgerichtet. Daher wird Coverity häufig selektiv innerhalb von Portfolios eingesetzt und konzentriert sich auf Komponenten, bei denen höchste Genauigkeit bei der Fehlererkennung entscheidend ist.

Integration in unternehmensweite Entwicklungsworkflows

Coverity ist für die Integration in Unternehmensentwicklungsprozesse konzipiert, einschließlich CI/CD-Pipelines und zentralisierter Fehlermanagementsysteme. Scans können geplant oder automatisch ausgelöst werden, und die Ergebnisse werden zur Behebung an die Entwicklungsteams weitergeleitet. Die Plattform unterstützt inkrementelle Analysen, sodass sich Teams auf neu aufgetretene Probleme konzentrieren und gleichzeitig den Überblick über bestehende Fehler behalten können.

In vielen Organisationen wird Coverity eher als Qualitätssicherungsinstrument denn als Werkzeug zur kontinuierlichen Datenanalyse eingesetzt. Die Scans werden häufig zu festgelegten Meilensteinen durchgeführt, beispielsweise vor größeren Releases oder im Rahmen formeller Qualitätsprüfungen. Dieses Nutzungsmuster spiegelt die Rolle von Coverity bei der Durchsetzung von Zuverlässigkeitsstandards wider, anstatt schnelle Iterationen zu unterstützen.

Skalierbarkeit und Leistungsmerkmale

Coverity wurde für die effiziente Verarbeitung sehr großer Codebasen entwickelt und eignet sich daher ideal für Unternehmen mit Millionen Zeilen kritischem Code. Die Leistung skaliert mit der verfügbaren Infrastruktur, sodass Organisationen umfangreiche Systeme ohne prohibitive Analysezeiten analysieren können. Zentrale Dashboards bieten Einblick in Fehlertrends und den Fortschritt der Fehlerbehebung in allen Projekten.

Die Skalierbarkeit von Coverity konzentriert sich jedoch auf das Codevolumen und nicht auf die Systemkomplexität. Es versucht nicht, anwendungsübergreifende Abhängigkeiten, die Ausführungsreihenfolge von Batch-Prozessen oder die Datenherkunft über verschiedene Plattformen hinweg zu modellieren. Die Erkenntnisse konzentrieren sich weiterhin auf die Fehlererkennung innerhalb einzelner Codebasen und nicht auf das systemweite Verhalten.

Typische Anwendungsfälle und Einschränkungen in Unternehmen

Coverity ist besonders effektiv in Unternehmen, die eine zuverlässige Fehlererkennung in kritischen Softwarekomponenten benötigen. Es zeichnet sich durch seine Fähigkeit aus, subtile Probleme zu identifizieren, die zu Abstürzen, Sicherheitslücken oder unvorhersehbarem Verhalten im Produktivbetrieb führen könnten, insbesondere in Low-Level- oder leistungssensiblem Code.

Seine Grenzen werden bei Modernisierungs- oder Transformationsprojekten deutlich, die ein Verständnis der Auswirkungen von Änderungen auf vernetzte Systeme erfordern. Coverity bietet keine Architekturabhängigkeitsanalyse oder Wirkungsanalyse auf Ausführungsebene und wird typischerweise durch Tools ergänzt, die sich auf Portfoliotransparenz, Abhängigkeitsanalyse und Verhaltensanalyse in heterogenen Unternehmensumgebungen konzentrieren.

Parasoft C/C++ Test und DTP

Parasoft C/C++test und die zugehörige Entwicklungs- und Testplattform (DTP) bilden eine Lösung für statische Codeanalyse und Konformitätsprüfung auf Enterprise-Niveau, die speziell für sicherheitskritische und stark regulierte Softwareumgebungen entwickelt wurde. In großen Unternehmen dient Parasoft primär der strengen Verifizierung von Systemcode, da Fehler zu Betriebsstörungen, Verstößen gegen gesetzliche Vorschriften oder Sicherheitsvorfällen führen können. Parasoft wird häufig in Branchen wie der Luft- und Raumfahrt, der Automobilindustrie, der Verteidigungsindustrie und im Bereich industrieller Systeme eingesetzt, wo das Verhalten von Software nachweislich korrekt und auditierbar sein muss.

Im Gegensatz zu allgemeinen statischen Analysetools legt Parasoft Wert auf die Einhaltung definierter Standards und Verifizierungsziele. Die Plattform ist für Umgebungen konzipiert, in denen die Entwicklung durch formale Prozesse, Zertifizierungsanforderungen und dokumentierte Sicherheitsnachweise und nicht durch schnelle Iterationen gesteuert wird.

Standardsbasierte statische Analyse und Durchsetzung der Konformität

Kernstück von Parasoft C/C++test ist eine statische Analyse-Engine, die mit branchenüblichen Sicherheits- und Codierungsstandards wie MISRA, CERT und ISO-Richtlinien kompatibel ist. Die Engine bewertet Quellcode anhand strenger Regelsätze, die zulässige Konstrukte, Nutzungsmuster und Fehlerzustände definieren. Verstöße werden nach Schweregrad kategorisiert und direkt den Compliance-Anforderungen zugeordnet, sodass Unternehmen die Einhaltung vorgeschriebener Entwicklungspraktiken nachweisen können.

Dieser standardorientierte Ansatz passt zu Umgebungen, die auf ... basieren. formale Überprüfung Konzepte, bei denen Korrektheit nicht nur durch funktionales Verhalten, sondern auch durch die Einhaltung vorgegebener Regeln definiert wird. Die Analyseergebnisse von Parasoft können als Nachweis in Zertifizierungs- und Auditprozessen verwendet werden und reduzieren so den manuellen Prüfaufwand.

Gezielte Sprachunterstützung und tiefgehende, zielgerichtete Analyse

Parasoft C/C++test ist speziell für C- und C++-Codebasen optimiert und bietet umfassende Analysefunktionen für Sprachen, die häufig in eingebetteter Software und Systemsoftware eingesetzt werden. Dank dieser Spezialisierung kann die Plattform Low-Level-Probleme wie Speichermissbrauch, Zeigerfehler und Parallelitätsfehler identifizieren, die in sicherheitskritischen Umgebungen besonders gefährlich sein können.

Diese Detailtiefe ist zwar im Zielbereich wertvoll, schränkt aber gleichzeitig die Anwendbarkeit der Plattform in breiteren Unternehmensumgebungen ein. Parasoft zielt nicht darauf ab, eine umfassende Abdeckung verschiedener Programmiersprachen, Batch-Verarbeitungsumgebungen oder älterer Mainframe-Systeme zu bieten. Daher wird die Lösung typischerweise in ausgewählten Segmenten eines Unternehmensportfolios eingesetzt und nicht als universelle Analyselösung.

Integration in regulierte Entwicklungszyklen

Parasoft ist für die Integration in strukturierte Entwicklungszyklen konzipiert, die Wert auf Rückverfolgbarkeit, Dokumentation und kontrollierte Änderungen legen. Statische Analyseergebnisse lassen sich über die DTP-Komponente mit Anforderungen, Testfällen und Fehlerverfolgungssystemen verknüpfen und ermöglichen so eine durchgängige Rückverfolgbarkeit von der Spezifikation bis zur Verifizierung.

Diese Integration unterstützt Entwicklungsmodelle, bei denen Änderungen gezielt eingeführt und formal geprüft werden. Analysen werden häufig zu definierten Meilensteinen durchgeführt, beispielsweise vor Zertifizierungseinreichungen oder größeren Releases, anstatt kontinuierlich bei jedem Commit. Dieses Betriebsmodell spiegelt die Prioritäten regulierter Umgebungen wider, in denen Vorhersagbarkeit und Sicherheit wichtiger sind als Geschwindigkeit.

Berichterstattung, Rückverfolgbarkeit und Auditbereitschaft

Die Entwicklungstestplattform bietet zentralisierte Berichterstattung und Analysen für Projekte und Teams. Kennzahlen zum Compliance-Status, zu Fehlertrends und zur Verifizierungsabdeckung können aggregiert und von Qualitätssicherungs- und Compliance-Verantwortlichen geprüft werden. Die Berichte sind so strukturiert, dass sie Audit- und Zertifizierungsaktivitäten unterstützen und dokumentierte Nachweise über die Durchführung und die Ergebnisse der Analysen liefern.

Diese Berichte konzentrieren sich jedoch auf die Einhaltung von Codevorgaben und nicht auf das systemweite Verhalten. Parasoft modelliert weder Ausführungspfade über Anwendungen hinweg noch Batch-Verarbeitung oder plattformübergreifende Abhängigkeiten. Die Rückverfolgbarkeit orientiert sich an Anforderungen und Standards und nicht an der Laufzeitinteraktion zwischen Komponenten.

Typische Anwendungsfälle und Einschränkungen in Unternehmen

Parasoft C/C++test und DTP sind besonders effektiv in Unternehmen, in denen Sicherheit, Zuverlässigkeit und die Einhaltung gesetzlicher Vorschriften höchste Priorität haben. Sie bieten ein strukturiertes Framework zur Überprüfung, ob kritischer Code strengen Standards entspricht und einer formalen Prüfung standhält.

Ihre Grenzen werden in Umgebungen deutlich, die ein umfassendes Verständnis großer, vernetzter Systeme oder die Unterstützung heterogener Technologie-Stacks erfordern. Parasoft ist nicht darauf ausgelegt, Transparenz auf Portfolioebene oder anwendungsorientierte Wirkungsanalysen zu bieten und wird häufig durch Tools ergänzt, die sich auf architektonische Abhängigkeiten, Modernisierungsrisiken und das Systemverhalten in komplexen Unternehmenslandschaften konzentrieren.

Klowerk

Klocwork ist eine Plattform für statische Codeanalyse in Unternehmen, die sich auf die Identifizierung von Sicherheits-, Zuverlässigkeits- und Parallelitätsfehlern in großen, komplexen Codebasen spezialisiert hat. Ihre Hauptaufgabe in Unternehmensumgebungen besteht darin, Probleme aufzudecken, die die Systemstabilität oder -sicherheit gefährden können, insbesondere in Software, die unter hoher Last, paralleler Ausführung oder eingeschränkten Laufzeitbedingungen arbeitet. Klocwork wird häufig in Branchen eingesetzt, in denen Leistung und Korrektheit eng miteinander verknüpft sind, darunter Telekommunikation, eingebettete Systeme, Finanzinfrastruktur und umfangreiche Backend-Dienste.

Die Plattform legt Wert auf die frühzeitige Fehlererkennung durch statische Analyse und ermöglicht es Unternehmen, problematische Muster zu identifizieren, bevor diese zu Laufzeitfehlern führen. Klocwork positioniert sich typischerweise als Werkzeug zur Qualitäts- und Sicherheitssicherung und nicht als umfassende Analyselösung für ein gesamtes Produktportfolio.

Parallelitäts- und zuverlässigkeitsorientierte statische Analyse

Kernstück von Klocwork ist eine statische Analyse-Engine, die Fehler in komplexen Ausführungsszenarien identifiziert. Dazu gehören Probleme im Zusammenhang mit Speicherverwaltung, Ressourcenhandhabung und Synchronisierung. Die Engine ist besonders effektiv bei der Erkennung von Fehlern in der parallelen Ausführung, wo subtile Interaktionen zwischen Threads zu unvorhersehbarem Verhalten führen können.

Dank seiner Fähigkeit, parallele Codepfade zu analysieren, ist Klocwork in Umgebungen relevant, in denen Software unter Last zuverlässig funktionieren muss. Die Analyseergebnisse umfassen häufig Erkenntnisse zu Deadlocks, Race Conditions und fehlerhaften Synchronisierungsstrukturen. Diese Funktionen unterstützen Organisationen, die Instabilitäten aufgrund schwer reproduzierbarer Parallelitätsfehler reduzieren möchten. Rennbedingungen.

Sprachfokus und leistungsbezogene Bereiche

Klocwork bietet umfassende Unterstützung für Sprachen, die häufig in systemnaher und leistungskritischer Software eingesetzt werden, darunter C, C++ und Java. Diese Fokussierung entspricht der Anwendung in Bereichen, in denen systemnahe Korrektheit und Laufzeiteffizienz entscheidend sind. Durch die Konzentration auf eine engere Auswahl an Sprachen ermöglicht die Plattform im Vergleich zu umfassenderen, allgemeineren Tools eine tiefere Analyse dieser Umgebungen.

Diese Spezialisierung schränkt jedoch auch die Anwendbarkeit in heterogenen Unternehmensumgebungen ein. Klocwork ist nicht für die Analyse von Batch-Workloads, Mainframe-Sprachen oder komplexen Skriptumgebungen ausgelegt, die in langlebigen Unternehmenssystemen häufig vorkommen. Daher wird es oft selektiv und nicht als universelle Analyselösung eingesetzt.

Integration in unternehmensweite Qualitäts- und Sicherheitsprozesse

Klocwork integriert sich nahtlos in bestehende Entwicklungs-Workflows von Unternehmen, einschließlich CI/CD-Pipelines und Fehlerverfolgungssystemen. Scans lassen sich automatisieren und die Ergebnisse zur Behebung an die Entwicklungsteams weiterleiten. Die Plattform unterstützt inkrementelle Analysen, sodass sich Teams auf neu aufgetretene Probleme konzentrieren und gleichzeitig den Überblick über bestehende Fehler behalten können.

In vielen Organisationen wird Klocwork im Rahmen formaler Qualitätssicherungsprozesse eingesetzt. Analysen können in Schlüsselphasen wie der Validierung vor der Veröffentlichung oder größeren Refactoring-Maßnahmen ausgelöst werden. Dieses Nutzungsmuster spiegelt die Rolle von Klocwork bei der Gewährleistung von Zuverlässigkeit und Sicherheit wider, nicht jedoch bei der kontinuierlichen Architekturerkundung.

Skalierbarkeitseigenschaften und Betriebsumfang

Klocwork ist für die Skalierung auf große Codebasen ausgelegt und ermöglicht die Analyse umfangreicher Systeme ohne übermäßigen Leistungsverlust. Zentrale Dashboards bieten Einblick in Fehlertrends und den Fortschritt der Fehlerbehebung in allen Projekten. Diese Ansichten unterstützen das Management bei der Überwachung und helfen Teams, Korrekturmaßnahmen anhand ihrer Schwere und Auswirkung zu priorisieren.

Trotz seiner Skalierbarkeit hinsichtlich des Codeumfangs bleibt der Analysebereich von Klocwork auf einzelne Anwendungen oder Komponenten beschränkt. Es modelliert weder anwendungsübergreifende Abhängigkeiten noch die Reihenfolge der Batch-Ausführung oder die Datenherkunft über verschiedene Plattformen hinweg. Die Erkenntnisse konzentrieren sich auf die Korrektheit des Codes und nicht auf das systemweite Verhalten.

Typische Anwendungsfälle und Einschränkungen in Unternehmen

Klocwork ist besonders effektiv in Unternehmen, die eine zuverlässige Erkennung von Parallelitäts- und Zuverlässigkeitsfehlern in leistungskritischer Software benötigen. Es zeichnet sich durch die Aufdeckung von Problemen aus, die sich durch Tests nur schwer reproduzieren lassen und in Produktionsumgebungen zu sporadischen oder katastrophalen Ausfällen führen können.

Seine Grenzen werden bei Transformationsinitiativen deutlich, die ein umfassendes Verständnis von Anwendungsportfolios, Ausführungsabläufen oder den Auswirkungen von Modernisierungen erfordern. Klocwork bietet keine Abbildung architektonischer Abhängigkeiten oder eine Wirkungsanalyse auf Ausführungsebene und wird typischerweise durch Tools ergänzt, die sich auf ein breiteres Systemverständnis und die Bewertung von Änderungsrisiken in heterogenen Unternehmensumgebungen konzentrieren.

OpenText DevOps Cloud Static Analysis

OpenText DevOps Cloud Static Analysis ist eine statische Analysefunktion für Unternehmen, die als Teil einer umfassenderen DevOps- und Application-Lifecycle-Management-Suite bereitgestellt wird. Ihre Hauptaufgabe in großen Organisationen besteht darin, standardisierte Codequalitäts- und Sicherheitsprüfungen durchzuführen, die mit etablierten Governance-Modellen für die Bereitstellung von Software übereinstimmen. Anstatt als eigenständige Deep-Learning-Plattform zu fungieren, wird sie typischerweise von Unternehmen eingesetzt, die Wert auf die Konsolidierung ihrer Toolchain und die zentrale Überwachung von Entwicklung, Test und Release legen.

Die Plattform wird am häufigsten in Umgebungen eingesetzt, in denen die Softwarebereitstellung formalen Kontrollen unterliegen muss und die Integration mit bestehenden ALM-, Test- und Release-Management-Tools eine zentrale Anforderung darstellt. Ihr Wert liegt eher in der Konsistenz und der Abstimmung mit Governance-Richtlinien als in tiefgreifenden Verhaltens- oder Architekturanalysen.

Suiteorientierte statische Analysefunktionen

OpenText DevOps Cloud Static Analysis bietet im Kern eine regelbasierte Quellcodeanalyse zur Identifizierung von Qualitätsproblemen und Sicherheitslücken. Die Analyse konzentriert sich auf häufige Fehlerkategorien, Verstöße gegen Programmierrichtlinien und Schwachstellenmuster, die ohne Ausführung der Anwendung erkannt werden können. Die Ergebnisse werden normalisiert und in zentralen Dashboards zusammen mit anderen DevOps-Metriken dargestellt.

Dieser Suite-orientierte Ansatz unterstützt Organisationen, die statische Analysen als eine Komponente eines umfassenderen Liefersteuerungs-Frameworks nutzen möchten. Durch die Einbettung von Analysen in eine integrierte Plattform können Unternehmen teamübergreifend einheitliche Standards durchsetzen, ohne zusätzliche Insellösungen in bereits komplexe Umgebungen einzuführen.

Integration mit Enterprise Delivery Governance

Die statischen Analysefunktionen von OpenText sind eng mit umfassenderen Lifecycle-Management-Funktionen wie Anforderungsverfolgung, Tests und Release-Orchestrierung integriert. Diese Integration ermöglicht die Verknüpfung von Analyseergebnissen mit Arbeitselementen, Fehlern und Genehmigungen und gewährleistet so die Rückverfolgbarkeit im gesamten Bereitstellungsprozess. Für Organisationen mit formalen Governance-Modellen vereinfacht diese Ausrichtung die Überwachung und das Reporting.

Die Plattform ist häufig darauf ausgelegt, strukturierte Change Management Prozesse, in denen Softwareänderungen definierte Prüf- und Genehmigungsphasen durchlaufen müssen. Die Ergebnisse statischer Analysen fließen in die Nachweise zur Beurteilung der Freigabebereitschaft ein und dienen nicht mehr als eigenständige Quelle technischer Erkenntnisse.

Schwerpunkt Sprachabdeckung und Standardisierung

OpenText DevOps Cloud Static Analysis unterstützt eine Reihe gängiger Enterprise-Programmiersprachen und ermöglicht so die einheitliche Einhaltung von Codierungsstandards in diversen Entwicklungsteams. Die Sprachunterstützung ist auf gängige Anwendungsentwicklungs-Stacks ausgerichtet und nicht auf Nischen- oder Legacy-Umgebungen.

Diese Breite unterstützt zwar die Standardisierung, die Analysetiefe bleibt jedoch im Vergleich zu spezialisierten Tools relativ gering. Die Plattform modelliert keine Ausführungspfade, löst keine Logik der Batch-Orchestrierung auf und analysiert keine anwendungsübergreifenden Abhängigkeiten. Ihre Ergebnisse eignen sich am besten zur Identifizierung lokaler Probleme innerhalb einzelner Codebasen.

Skalierbarkeit und Betriebseigenschaften

OpenText DevOps Cloud Static Analysis wurde als Teil einer Cloud-Suite konzipiert und skaliert dank zentralisierter Administration über mehrere Projekte und Teams hinweg. Dadurch eignet es sich ideal für Unternehmen, die einheitliche Kontrolle über große Entwicklergruppen anstreben. Die Performance skaliert mit der Cloud-Infrastruktur, wodurch der Bedarf an dedizierten On-Premise-Ressourcen reduziert wird.

Skalierbarkeit bezieht sich in diesem Kontext jedoch eher auf die organisatorische Abdeckung als auf die analytische Tiefe. Die Plattform bietet zwar einen umfassenden Überblick über Projekte, aber nur begrenzten Einblick in das Verhalten von Systemen zur Laufzeit oder die Ausbreitung von Änderungen in komplexen, vernetzten Umgebungen.

Typische Anwendungsfälle und Einschränkungen in Unternehmen

OpenText DevOps Cloud Static Analysis ist besonders effektiv in Unternehmen, die Wert auf integrierte Bereitstellungssteuerung und standardisierte Kontrollen legen, anstatt auf tiefgreifende technische Analysen. Es unterstützt Umgebungen, in denen die statische Analyse ein Kontrollpunkt unter vielen in einem kontrollierten Release-Prozess ist und die konsistente Einhaltung grundlegender Qualitäts- und Sicherheitsanforderungen gewährleistet.

Die Grenzen der Plattform werden in Szenarien deutlich, die ein detailliertes Verständnis des Ausführungsverhaltens, von Abhängigkeitsketten oder den Auswirkungen von Modernisierungen auf heterogene Systeme erfordern. Die Plattform bietet weder die notwendige Transparenz des Verhaltens noch die erforderliche Folgenabschätzung für die sichere Durchführung umfangreicher Refactoring- oder Modernisierungsprojekte und wird daher häufig durch Tools ergänzt, die auf Einblicke in die Ausführung und plattformübergreifende Analysen spezialisiert sind.

SCA Solutions – Vergleichstabelle der Fähigkeiten

| Capability | SMART TS XL | SonarQube Ent | Checkmarx Eins | SCA stärken | CAST-Highlight | CAST-Bildgebung | Veracode | Deckung | Parasoft | Klowerk | OpenText |

|---|---|---|---|---|---|---|---|---|---|---|---|

| Unternehmensportfolio-Skalierung | ✅ Ausgezeichnet | ◐ Mittel | ◐ Mittel | ◐ Mittel | ✅ Ausgezeichnet | ✅ Ausgezeichnet | ◐ Mittel | ◐ Mittel | ◐ Mittel | ◐ Mittel | ◐ Mittel |

| Multiplattform (Mainframe + Verteilt) | ✅ Voll | ❌ Nein | ❌ Nein | ❌ Begrenzt | ❌ Begrenzt | ❌ Begrenzt | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Begrenzt |

| Unterstützung älterer Programmiersprachen (COBOL, JCL, RPG) | ✅ Voll | ❌ Nein | ❌ Nein | ❌ Begrenzt | ❌ Begrenzt | ❌ Begrenzt | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein |

| Systemübergreifende Abhängigkeitsanalyse | ✅ Voll | ❌ Nein | ❌ Nein | ❌ Nein | ◐ Hohes Niveau | ◐ Strukturell | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein |

| Sichtbarkeit des Ausführungspfads (statisch) | ✅ Voll | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ◐ Teilweise | ◐ Teilweise | ◐ Teilweise | ❌ Nein |

| Batch- und Job-Flow-Analyse | ✅ Voll | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein |

| Folgenabschätzung vor der Änderung | ✅ Tief | ◐ Flach | ◐ Nur für Sicherheitszwecke | ◐ Nur für Sicherheitszwecke | ◐ Portfolio | ◐ Strukturell | ◐ Nur für Sicherheitszwecke | ◐ Codeebene | ◐ Codeebene | ◐ Codeebene | ◐ Governance |

| Sicherheitslückenerkennung (SAST) | ◐ Kontextbezogen | ◐ Grundlegend | ✅ Stark | ✅ Stark | ◐ Richtwert | ❌ Nein | ✅ Stark | ◐ Begrenzt | ◐ Begrenzt | ◐ Begrenzt | ◐ Grundlegend |

| Einblick in Leistung und Komplexität | ✅ Tief | ◐ Kennzahlen | ❌ Nein | ❌ Nein | ◐ Aggregat | ◐ Strukturell | ❌ Nein | ◐ Defektbasiert | ◐ Einhaltung | ◐ Defektbasiert | ❌ Nein |

| Analyse der Modernisierungsbereitschaft | ✅ Einheimisch | ❌ Nein | ❌ Nein | ❌ Nein | ✅ Primär | ◐ Strukturell | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein | ❌ Nein |

| Durchsuchen Sie alle Assets | ✅ Fortgeschritten | ◐ Nur Repo | ◐ Nur Repo | ◐ Nur Repo | ◐ Metadaten | ◐ Metadaten | ◐ Nur Repo | ◐ Nur Repo | ◐ Nur Repo | ◐ Nur Repo | ◐ Nur Repo |

| CI / CD-Integration | ◐ Optional | ✅ Stark | ✅ Stark | ◐ Mittel | ❌ Nein | ❌ Nein | ✅ Stark | ◐ Mittel | ◐ Mittel | ◐ Mittel | ✅ Einheimisch |

| Erstellung von prüfungsfähigen Nachweisen | ✅ Einheimisch | ◐ Begrenzt | ◐ Begrenzt | ✅ Stark | ◐ Aggregat | ◐ Strukturell | ◐ Begrenzt | ◐ Begrenzt | ✅ Stark | ◐ Begrenzt | ◐ Stark |

Andere statische Codeanalyse-Tools (eingeschränkte Anwendbarkeit in Unternehmen)

- ESLint

- Vorteile: Sorgt für die Einhaltung von Codierungsstandards in JavaScript und TypeScript mit schnellem Entwickler-Feedback.

- Einschränkungen: Funktioniert auf Repository-Ebene ohne Transparenz hinsichtlich systemübergreifender oder unternehmensweiter Auswirkungen.

- PMD

- Vorteile: Erkennt häufig auftretende Codequalitätsprobleme in verschiedenen Programmiersprachen.

- Einschränkungen: Regelbasierte Analysen sind für große, heterogene Unternehmensbestände ungeeignet.

- Flake8

- Vorteile: Leichtgewichtige statische Analyse zur Durchsetzung von Python-Syntax und -Stil.

- Einschränkungen: Bietet keine Einblicke auf Architektur- oder Ausführungsebene.

- Räuber

- Vorteile: Identifiziert Sicherheitsprobleme in Python-Code mittels musterbasierter Analyse.

- Einschränkungen: Eingeschränkter Fokus und kein Verständnis für die Wechselwirkungen zwischen Unternehmenssystemen.

- CodeQL

- Vorteile: Abfragebasierte Analyse zur Identifizierung komplexer Schwachstellenmuster.

- Einschränkungen: Erfordert spezialisiertes Fachwissen und bietet keine unternehmensweite Umsetzungsmodellierung.

- Semgrep

- Vorteile: Schnelle, individuell anpassbare Mustererkennung für Sicherheits- und Qualitätsprüfungen.

- Einschränkungen: Der musterorientierte Ansatz vernachlässigt Abhängigkeiten und Verhaltenskontext.

- Snyk-Code

- Vorteile: Entwicklerfreundliche statische Analyse, integriert in Cloud-native Workflows.

- Einschränkungen: Der Fokus liegt eher auf der Sicherheit auf Anwendungsebene als auf der Unternehmensarchitektur.

- Pylint

- Vorteile: Bietet detaillierte Codequalitätsprüfungen für Python-Projekte.

- Einschränkungen: Nicht für projektübergreifende oder plattformübergreifende Analysen konzipiert.

- Cppcheck

- Vorteile: Open-Source-statische Analyse für C und C++ mit niedriger Falsch-Positiv-Rate.

- Einschränkungen: Begrenzte Skalierbarkeit und eingeschränkte Unterstützung der Unternehmensführung.

- Infer

- Vorteile: Erkennt Speicher- und Parallelitätsprobleme mithilfe fortschrittlicher Analysetechniken.

- Einschränkungen: Eingeschränkte Sprachunterstützung und begrenzte Unternehmensintegration.

- LGTM

- Vorteile: Kombiniert statische Analyse mit cloudbasierten Code-Review-Workflows.

- Einschränkungen: Repository-zentriert mit begrenztem Einblick in das System.

- FxCop-Analysatoren

- Vorteile: Setzt Design- und Codierungsrichtlinien für .NET-Anwendungen durch.

- Einschränkungen: Berücksichtigt keine anwendungsübergreifenden Abhängigkeiten.

- PHPCS

- Vorteile: Sorgt für die Einhaltung von Codierungsstandards in PHP-Projekten.

- Einschränkungen: Stilorientiert mit minimaler analytischer Tiefe.

- SpotBugs

- Vorteile: Identifiziert häufige Fehlermuster im Java-Bytecode.

- Einschränkungen: Musterbasierte Erkennung ohne Modellierung des Ausführungspfads.

- Bremser

- Vorteile: Spezialisierte Sicherheitsprüfung für Ruby on Rails-Anwendungen.

- Einschränkungen: Frameworkspezifisch und ungeeignet für unternehmensweite Analysen.

- ReSharper-Befehlszeilenwerkzeuge

- Vorteile: Integriert statische Analysen in .NET-Build-Pipelines.

- Einschränkungen: Fokus auf Entwicklerproduktivität statt auf unternehmensweite Erkenntnisse.

- DeepSource

- Vorteile: Automatisierte Codeüberprüfung und Qualitätsanalyse für moderne Repositories.

- Einschränkungen: SaaS-zentriert mit begrenzter Tiefe der Strukturanalyse.

- Codacy

- Vorteile: Zentralisierte Qualitätsberichterstattung über mehrere Repositories hinweg.

- Einschränkungen: Fokus auf Aggregation ohne tiefes Systemverständnis.

- Sonatype Lift

- Vorteile: Sicherheits- und Qualitätsprüfungen sind in DevOps-Workflows integriert.

- Einschränkungen: Eingeschränkte Transparenz hinsichtlich des Laufzeitverhaltens und bestehender Systeme.

- NDepend

- Vorteile: Bietet Abhängigkeitsanalyse für .NET-Anwendungen.

- Einschränkungen: Technologiespezifisch und nicht geeignet für heterogene Immobilienbestände.

- Coverity Scan (Open Source)

- Vorteile: Kostenlose statische Analyse für ausgewählte Open-Source-Projekte.

- Einschränkungen: Nicht repräsentativ für Einsatzszenarien in Unternehmen.

- OWASP-Abhängigkeits-Check

- Vorteile: Identifiziert bekannte Schwachstellen.